처음 참여한 대형 컨퍼런스라 무척 떨렸다. 현장 분위기는 기대 이상이었다. 음식은 훌륭했고, 유명 연사도 여럿 만나고, 사은품도 넉넉히 챙겼다. 알찬 내용까지 머릿속에 가득 담고 돌아와 정말 행복했다.

다만 대부분의 발표와 자료가 영어로 진행된 점은 조금 당황스러웠다. 수능·토익으로 익힌 영어만으로는 100% 이해하기에 역부족이었다. 그래도 귀를 쫑긋 세우고 끝까지 집중하며 최대한 이해하려고 노력했다.

리눅스 재단 이사 짐 젤린 인터뷰

이 분 목소리 처음 듣는데 성우인 줄 알았다. 흡입력있는 목소리랄까?

그리고 영어 발음 또한 수능 영어에 나오는 거처럼 엄청 또박또박 명확하게 발음하셨다. 영어를 잘하지 못한 나 같은 사람을 위해 배려해주신 느낌이 났다.

첫 번째, 두 번째 날 모두 다녀오고 지금 후기를 작성하면서 다시 곱씹어봐도 가장 인상깊었던건 짐 젤린의 인터뷰였던거 같다.

- 현재의 AI 버블은 데이터센터, GPU 등 인프라 리소스 중심으로 형성됨.

- 오픈소스는 인프라 자체보다는 모델 및 소프트웨어 계층에서 혁신을 주도.

- 향후 목표는 하드웨어 성능을 최대한 활용하는 저비용·고효율 AI 모델 개발.

- OSS 커뮤니티는 특히 비용이 큰 AI Agent 생태계를 혁신할 수 있는 MCP, A2A, AgentGateway 프로젝트에 집중할 전망.

짐 젤린의 발언을 통해서 AI 시대 속에서 오픈소스의 중요성을 다시금 깨닫게 해주었고, 개발자로서 오픈소스 생태계에 기여해야 하는 이유를 분명히 느낄 수 있었습니다.

KT Cloud CTO 안재석 인터뷰

ref: https://www.todaymild.com/news/articleView.html?idxno=21946

차세대 클라우드 플랫폼 ‘NEXT’를 공개하면서 KT cloud 의 기술 방향, 그리고 오픈소스에 기여도를 언급하였다.

발표 기다리면서 앉아있었는데 KT Cloud 가 다이아몬드 스폰서였던 점, 그리고 부스에서 설명들었던 'Dev Rel' 등 얘기를 들어보니 KT Cloud 가 오픈소스에 진심이구나 느꼈다.

- “OpenStack + Kubernetes” 조합의 중요성 부각.

- KT Cloud 사례를 통해 오픈소스 클라우드 인프라의 상용 활용이 강조됨.

- 이제는 “학습보다 추론이 중요한 세상”으로 변화.

- NVIDIA 독점 구조 완화, 다양한 벤더(GPU/가속기) 유입 가능성 확대.

- 결과적으로 멀티 벤더 환경에서의 효율적 오픈 인프라 운영이 핵심 과제로 제시됨.

AI미래기획수석 하정우 인터뷰

대한민국에서 요즘 핫한 인물 하정우를 영접한 순간이였다. 과거 회사에서 따로 초청하여 온라인으로 AI 강연을 들었는데 이번에 오프라인으로 처음 강연을 들어봤다.

대한민국 AI 에 정말 진심이고, 미래에 전 세계적으로 상위 수준으로 발달한 대한민국 AI 를 널리 알리고자 하는 마음이 와닿았다.

- LG, Upstage, Naver, SK, NC 등 5대 기업이 자체 모델 개발을 주도.

- 정부가 제공한 NVIDIA 칩 기반 인프라로 국산 AI 모델 혁신을 추진 중.

- 목표는 “AI 기술 소비국 → AI 생태계 기여국”으로 전환.

- 개별 모델 개발뿐 아니라, 오픈소스 중심의 협력형 AI 생태계를 구축할 계획.

MCP 튜토리얼: AgentGateway로 확장하는 멀티 에이전트 시스템

이번 LF OSS 에서 처음으로 듣게된 강연이였다. 주제는 MCP 튜토리얼이였지만 실제 내용은 MCP, A2A 프로토콜에 대한 개념 설명, 그리고 ADK 를 이용한 개발, 마지막으로 AgentGateway 소개 및 적용(+ 장점)을 소개하였다.

이전에 MCP 에 대해서 얼추 알고 있었지만 이번 강연을 토대로 AI 관련 프로토콜, 그리고 에이전트 개념에 대해 명확하게 이해할 수 있었다.

1. AI Agent의 진화 과정 (Evolution of AI Agents)

- LLM (단일 모델 기반)

- 기본적인 텍스트 생성

- 한계: 할루시네이션(Hallucination) 발생

- LLM + Prompt

- 프롬프트 엔지니어링으로 개선

- 여전히 지식 한계(Knowledge cutoff) 및 데이터 부족(Data limitation) 존재

- LLM + Retrieval (RAG)

- 외부 데이터(인터넷, 사설 스토리지) 활용 가능

- LLM + Retrieval + Actions (Tools)

- API 및 함수 호출 기능 추가

- LLM + Tools + Reasoning Loop

- 다중 툴 및 추론 루프 기반 에이전트 구조로 발전

- Multi-Agent System

- 여러 에이전트가 협력하여 복잡한 작업을 수행하는 단계

2. MCP, ADK, A2A 그리고 AgentGateway

2-1) 왜 MCP 서버가 등장했을까?

기존 AI 에이전트 개발에서는 같은 기능의 도구(tools) 를 프레임워크마다 반복 구현, 유지보수는 복잡하고, 보안도 불안정하다. 이를 해결하기 위해 MCP (Model Context Protocol) 개념이 등장하였다.

AI 세계의 USB-C 표준처럼, 에이전트와 외부 시스템을 표준화된 방식으로 연결해주는 프로토콜

MCP의 핵심 역할:

- 도구를 중앙 서버로 관리 (FastMCP 등)

- 에이전트 간 재사용 가능

- 표준화된 인터페이스로 통합

[Agent 1] →

↘

[MCP Server] → [Weather API / Exchange API / Holiday API]

↗

[Agent 2] →2-2) 멀티 에이전트란?

단일 AI 모델이 모든 일을 처리하기엔 한계가 있다. 그래서 등장한 것이 Multi-Agent System. 즉, 서로 다른 전문성을 가진 에이전트들이 협력해 복잡한 문제를 해결한다.

예시:

[Travel Agent]

├── [Country Agent] → 국가 정보, 날씨, 공휴일

└── [Exchange Agent] → 환율 계산2-3) A2A (Agent-to-Agent) 프로토콜의 등장

멀티 에이전트가 많아지면서, 에이전트 간 통신 표준이 (MCP 처럼) 필요해졌고, Google A2A 프로토콜이 등장하였다.

"한 에이전트가 다른 원격(Remote) 에이전트에게 안전하게 요청하고 응답받을 수 있도록 하는 통신 규격"

[User] → [Travel Agent] → A2A → [Country Agent Server] → [Exchange Agent]2-4) AgentGateway의 필요성

MCP 서버를 여러 에이전트가 공유하게 되면, 모든 도구에 접근 가능한 보안 취약점이 발생한다. 이를 해결하기 위해 AgentGateway 가 등장.

오픈소스 AI 게이트웨이로, 에이전트 간 통신을 보안, 정책, 관찰성 기준으로 관리

AgentGateway 기능:

- 접근 제어 (에이전트별 도구 권한 설정)

- YAML 기반 정책 관리

- 실시간 모니터링 UI 제공

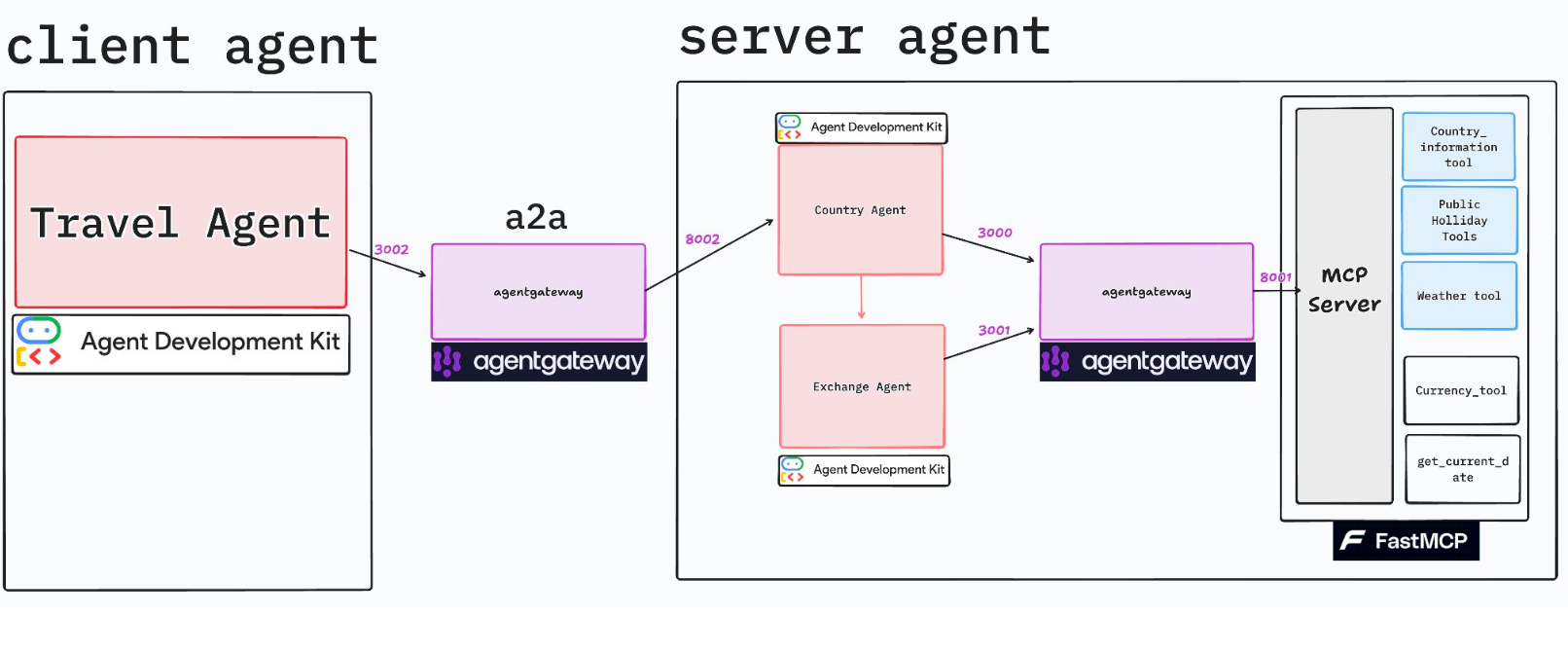

해당 내용 관련해서는 아래 튜토리얼 전체 아키텍쳐 구조를 살펴보면 좋을 거 같다.

3. 튜토리얼

코드는 별도로 제공하였는데 어딨는지 찾을 수가 없다...

전체 아키텍쳐 구조

- Travel Agent 는 agent gateway 를 통해 Country Agent 에게 질문 전달

- Country Agent 는 질문에 대해서 agent gateway 를 통해 MCP 서버의 툴을 사용하여 적절히 답변

- 일단 자신이 전달 가능한 답변에 대해서 MCP 서버를 통해 툴 사용

- 그리고 나머지는 하위 Exchange Agent 에게 전달하고, 서브 에이전트도 마찬가지로 MCP 서버를 통해 툴 사용