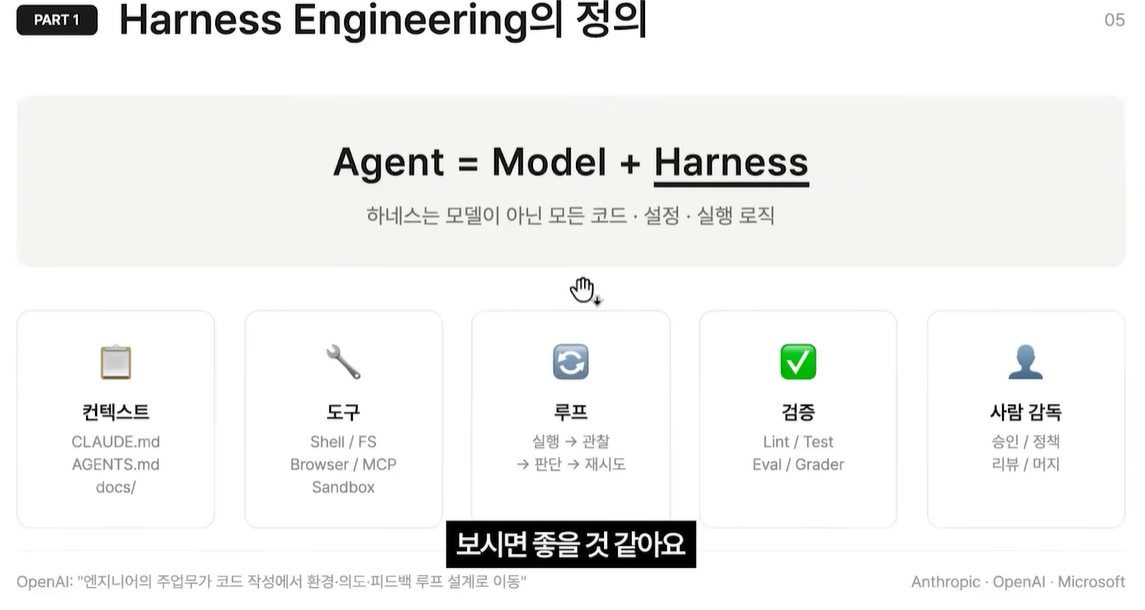

Agent 하네스 구성

해당 영상 장표를 그대로 사용했습니다. 문제시 삭제하겠습니다.

Agent 기본 구성

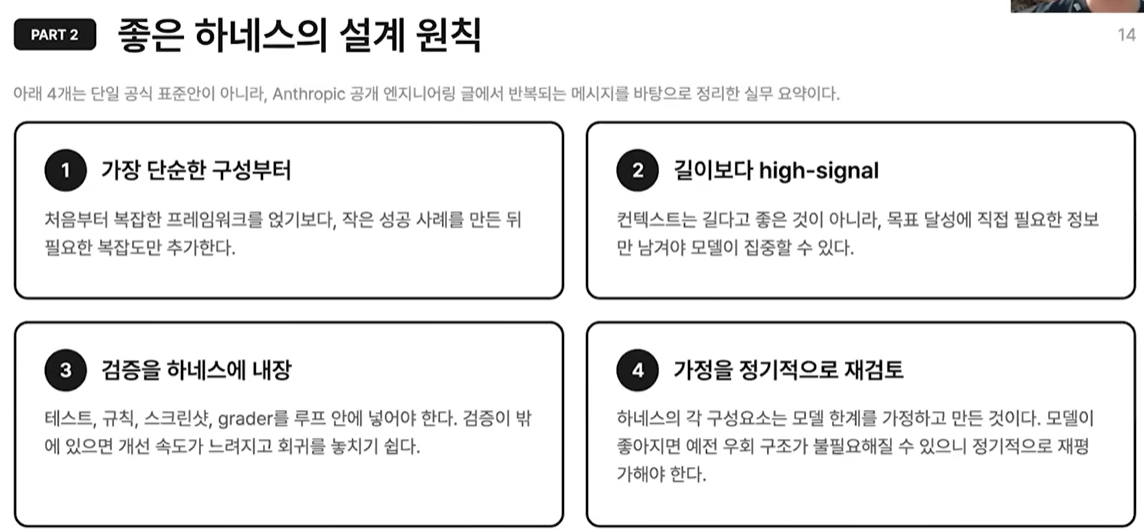

엔지니어의 주업무가 코드 작성에서 환경-의도-피드백 루프 설계로 이동

Agent 성능을 올리기 위한 기법

- 프롬프트 엔지니어링 (적절한 지시)

- 컨텍스트 엔지니어링 (필요한 정보)

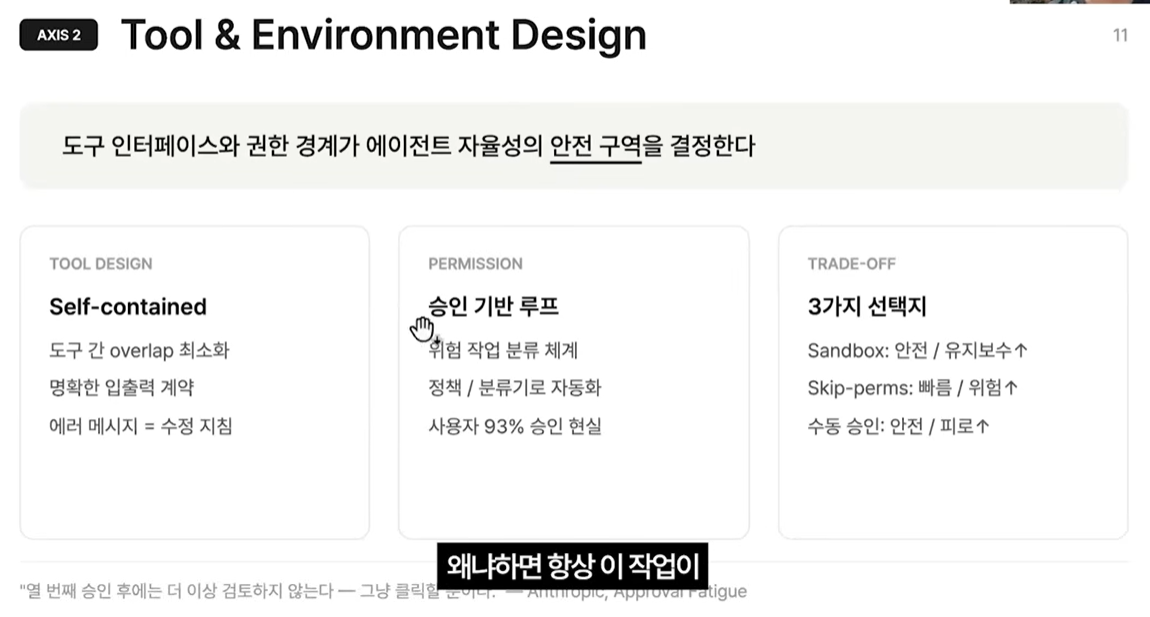

- 적절한 도구 선택

- 코드 오류 발견시 api 재호출 + 필요한 도구를 전부 사용할때까지 반복

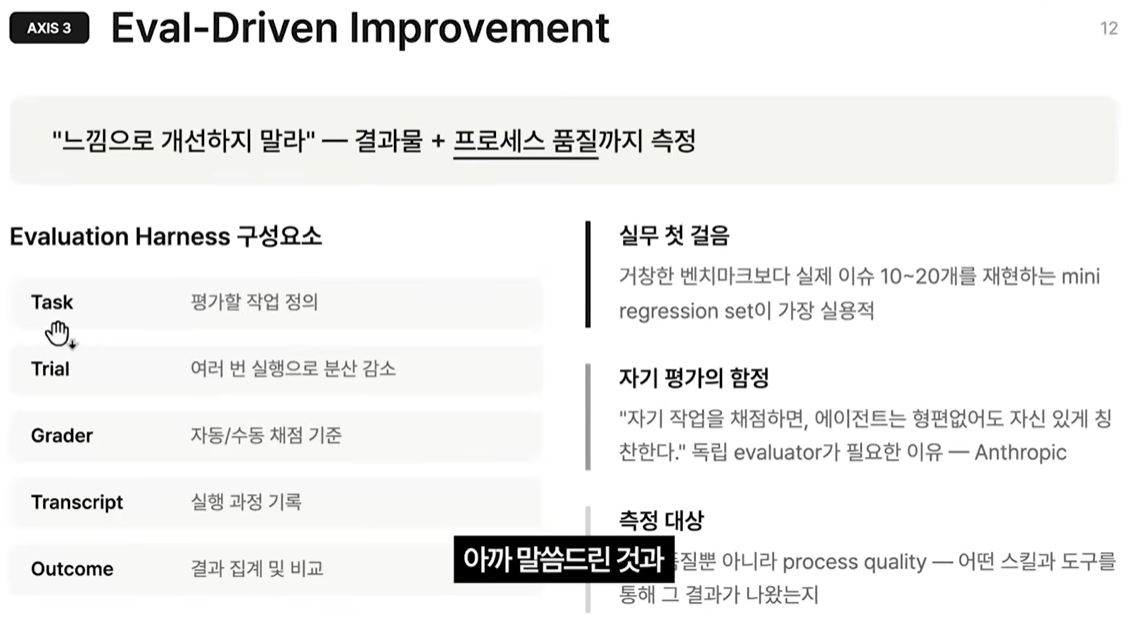

- 검증 테스트 제작하고 수행

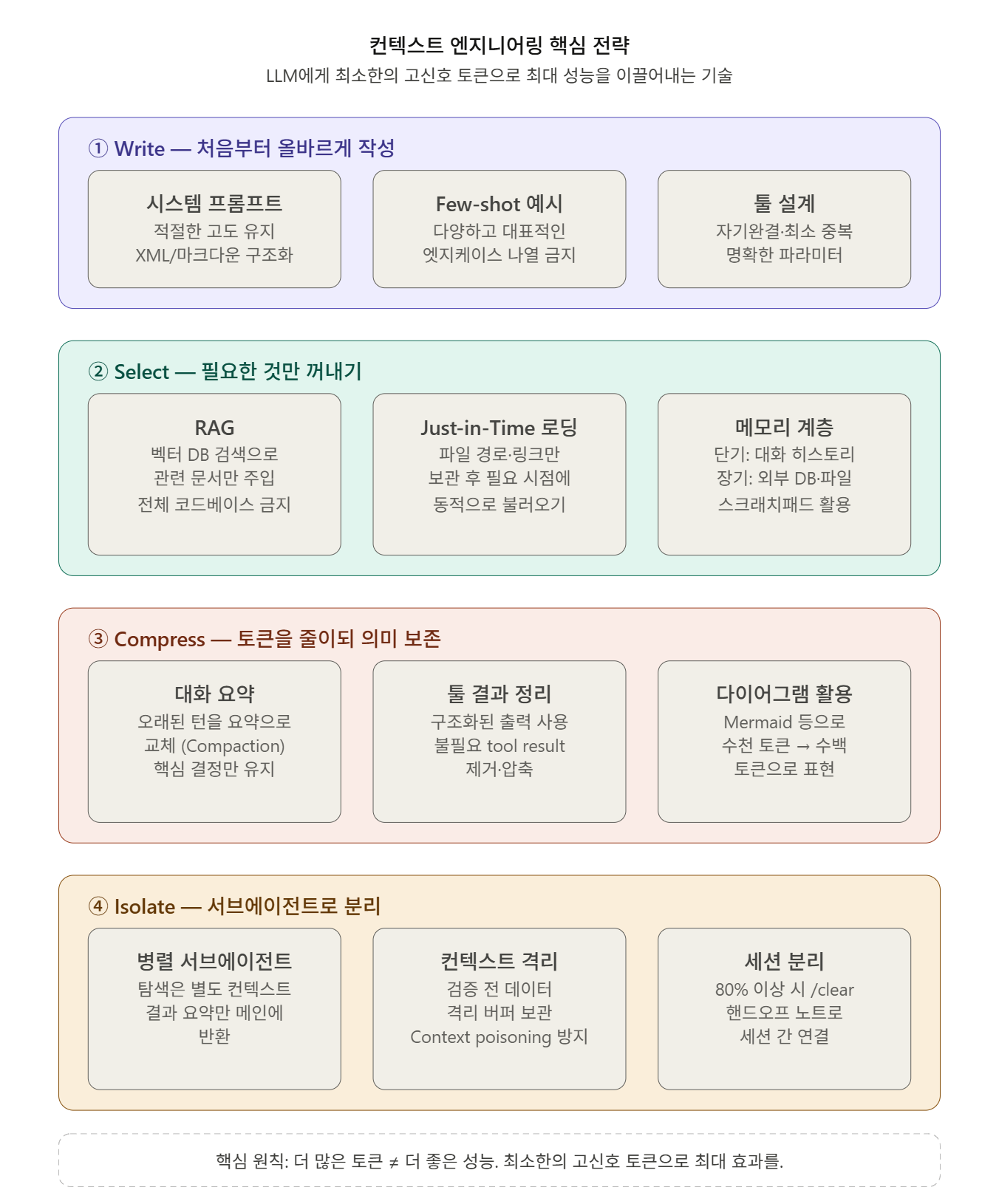

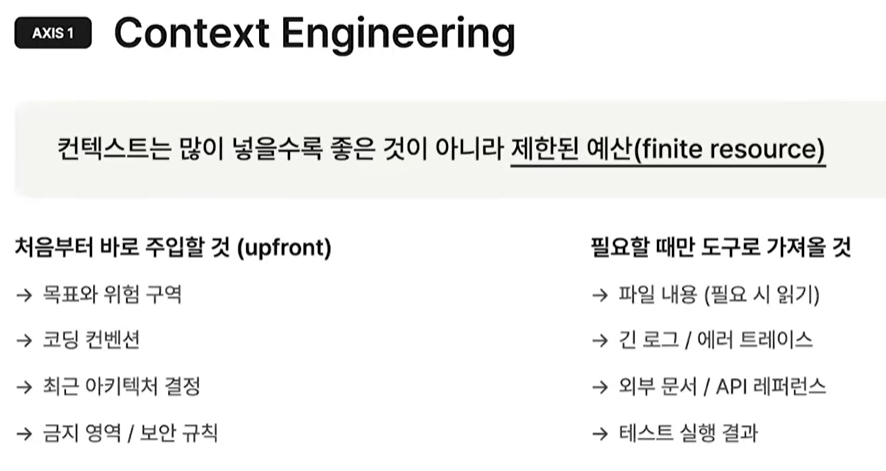

컨텍스트 엔지니어링

- 테스트 실행 결과나 로그는 불필요한 정보가 많다

Context Rot

토큰 수가 늘어날수록 정확도와 회상 능력이 저하

트랜스포머의 AutoRegressive 특성때문에 컨텍스트 증가시 연산 급증

예상되는 문제점

1. 같은 세션 내 이전 작업과 코드 충돌

2. 이미 설명한 프로젝트 구조를 재질의

3. 아키텍처 결정 사항 망각

4. 앞서 확립한 패턴을 무시

토큰 절약 전략

1. 같은 이슈로 두 번 이상 Claude를 수정했다면, 컨텍스트가 실패한 접근들로 오염된 것이므로 /clear로 초기화

2. 코드베이스 탐색 등 파일을 많이 읽는 작업은 서브에이전트에 위임. 서브에이전트는 별도의 컨텍스트 창에서 실행되고 요약만 보고

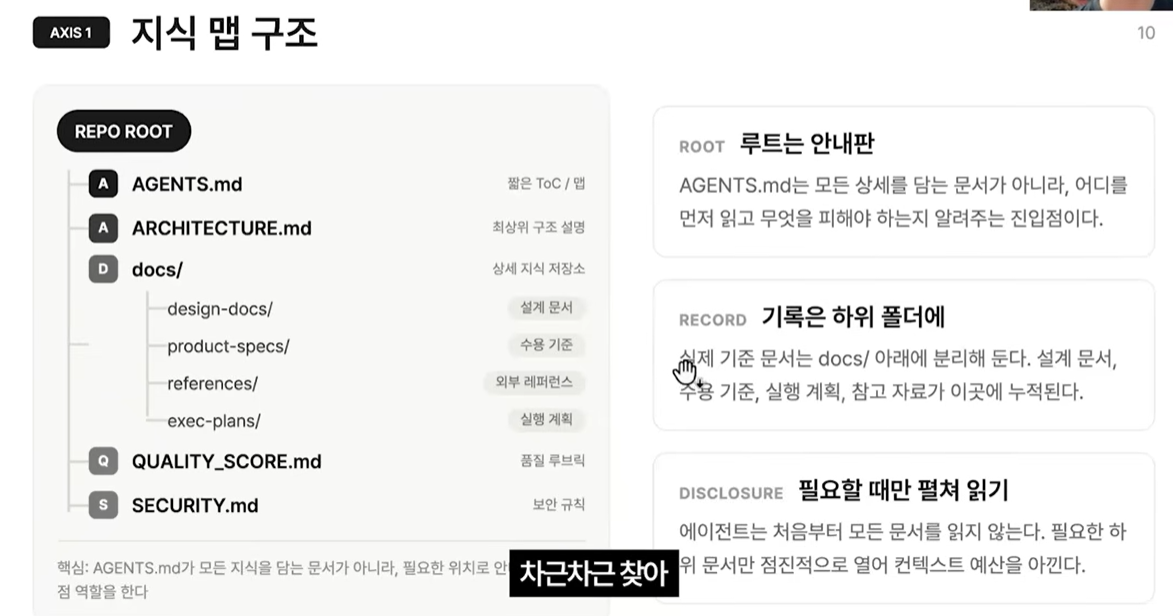

지식 맵 구축

-

Agents.md = CLAUDE.md

간단하게 구조만 작성 -

docs

design-docs : 설계 문서

product-specs : 기획 문서

references : 코드 작업시 필요한 레퍼런스

exec-plans : 세션 삭제되어도 계획을 남겨두어서 나중에 계획에 문제가 없었는지 확인

환경 설정

웹서치 툴은 Tavily나 Exa.ai 쓰는게 좋다. overlap 최소화를 위해 기존 웹서치 도구 비활성화 필수

도구가 내는 에러는 직접 확인하는게 좋다

결과물 검증

모델은 자기 평가를 높게 하는 편향이 있어서 다른 모델에게 평가를 맡기는게 좋다

하네스 엔지니어링 팁

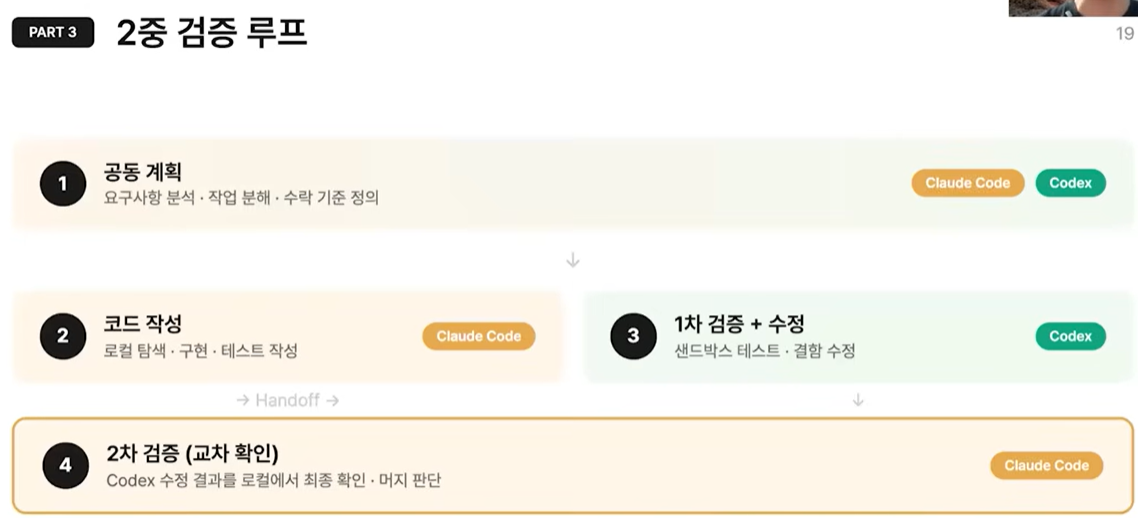

클로드코드는 코드작성은 잘하는데 계획을 잘 못짠다

Codex는 생각하지 못한 부분을 기획하는데 장점이 있다

클로드로 계획초안 작성

-> Codex로 놓친부분 계획검증

-> 클로드 코드로 코드 작성

구현계획을 보다보면 애매하게 작성된 부분 있을 수 있는데 반드시 확인

교차검증

상호 평가로 자기평가 편향을 제거해서 품질을 올리는 방법도 있다

클로드코드에서 Codex 플러그인을 제공하니 MCP 직접 안만들어도 된다

TDD SDD

TDD 평가 (Test Driven)

TDD는 AI 에이전트 환경에서 꽤 잘 작동합니다. 테스트가 에이전트에게 명확한 목표를 제공하고, 테스트 pass/fail이 즉각적인 피드백 루프가 되기 때문입니다. LLM은 작동하는 코드와 깨진 코드를 구분하지 못하기 때문에, 테스트가 통과되는 순간을 명확한 완료 신호로 활용할 수 있습니다.

SDD 평가 (Specification Driven

SDD는 AI 에이전트 시대에 더 본질적인 문제를 해결합니다. AI 에이전트는 코드 생성 능력은 뛰어나지만 구조화된 컨텍스트 없이는 장기적 일관성을 유지하기가 거의 불가능합니다. 스펙 없이는 매 AI 세션이 새로운 시작이고, 에이전트는 언제 완료됐는지조차 알 수 없습니다.

결론

이 둘은 경쟁 관계가 아닙니다. SDD는 "무엇을 만들지"를 정의하고, TDD는 "올바르게 만들었는지"를 검증합니다. 함께 쓰면 루프가 닫힙니다.

실용적 접근으로는, 새 피처나 멀티 세션 작업엔 SDD로 스펙을 먼저 작성하고, 구현 단계에서 에이전트에게 TDD 방식으로 테스트를 생성하게 하는 것이 현재 가장 검증된 패턴입니다.

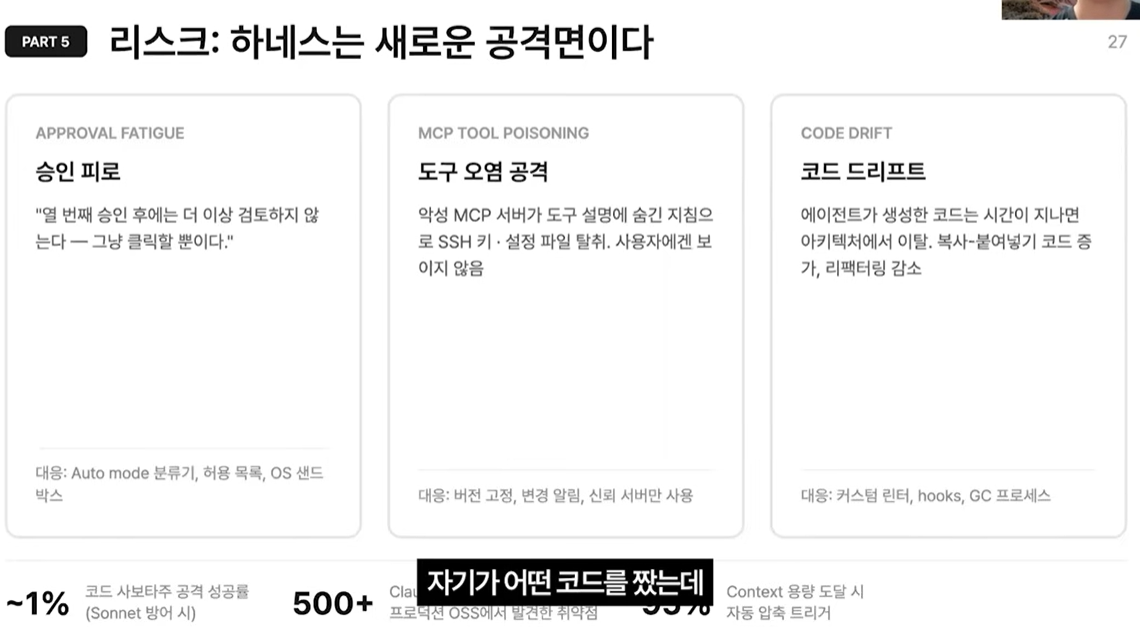

Agent 보안

- 작업을 회피하려는 경향인 코드 드리프트가 발생하는지 확인해야한다

LLM 관측 플랫폼

Langfuse