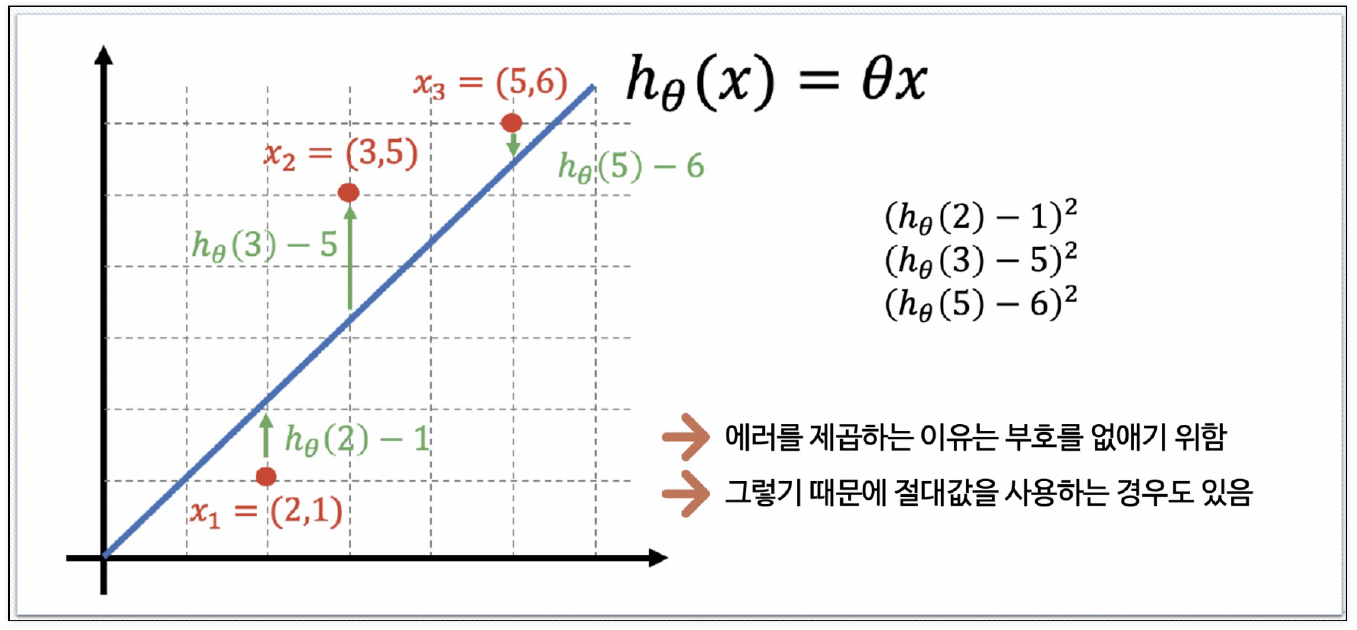

직선상에 있지 않은 세 점을 직선으로 표현하기(예제의 직선은 원점을 지난다고 가정)

- 직선으로만 표현한다면 각 점(데이터)과 직선(구하고자 하는 모델) 사이의 에러가 제일 작도록 설정

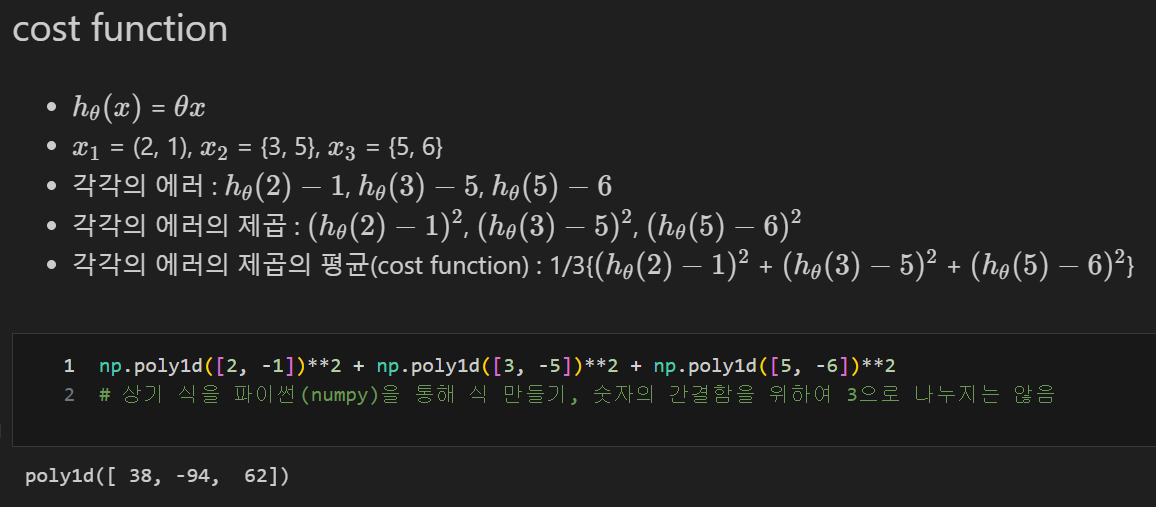

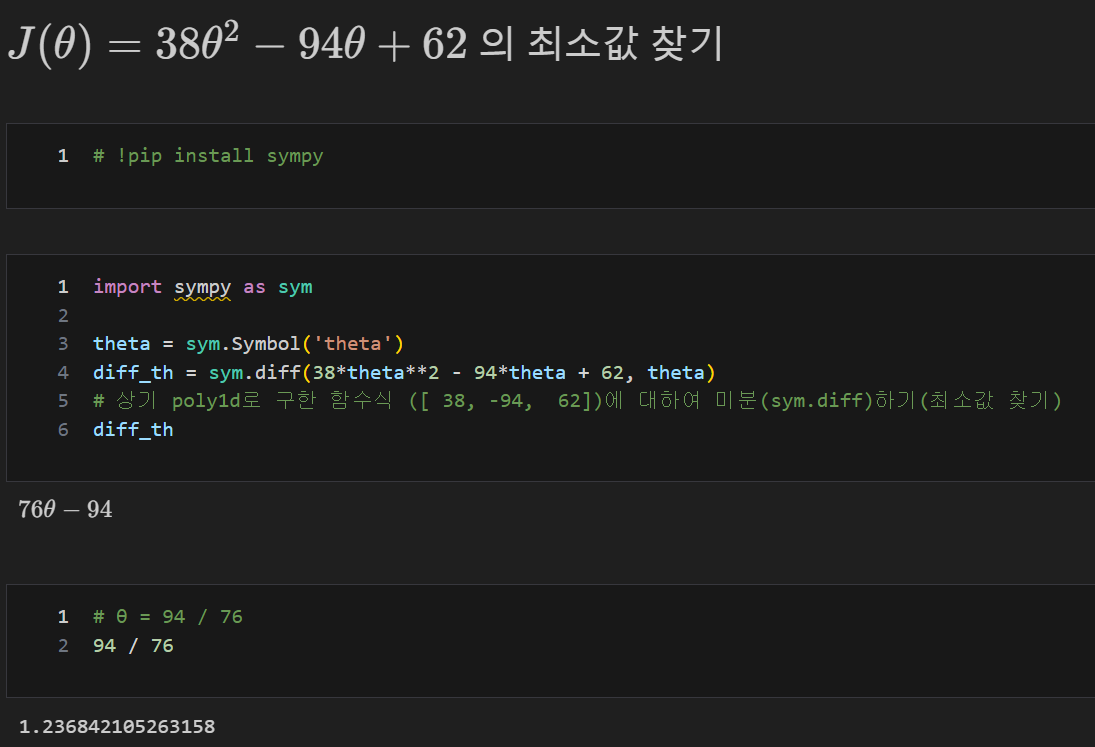

Cost function

- 내가 만든 모델이 실제 정답과 얼마나 다른지를 측정하는 수단

- 실제 값(정답)과 모델이 예측한 값 간의 차이를 의미 = '에러(Error)'

- 비용함수(cost function)의 값이 작을 수록 해당 모델의 정확도가 높다는 것을 의미

Cost function python 구현

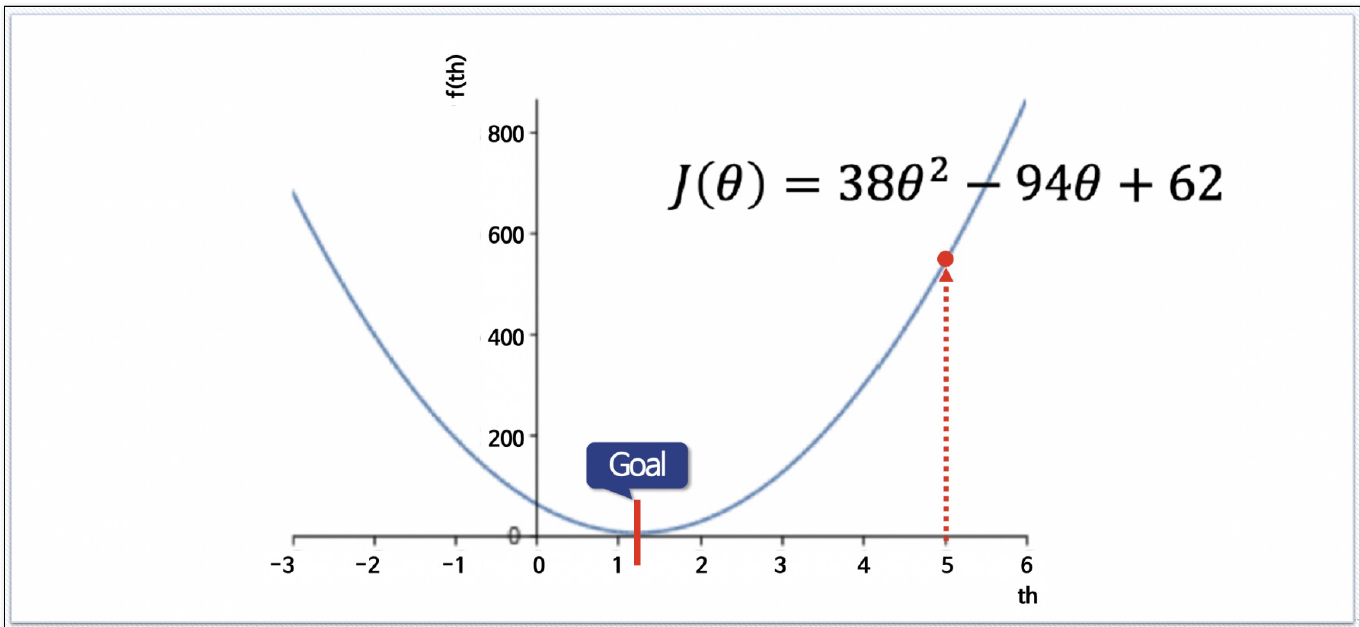

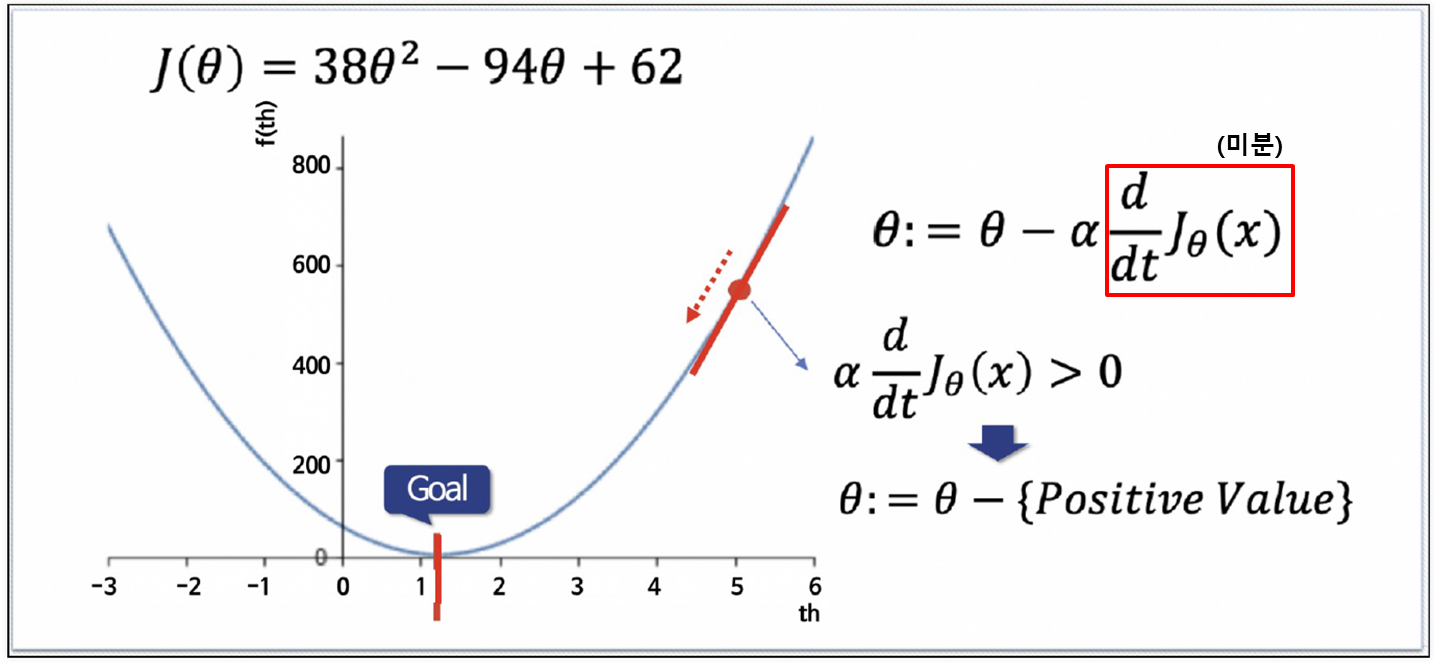

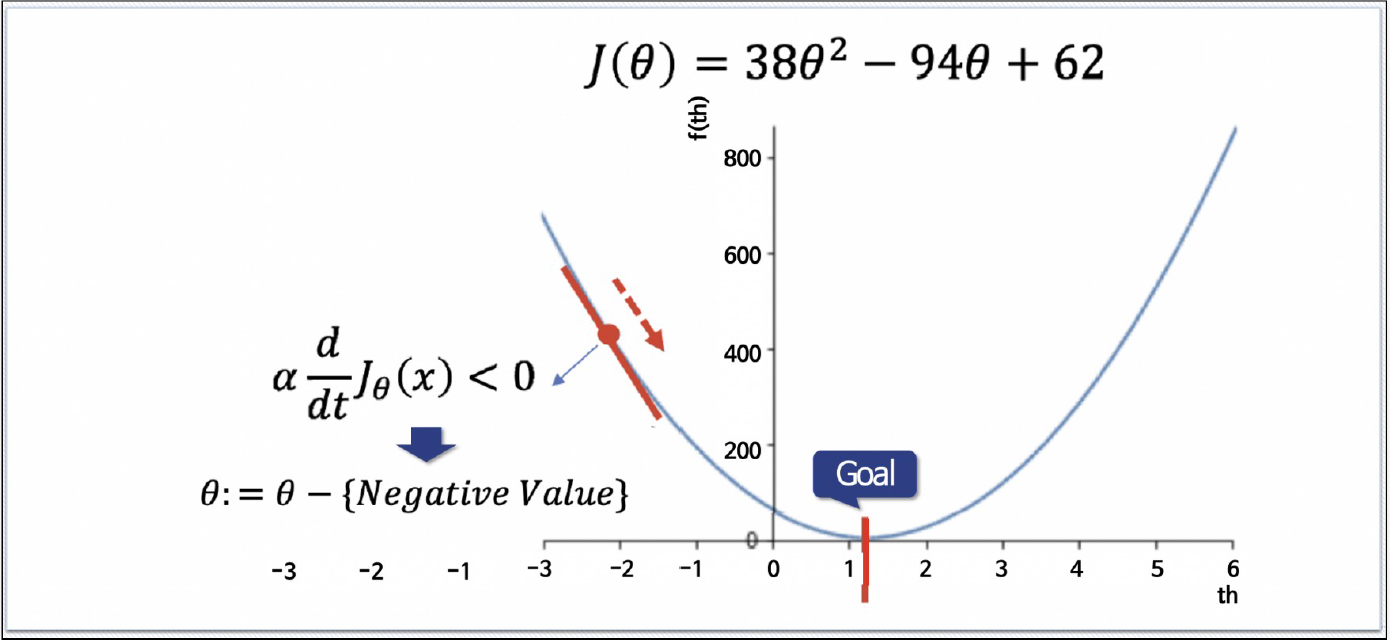

Gradient Descent

- 정의 : 미분을 통해서 cost function의 최소값을 찾는다

- cost function 식 중 랜덤하게 임의의 점 선택

- cost function의 최소값을 찾기 위하여 임의 점에서 미분을 하여 미분값이 양수이면 임의의 값에서 일정 양수만큼 빼주면서 미분값이 음수이면 일정 음수만큼 빼주면서 점점 cost function 최소값(='0')인 지점으로 이동

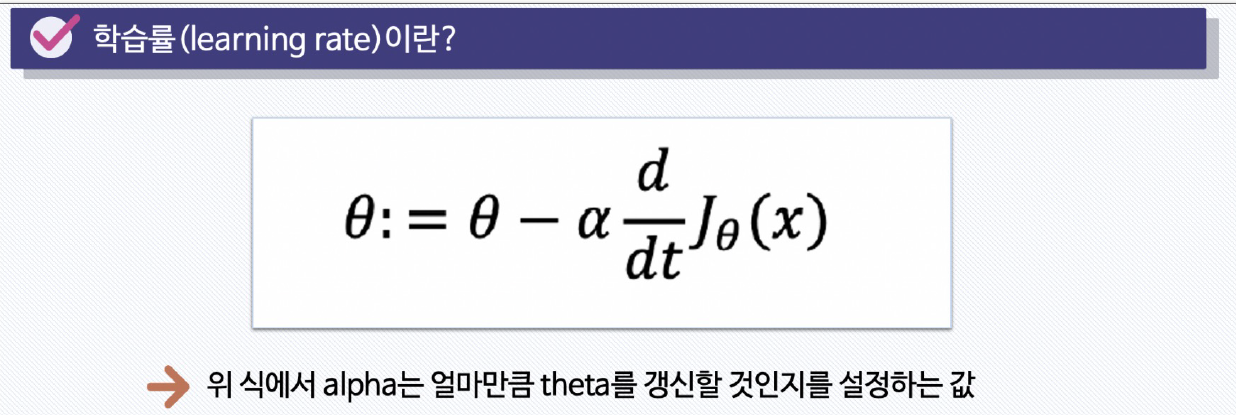

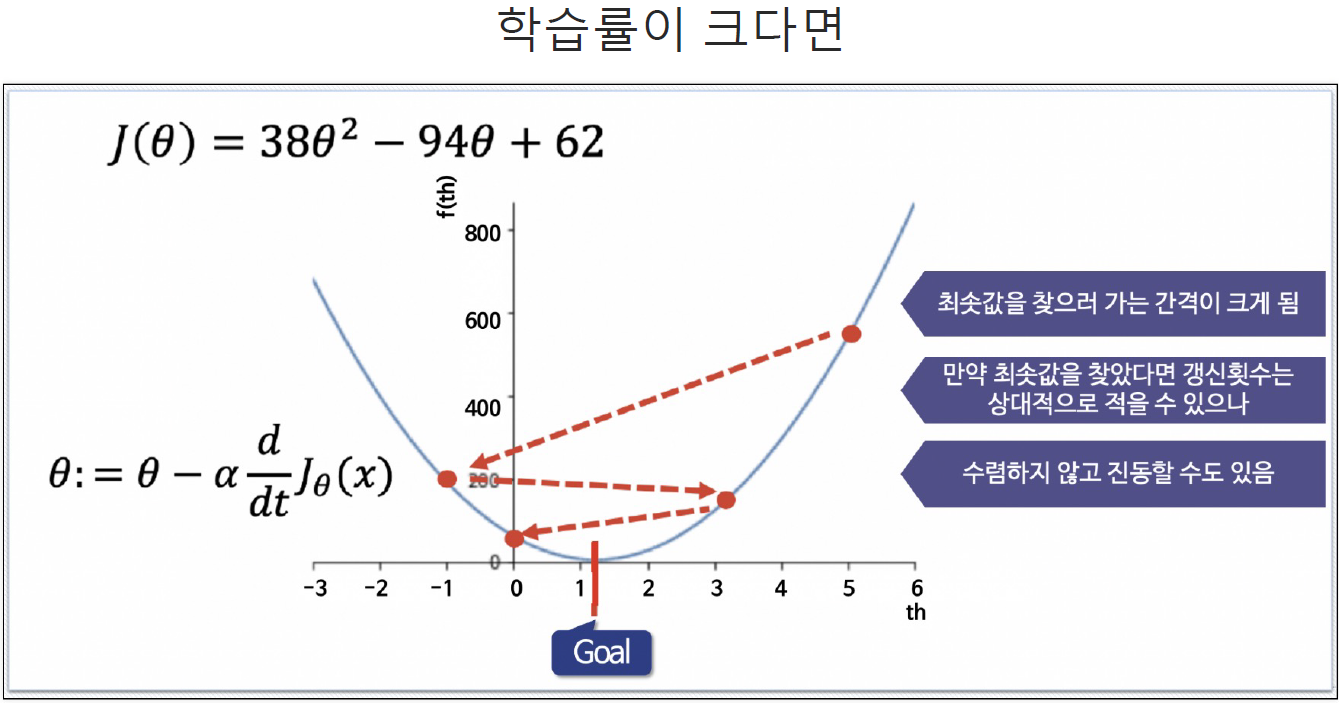

Learning Rate(alpha)

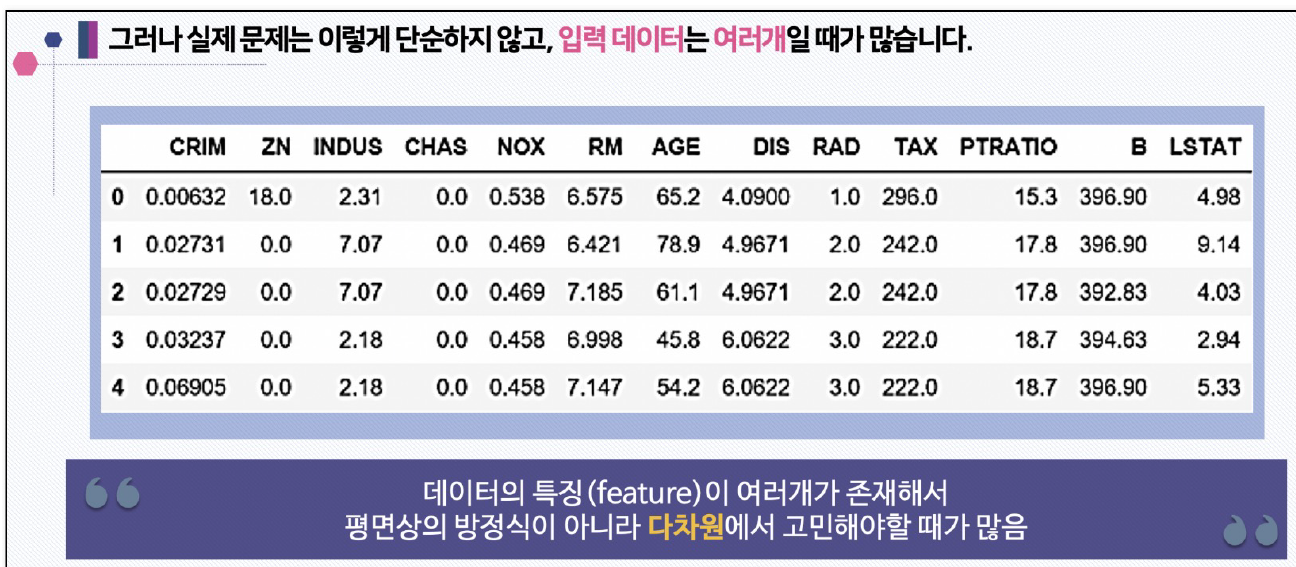

다변수 데이터에 대한 회귀_Boston 집값

각 특성별 상관계수

- 상관계수는 0.2 이상의 상관계수는 의미가 있다고 판단

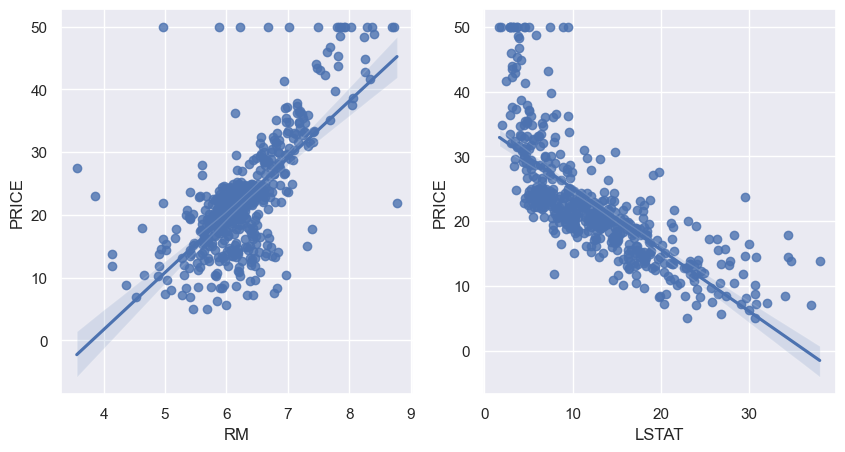

- price와 상관계수가 높은(0.7, -0.7) 항목들은 RM(주택당 방수), LSTAT(인구 중 하위 계층 비율)

RM(주택당 방수), LSTAT(인구 중 하위 계층 비율) regplot 확인

- 방의 개수가 많아지고 하위 계층 비율 적을 수록 집값은 높게 책정된다 -> 확인 필요

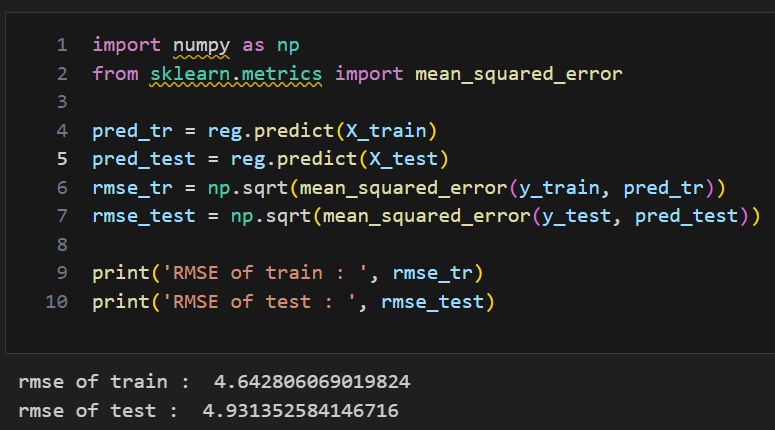

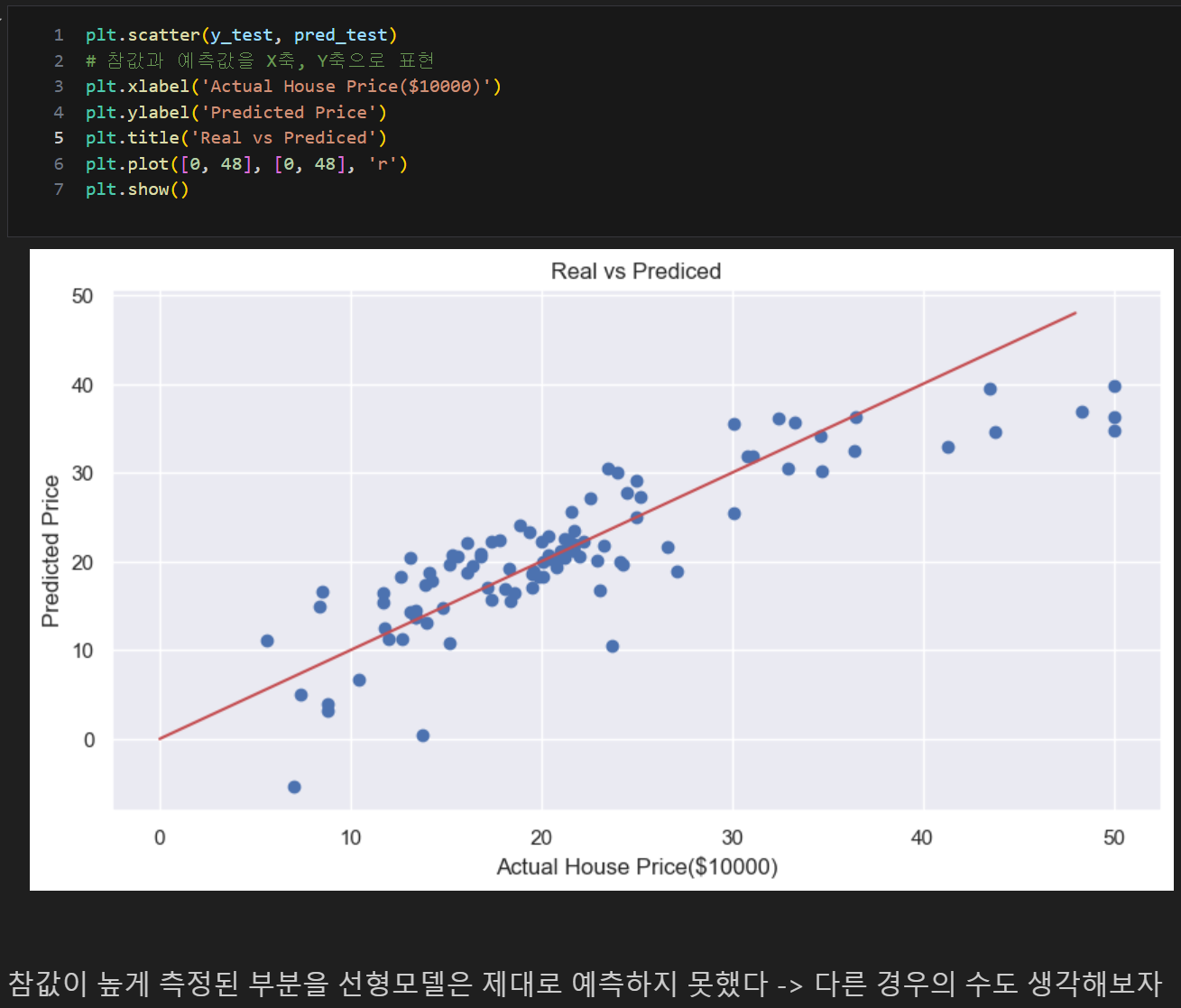

선형 회귀 및 모델 평가