Linear Classifiers

- Linear Classifiers는 Neural Network를 이루는 근간입니다.

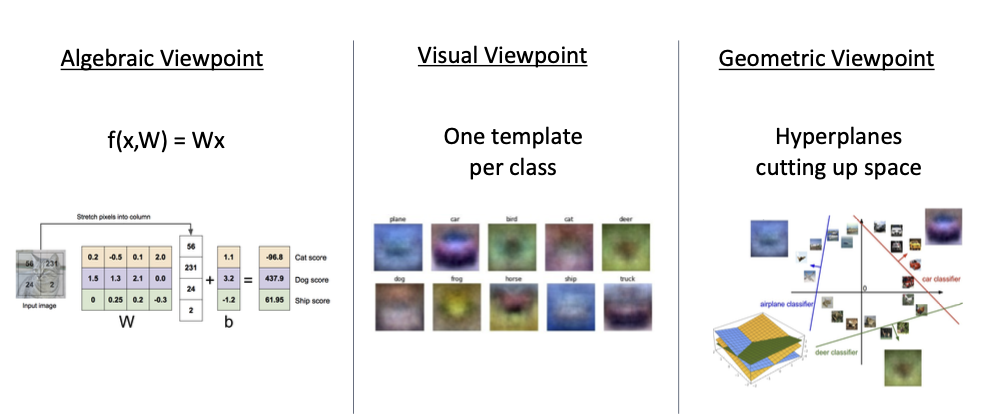

- Linear Classifiers를 생각하는 3가지 방식이 있습니다.

- Algebraic Viewpoint

- VIsual Viewpoint

- Geometric Viewpoint

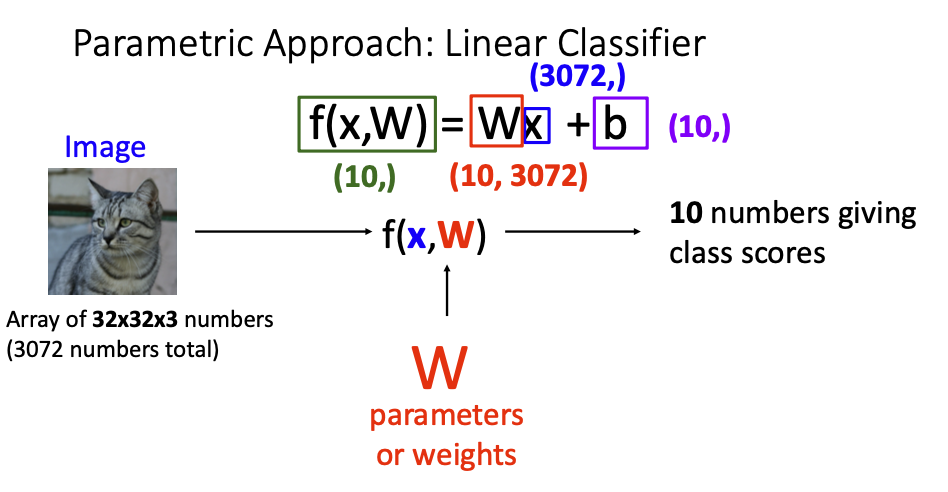

Algebraic Viewpoint

- f(x, W) = Wx로 표현됨

- x는 32x32x3=3072의 각 픽셀데이터이고

- W는 3072픽셀데이터에 대한 weight로 최종적으로 10개의 class에 대한 점수를 보여줌

- b는 bias로 10개 class에 대한 bias를 더해줌

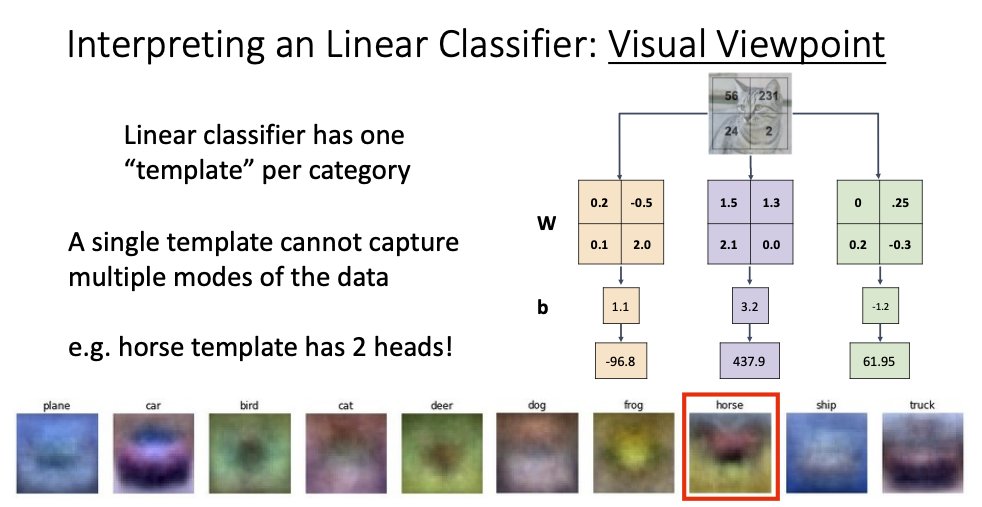

Visual Viewpoint

- One template per class

- 카테고리 하나당 하나의 템플릿으로 인식한다?

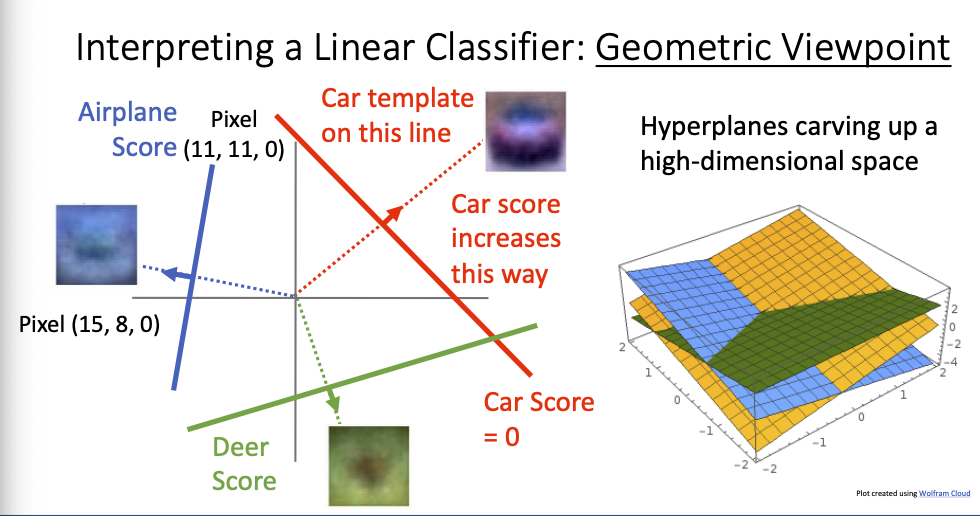

Geometric Viewpoint

- 클래스 간의 공간을 가르는 초평면(Hyperplanes)

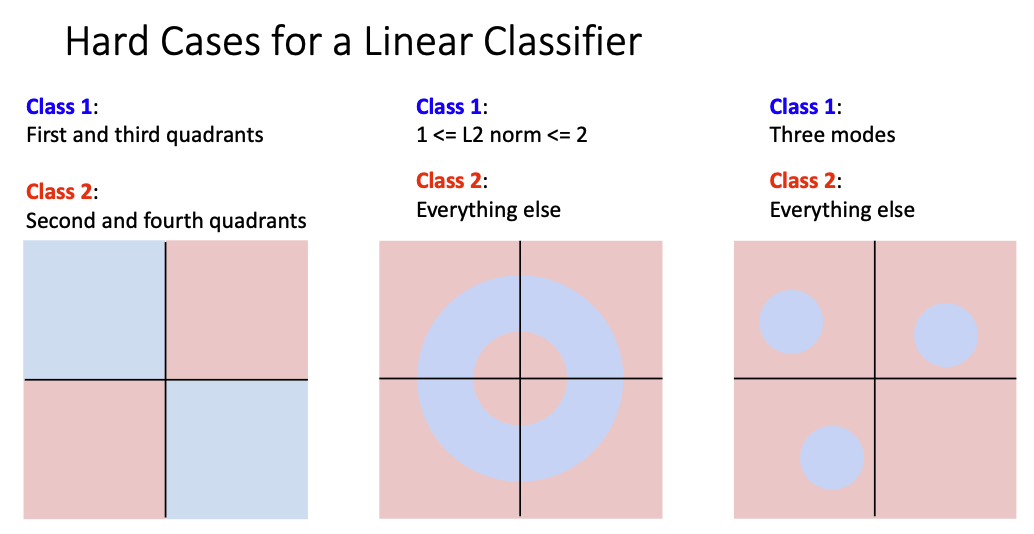

Hard Cases for a linear classifier

- 선형이기 때문에 특별한 모양으로 분포된 데이터에 대해서는 성능을 낼 수 없다.

Choosing a good W

- W값이 얼마나 좋은지를 계산하는

Loss Function을 사용한다. Optimization: loss function을 최소화하는 W를 찾는다.

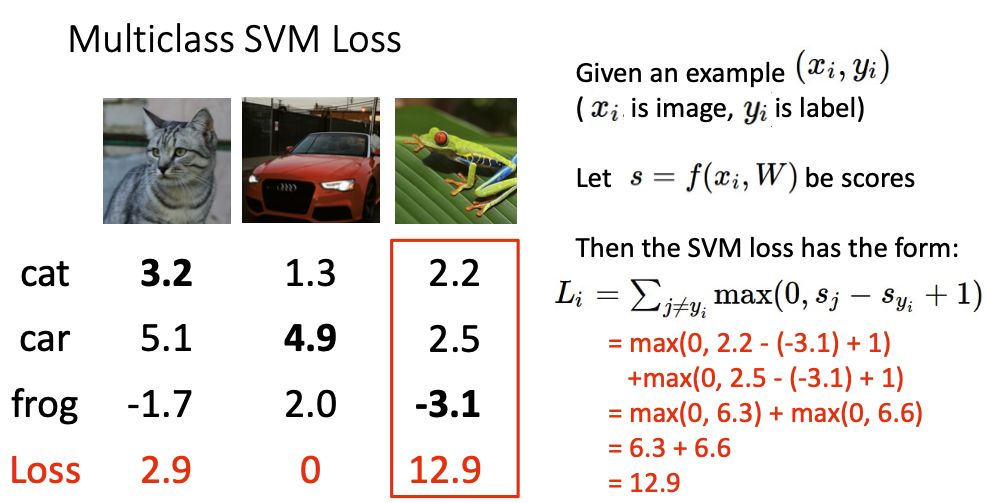

Multiclass SVM Loss

- 각 Loss 계산법

- frog에 대한 loss를 계산한다고 했을 때, frog는 제외하고 나머지 cat과 car에 대해서 max(0, cat - frog + 1) + max(0, car - frog + 1)을 계산한다.

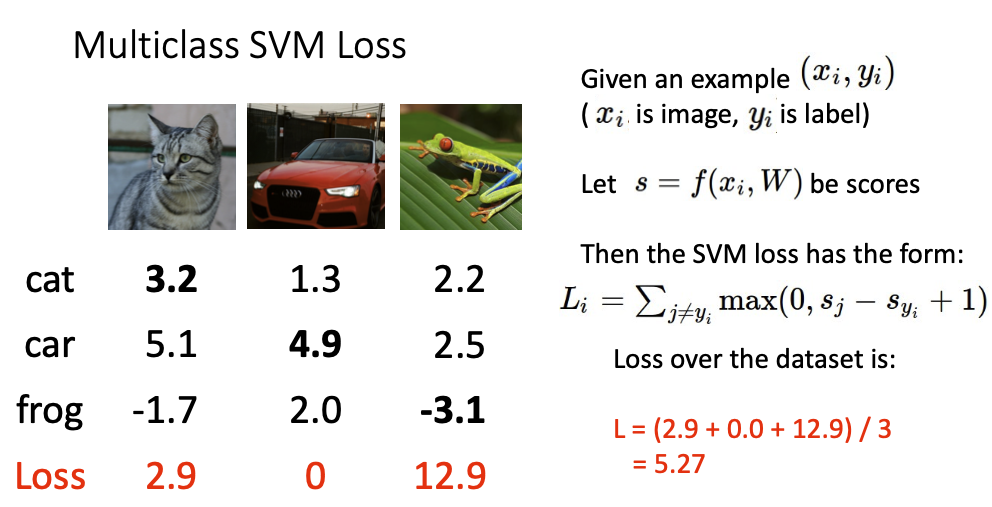

- 평균로스 계산

- 평균 로스는 각 데이터에 대한 로스값을 더해 그 값을 개수로 나누면 된다

- Q) 평균 로스가 0인 W를 찾았는데 이는 유니크한가?

- A) W로 평균로스 0을 만들었으면 2W로도 평균로스 0을 만들 수 있다.

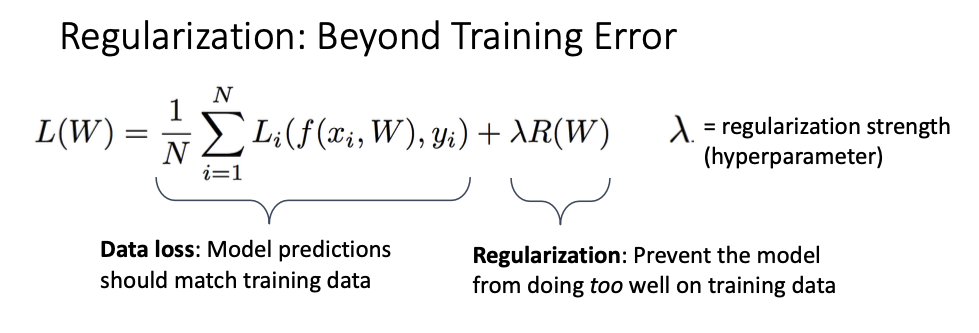

Regularization

- 학습데이터에 오버피팅되는 것을 막음

- train dataset을

일반화시키는데 도움을 줌

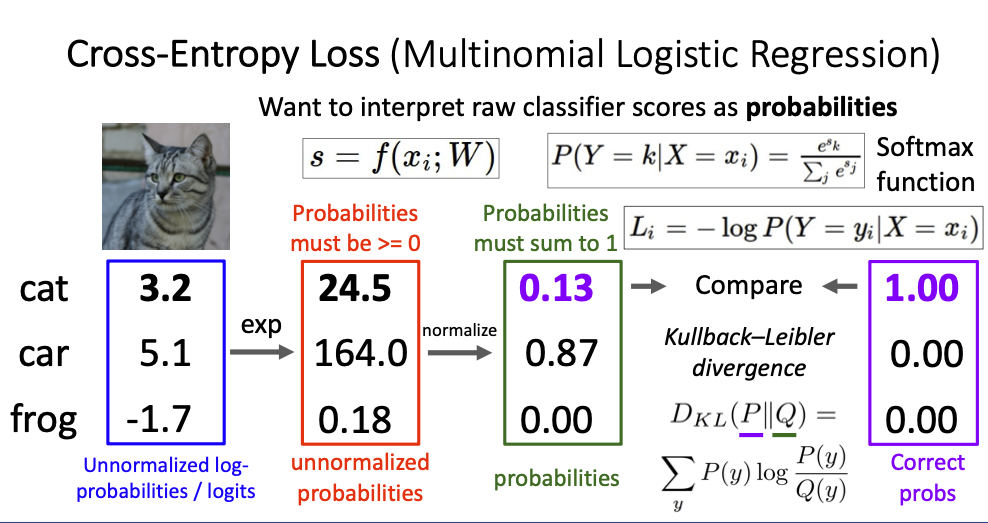

Cross-Entropy Loss

- classifier 점수를 확률로 표현