Optimization

-

Loss Function의 값을 최소로 만드는 weight을 찾는과정

-

Idea

1. Random Search

2. Follow the slope

3. Gradient Descent

4. Stochastic Gradient Descent (SGD)

5. SGD + Momentum

6. Nesterov Momemtum

7. AdaGrad

8. RMSProp

9. Adam

Random Search

- 랜덤한 weight를 이용해서 여러번 테스트

Follow the slope

- 기울기를 구하는 미분을 통해 따라간다.

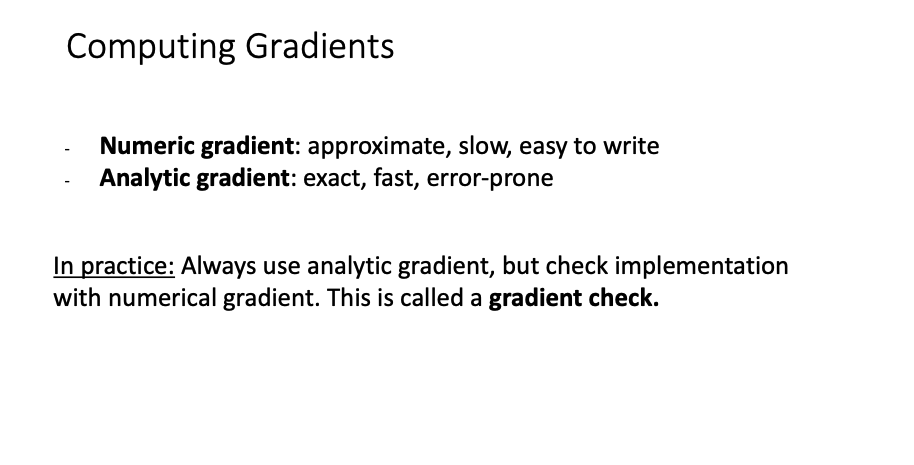

- 미분값을 구하는 두가지 방법: Numeric gradient, Analytic gradient

- Analytic gradient를 사용하되 항상 Numeric gradient로의 구현을 확인한다.

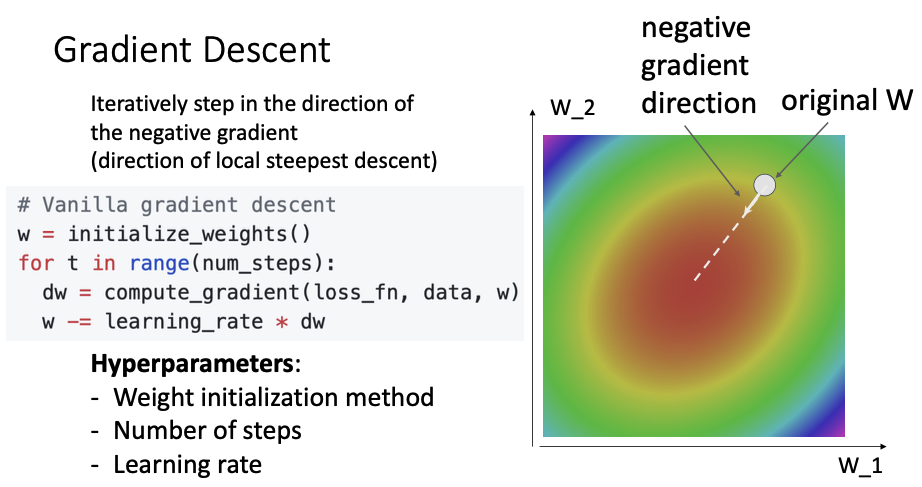

Gradient Descent

- Loss 함수의 제일 깊은 부분으로 따라 내려감

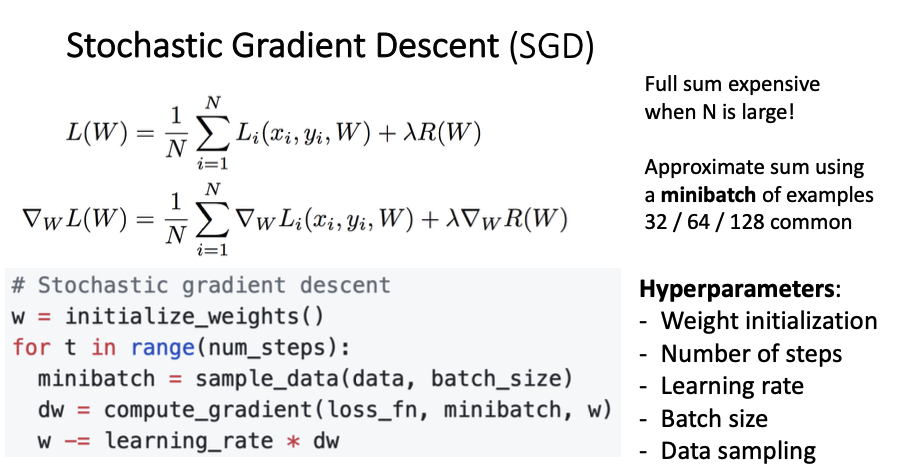

Stochastic Gradient Descent (SGD)

- Gradient Descent는 모든 데이터를 이용해 Loss를 구하지만, SGD는 32,64,128의 샘플을 뽑아 계산함

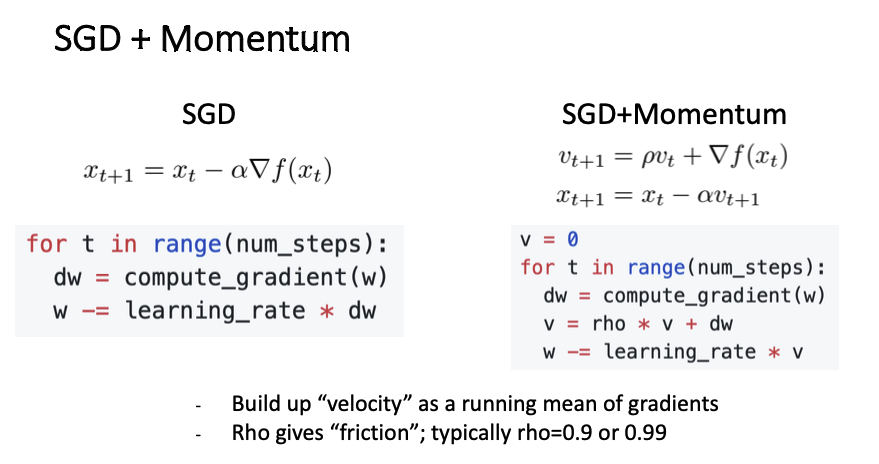

SGD + Momentum

- SGD를 사용하면 Poor Conditioning, Local Minima(지역최소), Saddle Point(평평한 구간)이라는 문제점이 생김

- 이를 해결하기 위해 Momentum을 더해줌

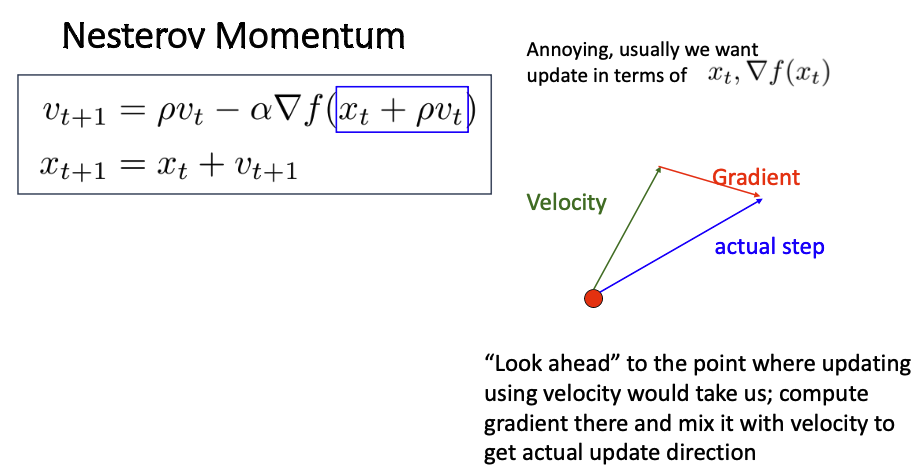

Nesterov Momentum

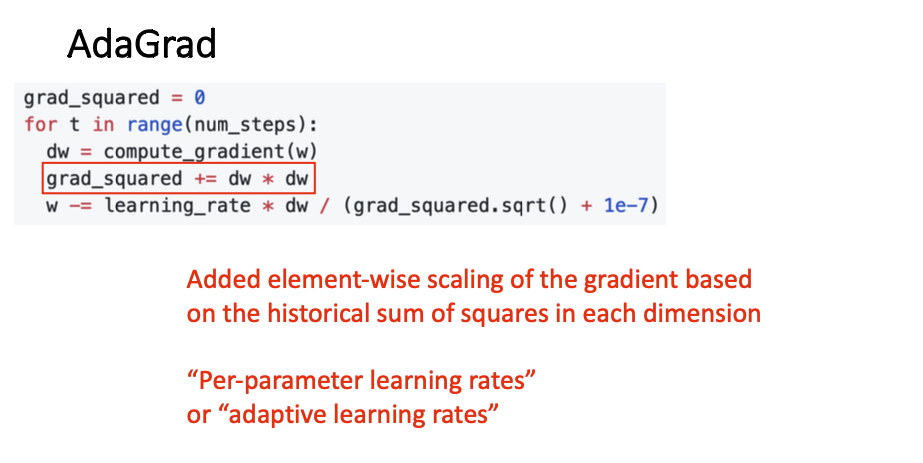

AdaGrad

- 이전의 기록들 저장?

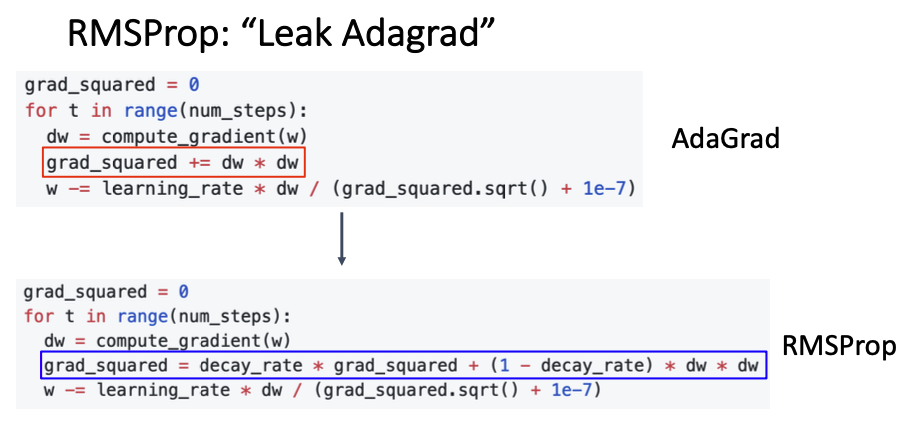

RMSProp

- AdaGrad에 decay rate를 설정

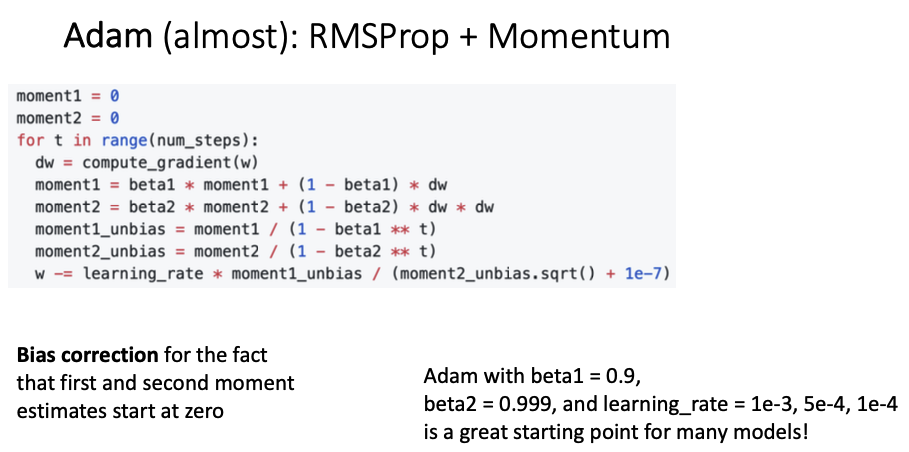

Adam

- RMSProp + Momentum