Original Paper (Arxiv) : ResNet (https://arxiv.org/pdf/1512.03385)

📥Background

VGGNet

- 매우 작은 필터를 사용함으로써 파라미터 개수가 감소했고, 비선형성이 증가하여 더 복잡한 패턴도 학습할 수 있음.

- 선행 모델들보다 층을 매우 깊게 쌓음으로써 성능 향상을 확인했음.

etc.

- 저자 중 한 사람인 Kaiming He가 He 초기값을 제안한 그 He임.

📄Paper Review

🚨해당 논문은 Introduction에 핵심 개념을 모두 설명하고 이후 본론에서는 실험 결과를 위주로 증명하는 방식으로 전개됩니다. 따라서 1 Introduction 부분에 많은 내용이 나와도 당황하지 마시고 천천히 읽으시길 바랍니다.🚨

0 Abstract

- 깊은 신경망은 학습하기 어렵기에 이전까지보다 더 깊은 신경망을 쉽게 학습시키기 위해 Residual Learning Framework를 제안함.

- VGGnet보다 8배 깊은 152개 층의 신경망에 대해 연구함. 이때 해당 네트워크의 복잡도는 오히려 이전보다 낮음.

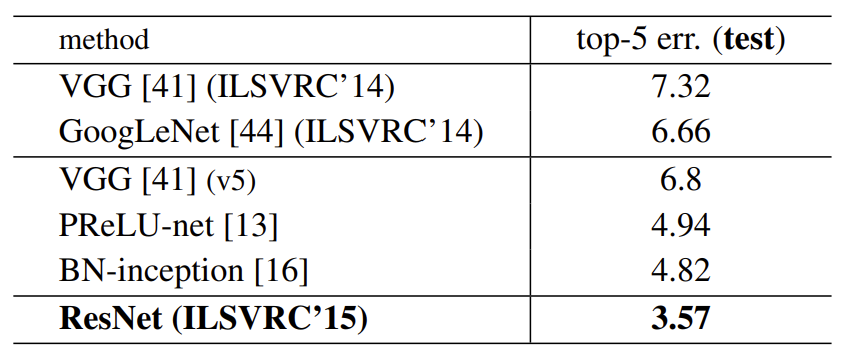

- ImageNet 데이터셋에 대하여 3.57%의 오차를 기록하며 ILSVRC 2015 에서 1위를 차지함.

- COCO 데이터셋에서도 28%의 성능 향상을 이끌었고, COCO 2015 에서 1위를 차지함.

- 더불어, ImageNet detection, ImageNet localization, COCO detection, COCO segmentation 에서도 1위를 차지함.

- ImageNet detection : 여러 개 의 객체 검출

- ImageNet Localization : 하나 의 주요 객체의 위치와 클래스 예측

- COCO detection : 객체를 bounding box로 감싸는 방식

- COCO segmentation : 객체의 윤곽선을 정확하게 따라가면서 픽셀 단위로 분할

1 Introduction

- 최근 연구들을 통해 네트워크의 깊이가 매우 중요하다는 것을 알아냈음.

- ImageNet 데이터셋에서 16~30개의 깊은 신경망 모델이 좋은 성능을 보였고, 이외 복잡한 이미지 데이터셋에 대해서도 같은 양상을 보임.

❓그런데 신경망의 성능을 높이기 위해 단순히 레이어 수를 늘리는 것만으로 충분한가?

1-1 Two Problems due to deep layers

1. 기울기 소실/발산 문제 → 해결 가능!

- 네트워크가 깊어질수록 기울기가 소실되거나 발산되어 수렴을 방해하고, 이로 인해 모델이 제대로 학습하지 못하게 됨.

- 가중치 초기화, Batch Normalization 등의 정규화 기법을 통해 깊은 네트워크도 SGD와 역전파를 통해 수렴 가능함.

2. 깊이에 따른 성능 저하 문제 → ResNet 등장 배경

- 층이 깊어짐에 따라 accuracy saturation (정확도 포화)와 급격한 degradation (성능 저하) 문제가 발생함.

- accuracy saturation : 모델을 개선하거나 더 깊은 네트워크를 사용하더라도 정확도가 더 이상 증가하지 않는 현상. 즉, 성능이 나빠지진 않지만, 그렇다고 개선되지도 않는 상황.

- degradation : 말 그대로 성능이 저하되는 현상.

- 이러한 성능 저하 문제는 의외로 과적합으로 인해 발생하는 것이 아님.

- 층을 깊게 쌓을수록 training error가 점점 높아짐.

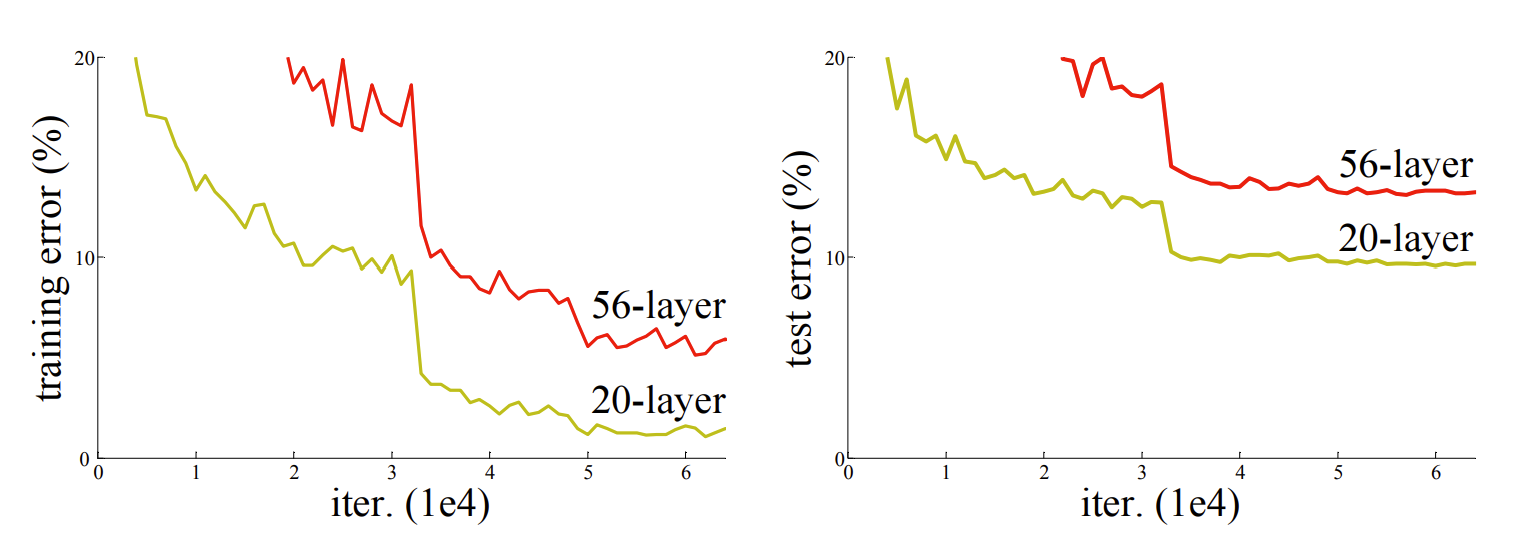

<그림1> 층이 깊은 네트워크가 오히려 더 높은 training error를 보이고 있음 (논문발췌)

- 원래 이론적으로, 깊은 네트워크는 얕은 네트워크보다 더 나쁜 성능을 가질 이유가 없음. 왜냐하면 깊은 네트워크는 얕은 네트워크의 가중치를 복사하고, 추가된 층을 항등 매핑으로 설정하면 동일한 성능을 가져야 하기 때문임.

- 하지만, 실제 실험에서는 기존의 최적화 방법(SGD 등)이 이러한 이상적인 해를 찾지 못하고, 깊은 네트워크가 학습 오류가 더 높아지는 degradation 이 발생함.

단순히 층을 더 추가하는 것이 항상 최적의 방법이 아니며, 효과적인 학습이 가능하도록 새로운 구조가 필요함.

→ !!ResNet의 등장 배경!!

1-2 Solving process ; Deep Residual Learning framework

일반적인 신경망 : 깊은 층이 원하는 함수를 직접 학습하도록 함.

- 기본 CNN 혹은 MLP에서는 신경망이 입력 로부터 직접 를 예측하는 함수 를 학습함.

- 문제는 층이 깊어질수록 원하는 함수를 직접 학습하려고 하면 기울기 소실과 최적화 난이도 증가 등의 이유로 학습이 비효율적임.

ResNet에서는 입력과 출력 간의 차이인 잔차를 학습하도록 함.

- : 원하는 함수 (출력되는 예측값)

- : 출력값 예측값

→

잔차 함수를 최적화하는 것이 원하는 함수를 최적화하는 것보다 수월함. 극단적인 예시를 들자면,

- , 즉

겉으로 봤을 때는 매우 쉬운 수식이기에 왜 굳이 잔차를 학습하나 싶은 생각이 들 수도 있지만, 깊은 네트워크는 이렇게 단순한 항등 매핑도 학습하기 어려움.

따라서 항등함수인 를 직접 학습하는 것이 아니라 를 그대로 출력할 수 있도록, 즉 출력과 입력의 잔차가 이 되도록 을 학습하는 것이 훨씬 쉬운 방법임.

| 구현 방법 |

-

는 입력과 출력의 잔차로 구할 수 있으므로 포인트는 를 어떻게 그대로 전달하는가임.

-

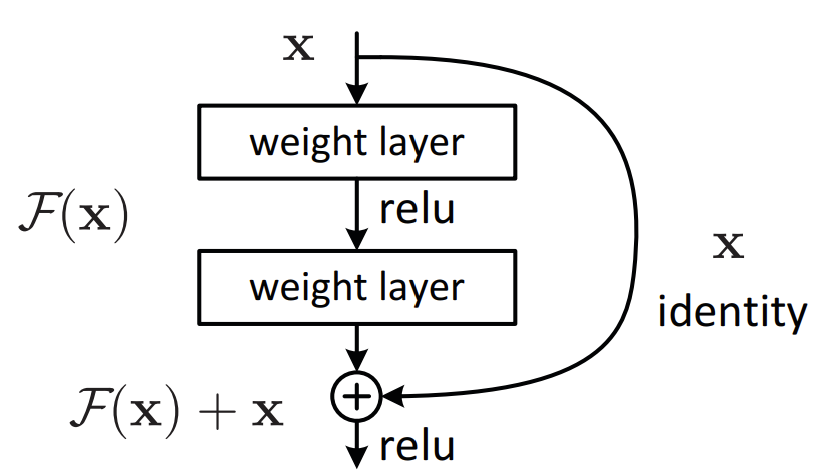

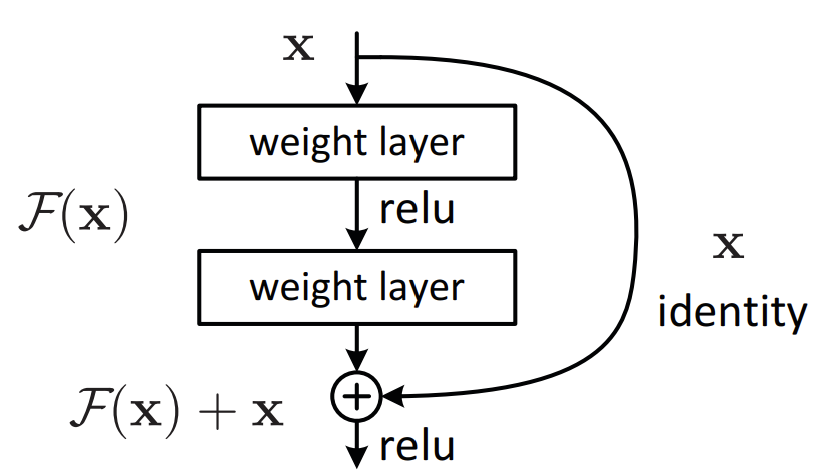

"숏컷 연결(shortcut connections)"를 갖고 있는 피드포워트 신경망을 통해 구현할 수 있음.

(※숏컷 연결이란 하나 이상의 층을 통과(skip)하는 것을 의미함.) -

해당 논문에서는 를 그대로 전달할 수 있는 항등함수임.

-

항등 숏컷 연결은 추가적인 가중치나 복잡한 연산을 필요로 하지 않음.

-

해당 구조를 도입해도 여전히 SGD와 역전파를 사용하는 등 기존의 라이브러리에서 쉽게 구현 가능함.

<그림2> 신경망은 잔차를 학습하며, 항등 숏컷 연결을 통해 입력값을 출력에 그대로 전달 (논문발췌)

1.3 Evaluation - ImageNet, CIFAR-10, COCO

1. ImageNet

- 단순히 깊게 쌓기만 한 신경망보다 잔차 학습 구조로 변환하여 깊게 쌓는 것이 최적화하기에 훨씬 수월하고 성능도 좋음.

- 잔차를 학습하는 신경망은 층이 깊어질수록 정확도가 늘어남. (정확도 포화 및 성능 저하 문제 해결)

- 152-layer residual net으로 top-5 error에서 3.57%를 기록하며 ILSVRC 2015에서 1위를 달성함.

2. CIFAR-10 set

- 100층 이상을 신경망을 성공적으로 학습했음.

- 1000층 이상의 모델도 실험함.

3. COCO

- 마찬가지로 좋은 성능을 보여 COCO 2015에서 1위를 달성함.

2 Related Work

2.1 Residual Representations

| 이미지 인식 |

- VLAD : 잔차 벡터 를 사용하여 특징 표현

- 이미지의 다양한 지역에서 추출한 특징점을 벡터화한 것을 기반으로 VLAD 표현 생성

- 특징점들을 K개의 클러스터로 분류하여 각 특징점이 가장 가까운 클러스터(시각적 단어)에 할당됨. 이때, 각 특징점이 속한 클러스터 중심과의 차이를 벡터로 저장하여 "특징점이 클러스터의 중심에서 얼마나 벗어나 있는지"를 반영함.

- Fisher Vector : VLAD의 확률적 확장 버전

- K-means가 아닌 GMM을 기반으로 계산됨.

- GMM의 원리를 고려하여 특징 벡터들이 각 클러스터에 할당되는 것이 아니라 클러스터 내에 확률적으로 분포한다고 가정함.

- "가장 가까운 클러스터 중심과의 차이"만 기록하는 것이 아니라, 가우시안 분포를 이용하여 특징 벡터의 변화 양상을 표현하기 때문에 평균뿐만 아니라 분산 정보까지 포함하여 더욱 풍부한 특징을 학습할 수 있음.

- 비선형적이며 더욱 정교한 특징 표현이 가능해짐.

- 대규모 이미지 검색 및 분류에서 매우 효과적임

| 편미분방정식(PDE)를 풀기 위한 방법 |

- 다중 격자 방법 (Multigrid Method)

- 이미지를 잔차 기반으로 분할하여 저차원(낮은 해상도)에서 해를 구한 뒤, 해상도를 점진적으로 보정함으로 최적화 과정을 효율적으로 수행함.

- ResNet이 잔차를 학습하는 것과 비슷한 양상

- 계층적 기저 전처리 (hierarchical Basis Preconditioning)

- 다중 격자 방법의 대안으로, 다중 스케일에서 문제를 해결할 때, 각 스케일 간의 잔차 벡터를 활용함.

→ 이렇듯 잔차를 이용하면 불필요한 계산을 줄이고 최적화 문제를 더 쉽게 해결할 수 있음.

2.2 Shortcut Connections

1. MLP(다층 퍼셉트론)에서 "입력 → 출력"을 직접 연결하는 선형 레이어 추가에 대한 연구

2. 보조 분류기(auxiliary classifier)

- 몇몇 중간 계층은 기울기 소실 및 폭발 문제를 해결하기 위해 보조 분류기에 직접 연결되기도 했음.

- GoogleNet에서 사용됨.

3. Inception 네트워크

- 깊은 네트워크를 효율적으로 학습하기 위해, 숏컷 연결을 포함한 다양한 경로를 사용

- GoogleNet의 Inception 모듈에서는 얕은 경로와 깊은 경로를 함께 사용하여 특징을 추출

4. highway networks (숏컷 연결 + 게이트 기능)

-

gate는 데이터 의존적이고 가중치를 두고 있음. (ResNet과 다르게)

- gate가 닫혀있는 경우 (0에 다가갈 경우)

- 잔차 학습을 진행하지 않음.

- 원하는 함수를 직접 학습함.

- gate가 열려있는 경우 (1에 다가갈 경우)

- 항상 잔차학습을 진행함.

- 항등 숏컷 연결이 항상 열려있으므로 모든 정보와 추가적으로 학습된 잔차가 전달됨.

- gate가 닫혀있는 경우 (0에 다가갈 경우)

3 Deep Residual Learning

3.1 Residual Learning

- : 원하는 함수 (출력되는 예측값)

- : 출력값 예측값

→

- 여러 개의 비선형 층이 복잡한 함수를 점근적으로 추정할 수 있다는 것은 잔차 함수 역시 추정할 수 있음을 의미함.

- 따라서 해당 논문에서는 학습의 편이를 위해 네트워크가 를 추정하도록 함.

- 실제에서는 Introduction 에서 제시한 예시와 같이 가 항등함수일 가능성은 낮지만, 그와 비슷한 함수라면 를 통해 아주 작은 변화만 학습하면 되니까 여전히 효과적임.

- 실험 결과, 학습된 잔차 함수의 출력값이 작은 것으로 보아 에 가까웠음을 의미함. 이는 항등매핑이 좋은 초기값 역할을 했다는 것을 시사함.

3.2 Identity Mapping by Shortcuts

- (1)

- : 입력 벡터

- : 출력 벡터

- : 잔차 함수

- 가중치 혹은 복잡한 연산이 없다는 것은 실제 적용 시, 플러스가 되는 좋은 요소인 동시에 기존의 plain 네트워크와 같은 조건에서 성능을 비교할 때도 중요한 역할을 함.

행렬 연산을 위해 와 의 차원은 반드시 동일해야 함! 즉, 입력과 출력의 채널 개수가 같아야 함. 만약 채널 개수 증가 등의 이유로 둘의 차원이 달라진다면 다음 (2)식을 통해 조정해야함.

- (2)

- 는 Conv 1x1 연산을 수행하는 선형 변환 행렬로, 채널 수를 조정해주는 역할을 함.

- 해당 식(2)는 행렬의 차원이 다른 경우에만 사용함. 이외의 경우에는 앞서 제시한 식(1)을 활용함.

잔차 함수 의 형태는 유연하기에 2개 혹은 그 이상의 층을 가질 수 있음. 다만, 1개의 층으로만 이루어져 있다면, 식(1)은 와 같은 선형식에 가까워지고, 이는 어떠한 장점도 지니지 않기에 추천하지 않음.

| 예시 |

<그림2>에서처럼 2개의 층이 있는 경우, 식은 다음과 같음.

- 는 ReLU함수를 의미함.

- 편향은 식 단순화를 위해 생략됨.

<그림2> 신경망은 잔차를 학습하며, 항등 숏컷 연결을 통해 입력값을 출력에 그대로 전달 (논문발췌)

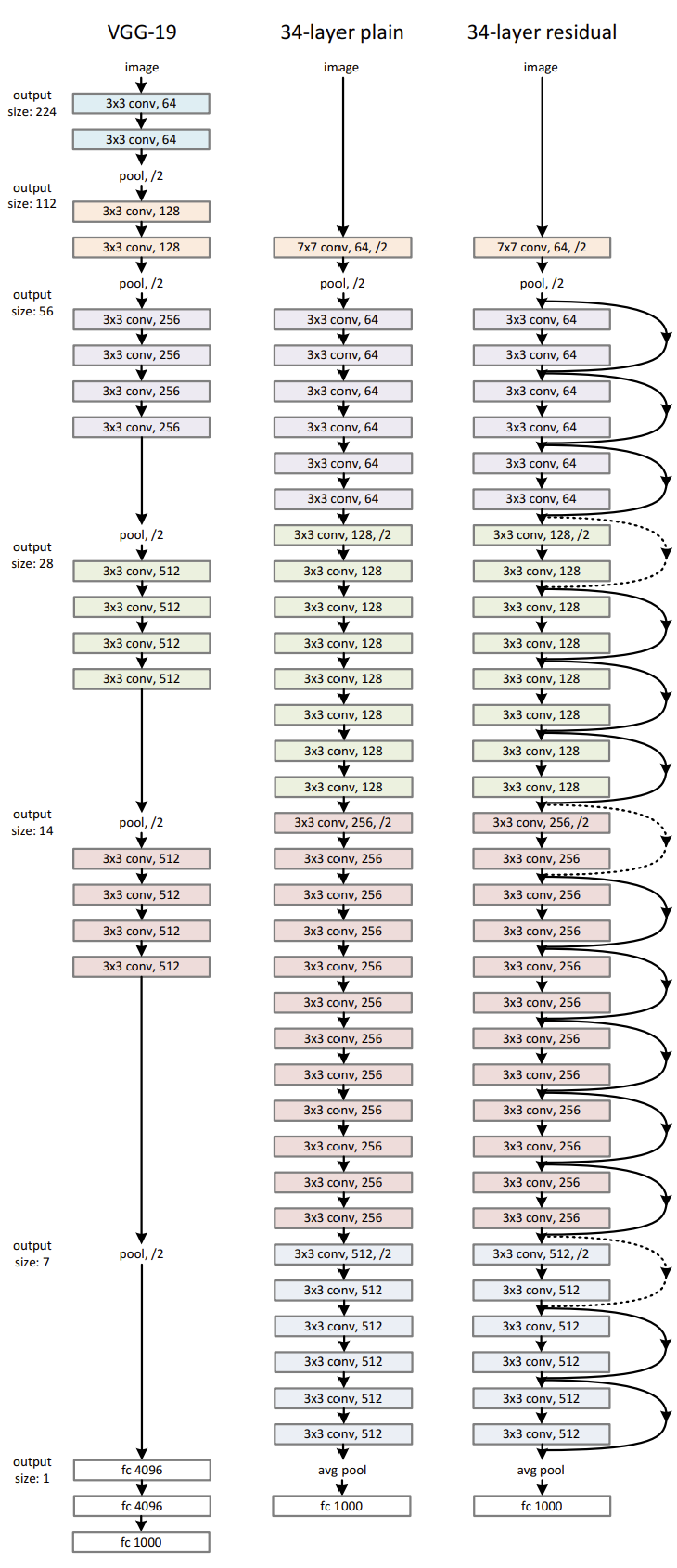

3.3 Network Architectures

<그림3> 왼쪽부터 순서대로 VGGnet, plain network, residual network (논문발췌)

1. Plain Network (<그림3>에서 가운데 모델)

- 주로 VGGnet으로부터 영감을 받아 설계됨.

- 대부분 3x3 필터를 활용함.

다음 2개의 규칙을 따름.

- 같은 크기의 출력맵을 도출해야 하기 때문에 대부분의 층의 필터 개수는 동일함.

- 만약 채널 개수를 2배로 늘려기 위해 출력맵의 크기를 반으로 줄일 때는, 필터의 개수를 2배로 늘림. 이때 pooling이 아니라 conv layer에서 stride=2로 설정함으로써 출력맵의 크기를 줄임

- 마지막 부분에서 global average pooling을 사용하여 출력된 특징 맵을 벡터로 변환함.

( ※맵의 크기를 줄이는 동시에 채널 개수를 늘리면서 벡터로 도달하는 과정은 VGGnet 논문 리뷰의 <그림5>를 참고 ) - 최종적으로 softmax를 장착한 FC layer(1x1x1000)에 전달함으로써 ImageNet 1000개 데이터를 분류함.

2. Residual Network

- plain network에 숏컷 연결 추가함.

- 대부분의 경우 앞서 정의한 식(1)을 적용함.

- 중간중간 채널의 개수가 2배가 되면서 /2 표시된 구간에는 적용할 방법음 다음 2가지임.

- 그대로 식(1)을 적용하고 해당 구간의 입력맵의 채널에 zero padding을 사용함. (는 이전 층에서 더 작은 채널 개수를 그대로 갖고 오기 때문에 가 이와 차원을 맞추기 위해 에서 부족한 채널 부분을 0으로 채워서 채널의 수를 증가시킨다는 의미의 zero padding임.)

- 식(2)를 적용함. (항등 숏컷 연결 부분에 선형 변환한 식)

3.4 Implementation

- S를 설정할 때 multi-scale 사용 → [256, 480] 에서 S값 랜덤으로 정함.

- 224x224 크기만큼 crop 진행함. 더불어 좌우반전으로 데이터 증강함.

- 각 합성곱 연산 이후 활성화 함수에 통과시키기 전, 배치 정규화를 진행함.

- He 초기값 사용함.

- 학습률은 0.1부터 시작해서 오차가 늘어나면 만큼 곱해줌. 최종 학습률은 .

- 가중치 감소(weight decay) = 0.0001

- 모멘텀 = 0.9

4 Experiments - ImageNet Classification

- training data : 128만 개

- validation data : 5만 개

- testing data : 10만 개

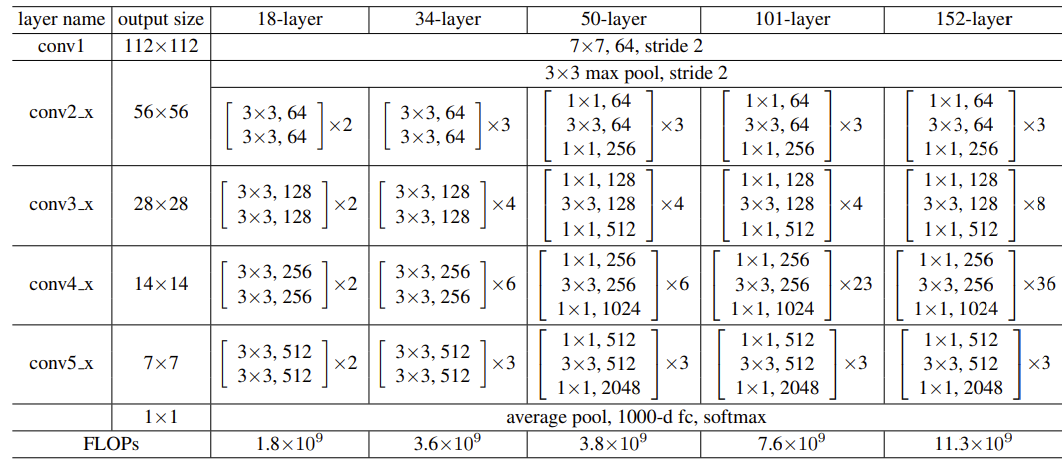

<그림4> 모델 구조 (Plain, Residual 모두 동일. 차이는 숏컷 연결 사용 여부) (논문발췌)

1. Plain Networks

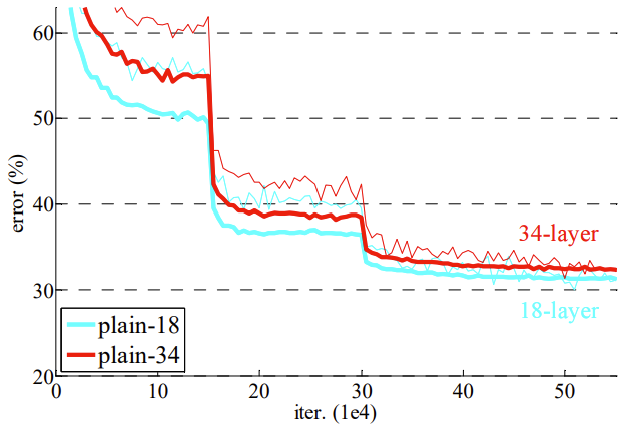

<그림5> ImageNet - Plain Net의 error (18층 vs. 34층) (논문발췌)

- 18층과 비교했을 때 34층 모델이 training, validation 모두에서 성능이 더 나빴음.

- Introduction에서 살펴본 바와 같이, 기울기 소실 및 폭발 등의 문제는 아님.

- 연구 결과, 깊은 plain 모델은 수렴률이 기하급수적으로 낮아짐을 확인함. 다시 말해, parameter에 변화를 주어도 오차가 크게 줄지 않아 최적화가 어렵다는 뜻임.

2. Residual Networks

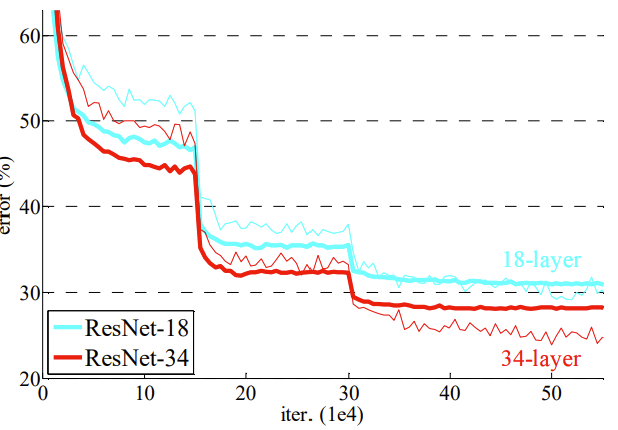

<그림6> ImageNet - ResNet의 error (18층 vs. 34층) (논문발췌)

- baseline은 <그림4>에서 볼 수 있듯 Plain Networks와 동일함. 숏컷 연결만 추가함.

- training, validation 모두에서 더 나은 성능을 보이고 있음.

| Conclusion |

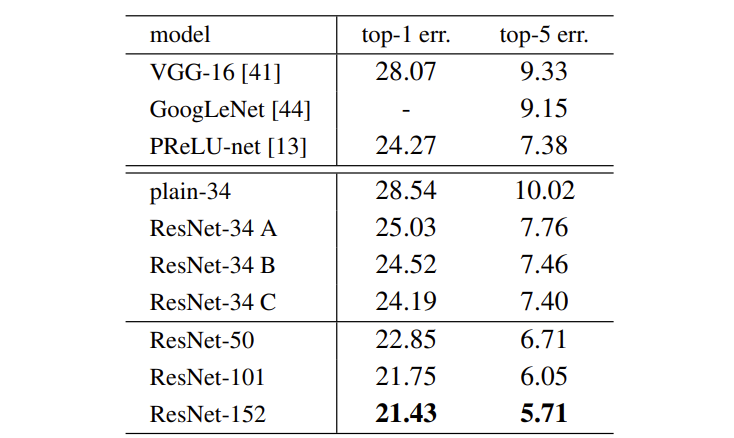

- multi-crop 방식

<그림7> 10-crop 방식, 즉 multi-crop 방식 (VGGnet 글 참고) (논문발췌)

-

single crop 방식

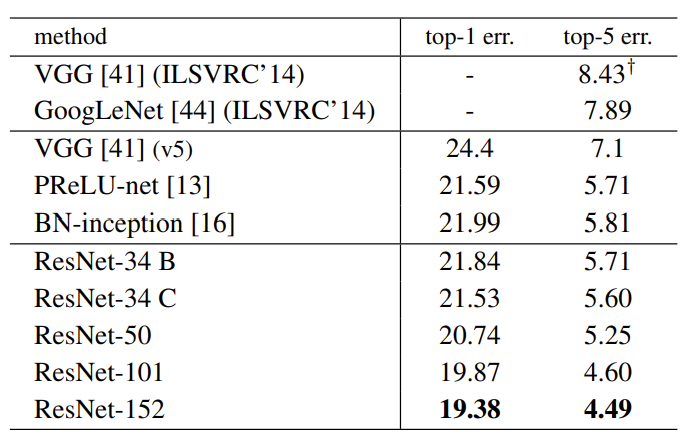

<그림8> single-model, 즉 single-crop 방식 (논문발췌)

- 알파벳은 숏컷 연결에 사용하는 방법 3가지에 대한 것임.

(A) : zero-padding shorcuts (채널 개수가 늘어날 경우에만, 이외에는 식(1) 적용)

(B) : projection shortcuts (채널 개수가 늘어날 경우에만, 이외에는 식(1) 적용)

(C) : all projection shortcuts (모든 경우에 식(2) 적용) - (C) > (B) > (A) 순으로 더 나은 성능을 보이긴 했지만, 그 차이가 미묘하기 때문에 projection shortcuts, 즉 식(2)가 필수적이지 않음을 보여줌.

- 메모리 비용을 아끼기 위해 (C) 는 사용하지 않음.

- 알파벳은 숏컷 연결에 사용하는 방법 3가지에 대한 것임.

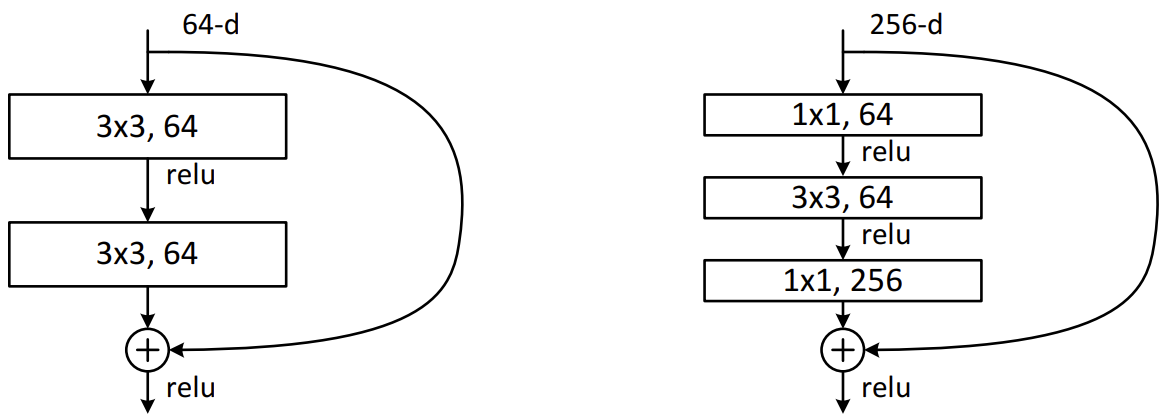

| Deeper Bottleneck Architectures |

<그림9> 2개의 3x3 layers vs. 1x1 layer를 이용한 병목 구조 (논문발췌)

- 학습속도를 높이기 위해 병목 구조를 고안함.

- 각 잔차 함수를 <그림9>와 같이 1x1→3x3→1x1 로 구성함.

- 항등 숏컷 연결이 중요한 역할을 하는데, 만약 항등 숏컷 연결이 아닌 projection shortcut, 즉 직전의 (C)를 사용할 경우, 시간 복잡도와 모델 크기가 2배가 됨. 따라서 반드시 항등 숏컷 연결을 사용해야 함.

깊이가 서로 다른 6개의 ResNet을 앙상블하여 다음과 같은 결과를 냈음

<그림10> 최종 결과 (논문발췌)

🤔 내 생각

- 잔차를 학습한다는 개념이 신선하면서도 그 과정이 처음에는 쉽게 이해되지 않았음.

- 논문 구조가 특이해서 개인적으로 읽기 힘들었음.

- 0 Abstract와 1 Introduction 겹치는 내용도 많고, introduction에서 생각보다 딥하게 설명해줘서 읽는 사람으로 하여금 오히려 헷갈리게 만듦. 친절한 논문은 아니였음.

- 그리고 무엇보다 레퍼런스를 친절하게 안 써줌. 본문 작성할 때, 마지막에 왕창 정리해둔 레퍼런스 모음에서 [40] 이런식으로 따오니까 어떤 선행 모델 및 논문을 말하는 것인지 헷갈렸음...

글이 정말 잘 정리되어 있네요 !! 좋은 글 감사합니다 ╰(°▽°)╯