논문리뷰

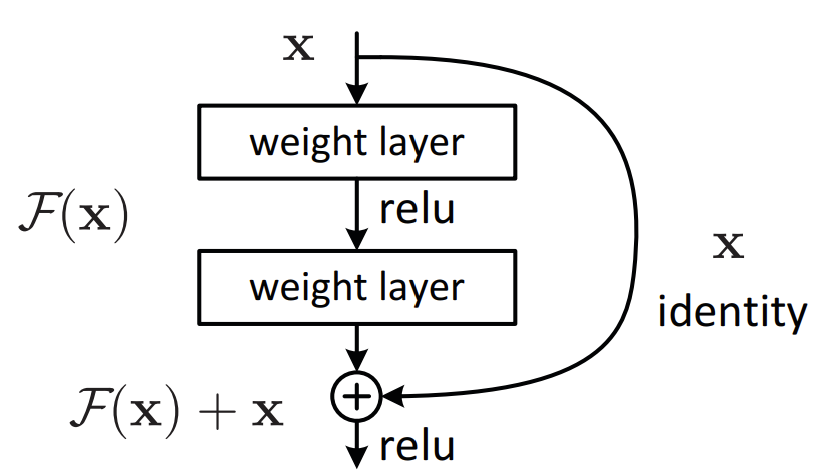

1.ResNet : Deep Residual Learning for Image Recognition (2015)

Original Paper (Arxiv) : ResNet (https://arxiv.org/pdf/1512.03385) 📥Background VGGNet 매우 작은 필터를 사용함으로써 파라미터 개수가 감소했고, 비선형성이 증가하여 더 복잡한 패턴도 학습할 수 있음.

2.VGG : VERY DEEP CONVOLUTIONAL NETWORKS FOR LARGE-SCALE IMAGE RECOGNITION (2015)

Original Paper (Arxiv) : VGGNet (https://arxiv.org/pdf/1409.1556.pdf) 0 Abstract 해당 논문의 contribution은 3X3 convolution filters와 같이 매우 작은 필터를 활용하는 아키텍처

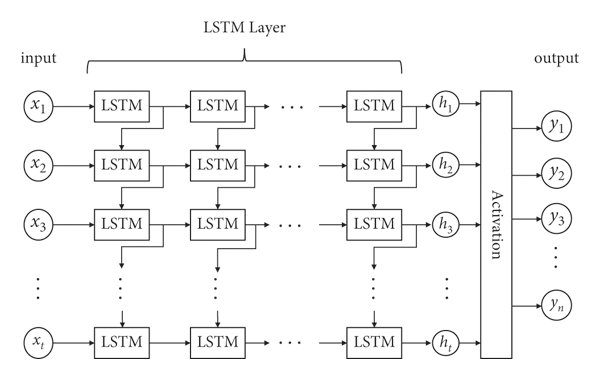

3.Sequence to Sequence Learning with Neural Networks (2014)

Original Paper (Arxiv) : seq2seq (https://arxiv.org/pdf/1409.3215논문에는 자세히 나와있지 않은 내용들이 많아서 wididocs를 참고하여 작성함. https://wikidocs.net/24996van

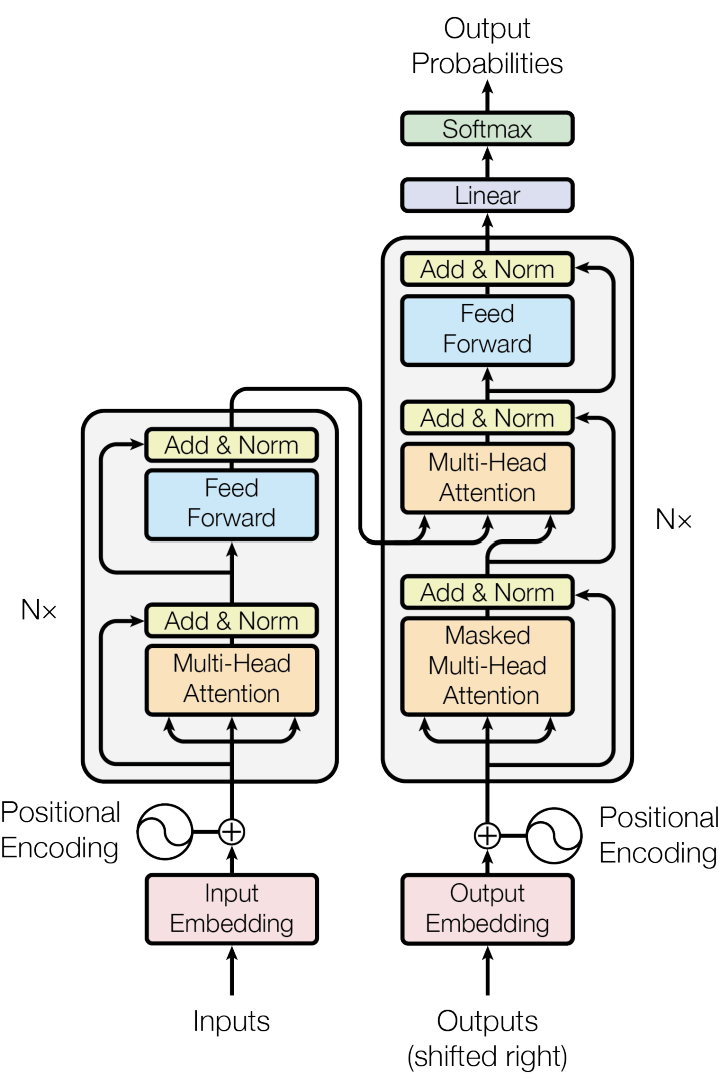

4.Transformer : Attention Is All You Need (2017)

Original Paper (Arxiv) : Transformer (https://arxiv.org/pdf/1706.03762) 📥Background 1. vanilla seq2seq > 자세한 설명은 seq2seq에 대해 정리한 글 참고 : Sequence to

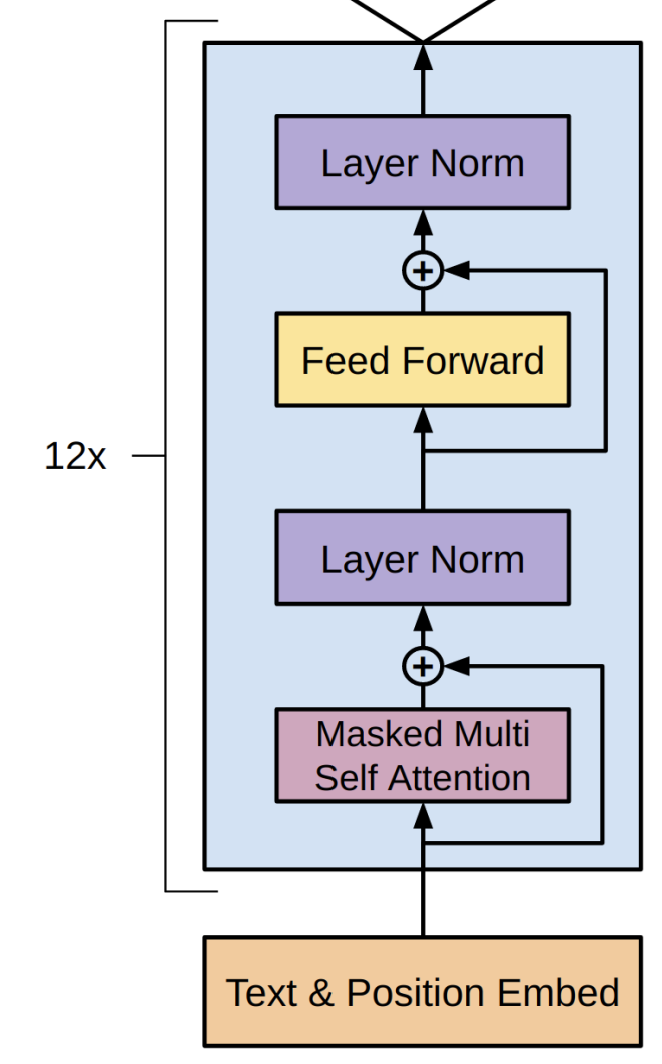

5.GPT-1 : Improving Language Understanding by Generative Pre-Training (2018)

Original Paper : GPT-1 (https://cdn.openai.com/research-covers/language-unsupervised/languageunderstandingpaper.pdf) 📥Background Transformer > Transformer 정리 글 참고 https://velog.io/@angel5893/Transfo...

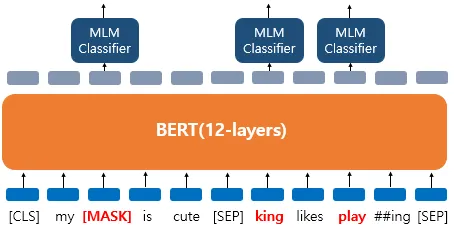

6.BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding (2018)

Original Paper (Arxiv) : BERT (https://arxiv.org/pdf/1810.04805) 📥Background 1. ELMo (Embeddings from Language Model) (1) biLM(Birdirectional Langua

7.SpanBERT: Improving Pre-training by Representing and Predicting Spans (2019)

Original Paper (Arxiv) : SpanBERT (https://arxiv.org/pdf/1907.10529)입력 텍스트의 15%를 랜덤으로 마스킹한다.80% : MASK10% : 랜덤으로 대체10% : 미변경 (원래 단어 그대로)해당 토큰들 이외

8.RoBERTa: A Robustly Optimized BERT Pretraining Approach (2019)

Original Paper (Arxiv) : RoBERTa (https://arxiv.org/pdf/1907.11692)BERT 정리글 참고https://velog.io/@angel5893/BERT-Pre-training-of-Deep-Bidirect

9.ViT : An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale (2021)

Original Paper (Arxiv) : ViT (https://arxiv.org/abs/2010.11929) 📥Background : Transformer > Transformer 논문 리뷰 글 https://velog.io/@angel5893/Transformer-Attention-Is-All-You-Need-2017 (1) Positional...

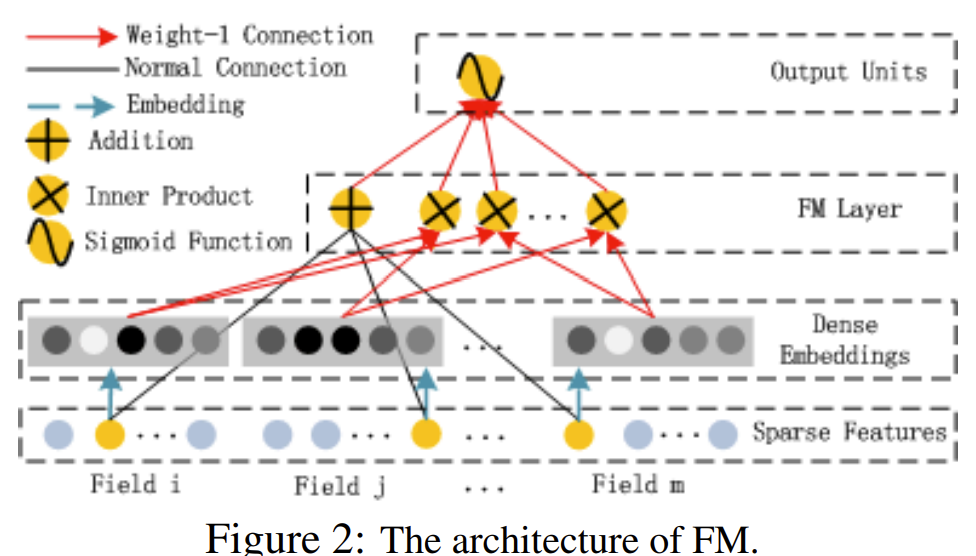

10.DeepFM: A Factorization-Machine based Neural Network for CTR Prediction (2017)

Original Paper (Arxiv) : DeepFM (https://arxiv.org/pdf/1703.04247)"비슷한 사용자 들이 좋아한 아이템을 추천하자"(1) 원리사용자와 아이템간의 상호작용 기록 (e.g. 클릭, 좋아요, 구매 등)만을 기반으로

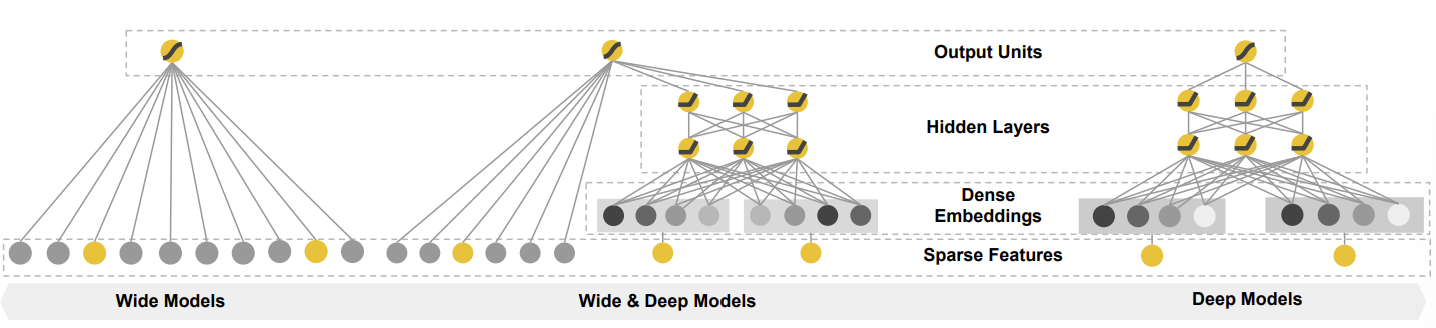

11.Wide & Deep Learning for Recommender Systems (2016)

Original Paper (Arxiv) : Wide&Deep (https://arxiv.org/pdf/1606.07792)"비슷한 사용자 들이 좋아한 아이템을 추천하자"(1) 원리사용자와 아이템간의 상호작용 기록 (e.g. 클릭, 좋아요, 구매 등)만을 기반

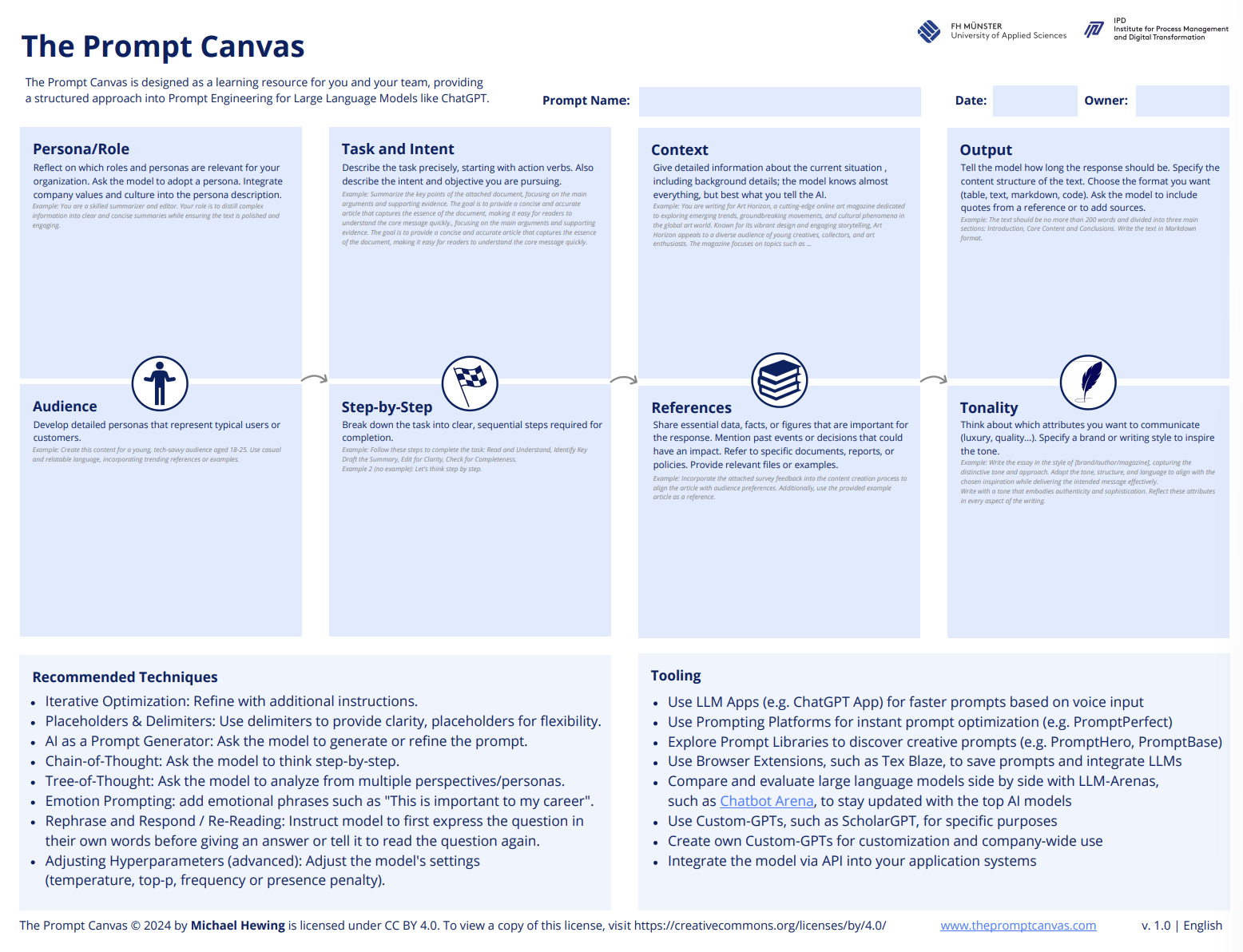

12.PROMPT DESIGN AND ENGINEERING: INTRODUCTION AND ADVANCED METHODS (2024)

Original Paper : Prompt Design and Engineering (https://arxiv.org/pdf/2401.14423)지난주부터 인턴 생활을 시작하고 태스크를 수행하면서 체계적인 프롬프팅의 중요성에 대해서 새삼 다시 깨닫게 되었다.