딥러닝에서 왜 확률론이 필요한가?

- 딥러닝은 확률론 기반의 기계학습 이론에 바탕을 두고 있다.

- 기계학습에서 사용되는 손실함수들의 작동 원리는 데이터 공간을 통계적으로 해석해서 유도함

- 회귀분석에서 손실함수로 사용되는 L2-노름은 예측오차의 분산을 가장 최소화하는 방향으로 학습하도록 유도합니다

- 분류문제에서 사용되는 교차엔트로피는 모델 예측의 불확실성을 최소화하는 방향으로 학습하도록 유도합니다.

- 분산 및 불확실성을 최소화하기 위해서는 측정하는 방법을 알아야 한다

확률분포는 데이터의 초상화

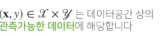

- 데이터공간 x 라 표기하고 는 데이터 공간에서 데이터를 추출하는 분포

- D는 이론적으로 존재하는 확률분포이기 때문에 사전에 알 수 없습니다.

- 데이터는 확률변수로 ~ 라 표기

- 확률변수는 확률분포 에 따라 이산형과 연속형 확률변수로 구분하게 됨

- 데이터공간 x 에 의해 결정되는 것으로 오해하지만 에 의해 결정된다

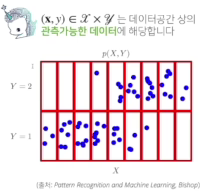

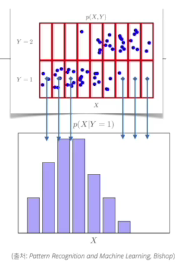

- 결합분포 는 를 모델링합니다.

- 원래 확률분포와 상관없이 결합분포가 이산형 또는 연속형으로 결정(모델링에 따라 달라짐)

- 는 입력x에 대한 주변확률분포로 x에 대한 정보를 주지만 y에 대한 정보를 주진 않습니다.

- x에 대해서 덧셈을 해주거나 x에 대한 적분한다면 y에 대한 주변확률분포를 구할수 있음

- x에 대해서 덧셈을 해주거나 x에 대한 적분한다면 y에 대한 주변확률분포를 구할수 있음

- 조건부확률분포 는 데이터공간에서 입력x와 출력y의 관계를 모델링합니다

- 는 특정 클래스가 주어진 조건에서 데이터의 확률분포를 보여줌

이산확률변수 VS 연속확률변수

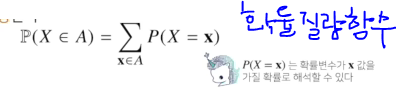

- 이산형 확률변수는 확률변수가 가질 수 있는 경우의 수를 모두 고려하여 확률을 더해서 모델링한다

- 연속형 확률변수는 데이터 공간에 정의된 확률변수의 밀도 위에서의 적분을 통해 모델링한다

조건부확률과 기계학습

- 조건부확률 는 입력변수x에 대해 정답이 y일 확률을 의미합니다.

- 연속확률분포의 경우, 는 확률이 아니고 밀도로 해석한다는 것

- 로지스틱 회귀에서 사용했던 선형모델과 소프트맥스 함수의 결합은 데이터에서 추출된 패턴을 기반으로 확률을 해석하는데 사용

- 분류 문제에서 softmax(WΦ +b)은 데이터 x로부터 추출된 특징패턴 Φ(x) 과 가중치행렬W을 통해 조건부확률를 계산합니다.

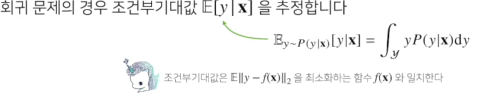

- =

- 조건부기댓값을 사용하는 이유: 회귀문제의 경우 L2-노름기댓값을 사용하는데 조건부기댓값은 L2-노름기댓값을 최소화하는 함수와 일치

- =

- 딥러닝은 다층신경망을 사용하여 데이터로부터 특징패턴Φ을 추출합니다

- 특징패턴을 학습하기 위해 어떤 손실함수를 사용할지는 기계학습 문제와 모델에 의해 결정된다.

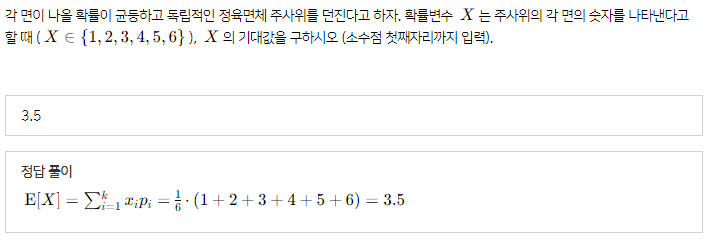

기댓값이 뭔가요?

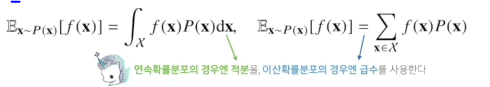

- 확률분포가 주어지면 데이터를 분석하는데 사용 가능한 여러 종류의 통계적 함수를 계산할 수 있습니다.

- 기대값은 데이터를 대표하는 통계량이면서 동시에 확률분포를 통해 다른 통계적 범함수를 계산하는데 사용됩니다

- 기댓값을 평균으로도 봄(평균 이외에도 다양한 것들이 있음)

- 기댓값을 이용해서 분산, 첨도, 공분산등 여러 통계량을 계산할 수 있습니다.

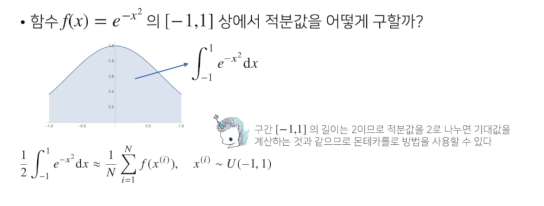

몬테카를로 샘플링

- 기계학습의 많은 문제들은 확률분포를 명시적으로 모를 때가 대부분이다

- 확률분포를 모를 때 데이터를 이용하여 기대값을 계산하려면 몬테카를로 샘플링 방법을 사용해야 한다.

- 이산형이든 연속형이든 상관없다.

- 몬테카를로 샘플링은 독립추출만 보장된다면 대수의 법칙에 의해 수렴성을 보장한다