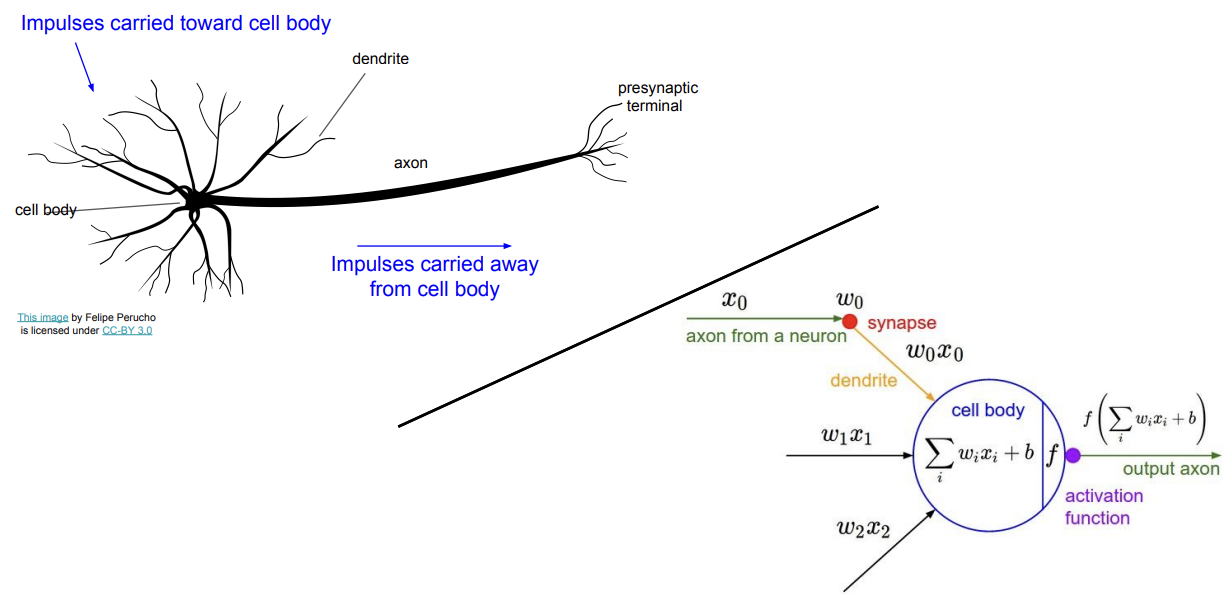

Perceptron

- 인공 신경망의 가장 기본적인 단위, 인간의 뇌를 구성하는 뉴런의 작동 방식을 간단히 모방했음.

- 다층 퍼셉트론과 딥러닝의 등장으로 인해 인공 신경망은 더욱 복잡한 문제를 해결할 수 있게 되었음.

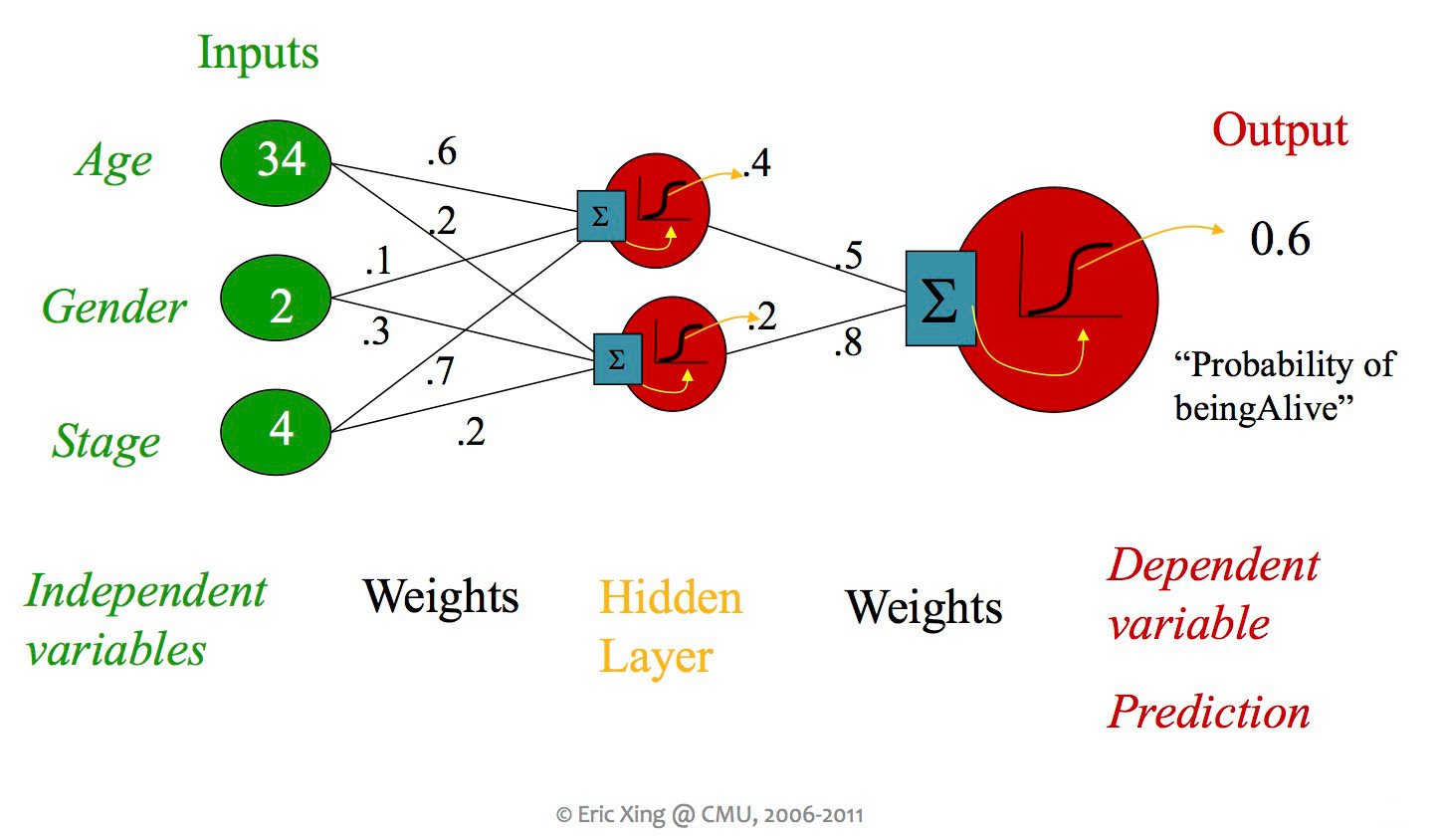

- 여러 개의 입력값 x에 각각 가중치 W를 곱해 모두 더한 뒤, 활성화 함수에 통과시켜 출력값을 얻음.

- Linear Regression 모델에 Activation Function을 붙인 것으로 볼 수 있음.

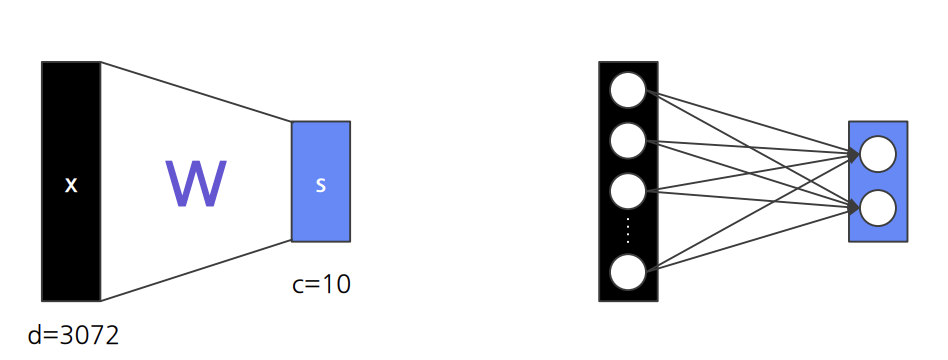

Single Layer Perceptron

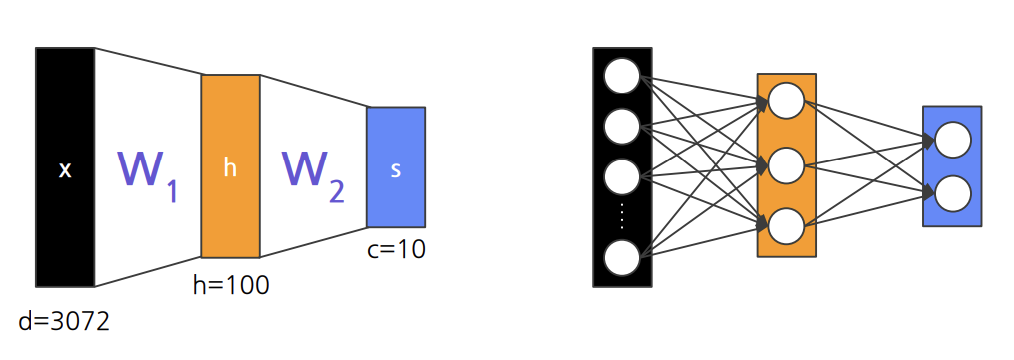

Multi-layer Perceptron (MLP)

- 에서 여전히 linear함.

-> 즉, 여러 층을 쌓아도 의미가 없음. (결국에 Linear model로 표현될 수 있기 때문)

- 활성화 함수(Activation Function)를 이용해 non-linear하게 만들 수 있음.

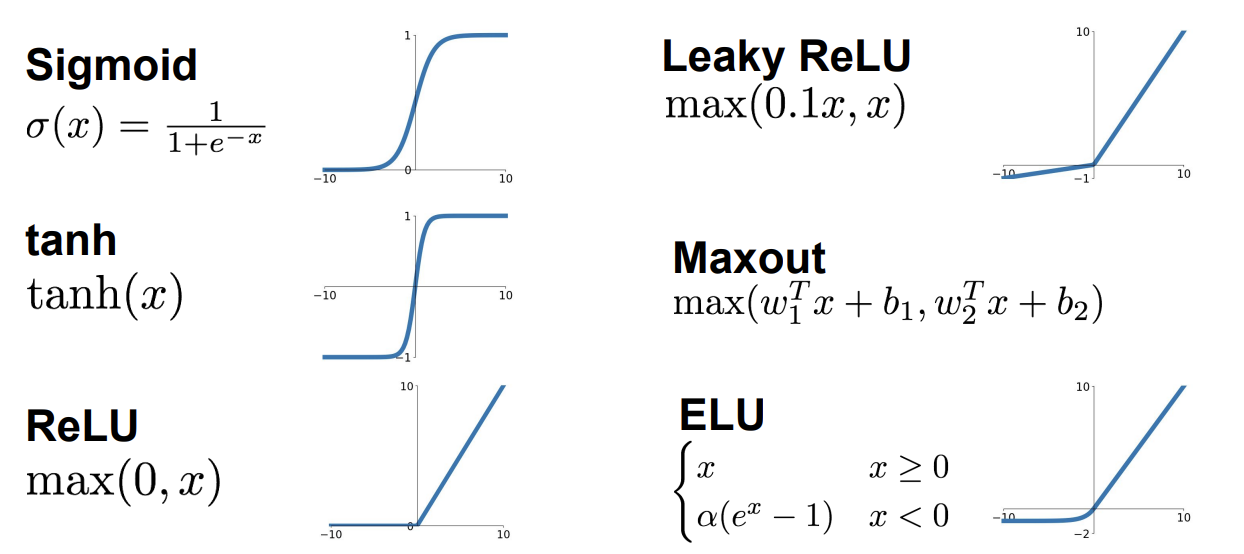

Activation Functions

Neural Network의 예시

-> weight과 activation function을 무수히 반복하다보면, 굉장히 복잡한 패턴을 갖는 dataset에 대해서도 내재된 패턴을 찾을 수 있다.