LLM 및 자율제어 시스템에서 할루시네이션 억제와 답변 일관성 유지 전략

1. 개요

-

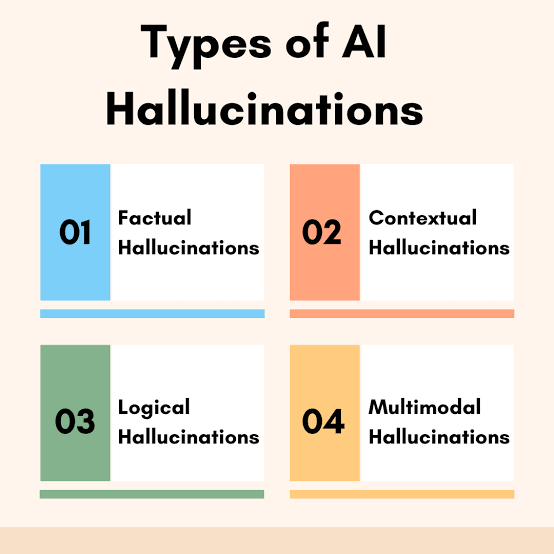

LLM(Large Language Model)과 AI 기반 자동제어 시스템은 강력한 추론·생성 능력을 제공하지만, 할루시네이션(Hallucination)과 답변 변동성 문제는 신뢰성·안전성·규제 준수에 직접적인 영향을 미칩니다.

-

특히 자율주행(Autonomous Driving)과 같은 물리적 제어 영역에서는 잘못된 판단이 사고·인명 피해로 이어질 수 있으므로, 다층적인 억제·검증·일관성 유지 전략이 필수입니다.

2. LLM 할루시네이션 억제 전략

2.1 데이터 레벨 접근

-

고품질 학습 데이터 강화: 신뢰성 있는 데이터셋으로 파인튜닝(Fine-tuning)

-

Instruction Tuning / SFT(Supervised Fine-tuning): 명령-응답 데이터로 미세조정

-

데이터 필터링: 위키, 논문, 공식 문서 등 검증된 출처만 학습

2.2 모델 아키텍처 / 학습 방식

-

RLHF(Reinforcement Learning from Human Feedback): 사람 피드백 기반 강화학습

-

DPO(Direct Preference Optimization): 선호 데이터 기반 직접 최적화

-

컨트롤 토큰/스위치: “정확성 모드” 같은 내부 제어 신호 활용

2.3 검색 증강 (RAG: Retrieval-Augmented Generation)

-

외부 지식베이스 참조 → 환각 감소

-

출처 근거 제공 → 답변 신뢰성 강화

2.4 디코딩 전략

-

Temperature, Top-k, Top-p 조정 → 보수적 응답

-

Constrained Decoding → 특정 포맷 강제(SQL, JSON 등)

2.5 사후 검증 (Post-hoc Verification)

-

Fact-checker 모델: 1차 생성 후 검증

-

Self-consistency / Reflection: 다회 생성 후 일관성 높은 답변 선택

-

Chain-of-Verification(CoVe): 스스로 근거 추출·검증

2.6 멀티모달·에이전트 기반

-

Tool-augmented LLM: 검색엔진·계산기·DB 호출

-

Agentic workflows: 응답 전 검증 루프 포함

3. 자율제어(자율주행)에서의 할루시네이션 억제

3.1 센서 데이터 기반 사실 제약

-

카메라, LiDAR, 레이더, GPS, IMU 등 다중 센서 활용

-

Sensor Fusion으로 LLM/RL 추측 덮어쓰기

3.2 Rule-based Safety Layer

-

예: “앞차 거리 < 2m → 무조건 제동”

-

규칙 엔진이 최종 방어막 역할

3.3 Hybrid Control (AI + 전통 제어)

-

AI는 전략적 의사결정(경로 선택)만 수행

-

실제 Steering/Throttle/Braking은 PID, MPC 등 검증된 제어기가 실행

3.4 Real-time Verification & Simulation

-

Digital Twin, 시뮬레이터로 정책 사전 검증

-

충돌 위험 정책은 배포 차단

3.5 Uncertainty Estimation (불확실성 추정)

-

Bayesian, Ensemble, Monte Carlo Dropout 등으로 확신도 추정

-

불확실성 높으면 Fallback(정지, 안전모드)

3.6 Human-in-the-loop & Override

-

레벨 2~3: 운전자 개입 가능

-

레벨 4~5: 원격 관제(teleoperation) Fallback 제공

4. 답변 일관성 유지 메커니즘

4.1 메모리 기반

-

대화 메모리(Conversation Memory): 이전 입력·출력·맥락 저장

-

세션 메모리(Session Memory): 세션 내 임시 저장

-

장기 메모리(Long-term Memory): DB/파일 형태로 지속 저장

4.2 메모리 외 요소

-

모델 파라미터 고정(Fixed Parameters): temperature=0.0 등 랜덤성 제거

-

규칙 기반 처리(Rule-based Logic): 특정 질문에 사전 정의된 답변 반환

-

버전 관리(Version Control): 알고리즘·데이터셋 버전 고정

4.3 실무 예시

response = llm.generate(

prompt=user_input,

temperature=0.0, # 랜덤성 제거

memory=session_memory # 이전 대화 맥락 참조

)5. Fallback 제공의 의미와 활용

-

메인 로직 실패·불확실 시 안전한 대체 응답 제공

-

목적: 서비스 중단 방지, 사용자 경험 보호

-

예시

-

챗봇: "죄송합니다, 현재 해당 정보를 찾을 수 없습니다."

-

자율주행: 불확실성 높으면 차량 정지 또는 안전 모드 전환

-

6. 자율주행 자동제어 아키텍처 (4계층 구조)

[Sensors] → [Perception] → [Prediction] → [Planning] → [Control] → [Actuators]

(Camera,LiDAR) (객체인식) (행동예측) (경로/의사결정) (PID/MPC) (모터,브레이크)

환각 억제① 환각 억제② 환각 억제③ 환각 억제④

- Sensor Fusion - 불확실성 추정 - Safety Layer - 전통제어로 실행

- 다중센서검증 - Ensemble - Rule-based Check - 직접 제어 금지7. 최종 정리

-

일반 LLM 환각 억제: 데이터 품질 → RLHF/DPO → RAG → 디코딩 전략 → 사후 검증 → 에이전트 기반

-

자율주행 환각 억제: 센서 강제 → Safety Layer → 전통 제어 병행 → 시뮬레이션 → 불확실성 추정 → Human-in-the-loop

-

답변 일관성 유지: 메모리 + 파라미터 고정 + 규칙 기반 로직 + 버전 관리

-

Fallback: 불확실·오류 상황에서 안전한 대체 처리 제공

실무 팁

- LLM/RL은 중심 제어기가 아니라 보조 의사결정 도구로 사용

- 최종 액션은 검증된 전통 제어기와 안전 레이어가 실행

- 모든 단계에서 불확실성 추정 → Fallback → 안전 모드 흐름을 설계