[논문리뷰] AI Agents vs. Agentic AI: A Conceptual Taxonomy, Applications and Challenges

Paper Review

AI Agents와 Agentic AI의 차이? 이 차이에 대해서 생각해본 적 없기에 논문 제목에서 부터 흥미를 끌었다. 올해 초 Agents의 개념을 정리하기 위해 각종 글을 읽으며 끙끙댔던 기억이 있는데 명확한 개념 정리를 목표로 한다니 반갑기도 했다. 논문을 열어보니 약 30장 정도의 긴 분량에 헉! 했지만 찬찬히 읽면서 정리했다.

초록에서 간략하게 언급하는 AI Agents와 Agentic AI의 차이는 다음과 같다.

| AI Agents | Agentic AI | |

|---|---|---|

| 개념 | 특정 태스크를 자동화하기 위해 설계된 모듈형 시스템(단일 에이전트 기반) | 기존 AI Agents 보다 발전된 형태로, Agents 기반의 협업과 자율성이 강조되는 시스템(다중 에이전트 기반) |

| 기능, 특징 | 주로 LLM을 통해 구현되며 툴 통합, 프롬프트 엔지니어링, 추론 능력 강화 등의 특징을 가짐 | multi-agent의 협업, 동적인 분산 작업, 지속적인 메모리와 자율성의 조정 등의 특징을 가짐 |

| 적용 사례 | customer support, scheduling, data summarization | research automation, robotic coordination, medical decision support |

최근에 언급되는 다중 에이전트, 툴을 통합하여 자율적이고 동적인 작업을 하는 시스템은 Agentic AI에 가깝다고 볼 수 있다.

1️⃣ Introduction

서론 파트에서는 LLM과 AI에 대한 활발한 논의가 있기 전, 즉 ChatGPT가 등장한 2022년 이전의 Agent의 개념에 대해서 우선 다룬다(이런 논문들을에서 대부분 'Before ChatGPT was introduced...'와 같은 문장들이 많이 나오는 것으로 보아 ChatGPT가 정말 AI 붐의 고유대명사 혹은 하나의 아이콘과 같은 역할이긴 한 것 같다).

전형적인 Agent-like 시스템은 사전에 정의된 룰 기반으로 특정 작업을 수행하도록 설계되고 제한된 자율성을 가졌다. 즉, 맥락을 인식하는 방법보다는 심볼릭한 추론, 룰 기반 로직 혹은 스크립트에 의존적인 수행을 하는 것이다. 이들의 공통적인 한계는 (1) self-learning의 부족 (2) 비구조적이고 변화하는 환경에 대한 적응력의 부족 등과 같으며, 최근 언급되는 Agentic AI와 차별점이 된다고 한다.

2022년 이후, LLM을 기반으로 자율적이고 자업 지향적인 프레임워크로써 1998년에 처음 언급된 Agents의 개념이 다시 주목받게 되었다. 우선 언급된 개념은 AI Agents로, 외부 도구를 호출하고 LLM이 실시간 정보를 검색하며 피드백 등의 루프를 통해서 목표를 달성하는 과정으로 진행되며, AutoGPT, BabyAGI 등과 같은 프레임워크가 제안되었다. 2023년 후반에는 보다 발전된 개념인 Agnetic AI가 등장했는데, 이는 목표를 분해(deompose)하고 의사 소통하며 공동의 목표를 향해 자율적으로 조정하는 복합체의 개념으로 설명된다. 이 과정에서 서로 다른 환경의 에이전트들이 의사 소통을 하기 위한 표준 프로토콜로 2025년 Google은 A2A(Agent-to-Agnet)를 발표했다. 이 프로토콜은 5가지의 주요 원칙을 가지며(에이전트의 기능 수용, 기존 표준 구축, 기본적인 상호 작용 확보, 장기 실행 작업 지원, 모달리티 불가지론 보장?), 확장 가능한 에이전트 인프라 구축을 위한 토대 마련을 목표로 한다.

이런 상황에서, AI Agents와 Agentic AI는 모두 LLM을 기반으로 하고 생성한 시스템에서 확장된 개념이지만, 근본적으로 다른 아키텍쳐를 가지고 상호 작용과 자율성 수준이 다르다는 점에서 명확히 구분될 필요가 있다. 또한 두 개념을 분류 체계(taxonomy)로 분류하는 것은 정확하고 효율적인 시스템 설계와 올바른 성능 평가 등을 위해서도 중요하다.

Methodology Overview 부분에서 이 리뷰 논문을 작성하기 위해서 어떤 사고(?) 과정과 작업을 진행했는데 굉장히 자세하게 설명하고 있어서 인상적이었음

본 논문의 목적은 AI Agents와 Agentic AI의 명확한 구분을 위해 공식적인 개념과 구조적 분류를 제공하며 이 과정을 계층적, 순차적으로 설명하는 것이다.

2️⃣ Foundational Understanding of AI Agents

AI Agents는 특정 목표를 달성하기 위해서 디지털 환경에서 구현되는 자율적인 개체로 정의될 수 있다. 이때의 Agents는 전통적인 자율성, 즉 정해진 workflow를 따르지 않고 반응형 과정을 통해 동적인 출력을 도출해낸다는 특징이 있다. AI Agents를 활용한 사례로는 Claude의 'Computer Use' 프로젝트가 있다. Computer use를 통해 Cluade는 컴퓨터 화면의 내용을 시각적으로 해석하고, 마우스와 키보드를 제어하며 다양한 소프트웨어 응용 프로그램을 탐색할 수 있으며, 양식을 작성하거나 데이터를 복사하는 등 반복적인 작업들을 자동화할 수 있고, 코드 작성과 테스트 등의 복잡한 작업도 할 수 있다고 한다. 이런 작업의 핵심 기술은 목표를 받은 뒤, 다음 작업을 진행하며 도출된 결과를 다시 검토하며 최종적으로 작업이 완료될 때까지 프로세스를 반복하는 것으로, Agents의 자율성이 기반이 된다.

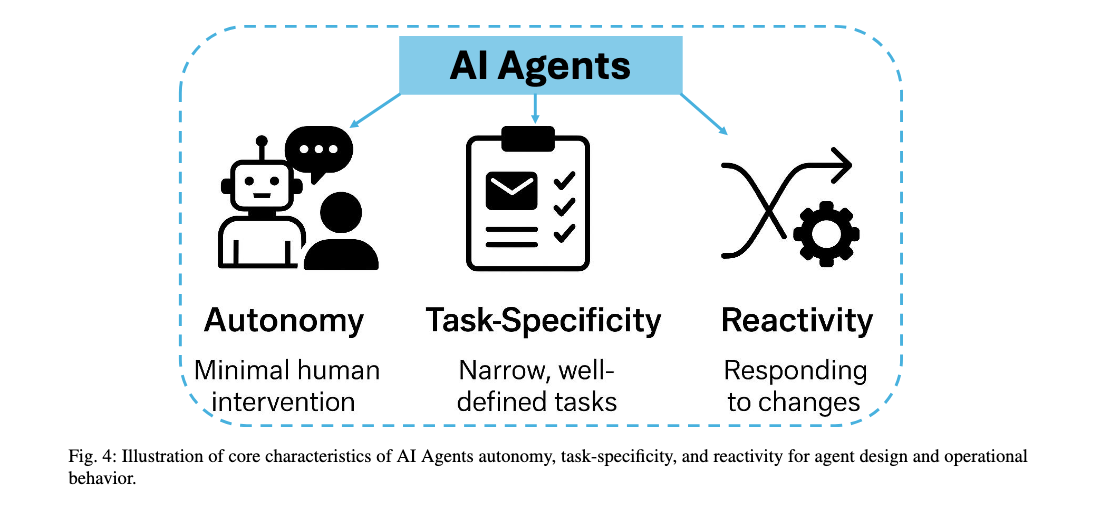

1) Core Characteristics of AI Agents

LLM은 AI Agents의 핵심 요소이지만, 단일 LLM을 사용하는 것과 이를 기반으로한 Agents는 차이가 있다. Agents의 핵심 특징은 다음과 같으며,

(1) Autonomy

Agents는 작업 과정에서 인간의 개입이 최소화되거나 거의 없다는 특징을 가지며, 이를 자율성이라고 한다. 자율성은 고객지원 챗봇이나 스케쥴링 어시스턴트와 같이 인간과 지속적으로 상호작용을 하지 않는 응용 프로그램에서 더욱 확장가능하다.

(2) Task-Specificity

AI Agents는 명확하게 정의된 작업(이메일 필터링, DB쿼리, 캘린더 조정 등)을 수행하기 위한 목적으로 설계된다. 이런 작업들은 반복적으로 수행되며, 추론이 불필요하며, 작업의 효율성과 정밀성을 높이기 위한 목적을 갖는다.

(3) Reactivity and Adaptation

AI Agents는 사용자의 요청이나 외부 API 호출 등과 같은 동적인 입력과 상호작용을 수행할 수 있다. 일부 시스템은 피드백 루프나 맥락적 업데이트 등을 통해 시간이 지나면서 행동을 개선할 수 있다.

2) Foundational models: The Role of LLMs and LIMs

AI Agents의 발전은 LLMs과 LIMs에 의해서 가속화되었다. 이때의 LLMs(Large Language Models)은 GPT 시리즈와 같이 대규모의 텍스트 데이터를 활용하여 학습되며, 자연어 이해를 바탕으로 질문에 답변하고, 요약, 추론 등을 수행할 수 있다. AI Agents 내에서 LLM은 기본적으로 사용자의 쿼리를 분석하고, 다단계의 솔루션을 계획하며 자연어로 응답을 하는 전 과정에서 엔진 역할을 한다. LIMs(Large Image Models)은 CLIP이나 BLIP과 같은 모델이 해당하며, Agents의 시각적인 영역까지 확장할 수 있도록 한다. LIMs는 이미지와 텍스트 쌍의 데이터로 학습되며, 객체를 인식하여 구분하는 등의 작업을 수행하여 자율 주행차나 드론 같은 시각적 요소가 포함된 도메인에서 활용 가능하다.

3) Generative AI as a Precursor

여러 문헌들에서는 일관적으로 생성형AI가 에이전틱 인텔리젼스의 기반(foundation) 기술로써 활용되는 것에 대하여 다루고 있다. 즉, 입력값에 대하여 텍스트, 이미지, 오디오 중 멀티 모달 작업을 LLM, LIM 기반으로 최적화하여 수행한다는 것이다.

생성형AI의 주요 특징들은 다음과 같다(Agents에 비해서 이런 특성들을 갖는다고 이해하면 될 것 같다).

(1) Reactivity

생성형AI는 비자율성(non-autonomous) 시스템으로, 입력값을 기반으로 사전에 작성된 프롬프트를 의해 작동한다. 이 과정에서 메모리의 지속성이 떨어지며, 목표를 달성하고자 하는 매커니즘이 부족하다고 한다.

(2) Multi-modal Capability

최근 공개되는 생성형AI 모델들은 텍스트 뿐만 아니라 이미지, 음성 등 다양한 멀티 모달 기능을 수행할 수 있다.

(3) Prompt Dependency and Statelessness

생성형AI는 기본적으로 이전 대화를 기억하지 않으므로(statellessness; 상태 비저장성) 프롬프트로 필요한 정보를 계속 다시 제공해야한다. GPT-4.1의 경우 context window가 100만개 정도 이고 장기 텍스트 맥락을 이해하는 성능이 개선되긴 했지만, 여전히 이 방식은 최적의 효율성 방식이라고 볼 순 없다. 또한 구조적으로 피드백 루프나 상태 관리, 목표를 달성하기 위해 자율적이고 다단계로 개선해나가는 등의 기능은 부족하다.

정리하면, 생성형AI 자체는 자연어를 비롯한 여러 형태의 입력값을 처리하고, 인간 친화적인 답변을 할 수 있으며 기본적인 작업 처리가 가능하지만, 외부 도구를 사용하지 않고서는 제한적인 역할을 수행할 수 밖에 없다는 것이다. 따라서 생성형AI를 엔진으로 활용하여 외부 도구를 사용하고 반복적인 작업을 수행하는 자율성을 부여하는 Agents의 활용도는 더욱 높아진다.

A. Language Models as the Engine for AI Agent Progression

앞서 언급했듯 생성형AI 즉, LLMs(혹은 LIMs)는 AI Agents의 핵심 엔진으로 사용될 수 있다.

1) LLMs as Core Reasoning Components

GPT4.1나 Claude Sonnet 3.5(현재는 4가 나왔음), LLaMA와 같은 모델들은 대규모의 텍스트 데이터로 SFT, RHFL 등의 방식으로 사전 학습된다. 이 모델들을 활용한 에이전트 관리 엔진은 사용자의 목표를 해석하고, 가장 적절할 전략을 선택하고 외부 도구를 활용하는 등의 인지, 판단을 수행할 수 있어야 하며, 최근 연구는 이런 모델들은 planner 혹은 executor로써 활용하여 인간의 자율적인 판단 기능을 모방하도록 한다.

2) Tool-Augmented AI Agents: Enhancing Functionality

환각 현상이나 최신 정보 반영의 부족 등과 같은 기존 모델의 한계를 극복하기 위해 제안된 것이 API 등의 외부 툴을 사용하는 방법이다. 외부 도구를 사용하여 참조 정보를 수집하거나 작업을 수행한 뒤, Agents는 최종적으로 결과를 종합하여 도출한다.

3) Illustrative Examples and Emerging Capabilities

도구 LLM 기반 AI 에이전트는 다양한 응용 분야에서 잠재력을 보여 주었으며, AutoGPT(웹 서치), GPT-Engineer(코딩), Paper-QA(연구 분야) 등의 사례를 제시한다.

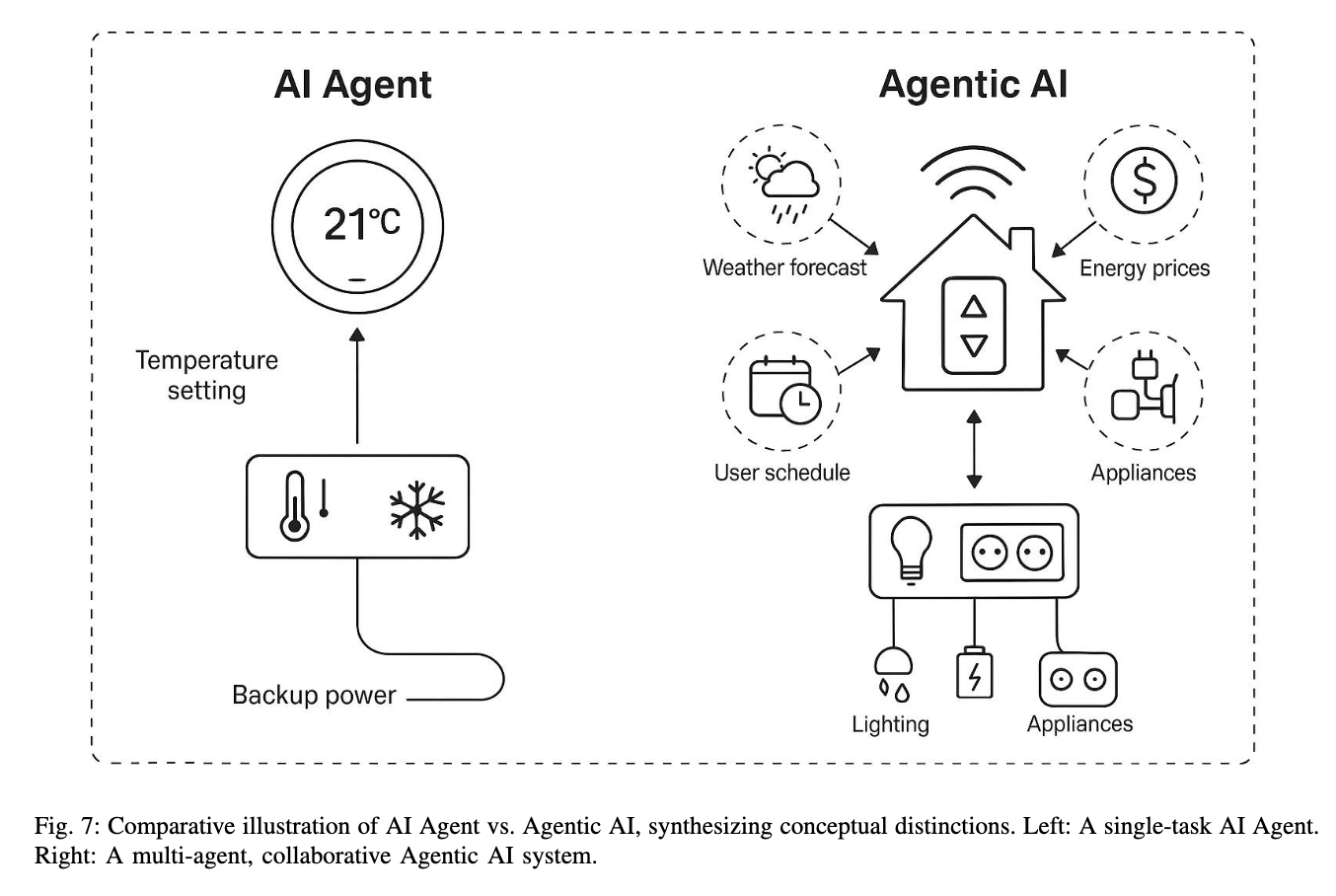

3️⃣ The Emergence of Agentic AI from AI Agent Foundations

AI Agents는 자동화된 작업 처리 부분에서 AI 분야의 비약적 성장을 이끌었지만, 여전히 복잡하고 다중 처리가 필요한 현실 세계에서는 한계가 있다. 따라서 논문에서는 AI Agents의 발전된 형태가 바로 Agentic AI라고 설명한다. Agentic AI는 구조화 된 의사 소통, 공유 메모리, 동적인 역할 할당을 통해 공동의 목표를 추구함으로써 더 확장된 기능을 수행할 수 있다.

1) Conceptual Leap: From Isolated Agents to Coordinated Systems

AI Agents는 외부 도구를 API 등으로 호출해서 작업할 수 있지만, 복잡한 작업에서 단일 Agents는 한계가 있다. Agentic AI는 복잡하고 고도화된 작업을 수행하기 위해 전문화된 여러개의 Agents들이 협업하여 다단계로 문제를 해결한다. 이 구조의 목표는 'decomposition', 즉 분산된 작업으로, 하위 테스크들로 쪼개서 부분 작업을 진행한다. 또한 반사적(reflective)추론과 메모리 시스템을 통해 여러 상호 작용에 대한 맥락을 저장하고 과거 결정을 평가하며, 전략을 반복적으로 개선해나가는 등 유연한 작업이 가능하다.

Fig7에서는 Agentic AI의 예시로 'smart home ecosystem'을 설명하는데, 기상예보 관측, 전기가격, 사용자의 스케쥴, 기기 등 다양한 정보가 동적으로 공유되어 공동의 목표(최적의 집 상태 유지, 에너지 효율 최적화 등)를 추구한다.

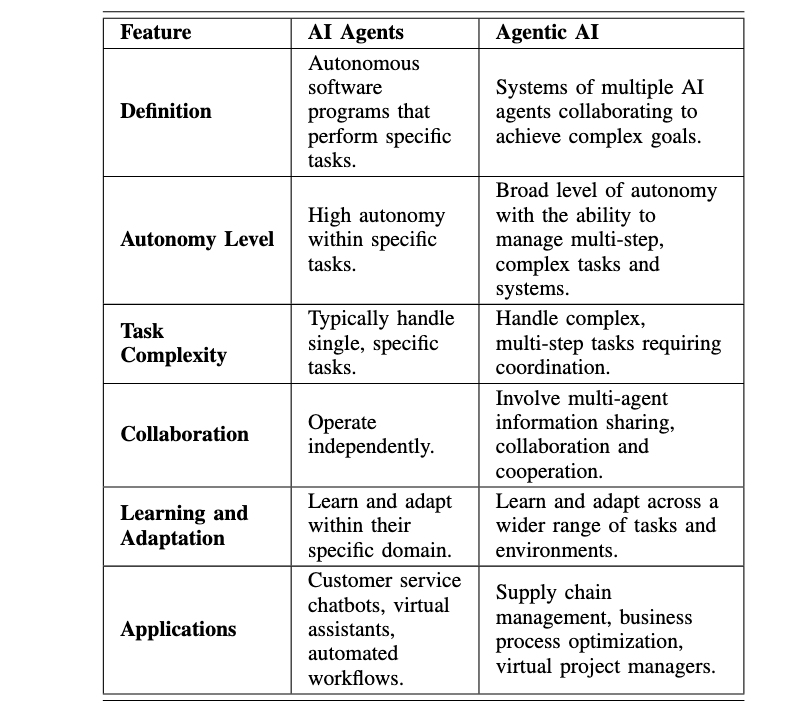

2) Key Differences between AI Agents and Agentic AI

위 테이블은 AI Agents와 Agentic의 차이에 대해서 정의나 자율성의 정도, 처리할 수 있는 태스크의 복잡도 등을 간단하게 비교한 것이다. 그러나 논문에서는 이 차이를 비교하기 위해서는 단순히 구조적인 내용 뿐만 아니라 시작 매커니즘, 메모리 사용, 학습 용량과 오케스트레이션 전략 등 포괄적으로 검토해야 한다고 설명한다. 특히, 최근에는 'Generative Agents'와 같이 에이전트 환경을 더욱 복잡하게 하는 하이브리드 식의 구조도 제안되고 있기 때문에 통합적인 비교 프레임워크가 필요하다.

Table2~9에서는 Generative AI를 베이스 라인으로 두고 AI Agent와 Agentic AI, 그리고 Generative Agent를 여러 측면에서 비교하고 있다. 다른 모델들의 비교는 앞서 설명을 통해서 쉽게 이해할 수 있으므로, Generative Agent의 특징만 자세히 살펴보겠다.

- 주요 기능: 컨텐츠 생성 중심 (Agentic AI는 자율적인 목표 달성을 추구함)

- 매커니즘: 프롬프트 --> LLM + 메모리/계획 --> 결과 (선형적)

- 아키텍쳐 구성요소: 단일 Agents + No 오케스트레이션 + (선택적) Tools

- 확장성: 제한적(단일 모델을 사용하므로)이며, 특화된 작업에 적합한 방식

- 계획 능력: 단기 계획, 제한적 상태 관리

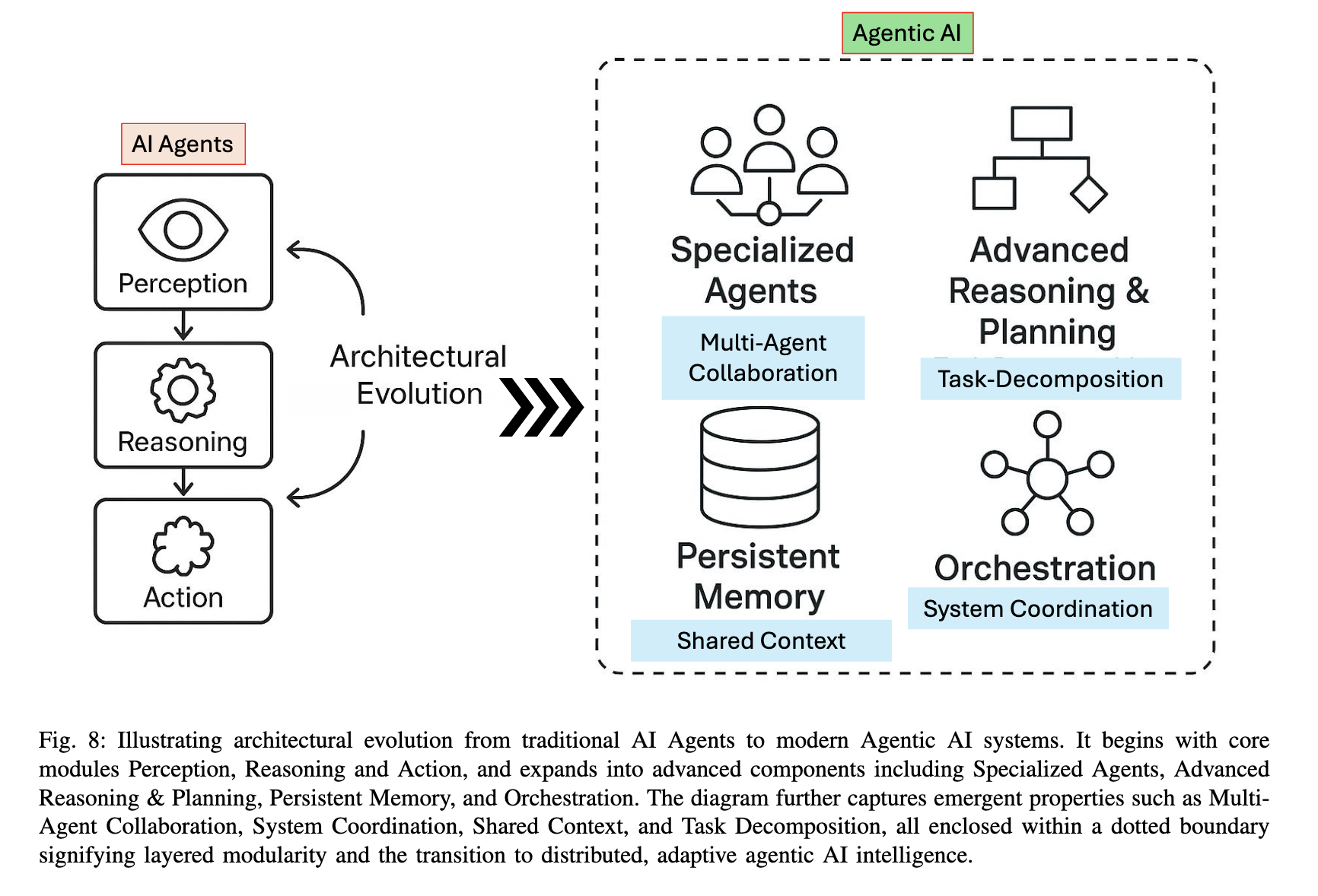

A. Architectural Evolution: From AI Agents to Agentic AI Systems

이 부분에서는 AI Agents에서 Agentic AI가 구체적으로 어떻게 더 진화했는지를 설명한다. 우선 AI Agents의 핵심 아키텍쳐 컴포넌트는 다음과 같다.

-

Perception Module: 인지 모듈은 자연어 프롬프트나 외부 API 등의 입력 신호를 입력하고 에이전트의 추론 모듈에서 해석할 수 있는 형식의 데이터 세트를 제공하기 위한 사전 프로세스를 진행한다. Langchain 기반의 prompt template이나 RAG를 위한 document chunking, embedding 등이 이 파트에 해당한다.

-

Knowledge Representation and Reasoning Module: Agents의 핵심 요소로, 입력된 데이터에 심볼릭하거나 확률적인 로직을 적용하는 부분이다. 이 부분에는 룰베이스나 workflow 방식도 포함되며, 추론 능력은 도구를 호출하거나 다른 작업 프로세스를 결정하는 단계를 향상시킨다.

-

Action Selection and Execution Module: 추론의 결과로 결정된 작업 순서에 따라 실제로 작업을 수행해야 한다. 작업은 메시지를 보내거나 데이터베이스를 업데이트 하는 등이 될 수 있으며 LangChain의

agent executor가 이 역할을 수행한다. -

Basic Learning and Adaptation: 전통적인 AI Agents는 휴리스틱한 파라미터 조정이나 이전 이력을 기반으로 제한된 학습 메커니즘을 사용한다.

Agentic AI는 여기서 확장된 기능을 갖는다. 우선 기존에 단일 Agents 구조가 인지하고 추론하고 실행하는 이 과정을 Agentic AI에는 여러 Agents가 수행할 수 있다. 즉, 인지-추론-실행 능력을 가진 Agents가 병렬적(선택적)으로 작업을 수행할 수 있으며, 상호작용(message queues, blackboards, shared memory 등을 통해)할 수 있다는 것이다. 또한 추론 능력도 향상되었는데, ReAct나 CoT, GoT 등의 프레임워크를 반복적으로 활용함에 따라 복잡한 작업을 쪼개어 진행하고 유동적으로 실행할 수 있게 된다.

메모리 측면의 차이도 있는데, 에이전트의 세션이 끝나거나 테스크 사이클 단위 안에서는 연속된 메모리를 사용하여 각 작업의 내용이 공유되고, 유지될 수 있도록 한다. Agentic AI의 가장 핵심 기술은 Orchestration Layers 이다. 작업 전반의 라이프 사이클을 조정, 관리하며 역할을 할당하며 충돌을 해결하는 과정이 자율적으로 수행되며, 종종 평가나 중재(moderators)의 역할도 수행한다. 이러한 구조는 사전에 정의된 워크 플로우를 수행할 뿐만 아니라 복잡한 목표를 달성함에 있어 최소한의 인간 개입만 필요하다는 점에서 '지능형 인공지능'에 가까워지고 있다고 볼 수 있다.

4️⃣ Application of AI Agents and Agentic AI

4장은 AI Agent와 Agentic AI의 응용 사례를 각각 4개씩 설명하고 있는데 간단하게만 살펴보고 넘어가겠다.

| index | AI Agents | Agentic AI |

|---|---|---|

| 1 | Customer Support Automation and Internal Enterprise Search: 고객의 주문 추적, 반품처리 자동화나 회사 내부 문서나 매뉴얼을 RAG 기반으로 검색하는 시스템을 구축할 수 있음 | Multi-Agent Research Assistants: 학술적, 산업계의 연구 보고서를 작성할 때, 각각의 에이전트들이 작업을 분산해서 진행하고 초안을 검토하여 통합된 글을 작성할 수 있음 |

| 2 | Email Filtering and Prioritization: 메일에서 자동으로 긴급도를 고려한 필터링이나 작업 정리, 요약, 태깅, 답장 작성 등을 수행할 수 있음 | Intelligent Robotics Coordination: 여러개의 로롯들을 관리하는 오케스트레이터를 통해 워크플로우를 조정하고 서로 동기화된 작업을 수행할 수 있음(농업 로봇의 예시 제시) |

| 3 | Personalized Content Recommendation and Basic Data Reporting: 개인 맞춤형 추천 서비스(상품 추천 등)와 데이터 분석 보고서 제공 | Collaborative Medical Decision Support: 고위험 임상 환경에서 히스토리, 상태 모니터링 등의 데이터를 종합하여 치료 계획 옵션을 제안할 수 있음 |

| 4 | Autonomous Scheduling Assistants: 캘린더, 업무 메신저 등과 연동하여 자동으로 스케쥴을 정리해주는 툴을 구축할 수 있음 | Multi-Agent Game AI and Adaptive Workflow Automation: 시뮬레이션 게임 등과 같은 작업에서 비정상적인 엑세스나 실시간 위험 탐지 등을 여러 Agents가 지원할 수 있음 |

5️⃣ Challenges and Limitations in AI Agents and Agentic AI

| index | AI Agents | Agentic AI |

|---|---|---|

| 1 | Lack of Causal Understanding: 상관관계와 인과관계를 잘 구분하지 못하고, 반사실적 사고(만약~했더라면)를 잘 수행하지 못함. CoT와 같은 추론 역시 수학적/논리학적으로 신뢰할 수 있는 추론이 아님 | Amplified Causality Challenges: 더 확장되고 다양한 상황에 노출됨에 따라 인과관계를 추론하는 능력이 더 떨어질 수 있음. 에이전트 간의 상태를 주고 받는 만큼 추론 능력 저하는 중복 계산이나 오류 발생 가능성을 높이게 됨 |

| 2 | Inherited Limitations from LLMs: 여전히 환각현상을 일으키는 답변을 하고, 편향이 존재하며, latency와 비용 측면의 한계가 있음 | Communication and Coordination Bottlenecks: 여러 에이전트들이 소통하는 과정에서 종종 주요한 맥락을 놓치는 경우가 있음. 또한 통신 프로토콜의 제한으로 인해 병목현상이 발생할 수 있음 |

| 3 | Incomplete Agentic Properties: 자율성, 반응성 등이 부분적으로만 반영됨. 인간이 작성한 프롬프트와 피드백에 의존하는 경향이 높고, 자발적인 우선순위 수정, 행동 등에는 제약이 있음 | Emergent Behavior and Predictability: 자율성이 높아진다는 것은 곧 불확실성이 높아진다고도 볼 수 있음. 예측 불가능한 작업 과정과 결과는 위험성이 있음 |

| 4 | Limited Long-Horizon Planning and Recovery: 시간 흐름이나 이전 상태에 대한 기억이 없어서 장기적인 계획을 수행하는 능력이 떨어짐 | Scalability and Debugging Complexity: 복잡성이 높이집에 따라 오류 발생시 해결하기도 어려워짐. LLM의 black-box 특성은 여전히 갖고 있으며 유지보수의 어려움과 확장성의 한계가 있음 |

| 5 | Reliability and Safety Concerns: 아직까지 신뢰성이나 안전성이 떨어짐. Agents가 중간 단계에서 도출하는 계획이나 소결의 정확성을 판단할 수 없음 | Trust, Explainability, and Verification: 에이전트들의 작업에 대해서 설명하거나 검증하기 어려움. 메모리와 전체 프로세스를 추적할 수 있으나, 실패의 명확한 원인을 순서에 맞게 찾는 것이 쉽지 않음. 또한 공식적인 검증도구가 없어 아직까지 위험도 높은 실제 환경에 적용하긴 어려움이 이 있음 |

| 6 | Security and Adversarial Risks: 단일 모델에 비해 위험에 노출될 가능성이 높고, 상호의존적이기 때문에 이 위험이 쉽게 공유되어 더 큰 문제 발생 가능성이 있음 | |

| 7 | Ethical and Governance Challenges: 분산되고 자율적인 특징은 책임성과 공정성 측면에서 윤리적, 거버넌스 이슈가 있음. 개별 에이전트들이 통함된 가치를 공유하지 않으면 중요한 목표를 다르게 해석하거나 다른 의도의 작업을 수행할 수 있음 | |

| 8 | Immature Foundations and Research Gaps: 아직 발전 과정에 있음에 따라 표준 아키텍쳐가 부족함. 에이전트를 개발하고 구조를 설계하는 것에 대한 표준의 부족은 상호 운용성과 일관성을 떨어트려 신뢰성 보장이 어려워지는 문제가 발생함. |

6️⃣ Potential Solutions and Future Roadmap

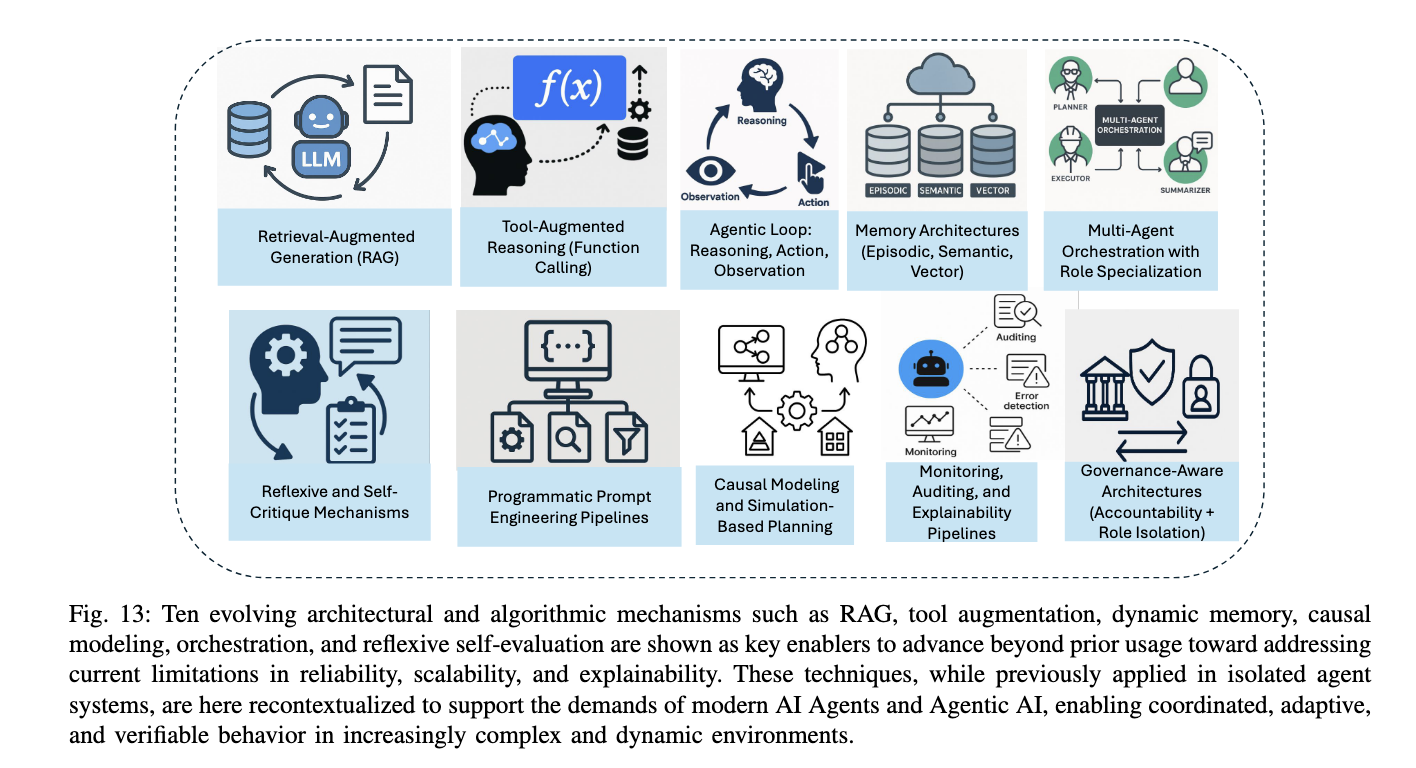

해당 챕터는 위에서 언급한 한계점들을 보완할 수 있는 기술적 방안들과 향후 연구 방향을 제시한다.

우선 RAG는 환각 문제와 실시간 데이터 반영을 지원할 수 있는 기법으로, Agentic AI 시스템에서도 정확성을 높이는 데 도움을 줄 수 있다. 외부 도구를 사용하는 것도 확장된 답변을 얻을 수 있는 한 가지 방법으로, 전문적인 기능들을 독립적으로 수행하고 오케스트레이션을 통해 공동의 목표를 달성할 수 있다.

추론과 실행, 결과의 피드백과 같은 루프를 반복하는 것도 에이전트의 성능을 높일 수 있는 방법이다. ReACT 패턴은 API를 호출하여 적용한 다음 중간 단계에 대한 의존성, 적합성을 검토한뒤 필요한 경우 재실행하는 작업 패턴을 활용한다. 이러한 루프를 통해 정확성과 신뢰도를 높일 수 있다. 반복적으로 언급되는 인과 관계 추론과 관련해서는 인과 그래프, 시뮬레이션 환경, 베이지안 추론 레이어 등을 통해 향상시킬 수 있다.

멀티 에이전트의 오케스트레이션 과정에서 역할을 세분화하는 것은 기존 단일 에이전트의 과부화 상태를 해결할 수 있다. 각 에이전트 별 역할과 추론 과정을 분리해서 병렬적으로 처리함으로써 오류 역시 개별적으로 관리할 수 있고 이를 각각 모니터링 할 수 있다.

매뉴얼한 수동 프롬프팅은 재현성과 확장성이 부족하다는 한계가 있다. 따라서 자동화된 프롬프트 파이프라인을 통해 작업 템플릿을 구축하고 구조화된 프롬프트를 통해 일관된 추론을 수행할 수 있다.

에이전트는 투명성이 부족하고 디버깅이 쉽지 않으므로 프롬프트, 사용 도구, 메모리 사용과 출력 결과 등 전 과정을 로깅하는 시스템을 통해 사후 유지보수를 대비할 수 있다. 이는 에이전트의 실행 과정을 설명하는 타임라인이나 시각화 등을 통해 구현할 수 있다. 마지막으로 책임과 역할, 거버넌스에 대해서는 신뢰할 수 있는 AI 생태계를 위해 표준 프로토콜, 윤리적 점검 체계, 에이전트 인증 등 체계의 필요성을 언급한다.

B. Future Roadmap

AI Agents의 핵심 발전 방향 5가지는 다음과 같다.

- 능동적(proactive) 지능: 이전 패턴을 바탕으로 작업을 요청할 것을 미리 예측하고 스스로 준비해두는 에이전트

- 외부 도구 통합

- 인과 추론

- 지속적 학습: 피드백 루프와 에피소드별, 세션의 경계를 넘나드는 메모리

- 신뢰 중심 운영: 검증 가능한 출력 로깅

Agentic AI의 핵심 발전 방향 6가지는 다음과 같다.

- 멀티 에이전트 스케일링

- 통합 오케스트레이션: 동적 역할 배정, 커뮤니케이션 관리, 참재적 충돌 해결

- 지속적 메모리: 장기적 운영 환경에서 연속성 지원

- 시뮬레이션 계획: 가상의 의사결정 모델링, 결과 예측 등을 통한 실제 상황의 오류 감소 효과

- 윤리적 거버넌스: 책임 구조, 검증 메커니즘, 도덕적/법적 경계 준수

- 도메인별 특화 시스템: 도메인 별 전문화를 통해 범용 에이전트 대비 성능 향상

한편, 미래 AI 시스템의 혁신적 패러다임으로 AZR(Absolute Zero Reinforced Self-play Reasoning)도 설명하고 있다. Agent 시스템을 포함하여 전통적인 AI는 사람이 라벨링하고 생산한 데이터과 정적인 지식 체계, 사전에 구축된 환경에 의존한다는 특징이 있다. 이에 대한 해결책으로 완전 자율형 추론 에이전트는 데이터가 부족한 환경에서도 자기 주도적 학습을 추구한다. 즉, 사전에 주어진 데이터나 학습이 없었음에도 스스로 유추하거나 검증할 수 있는 문제를 생성하는 방식으로 내부에서 스스로 해결하는 프로세스를 갖추는 것이다. 이는 간단한 체스 규칙만 알려주고 스스로 학습을 통해 인간 챔피언과 기존 체스 프로그램을 모두 압도한 AlphaZero와 같은 사례로 설명될 수 있다고 한다.

7️⃣ Conclusion

위 내용들을 다시 정리하면, AI 시스템의 진화 과정은 생성형AI에서 시작해 AI Agents, Agentic AI로 발전해왔다. Agentic AI는 분산 인지와 작업, 지속적인 메모리, 오케스트레이션과 멀티 에이전트 등의 특징을 가지며, 여전히 인과성을 인식하는 것이나 협력 과정의 제한점, 불예측성과 거버넌스 문제 등의 한계가 있다. 그러나, 단순한 작업 수행을 넘어 지능형 시스템으로 진화하는 과정으로 볼 수 있고, 논문의 분석은 Agentic AI의 발전 방향을 제시한다는 점에서 의의가 있다.