Paper review

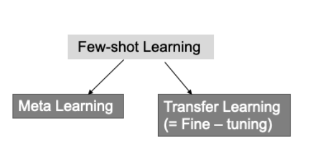

1.Meta-learning Sparse Implicit Neural Representations Review

Meta-sparse INRmeta-learning sparse implicit neural representations, 줄여서 meta-sparse INR 이라고 하는 이 논문은 21년 NeurIPS에 실린 논문입니다.

2023년 3월 26일

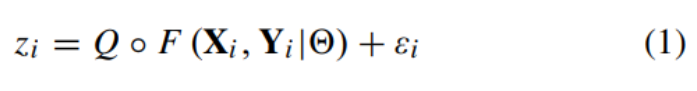

2.A Novel Image Quality Assessment With Globally and Locally Consilient Visual Quality Perception Review

TBA

2023년 3월 29일

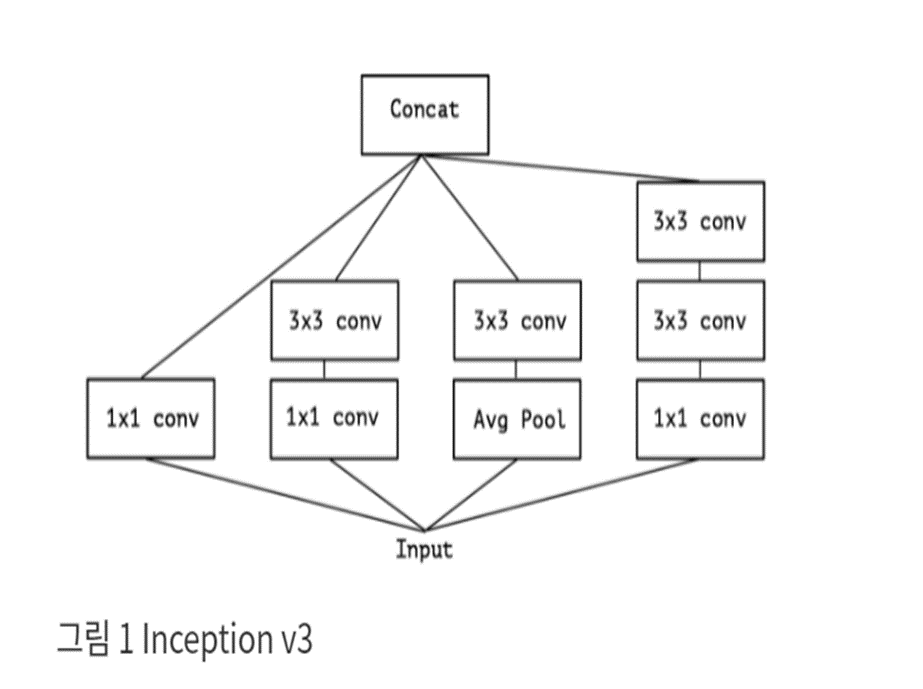

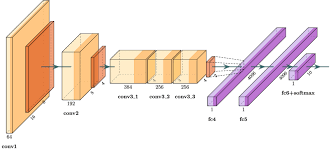

3.Xception

Deep Learning with Depth-wise Separable Convolutions

2023년 4월 5일

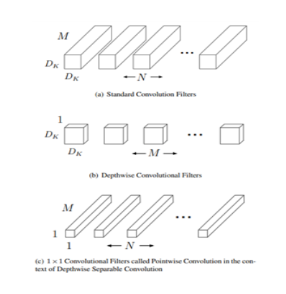

4.MobileNet

Not performance, but efficiency

2023년 5월 14일

5.Seeing Implicit Neural Representations as Fourier Series

highly detailed signal이 input에 fourier mapping을 적용함으로써 표현할 수 있고, 논문에서 제안하는 Fourier mapped perceptron이 SIREN의 히든 레이어 한층과 동일하다는 것이 핵심 내용입니다.

2023년 6월 4일

6.ImageNet Classification with Deep Convolutional Neural Networks (AlexNet)

Object recognition의 performance를 올릴 수 있는 방법에는 더 강력한 모델로 학습을 하거나, 더 큰 데이터셋을 준비하거나, overfitting을 막을 수 있는 더 나은 기술을 사용하는 것이 있다.

2023년 8월 1일

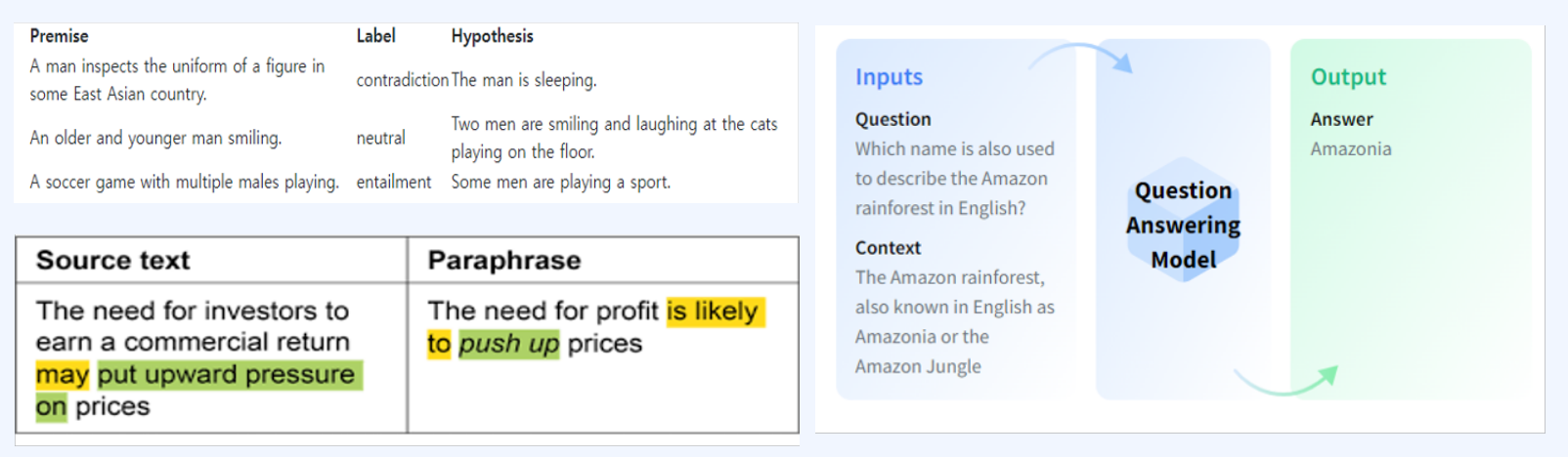

7.BERT: Bidirectional Encoder Representations from Transformers

BERT는 이름에서 알 수 있듯 transformer의 encoder 구조만을 사용해 bidirectional model을 만들었다.

2023년 8월 22일