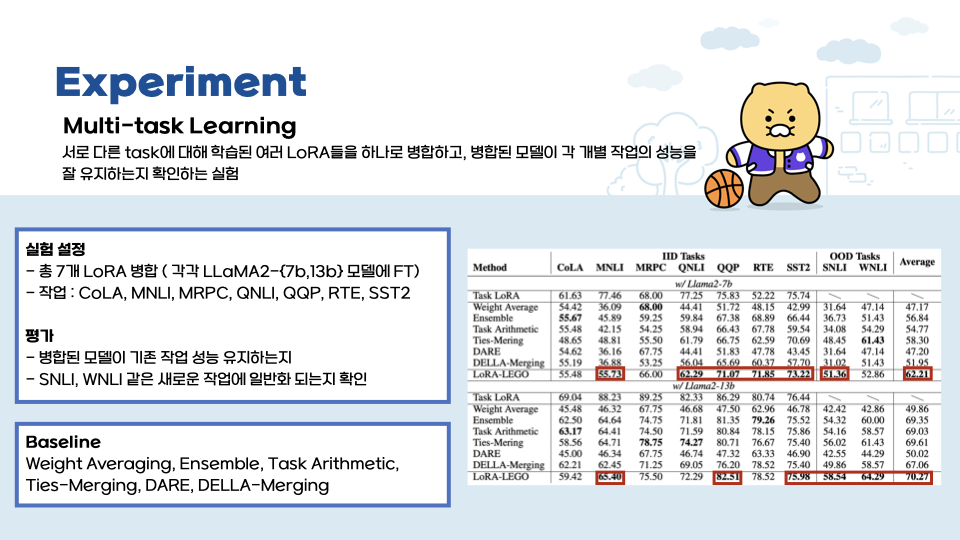

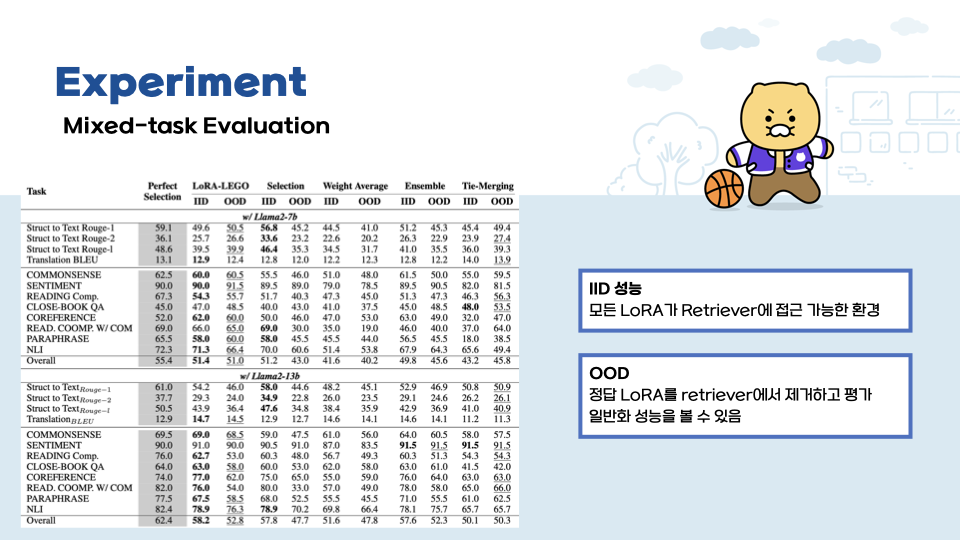

LoRA-LEGO 간단 설명

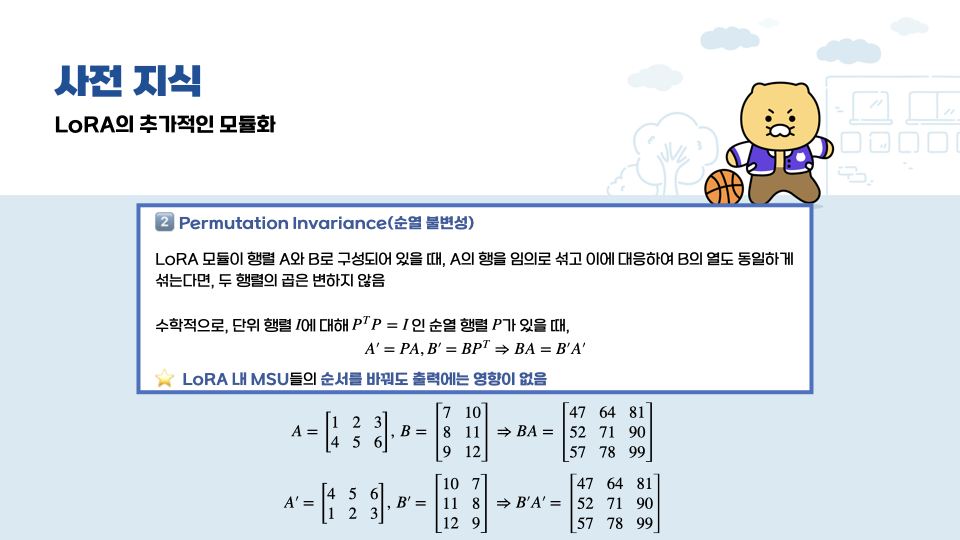

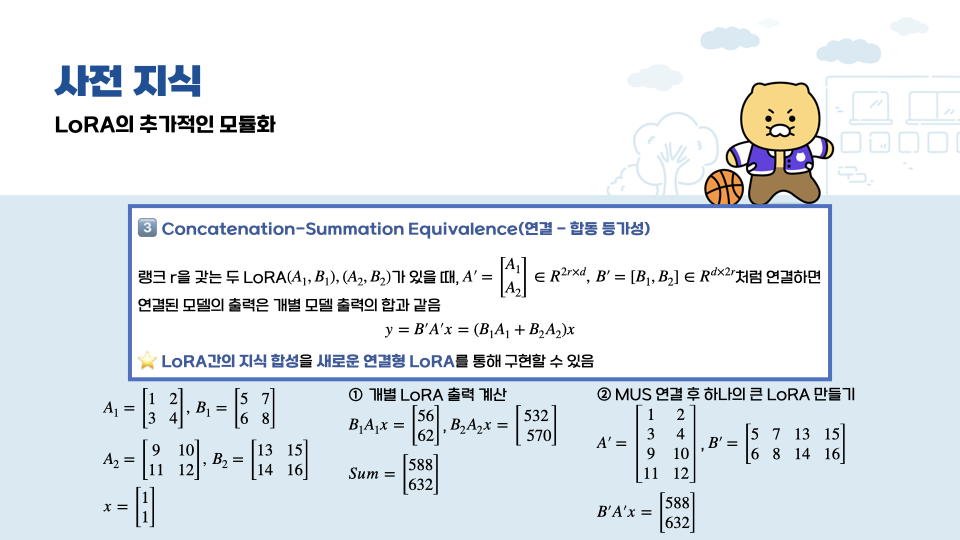

메인 내용에 들어가기 앞서 LoRA의 추가적인 모듈화에 대해서 알아야함

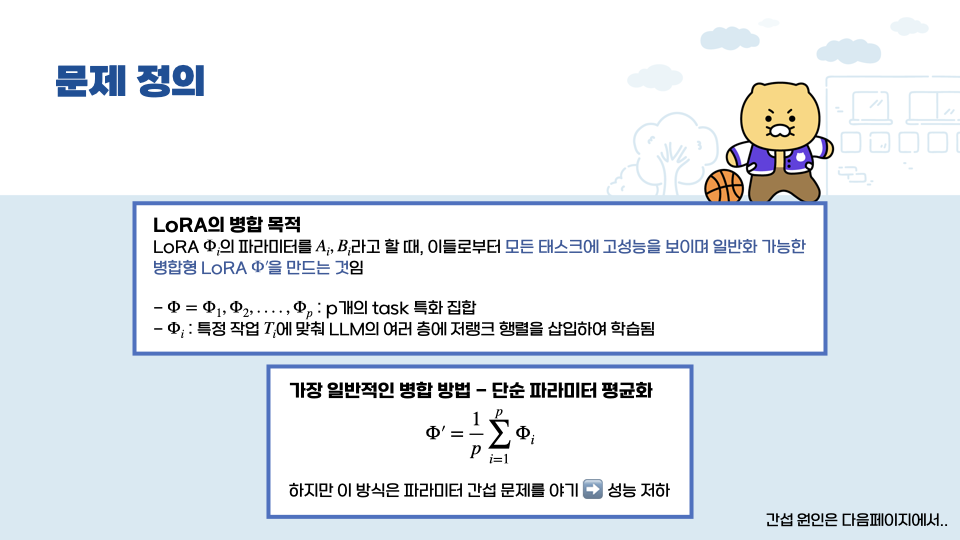

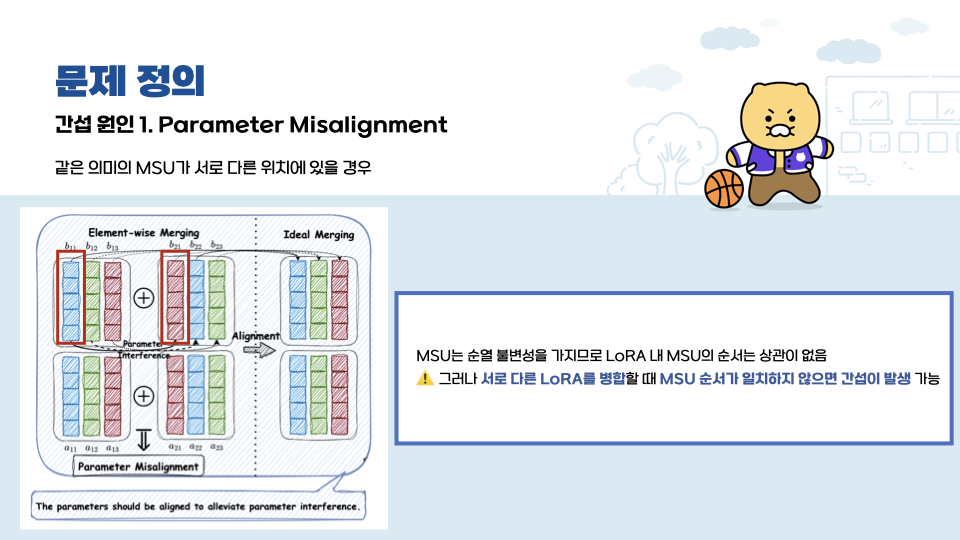

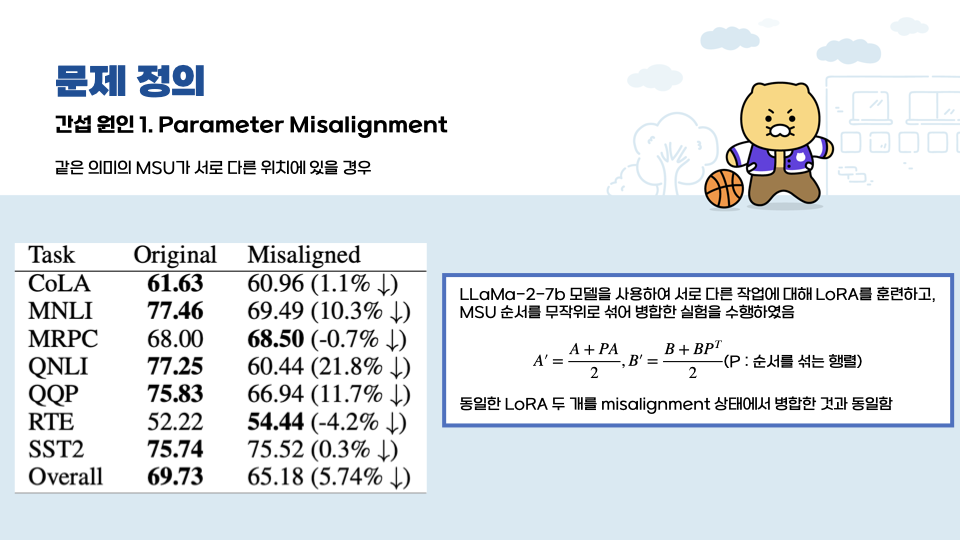

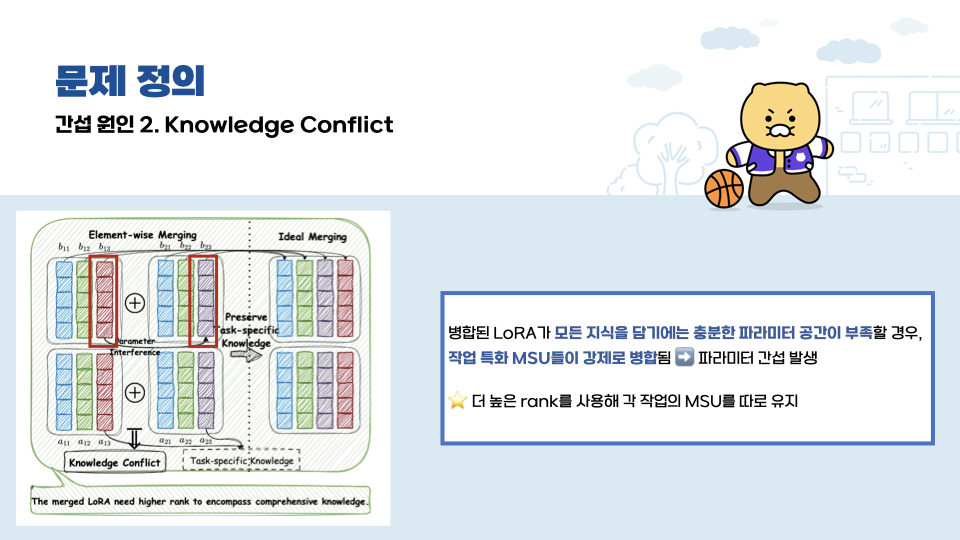

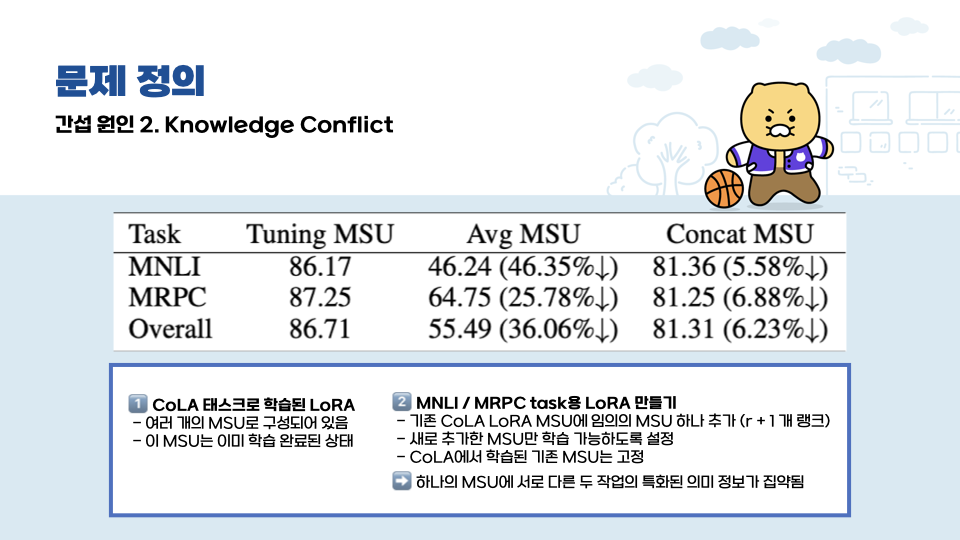

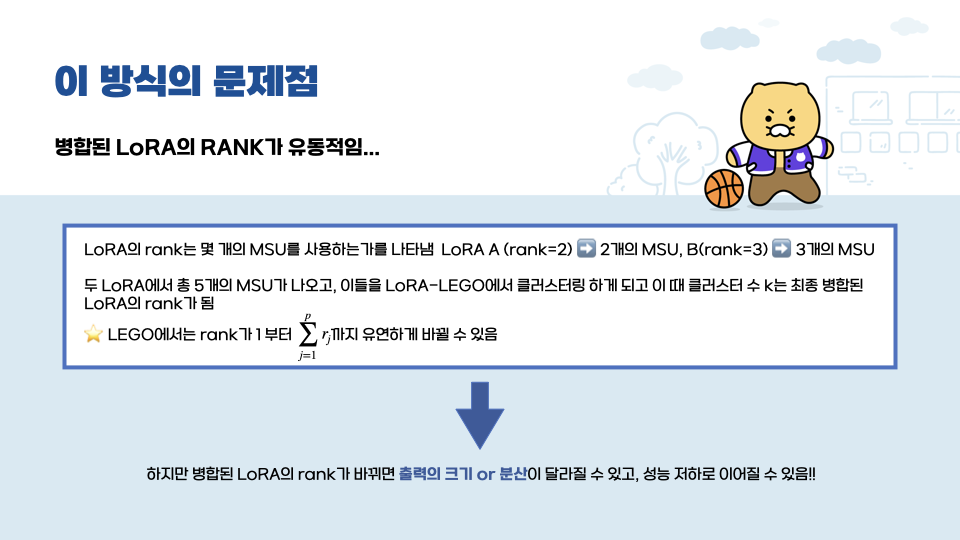

기존의 LoRA 병합 방식은 파라미터 간섭, 의미 유사성을 고려하지 않고, 서로 다른 rank를 가진 LoRA는 병합이 불가하므로 병합 후 성능 회복을 위해 추가 학습이 필요함

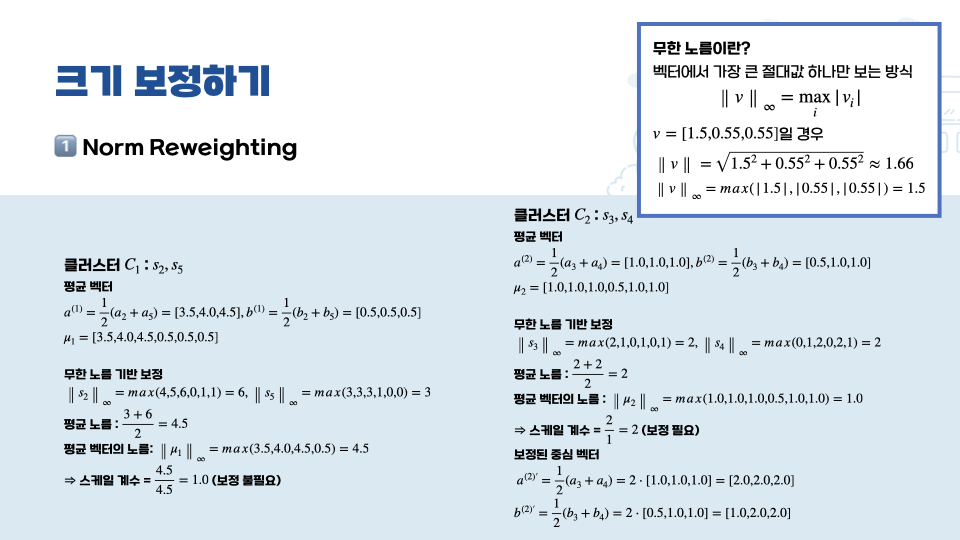

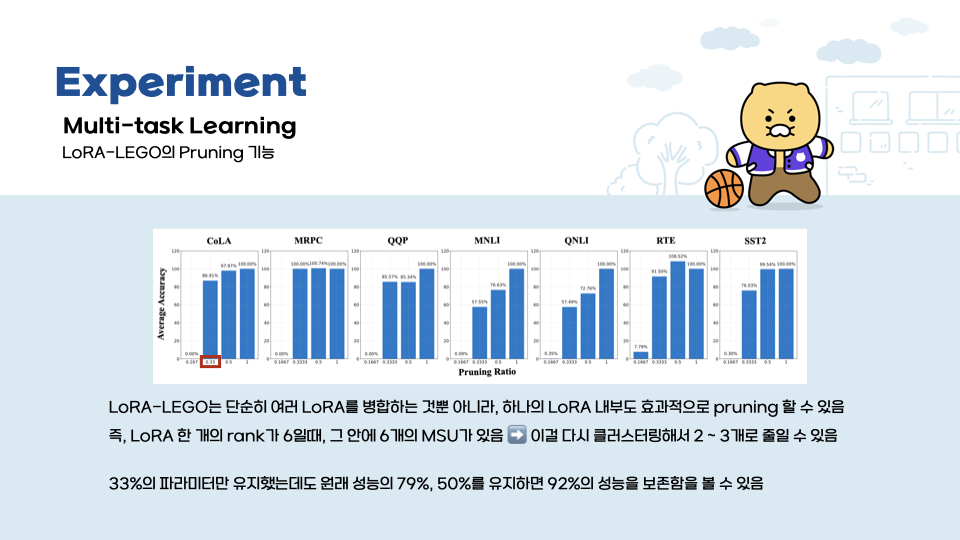

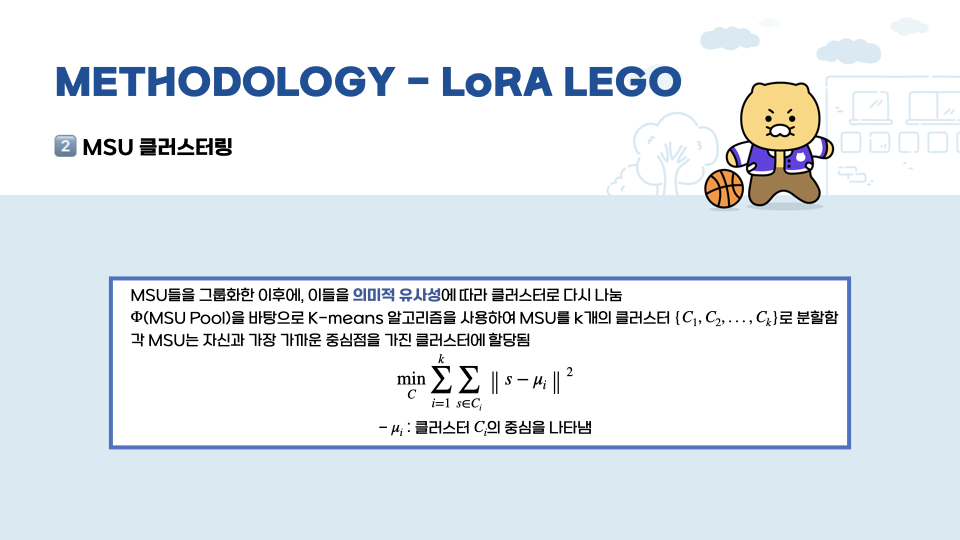

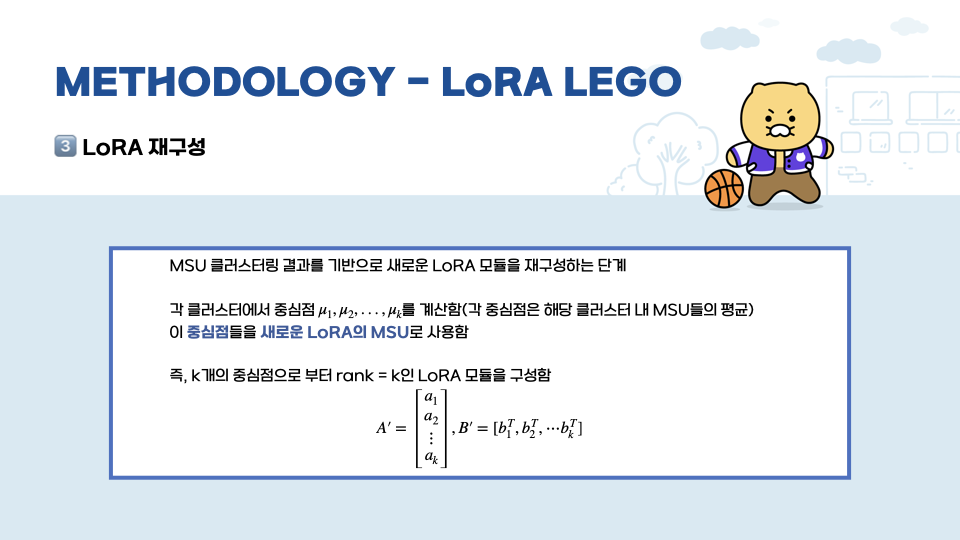

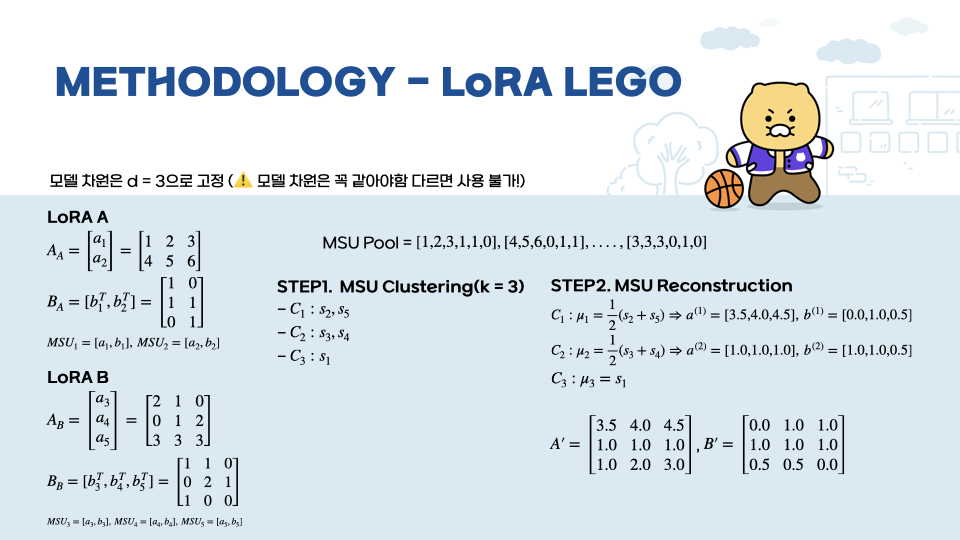

LoRA-LEGO는 모든 MSU를 벡터로 추출하고 클러스터링을 통해 의미적 유사한 MSU끼리 그룹화 하도록하여 비슷한 의미의 MSU가 병합되도록 하여 간섭을 최소화함.

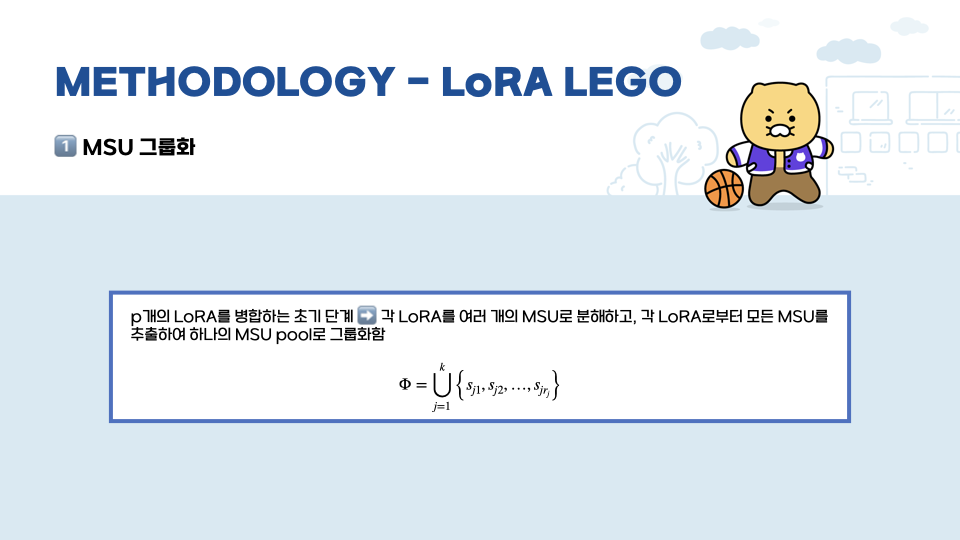

LoRA-LEGO 프레임워크는 세 가지 주요 단계로 구성된다

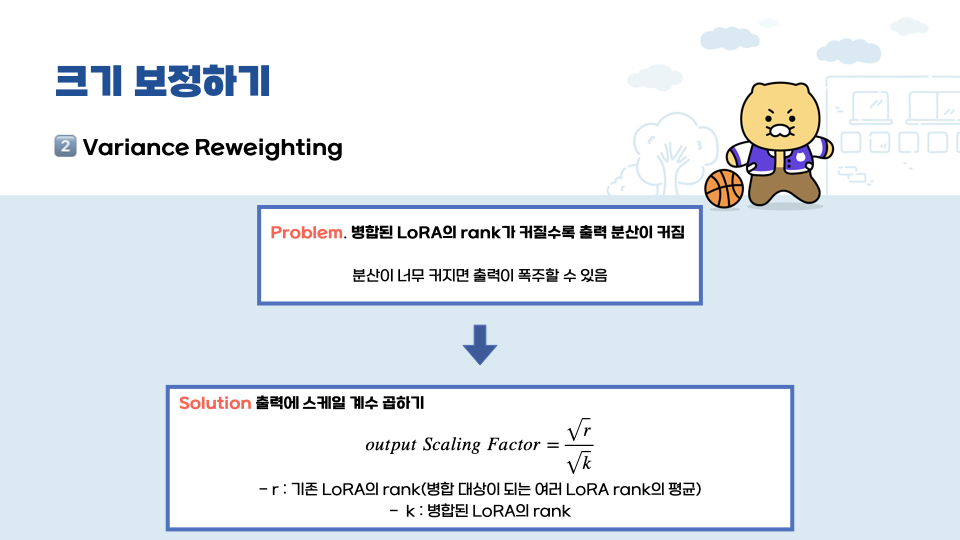

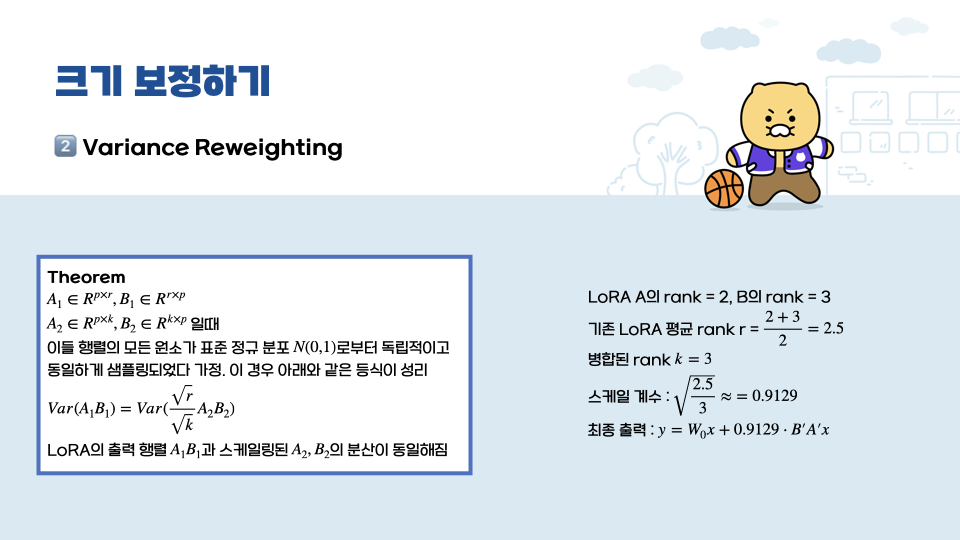

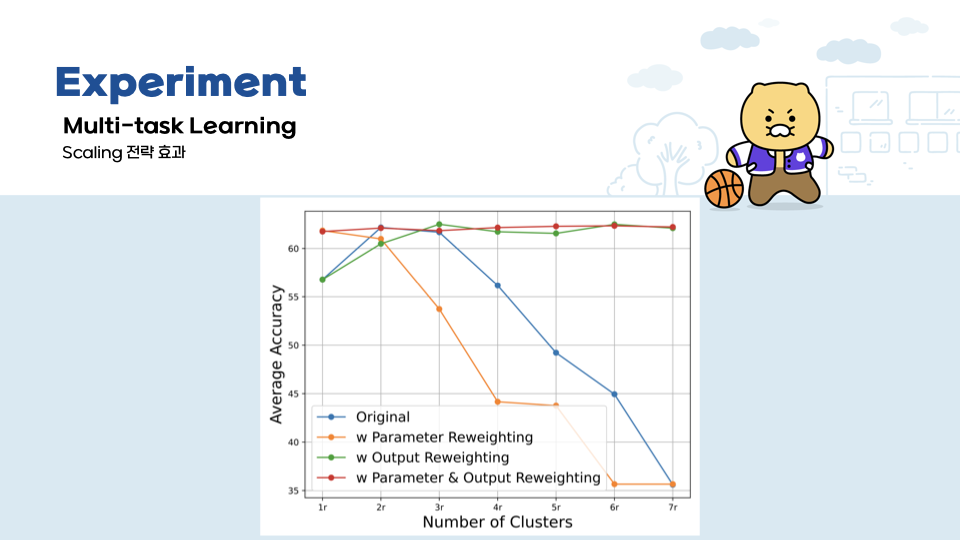

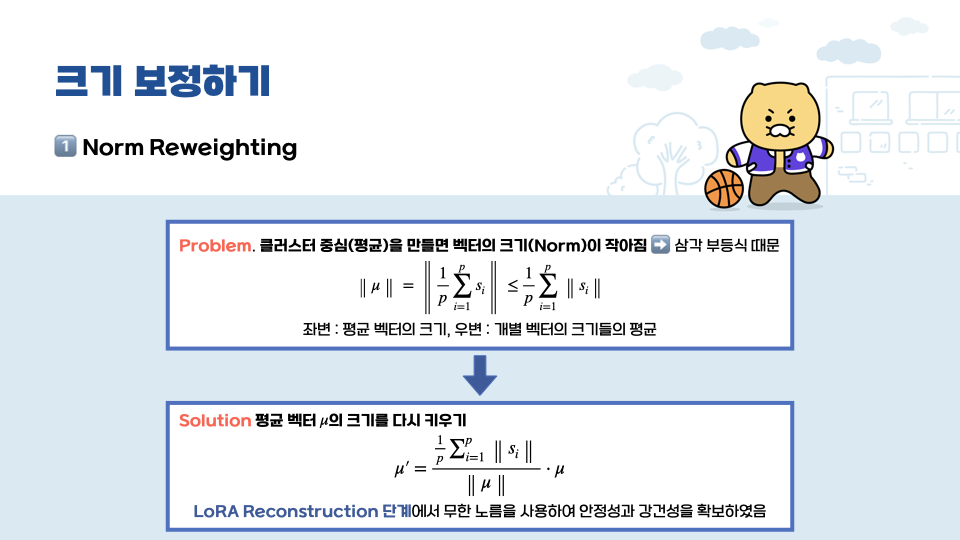

위 현상이 나타나면 가 작아져 결국 출력값이 줄어들게 되어 모델이 학습한 조정 효과가 약해져 성능 저하 가능성이 생김