GPT란

요즘 chat gpt에 대한 세간의 관심.. 화제.. 가 상당해서 대체 GPT가 뭔지 한번 알아보았다.

GPT

GPT란 Generative Pre-trained Transformer이다.

* Generative?

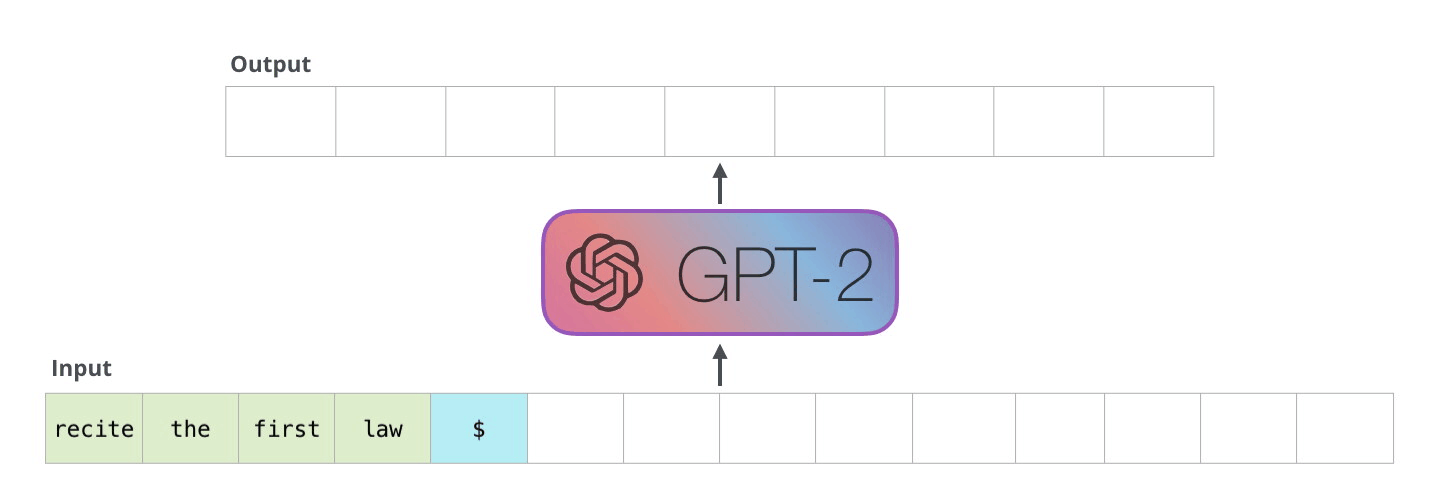

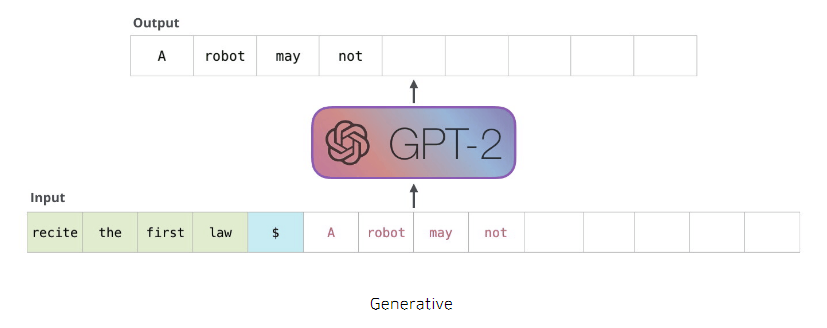

출처 : https://ainote.tistory.com/17- 위의 그림은 generative의 개념을 직관적으로 설명해준다. 그림과 같이 GPT는 한 단어가 들어오면 다음에 올 적절한 토큰을 생성하는 언어 모델이라고 할 수 있다.

* Pre-trained?

- GPT는 기존에 사전 학습된 말뭉치(Corpus)만을 가지고 다음에 올 토큰을 예측하는 방식으로 학습한다.

* Transformer?

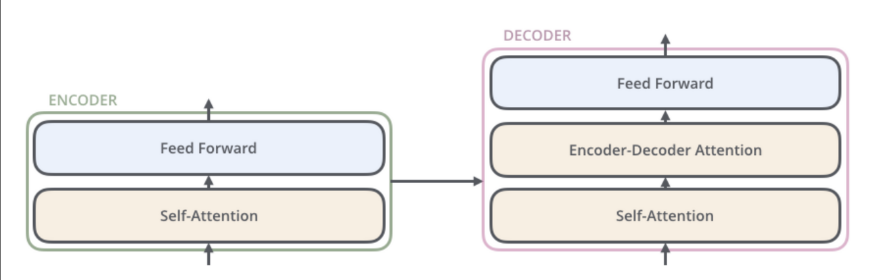

GPT의 모델 구조는 Transformer(2017년 구글에서 제시된 기계 번역을 위한 언어 모델)의 Decoder구조와 매우 유사하다.(Transformer의 decoder를 살짝 찾아봤는데 어려워서 그냥 그림으로 이해하고 넘어갔다...)

출처 : https://ahnjg.tistory.com/57➡️ 한 마디로 GPT는 방대한 양의 텍스트 데이터를 학습해서 적절한 문장을 만들어내는 인공지능의 일종이다.