Abstract

인공지능 훈련 시 '파괴적 망각 (catastrophic forgetting)' 문제를 해결하기 위해 딥 생성 재생(Deep Generative Replay)이라는 새로운 프레임워크가 제안되었다. 이는 생성 모델 (generator)과 과제 해결 모델 (solver)로 구성된 듀얼 아키텍처로, 이전 과제의 데이터를 샘플링해 새로운 과제 데이터와 함께 사용할 수 있다. 이 방법은 이미지 분류 등 여러 순차 학습에서 테스트되었다.

Introduction

심층 신경망의 지속적인 학습은 '파국적 망각' 문제로 인해 새로운 작업을 학습할 때 이전 작업 성능이 급격히 저하되는 현상을 겪는다. 기존 해결책은 과거 데이터를 저장하고 재생하는 에피소드 기억 시스템을 사용하여 문제를 완화하려 했으나, 이는 큰 작업 메모리를 필요로 하고 현실 상황에서 실행 가능하지 않은 경우가 많다. 인간과 대형 영장류는 제한된 경험에서도 새로운 지식을 배우고 과거 기억을 유지할 수 있는데, 이는 해마와 대뇌 피질을 포함한 이중 기억 시스템으로 인해 가능하다.

이를 해결하기 위해 딥 생성 재생 프레임워크가 제안되었다. 이 프레임워크는 과거 데이터를 참조하지 않고 생성 모델과 해결 모델을 사용하여 과거 데이터를 모방하고, 생성된 가상 데이터를 새로운 데이터와 함께 사용하여 모델을 업데이트한다. 생성적 적대 신경망(GANs)을 활용하여 과거 데이터를 모방하는 심층 생성 모델을 훈련시키고, 생성된 데이터는 과거 작업 해결 모델의 응답과 함께 쌍을 이루어 이전 작업을 나타낸다. 이러한 학자 모델은 새로운 작업을 배우면서 과거 지식을 잊지 않고, 개인정보 문제를 포함한 다양한 실제 상황에 적용될 수 있다. 훈련된 생성기가 입력 공간을 신뢰성 있게 재현하는 한 어떤 작업에도 적용 가능하다.

Related Works

파괴적 망각이 신경망의 근본적인 한계이자 높은 일반화 능력의 단점이라고 주장했다. 파국적 망각은 신경망이 입력의 내부 특징을 파라미터화하고 새로운 샘플 학습이 기존 표현을 변경시켜 발생한다고 알려져있다. 이를 해결하기 위해 모든 이전 데이터를 재생하는 등의 몇 가지 초기 해결책이 제시되었다.

Comparable methods

일부 연구들은 이전 데이터에 대한 접근이 제한된 상황에서,신경망의 파라미터를 최적화하면서 이미 통합된 가중치의 변화를 최소화하는 데 중점을 둔다.

- dropout과 L2 정규화: 새로운 학습의 간섭을 줄이는 데 도움이 된다

- Elastic Weight Consolidation (EWC): 이전 작업에 중요한 가중치를 보호하여 성능 저하를 완화한다.

- 작업별 파라미터 추가: 입력에 가까운 레이어는 공유하고, 독립적인 출력 레이어는 작업별 출력을 생성하여 파괴적 망각을 줄인다.

- 일부 파라미터의 학습률을 낮추어 망각을 줄인다.

- Learning without Forgetting (LwF): 이미지 분류 작업에서 공유 네트워크 파라미터의 변화를 최소화하면서 순차 학습 문제를 해결한다. 새로운 작업 입력에 대한 네트워크의 응답이 이전 작업에 대한 지식을 나타내며, 학습 과정 동안 유지된다.

Complementary Learning System(CLS) theory

몇몇 연구들은 파국적 망각을 완화하기 위해 보완적인 네트워크 아키텍처 설계에 집중하고 있다. '가상 리허설(pseudorehearsal)' 기법은 메모리 네트워크가 생성한 가상 입력과 목표를 사용하여 실제 데이터 없이 이전 입력-출력 패턴을 유지한다. 단순한 이진 패턴 작업에는 효과적이지만, 복잡한 데이터에는 한계가 있다. 최근 연구들은 해마의 구조를 모방한 아키텍처를 제안했지만, 고차원 입력을 생성하는 데 어려움을 겪는다.

generative replay 프레임워크는 가상 리허설과 달리 학습된 과거 입력 분포에서 가짜 입력을 생성하여, 생성된 과거 데이터와 실제 현재 데이터를 함께 사용해 네트워크를 공동 최적화한다. 이는 생성기가 입력 분포를 잘 회복하면 성능이 실제 데이터를 사용한 공동 훈련과 동일하다.

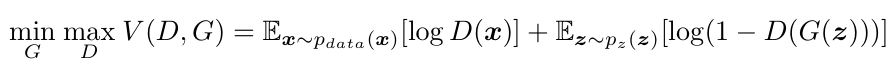

Deep Generative Models

생성 모델은 관찰 가능한 샘플을 생성하는 모델이다. 특히, 심층 신경망 기반의 심층 생성 모델은 주어진 실제 분포에서 생성된 샘플의 가능성을 최대화한다. 변분 오토인코더(VAE)와 생성적 적대 신경망(GAN)은 이미지와 같은 복잡한 샘플을 모방할 수 있다. GAN 프레임워크는 생성자(G)와 판별자(D) 사이의 제로섬 게임을 정의하며, 생성자는 실제 분포를 모방하고 판별자는 생성된 샘플과 실제 샘플을 구별하는 법을 배운다.

GAN과 VAE의 목표

Generative Replay

지속적 학습 프레임워크에서 해결해야 할 작업의 순서를 N개의 작업 T = (T1, T2, ..., TN)로 정의한다.

- 정의 1: 작업 Ti는 데이터 분포 Di에서 모델을 최적화하는 것이다. 여기서 훈련 예제 (xi, yi)가 추출된다

- 정의 2: scholar H는 <G,S> 튜플로, 생생 모델 G는 실제와 유사한 샘플을 생성하고 작업 해결 모델 S는 모든 작업 순서 T의 작업을 수행한다.

전체 목표는 작업 시퀀스에서의 모든 작업의 loss의 unbiased 합을 최소화하는 것이다.

Proposed Method

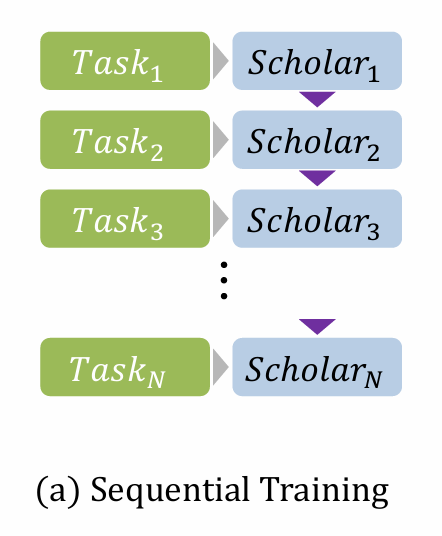

우리는 학자 모델에서 순차 학습을 고려한다. 단일 학자 모델을 훈련하는 것은 일련의 학자 모델을 훈련하는 것과 동일하다.

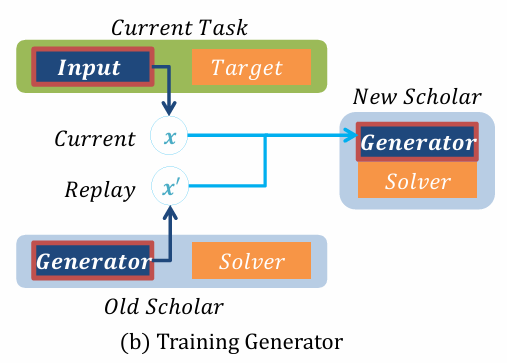

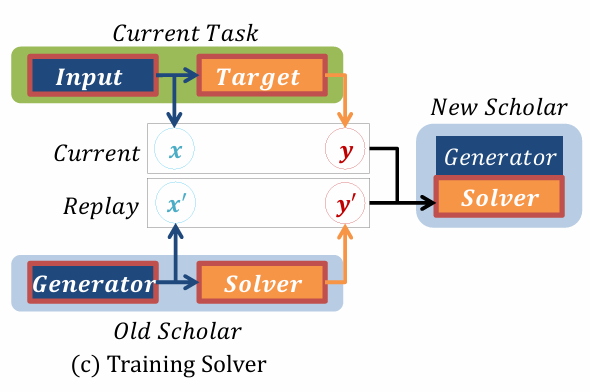

학자 모델을 다른 학자 모델에서 훈련하는 것은 generator와 solver의 두 가지 독립된 절차로 구성된다.

새로운 generator는 현재 작업 입력 x와 이전 작업에서 재생된 입력 x’를 받는다. 실제 샘플과 재생 샘플은일정한 비율로 혼합된다. generator는 누적 입력 공간을 재구성하는 법을 배운다.

새로운 solver는 실제 데이터와 재생 데이터의 동일한 혼합에서 추출한 입력과 목표를 연결하도록 훈련된다. 여기서 재생된 목표는 재생된 입력에 대한 이전 해결자의 응답이다.

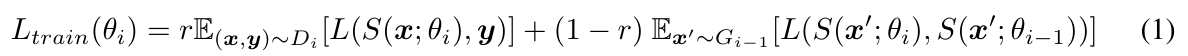

훈련 loss와 테스트 loss는 아래와 같다.

학자 모델의 구성

생성적 적대 신경망(GANs) 프레임워크에서 훈련된 생성기와 작업 순서를 해결할 수 있는 적절한 아키텍처를 가진 해결자를 사용하여 학자 모델을 구축한다.

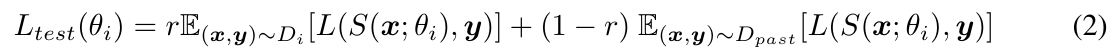

Preliminary Experiment

학습된 학자 모델만으로 빈 네트워크를 훈련시키기에 충분하다. MNIST 손글씨 숫자 데이터베이스 분류를 진행했다. 학자 모델 순서를 이전 학자로부터 생성 재생을 통해 처음부터 훈련시킨 결과 학자 모델이 정보를 잃지 않고 지식을 전달한다는 것을 관찰했다.

Experiments

생성 재생 프레임워크는 순차 학습 설정에서 탁월한 성능을 보여준다. 생성 모델의 품질이 유일한 성능 제약이며, WGAN-GP 기법을 사용해 최상의 결과를 얻었다. 생성 재생은 이전 작업이나 새로운 작업의 성능을 저하시키지 않고 순차 학습을 가능하게 한다. 독립적인 작업과 관련 도메인에서 네트워크를 훈련하여 망각의 정도를 조사했고, 생성 재생이 학자 네트워크 설계에서 지속적 학습을 가능하게 하며 다른 구조와도 호환된다는 것을 입증했다. 또한, 학자 네트워크가 서로 다른 작업에서 지식을 모아 메타 작업을 수행할 수 있음을 보여줬다.

생성 재생을 사용한 모델(GR), 정확한 재생(ER), 실제 분포와 유사하지 않은 경우(Noise), 기본 해결자(None) 네트워크의 성능을 비교했다.

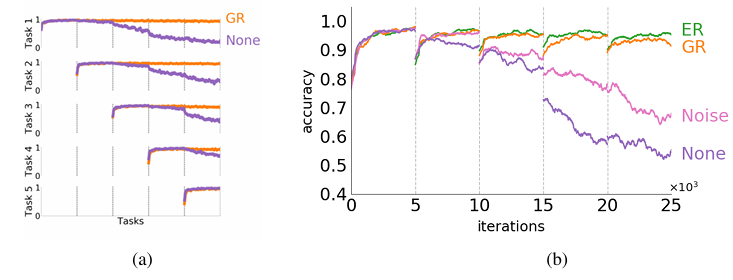

Learning independent task

지속적 학습에서 MNIST 손글씨 숫자 이미지의 픽셀 값을 무작위 순열로 셔플하여 작업을 구성하고, 해결자가 이를 원래 클래스에 분류하는 실험을 수행했다.

(a)에서 생성 재생을 사용한 해결자 (ER) 는 여러 작업에 대한 순차 학습 동안 이전 작업 성능을 유지했지만, 단순하게 훈련된 해결자(None)는 파적 망각을 겪었다.

(b)에서 누적 작업에 대한 평균 정확도 측면에서 생성 재생을 사용하는 해결자는 훈련된 작업에서 거의 완전한 성능을 달성한 반면, 단독으로 순차 학습된 해결자는 파적 망각을 겪었다(None). 무작위 가우시안 노이즈를 재생하는 것은 성능 저하를 완화하는 데 도움이 되지 않았다(Noise)

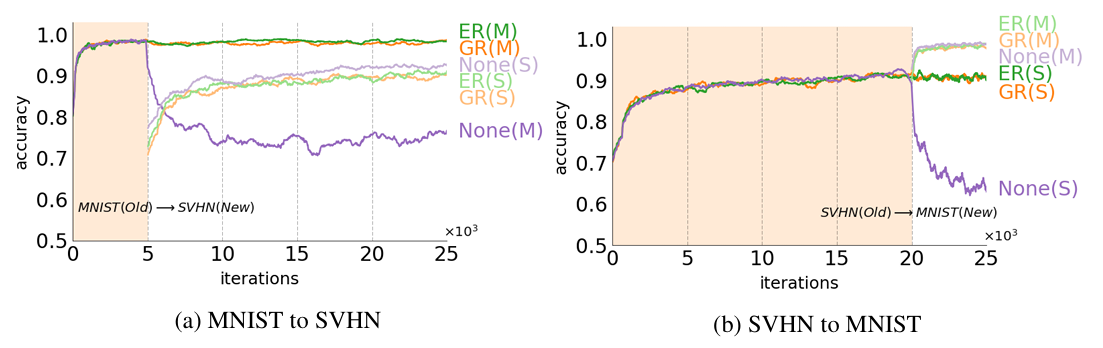

Learning new domains

동일한 네트워크에서 독립적인 작업을 훈련하는 것은 비효율적이다. 여러 도메인에서 작동하는 모델은 단일 도메인보다 더 나은 이해와 일반화를 제공할 수 있다.

MNIST와 SVHN 데이터셋을 순차적으로 분류하는 모델을 훈련하여 생성 재생의 효과를 테스트했다. 생성 재생을 사용한 해결자 (ER)는 새로운 작업을 수행하면서도 이전 작업의 성능을 유지한 반면 단독으로 훈련된 해결자 (None)는 파괴적 망각을 겪었다.

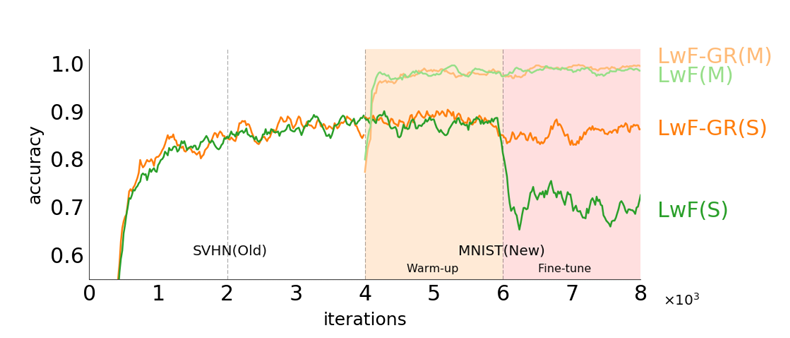

생성 재생은 다른 지속적 학습 모델, Learning without Forgetting (LwF)과도 호환된다. LwF는 현재 작업 입력을 재생하여 과거 지식을 상기시키지만, 생성 모델을 사용하면 이전 작업 입력과 유사한 샘플을 생성할 수 있다.

LwF 알고리즘과 LwF-GR 변형의 성능을 비교한 결과, LwF 알고리즘은 미세 조정 시 첫 번째 작업의 성능을 잃었지만, 생성 재생을 사용하면 네트워크는 대부분의 과거 지식을 유지했다.

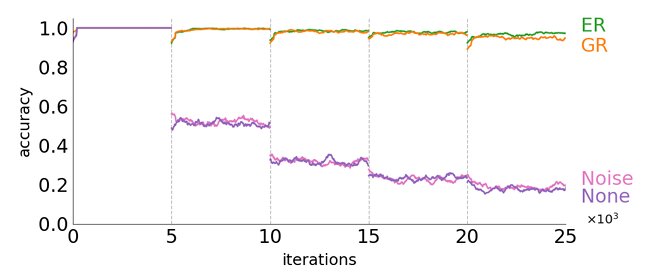

Learning new classes

생성 재생이 작업 간 입력과 목표가 편향된 경우에도 과거 지식을 회상할 수 있음을 보여주기 위해, 네트워크를 분리된 데이터로 순차적으로 훈련하는 실험을 진행했다. 에이전트는 한 번에 몇 개의 클래스 예제에만 접근할 수 있으며, 모든 클래스를 올바르게 분류해야 한다.

MNIST 데이터셋을 5개의 분리된 하위 집합으로 나누어 테스트한 결과, 단순하게 훈련된 분류기는 이전 클래스를 잊고 새로운 데이터만 학습했다. 노이즈 생성기를 사용한 모델 (Noise)은 지식을 유지하지 못했다. 그러나 입력과 출력 분포를 모두 재구성한 생성 재생 모델 (GR)은 이전에 학습한 클래스를 회상하고 모든 클래스를 구별할 수 있었다.

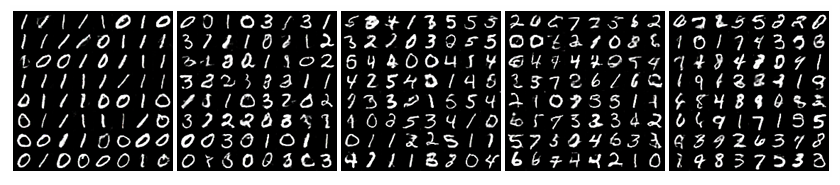

훈련된 생성기에서 생성된 샘플

생성기는 이전 생성기의 생성 샘플을 모두 모방하도록 훈련되었으며, 생성기는 지금까지 만난 모든 예제의 누적 입력 분포를 재현한다.

Discussion

딥 생성 재생 프레임워크는 가짜 데이터를 생성하고 재연하여 여러 작업에서 순차 학습을 가능하게 한다. 이 프레임워크는 생성기와 해결자로 구성된 학자 모델을 사용하여 지식을 유지하고 전이한다. 생성 재생은 저장된 네트워크에서 생성된 입력-목표 쌍만으로 이전 지식을 유지하므로, 이전 작업과 새로운 작업의 성능을 균형 있게 유지할 수 있다. 또한, 네트워크가 작업 목표를 향해 공동으로 최적화되므로 생성기가 이전 입력 공간을 회복하면 전체 성능을 달성할 수 있다.

그러나 생성 재생의 효율성은 생성기의 품질에 크게 의존하며, 성능 저하를 일으킬 수 있다. EWC와 LwF 같은 정규화 방법도 파괴적 망각을 완화하지만, 추가 손실 항목으로 인해 새로운 작업과 이전 작업의 성능 간에 트레이드오프가 발생할 수 있다. EWC, LwF, 논문의 접근 방식은 각각 다른 수준에서 메모리 유지에 기여하며, 세 가지 프레임워크의 혼합이 지속적 학습의 문제에 더 나은 해결책을 제공할 수 있다.