본 < 지능형 시스템 > 시리즈는 부산대 정보컴퓨터공학과 차의영 교수님의 '지능형 시스템' 강의에서 배운 내용을 바탕으로 작성합니다.

🧠 인공신경망이란?

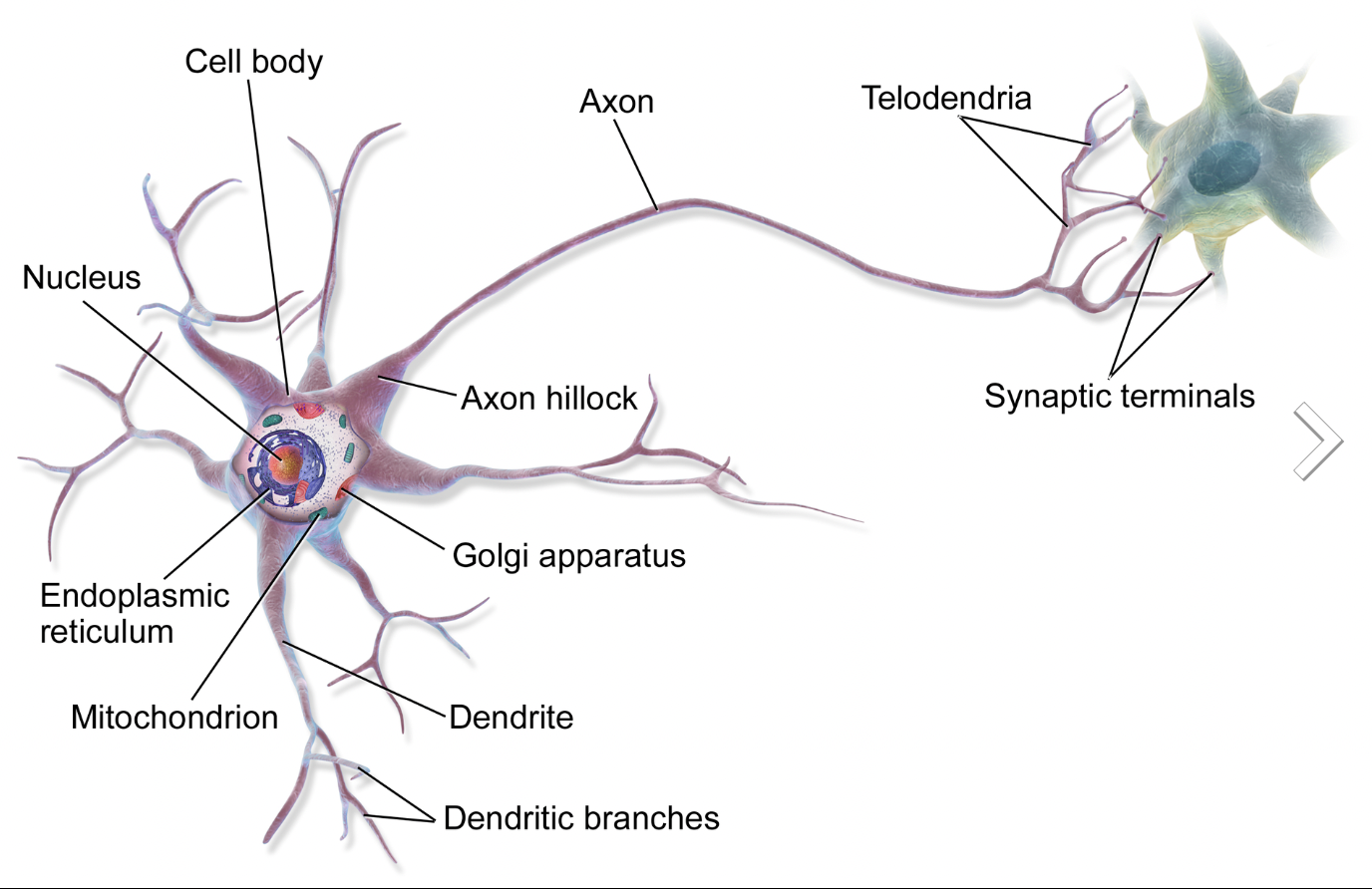

➡️ axon(축삭돌기) 연결을 통해 서로간에 통신을 하는 실제의 신경 시스템을 추상적으로 모방한 것

🧠 신경망의 배경

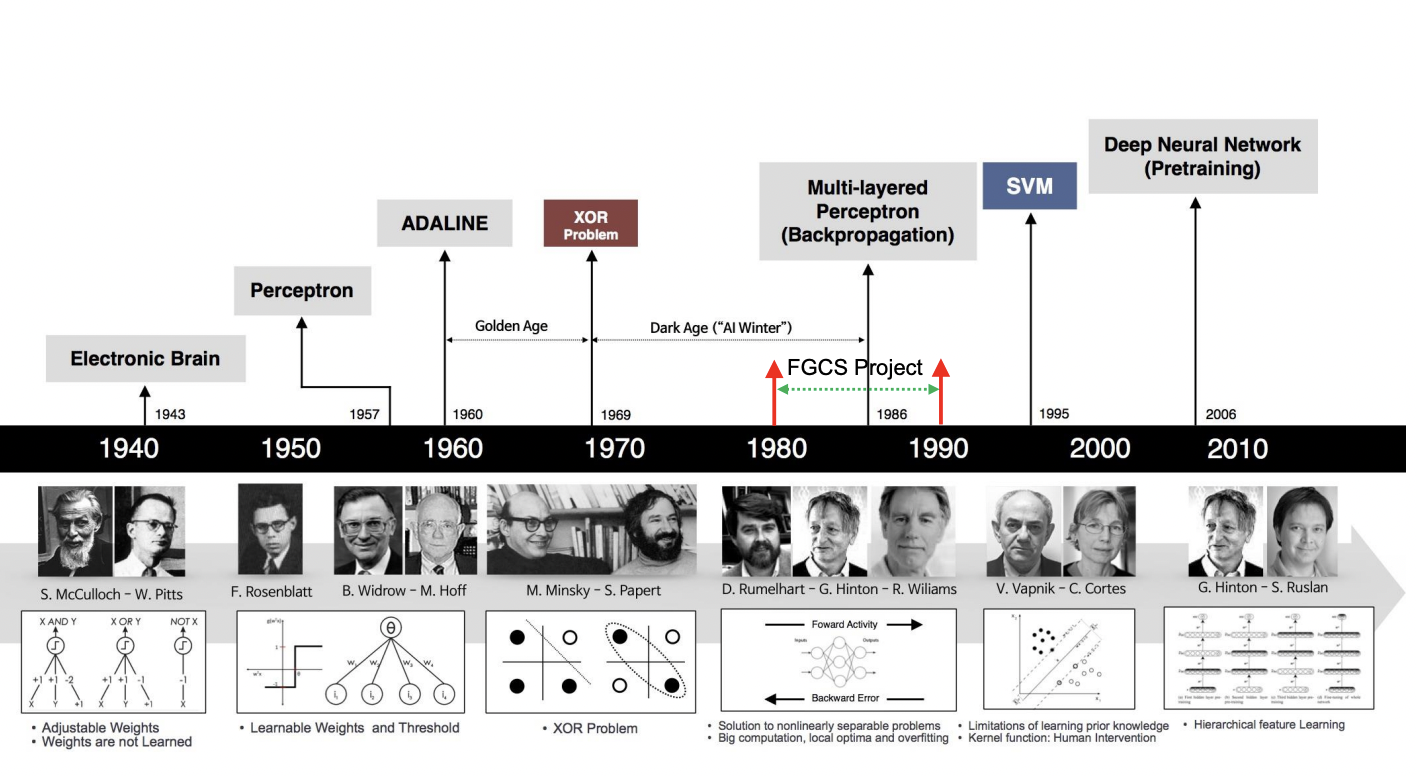

- 1940년대 : 최초의 구체적인 신경회로망 컴퓨터 작성 시도

- 1949 : D.O. Hebb가 최초로 learning rule 제안

- 1962 : Rosenblatt의 Perceptron

🙆♂️ Minsky, McCarthy (symbol manipulating AI group)

-> 인간의 능력을 모방하는데 중점

🙆♂️ Rosenblatt

-> 어떻게 두뇌가 그것을 하는가에 관심 - 1969 : Minsky, Papert에 의해 Perceptron 발간

- 1970년대 : 침체기

- 1970년대말 : 서서히 연구 시작

✔️ Error Backpropagation에 의한 다층 Perceptron의 학습방법 발견 - 1982 : John Hopfield model 등장

- 1983 : Fahlmann, Hinton, Sejnowsky의 Boltzmann machine

- 1986 : Hecht Nielsen의 상업용컴퓨터 TRW MARK 3-I

🧠 인공 뉴런

➡️ 생물학적 뉴런의 특성을 모방

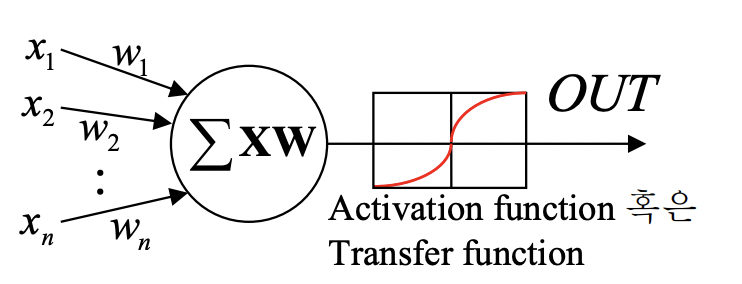

인공 뉴런의 요소들

| 요소 | 설명 |

|---|---|

| 입력 | 입력의 집합 X = (x1,x2, ... , xn) |

| 가중치 | 가중치(weight)의 집합 W = (w1,w2, ... , wn) ➡️ 신호의 영향도, 시냅스 효율 |

| 가중합 |  |

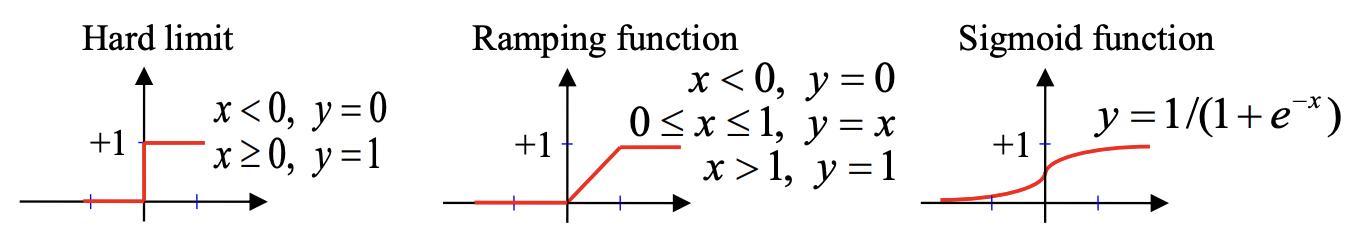

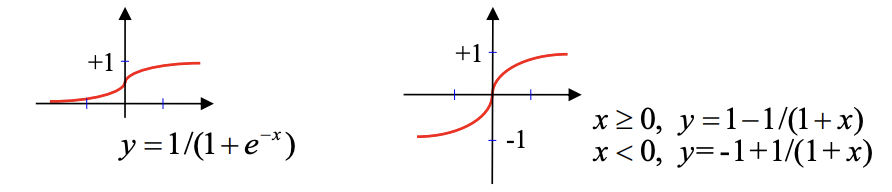

| 활성화 함수 | 🌹 스쿼싱 함수(squashing function) ➡️ 변수값에 상관없이 어떤 상한하한값을 못넘게 압축하는 함수  🌹 시그모이드 함수(sigmoid function) 🌹 시그모이드 함수(sigmoid function) ➡️ S자 모양의 함수 ex) logistic, hyperbolic tangent  |

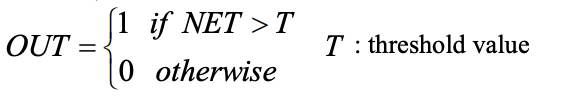

| 출력 |  |

인공신경망의 전파 규칙

1. 입력값과 가중치를 각각 곱해 입력 가중합 (NET)를 구한다.

2. 가중합을 활성화 함수의 입력으로 넣는다.

3. 함수 결과 값(== 학습 완료시 결과값)을 출력한다.

🧠 신경망의 분류

학습 방법에 따른 분류

- 지도학습(supervised learning) ➡️ Perceptron, ADALINE(LMS), Multilayer Perceptron,

HMM, DBNN - 비지도학습(unsupervised learning) ➡️ Neocognitron, Competitive Learning, ART

- 고정가중치(fixed weight) ➡️ Hamming Net, Hopfield Net, Combinatorial Optimization

입력 형태에 따른 분류

- 이진수(binary)

- 연속값(continuous value)

구조에 따른 분류

- Feedforward

- Feedback

출처 : https://en.wikipedia.org/wiki/Axon

참고한 자료 : http://blog.skby.net/%EC%9D%B8%EA%B3%B5%EC%8B%A0%EA%B2%BD%EB%A7%9D-artificial-neural-network/