인공지능

1.Adversarial Search

적이 있을 때 승리하기 위한 알고리즘, "Game Search" 라고도 함 상대방의 행동을 예측하고 해당 예측을 바탕으로 이익을 최대화하는 게 목적필요한 요소는 아래와 같다.S0, 초기 상태: 시작 시점에서의 게임의 설정To_Move(s): 상태 s에서 수를 둘 플레이

2021년 10월 10일

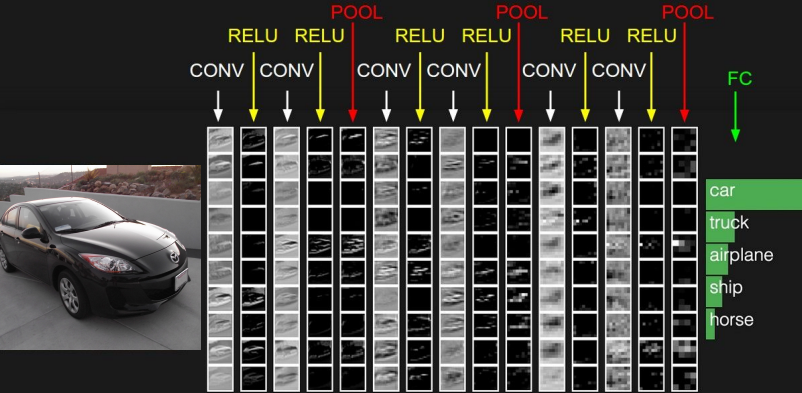

2.Neural Network with Pytorch #1

MLP, CNN의 개념 및 학습 성능 비교실험의 dataset으로 CIFAR 10을 사용했다. Neural Network with Pytorch #2에서 CNN에 대한 내용으로 이어간다.

2021년 12월 30일

3.Neural Network with Pytorch #2

MLP, CNN의 개념 및 학습 성능 비교실험의 dataset으로 CIFAR 10을 사용했다.전체 소스코드는 차후에 github으로 제공한다.

2021년 12월 31일

4.LSTM/시계열 데이터 예측

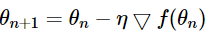

앞서 이론적으로 공부한 RNN/LSTM을 Pytorch를 통해 작성하여 이더리움 가격 그래프를 분석하고 Ethereum의 가격을 예측하는 실습을 진행했다.김훈 교수님의 기초 딥러닝 강의를 통해 앞선 포스트에 추가적으로 이론적인 내용을 학습했다.몇일 연속의 데이터를 이용

2022년 7월 29일