출처: https://www.slideshare.net/yongho/ss-79607172

출처: https://www.slideshare.net/yongho/ss-79607172

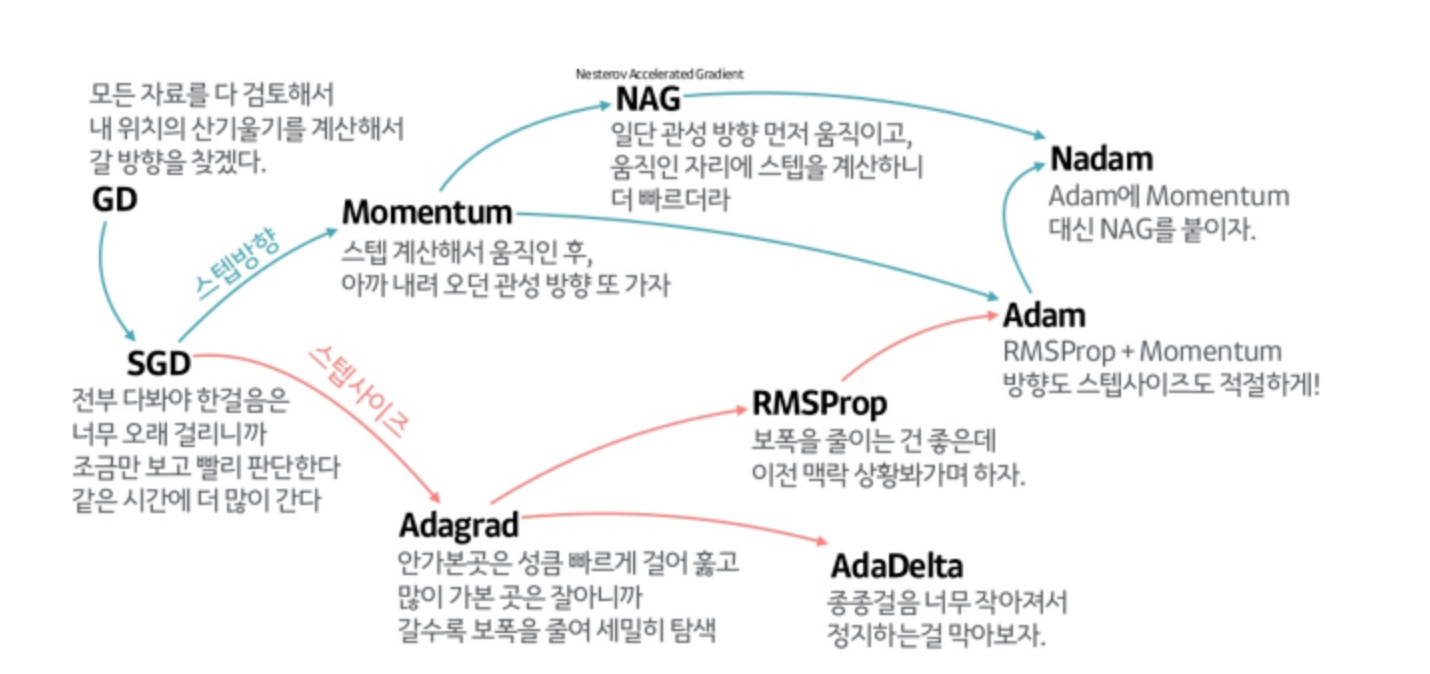

📌Optimizer

💡 딥러닝 학습 과정에서 사용되는 Optimizer에 대한 종류와 특징을 알아보자

Optimizer의 종류

- GD(경사하강법)

- SGD(확률적 경사 하강법)

- Momentum(모멘텀)

- Adagrad(Adaptive Gradient, 아다그라드)

- RMsprop(알엠에스프롭)

- Adam(Adaptive Moment Estimation, 아담)

- ❌ AdaDelta(Adaptive Delta, 아다델타)

- NAG (Nesterov Accelerated Gradient)

- Nadam (Nesterov-accelerated Adaptive Memoment Adam)

1. GD

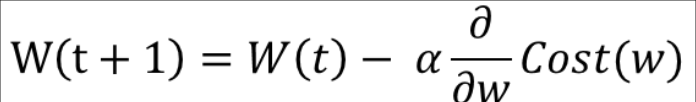

Neural network의 weight을 조절하는 과정에는 보통 ‘Gradient Descent’ 라는 방법을 사용한다. 이는 네트워크의 parameter들을 θ라고 했을 때, 네트워크에서 내놓는 결과값과 실제 결과값 사이의 차이를 정의하는 함수 Loss function J(θ)의 값을 최소화하기 위해 기울기(gradient) ∇θJ(θ)를 이용하는 방법이다

θ = θ − η∇θJ(θ)

이 때 η는 미리 정해진 걸음의 크기 ‘step size’ 로서, 보통 0.01~0.001 정도의 적당한 크기를 사용한다.

🔥 Loss Function을 계산할 때

- Batch Gradient Descent(BGD) :전체 데이터 셋에 대한 에러를 구한 뒤 기울기를 한번만 계산하여 모델의 parameter 를 업데이트 하는 방법

- Stochastic Gradient Descent (SGD) : 하나의 데이터에 대한 기울기 값을 구해 업데이트를 진행하고 그 과정을 반복하여 총 n회 업데이트를 진행

- Mini-batch Gradient Descent (MGD): 전체 데이터셋에서 뽑은 Mini-batch의 데이터에 대해서 각 데이터에 대한 기울기를 구한 뒤, 그것의 평균 기울기를 통해 모델의 parameter 를 업데이트 하는 방법으로 Batch 보다 빠르고 SGD 보다 낮은 오차율을 가진다.

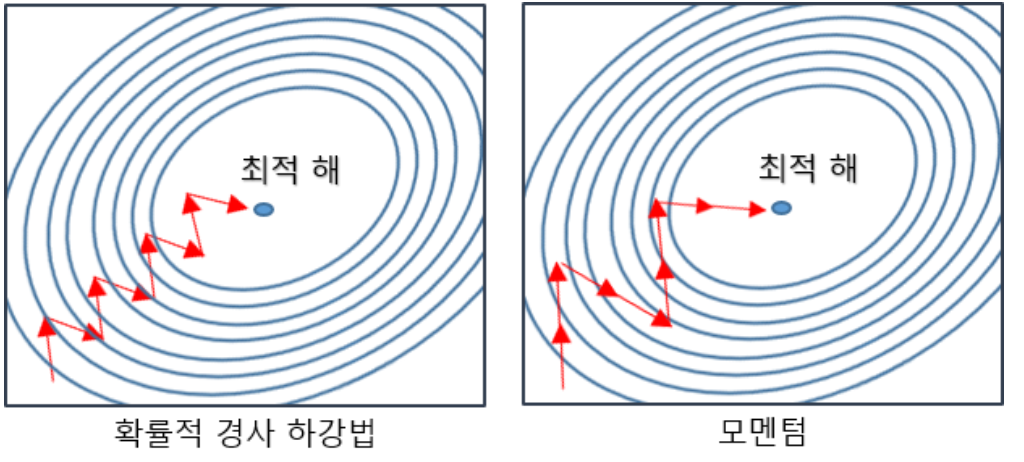

빨간색의 SGD가 우리가 알고 있는 Naive Stochastic Gradient Descent 알고리즘이고, Momentum, NAG, Adagrad, AdaDelta, RMSprop 등은 SGD의 변형이다.

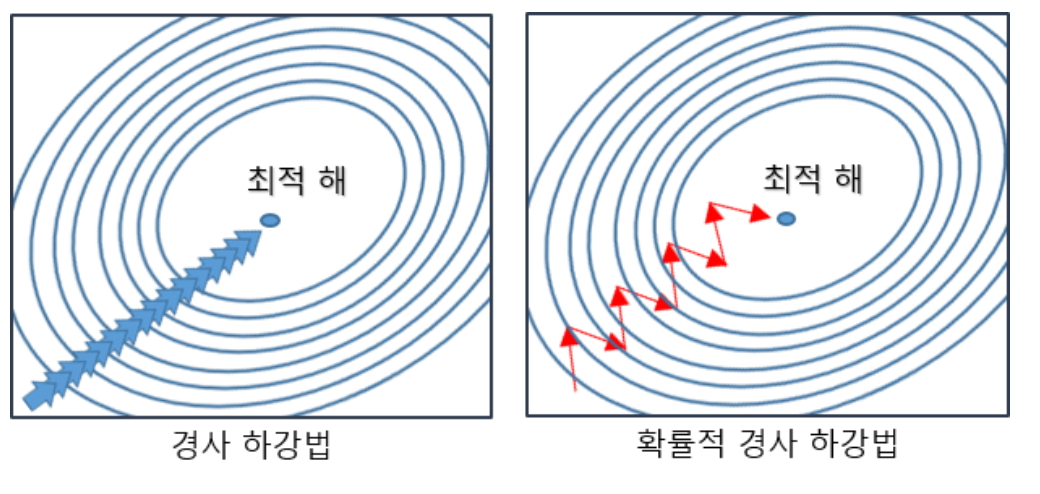

SGD는 다른 알고리즘들에 비해 성능이 낮다. 다른 알고리즘들 보다 이동속도가 현저하게 느릴뿐만 아니라, 방향을 제대로 잡지 못하고 이상한 곳에서 수렴하여 이동하지 못하는 모습도 관찰할 수 있다.

2. SGD

확률적 경사 하강법(Stochastic Gradient Descent)는 경사 하강법과 다르게 한번 학습할 때 모든 데이터에 대해 가중치를 조절하는 것이 아니라, 랜덤하게 추출한 일부 데이터에 대해 가중치를 조절한다. 결과적으로 속도는 개선되었지만 최적 해의 정확도는 낮다.

α는 Learning Rate

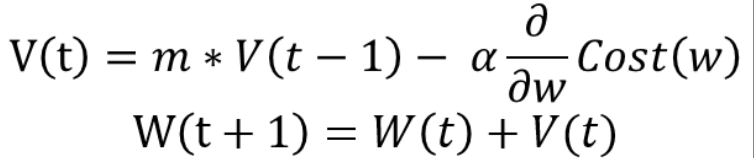

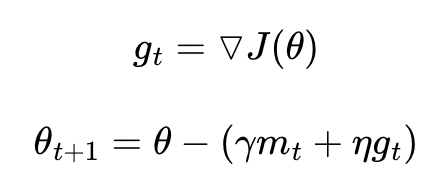

3. Momentum

모멘텀 SGD는 경사 하강법에 관성을 더해 주는 것이다. 경사 하강법과 마찬가지로 매번 기울기를 구하지만, 가중치를 수정하기전 이전 수정 방향(+,-)를 참고하여 같은 방향으로 일정한 비율만 수정되게 하는 방법이다. 수정이 양(+) 방향, 음(-) 방향 순차적으로 일어나는 지그재그 현상이 줄어들고, 이전 이동 값을 고려해여 일정 비율만큼 다음 값을 결정하므로 관성의 효과를 낼 수 있다.

α는 Learning Rate, m은 momentum 계수

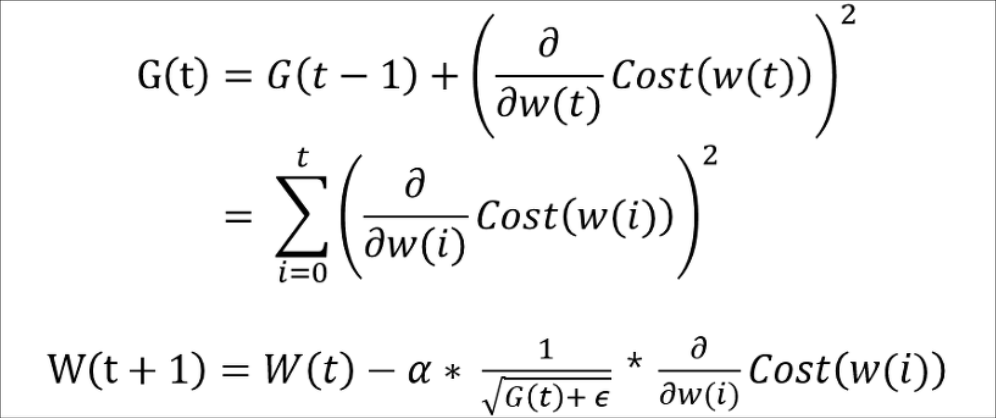

4. Adagrad

Adagrad는 변수의 업데이트 횟수에 따라 학습률(Learning rate)를 조절하는 옵션이 추가된 최적화 방법이다. 여기서 변수란 가중치(W) 벡터의 하나의 값(w[i])을 말한다. 아다그라드는 많이 변화하지 않은 변수들은 학습률(step size)를 크게하고, 반대로 많이 변화한 변수들에 대해서는 학습률을 적게한다.

Adagrad는 같은 입력 데이터가 여러번 학습되는 학습모델에 유용하게 쓰이는데 대표적으로 언어와 관련된 word2vec이나 GloVe에 유용하다.이는 학습 단어의 등장 확률에 따라 변수의 사용 비율이 확연하게 차이나기 때문에 많이 등장한 단어는 가중치를 적게 수정하고 적게 등장한 단어는 많이 수정할 수 있기 때문이다.

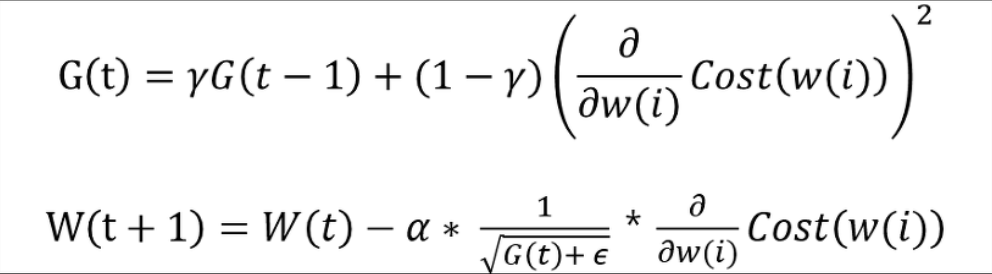

5. RMsprop

RMSprop은 아다그라드의 G(t)의 값이 무한히 커지는 것을 방지하고자 제안되었으며 지수 이동평균을 이용한 방법이다.

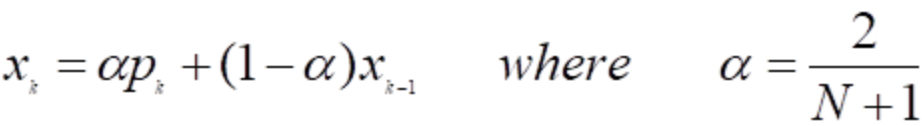

💡 지수 이동평균이란?

지수 이동평균이란 데이터의 이동평균을 구할 때, 오래된 데이터가 미치는 영향을 지수적으로 감쇠(exponential decay) 하도록 만드는 방법으로 최근 값에 값과 이전 값에 각각 가중치를 주어 계산을 한다.

지수 이동평균값은 x, 현재 값은 p, 가중치는 ⍺, 아래 첨자 k는 step 또는 시간, N은 값의 개수

RMSprop 수식은 다음과 같다.

이렇게 대체를 할 경우 Adagrad처럼 Gt가 무한정 커지지는 않으면서 최근 변화량의 변수간 상대적인 크기 차이는 유지할 수 있다.

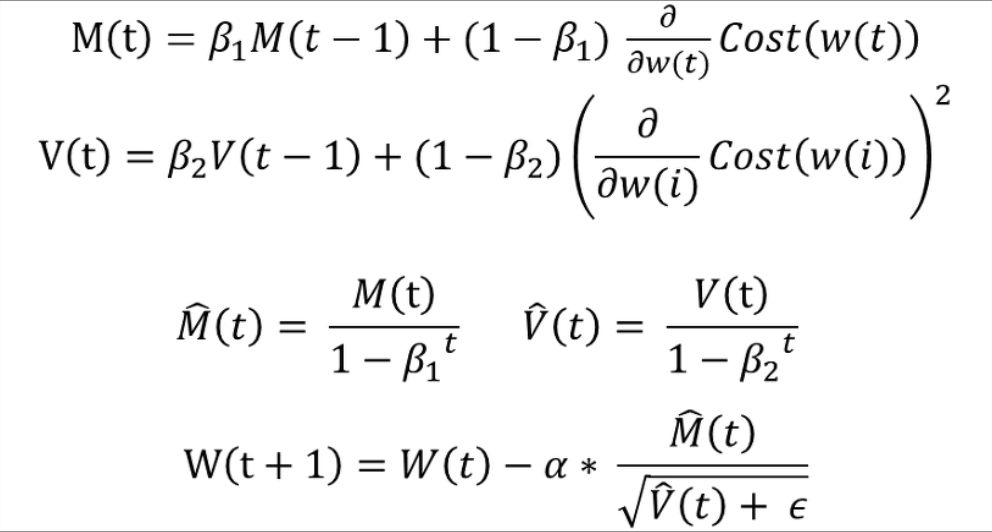

6. Adam

Adam은 RMSProp과 Momentum 방식을 합친 것 같은 알고리즘이다. 이 방식에서는 Momentum 방식과 유사하게 지금까지 계산해온 기울기의 지수평균을 저장하며, RMSProp과 유사하게 기울기의 제곱값의 지수평균을 저장한다.

Adam에서는 m과 v가 처음에 0으로 초기화되어 있기 때문에 학습의 초반부에서는 mt,vt가 0에 가깝게 bias 되어있을 것이라고 판단하여 이를 unbiased 하게 만들어주는 작업을 거친다.

mt와 vt의 식을 ∑형태로 펼친 후 양변에 expectation을 씌워서 정리해보면, 다음과 같은 보정을 통해 unbiased 된 expectation을 얻을 수 있다. 이 보정된 expectation들을 가지고 gradient가 들어갈 자리에 mt^, Gt가 들어갈 자리에 vt^를 넣어 계산을 진행한다.

보통 β1로는 0.9, β2로는 0.999, ϵ으로는 10^−8정도의 값을 사용한다고 한다.

7. AdaDelta (어려워서 스킵.. 추후 다시 쓰자)

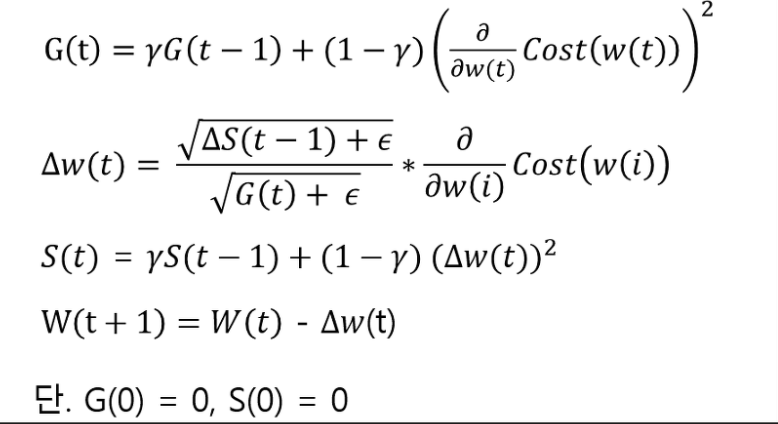

AdaDelta는 RMSProp과 유사하게 AdaGrad의 단점을 보완하기 위해 제안된 방법이다.

AdaDelta는 RMSProp과 동일하게 G를 구할 때 합을 구하는 대신 지수평균을 구한다. 다만, 여기에서는 step size를 단순하게 η로 사용하는 대신 step size의 변화값의 제곱을 가지고 지수평균 값을 사용한다.

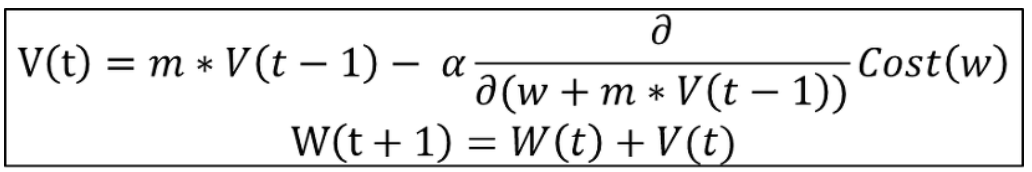

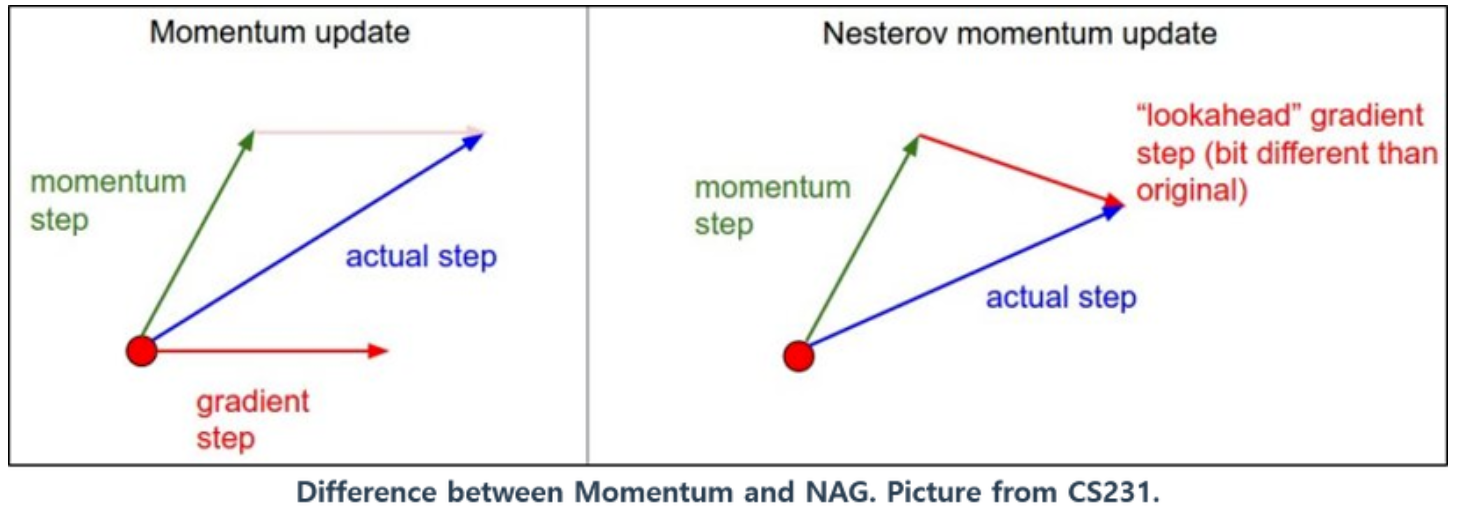

8. NAG

NAG는 momentum 값과 gradient 값이 더해 저 실제(actual) 값을 만드는 기존 모멘텀과 달리 momentum 값이 적용된 지점에서 gradient 값이 계산된다. 수식을 통해 gradient를 구할 때 분모()의 W(가중치)에 먼저 mV(t-1) 값을 더해 계산하는 것이란 걸 알 수 있다.

이 단계를 추가함으로 V(t)를 계산하기 전 모멘텀 방법으로 인해 이동될 방향을 미리 예측하고 해당 방향으로 얼마간 미리 이동한 뒤 gradient를 계산한는 효과를 얻을 수 있다. 즉 한 단계를 미리 예측함으로써 불필요한 이동을 줄일 수 있다.

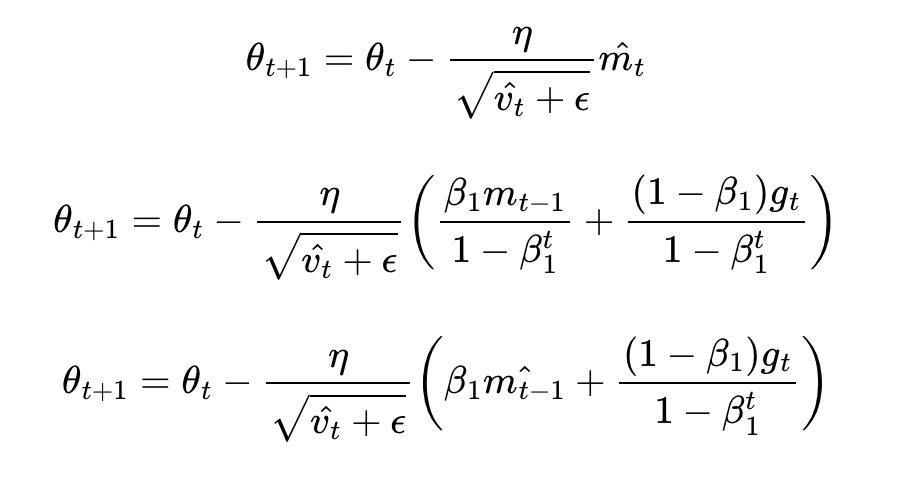

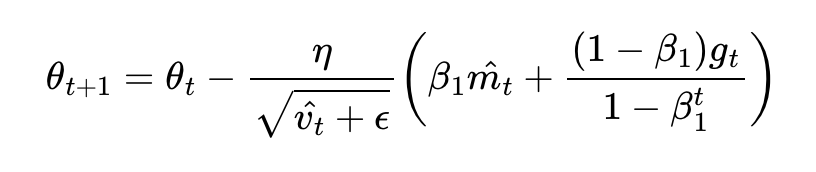

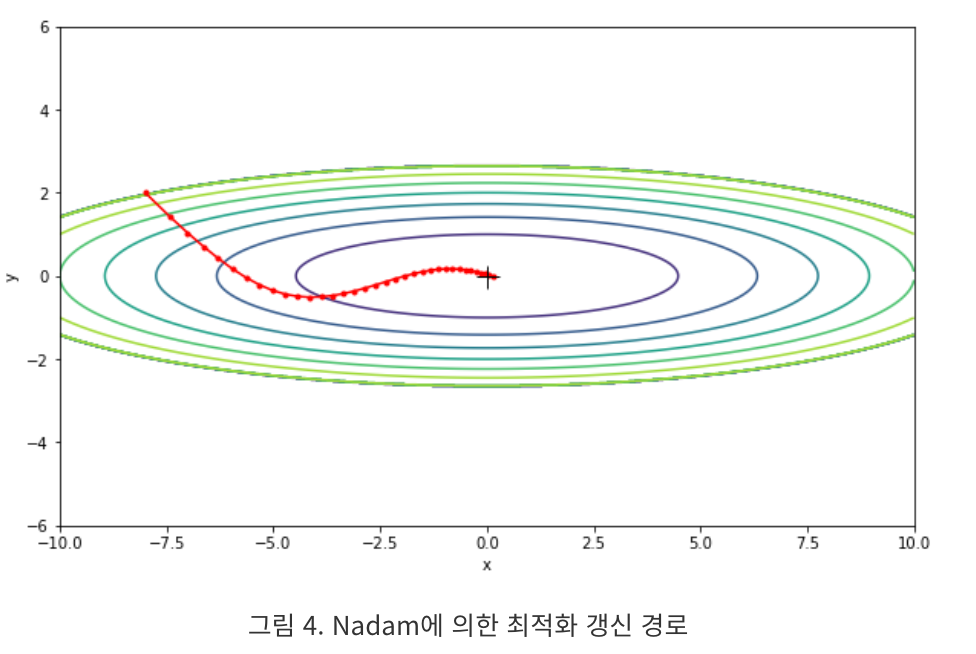

9. Nadam

Nadam은 Adam에서 적용한 모멘텀 기법을 NAG로 변경하였다. Nadam은 Adam과 NAG의 장점을 합쳤기 때문에, Adam보다 더 빠르고 정확하게 전역 최솟값을 찾을 수 있다는 장점이 있다.

NAG 공식에서 파라미터 갱신을 위하여 이전 단계의 모멘텀(m(t-1))을 2번 사용했다는 것을 알 수 있다. Nadam은 이를 조금 변형한다. 이전 단계의 모멘텀(m(t-1))을 대신하여 현재의 모멘텀(mt)을 사용함으로써 미래의 모멘텀을 사용하는 효과를 얻는다. 이를 NAG의 파라미터 조정에 반영하면 다음과 같다.

위의 효과를 Adam에 적용한다. 이를 위해서는 기존의 Adam이 파라미터를 수정하는 부분을 조금 더 풀어서 작성해야 한다.

Adam과 Nadam의 시각화 결과를 비교해보면, Nadam이 더 빠르고 정확하게 전역 최솟값을 찾아낸다는 것을 확인할 수 있다.

Reference:

- https://velog.io/@chang0517/Optimizer-%EC%A2%85%EB%A5%98-%EB%B0%8F-%EC%A0%95%EB%A6%AC

- https://twinw.tistory.com/247

- https://james-scorebook.tistory.com/entry/%EC%98%B5%ED%8B%B0%EB%A7%88%EC%9D%B4%EC%A0%80Optimizer-22

- http://shuuki4.github.io/deep%20learning/2016/05/20/Gradient-Descent-Algorithm-Overview.html

- https://velog.io/@minjung-s/Optimization-Algorithm

출처:

출처: