[week17] 2021/11/23

오피스아워

SqueezeNet

- AlexNet수준의 정확도

- 50배 작은 parameters, 0.5Mb미나의 크기

- 작은 CNN의 이점

- 분산학습시 모델의 파라미터 수와 서버간 통신overhead가 비례하므로, 빠르게 분산학습 가능

- 학습완료된 서버에서 자율주행차와 같은 다른 client로 모델을 전송할때 overhead감소

- FPGA, ASICS와 같이 제한된 메모리의 임베디드 환경에 베포 가능

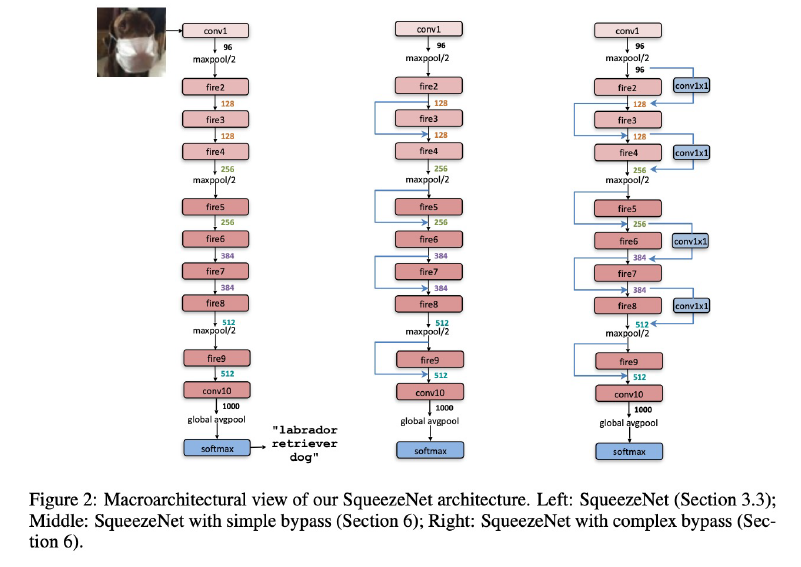

- 전체 구조

- 8개의 Fire module

- 입력과 출력쪽에 conv layer

- 출력단에 global avgpool

- 마지막 fire module뒤에 dropout

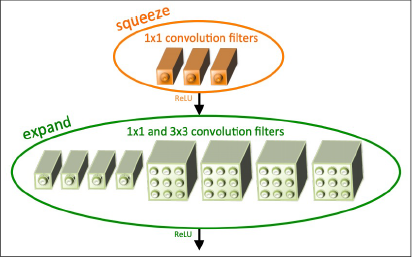

- Fire module

- 1*1 Squeeze Layer

: 기존의 3*3 filter보다 9배 감소한 parameter수 - 1*1 Expand Layer

- 3*3 Expand Layer

: filter 개수를 줄임. (s1 < e1 + e3)

- 1*1 Squeeze Layer