[U-Net] Recurrent Residual Convolutional Neural Network based on U-Net (R2U-Net) for Medical Image Segmentation 리뷰

논문 제목

Recurrent Residual Convolutional Neural Network based on U-Net (R2U-Net) for Medical Image Segmentation (2018)

URL: https://arxiv.org/abs/1802.06955

인용수 : 1376회 (24.09.12 기준)

요약

- Segmenation (분할) 연구 분야에서 U-Net은 가장 널리 사용되는 방법 중 하나이다.

- 본 논문에서는 RCNN (Recurrent Convolution Neural Network, 순환 컨볼루션 신경망)과 RRCNN (Recurrent Residual Convolution Neural Network, 순환 잔차 컨볼루션 신경망)을 적용한 RU-Net, R2U-Net을 제안.

- 제안된 모델은 U-Net, Residual Network, RCNN의 장점을 활용하여 U-Net, ResU-Net보다 여러 평가지표에서 우수한 성능을 보였다.

U-Net & R2U-Net 구조

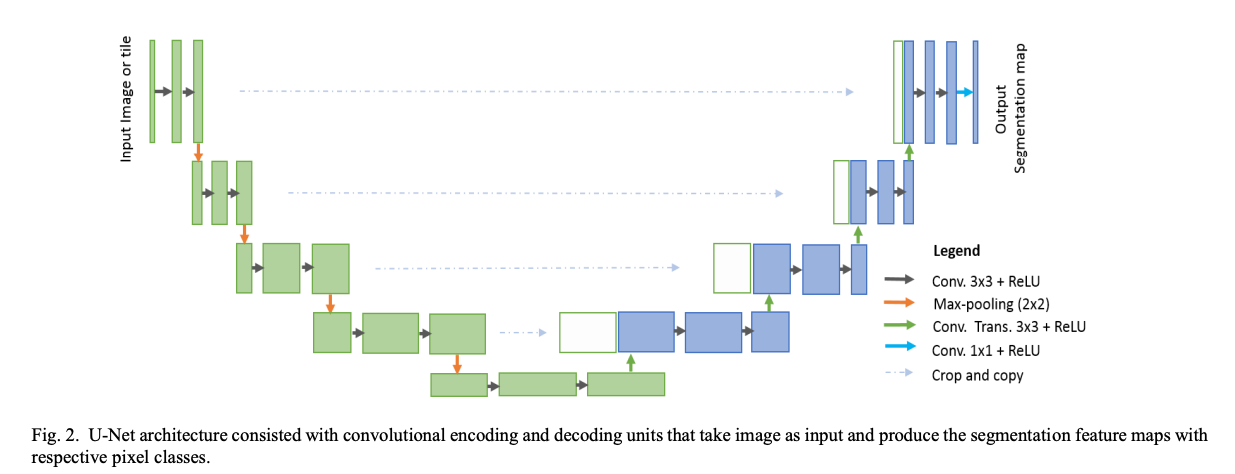

기본적인 U-Net의 구조이다. 인코딩과 디코딩을 위한 Conv + ReLU 블럭을 사용하며, Skip Connection이 존재한다.

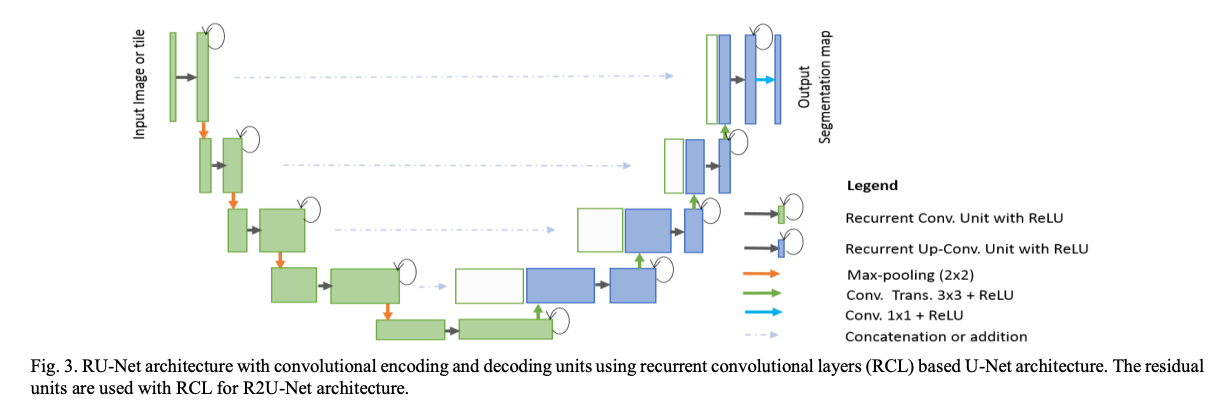

본 논문에서 제안한 방법 중 하나인 RU-Net의 구조이다. 인코딩과 디코딩 중 Conv + ReLU 블럭을 순환하는 구조를 사용한다.

깃허브 코드를 살펴보면 정말 단순하게 forward함수 내 for 반복문을 사용한다.

RCNN & RRCNN 구조

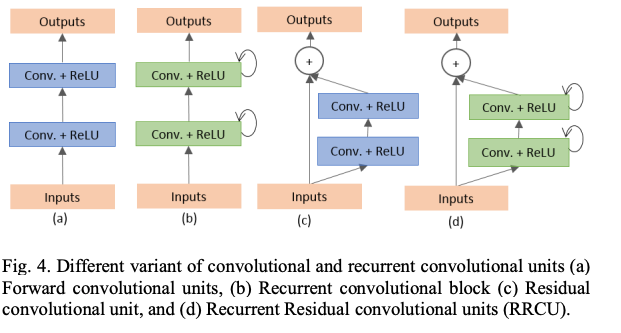

RCNN 논문 (2015)에서 영감을 받아서 제안했다고하며, RCNN은 객체 인식 (Object Recognition)에서 우수한 성능을 보여준 방법이라고함.

(a) : U-Net에서 기본적으로 사용하는 컨볼루션 유닛

(b) : RU-Net에서 사용하는 순환 컨볼루션 유닛 (제안)

(c) : ResU-Net에서 사용하는 잔차 컨볼루션 유닛

(d) : R2U-Net에서 사용하는 순환 잔차 컨볼루션 유닛 (제안)

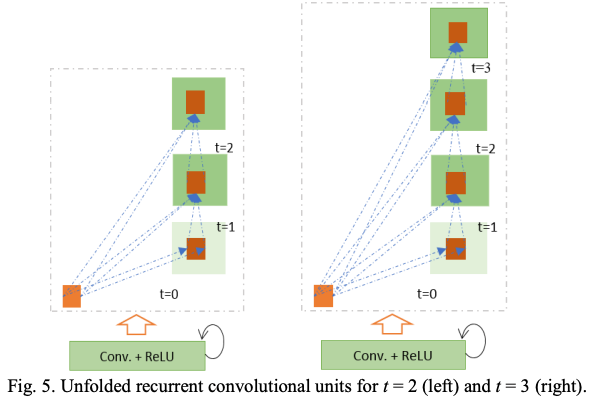

여기서 순환 컨볼루션은 위 이미지와 같이 진행되며, 순환 수를 정의하는 추가적인 파라미터 t (default=2)를 필요로 한다.

RCNN은 output값을 다시 입력으로 받는 효율적인 특징 축적을 통해 더 나은 특징 표현을 보장한다. 따라서 매우 낮은 수준의 특징을 추출하는데 도움을 준다고함.

최종적으로 R2U-Net은 잔차 학습과 순환 구조를 통해 네트워크 파라미터는 U-Net과 동일하지만, 더 효율적인 모델을 제안했다고 할 수 있다.

실험 설정 & 결과

사용 데이터셋

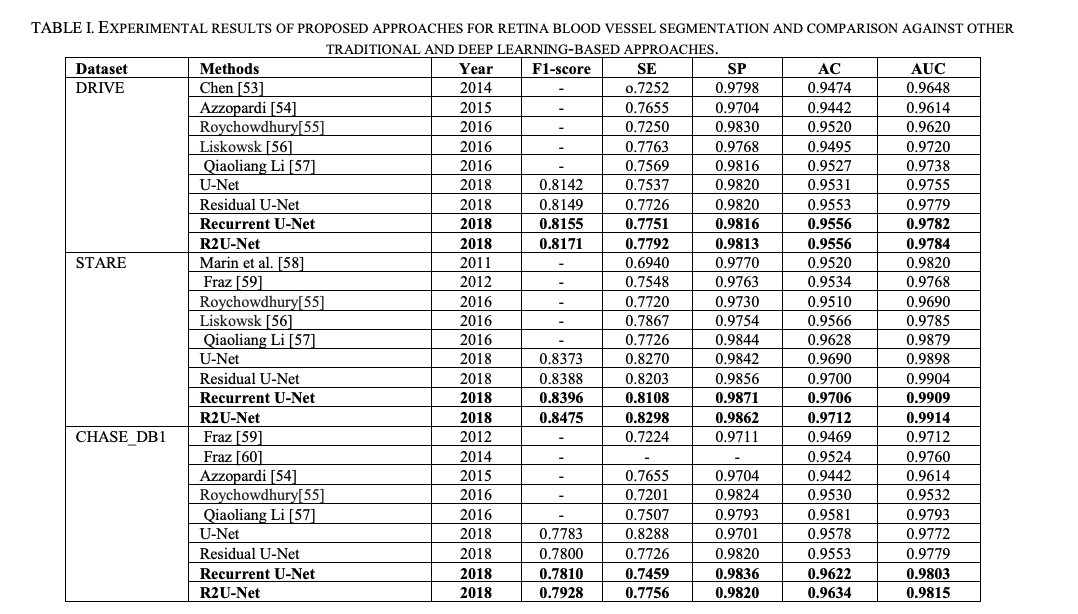

1. 혈관 (Blood Vessel Segmentation)

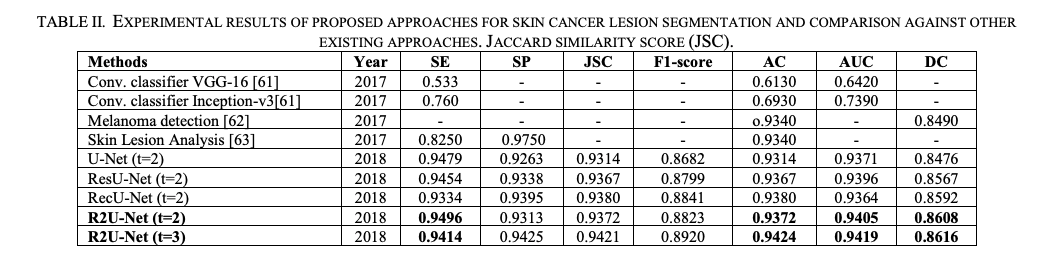

2. 피부암 (Skin Cancer Segmentation)

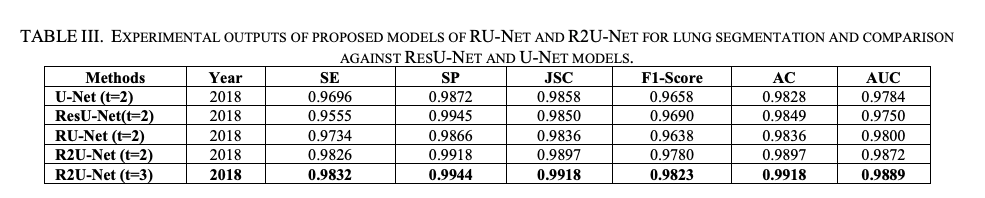

3. 폐 (Lung Segmentation)

정량평가

1. 정확도 (AC)

2. 민감도 (SE)

3. 특이도 (SP)

4. F1-Score

5. Dice Coefficient (DC)

6. Jaccard Similarity (JS)

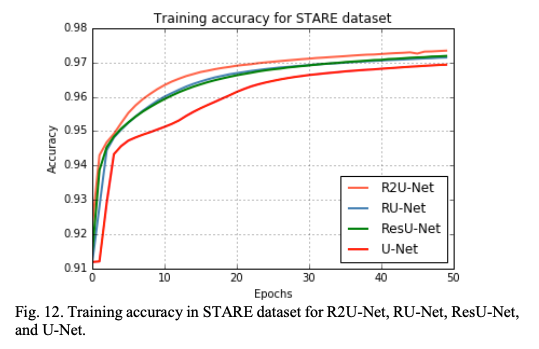

학습 곡선을 살펴보면 제안 모델이 더 안정적이고 성능도 높은 것을 확인할 수 있다.

세 가지 실험에서 제안한 RU-Net과 R2U-Net이 동일 연도에 제안된 ResU-Net이나 U-Net보다 좋은 지표를 보였다.

결론

- 제안된 RU-Net 및 R2U-Net 모델은 기존의 U-Net 및 잔차 U-Net(ResU-Net) 모델과 동일한 네트워크 매개변수를 사용하면서도 분할 작업에서 더 나은 성능을 보여주었다.

- 이 모델들은 훈련뿐만 아니라 테스트 단계에서도 더 나은 성능을 보장했다.