선형 회귀(Linear Regression)에 대해 머신러닝 수업을 들으며 정리한 노트입니다. 영상 중 이해가 안 된 부분이나 핵심 개념을

이미지와 함께 메모한 내용을 바탕으로 다시 정리했습니다.

선형 회귀 (Linear Regression)

1. 머신러닝 지도학습 분류

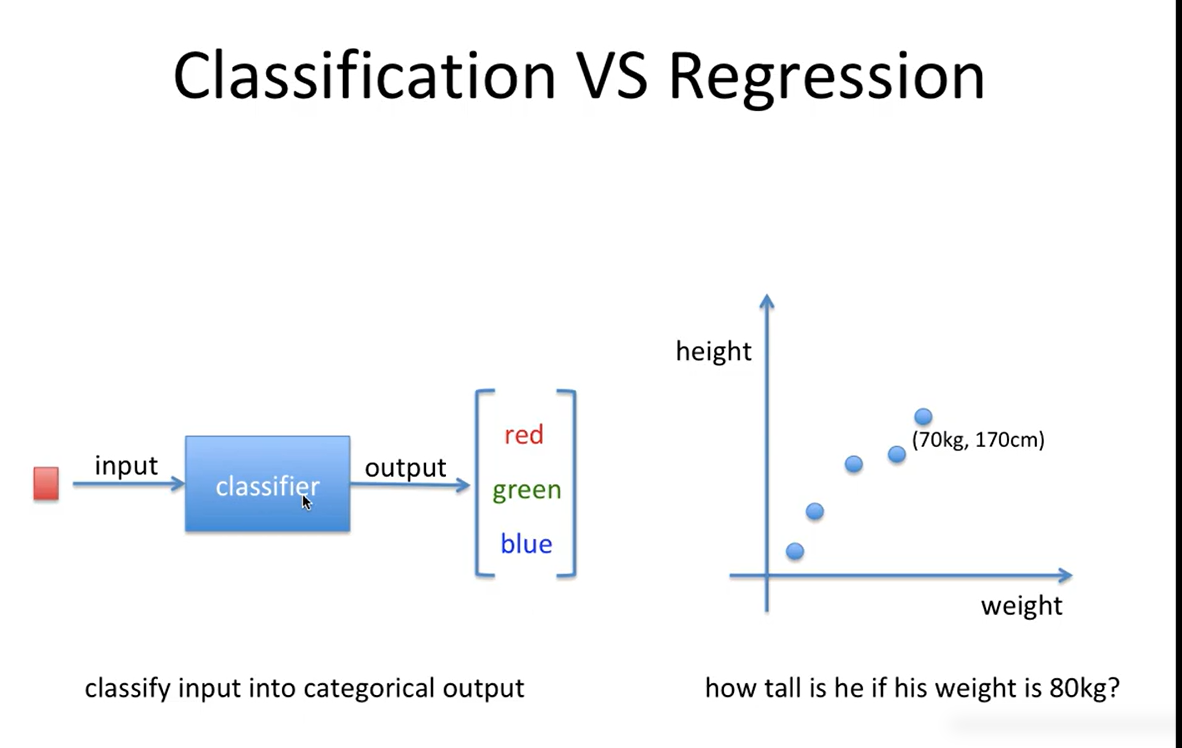

머신러닝의 지도학습(Supervised Learning)은 크게 두 가지로 나뉩니다:

- 회귀(Regression): 연속적인 숫자 예측 (ex: 키, 체중, 온도)

- 분류(Classification): 범주형 예측 (ex: 합격/불합격, 스팸/정상)

→ 선형 회귀는 그 중 회귀에 해당하는 알고리즘입니다.

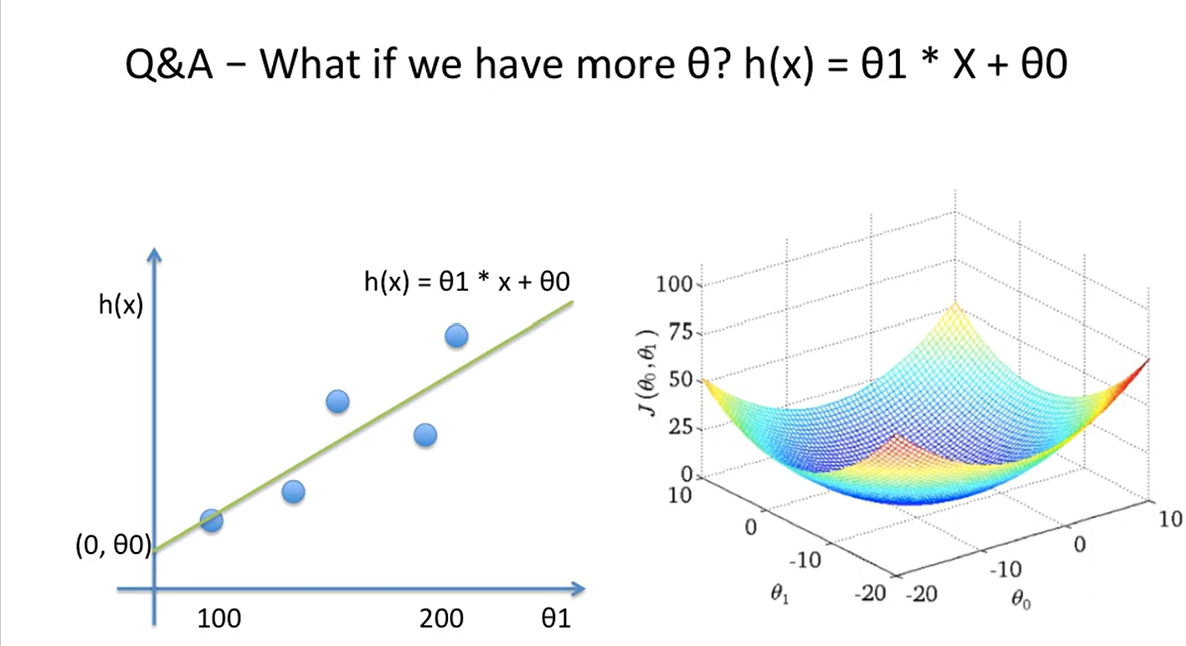

2. 선형 회귀 기본 구조

선형 회귀는 데이터를 일직선으로 근사해 예측하는 모델입니다.

h(x) = θ₀ + θ₁x- x: 입력 특성

- θ₀: 절편 (bias term)

- θ₁: 가중치 또는 기울기

→ 입력 x에 따라 y를 예측하는 직선 하나를 그리는 것

3. Cost Function (비용 함수)

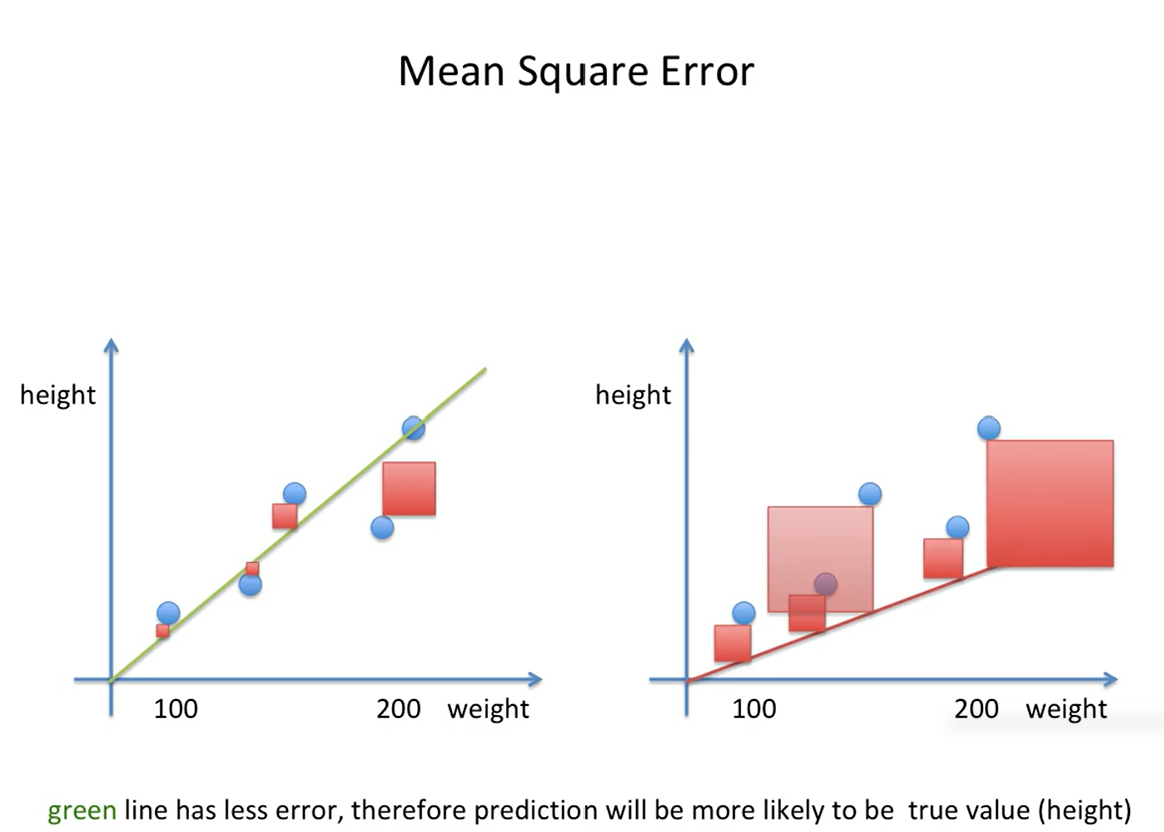

모델이 얼마나 예측을 잘하고 있는지를 수치로 나타내는 함수입니다.

MSE (Mean Squared Error)

J(θ) = (1/2m) ∑ (h(xᵢ) - yᵢ)²- h(xᵢ): 예측값

- yᵢ: 실제값

- m: 전체 샘플 수

목표: 이 값을 최소로 만드는 최적의 θ 찾기

4. Gradient Descent (경사 하강법)

Cost Function을 최소화하려면 기울기 방향으로 θ 값을 조금씩 업데이트해야 함

θ := θ - α * ∇J(θ)- α: 학습률 (learning rate)

- ∇J(θ): θ에 대한 비용 함수의 미분(기울기)

이미지 기반 요약:

- 처음 세타(θ)를 아무 값(예: 1)으로 시작

- 미분해서 기울기 방향 확인

- 기울기가 양수면 → 아래로 내려가야 하므로 θ 줄이기

- 반복하면 언젠가는 기울기=0 → 최솟값 도달

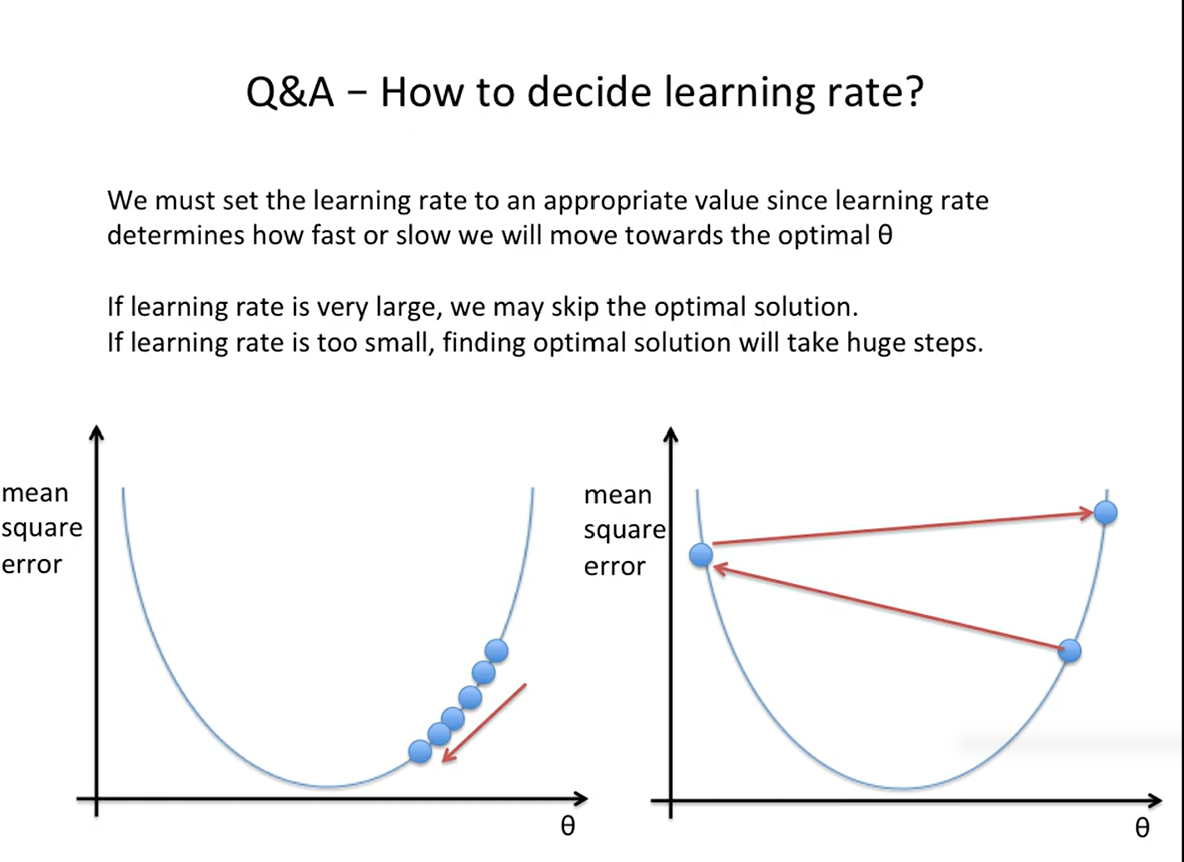

5. 학습률(α)의 중요성

- 학습률이 너무 작으면 → 수렴까지 오래 걸림

- 너무 크면 → 최소값을 지나쳐서 발산하거나 진동

→ 실험적으로 적절한 α 값을 정해야 안정적 학습이 가능

6. 회귀선(Linear Line) 생성

학습이 완료되면 θ 값이 확정되고, 그에 따라 하나의 직선이 만들어짐

→ 이 직선을 기반으로 새로운 입력 x에 대한 예측값 y를 쉽게 얻을 수 있음

7. 정리 요약

| 항목 | 설명 |

|---|---|

| h(x) | 예측 모델 (선형 함수) |

| 목적 | 예측 오차 최소화 |

| Cost | 평균제곱오차 (MSE) |

| 최적화 | Gradient Descent |

| 변수 조정 | 학습률(α), 반복 횟수 |

8. 내가 느낀 점

- θ 값을 점점 조정해나가면서 비용 함수가 내려가는 걸 보니

진짜 '기울기를 따라 내려가는 느낌'이 들었음 - 러닝레이트를 너무 작게 주면 모델이 느려서 시간 낭비고,

너무 크게 주면 발산할 수 있다는 게 되게 중요한 포인트였다 - 선형 회귀는 구조도 간단하고 시각적으로도 직관적이어서

머신러닝 입문용으로 확실히 좋은 모델인 것 같음