✔ Basic Info

📌 Parameter-Efficient Transfer Learning for NLP (2019)

🔗 https://arxiv.org/pdf/1902.00751

☑️Sum-up

-

Bottleneck Adapter 가 무엇인지 찾아보다가 Adapter 라는 개념이 생소해서 찾아본 논문

-

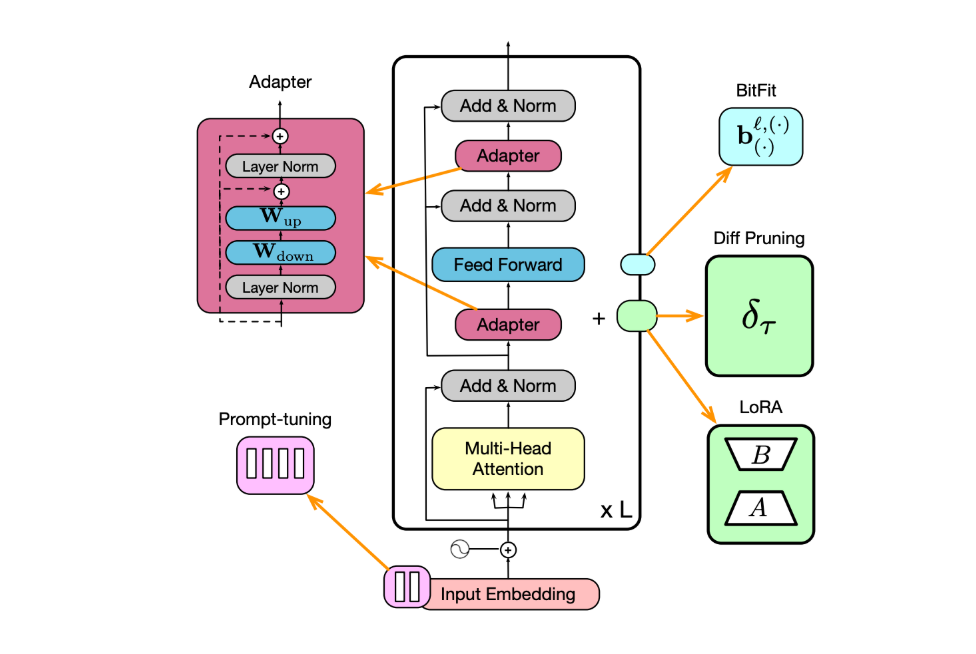

PEFT 기법을 설명할때 Adapter 와 LoRA 를 말하는데, 그 중 하나

-

전체 파라미터를 다 fine-tuning 하는 것은 지나치게 큰 학습량이 필요하다. 따라서 Adapter 를 추가하여 사전 학습된 파라미터는 freeze 시키고 -> adapter 모듈만 학습하여 downstreem task 에 적용할 수 있게 만든 기법

-

즉, 모델 내부에 (transformer 에, 예를 들어) 레이어를 넣고 task-specific 하게 조정할 수 있게 만든 구조

-

여담으로, 새삼 이와 같은 기초 논문들이 얼마나 중요한지 다시 깨달았다. 방법론적으로 배우는 것은 결국 중요 기초 논문들 같다.

☑️Glossary

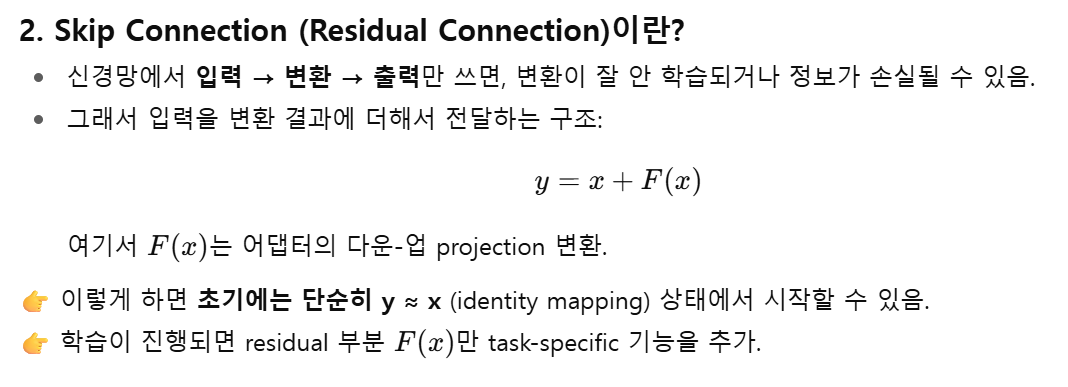

1️⃣ Skip Connection

2️⃣ GLUE 벤치마크

인간의 언어 능력을 인공지능이 얼마나 따라왔는지 정량적 성능지표를 만든 것

여러 다양한 종류의 언어 이해 문제를 통해 모델의 범용성과 지능 수준을 평가하는 지표라고 함

총 9개 과제로 이루어져 있고 감정 분석(SST-2), MNLI(문장간 논리 관계 판단), QQP(질문 중복 여부 판단), CoLA(문법적으로 옳은 문장인지 판별) 등 존재

✅Abstract

대규모 사전학습 모델을 파인튜닝 하는 것이 NLP 에서 효과적인 전이학습(Transfer Learning) 방법임. 근데 다수의 사전학습된 모델을 실제 task 에 적용시켜 fine-tuning 해야 할 경우 매번 파인튜닝 하는건 비효율적임.

이것에 대한 대안 → Adapter Module 을 사용한 전이학습.

어뎁터 모듈은 효율적이고 + 확장 가능한 모델 가능하게 함.

각 작업마다 소수의 학습 가능한 파라미터를 추가시키고 기존 학습된 task 다시 학습하지 않으면서 새로운 task 추가 가능

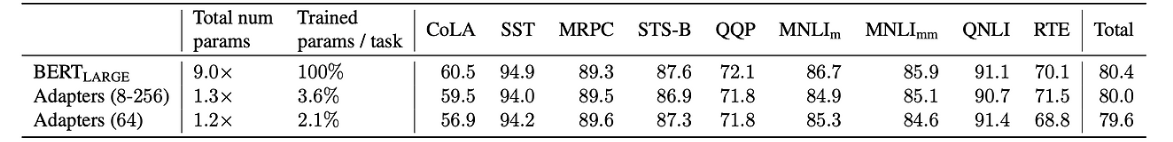

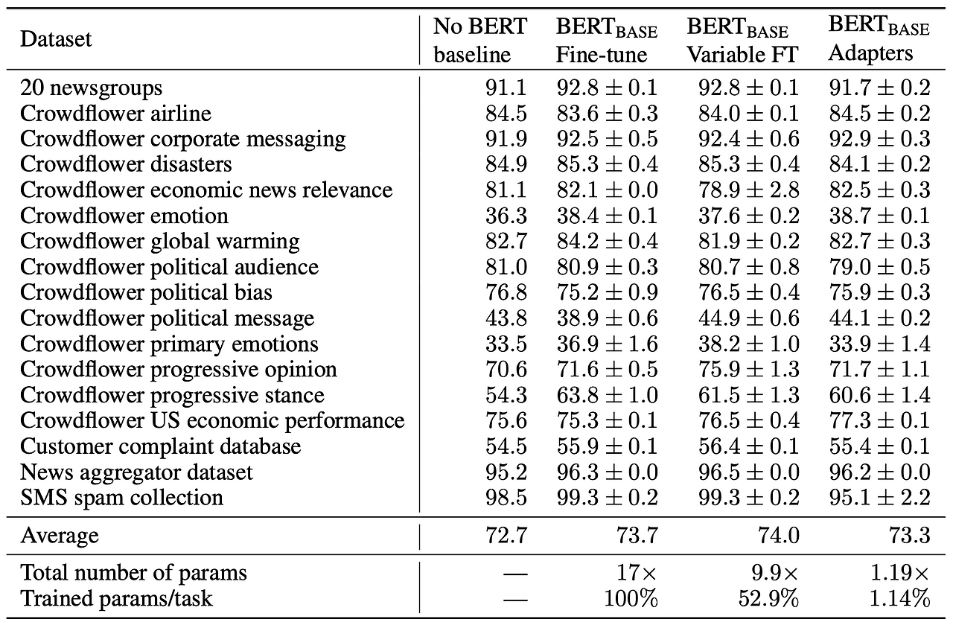

논문은 BERT 모델을 GLUE 벤치마크 포함 26개의 다양한 텍스트 분류 작업에 전이(transfer) 적용함

어뎁터 구조 사용했더니 소수 파라미터만 추가하면서 SOTA 근처 성능 달성

GLUE 벤치마크에서 전체 파인튜닝 대비 성능 손실이 0.4% 정도 수준이며 작업당 파라미터는 3.6% 만 추가하면 되는 결과 얻음

반면, fine-tuning 작업은 매번 전체 파라미터 재학습해야 하므로 매우 비효율적

✅Introduction

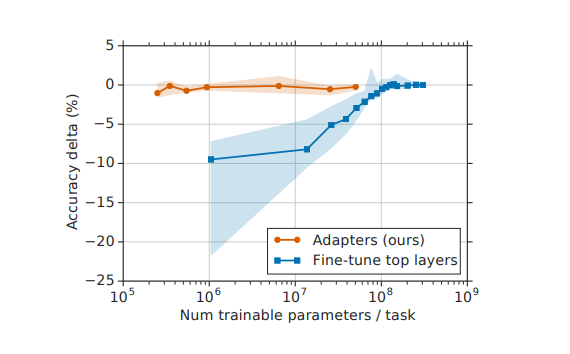

그래프 해석 : X 축은 각 작업마다 학습된 파라미터 수

Y축은 전체 파인튜닝 대비 정확도가 얼마나 달라졌나 (0% : fully fine-tuning 과 동일)

오렌지선이 Adapter 쓰고 학습시킨건데 Y=0 유지하는걸 보니 적은 파라미터 쓸때도 fully fine-tuning 과 비슷.

반면 파란색선은 상위 레이어만 일부 fine-tuning 했을때인데 파리미터 수가 적으면 성능이 현저히 떨어짐을 확인 가능

→ Adapter 의 효율성 강조

이 논문은 온라인 설정 다룸 - task 가 연속적으로 들어오는 상황

모든 작업에서 좋은 성능을 내면서 작업마다 새 모델을 훈련하지 않아도 되게 만들어야 함

전이 학습(Transfer Learning)은 기존 자연어 처리(NLP)에서는 주로 두 가지 방식으로 이뤄졌음

- Feature-based Transfer Learning Word2Vec, GloVe, ELMo 등과 같은 사전 학습된 임베딩 모델을 활용하여, 각 단어를 고정된 벡터 표현으로 변환 → 이때 생성된 임베딩 벡터를 downstream task 모델의 입력 특징(feature)으로 사용하는 방식

- Fine-tuning GPT와 같은 사전 학습된 대규모 언어 모델(LLM)의 전체 또는 일부 파라미터를 downstream task에 맞게 직접 조정하는 방식 → 이 방식은 모델이 과제별 문맥에 적응할 수 있도록 하여 보다 유연하고 높은 성능을 기대할 수 있었음

근데 Adapter 가 더 효율적임 왜냐면 위 두 방법 모두 task 마다 새 가중치 학습시켜야 했는데 Adapter 은 아주 적은 양의 파라미터만 학습시키면 되니까.

📌논문 목표 : Compact + Extensible 모델 만들기

Compact : task 마다 소수 파라미터만 추가해서 여러 작업 해결할 수 있는 모델

Extensible : 기존 작업 잊지 않고 새 task 를 점진적으로 학습할 수 있는 모델📌 핵심은 효율적이면서도 효과적인 bottleneck adapter 만들어 online setting 에서 매번 파라미터 튜닝 안해도 되는 상황 만드는거임

여기서 bottleneck (병목 구조) 이란 100차원 입력 → 10차원 → 100차원 복원하여 중간의 중요한 정보만 학습하게 만드는 방법

이런 bottleneck 사용하면 전체 파인튜닝 BERT 랑 거의 비슷한 성능 내지만 작업마다 필요한 파라미터는 단 3% ↔ 이에 반해 전통적인 fine-tuning 은 100% 전체 파라미터를 작업마다 재학습해야 한다. 그럼에도 두 방법 성능은 비슷했다 라는게 의의

✅Adapter Tuning for NLP

Large Text Model 을 여러 다운스트림 작업 (실제 언어 문제들) 에 대해 튜닝 하는 전략 제시

- 좋은 성능

- 작업 하나씩 순차적 훈련

- 작업당 소량 파라미터만 추가

Task 가 연속해서 들어오는 과정은 클라우드 환경에서 유용함.

Adapter 모듈 튜닝할때는 작은 크기의 파라미터 블록을 추가하고, 이것만 훈련시키면 됨

↔ 비교해서 일반 파인튜닝에서는 모델의 상위 레이어를 직접 수정해야 함 → 왜냐하면 업스트림 (사전학습) 과 다운스트립(적용하려고 하는 실제 작업) 레이블 종류 및 손실함수가 다르기 때문. 즉 구조가 다르니까 출력 레이어 바꾸는게 불가능한거

어댑터 모듈은 기존 네트워크에 새로운 층을 살짝 삽입하는 방식으로 해결함

기존 모델의 가중치는 전혀 바꾸지 않고 어댑터 층만 초기화해서 학습

Adapter Tuning 에서는 기존 네트워크 파라미터 freeze 해서 모든 작업 공유가능하게 하고 adapter 층만 학습시키게 됨

Adapter 모듈 특징

- 파라미터가 매우 적다

- 초기에는 near-identity initialization 상태로 시작

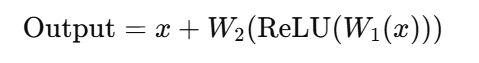

Output = Input + W₂(ReLU(W₁(Input)))- W₁: 입력을 bottleneck으로 축소 (d → m)

- W₂: 다시 확장 (m → d)

여기서 W1, W2 를 0 근처로 초기화해서 마치 adapter 가 아무것도 안하는 것처럼 세팅하는걸 near-identity initialization 이라고 함 이렇게 해야 기존 모델 성능 보존 상태에서 학습 필요한 방식으로 조정 함

처음에는 어댑터가 신호를 그냥 통과시켜서 기존 네트워크는 훈련 초반에 어뎁터 영향 전혀 안받음

그런데 훈련 진행되면서 어뎁터가 점점 신호 조절

초기부터 어뎁터가 작동하면 모델이 학습을 더 느리게 하거나 불안정해질 수 있음

Adapter 모듈은 기존 레이어보다 훨씬 작게 설계됨 → 그래서 작업이 점점 추가돼도 모델 크기가 천천히 커지게 됨

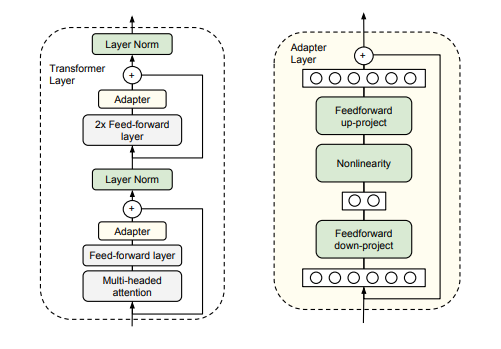

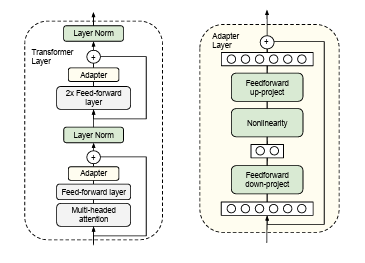

2.1 Adapter to Transformer

Adapter 모듈을 Transformer 에 적용시킴

Attention Layer 뒤에, FFN 뒤에 어댑터 위치시킴

여러 구조 가능하겠지만 가장 단순한 위 구조가 성능이 가장 좋았다고 함

원래 Transformer 구조 안건드리면서 끼어들어 학습 가능한 조정 역할 하게 됨

파라미터 수 줄이기 위해 Bottleneck Architecture 사용

어댑터 단계

- 입력 d 차원 → m 차원 축소 (Down-Project)

- 비선형함수 적용 (Non-Linearity) ReLU 등

- 다시 d 차원 확장 (Up-Project)

이렇게 했을때 각 어댑터가 레이어당 추가하는 총 파라미터 수는

- 첫 projection W1 → m * d = md (선형 변환 행렬 계산에 의거함)

- 두번째 projection W2 → d*m = md

- bias : d (W2) + m(W1) (bias 는 출력 차원만큼 존재해야 하므로)

따라서 2md + d + m 만큼의 파라미터를 학습시켜주면 됨

m 을 d 보다 훨씬 작게 설정하면 파라미터 수를 크게 줄일 수 있게 됨

이 구조 경우 전체 모델 파리미터의 0.5-8% 사용

bottleneck dimension m 은 성능과 효율성 사이 trade-off 조절하는 핵심변수임

어댑터 모듈 내부에 skip connection 존재 (이전 입력을 그대로 더해서 다음 레이어로 출력 보내는 방식)

이것 덕에 만약 projection 파라미터를 0으로 초기화시 어댑터는 항등혐수처럼 작용하게 됨

✅Experiments

결과 : GLUE 벤치마크에서 어댑터 튜닝은 전체 BERT 파인튜닝보다 성능 차이는 0.4% 밖에 나지 않지만 학습된 파라미터는 전체의 3% 정도뿐임

→ 분석 결과 어댑터 기반 튜닝은 트랜스포머 상위 레이어 처리에 집중하는 경향

현저히 낮은 수 파라미터로 비슷한 성능 입증

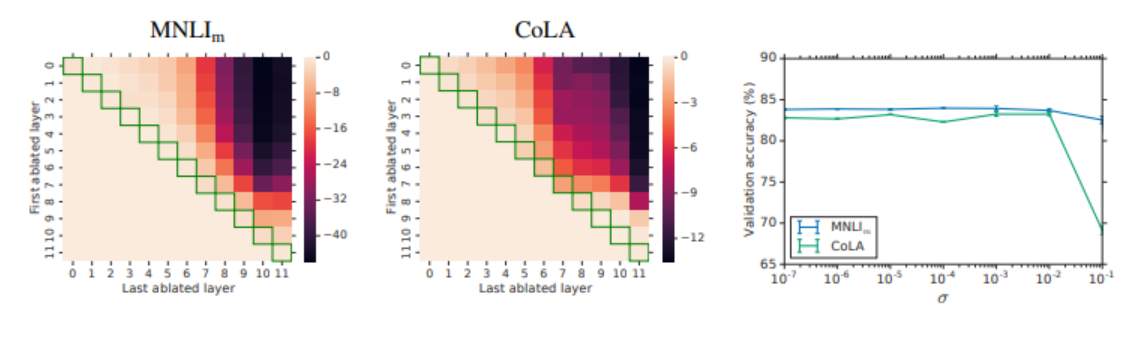

MNLIm 데이터셋과 CoLA 데이터셋에 대해 BERTBASE 모델로 학습시킨 후 ablation 실험 진행 (즉 학습된 어댑터 일부 제거하면서 평가 → 어뎁터가 성능 변화와 얼마나 영향 있나 확인)

-

X 축은 마지막에 제거된 레이어, Y 축은 처음에 제거된 레이어

-

세로 초록색 부분은 단일 레이어 어댑터 제거한거 → 이건 별로 성능 영향 없음

-

색깔 진해질수록 성능 크게 하락한건데, 모든 레이어 어댑터 제거하면 두 데이터셋에서 모두 성능 대폭 하락 보임 (MNLI - 37% 정확도, CoLA - 69%) : 한 레이어에서의 어댑터 영향은 작아도 전체적으로 중요한 역할 함을 알 수 있음

-

또한 초기화 (초기에는 near-identity initialization 상태로 시작 → 이 부분) 0에 가까울수록 성능 좋음 입증 (맨 왼쪽 그래프)

✅Related Work

🔴Pre-trained text representation

- 대규모 corpora 에 대해 주로 비지도 학습으로 훈련한다

- 사전학습된 임베딩이 처음부터 학습 진행하는거보다 성능 우수

- Word Embeddings 등 많은 기법들 (Word2Vec, Glove 등) → 단어 수준 이상 더 긴 텍스트, 문장 단락 임베딩 발전 → 문맥 반영 위해 시퀀스 모델 내부 표현 특성 추출 접근 사용 (ELMo 의 BiLSTM 내부 레이어 사용 등)

- 그러나 이런 방법은 내부 레이어에서 정보를 “읽는” 거라고 함

- 근데 Adapter 은 내부 레이어에 쓰기 “writing” 을 수행 (정보 흐름 재구성 하니까)

🔴Fine-Tuning

- SOTA 달성한 Q&A 시스템 최신 성능은 Trasformer 을 마스킹 사전학습 뒤 파인튜닝 달성한게 많았음 (BERT 이야기 하는듯)

- 근데 이거 비효율적임

🔴Multi-Task Learning

- 여러 작업 동시 학습

- 하위 레이어 공유화 → 상위 레이어를 작업별로 분리해서 특화시키는 과정

- MTL 하면 모든 작업 하나의 모델로 처리 가능 : 그런데 모든 작업에 동시 접근 가능해야 함

🔴Conditional Learning

- Adapter 모듈은 task 에 따라 모델 동장 방식을 변경함 상황에 따라 학습되는 파라미터가 달라지니까 → Conditional Learning (조건부 학습) 은 결국 모든 레이어 항상 다 쓰는게 아니라 task 에 따라 필요 부분만 사용하는 효율적 계산 구조임 → 특정 조건에 따라 정규화 파라미터 달라지는 조건부 배치 정규화와 유사

🔴Transfer Learning (in Vision)

- 원래 비전 분야에서 파라미터 수 최소화 해서 시각 네트워크 전체에 삽입되는 redidual adapter 모듈이라는걸 제안했었음 그래서 새 task 에 저비용으로 학습이 가능했는데 이걸 NLP 분야에 적용시킨게 우리 연구라고 함