[End-to-End Neural Diarization data preparation 리뷰] Multi-Speaker And Wide-Band Simulated Conversations as Training Data For End-to-End Enural Diarization

EEND

업데이트

- v0 (2023-08-19)

소개

- 이 글은 논문을 읽고 정리하기 위한 글입니다.

- 내용에 오류가 있는 부분이 있다면 조언 및 지적 언제든 환영입니다!

ICASSP 2023에 올라온 논문입니다. (Paper, Github

Citation

Landini, F., Diez, M., Lozano-Diez, A., & Burget, L. (2023, June). Multi-Speaker and Wide-Band Simulated Conversations as Training Data for End-to-End Neural Diarization. In ICASSP 2023-2023 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP) (pp. 1-5). IEEE.

Introduction

현재, 화자 분류 (Speaker Diarization)에 큰 문제 중 하나는 라벨이 있는 실제 데이터의 데이터의 부족과 다양한 Overlap Speech ratio 를 가진 데이터셋이 현저히 부족하다는 점입니다.

나름 다양한 오픈 데이터들 (AMI, AliMeeting, VoxConverse, AVA-AVD, CSJ(?), MagicData-RAMC ...)과 유료 데이터들 (AMI-Meeting, CALLHOME, DIHARD ...) 등이 있지만 데이터의 양이 EEND 모델들을 잘 학습하기에는 어려움이 있습니다.

또한, 이러한 데이터들은 다양한 또는 높은 Overlap Speech ratio를 가지는 경우가 드믈고 많은 화자 수를 가지는 데이터들이 적습니다. 예로 VoxConverse 의 overlap ratio 는 약 2~3% 이며, AMI 또는 AliMeeting 은 2~4명 입니다.

이러한 문제들로 다양한 상황에서 잘 작동할 수 있는 EEND, TS-VAD series 모델들을 학습시키기가 쉽지 않습니다.

이러한 문제를 그나마 해결하기 위한 방법으로 Hitachi Team에서는 화자 분류 학습을 위한 Simulation Dataset을 생성하는 방법들을 제안하고, 이를 이용하여 EEND 모델 성능을 효과적으로 향상시켰습니다.

정말 감사하게도, Hitachi Team 에서는 이러한 시뮬레이션 데이터를 생성하기 위한 모든 script 와 코드들을 Open Source로 공유하였고 이를 이용하여 시뮬레이션 데이터 생성이 가능했습니다.

Remain Problems and Limitations

이러한 점에도 몇몇 아쉬운 점들이 남아있었고 오늘 리뷰할 논문의 저자가 속한 BUT Speech@FIT 팀에서 아래와 같은 문제들에 대해서 해결하고자 했습니다.

- 유료 데이터셋 문제

- Hitachi Team에서 EEND을 학습하기 위한 시뮬레이션 데이터를 생성하기 위한 재료가 되는 데이터들이 유료데이터셋 입니다. (NIST SRE, SWBD)

- Librispeech 데이터셋을 이용하여 mini-Libri 데이터를 만들 수는 있지만 아쉬운 상태입니다.

- Narrow-band dataset (8k sampling rate)

- 시뮬레이션 데이터 생성을 위한 재료 데이터가 8k 입니다.

- 시뮬레이션 생성 알고리즘의 문제

- 이전 알고리즘의 경우, 대화 특징을 모델링하는 방법이 아니었습니다.

- 단순히 각 화자에 대해서 독립적으로 Mixture를 생성하고 단순히 Summation해서 사용하는 방법이었습니다. Overlap ratio 조절은 가능했지만, 두사람간에 speaker turn 정보 (Speaker Change, Speaker pause, Overlap)들을 모델링하진 못했습니다.

Proposal Method

저자는 위에 3가지 문제를 아래와 같이 해결했습니다.

- Fully Open-Source Dataset

- Librispeech, VoxCeleb2, VoxPopuli 3가지 종류 오픈 데이터셋을 이용하여 시뮬레이션 데이터셋을 생성하고 EEND 모델의 학습이 가능함을 보였습니다.

- NIST SRE, SWBD를 이용한 성능을 이기지는 못했지만 그래도 오픈 소스화 했다는 점에서 감사했습니다.

- Wide-Band dataset (16k sampling rate)

- 이전보다 넓은 sampling rate인 16k 인 데이터셋을 생성하고 사용했습니다.

- 시뮬레이션 데이터 생성 알고리즘 개선

- 참조할 BenchMark 데이터셋으로 부터 Speaker Change, Speaker Pause, Overlap Speech 될 3가지 상황에 대한 통계 정보들을 분석하고 이러한 정보를 시뮬레이션 데이터를 생성할 수 있도록 변경했습니다. 또한, 각 상황에서 어느정도의 Silence 또는 Overlap speech duration 을 가지게 할 것인지에 대한 알고리즘을 참조할 BenchMark 데이터로 부터 분성된 정보를 이용하여 데이터를 생성할 수 있도록 했습니다.

- BUT 팀에서 Interspeech 2022 에서 이러한 대화 정보을 이용하여 시뮬레이션 데이터를 생성하는 알고리즘을 제안했지만 2명에서 그쳤었습니다. 본 논문에서는 2명이라는 제약을 없애고 Multi-Speaker 데이터 생성을 가능하게 했습니다.

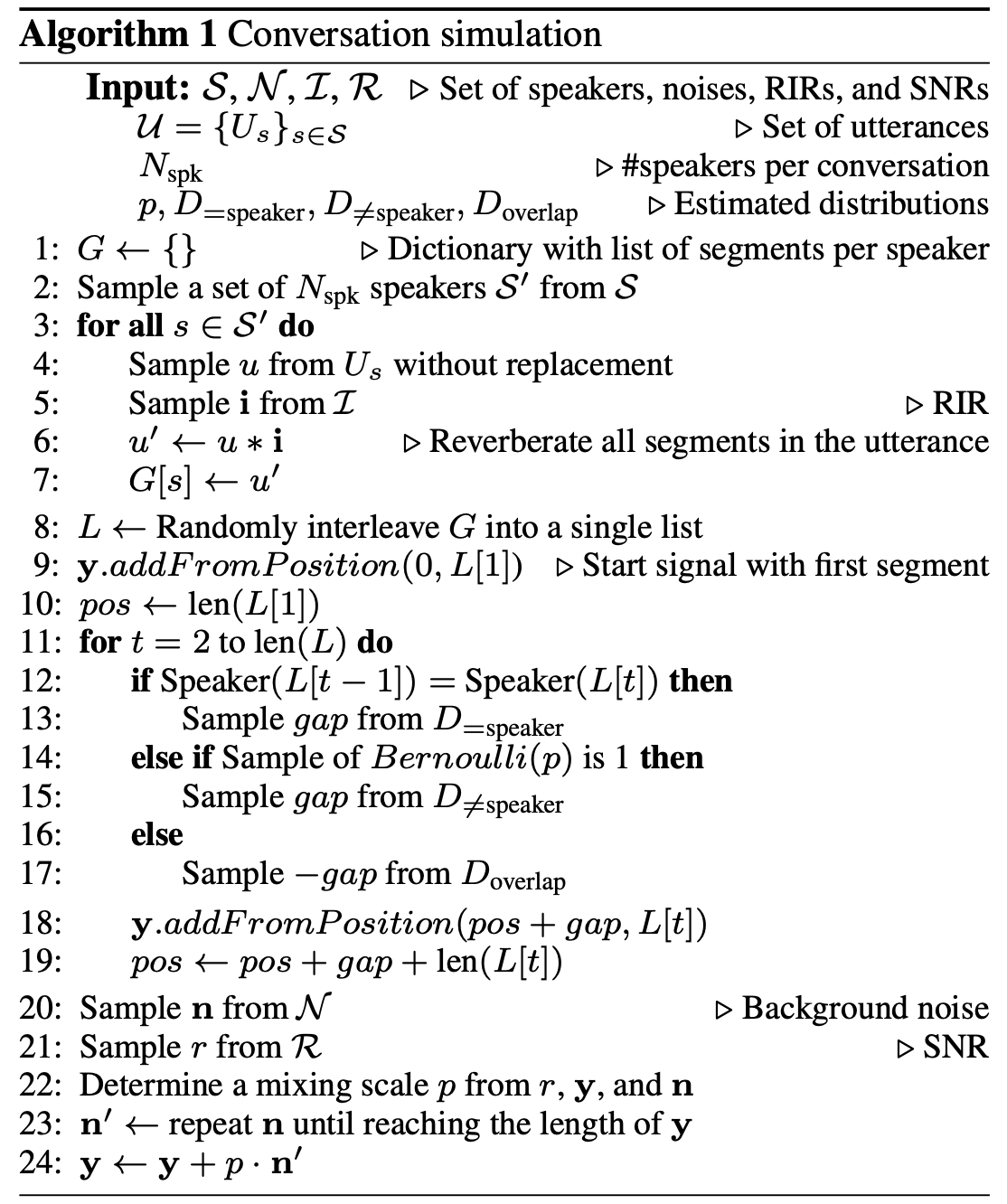

구체적인 알고리즘은 아래와 같습니다. (Multi-speaker 에 대한 알고리즘은 논문에 없고 이전 BUT 논문(Interspeech 2022)에서 2명에 대한 알고리즘을 봐도 참고 가능할것 같아서 첨부)

Line 2: 전체 화자중, 우리가 생성할 특정 화자 수 선택

Line 3~7: 각 화자 Segment

시뮬레이션 코드 설명: Github

딱히 시뮬레이션 알고리즘에 대한 알고리즘 테이블

Continue