💡이 글의 목적

공부하면서 마주한 내용들을 요약 및 정리를 통해 다양한 사람들에게 공유하고 공유를 하면서 오개념 혹은 개념정리를 하기 위함입니다. 많이 피드백해 주시고 비판해 주십시오.

💡Overview

🔫 Gradient Descent : 경사 하강법

미분값이 극소가 되는 방향을 찾아 극소값을 찾는다.여기서 미분의 대상이 되는 것은 'W'즉 Neural Network의 파라미터이고 Loss(실제값-예측값)에서 편미분을 하게 됩니다.

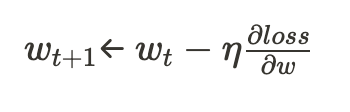

수식과 같이 t+1시점으로 진행하기 위해 -를 붙여 연산을 하게 되는데 이는 극소값에 도달하기 위해서 입니다. (넵타는 Learning_Rate을 뜻합니다.)

📌 Optimization : 기초원리로 Gradient Descent를 따라갑니다. 해당 부분이 발전되면서 다양한 방법론이 추가된다는 것으로 맥락을 잡아가면 좋습니다.

Key Concepts

💡Optimization의 방법론을 확장하고자 한다면 어떤 점들을 고려해야할까? Optimization의 key Concepts을 보며 이해해보자.

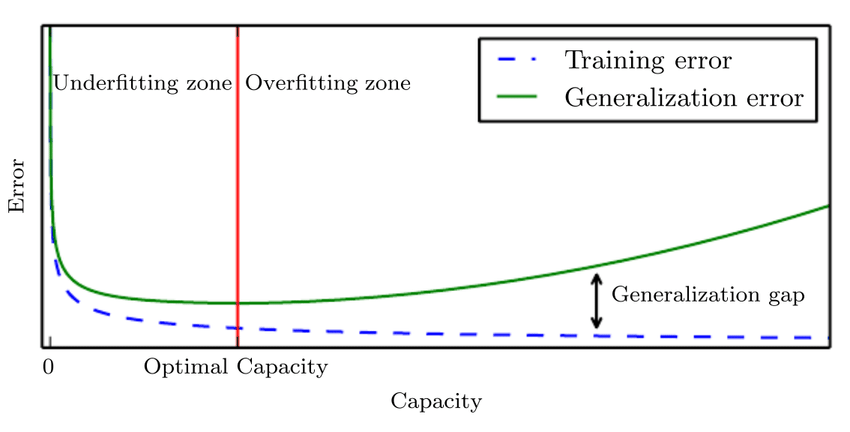

1. Generalization Gap

📌 Unseen data(test data)의 성능과 train data의 성능의 차이를 말합니다.

이러한 차이가 클수록 과적합(Over-fitting)이 우려 되기에 Early Stopping을 사용하게 됩니다. -> (Early Stopping은 개념보다 구현이 더 중요한 것 같아 추후 포스팅 하겠습니다. 22년 10월 5일)

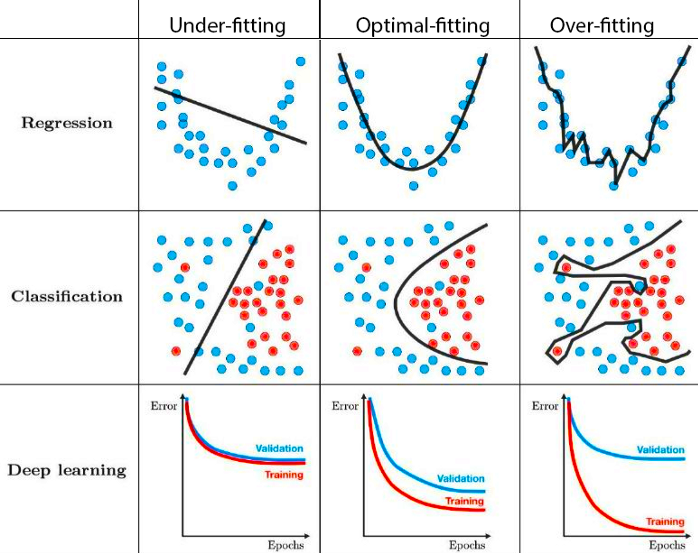

2. Under-fitting, Over-fitting

📌fitting은 모델이 학습 데이터를 기준으로 모델을 설정하는 것이다.

하지만 모델 학습의 목표는 학습 데이터에서만 잘 적용되는 것이 아니라 범용적으로 좋은 성능을 만들어 싶어 한다.

따라서 학습 목표를 이루기 위해 2가지 개념을 잘 이해해야한다.

- Under-fitting : Loss가 크고 epoch를 늘려도 loss가 큰 상황에서 수렴하는 경우

💊 파라미터의 수를 늘리거나 활성화 함수를 변경 - Over-fitting : train_loss는 적으나 Validation_loss는 큰 상황

💊 교차 검증 또는 earlystopping

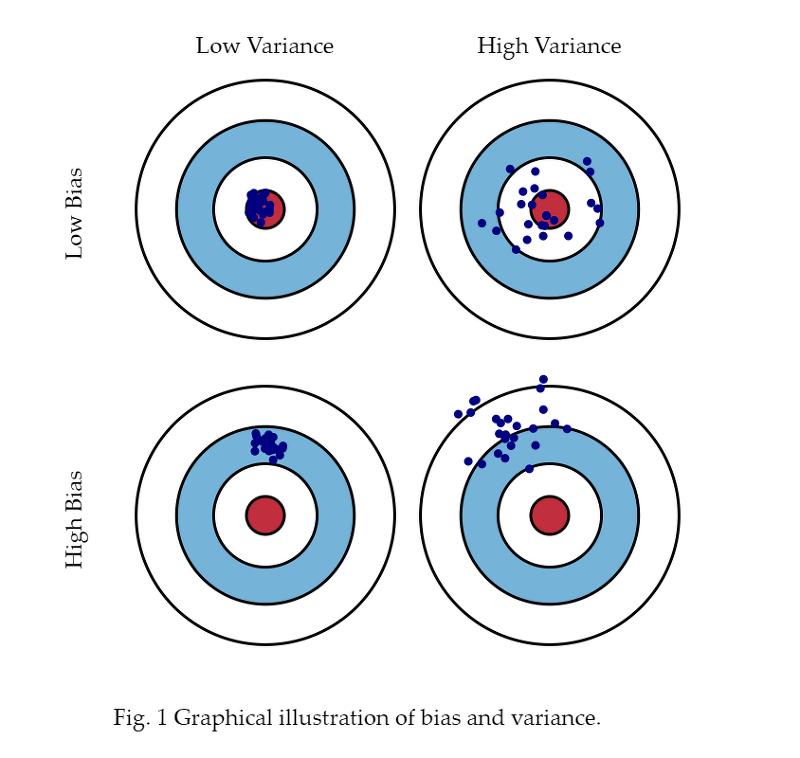

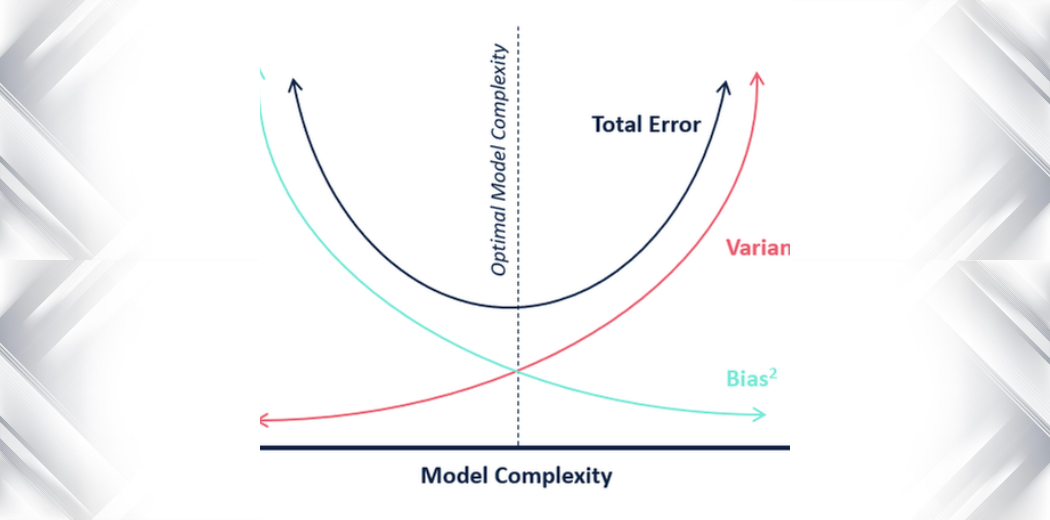

3. Bias-variance trade off

📌 Bias :편향, Variance : 퍼져있는 정도

💡 Cost = bias + variance + noise로 구성되어 있기 때문에 bias가 감소하면 variance가 이에 맞춰 증가하고 반대로 variance가 감소하면 bias가 증가하는 trad_off가 있다.

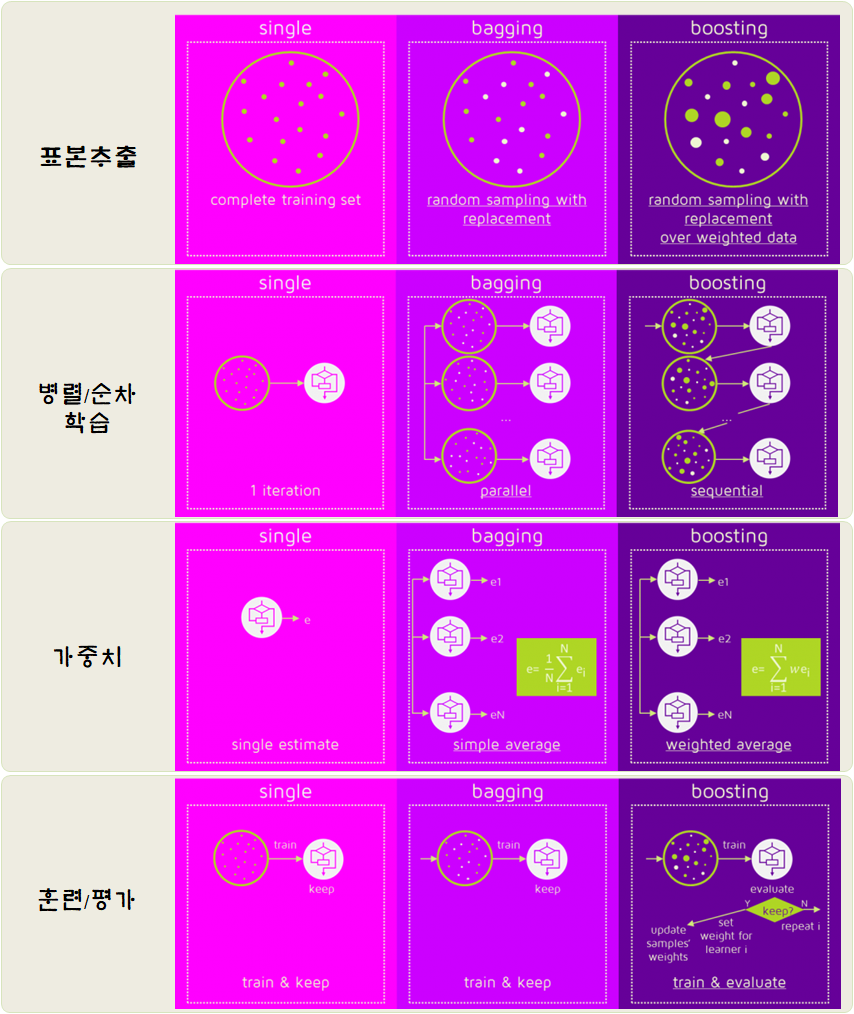

4. Bagging and boosting

💡앙상블(Ensemble) 기법의 일종, 앙상블이란? : 여러개의 예측 모형을 결합하여 '집단지성'의 효과를 나타낸다.

(cf.이산형 데이터 : Voting, 연속형 데이터 : AVG을 대표적인 결합방식으로 선택한다.)

내용이 많고 직관적인 이유를 위해 이 또한 따로 포스팅을 하겠습니다. (10월 5일 기준)

📌 Bagging : random subsampling으로 여러 모델을 하위 데이터셋으로 나눠 병렬 작업 뒤 합치는 과정

📌 boosting : weak learner를 분할 후 직렬 방식으로 예측한 결과물로 다시 예측함.

출처 : https://ybeaning.tistory.com/17

5.Batch-size Matters

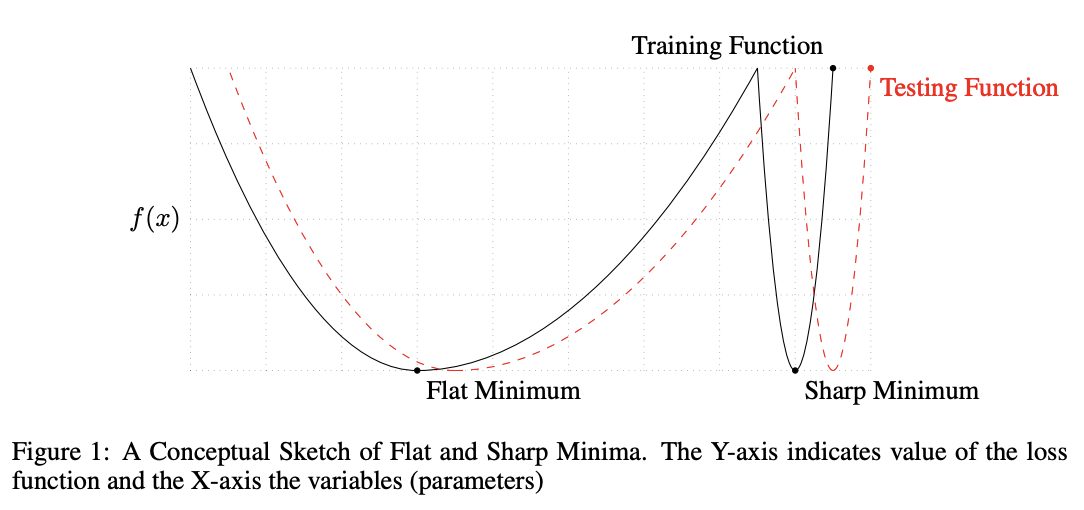

📌 Flat minimizer&sharp minimizer

On Large-batch Training for Deep Learning: Generalization Gap and Sharp Minima에서는 앞서 설명한 Large- Batch-size에 대해 문제를 제기했습니다.

Deep Learning은 데이터를 묶음단위(Batch)로 학습해 grad값을 갱신합니다. 이는 Weight값을 갱신해주게 됩니다. 하지만 묶음단위(Batch)가 크다는 것은 grad의 값이 크다는 것이고 이는 즉 Step 극솟값도달에 드는 step이 크다는 것을 뜻합니다.(Slope가 커진다.) 이를 Sharp minimizer라고 함.

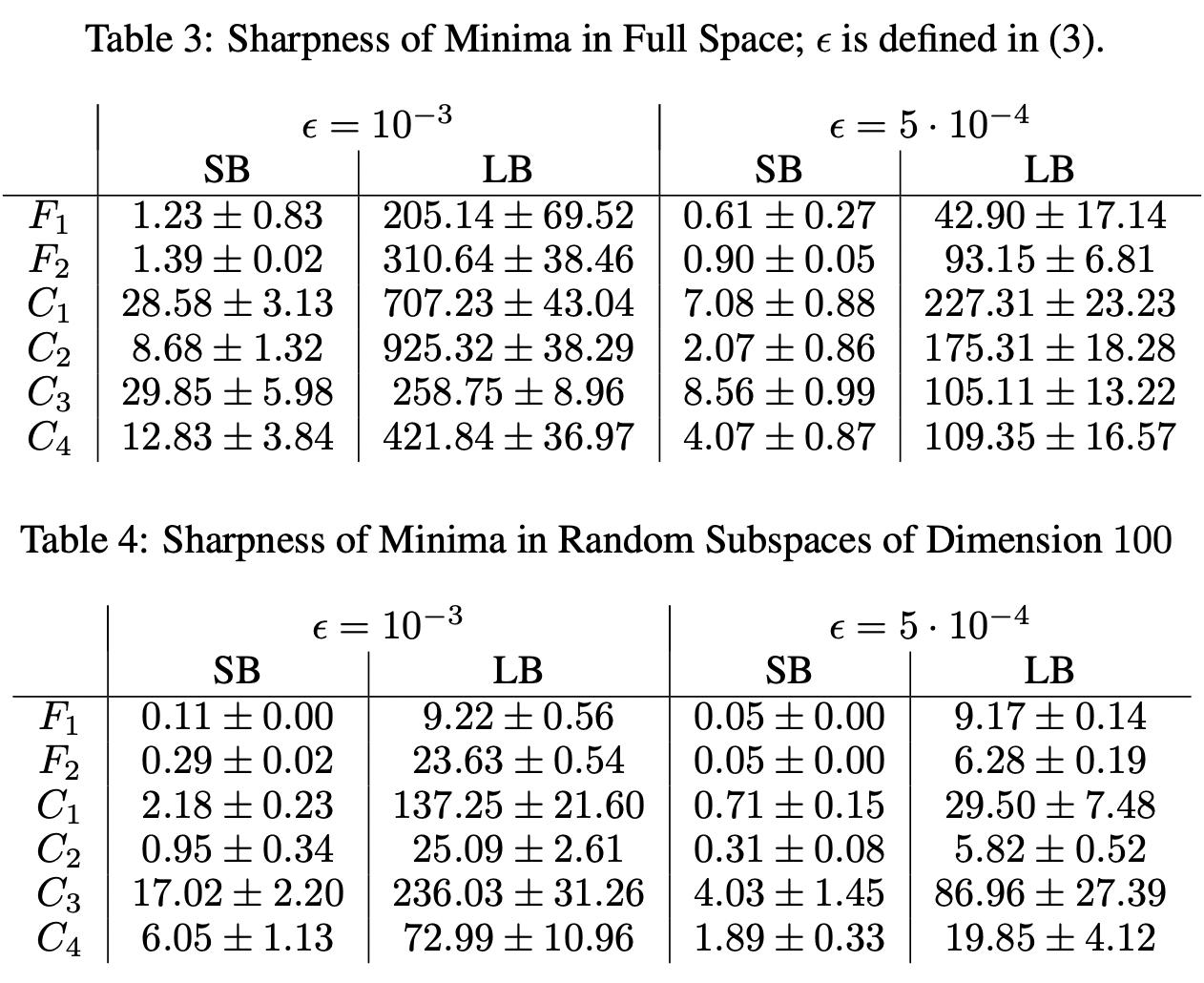

SB : small-Batch_size, LB : Large_Batch_size

에러가 동일한 상황에서 각각의 표본 공간을 표시한 것인데 LB에서 표본공간의 크기가 엄청난 것을 알 수 있고 예측값에 대한 변동이 크다는 것을 유추할 수 있다.