베이즈 추정이란?

만일 기계의 성능을 평가한다고 가정해볼때, 전체 중 일부를 무작위로 뽑아 표본으로 얻어진 정보만으로 모수(전체 기계)의 성능을 평가해야 한다.

하지만, 과거 기계의 성능검사기록, 부품 성능자료, 물리적 특성에 관한 지식을 통해 사전 정보를 얻을 수도 있다.

이런 경우 단순히 표본을 통해 모수를 추정하기 보다는 표본정보와 사전 정보를 함께 사용해 모수를 추정하는 것이 바람직하다.

위와 같이 추론 대상의 사전 확률과 추가적인 정보를 기반으로 해당 대상의 사후 확률을 추론하는 통계적 방법을 베이즈 추정(Bayesian Estimation)이라고 한다.

P(θ∣X)=P(X)P(θ∣X)=P(X)P(X∣θ)P(θ)

예시 문제

예를들어 A마을의 전체 사람들의 10.5%가 암환자이고, 89.%가 암환자가 아닐때

이 마을의 모든 사람들한테 암 검진을 실시할 때, 양성과 음성이 나오게 된다.

하지만 검진의 정확도는 100%가 아니다

암 환자 중 양성 판정을 받은 비율은 90.5%, 암 환자 중 음성 판정을 받은 비율은 9.5%

암 환자가 아닌 사람 중 양성 판정을 받은 비율은 20.4%, 암 환자가 아닌 사람 중 음성 판정을 받은 사람은 79.6%이다

이때 어떤 사람이 양성 판정을 받았을 때, 암환자일 확률을 얼마인가?

수식 표현

-

C : 암환자, P : 양성, N : 음성

-

P(C) : 암환자일 확률 = 0.105

-

P(~C) : 암환자가 아닐 확률 = 0.895

-

P(P|C) : 암 환자일 때 양성 판정을 받을 확률 = 0.905 (민감도|Sensitivity)

-

P(N|C) : 암 환자일 때 음성 판정을 받을 확률 = 0.095

-

P(P|∼C) : 암 환자가 아닐때 양성 판정을 받을 확률 = 0.204

-

P(N|∼C) : 암 환자가 아닐때 음성 판정을 받을 확률 = 0.796 (특이도|Specificity)

이때 P(C|P) 즉, 어떤 사람이 양성 판정을 받았을때, 암환자일 확률은?

베이즈 추정

P(C∣P)=P(P∣C)∗P(P)P(C)

P(P)=P(P∣C)+P(P∣∼C)⇒P(P∣C)×P(C)+P(P∣∼C)×P(∼C)

즉, 양성 판정을 받을 확률 = 암 환자이면서 양성 판정을 받을 확률 + 암 환자가 아닌데 양성 판정을 받을 확률

조건부 확률에 따라서

P(C∣P)=P(P∣C)×P(C)/P(P)⇒P(P∣C)×P(C)+P(P∣∼C)×P(∼C)P(P∣C)×P(C)

0.905×0.105/(0.905×0.105)+(0.204×0.895)=0.342

P(C∣N)=P(N∣C)×P(C)/P(N)⇒P(N∣C)×P(C)+P(N∣∼C)×P(∼C)P(N∣C)×P(N)

0.095×0.105/(0.095×0.105)+(0.796×0.895)=0.0138

P(∼C∣P)=P(P∣∼C)×P(∼C)/P(P)⇒P(P∣C)×P(C)+P(P∣∼C)×P(∼C)P(P∣∼C)×P(∼C)

0.204×0.895/(0.905×0.105)+(0.204×0.895)=0.6574

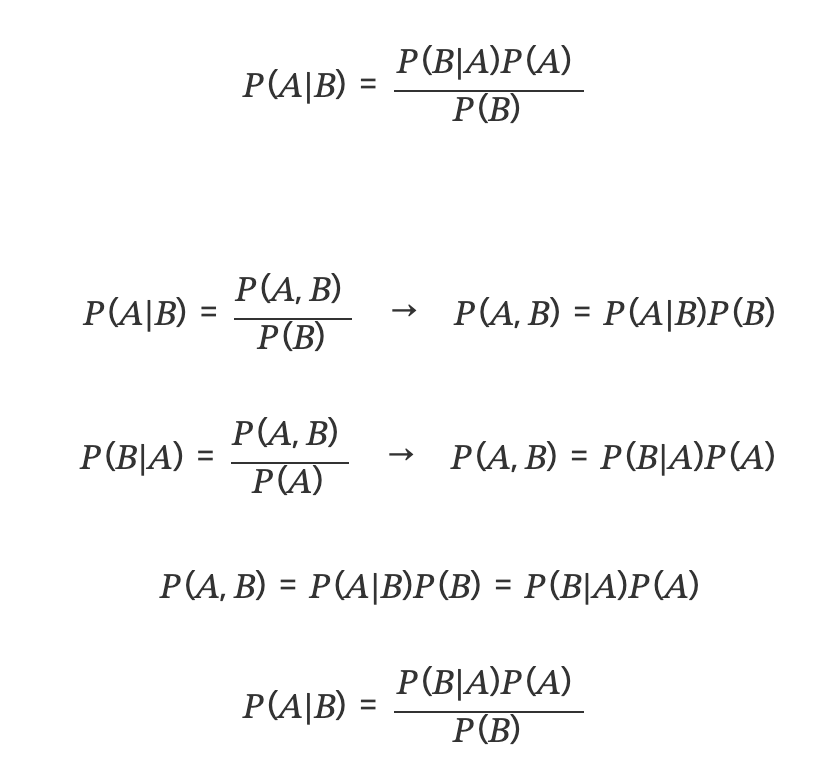

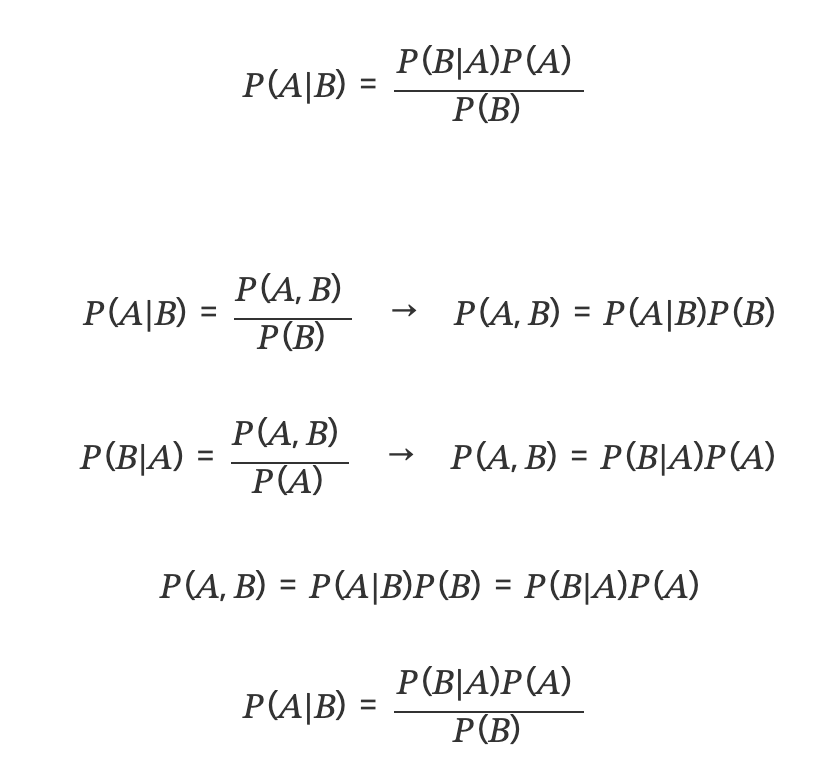

베이즈 정리

-

P(A) = 사전 확률(Prior) = 사건 B가 발생하기 전에 가지고 있던 사건 A의 확률

-

P(A|B) = 사후 확률(Posterior) = 사건 B가 발생한 후 갱신된 사건 A의 확률

-

P(B) = 정규화 상수(Normalizing Constant) OR 증거(Evidence) = 확률의 크기 조정

-

P(B|A) = 가능도(Likelihood) = 사건 A가 발생한 경우 사건 B의 확률

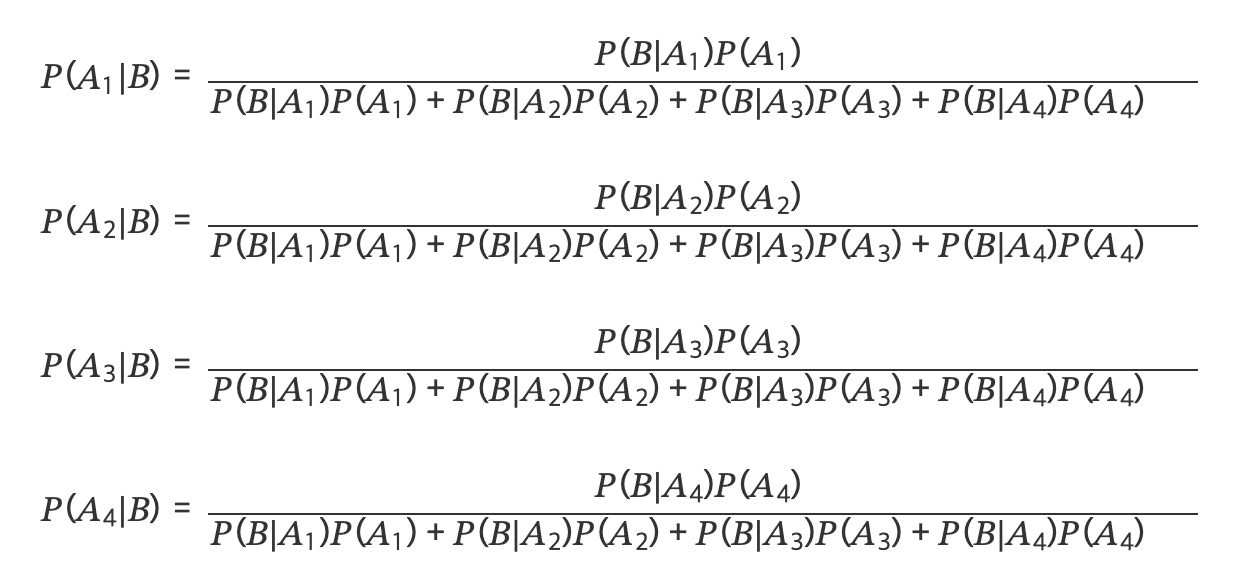

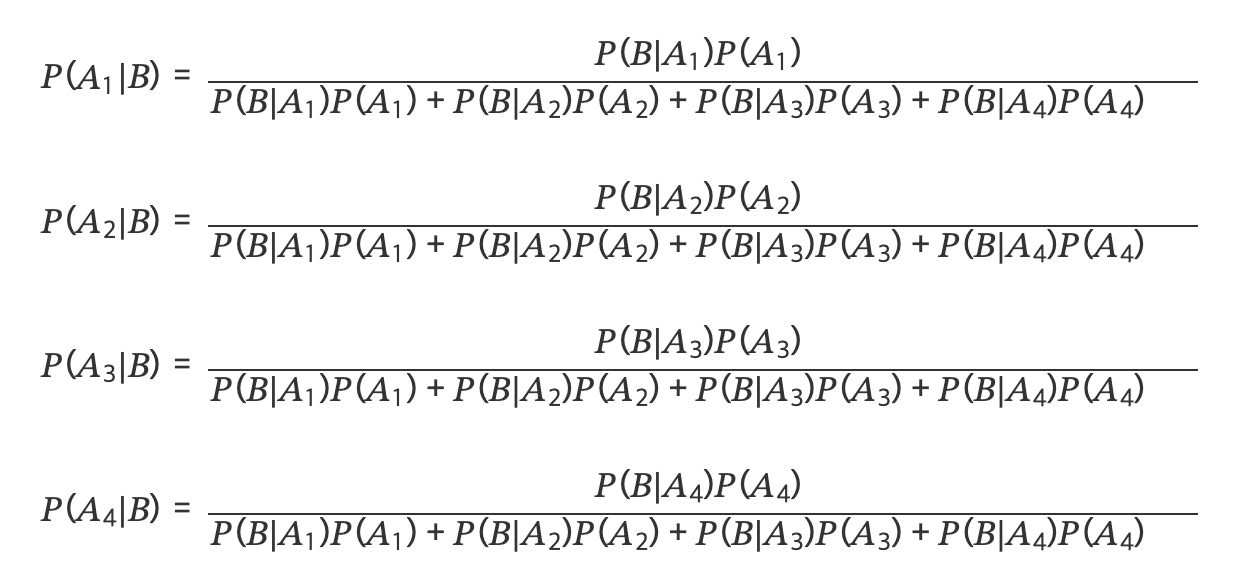

Multi-Class Classification에서의 베이즈 정리

-

B라는 힌트를 주고 보기 1번 ~ 4번 까지의 고르는 경우

-

P(A1∣B),P(A2∣B),P(A3∣B),P(A4∣B) 4개의 조건부 확률값을 비교

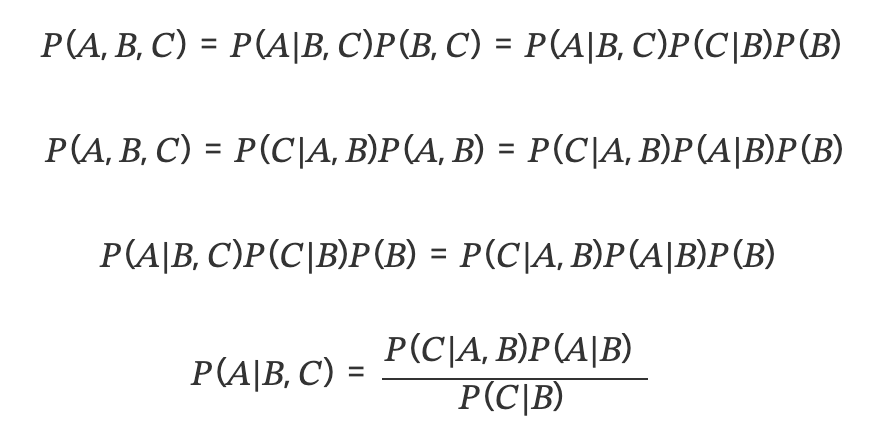

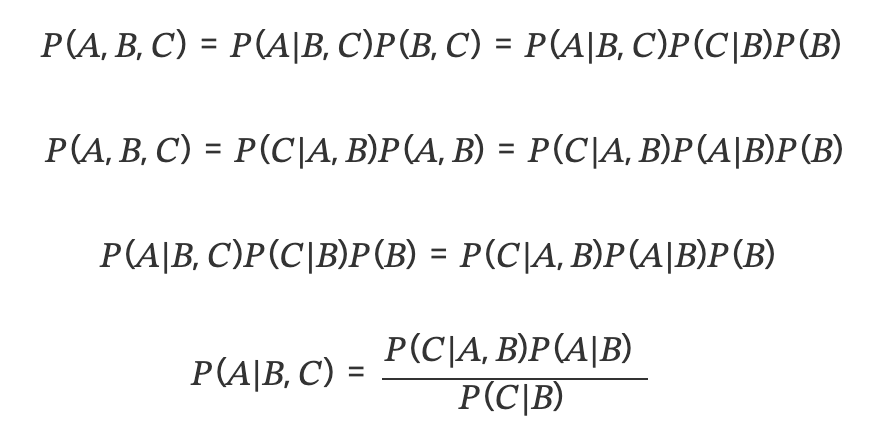

추가적인 사건 C가 발생했을 때의 베이즈 정리

P(A∣B,C)=P(A∣(B∩C)=P(C∣B)P(C∣A,B)P(A∣B)

- 증명