[Paper review] UniVAD: A Training-free Unified Model for Few-shot Visual Anomaly Detection

Paper Seminar

[CVPR 2025] UniVAD: A Training-free Unified Model for Few-shot Visual Anomaly Detection

Introduction

Visual Anomaly Detection (VAD)는 정상 패턴에서 벗어난 이상 샘플을 판별하는 과제로서, 산업, 논리적, 의료 영상 등 여러 도메인에서 중요하게 활용됩니다. 하지만 각 분야의 데이터 분포와 이상 유형이 크게 달라, 기존 VAD 기법들은 대개 특정 도메인에 특화된 맞춤 설계로 개발되어 왔습니다. 예를 들어, 산업 부품 결함 탐지에 뛰어난 PatchCore 모델도 논리적 이상 탐지 데이터셋에 적용하면 성능이 84.1%에서 62.0%로 급격히 하락합니다. 또한 동일 도메인 내에서도 “카테고리당 하나의 모델” 형태로 객체 종류마다 별도 모델을 훈련시키는 경향이 있는데, 이렇게 대량의 정상 샘플로 학습한 모델은 해당 범주 외엔 적용이 어렵고, 도메인 간 통합된 평가도 어렵게 만듭니다. 이러한 한계는 VAD 연구의 범용성과 표준화를 저해해왔습니다.

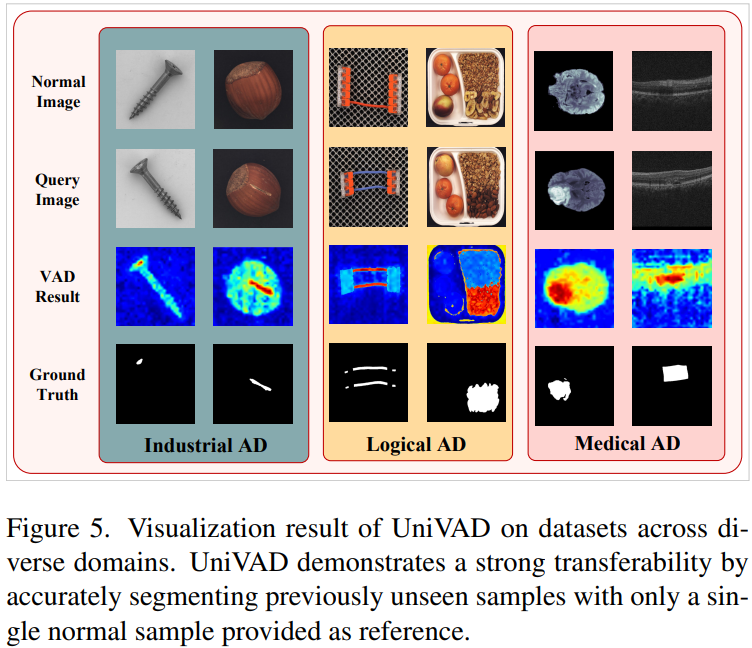

UniVAD는 이러한 문제를 해결하고자 제안된 새로운 방법으로, 학습 단계 없이 도메인에 구애받지 않고 이상 탐지를 수행하는 통합 모델입니다. 이 모델은 테스트 시 소량의 정상 샘플만 참고로 활용하여, 사전에 본 적 없는 새로운 객체의 이상까지 탐지할 수 있습니다. 특히 산업, 논리적, 의료 영상 등 서로 이질적인 영역에서 하나의 모델로 동작하도록 설계되었으며, 이미지의 구성요소들을 정확히 분할하고 다중 수준의 이상 징후를 포착하는 독자적인 모듈들을 도입했습니다. 그 결과 사전에 특정 도메인 데이터로 훈련하지 않고도 여러 분야에서 최첨단의 성능을 달성해, VAD 연구의 범용 모델 가능성을 보여줍니다.

Key Contributions

UniVAD 논문에서 저자들은 다음과 같은 주요 기여를 강조합니다:

-

도메인에 상관없이 동작하는 첫 학습-불필요 범용 VAD 모델 제시: 산업, 논리, 의료 이상 탐지를 단일 모델로 few-shot 설정에서 수행 가능하게 하였습니다. 별도 분야마다 탐지 기법과 모델을 개발해야 하는 부담을 줄여, 이상 탐지 연구의 표준화에 기여합니다.

-

효과적인 구성요소 기반 이상 탐지 모듈 설계: Few-shot 상황에서도 객체의 구성요소를 정확히 분할하는 문맥적 구성요소 클러스터링(C3) 모듈을 고안했습니다. 또한 구성요소-인식 패치 매칭(CAPM) 모듈과 그래프-강화 구성요소 모델링(GECM) 모듈을 결합하여, 서로 다른 의미 수준(국소 구조부터 논리 관계까지)의 이상을 견고하게 탐지할 수 있음을 보였습니다.

-

폭넓은 실험을 통한 SOTA 성능 입증: 산업(예: MVTec-AD, VisA), 논리(MVTec-LOCO), 의료(BrainMRI, LiverCT 등) 도메인의 9개 데이터셋에 대한 few-shot 이상 탐지 실험에서 최신 SOTA 성능을 기록하였습니다. 도메인 전반에 걸친 효과성과 일반화를 구현함으로써 제안 기법의 우수성을 입증했습니다.

Method Overview

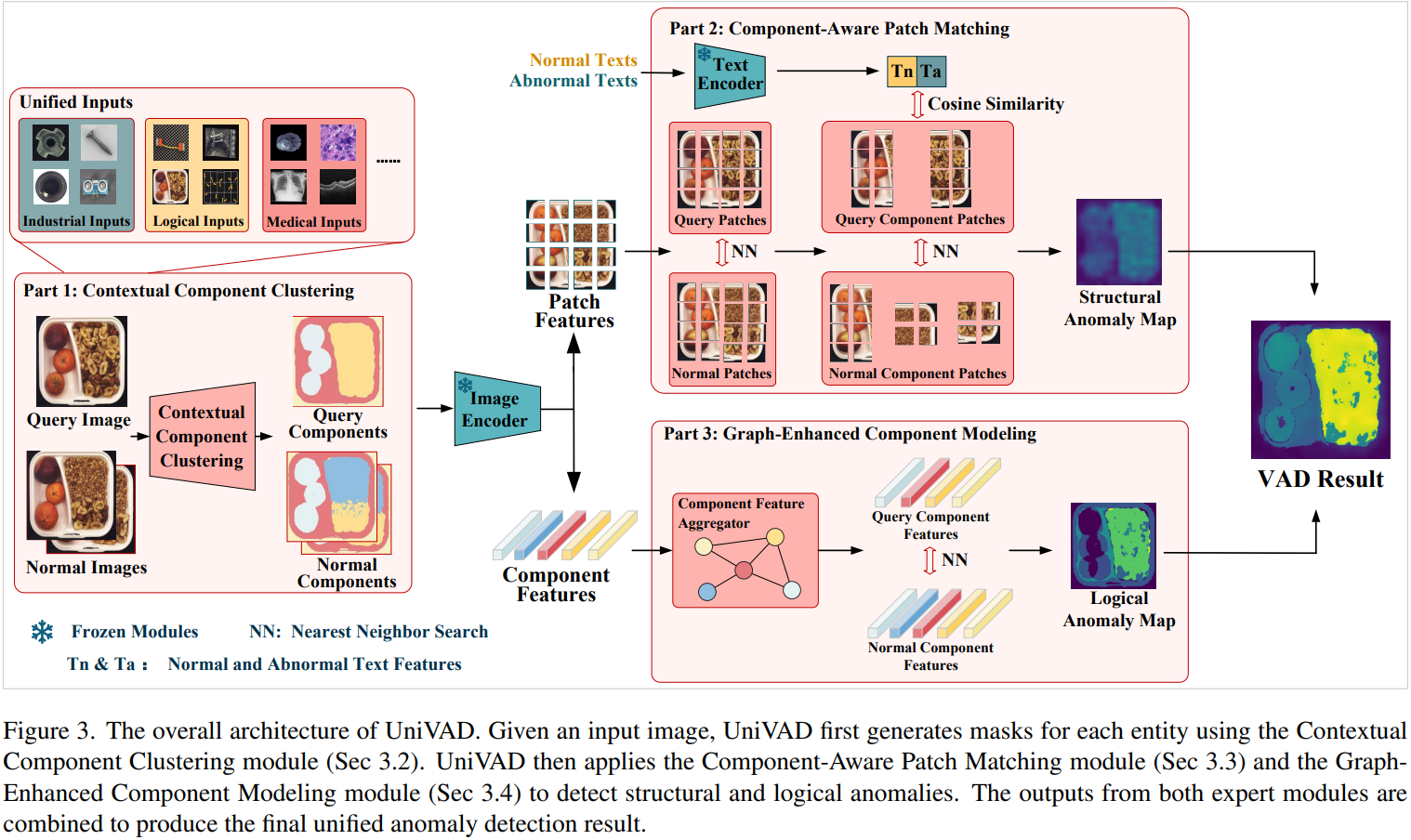

UniVAD는 세 단계의 모듈을 통해 이미지 이상을 탐지합니다. 우선 이미지에서 구성요소(segment)들을 분할해내고, 이후 패치 수준에서 세밀한 이상 징후를 탐지하며, 마지막으로 구성요소 간 관계를 분석하여 고수준 논리 이상을 찾아냅니다. 아래 그림은 UniVAD의 전체 구조를 보여줍니다.

Figure: UniVAD 아키텍처 개요. 입력 이미지와 몇 장의 정상 참고 이미지를 받아 (1) 문맥적 구성요소 클러스터링 (C3) 모듈로 구성요소를 마스크 단위로 분할합니다. 이후 이미지 인코더로 추출한 특징을 활용하여 (2) 구성요소-인식 패치 매칭 (CAPM)으로 국소 구조적 이상을 찾고, 텍스트 인코더를 활용한 이미지-텍스트 매칭까지 결합해 구조적 이상 맵을 생성합니다. 동시에 (3) 그래프-강화 구성요소 모델링 (GECM)으로 각 구성요소를 노드로 그래프 표현하여 논리적 이상 (누락, 추가, 잘못 배치된 구성요소)을 탐지하는 논리적 이상 맵을 생성합니다. 최종적으로 두 맵을 결합해 이미지의 이상 영역을 결정합니다.

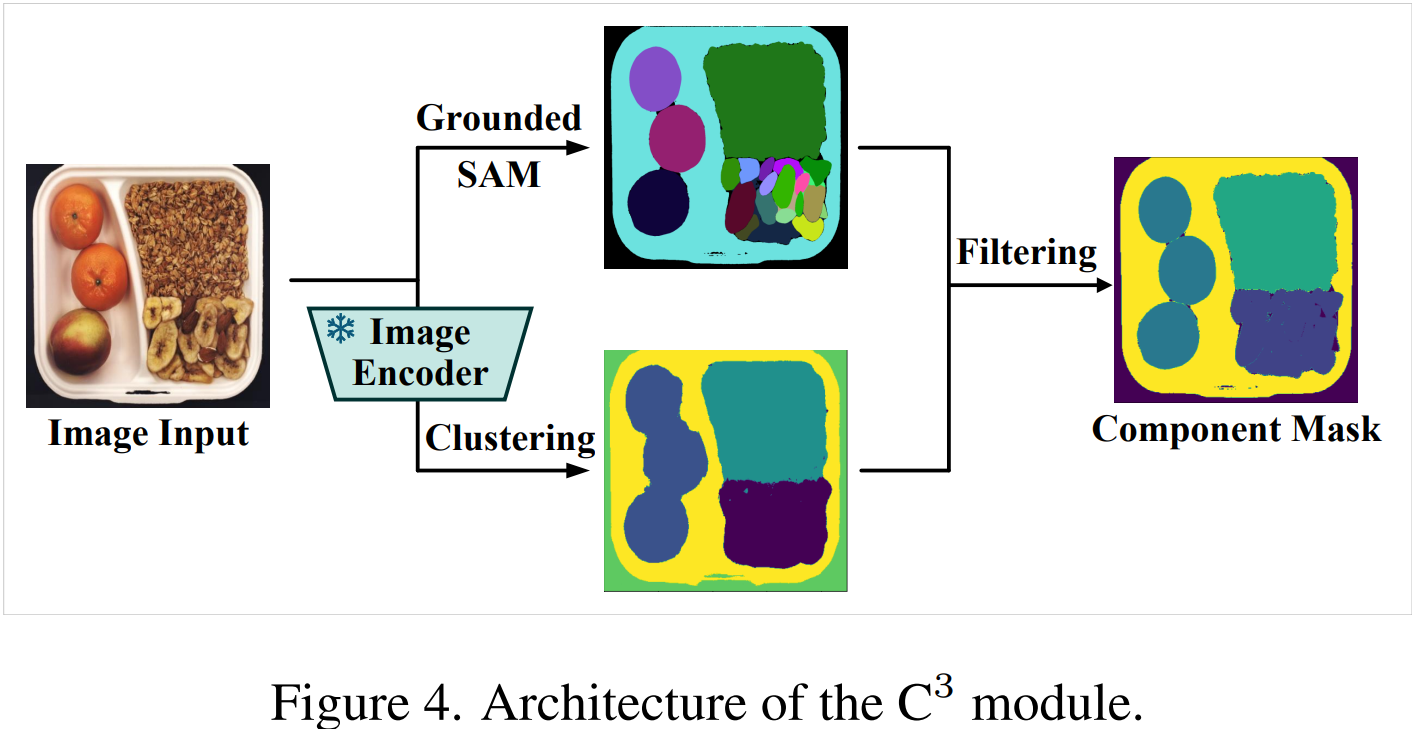

Contextual Component Clustering (C3)

C3 모듈은 Few-shot 환경에서 객체의 구성 요소(부분)를 정확하게 분할하기 위한 단계입니다. 사전 학습된 거대 비전 모델의 힘을 빌리면서도, 추가적인 클러스터링 기법으로 세분화 수준을 조절하는 것이 핵심입니다. C3 모듈의 동작을 요약하면 다음과 같습니다:

-

비전 파운데이션 모델 활용 초기 분할: 입력 이미지에 대해 RAM(Recognize Anything Model)으로 객체와 개념 태그를 인식하고, Grounded SAM으로 인식된 모든 요소의 마스크를 얻습니다. 이렇게 얻은 초기 마스크들은 때때로 너무 세밀하거나 지나치게 통합되는 문제가 있으므로 후처리가 필요합니다.

-

마스크 품질 판단 및 단일 객체 처리: 만약 SAM이 생성한 마스크가 하나뿐이며 이미지 대부분을 덮으면 (예: 나뭇결 같은 텍스처 표면) 해당 이미지 전체를 하나의 구성요소로 취급합니다. 반대로 마스크가 하나인데 이미지의 일부분만 덮는 경우에는 단일 객체 이미지로 간주하고 그 마스크를 그대로 채택합니다.

-

클러스터링 기반 다중 객체 분할 정제: 둘 이상의 마스크가 검출되었다면, 이미지 특징 공간에서의 클러스터링을 이용해 마스크들을 그룹화합니다. 구체적으로, 정상 참고 이미지들의 특징맵을 K-평균 클러스터링하여 N개의 군집 중심을 얻고, 각 픽셀이 어느 군집에 속하는지에 따라 N개의 클러스터 마스크를 형성합니다. 여기서 명백한 배경 군집은 제거하고 나면 유효한 구성요소 마스크 집합을 얻습니다. 마지막으로 초기 SAM 마스크들을 해당 군집에 할당하여, 같은 군집으로 분류된 여러 마스크를 하나로 합치는 방식으로 최종 구성요소 마스크를 산출합니다.

이 C3 과정은 대규모 사전학습 모델의 정밀한 분할 능력과 클러스터링의 군집화 제어력을 결합함으로써, 소량의 샘플만으로도 일관된 객체 구성요소 분할을 가능하게 합니다. 특히 기존 Vision 모델(SAM 등)만 사용할 때 발생하는 분할 과분/과소 문제를 보완하여, Few-shot 상황에서도 신뢰도 높은 구성요소 추출을 달성합니다.

Component-Aware Patch Matching (CAPM)

CAPM 모듈은 이미지의 세부 패치 수준에서 구조적 이상을 찾아내는 방법입니다. 이는 전통적인 패치 특징 매칭 기법을 발전시킨 것으로, 구성요소 단위 제약과 이미지-텍스트 특성 매칭을 도입하여 정확도를 높였습니다. CAPM의 주요 아이디어는 다음과 같습니다:

-

기본 패치 매칭: 사전학습된 이미지 인코더(예: ResNet, ViT 등)를 사용해 이미지의 특징맵을 추출하고, 이를 작은 패치(feature patch) 단위로 나누어 표현합니다. 이후 Query 이미지의 각 패치에 대해 정상(reference) 이미지들의 패치들과의 코사인 거리를 구하여 가장 가까운 패치를 찾고, 그 거리를 해당 패치의 이상 점수로 활용합니다. 이 방식은 PatchCore 등에서 사용된 패치 매칭 아이디어와 유사합니다.

-

구성요소-인식 제한: 기존 패치 매칭은 이미지 전체 패치를 통으로 비교하기에, 배경-전경 구분이 없어 배경 패치끼리 매칭되어 오탐지되거나, 다른 부위의 유사 패치가 잘못 매칭되어 놓치는 경우가 있었습니다. CAPM에서는 이러한 한계를 극복하기 위해 앞서 C3에서 얻은 구성요소 마스크를 활용합니다. 각 구성요소 마스크별로 Query와 정상 이미지 패치들을 그룹화하여 동일한 구성요소 내에서만 패치 매칭을 수행합니다. 이렇게 하면 원본과 대상 패치가 같은 부위에서 나오도록 제한되어 구조적 이상 탐지 정확도가 향상됩니다.

-

비전-언어 특징 매칭: 추가로, 사전학습된 CLIP과 같은 텍스트 인코더를 이용해 일반적인 “정상” 상태와 “이상” 상태에 대한 텍스트 임베딩을 얻습니다. Query 이미지의 각 패치 특징과 정상/이상 텍스트 임베딩 사이 코사인 유사도를 계산하여, 해당 패치가 문맥상 정상적 특성에 가까운지 혹은 이상 특성에 가까운지 점수화합니다. 이 이미지-텍스트 매칭 점수는 패치의 이상 여부를 판별하는 또 하나의 신호로 활용됩니다.

이 세 가지 요소—(1) 전체 패치 최근접 매칭 점수 $Score_{pm}$, (2) 구성요소 국한 매칭 점수 $Score_{aware}$, (3) 비전-언어 기반 점수 $Score_{vl}$—를 동등 가중치로 합산하여 최종적인 구조적 이상 점수 맵을 얻습니다. 이를 통해 작은 결함, 질감 이상, 조직 병변 등 국소적인 이상을 효과적으로 부각시킬 수 있습니다. CAPM은 구성요소 맥락과 언어 지식을 결합함으로써 기존 패치 매칭 대비 구조적 이상 탐지 성능을 향상시킨 것이 확인되었습니다.

Graph-Enhanced Component Modeling (GECM)

GECM 모듈은 구성요소 간 관계를 분석하여 고차원적인 논리 이상을 탐지하는 단계입니다. 예를 들어, 정상 샘플들에서는 항상 존재해야 할 부품이 누락되었거나, 추가되어선 안 될 요소가 끼어들었거나, 위치나 조합이 어긋난 경우 등을 잡아냅니다. 이러한 논리적 이상은 종종 이상 부위 자체는 정상 샘플에도 존재하는 요소이기에, 앞서의 패치 단위 비교만으로는 탐지가 어렵습니다. GECM은 그래프 신경망을 통해 각 구성요소의 전체적 특성과 상호 관계를 모델링함으로써 이러한 문제를 해결합니다.

구체적으로, Query 이미지와 정상 이미지들의 구성요소별 특징 벡터를 추출하여, 각 구성요소를 **노드(node)**로 취급합니다. 노드들 간의 유사도를 에지(edge)의 가중치로 하는 그래프를 만들어주는데, 이는 곧 구성요소들 사이의 유사성/연관성을 표현합니다. 이 그래프 구조 위에서 그래프 어텐션 네트워크를 적용해 노드 임베딩을 업데이트하면, 각 구성요소 노드가 주변 다른 노드들과의 관계까지 반영된 망라된 표현을 얻게 됩니다.

그 다음, Query 그래프의 각 구성요소 임베딩을 정상 그래프의 임베딩들과 비교하여 가장 가까운 거리를 딥(feature) 수준 이상 점수로 계산합니다. 동시에, 구성요소의 기하학적 속성(영역 크기, 색상, 위치 등)도 추출하여 동일하게 최근접 정상 대비 거리를 기하학적 이상 점수로 산출합니다. 예를 들어, 정상 샘플에서는 두 개 있어야 할 부품이 Query 이미지에서는 하나만 발견된다면, 해당 구성요소의 위치/개수 정보에서 이상 신호를 포착할 수 있습니다. 마지막으로 딥 특징 기반 점수와 기하학 점수를 결합하여 논리적 이상 점수를 얻고, 앞서 CAPM의 구조적 이상 맵과 합쳐 최종 이상 탐지 결과를 도출합니다.

정리하면 GECM은 구성요소 레벨에서의 전체 맥락 이해를 제공하여, 단순 패치 매칭으로는 놓칠 수 있는 구성요소의 누락/추가/오배치 같은 복합 이상을 잡아냅니다. 논리적 제약이 중요한 데이터셋(예: 복잡한 조립품, 논리적 무결성이 필요한 장면)에서 이 모듈은 성능 향상에 크게 기여합니다.

Experiments

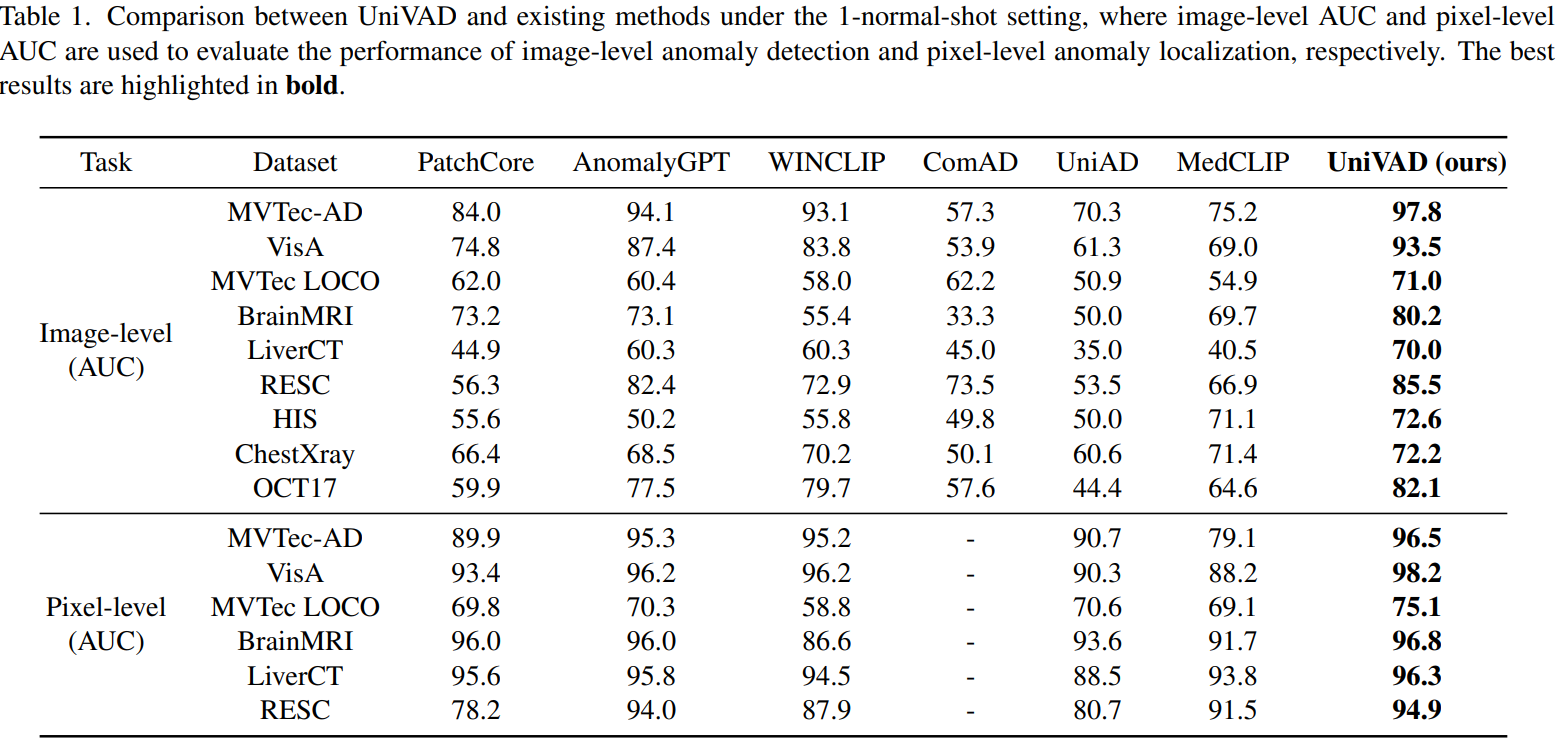

UniVAD의 성능은 산업, 논리, 의료 각 분야의 대표 9개 데이터셋에서 평가되었습니다. 특히 1-shot (정상 샘플 1장 참고)과 few-shot 설정에서 기존 기법들과 비교하여 큰 폭의 성능 향상을 보였습니다.

벤치마크 결과: 1-normal-shot 기준으로 Table 1의 결과를 요약하면, UniVAD는 모든 도메인에서 기존 특화 모델들을 능가하는 최고 성능을 기록했습니다. 예를 들어 산업 분야 MVTec-AD에서는 PatchCore, AnomalyGPT 등을 제치고 이미지 수준 AUC 97.8%로 1위를 달성했고, 논리적 이상 데이터셋 MVTec-LOCO에서도 기존 SOTA인 ComAD의 62.2%를 크게 웃도는 **71.0%**를 달성했습니다. 의료 영상의 BrainMRI의 경우도 80.2%로, 차best였던 AnomalyGPT(73.1%)보다 높았습니다. 이러한 향상은 도메인별 최고 기법 대비 이미지-AUC 평균 +6.2%p, 픽셀-AUC +1.7%p의 개선으로 요약되며, UniVAD의 뛰어난 범용성과 전이 성능(transferability)을 입증합니다. 또한 추가로 제시된 few-abnormal-shot 시나리오(소량의 이상 샘플로 파인튜닝)에서도 6개의 의료 데이터셋에 대해 기존 지도학습 기법들을 상회하는 성능을 보였는데, 이는 필요시 도메인 적응을 통해 성능을 극대화할 수 있음을 시사합니다.

모듈 별 성능 기여 (Ablation Studies): 저자들은 UniVAD의 핵심 구성요소들에 대한 ablation 실험을 수행하여 각 모듈의 효과를 검증했습니다:

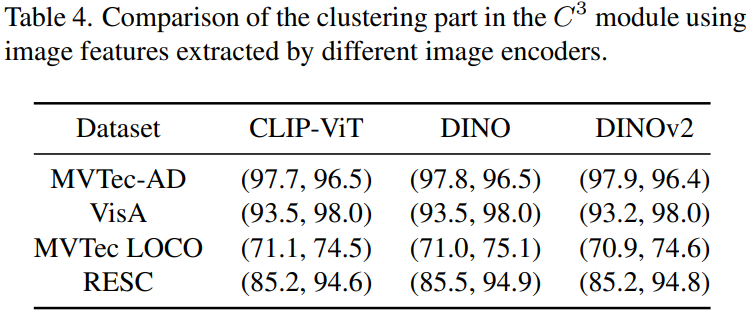

- C3 모듈 효과: “Vision foundation 모델만 사용” vs “클러스터링만 사용” vs *“C3 결합 사용”*으로 나누어 성능을 비교한 결과, 세 접근을 조합한 C3 모듈이 가장 우수한 이상 탐지 결과를 냈습니다. 이는 SAM 등의 강력한 분할 능력에 클러스터링으로 세밀 제어를 더한 C3 전략의 우월성을 뒷받침합니다. 또한 C3 내에서 사용된 이미지 인코더 종류(CLIP, DINO 등)를 바꿔 실험한 결과 큰 성능 차이가 없었는데, 이는 C3 방법의 인코더 불변적 견고함을 보여줍니다.

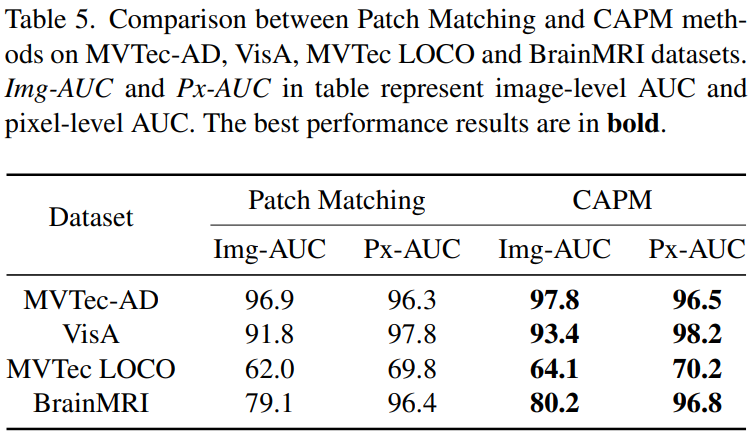

- CAPM vs 일반 패치매칭: Table 5에서 원본 패치매칭과 CAPM을 비교한 결과 모든 테스트 데이터셋에서 CAPM이 이미지-AUC 및 픽셀-AUC 향상을 가져왔습니다. 특히 MVTec-AD에서 이미지-AUC가 96.9%→97.8%, VisA에서 91.8%→93.4%로 향상되었고, 논리적 LOCO에서도 62.0%→64.1%로 상승했습니다. CAPM의 동일 부위 제한 매칭과 텍스트 결합이 구조적 이상 탐지에 기여했음을 보여줍니다.

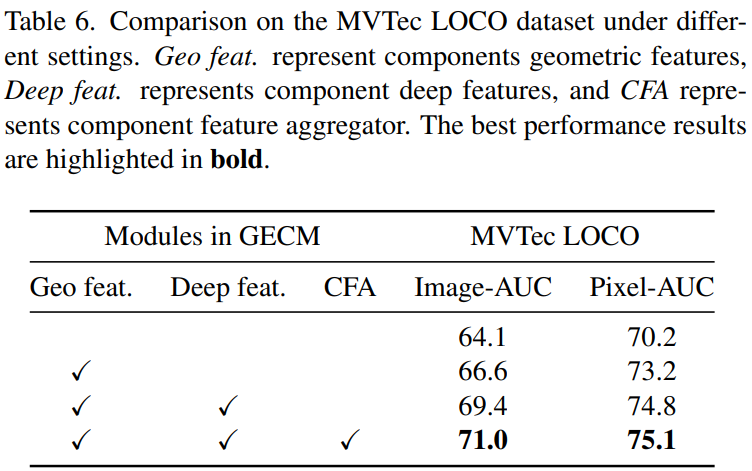

- GECM 세부 요소 기여: 논리적 이상 탐지에 중요한 GECM 모듈의 구성 요소들도 MVTec-LOCO 데이터에서 상세 분석되었습니다. 기하학 특징(Geo)만 사용, 딥 특징(Deep)만 사용, 그래프 어그레게이터(CFA) 미적용 등 몇 가지 설정을 비교한 결과, 모든 요소를 결합(CFA+Geo+Deep)했을 때 이미지-AUC 71.0%, 픽셀-AUC 75.1%**로 가장 높았습니다. 반면 단순 CAPM만 적용한 경우 이미지-AUC 64.1%, Geo추가 66.6%, Deep추가 69.4%로 단계적으로 향상되었습니다. 이는 구성요소 간 관계를 모델링하고 다양한 특징을 활용**하는 GECM 접근이 복합 이상 탐지에 효과적임을 입증합니다.

Strengths

UniVAD이 보여준 몇 가지 두드러진 강점을 정리하면 다음과 같습니다:

-

학습 없이도 범용 동작: 특정 도메인 데이터로 추가 학습이 전혀 필요 없고, 테스트 시 제공되는 몇 장의 정상 예시만으로도 이상 탐지가 가능합니다. 이러한 training-free 접근은 새로운 객체나 도메인에 즉각 적용될 수 있어 실용적입니다.

-

단일 모델로 도메인 통합: 산업용 결함, 논리적 무결성 이상, 의료 영상 병변 등 이질적인 분야를 하나의 모델로 처리할 수 있습니다. 연구자나 현업자는 더 이상 분야마다 다른 모델을 만들 필요 없이, UniVAD 같은 통합 솔루션을 활용하여 일관된 평가와 적용을 할 수 있습니다. 이는 VAD 연구의 표준화에도 기여하는 방향입니다.

-

Few-shot 환경에서의 뛰어난 성능: 정상 샘플이 매우 적은 1-shot/few-shot 상황에서도 UniVAD는 각 분야별 최적 기법들을 앞서는 탁월한 탐지 성능을 보였습니다. 이는 제한된 데이터 환경에서 모델의 일반화 능력과 전달 학습 효과가 매우 우수함을 의미하며, 실제 이상 탐지 시나리오(정상 데이터만 조금 있고 이상 데이터는 거의 없는 경우)에 적합합니다.

Limitations

물론 UniVAD에도 개선 여지가 있는 한계점이 있습니다:

-

대형 모델 의존으로 인한 속도 저하: UniVAD는 구성요소 분할을 위해 RAM, Grounding DINO, SAM 등의 비전 파운데이션 모델에 의존합니다. 이로 인해 추론 단계의 계산 지연이 발생하며, 실시간 처리가 요구되는 응용에는 제약이 있습니다. 예컨대 고해상도 이미지나 다수 구성요소를 가진 입력에 대해서는 현업 적용 시 속도가 충분치 않을 수 있습니다.

-

실시간 응용에서의 잠재적 병목: 위 제약과 맞물려, 제조 공정 모니터링 등 실시간 이상 감지 시스템에 UniVAD를 바로 적용하려면 추론 최적화가 필요합니다. 현재 구조는 고성능 GPU 환경에서의 오프라인 분석에는 적합하지만, 지연 허용도가 낮은 임베디드/엣지 환경에서는 성능 병목이 될 가능성이 있습니다.

Note: 저자들도 이러한 한계를 인지하고 있으며, UniVAD의 강점인 범용성과 일반화 성능이 이러한 속도상의 트레이드오프를 상회한다고 언급합니다.

Personal Commentary

UniVAD는 도메인 특수화가 만연했던 이상 탐지 분야에 통합 모델이라는 새로운 패러다임을 제시했다는 점에서 의의가 큽니다. 하나의 모델로 여러 분야의 이상을 다룰 수 있게 됨으로써, 연구 커뮤니티가 공통된 기준으로 성능을 비교하고 발전시킬 수 있는 길이 열렸습니다. 이는 마치 NLP 분야에서 범용 언어 모델이 등장해 표준화에 기여한 것처럼, VAD 분야의 표준화된 벤치마크와 기술 공유를 촉진할 것으로 보입니다. 특히 UniVAD는 "한 카테고리-한 모델"의 비효율을 극복하여 다양한 이상 유형을 포괄하는 범용 해법을 보여주었고, 향후 관련 연구의 새로운 기준선이 될 수 있습니다.

물론 실용화 측면에서 속도 개선은 중요한 과제로 남습니다. 현재의 파운데이션 모델 기반 분할을 더 가볍게 대체하거나 지능적으로 캐싱/리유즈하는 방법, 혹은 지엣 지도를 빠르게 예측하는 경량 모델과의 하이브리드 등을 통해 추론 지연을 줄이는 방향이 향후 연구될 수 있습니다. 또한 본 논문에서 제시한 few-shot 세팅 외에, 소수의 이상 샘플을 활용한 semi-supervised 학습 변형도 생각해볼 수 있습니다. 실제로 저자들이 시도한 few-abnormal-shot 미세 튜닝은 그런 맥락인데, 이를 보다 체계적으로 확장하면 정상/이상 데이터를 약간씩 사용해 성능을 극대화하는 도메인 적응 기법으로 발전시킬 수 있을 것입니다. 나아가 이상 부분의 정밀 분할(segmentation) 성능을 높이기 위해, UniVAD의 구조에 전용 세그멘테이션 모듈이나 후처리를 추가하는 연구도 전개될 수 있습니다.

종합하면, UniVAD는 학습 필요 없는 범용 이상 탐지라는 개념 증명을 훌륭히 해냈으며, 이를 바탕으로 향후 더 빠르고 효율적인 통합 모델, 소량의 라벨을 활용하는 변형 모델 등 다양한 후속 연구 방향이 기대됩니다. VAD 분야 전반의 발전과 표준화에 촉매가 될 흥미로운 연구라고 평가합니다.