Abstract

다중 인스턴스 학습은 감독 학습 예제에서 모호성을 모델링하는 방법입니다. 각 예는 인스턴스의 백이지만 개별 인스턴스가 아닌 백에만 레이블이 지정됩니다. 모든 인스턴스가 음수이면 백에 음수 레이블이 지정되고 하나 이상의 인스턴스가 양수이면 양수 레이블이 지정됩니다. 우리는 자연 이미지를 분류하는 방법을 학습하는 문제에 다중 인스턴스 학습 프레임워크를 적용합니다. 이미지는 다양한 것을 나타낼 수 있기 때문에 본질적으로 모호합니다. 이미지에 어떤 식으로든 개념이 포함된 경우 사용자는 이미지에 긍정적인 레이블을 지정합니다. 각 이미지는 가방이고 인스턴스는 이미지의 다양한 하위 영역입니다. 긍정적이고 부정적인 예의 작은 컬렉션에서 개념을 학습한 다음 이를 사용하여 대규모 데이터베이스에서 개념이 포함된 이미지를 검색할 수 있습니다. 우리는 다양한 밀도(Diverse Density) 알고리즘이 이 작업에서 잘 수행되고 간단한 가설 클래스가 자연 이미지를 분류하기에 충분하며 사용자 상호 작용이 성능 향상에 도움이 된다는 것을 보여줍니다.

1. INTRODUCTION

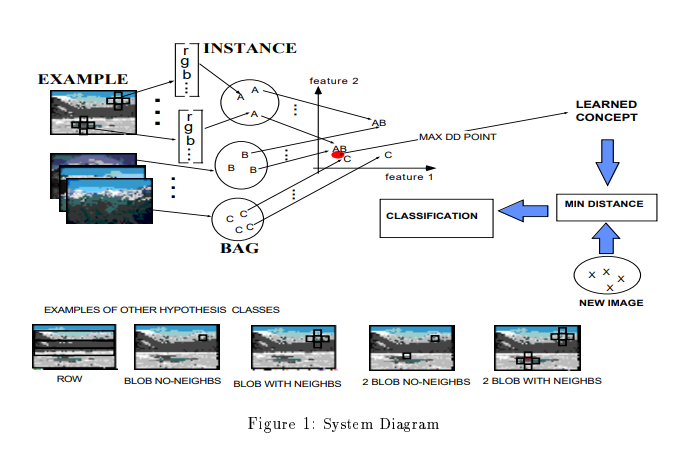

장면 분류는 머신 비전의 미해결 문제이며 이미지 및 비디오 데이터베이스 인덱싱에 적용됩니다. 긍정적이고 부정적인 예의 작은 세트에서 장면 클래스의 속성을 인코딩하는 시각적 개념을 학습하는 방법을 조사합니다. 추출된 개념은 클래스의 일부 색상 및 공간 속성을 캡처하는 간단한 템플릿입니다. Lipson의 작업[Lipson et al., 1997]은 이미지의 상대적인 색상과 공간 속성을 설명하는 단순하고 손으로 만든 템플릿을 성공적으로 사용하여 들판, 눈 덮인 산, 폭포와 같은 자연 장면을 분류할 수 있음을 보여줍니다. 이 문서에서는 이러한 템플릿을 학습할 수 있음을 보여줍니다. 대규모 데이터베이스에서 콘텐츠 기반 이미지 검색 작업에 효과적으로 사용할 수 있는 장면 클래스 개념을 학습하기 위한 프레임워크를 설명합니다. 이 논문에서 사용하는 학습 프레임워크는 다중 인스턴스 학습[Dietterich et al., 1997],[Maron and Lozano-Perez, 1998]이라고 합니다. 이 프레임워크에서 예제는 레이블이 지정된 예제가 아니라 레이블이 지정된 백입니다. 각 백은 인스턴스 모음입니다(그림 1). 백에 있는 모든 인스턴스가 음수이면 백에 음수 레이블이 지정되고 포함된 인스턴스 중 하나 이상이 양수이면 양수 레이블이 지정됩니다. 우리는 이 프레임워크를 사용하여 이미지를 설명하는 많은 가능한 템플릿에 이미지를 매핑할 때의 모호성을 모델링합니다. 특히, 모든 이미지는 가방이며 이미지를 설명하기 위한 각 가능한 템플릿은 가방의 한 인스턴스입니다. 다중 인스턴스 예제에서 개념을 학습하기 위해 다양한 밀도(Diverse Density)[Maron and Lozano-Perez, 1998]라는 방법에 대해 논의합니다.

우리는 COREL 사진 라이브러리의 이미지에 대한 접근 방식을 테스트합니다. 우리는 가설 클래스가 매우 간단한 템플릿을 포함하고 이미지가 매우 거칠게 샘플링된 경우에도 시스템이 성공적임을 보여줍니다. 또한 사용자 상호작용(더 많은 예제 추가를 통해 가설을 다듬음)이 학습 시스템의 성능 향상에 도움이 된다는 것을 보여줍니다. 섹션 2에서는 이미지 분류의 이전 및 관련 작업에 대해 설명합니다. 그런 다음 다중 인스턴스 학습 프레임워크와 다양한 밀도(Diverse Density) 알고리즘을 설명합니다. 섹션 4에서는 실험 설정을 자세히 설명하고 다양한 개념 클래스, 가설 클래스 및 훈련 체계에 대한 결과를 보여줍니다.

이 논문의 세 번째 기여(다중 인스턴스 학습의 새로운 적용 및 이 작업에서 놀랍도록 간단한 개념이 잘 수행된다는 발견에 추가)는 비전 및 기계 학습 커뮤니티의 아이디어를 결합하는 일반 아키텍처의 개발입니다. 우리 시스템의 핵심 부분은 백 생성기입니다. 이미지를 가져와 일련의 인스턴스를 생성하는 메커니즘입니다. 여기서 각 인스턴스는 이미지가 무엇인지에 대한 가능한 설명입니다. 이상적인 물체 인식기가 존재한다면 가방 생성기는 단순히 이미지의 물체 목록을 출력할 것입니다. 학습 알고리즘은 간단합니다: 네거티브 목록의 요소를 포함하지 않은 포지티브 목록 간의 교차점을 찾습니다. 다른 극단으로 가방당 수십억 개의 인스턴스를 처리할 수 있는 학습 알고리즘이 있다면 객체 인식기가 필요하지 않을 것입니다.

대신, 백 생성기는 이미지에 있는 픽셀의 모든 하위 조합을 간단히 출력합니다. 이 논문에서는 약간 더 정교한 백 생성기(하위 영역을 생성하는 것)를 사용하여 백당 인스턴스 수를 제한하므로 다양한 밀도(Diverse Density)와 같은 알고리즘을 사용할 수 있습니다. 핵심 관찰은 더 나은 백 생성기(비전 커뮤니티의 발전)가 더 간단한 학습 알고리즘으로 이어지는 동시에 더 나은 다중 인스턴스 학습 알고리즘(기계 학습 커뮤니티의 발전)을 통해 더 간단한 세분화 알고리즘을 사용할 수 있다는 것입니다. 이것은 예를 들어 [Keeler et al., 1991]의 아키텍처와 대조되는 것으로, 여기서 학습 메커니즘은 하위 이미지의 위치 불변 표현으로 짜여져 있습니다.

## 2. IMAGE CLASSIFICATION SYSTEMS 지난 몇 년 동안 디지털 이미지 및 비디오 라이브러리의 수가 증가함에 따라 데이터베이스에서 사용자 쿼리와 유사한 이미지를 효율적으로 검색할 수 있는 유연하고 자동화된 콘텐츠 기반 이미지 검색 시스템이 필요하게 되었습니다. 사용자가 원하는 것이 크게 다를 수 있기 때문에 우리는 시스템이 예제를 불러오도록 하여 사용자가 쿼리를 탐색하고 구체화할 수 있는 방법을 제공하고자 합니다.

인덱싱에 가장 널리 사용되는 글로벌 기술 중 하나는 이미지의 전체 색상 분포를 측정하는 색상 히스토그램입니다. 히스토그램은 위치 및 방향 변화에 상대적으로 민감하지 않기 때문에 유용하지만 색상 영역의 공간적 관계를 캡처하지 못하므로 식별력이 제한됩니다. 기존의 많은 이미지 쿼리 시스템은 색상, 질감 및 구조적 속성의 분포를 사용하여 전체 이미지 또는 사용자 지정 영역에서 작동합니다. QBIC 시스템[Flickner et al., 1995]은 그러한 시스템의 예입니다. 일부 공간 정보를 색상 기능 세트에 통합하려는 일부 최근 시스템에는 [Smith and Chang, 1996, Huang et al., 1997, Belongie et al., 1998]이 포함됩니다. 지구 이동자의 거리에 대한 Rubner의 유망한 작업[Rubner et al., 1998]은 인덱싱을 위한 분포 거리의 기존 정의의 비닝 문제를 극복하는 메트릭을 제공합니다. 이러한 기술의 대부분은 사용자가 쿼리 이미지에서 두드러진 영역을 지정하도록 요구합니다. 우리 시스템의 목표 중 하나는 특정 클래스의 자연 장면을 가장 잘 설명하는 관련 색상 및 공간 속성을 학습하는 것입니다.

보다 최근에 장면 분류에서 Lipson과 Sinha([Lipson et al., 1997])의 작업은 이미지의 상대적인 색상과 공간 속성을 설명하는 미리 정의된 유연한 템플릿이 이 작업에 효과적으로 사용될 수 있음을 보여줍니다. Lipson에 의해 구성된 유연한 템플릿[Lipson et al., 1997]은 장면 클래스를 일련의 이미지 패치 및 해당 패치 간의 질적 관계로 인코딩합니다. 각 이미지 패치는 색상 및 휘도 채널에 속성이 있습니다. 이러한 템플릿은 색상 관계(R,G,B 채널의 상대적 변화), 휘도 관계(휘도 채널의 상대적 변화) 및 두 이미지 패치 간의 공간 관계를 설명합니다. Lipson은 다양한 장면 클래스에 대해 이러한 유연한 템플릿을 수작업으로 제작했으며 들판, 폭포 및 눈 덮인 산의 자연 장면을 효율적이고 안정적으로 분류하는 데 사용할 수 있음을 보여주었습니다. 예를 들어 설산 클래스에 대해 다음과 같은 개념을 학습할 수 있습니다. "이미지에 갈색 얼룩 위에 있는 흰색 얼룩 위에 있는 파란색 얼룩이 있으면 산입니다." 이 논문에서 우리는 작은 양의 예와 음의 예를 통해 자연 이미지에 대한 이러한 개념을 배우고자 합니다.

위에서 설명한 모든 시스템은 사용자가 원하는 것을 정확하게 지정해야 합니다. Minka와 Picard[Minka와 Picard, 1996]는 시스템이 색상과 질감 단서를 기반으로 이미지 내에서 그리고 이미지 전체에서 이미지 그룹화를 선택할 수 있도록 하는 긍정적인 예와 부정적인 예를 사용하여 시스템에 학습 구성 요소를 도입했습니다. 그러나 그들의 시스템은 사용자가 장면의 다양한 부분에 레이블을 지정하도록 요구하는데, 우리 시스템은 전체 이미지에 대한 레이블만 가져오고 자동으로 장면의 관련 부분을 추출합니다. 이 논문에서는 소량의 포지티브 및 네거티브 예제를 사용하여 이미지 패치 간의 색상 및 공간 관계를 추출하여 자연스러운 장면 개념을 학습하는 데 중점을 둡니다.

우리 시스템은 데이터베이스에서 유사한 이미지를 검색하는 데 사용되는 장면 개념을 학습하기 위해 사용자가 선택한 긍정 및 부정 예제의 작은 세트를 사용합니다. 이 시스템은 또한 사용자가 개념을 다듬기 위해 각 반복 후에 더 긍정적이고 부정적인 예를 추가할 수 있도록 합니다.

3. MULTIPLE-INSTANCE LEARNING

전통적인 감독 학습에서 학습 알고리즘은 개별적으로 레이블이 지정된 예제로 구성된 훈련 세트를 받습니다. 특히 교사(teacher)가 개별 인스턴스에 레이블을 지정할 수 없고 인스턴스 모음에만 레이블을 지정할 때 이 모델이 실패하는 상황이 있습니다. 예를 들어, 폭포가 포함된 그림이 주어졌을 때 폭포로 분류되는 이미지의 원인은 무엇입니까? 구석에 맴도는 나비일까, 활짝 핀 꽃일까, 하얀 물줄기일까? 이미지 하나만 봐서는 구분이 불가능합니다. 우리가 말할 수 있는 최선은 이미지의 개체 중 적어도 하나는 폭포라는 것입니다. 여러 이미지(각각 폭포 또는 비폭포로 레이블이 지정됨)가 주어지면 비폭포 이미지에 나타나지 않는 폭포 이미지 내에서 공통점을 찾으려고 시도할 수 있습니다. 다중 인스턴스 학습은 이 문제를 형식화하는 방법이고, Diverse Density는 공통점을 찾는 방법입니다.

다중 인스턴스 학습에서 우리는 각각 양수 또는 음수 레이블이 지정된 가방 세트를 받습니다. 각 백에는 많은 인스턴스가 포함되며 각 인스턴스는 기능 공간(feature space)의 한 지점입니다. 백의 모든 인스턴스가 음수이면 백에 음수 레이블이 지정됩니다. 반면에 백에 양성인 인스턴스가 하나 이상 있으면 백에 양성 레이블이 지정됩니다. 라벨이 붙은 가방 모음에서 학습자는 보이지 않는 가방에 올바르게 라벨을 붙일 수 있는 개념을 유도하려고 합니다. 이 문제는 노이즈가 많은 감독 학습보다 더 어렵습니다. 긍정적으로 레이블이 지정된 백(노이즈 비율)에서 네거티브 인스턴스와 포지티브 인스턴스의 비율이 임의로 높을 수 있기 때문입니다.

다중 인스턴스 학습 모델은 [Dietterich et al., 1997]에 의해 최근에야 공식화되었으며 여기서 그들은 약물 활동 예측 문제에 대한 알고리즘을 개발했습니다. 이 작업에 이어 [Long and Tan, 1996, Auer et al., 1996, Blum and Kalai, 1998]에 의해 이어졌는데, 그는 예제가 생성되는 방식에 대해 매우 제한적인 독립 가정이 만들어지지 않는 한 다중 인스턴스 모델에서 PAC 학습이 어렵다는 것을 보여주었습니다. [Auer, 1997]은 이러한 가정에도 불구하고 MULLINST 알고리즘이 약물 활동 예측 문제에서 경쟁적으로 수행됨을 보여줍니다. [Maron and Lozano-Perez, 1998]는 다양한 밀도(Diverse Density)라는 알고리즘을 개발하고 약물 활동 예측, 주식 선택, 그 사람이 포함된 일련의 이미지에서 그 사람에 대한 설명 학습과 같은 다양한 문제에서 잘 수행됨을 보여줍니다.

3.1 MULTIPLE-INSTANCE LEARNING FOR SCENE CLASSIFICATION

이 논문에서 각 훈련 이미지는 가방입니다. 특정 백의 인스턴스는 다양한 하위 이미지입니다. 예를 들어 백이 폭포로 레이블이 지정된 경우 하위 이미지(인스턴스) 중 하나 이상이 폭포라는 것을 알 수 있습니다. 가방에 폭포가 아닌 것으로 레이블이 지정되어 있으면 폭포가 포함된 하위 이미지가 없다는 것을 알 수 있습니다. 각 인스턴스 또는 하위 이미지는 일부 기능 공간(feature space)의 지점으로 설명됩니다. 섹션 4에서 논의한 것처럼 인스턴스를 설명하는 여러 가지 방법을 실험했습니다.

그 중 하나(이웃이 있는 단일 blob)에 대해 자세히 설명합니다. 하위 이미지는 2x2 픽셀 집합(blob이라고 함)과 4개의 인접한 blob(위, 아래, 왼쪽 및 오른쪽)입니다. 하위 이미지는 벡터 [x_1,x_2,...,x_15]로 설명되며, 여기서 x_1, x_2, x_3는 중앙 블롭의 평균 RGB 값이고, x_4, x_5, x_6는 중앙 블롭과 그 위에 있는 블롭 간의 평균 RGB 값 차이 등입니다.

따라서 하나의 백은 인스턴스의 모음이며 각 인스턴스는 15차원 기능 공간(feature space)의 한 지점입니다. 이러한 인스턴스 중 적어도 하나는 폭포가 포함된 템플릿이라고 가정합니다.

이제 새 이미지를 폭포 또는 폭포가 아닌 것으로 올바르게 분류하는 설명을 종료하려고 합니다. 이것은 훈련 중에 주어진 폭포수 이미지와 폭포수 이미지가 아닌 이미지 사이의 차이점 사이에 공통점을 찾는 것으로 수행할 수 있습니다. DD(Diverse Density) 알고리즘의 기본 아이디어는 모든 포지티브 백에서 적어도 하나의 인스턴스에 가깝고 모든 네거티브 인스턴스에서 멀리 떨어진 기능 공간(feature space)의 영역을 찾는 것입니다. 알고리즘은 다양한 밀도(Diverse Density)가 높은 포인트에 대한 기능 공간(feature space)을 검색합니다. 최대 DD가 있는 지점(또는 지점)이 발견되면 하위 이미지 중 하나가 최대 DD 지점에 가까우면 새 이미지가 양성으로 분류됩니다. 섹션 4에서 볼 수 있듯이 전체 데이터베이스는 학습된 개념까지의 거리를 기준으로 정렬할 수 있습니다. 그림 1은 시스템 작동 방식의 개략도입니다.

다음 하위 섹션에서는 다양한 밀도(Diverse Density)의 파생과 큰 기능 공간(feature space)에서 최대값을 찾는 방법을 설명합니다. 또한 특징 공간의 위치뿐만 아니라 각 특징의 가중치와 관련하여 DD를 최대화하여 특징 공간의 적절한 스케일링을 찾을 수 있음을 보여줍니다.

3.2 DIVERSE DENSITY

이 섹션에서는 다양한 밀도(Diverse Density)의 확률적 척도를 도출합니다. 더 자세한 내용은 [Maron, 1998]에서 제공됩니다.

양성 백을 B_i+로 표시하고 해당 백의 j번째 인스턴스를 B_ij+로 표시합니다.

마찬가지로 B_ij-는 네거티브 백의 인스턴스를 나타냅니다.

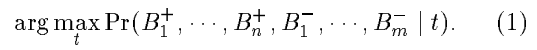

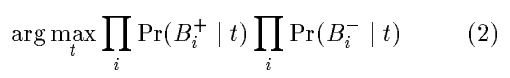

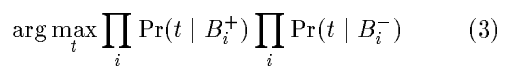

단순화를 위해 진정(ture)한 개념이 특징 공간(feature space)의 단일 지점 t라고 가정합니다. 특징 공간(feature space)에서 Pr(t|B_1+,..., B_n+, B_1-,..., B_m-) 전체 포인트를 최대화하여 t를 찾을 수 있습니다.

베이즈 규칙과 개념 위치에 대한 균일 이전을 사용하여 이것이 우도를 최대화하는 것과 동일함을 확인합니다.

백이 대상 개념(target concept) t에 대해 조건부 독립이라는 추가 가정을 함으로써 이것은 다음과 같이 분해됩니다.

이는 (위와 유사한 인수에 의해) 최대화와 동일합니다.

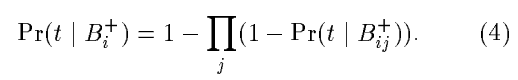

이것은 다양한 밀도(Diverse Density)의 일반적인 정의이지만 이를 인스턴스화하려면 제품의 용어를 정의해야 합니다. 본 논문에서는 다음과 같이 noise-or 모델을 사용한다.

noise-or 모델은 두 가지 가정을 합니다. 하나는 t가 대상 개념(target concept)이 되는 것이 백의 인스턴스 중 하나에 의해 발생(따라서 이에 근접)한다는 것입니다. 또한 인스턴스 j가 대상이 아닐 확률은 대상이 아닌 다른 인스턴스와 무관하다고 가정합니다.

마지막으로, 분포 Pr(t | B_ij+)를 가우시안과 유사한 exp(— || B_ij+ — t ||^2) 분포로 추정합니다. 네거티브 백의 기여도는 마찬가지로 Pr(t | B_i-) = ∏_i(1 — Pr(t | B_ij - )) 로 계산됩니다.

가장 가까운 이웃 또는 커널 회귀와 같은 감독 학습 알고리즘은 인스턴스 밀도를 계산하여 각 백의 기여도를 평균화합니다. 이 알고리즘은 각 백의 기여도의 곱을 계산하므로 이름이 Diverse Density입니다. n개의 백이 교차하는 지점의 다양성 밀도(Diverse Density)는 n — 1개의 백이 교차하는 지점보다 기하급수적으로 높지만, 다양성을 낮추기 위해 잘 배치된 하나의 음수 인스턴스만 있으면 됩니다.

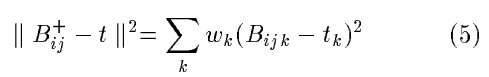

초기 특징 공간(feature space)은 아마도 이미지 간의 공통점을 찾는 데 가장 적합한 공간이 아닐 것입니다. 일부 feature는 관련이 없거나 중복될 수 있지만 다른 feature의 작은 차이는 긍정적인 예와 부정적인 예를 구별하는 데 중요할 수 있습니다. Diverse Density 프레임워크를 사용하면 feature 공간에서 적절한 위치를 찾을 수 있는 것과 동일한 방식으로 초기 feature 집합에서 최상의 가중치를 찾을 수 있습니다. feature가 관련이 없는 경우 이를 제거하면 긍정적인 인스턴스가 더 가까워지기 때문에 DD만 증가할 수 있습니다. 반면에 관련 feature가 제거되면 부정적인 인스턴스가 최상의 DD 위치에 더 가까워지고 낮아집니다. 따라서 DD를 높이려면 feature의 가중치를 변경해야 합니다. 형식적으로 feature space의 두 점(B_ij 및 t) 사이의 거리는 다음과 같습니다.

여기서 B_ijk는 i번째 백의 j번째 포인트에 있는 k번째 feature의 값이고 w_k는 음수가 아닌 배율 인수입니다. w_k가 0이면 k번째 feature는 관련이 없습니다. w_k가 크면 k번째 feature가 매우 중요합니다. Diverse Density가 최대가 되도록 t와 w를 모두 찾고자 합니다. Search 공간의 차원 수를 두 배로 늘렸지만 이제 작업을 수용하기 위해 표현(representation)을 변경할 수 있는 강력한 방법이 있습니다.

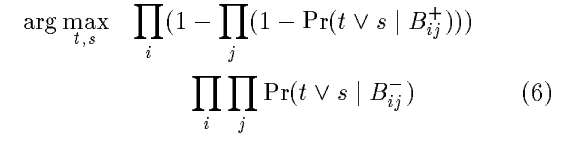

이 기술을 사용하여 단일 지점보다 더 복잡한 개념을 배울 수도 있습니다. 2-disjunct 개념 t V s를 학습하기 위해 다음과 같이 다양한 밀도를 최대화합니다.

여기서 Pr(t V s | B_ij+)는 max{Pr(t | B_ij+), Pr(s | B_ij+)}로 추정됩니다. 다른 근사치(예: noise-or)도 가능합니다.

고차원 공간에서 최대의 Diverse Density를 찾는 것은 어려운 문제입니다. 일반적으로 우리는 임의의 풍경을 검색하고 있으며 로컬 최대값의 수와 검색 공간의 크기는 효율적인 탐색을 금지할 수 있습니다. 이 논문에서는 여러 시작점과 함께 경사 오름차순(DD는 미분 가능 함수이므로)을 사용합니다. 이것은 우리가 사용할 시작점을 알고 있기 때문에 성공적으로 작동했습니다. 최대 DD 포인트는 positive 포인트 집합의 기여로 구성됩니다. 모든 positive 지점에서 상승을 시작하면 그 중 하나가 최대값에 가장 가깝고 가장 많이 기여하며 직접 상승할 가능성이 있습니다. 따라서 모든 긍정적 인스턴스에서 상승을 시작하면 최대 DD 지점을 찾을 가능성이 매우 높습니다. concept의 위치와 스케일링을 모두 찾아야 하는 경우 두 매개변수 세트에 대해 동시에 경사 상승을 수행합니다(모든 스케일 가중치는 1에서 시작). 그러나 검색 공간의 차원 수는 두 배가 되었습니다. 2-disjunct 개념을 찾아야 할 때 다시 한 번에 모든 매개변수에 대해 그래디언트 오름차순을 수행할 수 있습니다. 이것은 차원의 수가 두 배가 되었기 때문에 높은 계산 부담을 수반하며 긍정적인 인스턴스의 모든 쌍에서 시작하는 경사 상승을 수행합니다.

다음 섹션에서 우리의 목표는 (1) diverse density를 최대화하여 다중 인스턴스 학습이 자연스러운 장면 분류 영역에서 사용될 수 있고, (2) 저해상도 이미지의 간단한 개념으로 이러한 개념 중 일부를 학습하기에 충분하다는 것을 보여주는 것입니다. (3) 여러 반복(사용자 상호 작용)에 대해 위양성 및 위음성을 추가하여 분류기 성능을 개선할 수 있습니다.

4. EXPERIMENTS

이 섹션에서는 시스템 실행의 네 가지 유형의 결과를 보여줍니다. 하나는 다중 인스턴스 학습이 이 도메인에 적용된다는 것입니다. 두 번째 결과는 자연 이미지 도메인에서 개념을 배우기 위해 매우 복잡한 가설 클래스가 필요하지 않다는 것입니다. 또한 전역 히스토그램 방법을 포함하여 다양한 가설의 성능을 비교합니다. 마지막으로 분류기를 개선하기 위해 사용자 상호 작용이 어떻게 작동하는지 보여줍니다.

4.1 EXPERIMENTAL SETUP

우리는 폭포, 산, 들판의 세 가지 개념을 배우려고 노력했습니다. 교육 및 테스트를 위해 COREL 라이브러리의 자연 이미지와 COREL에서 제공한 레이블을 사용했습니다. 여기에는 폭포, Helds, 산, 일몰 및 호수와 같은 각 클래스의 100개 이미지가 포함되었습니다. 또한 다양한 클래스의 2600개 자연 이미지로 구성된 더 큰 테스트 세트를 사용했습니다.

위에서 언급한 5개의 클래스 각각에서 무작위로 선택된 20개의 이미지로 구성된 잠재적인 훈련 세트를 만들었습니다. 이로 인해 5개 클래스 각각의 나머지 80개 이미지로 구성된 작은 테스트 세트가 남았습니다. 우리는 잠재적인 훈련 세트를 테스트 세트에서 분리하여 다양한 훈련 체계와 가설 클래스를 사용한 결과를 공정하게 비교할 수 있도록 했습니다. 마지막으로 대규모 테스트 세트에는 다양한 클래스의 2600개의 자연 이미지가 포함되어 있습니다.

주어진 개념에 대해 잠재적 훈련 세트에서 개념의 5개의 긍정적인 예와 5개의 부정적인 예를 선택하여 초기 훈련 세트를 만듭니다. 이러한 예에서 개념을 학습한 후(최대 DD를 사용하여 기능 공간의 지점 및 스케일링을 찾아) 잠재적인 훈련 세트에서 사용되지 않은 90개의 이미지는 학습된 개념에서 거리를 기준으로 정렬됩니다. 이 정렬된 목록은 사용자가 추가 정제 예제로 선택하는 것을 시뮬레이션하는 데 사용할 수 있습니다. 특히, 가장 지독한 긍정 오류(정렬된 목록의 시작 부분에 있는 개념이 아닌 이미지)와 가장 지독한 거짓 부정(정렬된 목록의 끝에 있는 개념 이미지)은 사용자가 추가 부정 및 긍정 예로 선택할 가능성이 높습니다.

우리는 4가지 다른 훈련 체계를 시도했습니다. 초기는 단순히 초기 5개의 긍정적인 예와 5개의 부정적인 예를 사용하는 것입니다. +5fp는 가장 심각한 오탐지 5개를 추가합니다. +10fp는 +5fp 체계를 두 번 반복합니다. +3fp+2fn은 3개의 위양성과 2개의 위음성을 추가합니다.

모든 이미지는 가우시안 필터를 사용하여 평활화되었고 8 x 8로 서브샘플링되었습니다. 이 실험에서는 RGB 색 공간을 사용했습니다. 모든 클래스와 모든 훈련 계획에 대해 7개의 가설 클래스 중 하나를 사용하여 개념을 학습하려고 했습니다(그림 1은 몇 가지 예를 보여줍니다).

1. 행: 인스턴스는 행의 평균 색상과 위와 아래 행의 색상 차이입니다.

2. 이웃이 있는 단일 블롭: 인스턴스는 2 x 2 블롭의 평균 색상과 4개의 이웃 블롭과의 색상 차이입니다.

3. 이웃이 없는 단일 얼룩: 인스턴스는 2 x 2 얼룩의 각 픽셀 색상입니다.

4. 이웃이 있는 분리 블롭: 인스턴스는 이웃이 있는 단일 블롭과 동일하지만 학습된 개념은 두 개의 단일 블롭 개념의 분리입니다.

5. 이웃이 없는 이접 blob: 인스턴스는 이웃이 없는 단일 blob과 동일하지만 학습된 개념은 두 개의 단일 blob 개념의 분리입니다.

6. 이웃이 있는 두 개의 블롭: 인스턴스는 이웃이 있는 두 개의 단일 블롭과 이들의 상대적인 공간 관계에 대한 두 가지 설명의 평균 색상입니다.(두 번째 얼룩이 위인지 아래인지, 첫 번째 얼룩의 왼쪽인지 오른쪽인지).

7. 이웃이 없는 두 개의 블롭: 인스턴스는 이웃이 없는 두 개의 단일 블롭에 대한 두 설명의 평균 색상과 상대적인 공간 관계입니다.

개념을 학습하는 데는 간단한 가설의 경우 몇 초에서 2-blob 및 이접 가설의 경우 며칠이 걸렸습니다. 더 복잡한 가설은 더 많은 기능과 백당 인스턴스 수가 많기 때문에 학습하는 데 더 오래 걸립니다(그리고 최대 DD 포인트를 찾기 위해 모든 양성 인스턴스에서 경사 상승을 수행합니다). 이것은 프로토타입이기 때문에 실행 시간을 최적화하려고 시도하지 않았습니다. 그러나 인스턴스를 생성하는 보다 지능적인 방법(예: 연결된 구성 요소를 사용한 대략적인 분할)은 인스턴스 수와 실행 시간을 몇 배로 줄입니다.

4.2 RESULTS

이 섹션에서는 작은 테스트 세트와 큰 테스트 세트에 대해 다양한 가설 클래스, 훈련 체계 및 개념 클래스를 테스트한 결과를 보여줍니다. 작은 테스트 세트는 잠재적 훈련 세트와 교차하지 않으므로 학습된 개념의 일반화를 더 정확하게 나타냅니다. 대규모 테스트 세트는 시스템이 더 큰 이미지 데이터베이스로 확장되는 방법을 보여주기 위한 것입니다.

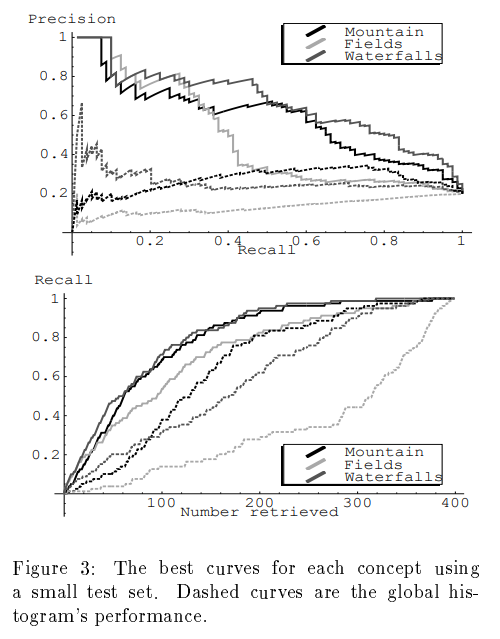

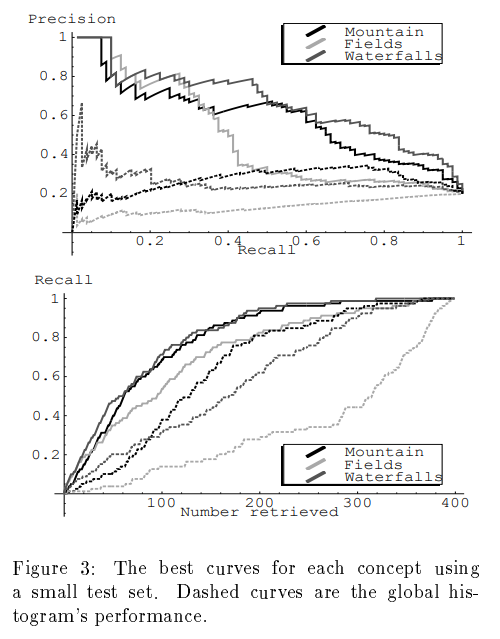

표시된 그래프는 정밀도 리콜 및 리콜 곡선입니다. 정밀도는 지금까지 본 이미지 수에 대한 올바른 이미지 수의 비율입니다. 재현율은 테스트 세트의 총 올바른 이미지 수에 대한 올바른 이미지 수의 비율입니다. 예를 들어, 그림 3에서 워터폴 정밀도-리콜 곡선은 약 0.7의 정밀도로 리콜 0.5를 갖습니다. 즉, 80개의 워터폴 중 40개를 검색하기 위해 검색된 이미지의 30%는 워터폴이 아닙니다. 왜냐하면 (1) Precision Recall의 시작은 상위 몇 개체만 중요한 응용 프로그램에 관심이 있고 (2) 리콜 곡선의 중간은 데이터베이스의 많은 비율에 대한 정확한 분류가 중요한 응용 프로그램에 관심이 있습니다.

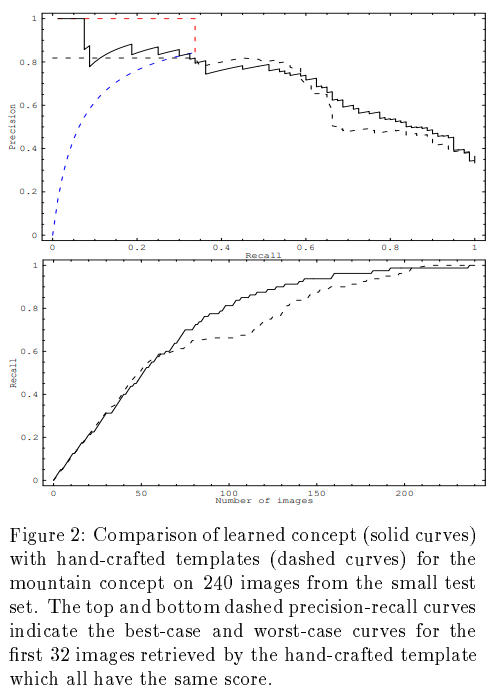

그림 2는 학습된 산 개념의 성능이 손으로 만든 산 템플릿([Lipson et al., 1997]에서)과 경쟁적임을 보여줍니다. 테스트 세트는 산 80개, 들판 80개, 폭포 80개로 구성되어 있습니다. 훈련 세트와 분리되어 있습니다. 처음 32개의 이미지가 모두 같은 점수를 받고 그 중 27개가 산이기 때문에 손으로 만든 모델의 정밀도 재현 곡선은 84%로 평평합니다. 또한 27개의 산을 먼저 검색하는 경우(최상의 경우) 또는 처음 5개의 오탐지 후(최악의 경우) 곡선을 표시합니다.

그림 3에서는 각 개념 클래스에 대한 최상의 가설과 학습 방법의 성능을 보여줍니다. 파선은 글로벌 히스토그램 방법의 성능 저하를 보여줍니다. Precision-Recall 그래프의 실선은 워터폴의 경우 +10fp인 이웃이 있는 단일 블롭, 필드의 경우 +10fp인 행, 산의 경우 +10fp인 이웃이 없는 이접 블롭의 성능을 보여줍니다. 리콜 곡선의 실선은 폭포에 대해 +10fp의 이웃이 있는 단일 Blob, 필드에 대해 +3fp+2fn이 있는 이웃이 있는 단일 Blob, 산에 대해 +3fp+2fn이 있는 행의 성능을 보여줍니다. 이 동작은 더 큰 테스트 세트에 대해 계속됩니다.

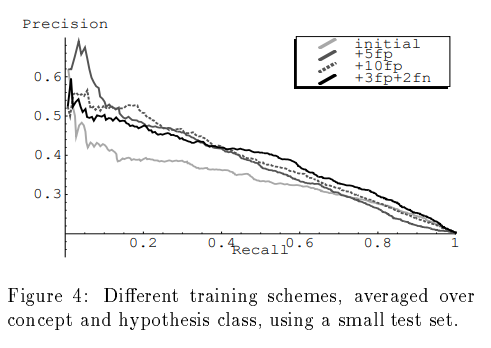

그림 4에서는 네 가지 훈련 방식 각각에 대한 정밀도-재현율 곡선을 보여줍니다. 우리는 모든 개념과 모든 가설 클래스에 대해 평균을 냅니다. 사용자 상호 작용으로 성능이 향상되는 것을 볼 수 있습니다. 이 동작은 더 큰 테스트 세트에서도 계속됩니다.

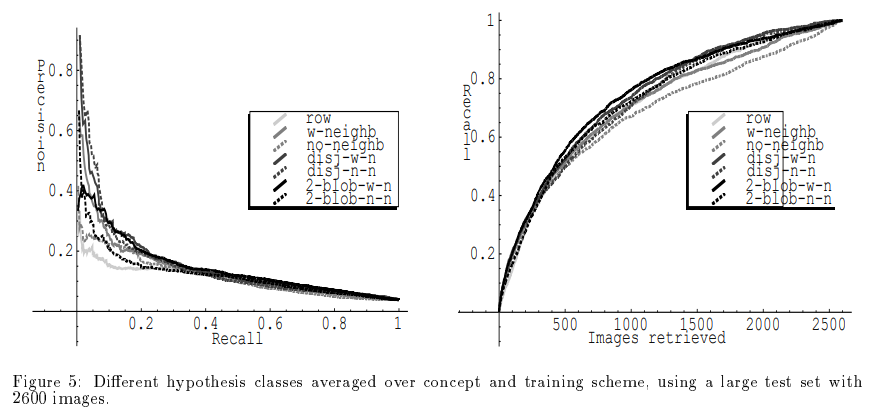

그림 5에서 우리는 모든 개념과 모든 훈련 체계에 대해 평균을 낸 7개의 가설 각각에 대한 정밀도-재현율 및 재현율 곡선을 보여줍니다. 이 곡선은 더 큰 2600 이미지 데이터베이스용입니다. 우리는 이웃 가설이 있는 단일 블롭이 좋은 정밀도를 가지고 있음을 봅니다. 우리는 또한 더 복잡한 가설 클래스(즉, 이접 개념 및 두 블롭 개념)가 더 나은 재현 곡선을 갖는 경향이 있음을 확인합니다.

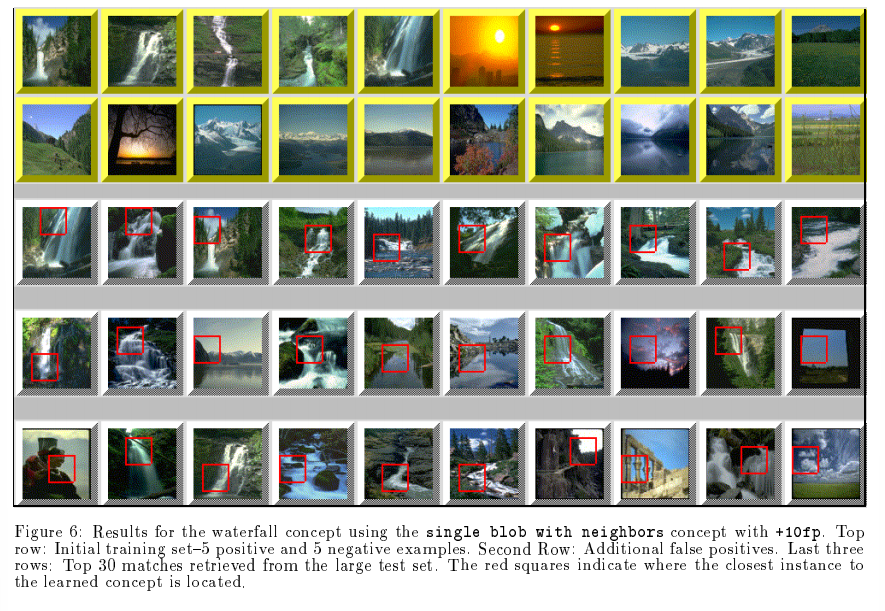

그림 6에서는 작동 중인 시스템의 스냅샷을 보여줍니다. 이 시스템은 폭포수 개념에 대해 훈련 체계 +10fp를 사용하여 훈련됩니다. 이웃 가설이 있는 단일 블롭을 사용하여 폭포수 개념을 학습했습니다. 학습된 폭포수 개념은 이미지 어딘가에 왼쪽 이웃이 파란색 값이 적고 자신의 파란색 값이 0.5(여기서 RGB 값은 [0, 1] 큐브에 있음)인 얼룩이 있고 아래 이웃의 파란색 값이 같다는 것입니다. 위의 이웃은 동일한 빨간색 값을 가지며 녹색 값은 0.55이고 위의 이웃은 동일한 파란색 값을 가지며 빨간색 값은 0.47입니다. 이러한 속성은 주어진 순서대로 가중치가 부여되며 다른 기능은 관련이 없는 것으로 확인되었습니다. 새 이미지에는 학습된 개념에 대한 인스턴스 중 하나의 최소 거리 등급이 있으며, 여기서 거리 메트릭은 관련 기능의 중요성을 설명하기 위해 학습된 배율을 사용합니다. 그림에서 볼 수 있듯이 이 간단한 학습 개념은 다양한 폭포 장면을 검색할 수 있습니다.

그림의 상위 20개 이미지는 훈련 세트입니다. 처음 10개의 이미지는 학습에 사용되는 초기 긍정 및 부정 예제입니다. 다음 10개의 이미지는 추가된 오탐지입니다. 마지막 30개 이미지는 대규모 데이터 세트에서 반환된 상위 30개 이미지입니다.

5 CONCLUSIONS

본 논문에서는 다양한 밀도를 최대화하여 다중 인스턴스 학습을 통해 자연경관 이미지를 분류할 수 있음을 보였다. 우리의 결과는 손으로 만든 모델과 비교했을 때 경쟁력이 있으며 글로벌 히스토그램 접근 방식보다 훨씬 뛰어납니다. 우리는 또한 저해상도 이미지에서 색상 관계를 캡처하는 간단한 학습 개념을 자연 장면 분류 영역에서 효과적으로 사용할 수 있음을 입증했습니다. 우리의 실험은 복잡한 개념(예: 이접 개념)이 더 나은 재현 곡선을 갖는 경향이 있으며 여러 반복에 대한 사용자 상호 작용(가양성 및 거짓 음성 추가)이 분류기의 성능을 향상시킬 수 있음을 나타냅니다. 백 생성기를 학습 메커니즘에서 분리함으로써 우리의 아키텍처는 컴퓨터 비전의 진행이 기계 학습의 유지에 도움이 되도록 하고 그 반대의 경우도 가능합니다.