Regularization

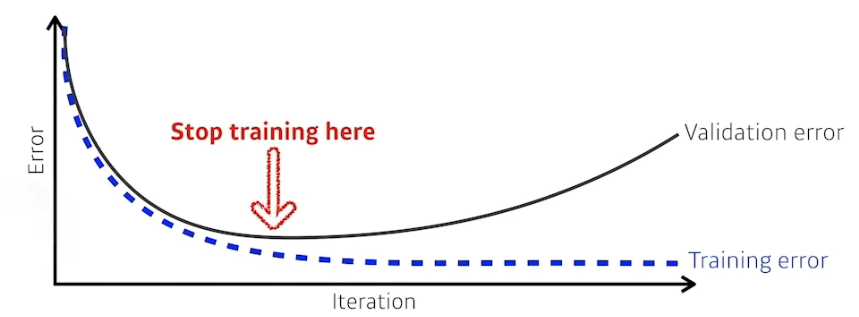

1. Early stopping

미리 학습을 멈춰서 어느 정도의 모델 신뢰도를 확보하는 방법입니다.

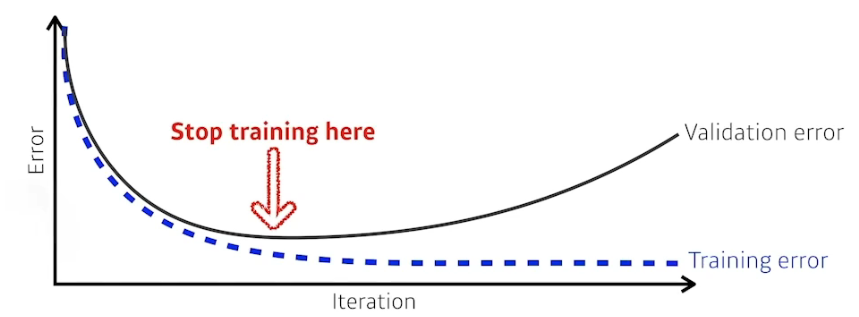

2. Parameter norm penalty

Parameter의 값이 너무 커지지 않도록 규제하는 것입니다. 모든 parameters를 제곱하여 더한 값이 일정 값 이상으로 넘어가지 않도록 합니다.

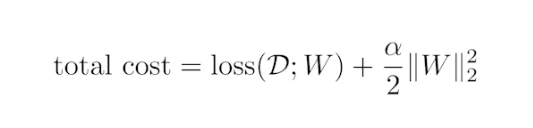

3. Data augmentation

보통의 경우에, Data가 적으면 전통적인 ML의 성능이 훨씬 더 높은 경우가 많습니다. 하지만 데이터의 크기가 어느 정도 커지게 되면, DL이 ML의 성능을 앞지르게 됩니다. 근데 이 데이터의 개수가 항상 무한히 많지 않기 때문에 DL의 성능이 잘 나오도록 이 데이터를 불리는 것이 Data Augmentation 입니다.

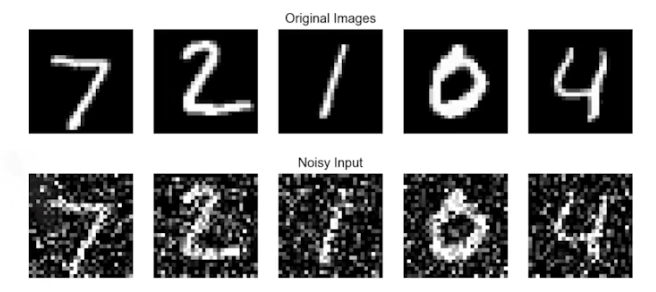

4. Noise robustness

입력 데이터나 weight에 노이즈를 넣으면 그 network가 그렇지 않은 network에 비해 성능이 높을 가능성이 높게 나옵니다. 이유는 아직 명확하게 밝혀지지는 않았고 실험적으로 밝혀진 연구 결과입니다.

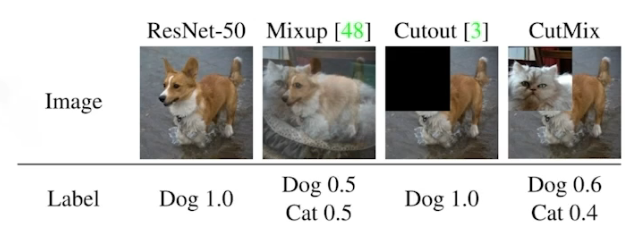

5. Label smoothing

이미지를 섞음과 동시에 label도 섞어버리는 규제 방법입니다.

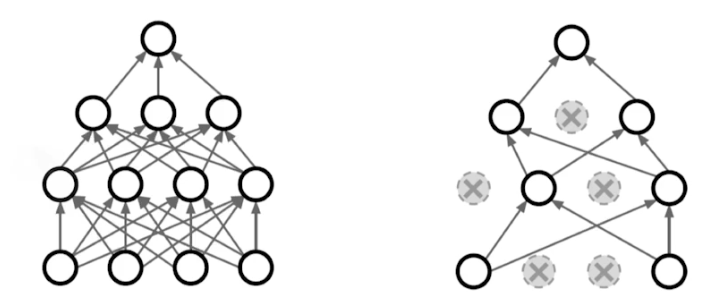

6. Dropout

7. Batch normalization

Batch Normalization compute the empirical mean and variance independently for each dimension (layers) and normalize.