Important Concepts in Optimization

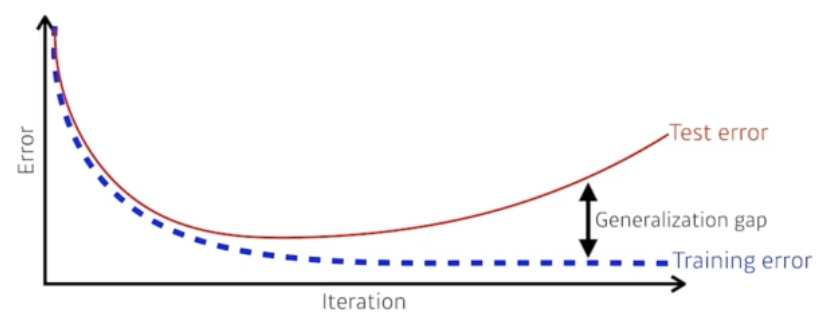

Generalization

How well the learned model will behave on unseen data.

Training error가 낮다고 해서 최적의 모델 성능을 가지게 되었다고 말할 수 없습니다. 좋은 Generalization을 가지고 있다 (generalization performance 가 좋다) = Test error 와 training error 사이의 차이가 적다고 할 수 있습니다.

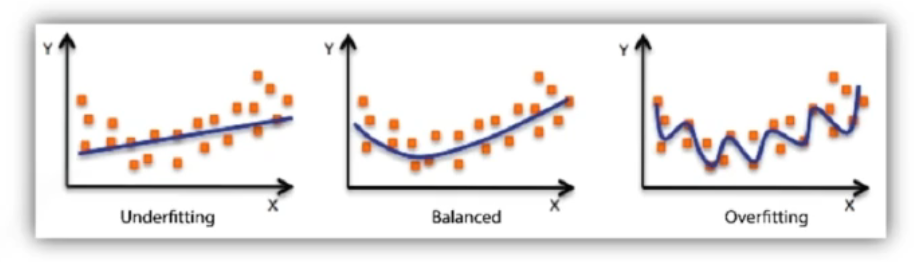

Under-fitting & Over-fitting

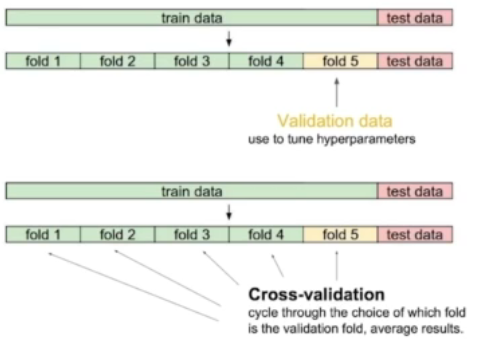

Cross Validation

Cross-validation is a model validation technique for assessing how the model will generalize to an independent (test) data set.

Train data 와 validation data를 나누어서 검증을 수행합니다. Cross validation, K-fold validation 을 통해 데이터가 적어서 적절한 학습이 어려울 때 모든 데이터를 학습하는 방향으로 검증하게 됩니다.

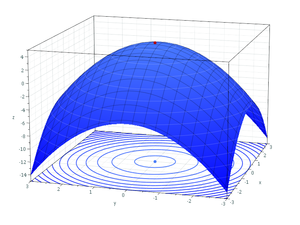

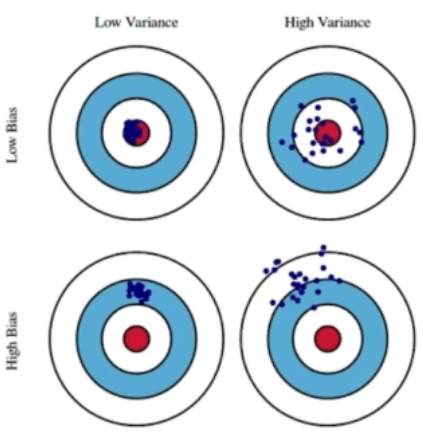

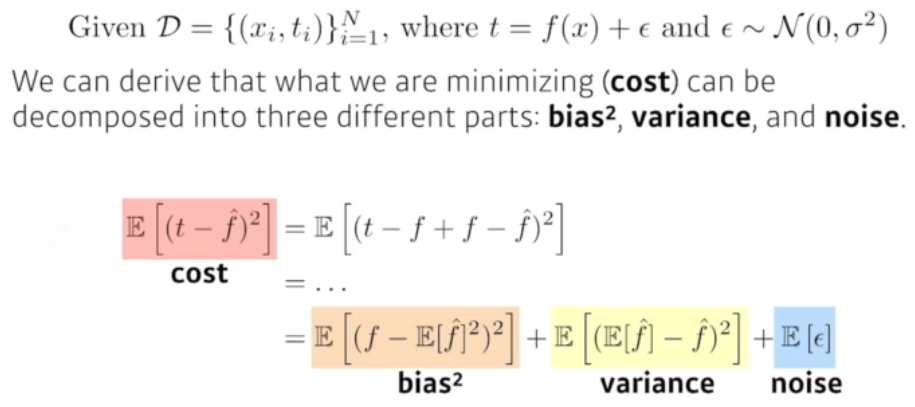

Bias-variance tradeoff

Low Variance 가 적중률이 좋기 때문에 지향해야하는 결과입니다.

Bias-variance tradeoff: 낮은 bias와 낮은 variance를 동시에 달성하기는 사실 상 힘들다는 이론입니다. 일종의 limitation이라고 할 수 있습니다.

Bootstrapping

Bootstrapping is any test or metricthat uses random sampling with replacement.

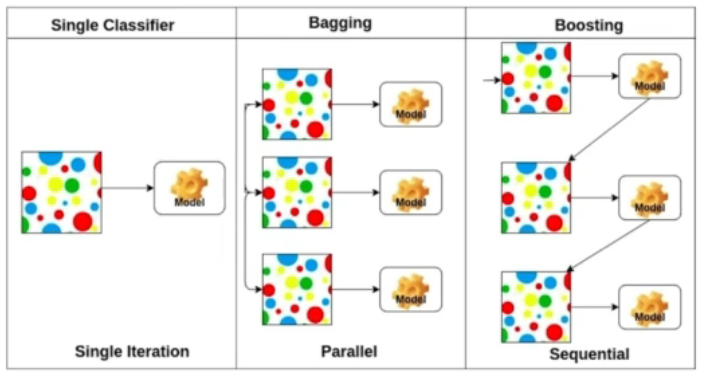

Bagging and boosting

- Bagging(Bootstrapping aggregating)

- Multiple models are being trained with bootstrapping.

- ex) Base classifiers are fitted on random subset where individual predictions are aggregated (voting or averaging).

- Boosting

- It focuses on those specific training samples that are hard to classify.

- A strong model is built by combining weak learners in sequence where each learner learns from the mistakes of the previous weak learner.