Abstract

다양한 downstream 테스크들에서 모델의 스케일을 키웠을 때 성능과 데이터 효율성이 좋아진다는 것을 예측할 것 있다고 알려져 있다.

반면, 본 논문에서는 LLM 모델의 Emergent Abilities라고 하는 예측 불가능한 현상에 대해서 다루고자 한다.

어떤 ability가 작은 모델에서는 나타나지 않지만 큰 모델에서 나타났을 때 우리는 이 ability가 emergent하다고 한다.

그래서 작은 모델에서 나온 성능을 바탕으로 emergent ability가 있는 큰 모델의 성능을 추론할 수 없다.

이런 emergence의 존재로 추가적인 스케일링이 언어 모델의 능력 범위를 더욱 확장시킬 수 있는지에 대한 의문을 제기했다.

1. Introduction

Language Model은 NLP 테스크의 발전에 큰 혁명을 일으켰다. Language Model의 scale을 키우면 NLP downstream task의 성능과 데이터 효율성이 좋아진다는 것은 잘 알려져 있다.

NLP 모델 이외의 경우에 scale이 성능에 미치는 영향은 scaling law에 의해 방법론적으로 예측할 수 있었다.

반면! 특정 downstream task의 성능은 우리의 직관과는 다르게 scale 함수를 따라서 증가하지 않기 때문에 이런 task들에서는 성능이 어떻게 증가할지 사전에 예측할 수 없다.

본 논문에서는 이런 예측 불가능한 현상을 LLM의 emergent abilities라고 하는 것을 다룬다.

Emergence라는 개념 자체는 오래 전부터 다양한 도메인(물리, 생물학, 컴퓨터공학)에서 논의되어 왔다. 그래서 우리도 Emergence의 보편적인 정의를 따를 것이다.

Emergence is when quantitativ changes in a system result in qualitative changes in behavior.

Emergence란 시스템의 양적 변화가 질적인 행동 변화를 일으키는 현상을 말한다.

본 논문에서 emergence를 모델 스케일과 연관지어 살펴볼 것인데, 여기서의 모델 스케일은 훈련 연산량과 모델의 파라미터 수에 의해 측정된다.

더 구체적으로, 저자들은 emergent abilities of LLM을 작은 스케일 모델에는 존재하지 않지만 큰 스케일 모델에는 존재하는 abilities로 정의했다.

저자들은 넓은 범위의 선행 연구에서 emergent abilities를 관찰된 것을 조사했고, 이를 few-shot prompting이나 augmented prompting strategies와 같은 setting으로 분류했다.

이런 emergence는 왜 이런 ability를 가질 수 있었는지와 스케일을 더 키웠을 때 emergent abilities가 더 좋아질 것인지에 대한 후속 연구에 대한 동기를 주었다.

2. Emergent Abilities Definition

Emergent Abilities

An ability is emergent if it is not present in smaller models but is present in larger models

작은 모델에는 존재하지 않지만 큰 모델에는 존재할 때 ability가 emergent하다고 한다.

그렇기 때문에, emergent ability는 작은 스케일 모델의 scaling law로부터 직접적으로 추론해낼 수 없다. 작은 모델의 scaling 곡선을 시각화할 때, emergency ability는 뚜렷한 패턴을 보여주는데, 성능이 랜덤하게 나오다가 어떤 기준을 기점으로 랜덤한 성능들보다 훨씬 뛰어난 성능들을 나오기 시작한다.

이런 질적인 변화를 Phase Transition이라고도 하는데 이런 드라마틱한 변화는 작은 스케일 시스템을 들여다본다고 해서 알 수 있는 것이 아니다.

오늘날의 LM은 3가지 요소로 스케일될 수 있다:

- 학습 연산량

- 모델 파라미터 수

- 훈련 데이터셋 크기

본 논문에서는, 각 모델의 학습 연산량을 x축에 FLOPs로 표시하여 서로 다른 모델들의 성능을 그래프에 표시해 스케일링 곡선을 분석한다.

(*LM의 학습 연산량이 많으면 대체로 파라미터 수도 많으므로 각 모델의 파라미터 수를 x축에 표시한 그래프도 그렸다)

두 그래프는 비슷한 모양을 가지는데 그 이유가 대부분의 dense Transformer LM 계열은 학습 연산량이 모델의 파라미터 수에 비례하기 때문이다.

훈련 데이터셋 크기도 또 하나의 중요한 요소지만, 많은 LM 계열이 모든 모델 크기에 대해 고정된 수의 학습 예시를 사용하기 때문에 이 요소를 기준으로 ability를 그래프에 표시하지 않는다.

여기서는 학습 연산량과 모델의 크기에 집중하지만, 스케일의 모든 측면을 충분히 포착할 수 있는 단일 대리 지표는 없다. 예를 들어, Chinchilla의 파라미터 수는 Gopher의 1/4배만큼 있지만 학습 연산량은 비슷하다. 또, sparce mixture-of-expert 모델은 (파라미터 수)/(훈련&추론 연산량)이 dense 모델보다 많다. 그래서 emergence를 많은 상관성이 있는 변수로 구성된 함수로 보는게 좋다.

알아둬야 할 점은 ability가 가장 처음 발견되는 지점은 여러 요인에 의한 것이고 ability의 불변의 속성이 아니다.

예를 들어, 학습 연산량 또는 파라미터 수는 적어도 데이터의 퀄리티가 높으면 emergence는 발생할 수 있다. 반대로, emergent abilities는 데이터 양의 제한이 없고 데이터 품질이 충분하며, 모델의 파라미터 수가 충분한지와 같은 다른 요인들에도 강하게 의존한다. (즉, 그렇지만 emergence가 나타나려면 데이터 양·품질·모델 크기 같은 기본 조건도 중요하다.)

오늘날의 LM은 아직 최적으로 훈련되지 않았을 것이며 시간이 지나면서 어떻게 하면 가장 최적의 모델을 훈련할 수 있을지에 대한 이해가 진화할 것이다.

본 논문의 목표는 emergent abilities가 나타나기 위해 요구되는 구체적인 스케일에 대한 주장이나 특징화가 아니라, 선행 연구들의 emergent behavior 예시들을 다루는 것이다.

3. Few-shot Prompted Tasks

본 논문에서는 GPT-3로 인해 유명해진 prompting에서의 emergent abilities를 다루고자 한다.

Prompting: 사전 학습된 LM에 테스크와 관련된 어떤 프롬프트가 주어졌을 때 이와 관련된 답변을 추가적인 훈련이나 파라미터 업데이트 없이 해낼 수 있게 한다.

Few-shot prompting (Brown et al. (2020)): 모델이 추론 단계에서 처음 보는 문제를 풀 수 있도록 해당 문제와 관련된 몇 개의 예시 질문-답 셋을 모델의 인풋으로 주는 방식이다.

어떤 테스크를 few-shot prompting을 할 때도 마찬가지로 ability가 emergent하다는 것은 모델의 스케일이 일정한 기준보다 작을 때 성능이 랜덤하게 나오다가, 이 기준보다 커졌을 때 성능이 월등히 증가하는 것을 말한다.

5개의 LM 계열의 8가지 문제들에 대해 emergent ability를 알아보고자 한다.

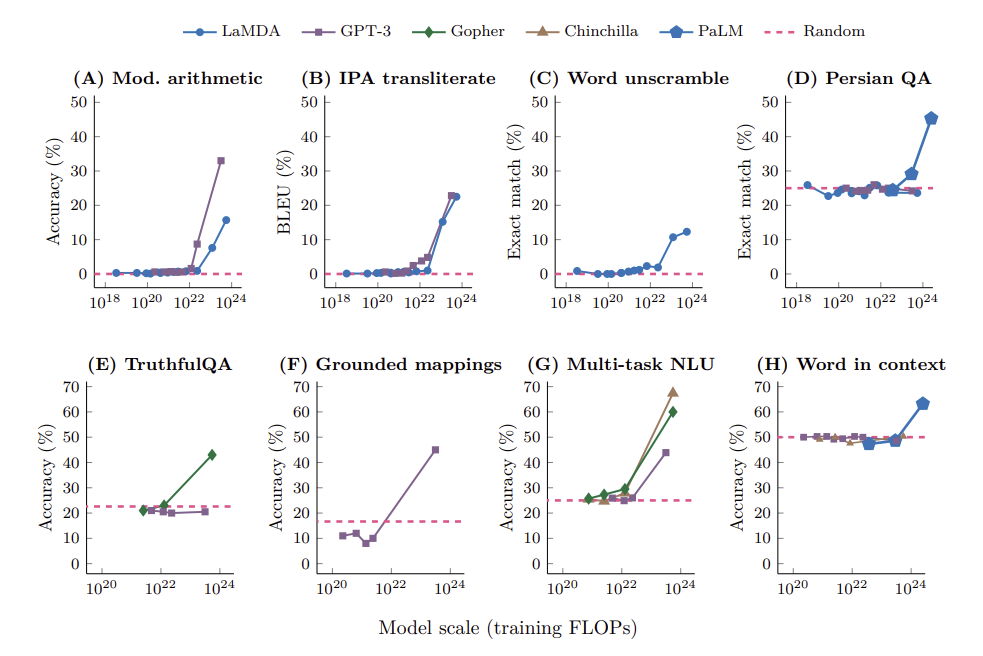

BIG-Bench (Figure 2A-D)

BIG-Bench: 언어 모델 평가를 위한 200개가 넘는 벤치마크로 구성된 크라우드소싱 기반 모음집 (크라우드소싱이란 불특정 다수(crowd)에게 작업·아이디어·데이터 수집 등을 요청해, 그들이 제공한 기여를 활용하는 방식)

Figure 2A

수식 연산 밴치마크, 3자리수 덧셈/뺄셈, 2자리수 곱셈

GPT-3 - 훈련 FLOPs, 13B 파라미터일 때 성능 폭발적 증가

LaMDA - 훈련 FLOPs, 68B 파라미터일 때 성능 폭발적 증가

(2B, 2C, 2D에 정리된 다른 테스크에 대해서도 2A와 비슷한 모델 스케일에서 emergent ability 발생)

Figure 2B: 국제 음성 기호(IPA)로부터 음차(표기)하는 것

Figure 2C: 뒤섞인 철자를 원래 단어로 되돌리는 것

Figure 2D: 페르시아어 질의응답

TruthfulQA (Figure 2E)

TruthfulQA benchmark: 질문에 진실되게(사실에 기반해) 답하는 능력을 측정한다

Figure 2E: TruthfulQA benchmark에 few-shot prompt한 성능을 측정한 그래프

GPT-3: 아무리 모델의 사이즈를 키워도 랜덤 성능 이상의 성능은 나오지 않는다

Gopher: 훈련 FLOPs, 280B 파라미터까지 키워야 성능이 향상된다

Grounded conceptual mappings (Figure 2F)

Task of conceptual mapping: 텍스트로 표현된 격자형 세계 안에서 방위와 같은 개념적 domain을 학습해 매핑해야 한다.

Figure 2F: Grounded mapping task의 성능을 측정한 그래프

GPT-3: 약 훈련 FLOPs일 때 성능 점프

Multi-task language understanding (Figure 2G)

MMLU benchmark (Massive Multi-task Language Understanding): 수학, 역사, 법 다양한 범위의 토픽을 포함한 57개 테스트들을 합쳐놓은 것

Figure 2G:

GPT-3, Gopher, Chinchilla: 대략 3-5 훈련 FLOPs 이상일 때 성능 점프

이 결과는 놀라운데 그 이유는 다양한 토픽을 다루는 knowledge-based 질의응답 테스크에서는 모델이 위의 스케일보다는 커야한다는 기준을 제공할 수 있기 때문이다. (물론 dense LM에서는 외부 메모리의 추가나 제거는 없어야함)

Word in Context (Figure 2H)

WiC (Word in Context) benchmark: 의미 이해 능력을 평가

Figure 2H:

GPT-3, Chinchilla: 모델의 스케일을 약 훈련 FLOPs까지 키워도 one-shot 학습에서 무작위 예측 수준을 넘는 성능을 달성하지 못했다.

(해당 모델들에서는 스케일만 키운다고 WiC를 해결하지 못할 수도 있다는 것을 시사함)

PaLM: 훈련 FLOPs, 540B 파라미터일 때 성능 점프

(위의 두 모델보다는 스케일이 훨씬 크다)

4. Augmented Prompting Strategies

LLM에서 현재 가장 많이 쓰이고 있는 방식이 few-shot prompting이긴 하지만, 최근에 다른 여러 방식의 prompting과 fine-tuning으로 LM의 ability를 증대하려는 시도가 소개되었다.

어떤 테크닉이 작은 모델에 적용했을 때 baseline보다 성능이 그대로거나 오히려 떨어졌다가 큰 모델에 적용했을 때 성능이 올라갔다면 이 테크닉 또한 emergent ability라고 간주한다.

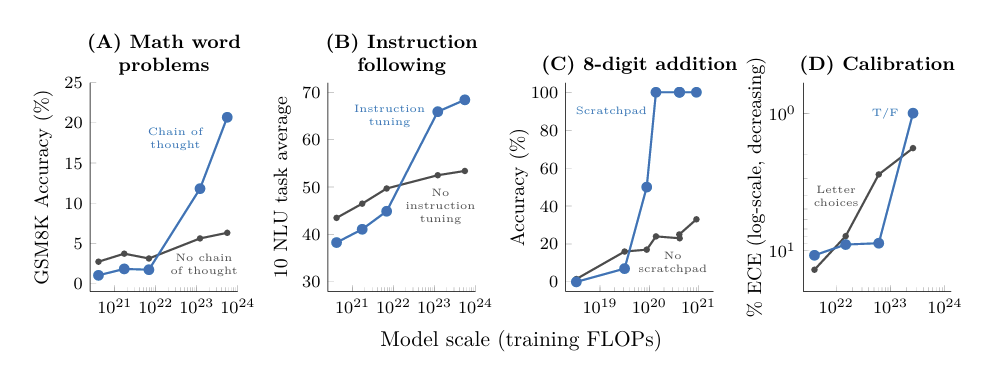

Multi-step reasoning

Chain-of-Thought prompting 방식으로 multi-step reasoning 문제를 해결할 수 있는데, 이는 모델이 최종 결과를 도출하기 전, 중간 단계들의 결과 또한 도출해낼 수 있도록 하는 방식이다.

Figure 3A: CoT로 수식 문제 해결하기 (benchmark: GSM8K)

LaMDA: 훈련 FLOPs, 100B 파라미터일 때 CoT prompting을 했을 때 CoT가 없는 스탠다드 prompting의 성능을 뛰어넘음

(few-shot prompting에 최종 결과 뒤에 이에 대해 설명하는 prompting을 추가하는 방식에 대해서도 CoT와 비슷한 성능 향상을 확인할 수 있다.)

Instruction following

LM이 새로운 task를 잘 수행할 수 있도록 하는 또다른 prompting 방식은 바로 새로운 task에 대한 instruction을 프롬프트로 주는 것이다. (few-shot exemplars 없이!)

여러 task의 mixture를 insturction 프롬프트로 fine-tuning시키면 LM은 처음 보는 task에서도 instruction에 쓰인대로 작동할 수 있다.

Figure 3B: (benchmark: GSM8K)

LaMDA: 모델의 스케일이 훈련 FLOPs, 8B 파라미터보다 작거나 같으면 Intrustion follwing을 안썼을 때보다 오히려 성능이 낮다. 훈련 FLOPs, 100B 파라미터일보다 크다면 성능이 더 좋아진다.

(Sanh et al. (2022): 이후 연구에서 insturction follow를 encoder-decoder T5 model에 finetuning하면 스케일이 더 작아도 성능 향상이 있다고 한다.)

Program execution

여러 단계의 연산을 해야하는 task (큰 수 덧셈, 프로그램 실행처럼 중간 메모리 상태가 중요한 문제) Nye et al. (2021) 연구에 따르면 LM을 중간 단계의 아웃풋도(일명 "Scratchpad") 예측하게 한다면 multi-step computations을 실행할 수 있다고 한다.

Scratchpad 방식과 chain-of-thought (CoT) 방식은 둘 다 중간 추론 과정을 LM 출력에 포함시킨다는 점에서 비슷하지만, 목적과 포맷이 조금 다르다.

Scratchpad: 중간 결과를 기계적으로 추적하는 방식

예시:

Input: 456 + 789

Step 1: carry = 1, sum = 5

Step 2: carry = 1, sum = 4

Step 3: carry = 1, sum = 2

Output: 1245CoT: 사람처럼 자연어로 추론 과정을 LM이 기술하게 하여, 논리적·수학적 문제 해결 성능을 향상 (비정형 자연어)

Figure 3C: 8 digit addition with scratchpad

LaMDA: 훈련 FLOPs, 40M 파라미터 이상의 스케일이면 성능이 잘나온다.

Model calibration

Calibration: 모델이 출력한 확률(신뢰도)이 실제 정답 확률과 얼마나 잘 일치하는지를 나타내는 지표, 언어 모델 배포 단계에서 중요하게 사용되는 지표 중 하나

Kadavath et al. (2022)에 따르면 두 가지 방법으로 모델의 calibration을 측정할 수 있다.

1. True/False technique

- 모델이 낸 예측값이 정답과 일치할 확률 "P(True)" 측정하는 방법

- 실제로 맞으면 1, 틀리면 0을 기록 → 여러 개를 모아서 신뢰도와 정답률 비교(ECE 계산 등)

2. 전통적인 calibration technique

- 모델이 정답 후보에 할당한 확률과 그 외 오답 후보들에 할당한 확률을 비교하는 방법

- 단순히 “맞았냐/틀렸냐”가 아니라, 정답이 다른 후보보다 얼마나 더 높은 확률을 받았는지, 전체 분포가 얼마나 잘 보정(calibrated)돼 있는지를 평가

Figure 3D: True/False technique 사용

LaMDA: 훈련 FLOPs, 52B 파라미터 이상의 모델 스케일에서만 성능 향상

5. Discussion

지금까지의 내용을 정리하자면 언어 모델의 스케일이 충분히 커진다면 모델의 성능이 갑자기 증가하는 것을 관찰할 수 있었다. 대규모 모델에서만 나타나는 ‘emergent ability’ 때문에, 작은 모델의 성능 향상 곡선을 단순히 연장해 큰 모델의 성능을 예측할 수 없다.

또한, emergent few-shot prompted task도 예측할 수 없는데, 왜냐하면 LM 사전 학습 당시 해당 task에 대한 명시적인 학습이 없고 사전학습 LM이 수행할 수 있는 few-shot prompted task의 범위를 알 수 없기 때문이다. 따라서 현재 최대 규모의 LLM으로도 해결하지 못한 과제를, 모델 규모 확대로 해결할 가능성이 있다.

더 나아가, scale의 ability로 예상치 못하게 새로운 기술을 가능하게 할 수 있다는 것은 이론적이지만 않다. Figure 2H가 그 예이다. 이 전에는 GPT-3의 스케일을 아무리 크게 해도 random-one-shot prompting 성능보다 잘 나오지 않았다. 이와 관련해서 Brown et al. (2020)은 GPT-3의 모델 구조나 autoregressive modeling objective가 아마도 원인일 것이라고 하면서 bidirectional 구조로 충분한 사이즈의 모델을 학습시키면 해결할 수 있다고 했다. 그런데 최근 연구에 따르면 decoder only LM의 스케일만 키워도 랜덤 성능보다 좋아진다고 발견했다. Figure 2H에 나와있듯이 PaLM (Chowdhery et al.(2022))의 스케일을 훈련 FLOPs, 62B 파라미터에서 훈련 FLOPs, 540B 파라미터까지만 키워도 성능이 드라마틱하게 향상이 되므로 Brown et al.이 제안한 엄청난 모델 구조 변형은 하지 않아도 된다.

5.1 Potential explanation of emergence

emergent ability가 나타나는 여러 예시들이 있지만 왜 emergent ability가 발생하는지에 대한 설명은 아직 부족하다.

특정 task에 대해서는, 모델이 특정 스케일을 기준으로 그것보다 크면 emergent ability가 발생하는지 직관적으로 알 수 있기도 하다.

1. multi-step reasoning은 l번의 sequential 연산이 필요하므로 모델의 깊이가 적어도 O(l)은 돼야 함.

2. 더 많은 파라미터와 더 많은 학습은 깊은 지식을 요구하는 task에 도움이 됨

예시: closed book question-answering task에서 모델이 충분한 파라미터를 있다면 압축된 지식을 충분히 학습할 수 있어 좋은 성능을 낼 수 있다.

대안 평가 지표로 cross entropy loss를 사용했고 이는 사전 학습에서도 사용하고 6

또한, emergent ability를 측정할 때 어떤 평가 지표를 사용했는지도 중요하다.

예를 들어, 긴 시퀀스를 맞추는 task에서 평가 지표로 ‘정확한 문자열 일치(exact string match)’를 사용하면, 작은 성능 향상이 계속 쌓여서 어느 순간 전체 문자열이 맞게 되었을 때, 그 순간 갑자기 성능이 뛰어오른 것처럼 보여서 emergent ability처럼 착각할 수 있다.

비슷한 문제가 multi-step 수학 추론 문제에서도 발생한다. 만약 중간 단계의 정확도는 고려하지 않고 최종 정답이 맞을 경우에만 정확도가 올라간다고 하면 문제가 된다. 왜냐하면 최종 정답에 대한 정확도는 중간 단계의 정확도에서 발생하는 emergent ability를 설명할 수 없어 이 평가 지표는 불완전하다. (중간 단계가 있어서 이런 emergent ability가 나타난거야 라는 주장이 있을 수도. 그러나 여러 단계의 추론 과정이 없는 classification task에서도 emergent ability를 관찰할 수 있기 때문에 말이 안됨.)

개의 Big-Bench task에서도 사용했다.

(Big-Bench (2022)의 셋업과 동일하게 실험을 구성했고 6개의 task도 마찬가지다)

Cross entropy를 사용하면 다른 평가지표 downstream metrics(exact match, BLEU, accuracy 등)를 사용했을 때와 다르게 작은 모델에서도 성능 향상이 된다고 나타난다. 이는 target sequence의 log-likelihood 발전이 downstream metrics로 인해 가려질 수 있다는 것을 나타낸다. 하지만 이러한 분석은 왜 downstream metrics에서 emergent가 발생하는지 설명하지 못하고 어느 정도 스케일에서 emergence가 발생하는지 예측하는데 도움이 안된다. 그러므로 어떤 스케일이 emergent abilities를 발생시키는지에 대한 더 많은 연구가 필요하다.

정리

Downstream metrics:

- emergence 아닌데 emergence처럼 보이게 할 수도 있고

- 실제 성능 향상을 가릴 수도 있음

Cross-entropy:

- 가려진 향상을 잡아낼 수 있음

- 그러나 emergence 현상의 원인이나 스케일 예측 능력은 없음

5.2 Beyond scaling

현재 특정 스케일에서 emergent ability가 관찰되고 있지만 이 ability가 나중에는 더 작은 스케일에서 발생할 수 있다. 즉, 스케일이 emergent ability를 발생시키는 유일한 원인이 아니라는 뜻이다. LLM 학습에 대한 연구가 진행되면, 모델의 새로운 구조, 더 높은 퀄리티의 데이터, 또는 훈련 단계의 발전으로 특정 abilities가 작은 스케일의 모델에서도 발견될 수 있다.

예를 들어, 14개의 BIG-Bench tasks에서 LaMDA는 137B 파라미터와 GPT-3는 175B 파라미터 스케일 모델에서는 랜덤 성능을 보이지만, PaLM은 62B 파라미터 스케일 모델에서 랜덤 성능을 뛰어넘는 성능을 보여, 스케일은 제일 작지만 emergent ability가 나타난 것을 확인할 수 있다. PaLM 62B와 이전 모델들 간의 모든 차이를 하나씩 제거해 가며 비교하는 실증 연구는 없지만(계산 비용이 너무 크기 때문), PaLM의 더 나은 성능에 대한 잠재적인 이유로는 높은 퀄리티의 학습 데이터(예: LaMDA보다 더 다국어 및 코드 데이터가 많음)와 구조적 차이 등이 있을 수 있다. Emergent ability를 발생시킬 수 있는 또다른 가능한 요인은 바로 사전 학습 objective이다. Tay et al.(2022c)에서 계산 효율적인 mixture-of-denoisers 목적 함수(Tay et al., 2022a)를 사용한 pre-training 학습 단계가 여러 BIG-Bench 과제에서 emergent 성능을 가능하게 했다는 것이 보여졌다.

더 나아가 ability가 발견이 되면 후속 연구를 통해 ability가 더 작은 스케일 모델에서 발생하도록 할 수 있다. Task를 설명하는 자연어 instruction을 따를 수 있도록 언어 모델을 만들려는 초기 단계의 방향성을 생각해보면 초기의 instruction-based fintuning은 68B 파라미터 또는 스케일이 더 큰 decoder only model에서만 성능이 좋았다. 하지만 이후 Sanh et al. (2022)의 연구에 따르면 encoder-decoder 구조로 11B 파라미터 스케일을 사용하면 앞의 모델들보다 더 좋은 성능을 낼 수 있다고 밝혀냈다. 또 다른 예로, Ouyang et al.(2022)는 InstructGPT 모델을 위해 finetuning과 인간 피드백을 활용한 강화 학습 접근법을 제안했으며, 이를 통해 1.3B 파라미터 모델이 다양한 사용 사례에 대한 인간 평가자 평가에서 훨씬 더 큰 모델들을 능가할 수 있게 했다.

또한, 일반적인 few-shot prompting의 abilities를 발전시키기 위한 연구들이 있었다. 언어 모델링 목적이 왜 특정 downstream 동작을 촉진하는지에 대한 이론적,해석 가능성 연구(Wei et al., 2021a; Saunshi et al., 2021)는, 단순히 규모를 확장하는 것 이상의 방식으로 emergence를 가능하게 하는 방법에 대한 시사점을 줄 수 있다. 예를 들어, 사전 학습 데이터의 특정한 feature이 emergent few-shot prompting과 연관이 되어 있다는 것이 밝혀졌고 작은 스케일의 모델에서도 가능하게 할 수 있다. 또한 few-shot learning은 특정 시나리오에서 특정 모델 구조를 요구할 수 있다. 계산언어학 연구에서는, 모델 파라미터 수와 학습 FLOPs를 고정한 상태에서 학습 데이터의 임계 빈도(threshold frequency)가 새로운 구문 규칙 학습(emergent syntactic rule-learning)을 활성화할 수 있음을 추가로 보여주었다(Wei et al., 2021b).

또한, 이러한 현상은 심리언어학 문헌에서 보고된 것과 유사한 놀라운 ‘아하(aha)’ 순간을 보이기도 한다는 것이 밝혀졌다. 언어 모델을 계속 학습함에 따라, emergent 능력의 규모 임계값(scale threshold)을 낮추는 것은 이러한 능력에 대한 연구를 더 폭넓게 커뮤니티가 활용할 수 있도록 하는 데 있어 점점 더 중요해질 것이다.

직관적으로 모델의 스케일만 키우는 것은 한계가 있다.

예를 들어,

1. 하드웨어적인 제한으로 스케일링에 bottle-neck이 발생할 수 있고, 이 지점에서 어떤 abilities는 나타나지 않을 수 있다.

2. 어떤 abilities는 한 번도 나타나지 않을 수 있다.

- 예를 들어, 훈련 데이터셋을 매우 크게 해도 그 데이터셋의 분포와 테스크가 전혀 관계가 없으면 높은 성능을 달성하지 못한다.

3. 어떤 ability가 나타나도 이 이상 증가하지 않고 그대로 유지될 수 있다. 즉, 스케일을 키워 우리가 원하는 특정 성능까지 도달할 수 있다는 것을 보장하지 못한다.

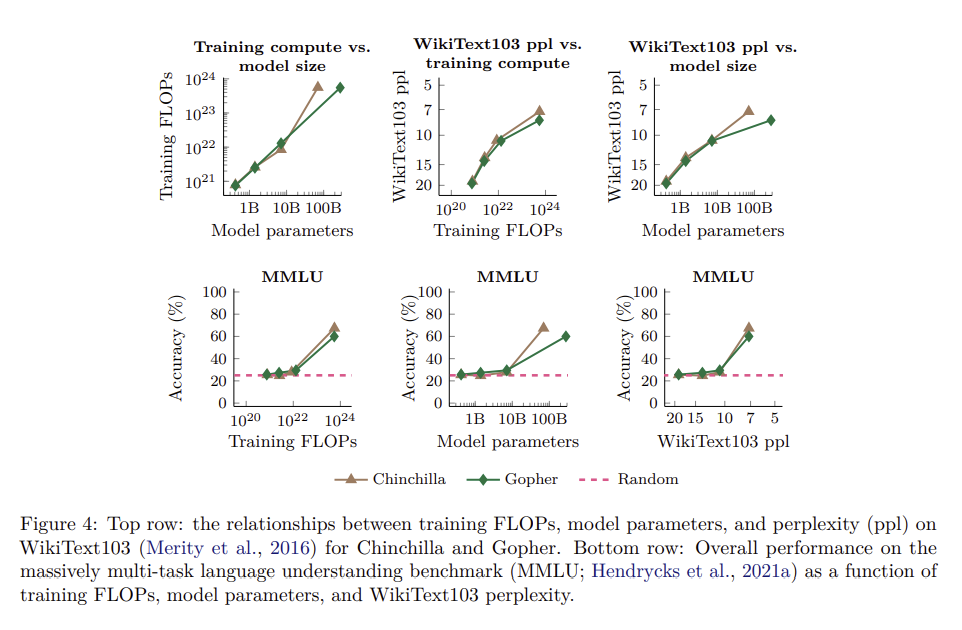

5.3 Another view of emergence

지금까지 LM의 downstream metrics 성능과 스케일이 매우 관련이 깊다는 것을 설명했는데, emergent abilities를 발생시키는데 스케일만 필요한 것은 아니다. 예를 들어, task별 emergent ability는 WikiText103과 같은 일반 텍스트 코퍼스에서의 언어 모델 퍼플렉서티(perplexity)의 함수로 분석할 수 있다.

위의 실험은,

x축: 언어 모델에 대한 WikiText103의 perplexity

y축: MMLU benchmark의 성능

이를 훈련 FLOPs와 모델의 파라미터를 x축으로 두었을 때의 그래프와 비교했다.

WikiText103 perplexity와 훈련 FlOPs가 매우 관련이 깊기 때문에 두 그래프가 비슷하게 그려진다. 그러나, 기본형(dense) 트랜스포머 모델을 넘어서는 새로운 기법들이 개발됨에 따라, WikiText103 퍼플렉서티와 규모(scale) 간의 이러한 상관관계는 앞으로는 유지되지 않을 수 있다. 예를 들어, 검색 보강(retrieval-augmented) 모델은 더 적은 학습 연산량과 더 적은 모델 파라미터로도 WikiText103에서 강력한 퍼플렉서티를 보일 수 있다. 또한, 학습 데이터 구성의 차이와 같은 요인들 때문에, WikiText103 퍼플렉서티를 사용해 모델 계열 간 성능을 비교하는 것은 복잡할 수 있다는 점에 유의해야 한다.

전반적으로, emergent 능력은 아마도 서로 상관된 여러 변수의 함수로 보는 것이 적절할 것이다.

5.4 Emergent Risks

Few-shot prompting에서 emergent ability가 발생하는 것과 비슷하게 (사전학습 때 명시적으로 포함시키지 않아도) risks도 발생할 수 있다.

예를 들어 LLM의 사회적 risks인 truthfulness, bias, 그리고 toxicity가 많이 연구되고 있다. 이런 risks들은 위의 정의대로 "emergent"하다고 할 수 있는지가 중요하고, 어떤 시타리오에서는 실제로 모델의 스케일에 따라 증가하기도 한다. 언어 모델의 스케일을 키우면 emergent abilities를 발생시킬 수 있지만, 꼭 emergent하게 발생하지 않더라고 스케일이 커지면 risks도 증가할 수 있다는 것을 유념해야한다.

모델의 스케일과 몇몇 social risks의 관계성

Gender bias

모델의 스케일이 커지면 "nurse"나 "electrician" 등의 직업에서 나타나는 gender biase가 완화된다.

하지만, BBQ bias benchmark에서 발견된 BIG-Bench에서는 문맥이 모호할 때 모델의 스케일이 커지면 bias가 발생할 수 있다고 한다.

Toxicity

LLM의 스케일이 커지면 RealToxicityPromopts dataset으로부터 더 많은 toxic한 결과가 도출될 수 있다고 한다.

이는 모델에 "helpful, harmless, and honest"와 같은 프로프트를 주어 해결할 수 있다고 밝혀졌다.

Overfitting

모델의 스케일이 커지면 모델이 훈련 데이터를 더 잘 기억할 가능성이 있다.

이는 deduplication methods로 모델이 데이터를 덜 기억하도록 하면서 동시에 성능을 높일 수 있다고 한다.

Falsehoods

GPT-3의 스케일이 커지면 모델은 인간이 하는 거짓말을 더 잘 흉내낼 수 있다고 알려져있다. 그러나 후속 연구를 통해 다중선택 버전의 gopher의 스케일을 280B 파라미터 이상으로 올리면 성능향상이 있다고 밝혀졌다.

더 나아가, emergent risks는 미래의 언어 모델이나 현재 언어 모델에서 아직 등장하지 않은 현상을 포함하기도 한다. 예를 들어, backdoor vulnerabilities, inadvertent deception, 아님 harmful content synthesis 등이 있다. 데이터 필터링, 예측(forecasting), 거버넌스(governance), 그리고 유해한 행동을 자동으로 탐지하는 방법을 포함한 접근법들이, emergent 위험을 발견하고 완화하기 위해 제안되어 왔다.

5.5 Sociological changes

지금까지 다룬 emergent ability는 모델의 behavior에 관련된 것이고 이는 NLP에서의 emergence 중 하나일 뿐이다. 이와 또다른 타입의 질적 변화는 사회적 변화인데, 모델의 스케일이 커지면 LLM을 바라보는 사회의 시선과 사용에 대한 인식이 달라진다. 예를 들어, 이전의 NLP는 task specific model이였다면 최근에는 모델 스케일이 커지고 모델의 발전하면서 하나의 모델이 다양한 task를 할 수 있는 general purpose 목적으로 사용되고 있다.

아론 general purpose 모델의 emergent한 사회적 변화에 대한 한가지 예시로 scaling으로 인해 few shot prompting한 general purpose 모델이 특정 task를 finetune한 모델보다 성능이 좋아졌다는 것이 있다.

예를 들어, GPT-3 175B 모델은 TriviaQA와 PiQA question-answering 밴치마크에서 새로운 SOTA 성능을 달성햇다. 또한, PaLM 540B도 세 가지 수식 추론 밴치마크에서 새로운 SOTA 성능을 달성했고, 멀티모달 Flamingo 80B으로도 5가지 visual question answering 밴치마크에서 새로운 SOTA 성능을 달성했다.

위의 모든 케이스들은 전례없이 큰 스케일의 모델을 few-shot prompting 시켰을 때 달성한 SOTA 성능이다. 이 abilities는 꼭 emergent할 필요 없고 smooth, predictable 스케일 곡선을 가져도 된다. 하지만 NLP 커뮤니티에서 general-purpose 모델을 향한 사회적인 전환은 emergent 해야만 한다.

general-purpose 모델이 몇 개의 예시만으로 처음 보는 task도 수행할 수 있도록 하는 능력은 언어 모델이 NLP 외의 다른 분야에도 많은 새로운 적용을 할 수 있게 한다. 예를 들어, 언어 모델 + prompting 기법은

1. 자연어를 기계가 이해할 수 있는 action으로 번역

2. 유저들과 상호작용

3. LLM이 실제 세계에 배포

되고 있다.

5.6 Directions for future works

-

Further model scaling

당연히 모델의 scale이 더 커지면 모델의 능력치도 올라가겠지만 연산량이 증가하고 하드웨어가 더 필요하다는 점에서 모델의 성능을 높이기 위한 다른 방안이 필요하다. -

Imporved model aritectures and training

모델의 구조를 발전시키거나 훈련 단계를 발전시키면 모델의 퀄리티가 올라가면서 연산량을 높이지 않고도 emergent ability를 낼 수 있다.

모델의 구조

1. sparse misture-of-expert architecture

2. more localized learning strategies than backpropagation through all weights in a neural network

3. augmenting models with external memory -

Data scaling

모델을 많은 데이터로 오래 학습시키면 당연히 성능도 더 올라간다. 그러므로 큰 데이터셋을 수집하는 것도 중요하다. -

Better techniques for and understaning of prompting

1. calibrating ouptut probabilities

2. using a noisy channel

3. augmenting few-shot exemplars with intermediate steps

또한, 어떤 prompting 방식이 더 효과적인지에 대한 연구로 작은 스케일의 모델에서도 emergent ability가 발생하도록 하는 인사이트를 줄 수 있다. -

Frontier tasks

아직도 많은 task들이 랜덤 성능 이상의 성능을 내지 못하고 있다. (특히, abstract reasoning을 포함한 task들)

후속 연구로 왜 아직 emergent abilities가 나타나지 못했는지와 어떻게 하면 나타나게 할 수 있는지를 연구해볼 수 있다. 또한, multilingual emergence로 model의 스케일과 training data가 emergence의 발생에 주요 요인이 된다. 더 나아가 여러 modality를 포함한 prompting에 관해서도 연구해 볼 수 있다.

Understanding emergence

후속 연구로 왜 그리고 어떻게 LLM에 emergence ability가 나타나는지가 남아있다. 본 논문에서는 BIG-Bench에 cross-entropy loss를 적용한 스케일링, generative tasks에 여러 metrics 적용, 어떤 task들에서 emergence가 발생했는지에 대해 연구했지만 아직 정확한 이유와 어떻게 발생하는지는 더 연구가 필요하다.

최종적으로, emergnece를 이해하는 것은 매우 중요한데 왜냐하면 이를 통해 우리가 미래의 모델이 어떤 능력을 가지고 있는지 예측할 수 있고, 어떻게 하면 언어 모델을 더 잘 훈련시킬 수 있는지에 대한 인사이트를 얻을 수 있기 때문이다.