T5

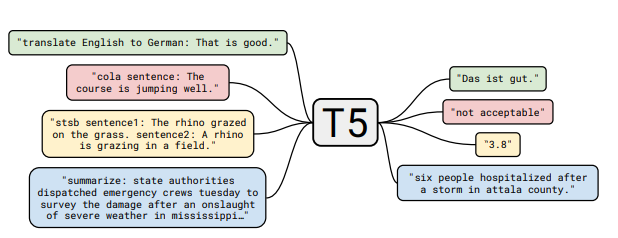

T5의 풀네임은 Text-to-Text Transfer Transformer로 T가 5개 들어가서 T5라고 한다.

구글에서 2019년 출시한 모델로 Text to Text 모델이다.

이름에서 알 수 있듯이, Encoder-Decoder 구조이다.

1. Introduction

모든 NLP작업을 text-to-text 형식으로 통합하여 처리하는 프레임 워크이다. 이때, 다양한 작업들을 수행 가능한데 번역, 요약, 분류, 질문 생성등의 작업이 포함된다.

다양한 작업이 가능하지만 각각의 작업에서 SOTA급의성능을 보인다.

해당 모델을 개발할때 C4라는 데이터셋을 구축하여 사용하였다. C4데이터셋은 아래에서 자세히 다루겠다.

2. Setup

2.1 Model

Transformer기반으로 인코더-디코더 구조로 설계되어있다.

GPT나 BERT처럼 Encoder, Decoder을 따로 사용하는 것이아니라 Encoder-Decoder구조를 그대로 가져와서 사용한다.

Transformer 모델인만큼 Seolf-Attention, Position Embedding, Residual Connection등의 요소를 사용한다.

다만, 변경점이 몇가지 존재하는데

Layer Normalization에서 bias를 제거하고 recaling만 수행- 위치 임베딩시

Absolute positional embedding->Relative positional embedding사용 - 레이어 전체에서 `position embedding parameter sharing

Denoising Corrupted Span사용

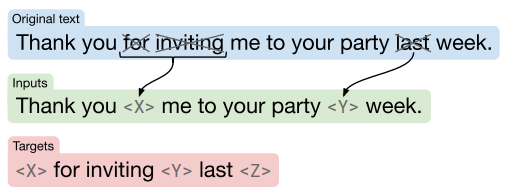

Denoising Corrupted Span

SpanBERT에서 사용된 MASK기법을 사용한다.

기존에는 노큰 하나를 [MASK]로 교체하였는데, Denoising Corrupted Span에서는 Span을 [MASK]로 교체한다.

요약하자면, T5모델은 기존의 트랜스포머 모델과 유사하지만, 레이어 정규화에서 Bias를 제거하고 상대적 위치 임베딩을 사용한다는 차이점이 있다.

2.2 The Colossal Clean Crawled Corpus (C4)

T5의 사전학습시에 사용된 데이터셋으로 Common Crawl을 클리닝 과정거친 데이터셋이다.

- 마침표, 느낌표, 물음표, 끝 따옴표로 끝나는 줄만 가져옴

- 문장 5개 미만은 제거, 3 단어 이상으로 이루어진 줄만 가져옴

- 비속어 담은 페이지는 제거

- JavaScript 단어 들어간 줄은 제거

- lorem ipsum (무의미한 문장) 있는 페이지 제거

- 중괄호 { 나타나는 페이지 제거

- 중복 문장 제거 위해서 3번이상 나오면 하나 빼고 다 제거

위와같은 클리닝 규칙들을 통해 9TB의 TextData가 800GB로 줄어들었다.

2.3 Downstream Tasks

위에서 언급했듯이,

T5모델은 Text-to-Text 형태의 다양한 작업을 수행하는 프레임 워크이다.

본문에서 언급한 작업은 다음과 같다.

- MAchine Translation

- QA

- Summarization

- Text Classification

2.4 Input and Output Format

Multi-Task Learning은 여러 작업에대해 한번에 학습하는 방식이다.

본문에서는 이방식을 위해 여러 학습과정을 실험해본 결과,

Pre-train + Fine-tuning 방식이 가장 성능이 좋다고 판단했다.

3. Experiments

최적의 T5모델을 만들기 위해 진행한 여러가지 실험과정들을 말한다.

3.1 Baseline

3.2 Architectures

- Encoder - Decoder 의 성능이 가장 우수

- 파라미터 공유: 모델크기를 줄이면서 성능 저하 최소화 요소

3.7 Putting It All Together

여러가지 요소들(크기, 학습 데이터, 학습 방식)들을 조합하여 최적의 성능을 보이는 조합을 찾는 과정을 말한다.

- Denoising Corrupted Span

- Longer pre-training

- Larger model (11B parameters) : 일반적으로 크기가 클수록 언어모델의 성능은 향상됨

- Multi-task pre-training + fine-tuning

- Beam Search: 텍스트 생성 알고리즘, 다양한 경로를 동시에 탐색하여 최적의 출력 시퀀스 출력

4.Reflection

본 연구에서 달성하지못한 연구 과제들은 다음과 같다.

1. 작은 크기로 좋은 성능 낼 수 있는 모델 개발

2. 효율적인 사전학습 방식을 통해 일반적 지식 학습

3. 각 작업별 유사성을 체계화 하여 지도학습 설계

게시물 잘 읽었어요~ 소통해요^^