0. 3줄 핵심 요약

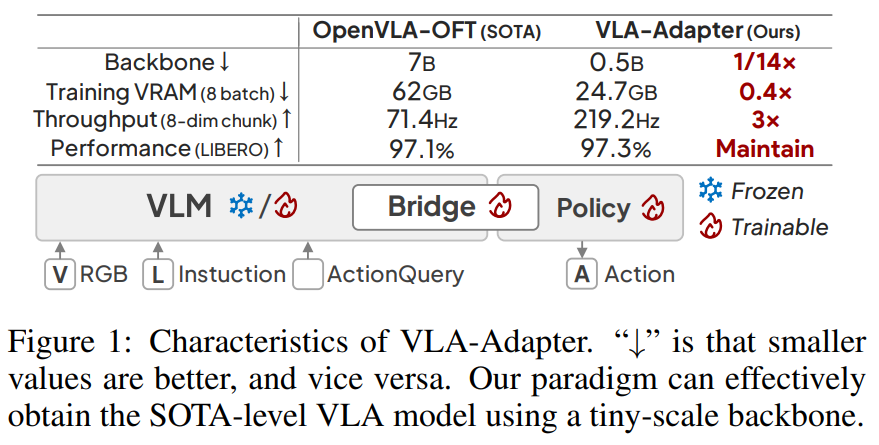

- 본 논문은 대규모 시각-언어 모델(VLM)과 막대한 사전 학습에 의존하는 기존 VLA(Vision-Language-Action) 모델의 한계를 극복하기 위해, 0.5B 수준의 극도로 작은 백본만으로 시각-언어 공간을 행동 공간으로 효과적으로 연결하는 'VLA-Adapter' 패러다임을 제안합니다.

- 기술적으로는 VLM의 각 레이어에서 추출된 원본 잠재 표현(Raw feature)과 행동 질의(ActionQuery)를 브릿지 어텐션(Bridge Attention) 모듈을 통해 정책 신경망에 최적의 비율로 동적 주입하는 메커니즘을 핵심으로 합니다.

- 로봇 데이터 사전 학습 없이도 단일 소비자용 GPU에서 8시간 만에 훈련이 가능하며, 압도적인 추론 속도(219.2Hz)와 함께 LIBERO 및 CALVIN 등의 벤치마크에서 SOTA 수준의 성공률을 달성하여 VLA 배포의 진입 장벽을 혁신적으로 낮추었습니다.

1. 배경 및 문제 정의

거대 다중 모달 언어 모델(MLLM)의 비약적인 발전과 함께, 자연어 명령을 기반으로 로봇의 시각적 인지와 물리적 행동을 단일 시스템으로 통합하려는 VLA(Vision-Language-Action) 프레임워크 연구가 활발히 진행되고 있습니다. OpenVLA, , GR00T 등 기존의 대표적 방법론들은 모델에 작업 적응력을 부여하기 위해 Open X-Embodiment와 같은 방대한 로봇 데이터셋을 활용해 대규모 VLM을 직접 사전 학습(Pre-training)하는 접근을 택했습니다.

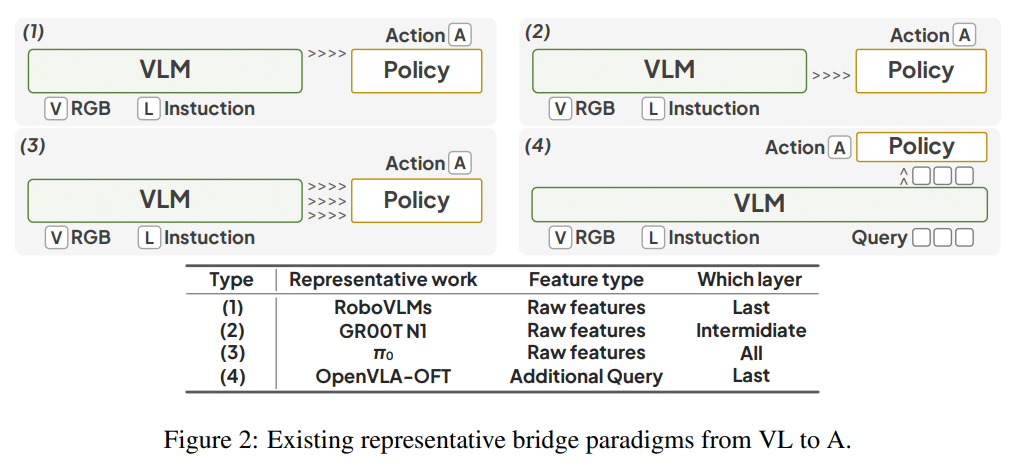

그러나 이러한 전통적 스케일링 방식은 뚜렷한 한계를 드러냅니다. 첫째, 막대한 학습 비용과 GPU 메모리(VRAM)를 요구하며 미세 조정(Fine-tuning) 속도가 매우 느립니다. 둘째, 추론 지연(Latency)이 길어 실시간 고주파 제어가 필수적인 로보틱스 환경에 바로 적용하기 어렵습니다. 셋째, 모델 구조적 측면에서 '시각-언어(VL) 공간의 표상을 어떻게 해야 행동(A) 공간으로 손실 없이 효과적으로 넘겨줄 수 있는가'에 대한 체계적인 분석 메커니즘이 부족했습니다. 본 논문은 이러한 한계에 주목하여, 단순히 파라미터 크기를 키우는 대신 "시각과 언어에서 추출된 어떤 정보(조건)가 행동 생성에 가장 필수적인가?"라는 근본적 질문을 던지고, 이를 최적으로 매핑하는 경량화 구조인 VLA-Adapter를 제안하여 문제를 해결하고자 합니다.

2. 제안 방법 (Method)

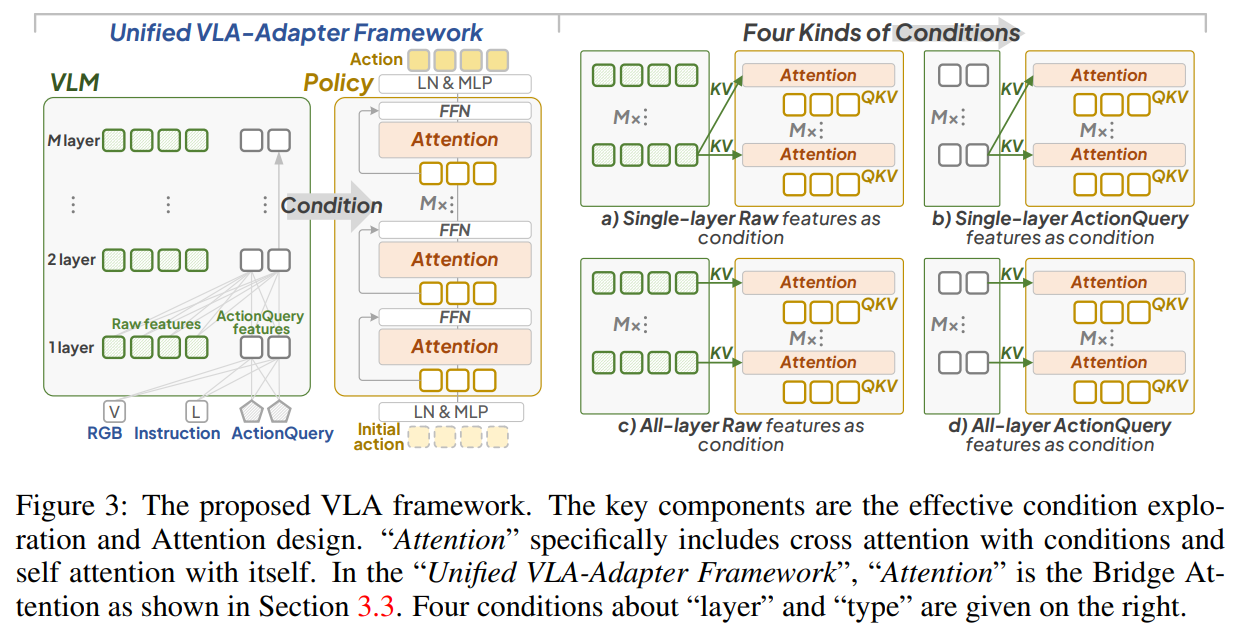

VLA-Adapter의 핵심 아이디어는 거대 모델의 종단간(End-to-End) 파라미터 업데이트에 의존하지 않고, 이미 학습된 소형 VLM(Qwen2.5-0.5B 등)에서 로봇 제어에 유리한 특정 레이어의 지식만을 선별하여 경량화된 정책 신경망(Policy Network)에 효율적으로 주입하는 것입니다.

입력 데이터의 표현 및 전처리 방식

타임스텝 에서 모델의 입력은 3인칭 카메라 이미지 , 그리퍼 뷰 이미지 , 언어 명령 , 그리고 새롭게 도입된 보조 인터페이스인 64개의 행동 질의 (ActionQuery)로 구성됩니다. 이미지 데이터는 DINOv2 및 SigLIP 인코더를 거쳐 시각 임베딩으로 변환되고, 토큰화된 언어 명령과 병합되어 VLM에 투입됩니다. VLM은 이를 처리하여 두 가지 핵심 조건을 출력합니다. 하나는 VLM 고유의 원본 잠재 표현인 (Raw latent)이고, 다른 하나는 추가 질의로부터 추출된 행동 질의 잠재 표현 (ActionQuery latent)입니다.

논문의 구조적 실험을 통해 밝혀진 기술적 핵심 발견은 다음과 같습니다. 의 경우 심층(Deep) 레이어의 피처는 고차원적 의미 구조에 치우쳐 있어 행동 제어에는 부적합하며, 시각-언어의 물리적 디테일이 보존된 중간(Middle) 레이어가 훨씬 유효합니다. 반면 밑바닥부터 학습되는 는 심층 레이어로 갈수록 다중 모달리티 정보를 밀도 있게 응집하여 디코딩에 강력한 성능을 발휘합니다. 저자들은 이 발견을 토대로, 정보 병목을 방지하고자 VLM의 '모든 레이어(All-layer)'의 특징을 정책 신경망의 각 대응 레이어로 전달하는 구조를 채택했습니다.

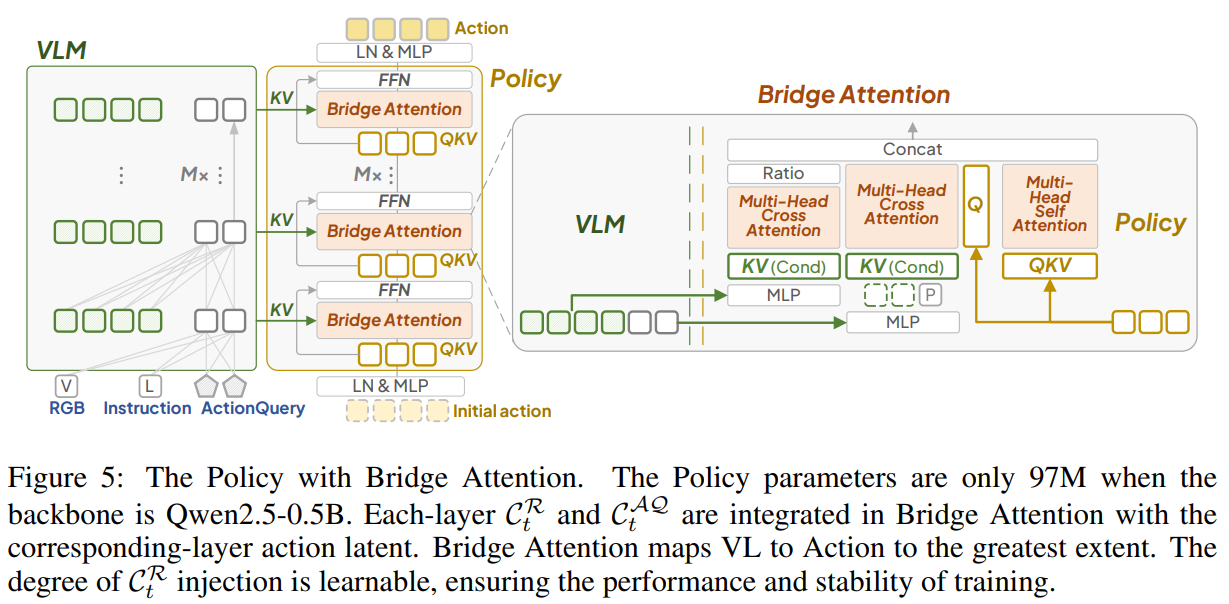

모델 세부 구조 (Policy with Bridge Attention)

제어 행동을 출력하는 정책 신경망은 VLM의 레이어 수()와 동일한 깊이를 가지는 L1 기반의 가벼운 잔차 네트워크(Residual Network)로 설계되었습니다. 복잡한 디퓨전(Diffusion) 과정 대신 다층 퍼셉트론(MLP)과 어텐션을 결합하여 추론 지연을 극소화했습니다.

번째 정책 레이어의 입력은 다음과 같습니다. 고유 수용성 상태(Proprioceptive state) , 그리고 초기화된 -스텝 궤적 데이터 가 LayerNorm과 MLP를 거친 행동 잠재 표현 입니다. 이 를 Query로 삼아, VLM에서 넘어온 및 를 Key, Value로 사용하는 브릿지 어텐션(Bridge Attention)을 수행합니다.

1) 교차 어텐션 1 (): 행동 잠재 공간과 간의 매핑을 수행합니다.

2) 교차 어텐션 2 (): 행동 잠재 공간과 고유 수용성 상태가 결합된 질의 정보 간의 매핑을 수행합니다.

3) 자가 어텐션 (): 자체의 시간적 맥락을 학습합니다.

이때 기존 방법론과 가장 차별화되는 엔지니어링 디테일은 학습 가능한 주입 제어 인자입니다. 정보를 정책 공간에 여과 없이 주입하면 텐서 분포가 붕괴될 위험이 있으므로, 학습 매개변수 를 도입해 활성화 값 로 정보 반영 비율을 자율적으로 조절합니다. 브릿지 어텐션의 출력 는 다음 수식과 같이 결합(Concatenation)됩니다.

학습(Training) 및 추론(Inference) 알고리즘 파이프라인

- 학습 단계: VLA-Adapter는 종단간(End-to-End) 학습되지만, 컴퓨팅 효율을 위해 백본 VLM은 동결(Frozen)하거나 LoRA를 통해 최소한으로 튜닝됩니다. 개의 정책 레이어를 모두 통과한 예측 행동 궤적 과 실제 정답(Ground Truth) 궤적 간의 L1 손실 함수를 최소화하도록 훈련됩니다.

- 추론 단계: 스트리밍으로 들어오는 비전 이미지와 명령어가 동결된 VLM을 한 번 통과하면 다차원 조건 텐서가 생성됩니다. 정책 신경망은 피드포워드(Feed-forward) 방식으로 이 조건들을 받아 단일 패스(Single-pass)로 다음 스텝의 행동 청크(크기 )를 생성해 냅니다.

3. 실험 결과 (Experiments)

평가는 LIBERO(단기 및 장기 조작 작업)와 CALVIN(Zero-shot 환경 일반화) 시뮬레이션 벤치마크, 그리고 6자유도 Synria Alicia-D 로봇 팔을 활용한 실제 환경(Real-world)에서 진행되었습니다. OpenVLA(7B), OpenVLA-OFT, (3B) 등 체급이 큰 최근 VLA 모델들이 비교 대상(Baseline)으로 사용되었습니다.

- 성능 우위와 매개변수 효율성: 0.5B 규모의 Qwen2.5 기반 백본을 사용한 VLA-Adapter는 LIBERO Long 환경에서 성공률 95.0%를 기록하여, 14배 더 큰 7B 파라미터의 SOTA 모델인 OpenVLA-OFT(94.5%)를 상회하는 결과를 보여주었습니다. 특히, 대규모 로봇 데이터 사전 학습을 전혀 거치지 않았음에도 미세 조정(SFT)만으로 이러한 성능을 달성했다는 점이 고무적입니다.

- 추론 스피드 (Throughput): 제안된 비-디퓨전(L1 기반) 정책 신경망 구조 덕분에 8차원 행동 청크 예측 시 추론 속도는 219.2Hz를 달성했습니다. 이는 기존 OpenVLA-OFT의 최적화 버전(109.7Hz)보다 2배 이상 빠른 속도이며, 실시간 피드백 제어에 이상적인 스펙입니다.

- Ablation Study: ActionQuery 개수를 64개로 설정했을 때 파라미터 효율과 다중 모달 표현력 간의 균형이 가장 좋았습니다. 또한, 브릿지 어텐션에서 주입 계수를 제거했을 때 성공률이 95.0%에서 91.4%로 하락함을 확인하여 동적 정보 조절 메커니즘의 타당성이 입증되었습니다.

4. 한계점 및 시사점

한계점 (Limitations)

논문은 방법론이 지닌 몇 가지 명확한 제약을 인정하고 있습니다.

- 일반화 역량의 제약: 모델 체급 자체가 극도로 작고(Tiny-scale) 대규모 로봇 동작 데이터(Embodied data)를 통한 사전 학습 과정이 생략되었기 때문에, 훈련 데이터에 없는 완전히 이질적인 물리 환경이나 낯선 객체가 등장하는 실제 환경(Zero-shot OOD)에서는 강건성이 다소 떨어질 수 있습니다.

- VLM 의존도: 정책 신경망의 출력 품질이 전적으로 VLM에서 넘어오는 조건 벡터(, )의 질에 종속되므로, 백본 VLM 자체의 구조가 바뀌면 최적화 파라미터를 다시 찾아야 하는 번거로움이 있습니다.

- 훈련 알고리즘의 단순성: 행동 복제(BC)를 위한 단순 L1 최적화에 의존하고 있으므로, 고난도 작업을 스스로 탐색하거나 복구 동작을 익히기 위한 강화학습(RL) 파이프라인이 부재합니다.

시사점 및 향후 연구 방향

VLA-Adapter는 로보틱스 AI 분야가 무작정 모델 스케일링(Scale-up)에 매몰되던 현 추세에 제동을 걸고, "인지와 행동을 연결하는 어댑터(Adapter)의 정교한 설계"만으로도 거대 모델 이상의 효율을 낼 수 있음을 증명한 기념비적인 연구입니다. 특히 8시간이라는 짧은 시간 내에 단일 소비자용 GPU(단일 노드) 환경에서 고성능 VLA 모델을 튜닝할 수 있게 함으로써, 산업 현장과 학계의 로보틱스 연구 장벽을 허물었습니다. 향후 이 구조 위에 강화학습(RL) 정렬을 결합하여 복잡한 순차적 추론 능력을 고도화하는 방향으로 쉽게 확장될 수 있을 것입니다.