Training language models to follow instructions with human feedback Long Ouyang, Jeffrey Wu, Xu Jiang, Diogo Almeida, Carroll Wainwright, Pamela Mishkin, Chong Zhang, Sandhini Agarwal, Katarina Slama, Alex Ray, John Schulman, Jacob Hilton, Fraser Kelton, Luke Miller, Maddie Simens, Amanda Askell, Peter Welinder, Paul F Christiano, Jan Leike, Ryan Lowe OpenAI, Submitted on 4 Mar 2022, Part of Advances in Neural Information Processing Systems 35 (NeurIPS 2022)

서론

문제 제기: LLM은 할루시네이션, 편향, 유해성, 지시 불이행을 보이곤 함. 학습 목표인 next-token prediction은 우리가 원하는 목표인 사용자 지시를 안전하게 따르기와 다르기 때문임(objective misalignment).

연구자들의 목표: 모델은 helpful, honest, harmless 해야한다(Askell et al., 2021)고 생각해서 InstructGPT 만듦. 이 기준들로 모델을 평가함.

방법과 실험적 디테일

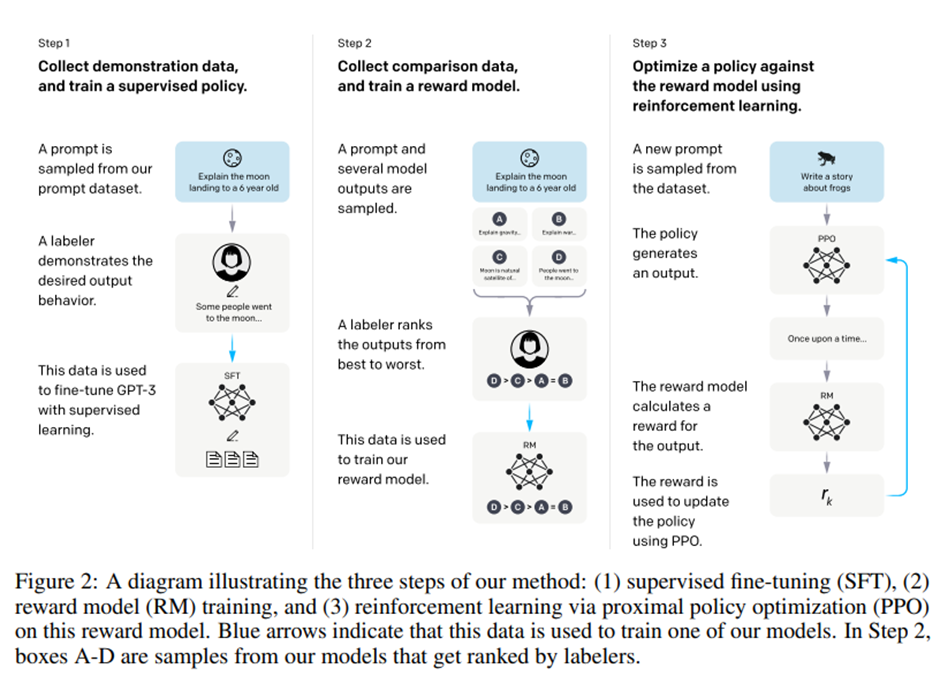

Ziegler et al. (2019)와 Stiennon et al. (2020)의 방법론을 따름.

SFT: 라벨러가 직접 작성한 “좋은 예시”로 지도학습

RM: 라벨러가 여러 출력에 순위를 매김 -> 이를 기반으로 보상 모델 학습. 라벨러가 보통 4~9개의 응답에 순위를 매기고, 이걸 전부 쌍(pairwise) 비교 데이터로 변환해서 RM을 학습함.

RLHF: PPO 알고리즘으로 보상 모델을 최대화하도록 SFT 모델을 파인튜닝. KL penalty를 추가해서 RM에만 과도하게 최적화되지 않도록 조정함.

데이터셋:

OpenAI API 프롬프트(96% 영어) + 일부 라벨러 작성 프롬프트로 구성.

13k (SFT), 33k (RM), 31k (PPO)

라벨러:

Upwork와 ScaleAI를 통해 약 40명을 선별 시험을 통해 채용(훈련 데이터에 전혀 참여하지 않은 별도의 held-out 라벨러 집단도 고용해서 평가함)

라벨러 간 합의율(inter-annotator agreement) 높음 (훈련 라벨러끼리 72 ~ held-out 라벨러끼리 77%)

모델

SFT 모델: GPT-3 기반, 시연 데이터로 지도학습. cosine learning rate decay와 0.2의 residual dropout을 사용해 16 에폭 동안 훈련. 에폭 훈련 많이 하면 RM 점수와 인간 선호 평가 모두에서 도움이 됨.

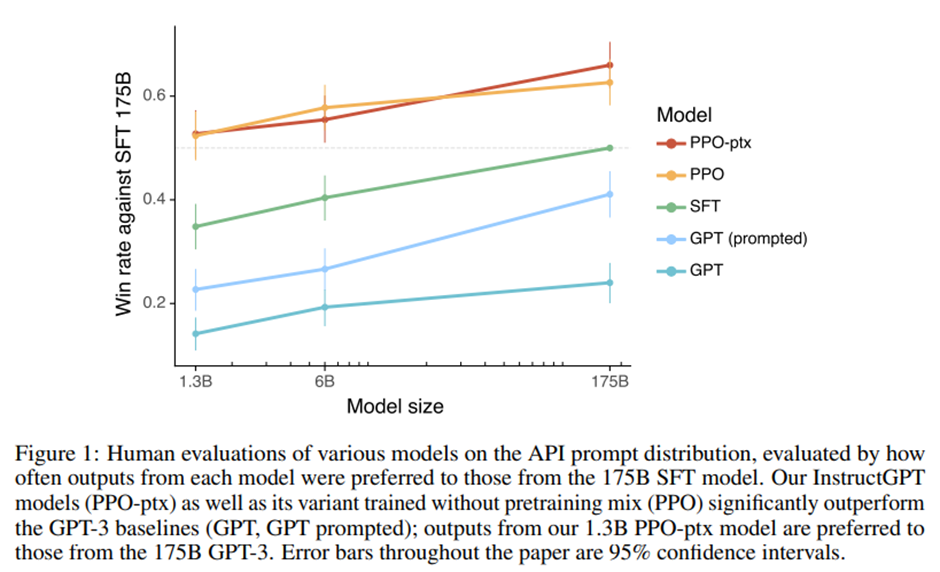

RM 모델: GPT-3를 파인튜닝하여 출력마다 점수를 매기도록 학습. 본 논문에서는 계산량을 크게 줄이고, 175B RM 훈련이 불안정할 수 있어 RL 동안의 가치 함수로 쓰기에 덜 적합하다는 사실을 발견했기 때문에 6B RM만 사용.

여기서 r_θ(x,y) 는 매개변수 θ를 가진 보상 모델의 출력, 프롬프트 x와 완료(completion) y를 입력으로 한다. y_w는 쌍 (y_w,y_l)중 선호되는 완료이고, D는 비교 데이터셋임.

PPO 모델: SFT + RM 기반으로 RLHF. Bandit 환경(무작위 사용자 프롬프트를 제시하고 프롬프트에 대한 응답을 기대). 보상 모델의 과도한 최적화를 완화하기 위해 각 토큰마다 SFT 모델과의 per-token KL 패널티를 추가(RM 점수만 높이려고 하다가 SFT 분포에서 너무 멀어지는 것을 막는 것), RM에서 가치 함수 초기화.

참고: PPO는 policy 네트워크와 value function 네트워크를 함께 학습하는 강화학습 구조를 따름. Policy(여기서는 SFT 모델)는 어떤 응답을 낼지 확률 분포를 주고, value function은 “이 상태에서의 기대 보상(예상 가치)”을 추정함. RM이 이미 응답의 품질을 잘 점수화하도록 학습됐으므로, value function 초기값으로 재사용한 것. -> RM은 응답이 좋은지 나쁜지 알려주고, value function은 이 정보를 이용해 학습하면 안정적임.

PPO-ptx: RLHF 중 일부 pretraining 그레디언트를 섞어 공개 NLP 데이터셋 성능 저하를 완화, 본 논문에서의 InstructGPT는 이 모델.

PPO 비교군: SFT, GPT-3 원본, GPT-3 few-shot prompted

InstructGPT 비교군: GPT-3를 FLAN (Wei et al., 2021), T0 (Sanh et al., 2021) 데이터셋으로 파인튜닝한 모델. 약 백만 개 예시로 이들을 파인튜닝하고, 검증 셋에서 가장 높은 RM 점수를 얻은 체크포인트를 선택.

결과

1. API 분포 결과

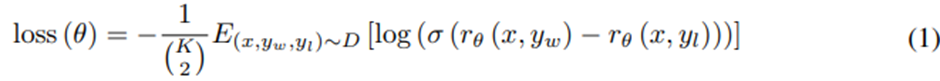

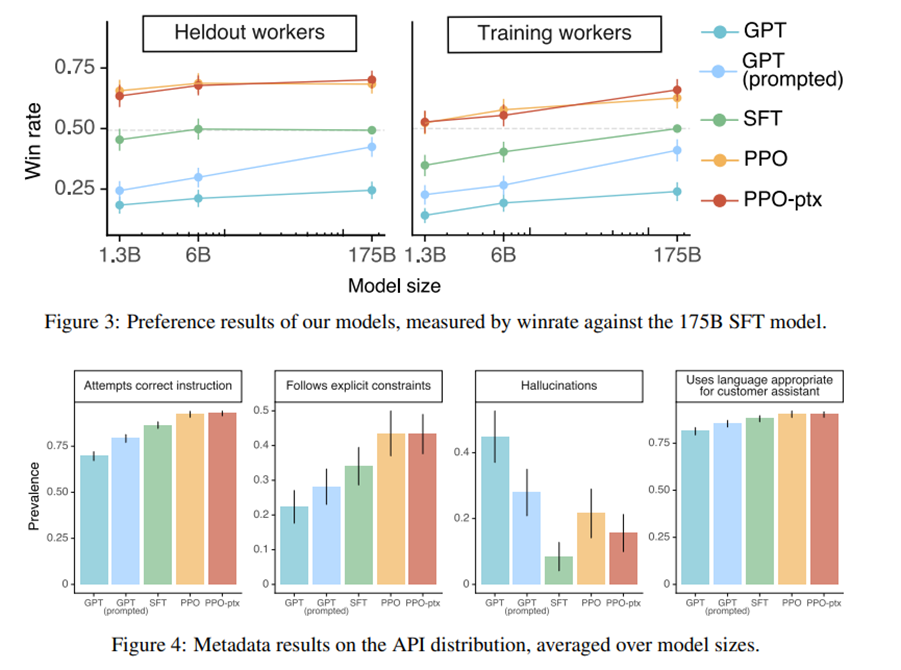

라벨러 선호: GPT-3 < GPT-3 prompted < SFT < PPO

175B InstructGPT vs GPT-3 -> 85 ± 3% 비율로 InstructGPT가 더 선호됨.

GPT-3와 비교했을 때, InstructGPT의 출력은 고객 어시스턴트 맥락에서 더 적절하고, 지시사항에 명시된 명시적 제약(예: “답변을 두 단락 이하로 작성하라.”)을 더 자주 따르며, 올바른 지시를 완전히 따르지 못하는 경우가 더 적고, 폐쇄형 과업에서 사실을 꾸며내는(할루시네이션) 경우가 더 적음.

2. 공개 NLP 데이터셋 결과

훈련데이터에 없던 held-out 라벨러에게도 성능 유지.

FLAN, T0 데이터셋으로 파인튜닝한 모델은 잘 선택된 프롬프트를 사용한 GPT-3 수준 또는 SFT보다 못함.

TruthfulQA: InstructGPT가 더 진실되고 정보 풍부한 응답 생성. (예외: 1.3B PPO-ptx는 동일 크기 GPT-3보다 성능 조금 더 안 좋음.)

유해성: “respectful prompt” 있을 때 GPT-3보다 소폭 감소. No prompt 상태에서는 장점 사라짐.

Bias는 큰 차이 없음

PPO-ptx 모델의 성능은 여전히 DROP, SQuADv2, 번역에서 GPT-3보다 뒤처지며, 이러한 성능 저하를 연구하고 더 줄이기 위해 더 많은 작업이 필요함. 사전학습 업데이트를 혼합하는 것이 단순히 KL 계수를 증가시키는 것보다 더 잘 작동함.

3. 질적 결과(Qualitative results)

코드, 다국어(비영어) 등 드문 지시(훈련 데이터에 없는)에도 일정 수준 일반화.

여전히 잘못된 전제를 가진 지시 수용, 불필요한 장황함(얼버무림), 다중 제약 처리 실패 문제 있음.

잘못된 전제를 가진 지시를 수용하는 것은 훈련 셋에 잘못된 전제를 가정한 프롬프트가 거의 없기 때문에 발생한다고 의심함. 답을 얼버무리는 행동은 부분적으로 라벨러들에게 인식적 겸손(epistemic humility)을 보상하도록 지시했기 때문에 나타난다고 의심함. 이것들은 적대적 데이터 수집(adversarial data collection; Dinan et al., 2019)으로 크게 줄일 수 있을 것.

논의

Alignment 연구 교훈:

RLHF는 모델 크기 100배 키우는 것보다 효과적이고 비용 효율적.

인간 감독 없는 상황에도 어느 정도 일반화됨.(비용 효율적)

성능 저하(Alignment Tax)는 파인튜닝으로 해결 가능함.

한계:

라벨러들이 주로 영어권 -> 다양성 부족.

모델은 여전히 유해성, 편향, 사실 왜곡 문제 있음.

사용자의 지시를 해롭더라도 무조건 따르는 문제가 있음. 모델에 최대한 편향되도록 프롬프트하면, InstructGPT는 동일한 크기의 GPT-3 모델들보다 더 독성적인 출력을 생성함.

사회적 영향:

긍정적: 사용자에게 더 도움이 되고, 진실하며, 무해한 모델 가능성.

부정적: 오히려 오용하기 쉬워짐 (허위정보, 혐오발언 자동 생성).

의료, 법 집행, 정치 광고 등 고위험 분야에서는 신중해야 함.

누구에게 정렬되는가는 매우 중요한 문제.

체크리스트

라벨러 보상 금액, IRB(기관생명윤리위원회) 관련 내용은 없음.

코드와 전체 데이터 공개는 하지 않음.