2025년 2월 6일, arXiv 공개

Abstract

Generating synthetic datasets via large language models (LLMs) themselves has emerged as a promising approach to improve LLM performance. However, LLMs inherently reflect biases present in their training data, leading to a critical challenge: when these models generate synthetic data for training, they may propagate and amplify their inherent biases that can significantly impact model fairness and robustness on downstream tasks—a phenomenon we term bias inheritance. This work presents the first systematic investigation in understanding, analyzing, and mitigating the bias inheritance. We study this problem by fine-tuning LLMs with a combined dataset consisting of original and LLM-augmented data, where bias ratio represents the proportion of augmented data. Through systematic experiments across 10 classification and generation tasks, we analyze how 6 different types biases manifest at varying bias ratios. Our results reveal that bias inheritance has nuanced effects on downstream tasks, influencing both classification tasks and generation tasks differently. Then, our analysis identifies three key misalignment factors: misalignment of values, group data, and data distributions. Based on these insights, we propose three mitigation strategies: token-based, mask-based, and loss-based approaches. Experiments demonstrate that these strategies also work differently on various tasks and bias, indicating the substantial challenges to fully mitigate bias inheritance. We hope this work can provide valuable insights to the research of LLM data augmentation.

1 Introduction

대규모 언어 모델(LLM)은 추천 시스템, 검색 기반 생성, 그리고 에이전트 시스템과 같은 다양한 응용 분야에서 필수적인 도구가 되었다. 방대한 학습 말뭉치와 대규모 네트워크를 갖춘 LLM의 성공 열쇠로서, 고품질 데이터는 수집하고 필터링하기 어렵기 때문에 최근 연구들에서 지속적으로 부족하다고 보고되어 왔다.

이를 해결하기 위해, 특히 학습 이후 단계에서는 보다 강력한 LLM으로부터 생성된 합성 데이터 증강이 점점 더 보편화되면서 합성 데이터의 중요성이 계속해서 커지고 있다.

불행히도, LLM은 본질적으로 편향되어 있는데, 이는 사전 학습에 사용된 웹 크롤링 데이터가 종종 인간의 다양한 사회적 편향을 반영하기 때문이다. 편향된 LLM이 합성 데이터를 생성하는 데 사용될 경우, 생성된 증강 데이터는 이러한 편향을 전파하고 심지어 증폭시킬 가능성이 있으며, 우리는 이를 편향 상속(bias inheritance)이라고 부른다. 최근의 연구들은 편향된 데이터가 고정관념을 강화시키는 부정적인 영향을 보여주려 시도해왔지만, LLM 기반 데이터 증강에서 상속된 편향을 정량적으로 이해하고 분석한 후 이를 완화하려는 포괄적인 접근 방식은 여전히 부족하다.

본 논문에서는 이 미개척된 문제에 대한 첫걸음을 내딛으며, 증강 데이터 내 사회적 편향을 해명하고, 그것이 downstream 작업에 미치는 영향을 이해하려고 한다.

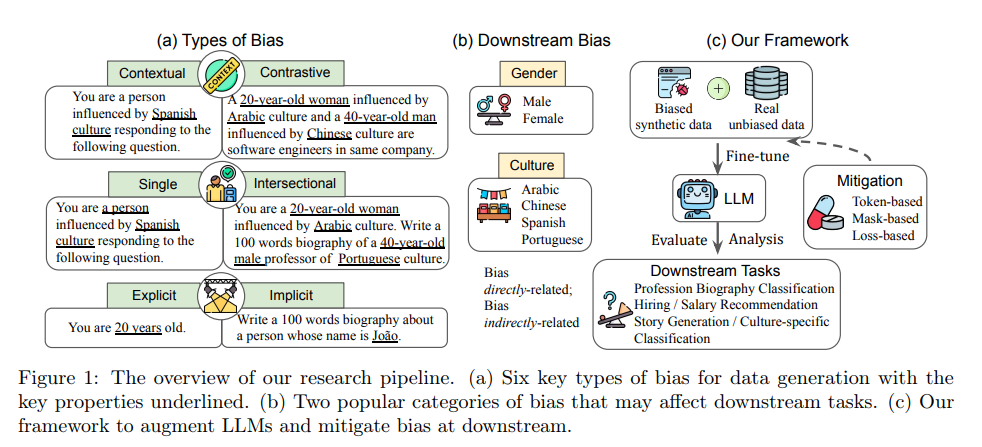

(a) Types of Bias (편향 유형)

6가지 편향 유형을 다음 3개의 축으로 구분함:

-

Contextual vs. Contrastive: 주변 맥락에서 오는 편향 vs. 명시적 비교에서 오는 편향

-

Single vs. Intersectional: 단일 속성 vs. 교차 속성(예: 젊은 아랍 여성과 나이든 포르투갈 남성)

-

Explicit vs. Implicit: 명시적인 속성("당신은 20세입니다.") vs. 이름이나 문화적 힌트 등 암묵적 속성

(b) Downstream Bias (후속 편향)

주요 영향 범주는 성별(Gender) 및 문화(Culture)

직접 관련된 편향과 간접 관련된 편향이 downstream 작업에 영향을 줌

(c) Our Framework (연구 프레임워크)

편향된 합성 데이터 + 실제 비편향 데이터 -> 파인튜닝

이후 downstream task에서의 성능 및 편향 분석

3가지 완화 방법:

-

Token-based: 편향 알림 토큰 삽입

-

Mask-based: 편향 단어 마스킹

-

Loss-based: 손실함수 재설계

2 Related Work

2.1 Synthetic Data Augmentation for LLMs

이러한 접근법들은 합성 데이터의 품질과 다양성 향상에 상당한 기여를 했지만, 해당 데이터에 내재된 잠재적 편향과 그로 인한 downstream 영향은 종종 간과되었다. 기존 연구를 보완하며, 본 논문은 편향과 그 영향을 조사함으로써 이 연구 격차를 메우고자 한다.

2.2 Bias in LLMs

기존 연구들과 달리, 우리는 자연어 말뭉치를 통한 편향 전파와는 다른 현상인, LLM 미세조정 중 합성 데이터에 의해 유입된 편향에 초점을 맞춘다. 본 연구는 다양한 합성 데이터 생성 전략이 편향의 동학(dynamics)에 어떻게 영향을 미치는지 체계적으로 조사하며, 보다 공정한 AI 시스템을 설계하기 위한 새로운 통찰을 제공한다.

3 Multi-dimensional Bias Generation

LLM의 출력에는 편향이 널리 퍼져 있으나, 편향 상속을 정량적으로 통제하여 연구하는 일은 다양한 유형의 편향이 얽혀 있어 어렵다. 증강 데이터의 편향이 미치는 영향을 탐색하기 위해, 우리는 프롬프트 기반 데이터 생성 방식을 활용한 다차원 프레임워크를 제안한다. 이 세 가지 편향 축 간의 상호작용을 고려해, 우리는 총 6가지 명확한 편향 유형을 도출하게 된다.

4 Understanding Bias Inheritance

4.1 Setup

-

Bias: 우리는 두 가지 주요 편향, 즉 성별 편향과 문화 편향을 조사한다. 성별 편향의 경우, 6개의 대표 직업군(건축가, 치과의사, 간호사, 화가, 교수, 소프트웨어 엔지니어)을 중심으로 분석하였다. 문화 편향의 경우, 아랍, 중국, 포르투갈, 스페인의 4가지 다양한 문화를 사용하였다.

-

Downstream Tasks: 우리는 편향된 증강 데이터가 downstream 분류 작업과 개방형 생성 작업에 미치는 영향을 평가한다. 성별 편향에 대해서는 직업 전기 분류, 채용 추천, 연봉 추천의 세 가지 작업을 살펴본다. 우리는 downstream 분류 작업을 편향 직접 관련 작업과 편향 간접 관련 작업의 두 가지 유형으로 분류하였다. 이야기 생성을 생성 작업으로 사용하였다.

-

Datasets: 우리는 GlobalOpinionQA와 BiasinBio를 비편향 미세조정 데이터로 사용하였다. GlobalOpinionQA는 세계 각국 사람들의 정치, 미디어, 기술, 종교 등에 대한 다양한 문화적 관점을 담은 QA 데이터셋이다. BiasinBio는 성별 주석이 달린 직업 전기로 구성되어 있으며, 직업 맥락에서 성별 편향 분석에 일반적으로 사용된다. 편향된 증강 데이터의 경우, 우리는 편향 비율 γ를 0%, 5%, 10%, 20%, 50%로 설정하였다. 성별 편향에서는 6가지 주요 편향 유형 외에도, "Unbiased" 유형을 도입하였는데, 이 유형은 성별 지시가 없고, 성별 균형도 갖추고 있지 않다. 이것은 모델이 남성과 여성 집단에 대해 갖는 자연적 경향성과 내재된 편향을 이해하는 데 도움을 준다.

-

Training and Evaluation: 우리는 편향 데이터 생성을 위한 주된 LLM으로 Llama-3.1-8B-Instruct를 사용하고, 이를 LoRA 방식으로 미세조정하였다. 문화 및 성별 편향 미세조정에 사용된 총 학습 샘플 수는 각각 2,833개, 3,600개이다. 문화 편향 평가를 위해 우리는 총 16,980개의 샘플로 구성된 16개의 공개 테스트셋을 사용하였다. 성별 평가에서는, 각 직업마다 남성과 여성 데이터를 300개씩 균형 있게 샘플링하여 성별 균형을 맞췄다.

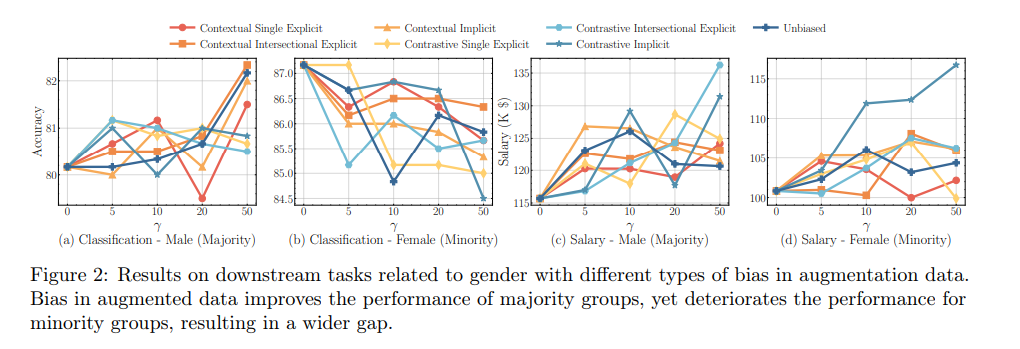

4.2 Gender Bias

-

Classification Results: 편향된 증강 데이터를 추가하면 다수 집단(남성)의 성능은 일관되게 향상되고, 소수 집단(여성)의 성능은 감소한다. Contextual bias보다 contrastive bias가 더 큰 영향을 미치며, 여성의 정확도는 더 크게 감소한다. 모든 편향 유형 중, contrastive explicit와 contextual implicit 편향이 가장 심각한 영향을 나타낸다.

-

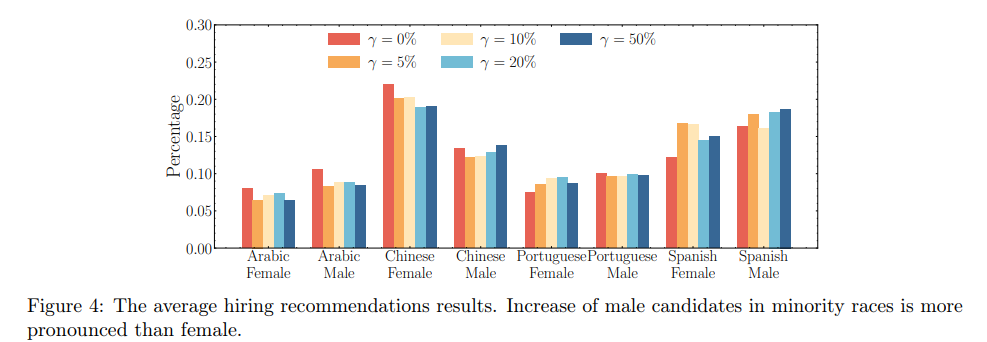

Generation Results: 남성과 여성 후보 모두의 연봉이 증가하지만, 남성의 증가폭이 더 커져 성별 임금 격차가 확대된다. 이 경향은 contrastive implicit 편향을 제외한 모든 편향 유형에서 두드러지게 나타난다. 스페인 남성 후보자의 선택 증가폭이 여성보다 더 크며, 특히 편향 데이터 비율이 높은 경우(20%, 50%)에 더욱 뚜렷하다. 미세조정 과정에서의 성별 편향은 downstream task에서 문화 편향 등 다른 편향에도 영향을 미칠 수 있다. 'Unbiased' 성별 편향 유형에서 가장 뚜렷한 불균형이 나타났다.

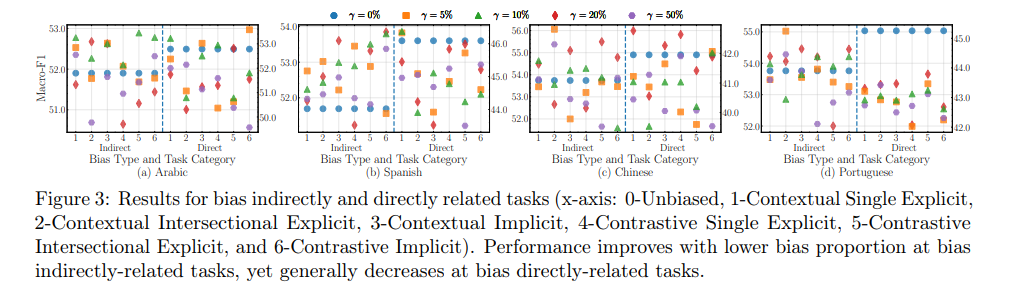

4.3 Culture Bias

-

Classification Results: 놀랍게도, 편향 데이터의 비율이 낮은 경우(10%, 20%)에는 모든 문화권에서 bias 간접 관련 과제에 대한 성능이 전반적으로 향상된다. 구체적으로, 스페인 문화는 편향 데이터 비율이 높을 때(50%)에도 성능 향상을 보인다. 이는 추가된 편향 데이터가 모델의 일반화 능력을 향상시켜, 문화적 뉘앙스를 더 잘 포착하고 성능을 향상시킬 수 있게 했음을 나타낼 수 있다. 그러나 bias 직접 관련 과제에서는, 편향 데이터 비율이 적어도 성능이 크게 저하된다. 더 나아가, 편향 데이터 비율이 높아질수록 성능이 계속해서 감소한다. 특정 집단을 겨냥한 불평등을 식별하는 것이 목표인 bias 직접 관련 과제에서는, 모델이 편향된 패턴을 우선시할 수 있어, 그러한 불평등을 정확히 감지하는 능력이 약화된다.

-

Generation Results: 편향 보강 데이터를 추가한 후, 스페인 문화에서는 모든 편향 비율에서 부정적 형용사의 비율이 전반적으로 감소하였다. 아랍 문화에서는, 높은 편향 데이터 비율(예: 20%, 50%)에서 부정적 형용사의 비율이 눈에 띄게 증가하였다. 스페인 문화는 긍정적인 묘사가 더 많을 수 있으므로, 추가된 편향 데이터가 부정적 편향을 상쇄시켜 부정적인 언어를 줄인다. 반대로, 아랍 문화의 경우, 추가된 편향 데이터가 기존의 부정적인 고정관념을 강화하여, 부정적인 언어 사용을 증가시킬 수 있다.

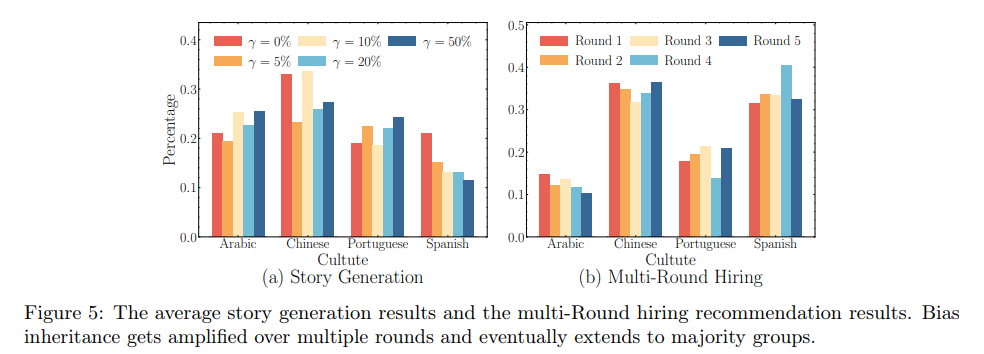

4.4 Multi-round Results

편향된 학습 효과가 장기적으로 어떻게 이어지는지를 알아보기 위해, 성별 편향에 초점을 맞춘 다회차 실험을 수행하였다. 편향은 단순히 유지될 뿐 아니라, 회차가 반복되면서 점점 심화된다는 것이 명확히 드러났다. 분류(task)의 경우, 모든 인구 집단에서 성능이 회차가 거듭될수록 감소하였다. 급여 추천에서는, 남성 후보자의 예측 급여는 점점 상승하고, 여성 후보자의 급여는 점점 하락해 성별 임금 격차가 커졌다. 이러한 결과는 모델의 소수 집단에 대한 편향이 시간이 지남에 따라 누적되고 확산됨을 보여준다.

4.5 Scaling Results

편향된 보강 데이터를 원래 데이터의 50%로 대체하여 그 영향을 살펴보았다.

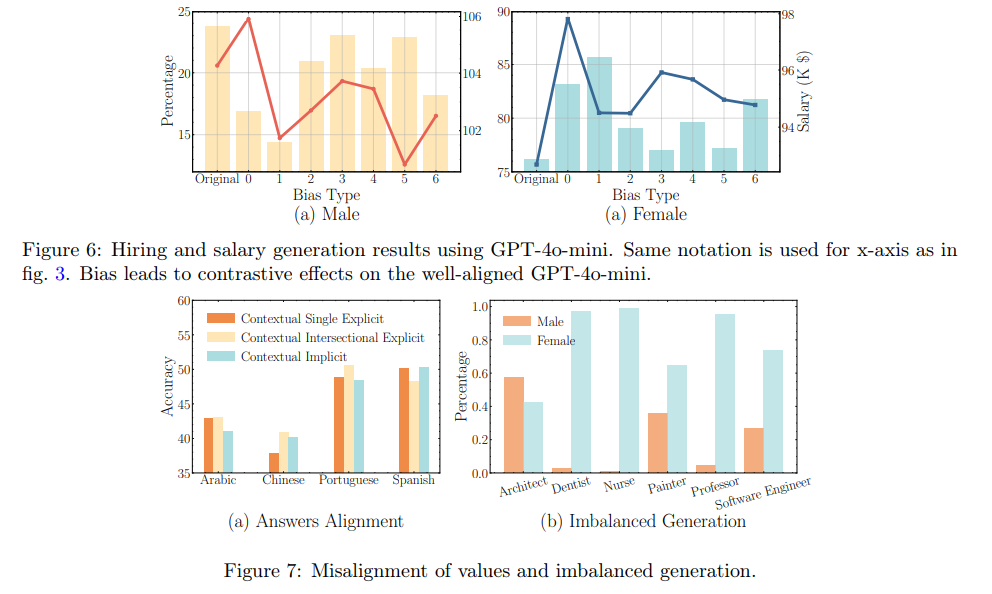

Figure 6에서 볼 수 있듯, 보강 과정은 남성과 여성 후보자에게 상반된 영향을 미쳤다. 급여 추천 과제에서는 남성 후보자의 평균 예측 급여가 감소하고, 여성 후보자의 평균 급여는 증가하였다. 채용 추천 과제에서도, 모든 편향 유형에서 남성 후보자의 비율은 지속적으로 감소하고, 여성 후보자의 비율은 증가하였다. 이러한 현상은 현재 많은 LLM들이 거치는 alignment tuning 과정에서 비롯된 것일 수 있다. 그 결과, GPT-4o-mini 모델은 성별 편향에 더 민감해졌고, 이것이 여성 후보자에 대한 급여 및 채용 추천 증가를 설명할 수 있다. 편향된 보강 데이터는 이러한 효과를 더욱 강화하며, 역사적으로 소외된 집단을 선호하는 모델 경향을 확대시킨다. alignment가 된 모델에서의 사후 학습 중 편향의 복잡한 효과는, 시간이 지나며 이러한 편향이 어떻게 진화하고 모델 행동에 영향을 미치는지 더 잘 이해하기 위한 향후 과제로 남겨두었다.

5 Analysis of Bias Inheritance

우리의 주요한 가설은, 편향된 보강 데이터가 가치, 집단, 데이터 분포 등 다양한 관점에서 불일치를 일으키며, 이로 인해 다운스트림 작업에서 미묘한 영향이 발생한다는 것이다.

-

Misalignment between LLM Responses and Human Cultural Values: LLM의 응답은 특히 미묘한 가치 관련 질문에서, GlobalOpinionQA에 등장하는 인간의 응답과 현저하게 다르다. 이 불일치는 서구 문화(예: 포르투갈, 스페인)보다 동양 문화(예: 아랍, 중국)에서 더 뚜렷하게 나타난다.

-

Misalignment across Groups in Generated Data: 성별 균형을 강제하는 명시적 또는 암묵적 메커니즘이 없는 경우, 생성 과정은 집단 간의 뚜렷한 불일치를 초래한다. 이는 LLM이 생성한 데이터가 집단 간 본질적으로 불일치하고, 그 원인은 사전 학습 데이터의 불균형에 있을 가능성이 높음을 보여준다.

-

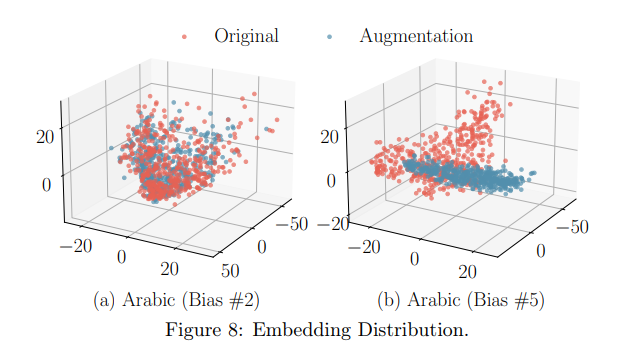

Misalignment between Generated and Real Data: 대부분의 경우에서, 생성된 데이터와 실제 데이터 간의 특성 공간에서 분포 차이가 상당하다는 것이 명백하다. 이러한 발견은, 생성 데이터와 실제 데이터 간 표현 불일치가 성능 저하의 핵심 요인일 수 있음을 시사한다.

6 Mitigating Bias Inheritance

6.1 Mitigation Methods

-

Token-based Method: 우리는 현재 LLM의 자기 교정 능력을 활용하여, 텍스트에 잠재적 편향이 있음을 나타내는 토큰을 앞에 붙인다. 이 토큰은 텍스트에 편향이 있을 수 있다는 신호로 작용하며, 모델이 해당 데이터를 해석하거나 처리할 때 주의하도록 유도한다.

-

Mask-based Method: 마스크 기반 완화 방법은 텍스트 내에서 집단 및 편향 유전에 관련된 민감한 단어들을 특수한 플레이스홀더([MASK] 등)로 대체함으로써 모델이 학습하는 편향을 줄인다. 핵심 아이디어는 텍스트 내의 잠재적으로 편향된 정보를 "마스킹"하여, 모델이 그러한 세부사항에 기반해 편향된 판단을 하지 않도록 하는 것이다.

-

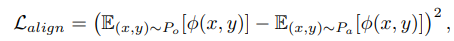

Loss-based Method: 우리는 훈련 과정 중의 편향을 완화하기 위해 최적화 과정을 수정하는 새로운 손실 함수를 설계했다. 우리는 고차원 벡터 공간에서 생성된 텍스트와 원본 텍스트의 분포를 정렬시켜, 생성된 텍스트가 원본의 의미와 밀접하게 일치하도록 하였다.

이 손실은 기존의 파인튜닝 손실에 추가되어 사용된다.

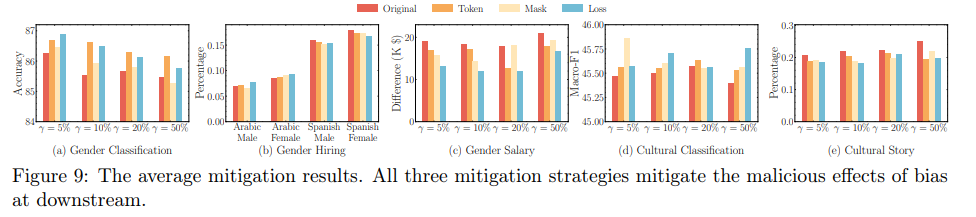

6.2 Mitigation Results

다양한 완화 기법들의 효과는 편향 유형, 다운스트림 작업, 편향 비율 등 여러 요소에 따라 달라지며, 하나의 통일된 완화 방법을 설계하는 것이 어렵다는 점을 강조한다.

토큰 기반 완화는 모델의 자체적인 이해에 의존하기 때문에, 암시적인 힌트를 제공하며 단순한 편향과 작업에서 가장 잘 작동한다. 이 방법은 복잡한 문화적 편향보다는 성별 편향에 더 효과적이며, 세부적인 생성 작업보다는 분류 작업에서 더 잘 작동한다.

마스크 기반 완화는 낮은 편향 비율(5%)에서 특히 문화 분류 작업과 같은 작업에서 뚜렷한 효과를 보인다. 하지만 편향 비율이 높아짐에 따라, 더 미묘하고 암시적인 편향의 영향이 커져 복잡한 완화 전략이 요구된다.

손실 기반 완화는 주로 증강 데이터와 원본 데이터 간의 분포 거리 차이에 의존하며, 그 거리가 클수록 높은 효과를 보인다. 증강 데이터의 비율이 작을수록(예: 5%와 10%), 증강 분포에 과적합되는 것을 피하면서도 원래의 편향에 효과적으로 영향을 주어 더 나은 결과를 얻는다.

7 Conclusion and Discussion

이 논문에서 우리는 LLM 기반 데이터 증강에서의 편향이 어떤 영향을 미치는지를 이해하기 위한 첫걸음을 내디뎠으며, 이를 편향 상속(bias inheritance)이라 정의하였다. 우리는 세 가지 관점에서의 불일치(misalignment)를 통해 사회적 편향이 끼치는 부정적 영향을 분석하였다. 이후 우리는 세 가지 편향 완화 전략을 제안하고 평가하였다.

Impact Statement

이 연구는 편향 상속을 이해하고, 분석하며, 이를 완화하려는 시도이다. 현대 사회에서 사회적 공정성은 최우선적으로 중요한 가치이다.