벡터란?

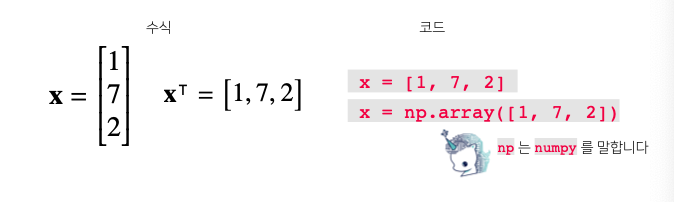

- 벡터는 숫자를 원소로 가지는 리스트(list) 또는 배열(array)입니다.

- X : 열 벡터, Xt는 (열 벡터 X를 transpose 시킨) 행 벡터를 나타냅니다.

부스트 캠프에서 강의를 듣기 전에는 벡터란 방향을 갖고 있는 어떤 선?이라는 개념으로 알고 있었는데 임성빈 교수님의 강의를 들으면서 제대로 된 정의를 알 수 있었습니다.

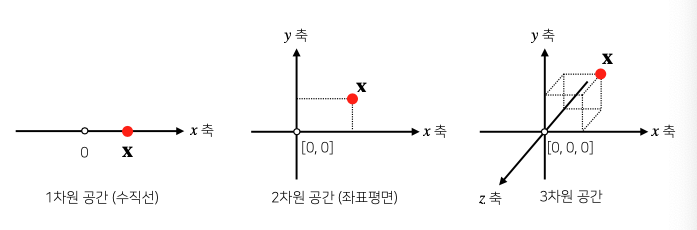

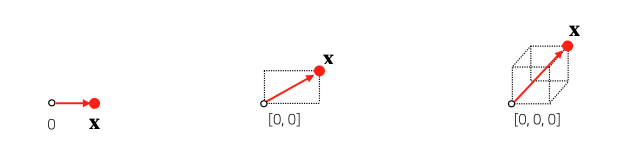

- 벡터는 공간에서 한 점을 나타낸다.

- 벡터는 원점으로부터 상대적 위치를 표현한다.

추가적으로 벡터에 숫자를 곱해주면 길이만 변하고 곱해주는 숫자가 0보다 작다면 반대 방향으로 바뀝니다.

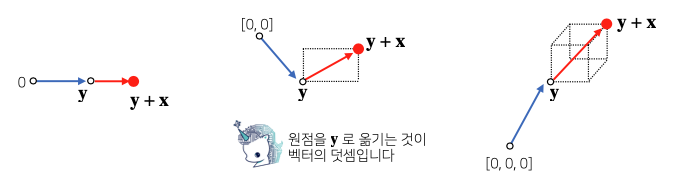

벡터의 덧셈

두 벡터의 덧셈은 다른 벡터로부터 상대적 위치이동을 표현합니다.

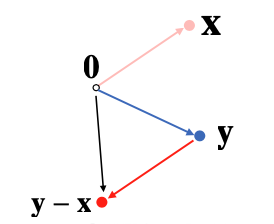

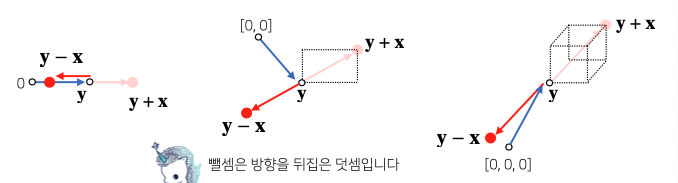

벡터의 뺄셈

두 벡터의 뺄셈은 방향을 뒤집은 덧셈

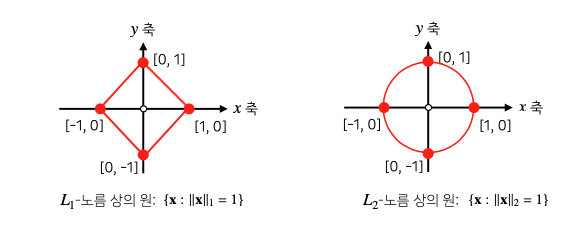

벡터의 노름

벡터의 노름(norm)은 원점에서부터의 거리를 말합니다. norm 은 L1-norm 과 L2-norm 으로 구분되는데 L1-norm 은 각 성분의 변화량의 절대값을 모두 더합니다.

L2-norm 은 피타고라스 정리를 이용해 유클리드 거리를 계산합니다.

두 개의 norm을 모두 알아야하는 이유는 노름의 종류에 따라 기하학적 성질이 달라지기 때문입니다. 머신러닝에선 각 성질들이 필요할 때가 있으므로 둘 다 사용한다고 합니다.

두 벡터 사이의 거리

벡터의 뻴셈을 이용하면 두 벡터 사이의 거리를 구할 수 있습니다.