회귀 (Regression)

- 🪐 머신러닝에서의 회귀란 ?

주어진 입력 변수와 출력 변수(예측하려는 변수) 사이의 관계를 모델링하는 기술이다.

예를 들어, 주택 가격의 예측 문제에서 주택의 크기,위치,연식 등을 입력 변수로 하여 주택의 가격을 예측할 수 있다. 이것이 회귀 분석이라 볼 수있다.

회귀는 지도 학습의 종류중 하나이며, 목표 변수가 연속적인 값을 가지는 경우에 적용 된다.

예시로는

주택 가격 예측주식 가격 예측온도 예측

등이 회귀 분석을 적용한 대표적인 예이다.

가설 (Hypothesis)

데이터에 숨겨진 관계를 표현하고 약품 투입량과 같은 독립변수에 대해 오염도라는 종속 변수가

어떠한 값을 가질지 예측하는 𝑓𝑎(𝑥) 와 𝑓𝑏(𝑥) 를 가설이라고 부른다.

좋은 가설은 오차가 작은 가설이며 회귀 분석은 데이터를 설명하는 좋은 가설을 찾는 것이라고 볼 수 있다.

회귀 분석에서는 일반적으로 두 가지 가설을 세우게 된다.

- 영가설(

H0,Null Hypothesis)

입력 변수와 출력 변수 사이에 관계가 없다. - 대립가설(

H1,Alternative Hypothesis)

입력 변수와 출력 변수 사이에 관계가 있다.

🤔 레이블(Label) 이란 ?

- 데이터에 제시된 목표값을 정답값 또는 레이블이라 칭한다.

→ 지도 학습은 주어진 입력-출력의 쌍을 학습한 후에 새로운 입력값이 들어왔을 때, 합리적인 출력 값을 예측하는 것이다.

일반적인 프로그래밍

→ 사람이 함수 𝑓(x) 를 고안하여 구현한 뒤 입력 x를 넣어 답 y를 얻는 것이다.

머신러닝

→ 데이터 (x, y)를 주면 함수 𝑓(x)를 만들어내는 일이다.

선형 회귀 (Linear Regression)

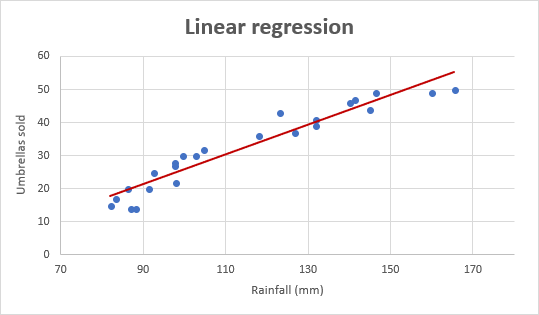

선형 회귀

- 주어진 데이터 포인트들 간의 선형적인 관계를 모델링하는 지도 학습 알고리즘이다.

선형 회귀 알고리즘을 통해 입력 변수(X) & 출력 변수(Y) 사이의 관계를 파악하고,

새로운 입력 값에 대한 출력 값을 예측할 수 있다.

지도 학습 알고리즘의 대표적인 두 유형은 회귀 분석과 분류이다.

✅ 두 알고리즘의 차이점?

| 회귀 분석 | 입력 데이터 하나 하나에 대응하는 출력 값을 예측한다. |

|---|---|

| 분류 (Classfication) | 입력 데이터를 몇 가지 이산적인 범주(Category) 중의 하나로 대응한다. |

-

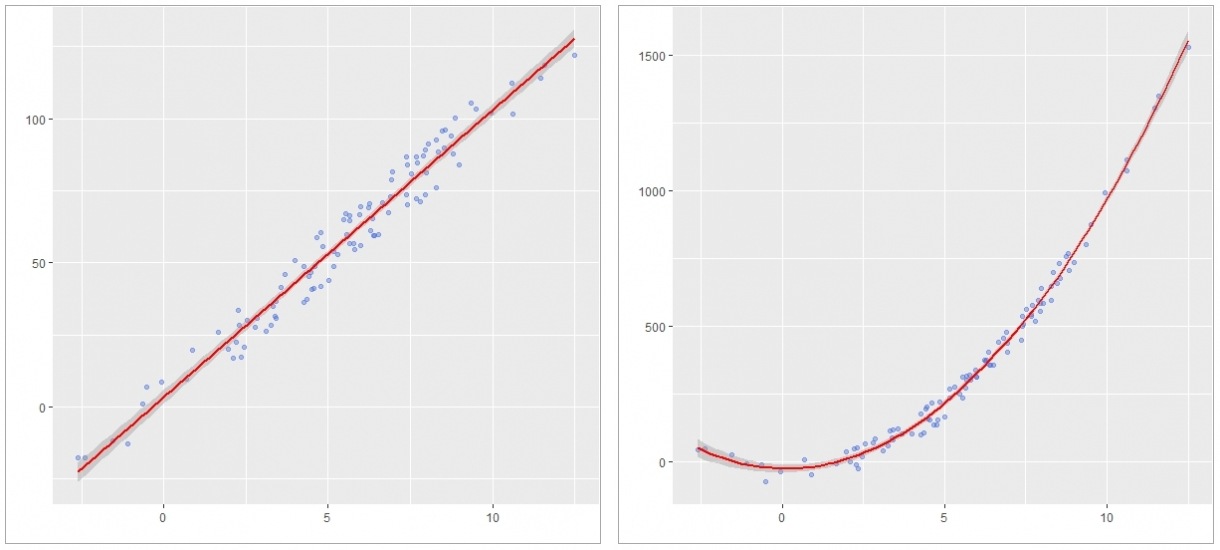

회귀 분석

데이터를 설명할 수 있는 직선을 찾는 선형 회귀와 곡선을 찾는 비선형 회귀로 구분된다. -

이진 분류 (Binary Classfication)

데이터를 양분하는 경계 직선이다.

데이터를 학습시킬 때, 데이터에서 중요한 일부 정보만을 추출해 이를 토대로 학습시키고 테스트할 수도 있다.

특징(Feature)

🤔 특징(Feature) 이란?

관찰되는 현상에서 측정할 수 있는 개별적인 속성을 의미한다.

𝑦 = 𝑓(𝑥) 의 함수를 찾는다고 할 때, 입력 매개변수로 사용되는 𝑥가 특징이다.

다음은 머신러닝에서 다룰 수 있는 특징의 예시이다.

- 사람의 키와 몸무게

- 강아지의 몸통 길이 & 높이

- 주택 가격에 영향을 주는 주택의 특징들(층고 & 방의 크기 등)

선형 회귀 모델의 성능 평가

데이터를 추정하는 가설이 얼마나 정확한지를 평가하는 방법에는 여러 가지가 있다.

가설이 훌륭한 모델일 경우, 데이터는 가설이 나타내는 직선 위에 모두 놓이게 될 것이다.

선형 회귀 모델의 성능 평가에는 여러 지표가 사용될 수 있다.

대표적인 지표로는 다음과 같다.

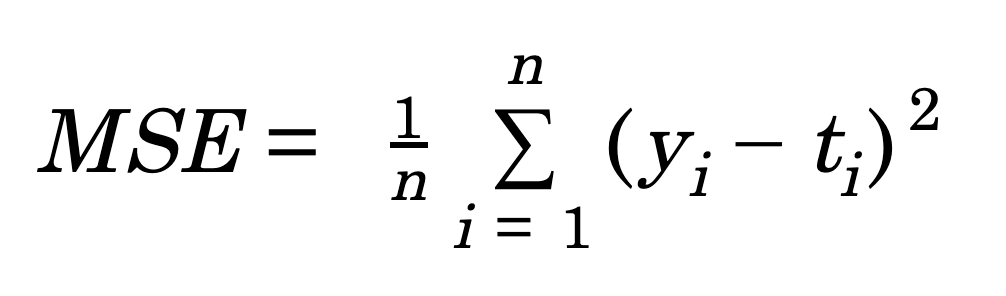

- 평균 제곱 오차 (Mean Squared Error, MSE)

n: 데이터 샘플의 개수Yi: i 번째 데이터 샘플의 실제 값Y^i: i 번째 데이터 샘플의 예측 값

평균 제곱 오차 값이 낮을수록 모델의 예측 성능이 높다고 할 수 있다.

이는 모델이 예측한 값과 실제 값 사이의 오차가 작다는 의미이며, 모델의 정확도가 높아졌다는 것을 나타낸다.

MSE의 단점으로는, 예측값과 실제값 사이의 차이를 제곱해 계산하므로 오차의 크기에 제곱에 비례하여 더 큰 영향을 받는다는 점이 있다.

이러한 단점을 보완하기 위해 평균 절대 오차(MAE)를 사용하기도 한다.

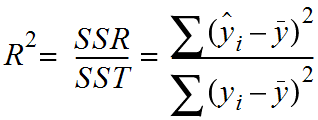

- 결정 계수 (Coefficient of Determination, R-squared)

📣 요약

- 회귀란?

주어진 입력 변수와 출력 변수 사이의 관계를 모델링하는 기술이다.

- 회귀 분석?

데이터를 설명하는 선형 함수를 찾는 선형 회귀와 비선형 함수를 찾는 비선형 회귀로 구분된다.

- 가설?

선형 회귀에서 데이터를 설명하기 위한 함수.

선형 회귀가 좋은 가설을 찾기 위해서는 입력에 대응하는 정답 출력을 레이블로 제공 해야한다.

회귀 모델은 가설의 출력과 레이블(목표치)을 비교해 얻은 오차를 줄이는 방식으로 가설을 개선하여 나간다.

- 지도학습?

레이블(목표치)에 근거하여 더 나은 가설을 찾아가는 방식의 학습.

- 평균 제곱 오차(MSE) ?

최적의 파라미터를 찾기 위한 과정에서 흔히 사용되는 오차값을 줄이기 위한 방법중 하나이다.

- 최적의 파라미터?

모델의 학습 과정에서 최적화 알고리즘을 통해 찾아낸 최상의 모델 파라미터를 의미한다.

모델 파라미터는 모델의 학습 과정에서 최적화 대상이 되는 값이므로, 이 값들을 조정해 모델의 예측 성능을 최적화 할 수 있다.

여기서, 가설의 동작을 결정하는 파라미터는 선형 방정식의 계수들이다.