KNN Classifier

- 지도학습 머신러닝 알고리즘

- 유사도 개념만으로 분석 가능하다.

- 새로운 데이터가 입력되면 그 데이터 주변의 가장 가까운 K개의 훈련데이터의 레이블을 확인하고, 가장 많이 보이는 라벨로 분류

- 분류가 가능하도 K는 홀수로 설정하는 것이 좋다.

- K가 작으면 노이즈에 민감하게 반응하는 과적합의 문제가 발생한다.

- K가 크면 노이즈의 영향이 줄어들지만 항목 간 경계가 불분명하다.

- 훈련 단계가 매우 빠르지만 데이터가 많아지면 분류 단계가 느려진다.

KNN 알고리즘 실습

- KNN알고리즘 실습 내용은 '혼자 공부하는 머신러닝+딥러닝'책을 이용하였다.

- 데이터 준비

import numpy as np

import matplotlib.pyplot as plt # 그래프 그리기 위함

# 생선을 분류하기 위해 두 가지 생선의 데이터를 준비한다.

# 35마리의 도미(bream) 데이터와 14마리의 빙어(smelt)데이터를 준비

bream_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0, 31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0, 35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0]

bream_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0, 500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0, 700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0]

smelt_length = [9.8, 10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

smelt_weight = [6.7, 7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]

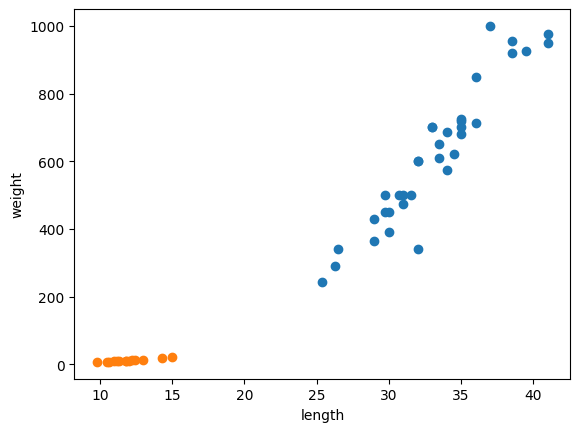

# 데이터가 어떻게 분포하는 지 보기 위해 산점도를 그려보았다.

plt.scatter(bream_length, bream_weight)

plt.scatter(smelt_length, smelt_weight)

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

산점도를 그려보니 주황색은 빙어, 파란색은 도미로 두 그룹이 극명하게 나뉘어진 것을 확인할 수 있다.

# 도미와 빙어의 길이, 무게의 특성을 합쳐 하나의 리스트로 생성

length = bream_length+smelt_length

weight = bream_weight+smelt_weight

# 이 두 특성을 묶어서 도미와 빙어를 설명하는 데이터셋으로 만든다.

# zip 함수는 나열된 리스트에서 원소를 각각 하나씩 꺼내온다.

fish_data = np.array([[l, w] for l, w in zip(length, weight)])

# 도미와 빙어의 특성을 순서대로 합쳤기 때문에 위의 35개는 도미이고, 나머지는 빙어일 것이다.

# 도미-1, 빙어-0로 하여 target 생성

fish_target = np.array([1] * 35 + [0] * 14)

from sklearn.neighbors import KNeighborsClassifier

kn = KNeighborsClassifier()

kn.fit(fish_data, fish_target) # 알고리즘 훈련

kn.score(fish_data, fish_target) # 1.0

# 훈련이 잘 되었는지 평가하기 위해 score 사용

# K를 49로 바꾸면 전체이고, 새로운 데이터가 오면 다수인 1로 예측한다.

kn49 = KNeighborsClassifier(n_neighbors=49)

kn49.fit(fish_data, fish_target)

kn49.score(fish_data, fish_target) # 0.7143

print(35/49) # 0.7143새로운 데이터를 예측해보자

print(kn.predict([[25.0,150.0]])) # 0으로 예측

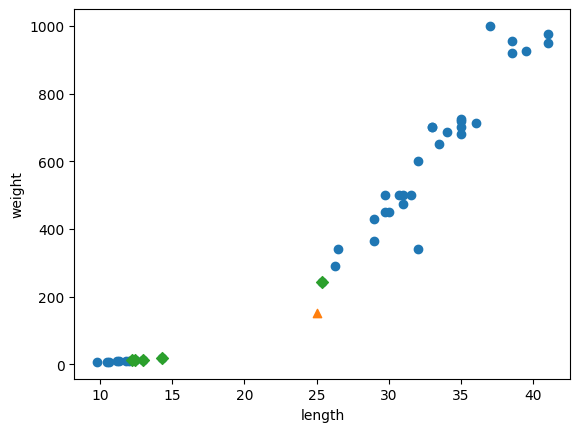

distances, indexes = kn.kneighbors([[25, 150]])

plt.scatter(fish_data[:,0], fish_data[:,1])

plt.scatter(25, 150, marker='^')

plt.scatter(fish_data[indexes, 0], fish_data[indexes, 1], marker='D')

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

n_neighbors의 기본값은 5이므로 새로운 데이터에서 가까운 5개의 이웃을 찾아준다. 산점도를 보면 도미에 더욱 가까울 것 같지만 가까운 이웃으로 도미는 1개, 빙어는 4개가 뽑혔다. 실제로 거리를 출력해보자.

print(distance)

# [[ 92.00086956 130.73859415 137.17988191 138.32150953 138.39320793]]

# indexes를 확인해보면 처음 값이 도미와의 거리이고, 나머지는 빙어와의 거리임을 알 수 있다.

# 산점도를 보았을때 도미가 가까워 보이지만 K값으로 안 뽑힌 것은 length와 weight의 범위가 다르기 때문이다.

# y축으로 조금만 멀어져도 실제 거리는 아주 크게 증가한다.

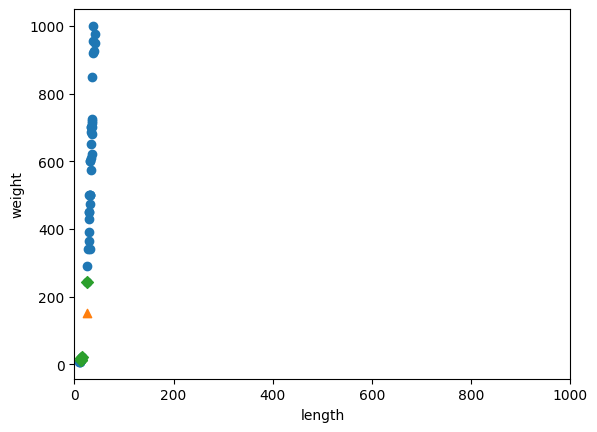

plt.scatter(fish_data[:,0], fish_data[:,1])

plt.scatter(25, 150, marker='^')

plt.scatter(fish_data[indexes, 0], fish_data[indexes, 1], marker='D')

plt.xlim((0, 1000))

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

xlim,ylim은 x축과 y축의 범위를 제한할 수 있는 함수로 x축과 y축의 범위를 똑같이 했을 때 x축의 변화는 미세한 것으로 나타난다.

이처럼 두 특성값의 범위가 극명하게 다른 경우 두 특성의 스케일이 다르다고 말한다.

그렇기 때문에 데이터 전처리 과정에서 scailing과정이 매우 중요하다는 것을 알 수 있다.