Papers

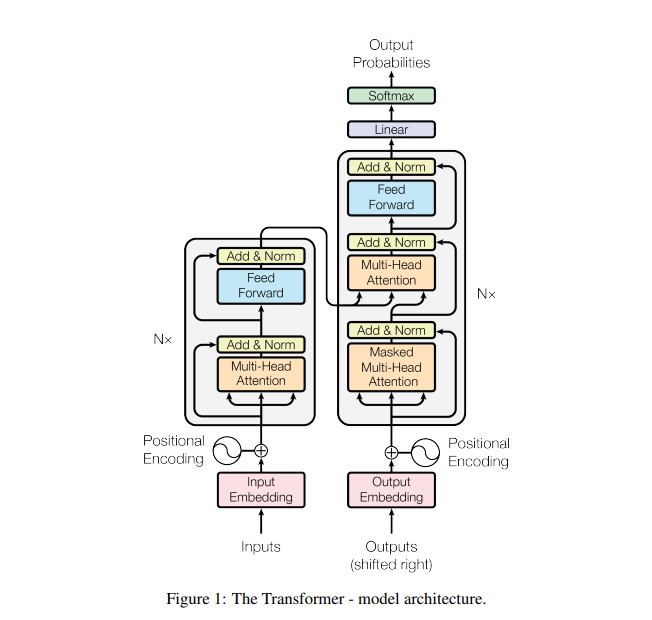

1.[논문 리뷰] Attention Is All You Need ❗

Summary 💡 기존의 복잡한 RNN, CNN 기반의 sequence data 처리 방식 및 한계에 대한 해결방안 제시 - “Transformer”

2024년 2월 2일

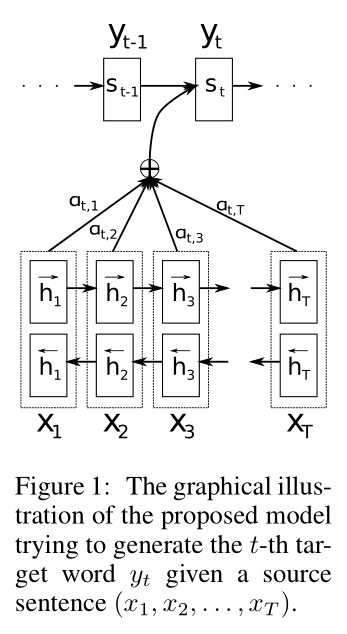

2.[논문 리뷰] Neural Machine Translation by Jointly Learning to Align and Translate 🪟

💡 기존 Encoder-Decoder 기반 텍스트 번역 시 긴 입력에 대한 성능 저하 해결방안 제시 - Variable-length Encoding & Attention Decoding by using "Context vector"

2024년 2월 7일