복습

linear regression은 세가지가 필요하다

-

Hypothesis: H(x) = Wx + b

-

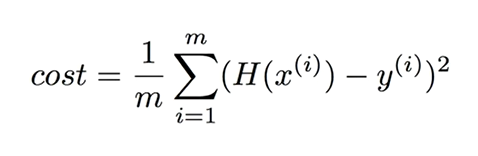

Cost function

-

Gradient descent algorithm

Multivariable linear regression

예시로, 3개의 input (x1, x2, x3)을 가진 regression을 생각해보자.

Hypothesis: H(x1, x2, x3) = w1x1 + w2x2 + w3x3 + b

-> Cost function이 너무 길어진다.

그래서 이것을 해결하기 위해, Matrix를 사용한다.

[m x n] 행렬과 [n x a] 행렬을 곱하면

[m x a]크기를 가진 행렬이 나온다.

이때 행렬의 곱셈에서는 n에 위치한 값이 서로 똑같아야 곱할 수 있다. 이에 유의하여 Matrix를 제작하면 된다.

=> H(X) = XW

(X와 W는 각각 input과 weight의 행렬)

Hypothesis with matrix는 구현에서 유용하게 사용된다.