1,2 일차 복습

학습절차

-

가중치에 값 할당

-

결과 예측

-

오차 계산

-

가중치 조정 (optimizer, 대체로 Adam 활용)

-

위의 작업 반복 (max iteration에 도달하면 끝)

Regression

딥러닝은 스케일링 필수

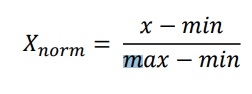

방법 1: Normalization(정규화)

모든 값의 범위를 0~1로 변환

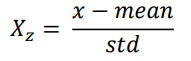

방법 2: Standardization(표준화)

모든 값을, 평균 = 0, 표준편차 = 1 로 변환

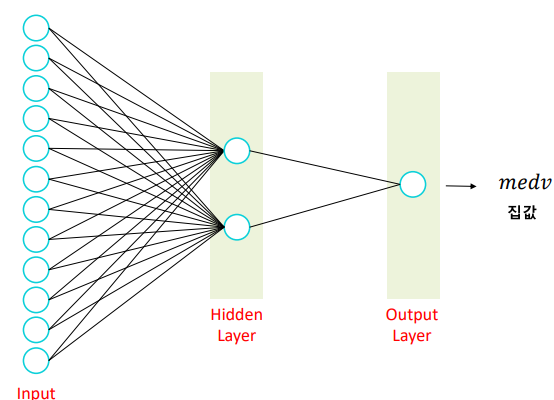

딥러닝 구조

hidden_layer

input_shape는 첫번째 layer에서만 설정

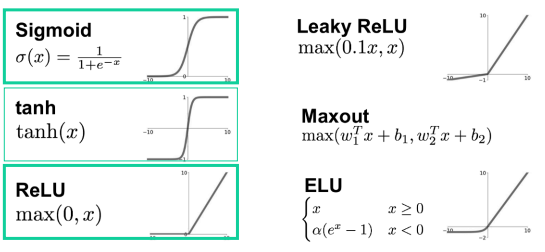

acitvation : 히든 레이어는 활성함수를 필요, 보통 'relu' 사용활성화 함수 Activation Function

Hidden Layer에서는 선형함수를 비선형 함수로 변환해 주는 역할

Output Layer에서는 결과 값을 다른 값으로 변환해 주는 역할

보통 ReLU가 국룰임

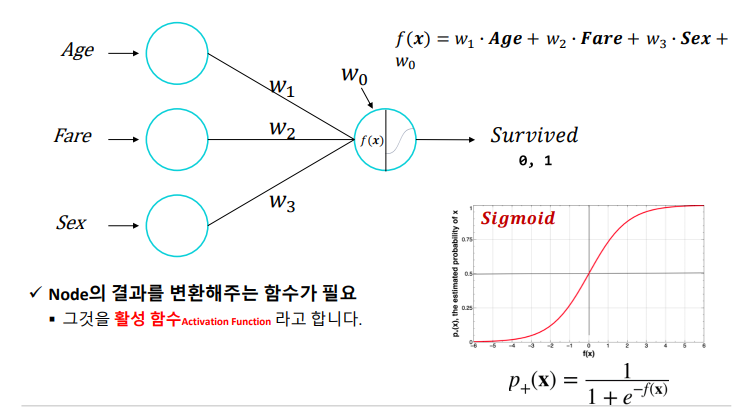

이진 분류

Output Layer에서 sigmoid 함수를 활용

loss founction에서는 binary_crossentropy를 활용한다

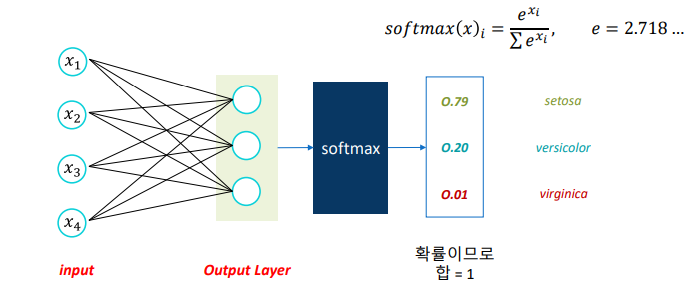

다중 분류

각 클래스 별 Output Node로 예측한 값을, 하나의 확률 값으로 변환

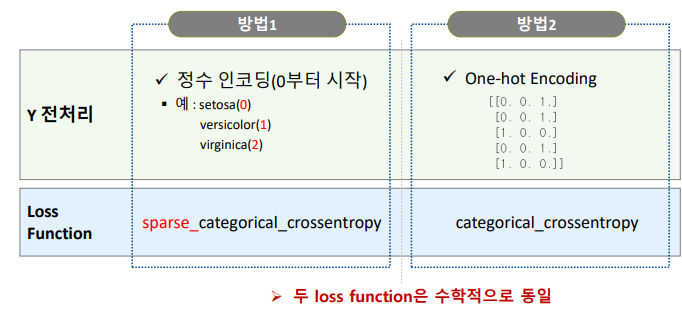

다중 분류 모델링을 위한 전처리

과거에 찍먹만 해봤던 딥러닝을 제대로 배울 수 있게 되었다. 열심히 해보자