NoiseCLR: A Contrastive Learning Approach for Unsupervised Discovery of Interpretable Directions in Diffusion Models (CVPR 2024)

논문 리뷰

목록 보기

20/21

Abstract

- GAN 기반 생성 모델들은 latent에서의 disentangle 성능으로 높게 평가되고 있으며, 이것은 이미지 편집에 있어서 핵심 아이디어가 된다.

- Diffusion도 최근 강력한 생성 능력을 보이고 있지만, latent 공간은 GAN만큼 이해되거나 연구되지 않았다.

- 최근 연구들은 text prompt에 의존하는 방식을 채택하고 있지만, 이러한 방식은 여러 분야에서는 제약이 될 수 있다.

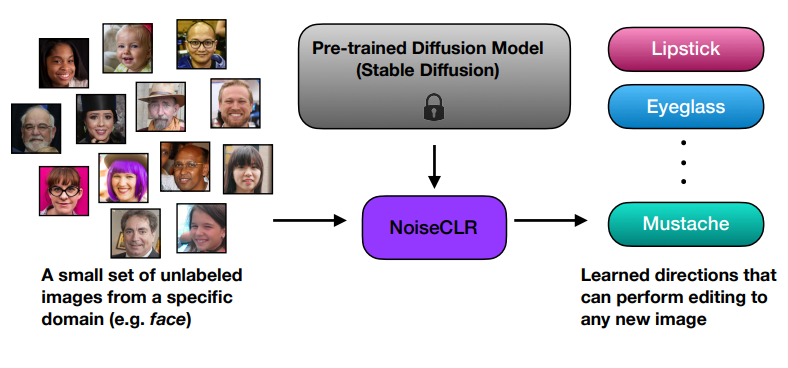

- 본 논문에서는 text-prompt없이 비지도 방식으로 latent의 semantic들을 이해하는 방식을 제안한다.

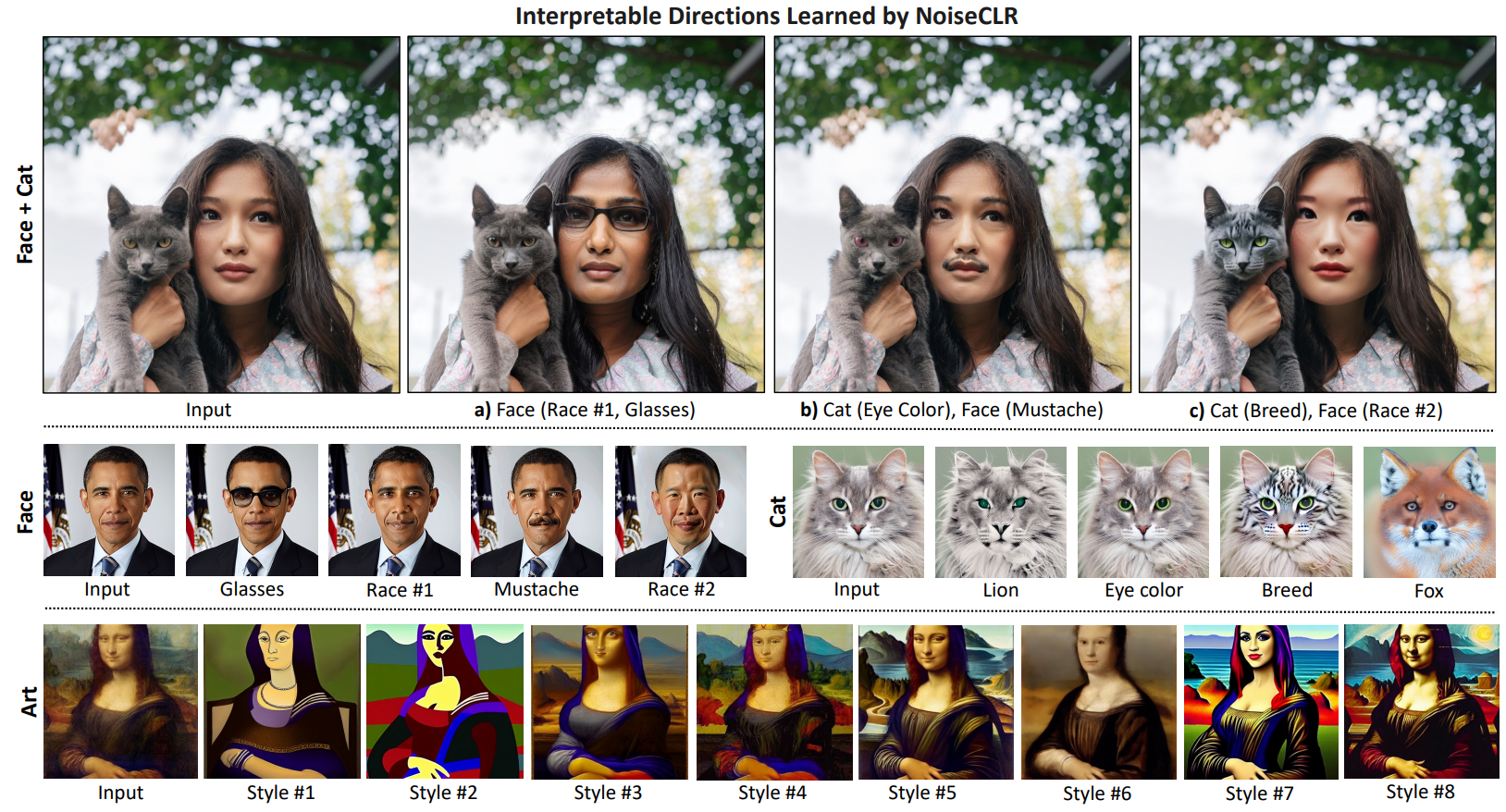

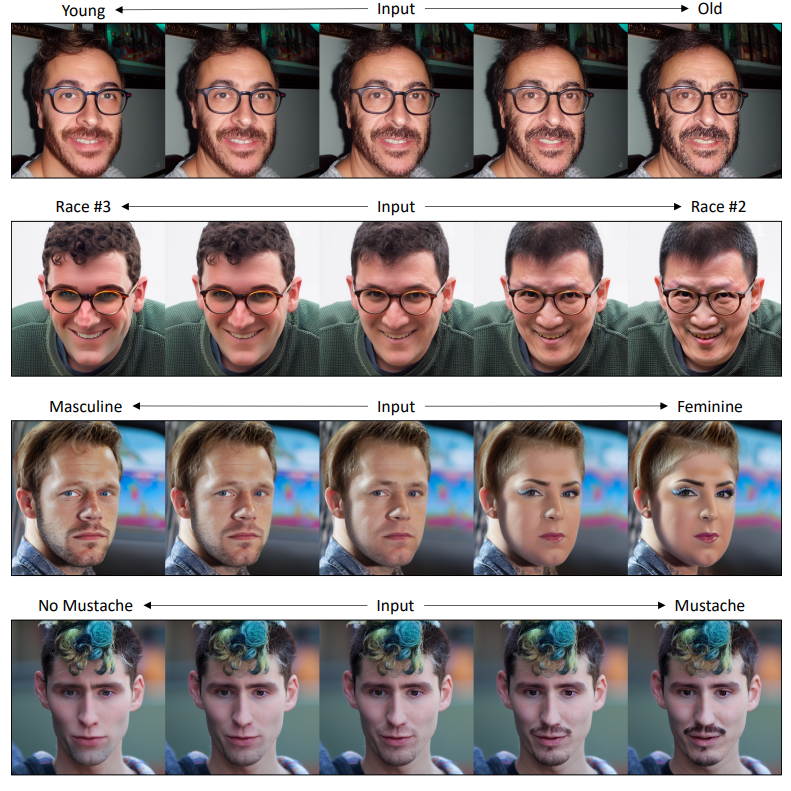

- 인풋으로 작은 크기의 unlabeled image set(서로 같은 도메인)을 받고, 이에 대한 다양한 semantic을 비지도 방식(contrastive learning 목적 함수)으로 알아낸다.

- 이렇게 알게 된 direction들을 같은 혹은 다른 도메인의 이미지에도 적용하는 것이 가능하다.

Method

- 기존의 Diffusion들은 중간중간에 noise를 바꾸어 주면서 conditioning이 가능했다.

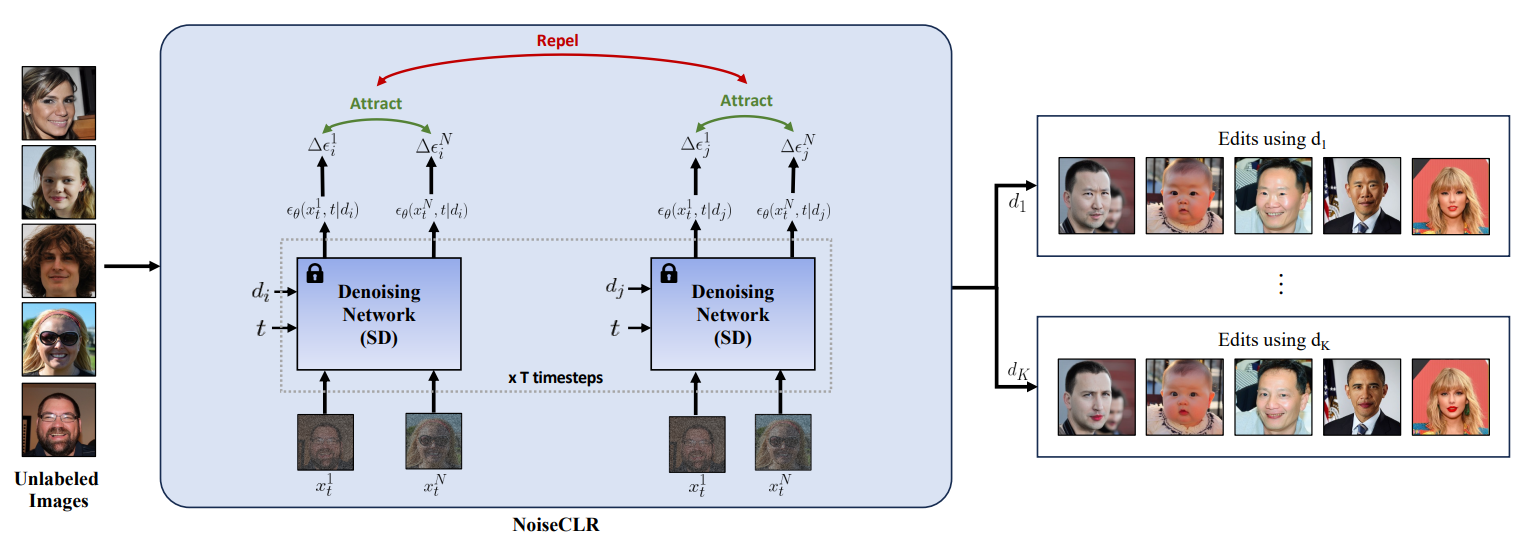

- Contrastive Learning을 통해서 K개의 sematic direction을 배우는 것이 NoiseCLR의 우선적인 목표이다.

- 즉, 같은 방향의 편집들은 서로를 끌어당기고, 다른 방향의 편집들은 서로를 밀어내게 하는 것이다.

- Direction들을 구했다면, 이를 이미지에 disentangle된 형태로 적용하는 것이 이미지 편집의 목표이다.

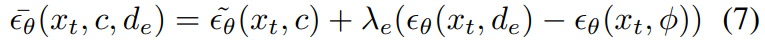

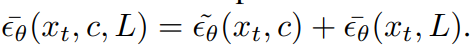

- 논문에서는 Classifier-Free Guidance 방식을 편집 방향 를 추가하여서 이것을 적용한다.

- 여기서 c는 기존의 이미지 생성을 conditioning할 때 사용된다.

- ϵθ(xt, c) − ϵθ(xt, ϕ)는 condition c로 인해 인코딩된 semantic 정보를 인코딩하는 것으로 미루어 보았을 때, ϵθ(xt, de) − ϵθ(xt, ϕ) 식을 추가하여서 각 timestep에 노이즈를 전개하는 방식을 채택한다.

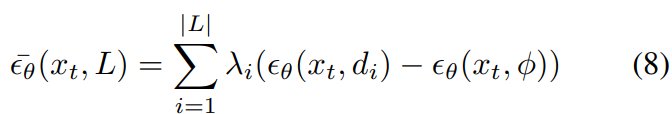

- Multiple Direction으로 편집을 하기 위해서 위 식과 같이 사용한다.

- timestep t에 대한 전반적인 노이즈 예측의 식은 위와 같다.

Experiments

- scale parameter을 통해서 이렇게 강도 조절이 가능하다.