일반화(generalization)

- 테스트데이터에서 만들어내는 오차를 일반화 오차라 부른다.

- 훈련데이터에서와같이 테스트데이터에서도 좋은 성능을 내는 모델은 일반화가 잘 된 모델이라고 부른다.

- 모델이 너무 훈련데이터에 과하게 학습(과적합)을 하지 않도록 하는 많은 일반화 방법들이 존재한다.

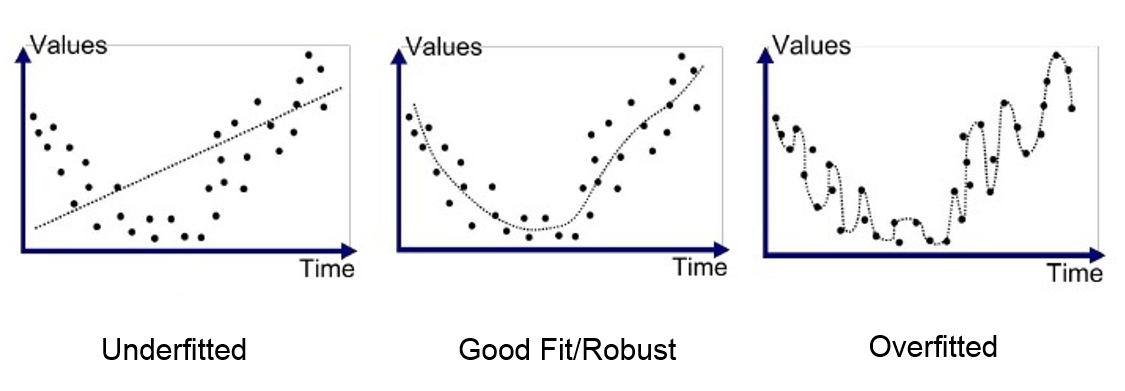

과적합 ( Overfitting )

모델이 훈련데이터에만 특수한 성질을 과하게 학습해 일반화를 못해 결국 테스트데이터에서 오차가 커지는 현상

과소적합 ( Underfitting )

훈련데이터에 과적합도 못하고 일반화 성질도 학습하지 못해, 훈련/테스트 데이터 모두에서 오차가 크게 나오는 경우

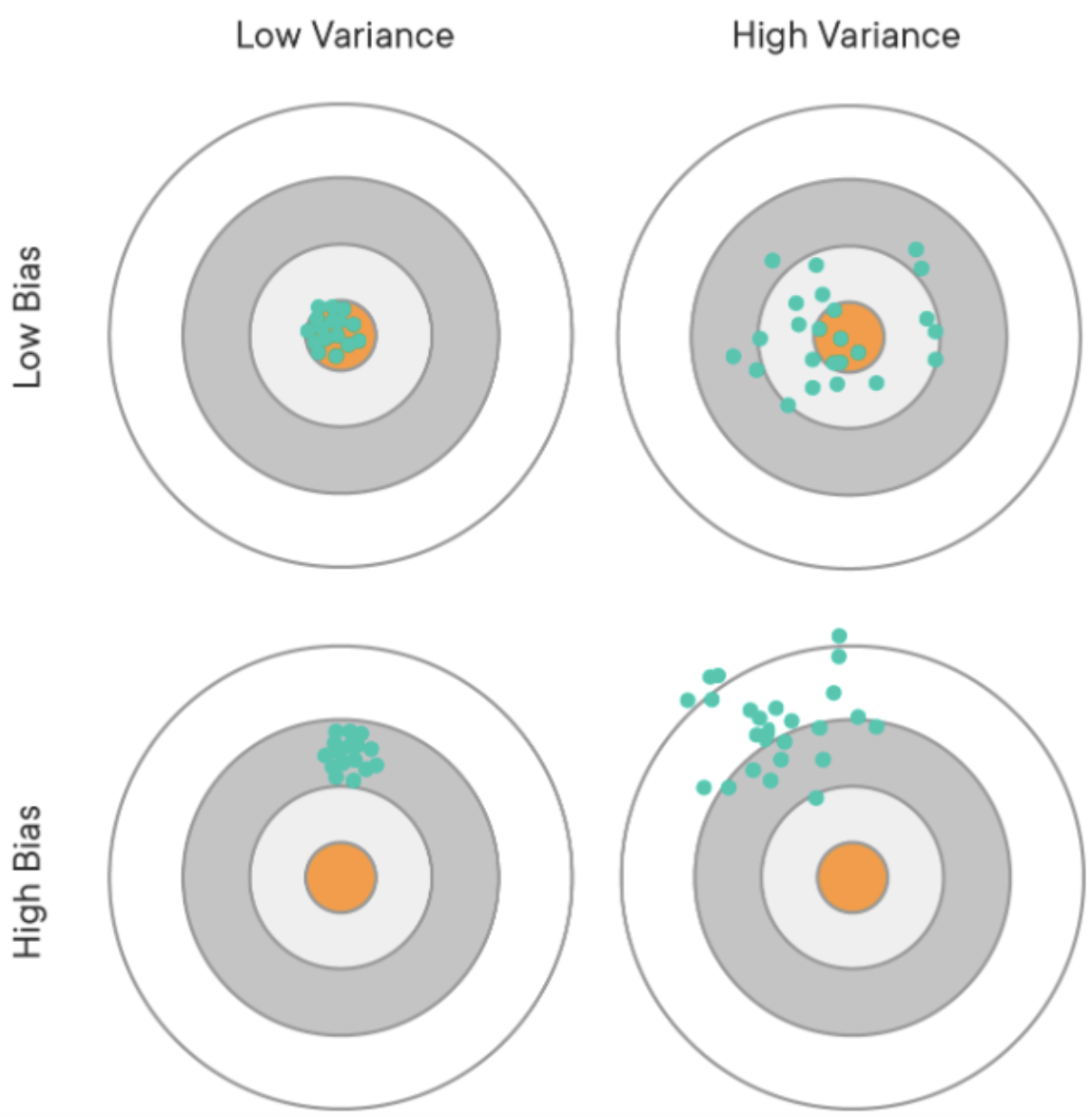

분산/편향 트레이드오프

과/소적합은 오차의 편향(Bias)과 분산(Variance)개념과 관계가 있다.

-

분산이 높은 경우 : 모델이 학습 데이터의 노이즈에 민감하게 적합하여 테스트데이터에서 일반화를 잘 못하는 경우. 즉 과적합 상태

-

편향이 높은 경우 : 모델이 학습 데이터에서, 특성과 타겟 변수의 관계를 잘 파악하지 못한 경우. 즉 과소적합 상태