안녕하세요! LLaVA 논문 리뷰 시리즈의 대장정을 마무리하는 마지막 편입니다.

지난 포스팅들을 통해 우리는 LLaVA가 어떻게 데이터를 모았고, 어떤 구조로 만들어졌으며, 어떻게 훈련되었는지 살펴봤습니다. 이제 가장 궁금한 부분이 남았죠.

"그래서, LLaVA가 얼마나 똑똑한데?" 🤔

이번 포스팅에서는 LLaVA의 실제 성적표(실험 결과)를 낱낱이 파헤쳐보고, 연구진이 솔직하게 고백한 한계점(Limitations)까지 깊이 있게 들여다보겠습니다.

📝 논문 정보

- Title: Visual Instruction Tuning (LLaVA)

- Link: https://arxiv.org/abs/2304.08485

1. 실험 결과: 얼마나 잘할까? (Experiments)

연구진은 LLaVA의 능력을 검증하기 위해 두 가지 핵심 질문을 던졌습니다.

- 일상 대화 능력: "챗봇으로서 얼마나 말을 잘 통하고 유용한가?" (LLaVA-Bench)

- 전문 추론 능력: "과학 문제 같은 전문적인 지식도 풀 수 있는가?" (ScienceQA)

💬 다중 양식 챗봇 성능 (Multimodal Chatbot)

이 모델을 평가하기 위해 연구진은 LLaVA-Bench라는 자체 데이터셋을 만들었습니다. 평가 방식이 아주 흥미로운데요, 바로 텍스트 모델인 GPT-4를 심판(Judge)으로 앉혀놓고 채점을 시킨 것입니다.

📊 (1) 아는 영역에서의 실력: LLaVA-Bench (COCO)

먼저, 학습 때 사용했던 도메인(COCO)과 유사한 이미지들로 테스트를 진행했습니다.

| Model | Conversation | Detail Description | Complex Reasoning | Overall (Avg) |

|---|---|---|---|---|

| LLaVA | 83.1% | 75.3% | 96.5% | 85.1% |

- GPT-4 수준에 근접: LLaVA는 텍스트 기반 GPT-4가 가진 지식 대비 85.1% 수준의 성능을 보여줬습니다.

- 놀라운 추론 능력: 특히 주목할 점은 복잡한 추론(Complex Reasoning) 점수입니다. 무려 96.5%를 기록했는데요, 이는 LLaVA가 단순히 "고양이가 있다"고 묘사하는 수준을 넘어, "고양이가 식탁 위에 있으니 곧 음식을 훔쳐 먹을 수도 있겠다"는 식의 논리적 상황 파악이 가능하다는 뜻입니다.

📊 (2) 모르는 영역에서의 실력: LLaVA-Bench (In-the-Wild)

진짜 실력은 처음 보는 문제에서 나오는 법이죠. 학습 데이터에 없던 뉴스, 야외 풍경, 밈(Meme) 등 완전히 새로운 이미지를 보여줬을 때의 결과입니다.

| Model | Overall Score (vs GPT-4) | 비고 |

|---|---|---|

| LLaVA | 67.3% | 복잡한 추론 항목은 81.7% 달성 |

| BLIP-2 | 38.1% | LLaVA보다 한참 뒤처짐 |

| OpenFlamingo | 19.1% | LLaVA와 비교 불가 |

- 압도적인 격차: 기존의 강력한 경쟁자였던 BLIP-2나 OpenFlamingo를 가볍게 따돌렸습니다.

- 일반화된 지능: 처음 보는 이미지에서도 복잡한 추론(81.7%) 점수가 높게 나왔습니다. 이는 LLaVA가 데이터를 단순히 암기한 게 아니라, Visual Instruction Tuning을 통해 '보는 법'과 '생각하는 법'을 제대로 배웠음을 증명합니다.

🧪 ScienceQA: 최고 성능(SoTA) 달성

LLaVA의 진가는 전문 지식이 필요한 ScienceQA 벤치마크에서 더욱 빛납니다. 자연과학, 사회과학, 언어과학 문제를 텍스트 혹은 이미지와 함께 풀어야 하는 까다로운 테스트입니다.

Table 7: Accuracy (%) on Science QA dataset

| Method | NAT | SOC | LAN | IMG | Average |

|---|---|---|---|---|---|

| Human (사람) | 90.23 | 84.97 | 87.48 | 87.50 | 88.40 |

| GPT-4 (Text-only) | 84.06 | 73.45 | 87.36 | 70.75 | 82.69 |

| MM-CoT (Large) | 95.91 | 82.00 | 90.82 | 88.80 | 91.68 |

| LLaVA | 90.36 | 95.95 | 88.00 | 88.00 | 90.92 |

| LLaVA+GPT-4 | 91.56 | 96.74 | 91.09 | 88.99 | 92.53 |

(NAT: 자연, SOC: 사회, LAN: 언어, IMG: 이미지 포함 문제)

🏆 주요 성과 포인트

- GPT-4를 이긴 눈: 텍스트 전용 GPT-4는 이미지를 볼 수 없어 이미지 문제(IMG)에서 70%대에 머물렀지만, LLaVA는 88.00%를 기록했습니다. 단일 모델만으로도 강력한 성능을 입증했죠.

- 사회과학 천재: 사회과학(SOC) 분야에서는 95.95%라는 경이로운 점수를 기록하며 기존 모델들을 압도했습니다.

- 최강의 듀오 (LLaVA + GPT-4): 연구진은 재미있는 앙상블 기법을 도입했습니다. LLaVA와 GPT-4가 서로 다른 답을 내놓으면, GPT-4를 '판사'로 세워 다시 한번 검토하게 한 것이죠. 그 결과 92.53%라는 세계 최고 기록(SoTA)을 달성하며 인간의 평균 점수(88.40%)를 훌쩍 뛰어넘었습니다.

2. 데이터 레시피의 비밀 (Ablation Study)

"도대체 뭘 먹였길래 이렇게 똑똑해진 걸까요?"

연구진은 데이터의 종류를 바꿔가며 성능 변화를 실험했습니다.

| 데이터 구성 | 성능 변화 (Accuracy %) | 분석 |

|---|---|---|

| Conversation Only | 약 73.8% | 평범한 대화만으로는 똑똑해지기 어렵습니다. |

| Detail + Complex Reasoning | 81.9% | '자세한 묘사'와 '추론'을 배우자 성적이 쑥 오릅니다. |

| All Mixed | 85.1% (Best) | 편식은 금물! 세 가지를 골고루 섞었을 때 시너지가 폭발합니다. |

🔑 핵심: 단순히 데이터 양이 중요한 게 아닙니다. 다양한 유형의 지시(Instruction)를 골고루 섞어서 가르치는 것이 모델의 지능을 높이는 비결이었습니다.

3. 가르치지 않아도 해냈다? (Emergent Behaviors)

LLaVA는 훈련 과정에서 의도적으로 가르치지 않은 능력들도 보여주며 연구진을 놀라게 했습니다.

- 🎨 스케치 코딩: 대충 그린 웹사이트 스케치를 보여주면, 즉시 작동하는 HTML/JS 코드를 짜줍니다. (GPT-4V에서 보던 그 기능입니다!)

- 🤣 밈(Meme) 판독기: 학습 데이터에 없던 '일론 머스크' 밈을 보여주자, LLM의 배경지식과 결합해 유머 포인트를 정확히 짚어냈습니다.

4. 솔직한 고백: 한계점 (Limitations)

물론 LLaVA가 만능은 아닙니다. 논문에서는 아직 해결해야 할 숙제들을 솔직하게 명시했습니다.

- 디테일 부족 (Fine-grained Perception): 숲은 잘 보지만 나무는 놓칠 때가 있습니다. 예를 들어, 냉장고 속 수많은 식재료 중 특정 요구르트 병에 적힌 작은 글씨는 잘 읽지 못합니다.

- 환각 현상 (Hallucination): 가장 치명적인 단점입니다. 이미지를 전체적인 맥락으로 보지 않고 조각(Patch)들의 집합(Bag of Patches)으로 인식할 때가 있습니다.

- 예시: 딸기는 왼쪽에, 요거트는 오른쪽에 멀리 떨어져 있는데 "딸기맛 요거트가 있네요"라고 우기는 식이죠.

- 윤리적 위험: LLaVA는 LLaMA, CLIP 등을 기반으로 만들어졌기에, 부모 모델들이 가진 편향성이나 유해한 콘텐츠 생성 위험을 그대로 물려받을 수 있습니다.

🏁 결론: 멀티모달 AI의 새로운 기준

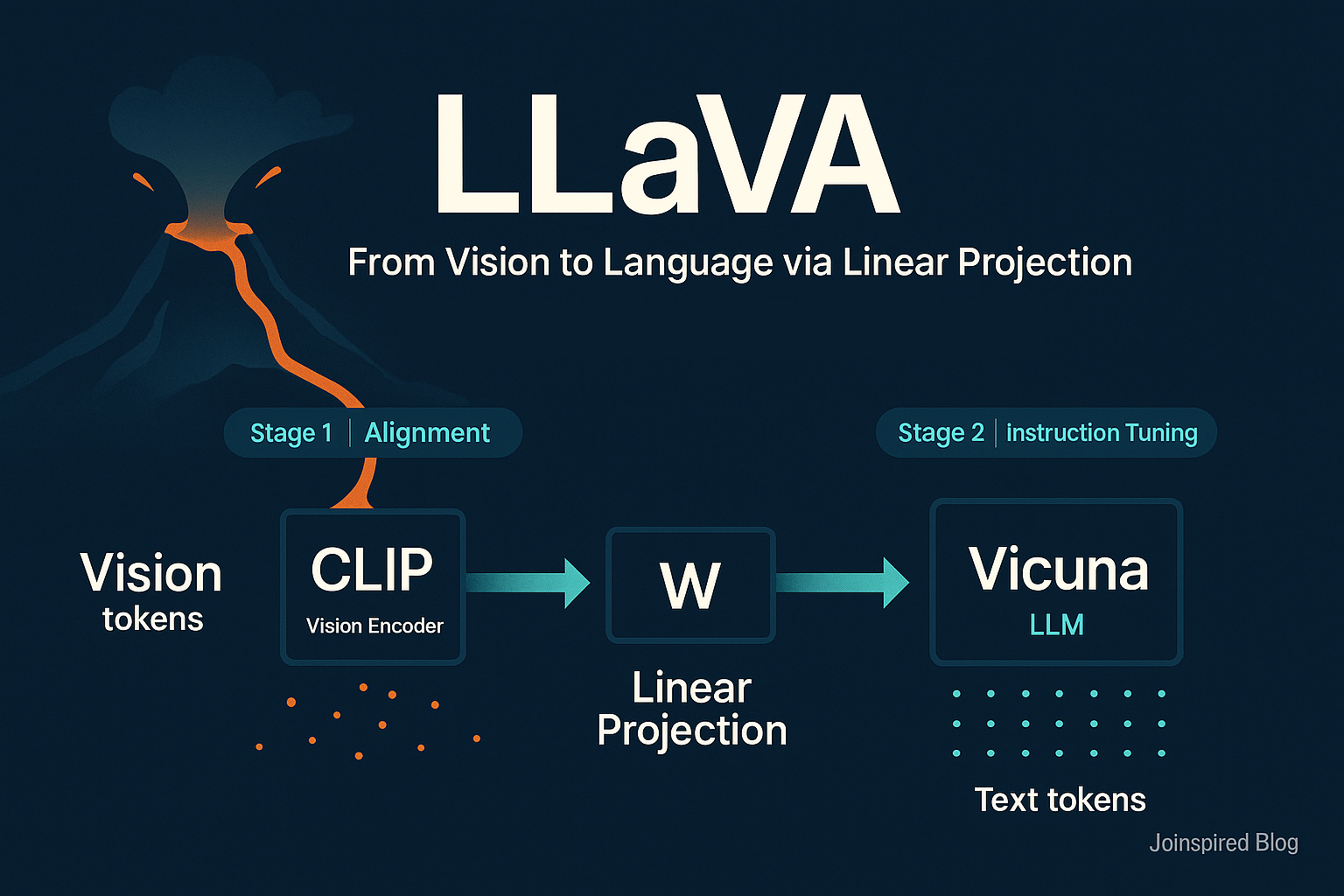

LLaVA는 Visual Instruction Tuning이라는 개념을 도입해, "언어 모델에게 시각을 달아주는 가장 효율적인 방법"을 제시했습니다.

[LLaVA가 남긴 유산 3가지]

- 데이터: GPT-4를 이용해 고품질 멀티모달 데이터를 만드는 파이프라인 구축.

- 구조: 복잡한 설계 없이 간단한 연결만으로도 강력한 성능 증명.

- 성능: 다양한 벤치마크에서 범용성을 입증하며 SoTA 달성.

LLaVA는 현재 우리가 쓰고 있는 GPT-4V나 Gemini 같은 거대 멀티모달 모델(LMM)들이 발전하는 데 아주 중요한 초석이 된 연구입니다. 앞으로 시각 모델들이 얼마나 더 똑똑해질지 기대되지 않나요?

긴 시리즈를 함께 읽어주셔서 감사합니다! 👋