MCP 하나면 다 된다고요? 정말일까요?

여러분은 이런 광고 문구를 본 적 있을 겁니다. "이 제품 하나면 다 됩니다!", "단 한 번의 클릭으로 해결!", "더 이상 고민하지 마세요!"... 그리고 대부분의 경우, 실제로는 그렇게 마법같은 일이 일어나지 않죠. 하지만 이번만큼은 예외인거 같습니다. 그 정체는 바로 MCP(Model Context Protocol)입니다.

"이제 MCP로 LLM에 전달할 외부 API를 규격화하세요!"

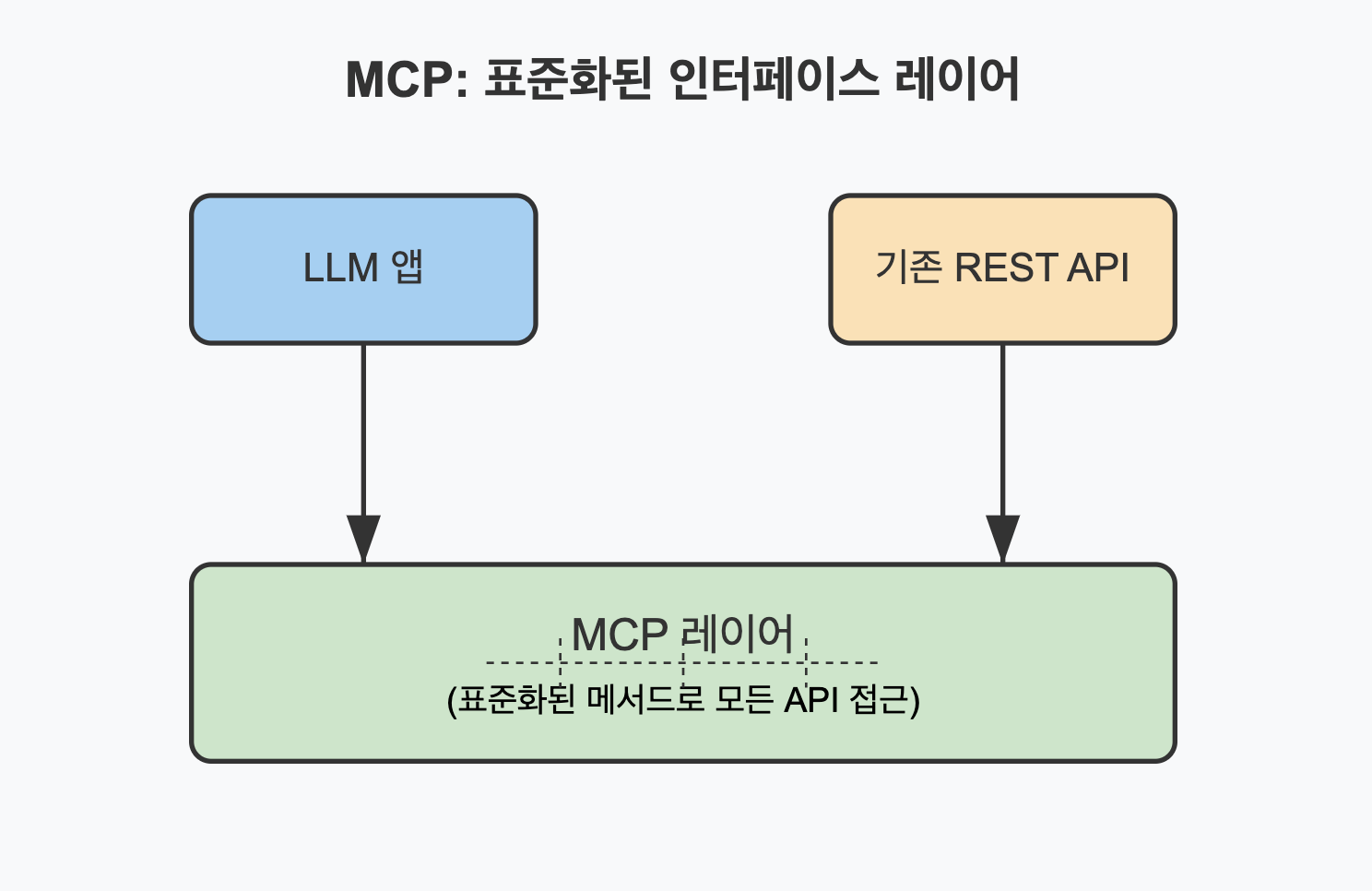

Anthropic 주도로 개발되고 오픈소스로 공개된 MCP는 마치 AI계의 USB-C 포트처럼 소개되고 있습니다. 다양한 기기를 표준화된 방식으로 연결하는 USB-C처럼, MCP는 LLM에 전달하는 외부 API의 규격화된 프로토콜을 제공합니다. 이 프로토콜은 https://github.com/modelcontextprotocol 에서 SDK 형태로 제공되어, 누구나 MCP 서버나 클라이언트를 쉽게 구현할 수 있습니다.

AI계의 USB-C가 등장했다! MCP로 연결하는 새로운 AI 세상

온 세상이 MCP 서버를 오픈하고 있습니다. Cursor와 같은 코딩 툴에서는 MCP를 통해 로컬 파일 시스템에 접근하여 코드를 분석하고 자동으로 코드를 작성해주는 기능을 선보이고 있습니다. Claude 데스크탑앱도 MCP 연동을 통해 외부 API를 활용하도록 지원하고 있으며, Microsoft는 Playwright MCP 서버 코드를 직접 오픈하여 웹 테스트 자동화를 지원하고 있습니다. 점점 더 많은 도구들이 이 프로토콜을 채택하며 대세가 되어가고 있습니다.

"에이, 그게 무슨 대수라고. 기존에도 API 연동 많이 했잖아요?"

맞습니다. LLM과 외부 도구를 연결하는 방법은 이전에도 있었습니다. 하지만 각 서비스마다 API 구조가 다르고, 인증 방식이 달라 통합하는 과정이 복잡했죠. MCP의 진가는 바로 이 지점에서 빛납니다. 규격화된 프로토콜을 통해 누구나 동일한 방식으로 API를 구현하고 연결할 수 있게 된 것입니다. 개발자라면 이런 표준화의 가치를 아실 겁니다. '모든 것이 연결된' AI 에코시스템의 꿈이 MCP를 통해 한 걸음 더 가까워진 것입니다.

Cursor, Figma에서 벌써 시작된 MCP 혁명: "코드요? 자동으로 뚝딱이죠!"

예를 들어보죠. Cursor에서는 MCP를 통해 다음과 같은 대화가 가능합니다:

"내 프로젝트의 모든 Python 파일을 분석해서 중복 코드를 찾아줘"

"이 기능을 테스트하는 유닛 테스트를 작성해줘"

"이 API와 호환되는 클라이언트 코드를 자동으로 생성해줘"

MCP 서버를 통해 AI가 로컬 파일 시스템에 안전하게 접근할 수 있게 되면서, 이제 AI는 단순히 대화 상자에 붙여넣은 코드 조각이 아니라 전체 프로젝트 구조를 이해하고 맥락에 맞는 코드를 생성할 수 있게 되었습니다. 이것이 바로 개발자들이 "와, 이거 진짜 마법 같은데?"라고 반응하는 이유죠.

너무 좋아서 의심스러운 MCP, 과연 실체는?

하지만 잠깐, MCP 서버만 구현하면 LLM이 촥 하고 달라붙어서 모든 기능을 자동으로 수행할까요? 이 역할도 MCP의 몫일까요?

물론 그렇지 않습니다. MCP는 결국 '프로토콜'일 뿐입니다. USB-C 포트가 있다고 해서 모든 기기가 자동으로 모든 기능을 수행하는 것은 아니죠. 케이블은 연결만 해줄 뿐, 각 기기가 어떤 기능을 수행할지는 또 다른 문제입니다.

그렇다면 MCP의 진짜 가치는 무엇일까요? 왜 이것이 중요한 걸까요? 더 나아가, MCP는 앞으로의 개발 패러다임을 어떻게 바꿀까요? 모든 사람이 AI 개발자가 되는 세상이 올까요? 전통적인 프로그래밍 기술 없이도 자신만의 AI 도구를 만들고 연결할 수 있는 미래가 도래할지도 모릅니다.

이제부터 Model Context Protocol의 오해와 진실, 그리고 어떤 가치가 있는지 MCP의 모든 것을 하나씩 파헤쳐보며, AI의 미래가 어떻게 변화할지 함께 살펴보겠습니다.

Function Call의 사촌, MCP

잠깐만요, Function Call이 뭐였죠?

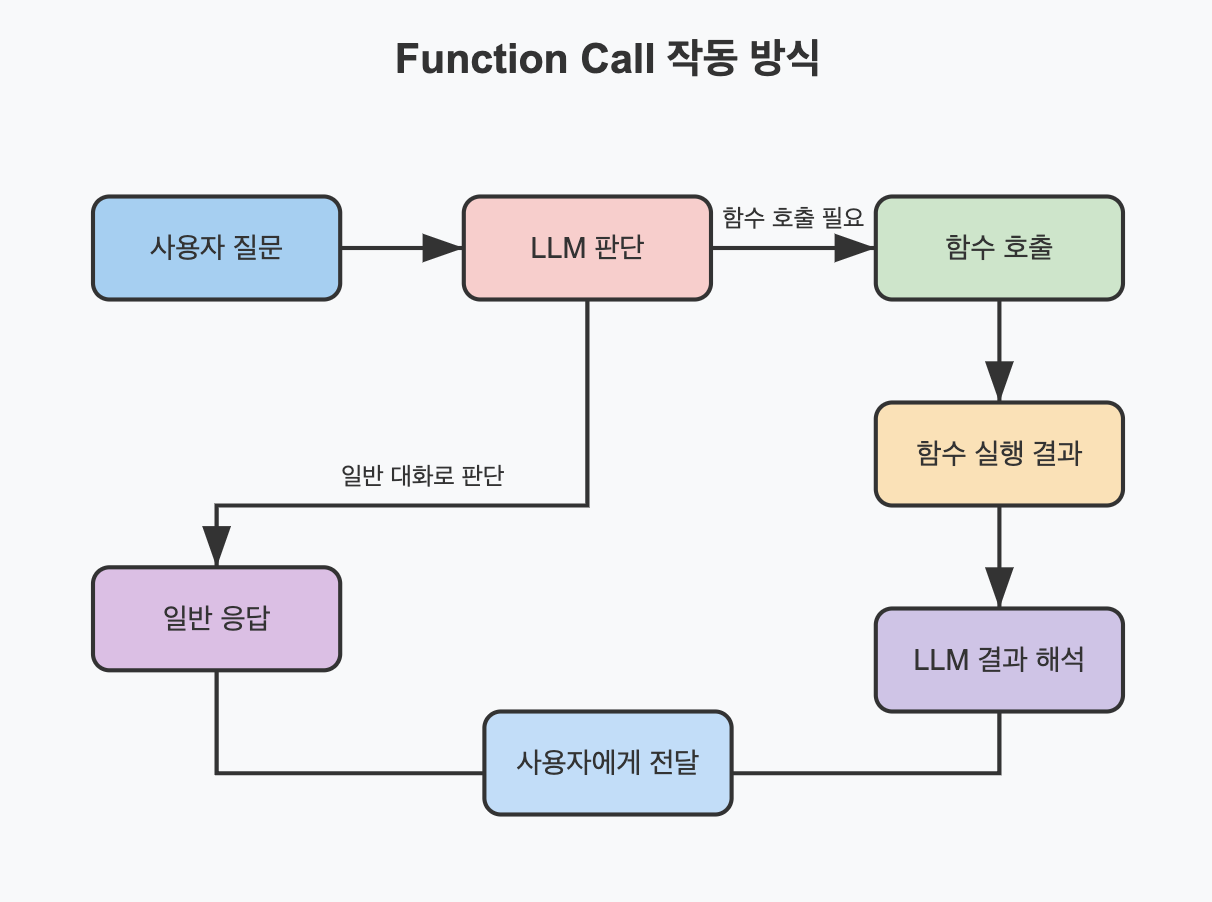

AI가 단순히 텍스트만 생성하던 시대는 지났습니다. 현대 LLM(Large Language Model)은 다양한 도구를 사용할 수 있는데, 이것이 바로 'Function Call'입니다. OpenAI가 선보인 이 개념은 AI가 특정 함수를 호출하여 외부 세계와 상호작용할 수 있게 해주었죠.

Function Call은 본질적으로 특별한 형태의 시스템 프롬프트입니다. 사용자의 질문이 들어오면 LLM은 이 질문이 Function Call을 호출해야 하는지 판단합니다. 만약 호출이 필요하다고 판단되면, LLM은 규격화된 인자(arguments)를 생성하고, 그렇지 않으면 일반적인 대화를 계속 진행합니다.

Function Call의 작동 방식을 도식화하면 다음과 같습니다:

간단한 예를 들어볼까요? OpenAI의 TypeScript SDK를 사용한 Function Call 예시입니다:

import OpenAI from 'openai';

const openai = new OpenAI({

apiKey: process.env.OPENAI_API_KEY,

});

// 함수 정의

const functions = [

{

name: 'get_weather',

description: '특정 위치의 현재 날씨 정보를 가져옵니다',

parameters: {

type: 'object',

properties: {

location: {

type: 'string',

description: '도시 이름, 예: 서울, 뉴욕, 런던',

},

},

required: ['location'],

},

},

];

// 채팅 완성 요청

async function main() {

const completion = await openai.chat.completions.create({

model: 'gpt-4',

messages: [

{ role: 'user', content: '서울의 오늘 날씨는 어때?' }

],

tools: functions,

tool_choice: 'auto',

});

// Function Call 결과 확인

const message = completion.choices[0].message;

if (message.tool_calls) {

// AI가 함수를 호출하려고 한다면

const functionCall = message.tool_calls[0];

console.log(`함수 호출: ${functionCall.function.name}`);

console.log(`매개변수: ${functionCall.function.arguments}`);

// 여기서 실제 날씨 API를 호출하고 결과를 AI에게 돌려줄 수 있습니다

} else {

// 일반 텍스트 응답

console.log(message.content);

}

}

main();이 코드에서 일어나는 일을 단계별로 살펴보면:

- 개발자는

get_weather라는 함수와 그 매개변수를 정의합니다. - 사용자가 "서울의 오늘 날씨는 어때?"라고 질문합니다.

- LLM은 이 질문을 분석하고 날씨 정보를 요청하는 것으로 판단합니다.

- LLM은

get_weather함수를 호출하기로 결정하고,location: "서울"이라는 인자를 생성합니다. - 개발자가 작성한 코드는 이 함수 호출을 감지하고, 실제 날씨 API를 호출할 수 있습니다.

- 그 결과를 다시 LLM에 전달하면, LLM은 사용자에게 적절한 응답을 생성합니다.

이것이 바로 Function Call의 핵심입니다. LLM은 사용자의 의도를 파악하여 적절한 함수를 호출하고, 개발자는 실제로 그 함수를 구현하여 외부 세계와의 상호작용을 가능하게 합니다.

👋 안녕, 나는 MCP야: Model Context Protocol의 정체 파헤치기

Function Call에 익숙해지셨다면, 이제 MCP(Model Context Protocol)를 만나볼 시간입니다. MCP는 LLM과 외부 도구 간의 통신을 표준화하는 프로토콜입니다. 그런데 이 추상적인 설명만으로는 MCP의 진짜 모습을 이해하기 어렵겠죠? 직접 코드를 살펴보며 MCP의 정체를 파헤쳐 봅시다.

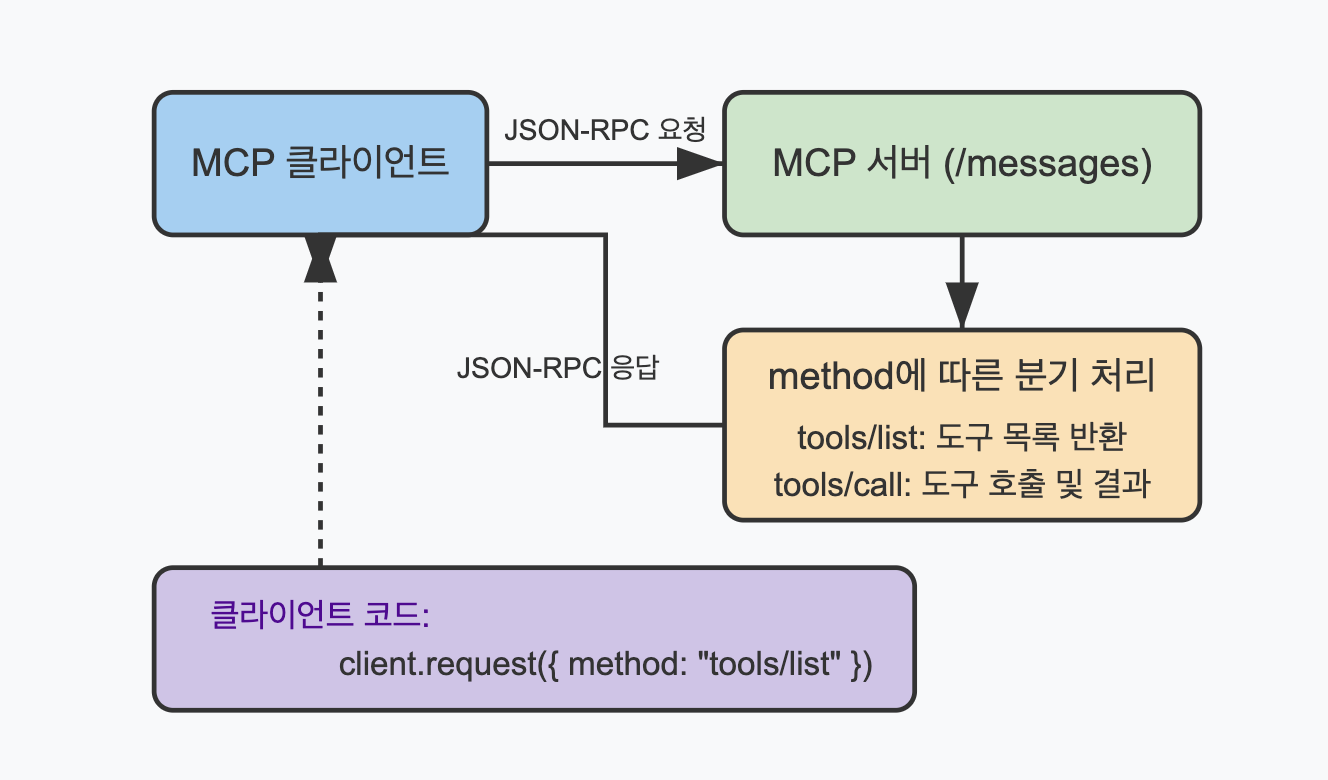

JSON-RPC: MCP의 통신 방식

MCP는 JSON-RPC 2.0 프로토콜을 기반으로 합니다. JSON-RPC란 간단히 말해 JSON 형식으로 원격 프로시저 호출(RPC)을 인코딩하는 경량 프로토콜입니다. 복잡한 말처럼 들리지만, 실제로는 매우 단순합니다:

- 클라이언트가 서버에 JSON 형식의 요청을 보냅니다

- 서버는 요청을 처리하고 JSON 형식의 응답을 반환합니다

각 요청과 응답은 다음과 같은 형태를 가집니다:

요청:

{

"jsonrpc": "2.0",

"id": "unique-request-id",

"method": "메서드 이름",

"params": { /* 매개변수 */ }

}응답:

{

"jsonrpc": "2.0",

"id": "unique-request-id",

"result": { /* 결과 데이터 */ }

}MCP는 이 JSON-RPC 형식을 사용하여 tools/list, tools/call 등의 표준화된 메서드를 정의합니다. 공식 SDK(https://modelcontextprotocol.io/introduction)를 사용하면 쉽게 구현할 수 있습니다. 이를 통해 클라이언트와 서버는 일관된 방식으로 통신할 수 있죠.

tools/list 요청 및 응답 예시

tools/list는 MCP 서버에서 사용 가능한 도구 목록을 조회할 때 사용하는 메서드입니다. 요청과 응답 형식은 다음과 같습니다:

요청:

{

"jsonrpc": "2.0",

"id": "request-123",

"method": "tools/list"

}응답:

{

"jsonrpc": "2.0",

"id": "request-123",

"result": {

"tools": [

{

"name": "readFile",

"description": "파일 내용을 읽어옵니다",

"inputSchema": {

"type": "object",

"properties": {

"path": {

"type": "string",

"description": "파일 경로"

}

},

"required": ["path"]

}

},

{

"name": "searchWeb",

"description": "웹에서 정보를 검색합니다",

"inputSchema": {

"type": "object",

"properties": {

"query": {

"type": "string",

"description": "검색 쿼리"

},

"limit": {

"type": "number",

"description": "최대 결과 수",

"default": 5

}

},

"required": ["query"]

}

}

]

}

}tools/call 요청 및 응답 예시

tools/call은 특정 도구를 호출할 때 사용하는 메서드입니다. 요청과 응답 형식은 다음과 같습니다:

요청:

{

"jsonrpc": "2.0",

"id": "request-456",

"method": "tools/call",

"params": {

"name": "searchWeb",

"arguments": {

"query": "최신 AI 기술 동향",

"limit": 3

}

}

}응답:

{

"jsonrpc": "2.0",

"id": "request-456",

"result": {

"content": [

{

"type": "text",

"text": "최신 AI 기술 동향에 관한 검색 결과:\n1. 생성형 AI의 발전과 윤리적 고려사항\n2. 자율주행 기술의 최신 동향\n3. 의료 분야에서의 AI 활용 사례"

}

]

}

}MCP 서버와 Transport 인터페이스

MCP 서버를 직접 구현한다면 어떻게 할까요? 가장 간단한 방법은 단일 엔드포인트(예: /messages)를 노출하는 API를 만드는 것입니다. 이 엔드포인트는 요청 본문(body)을 해석하여 method 필드의 값에 따라 다른 응답을 반환합니다:

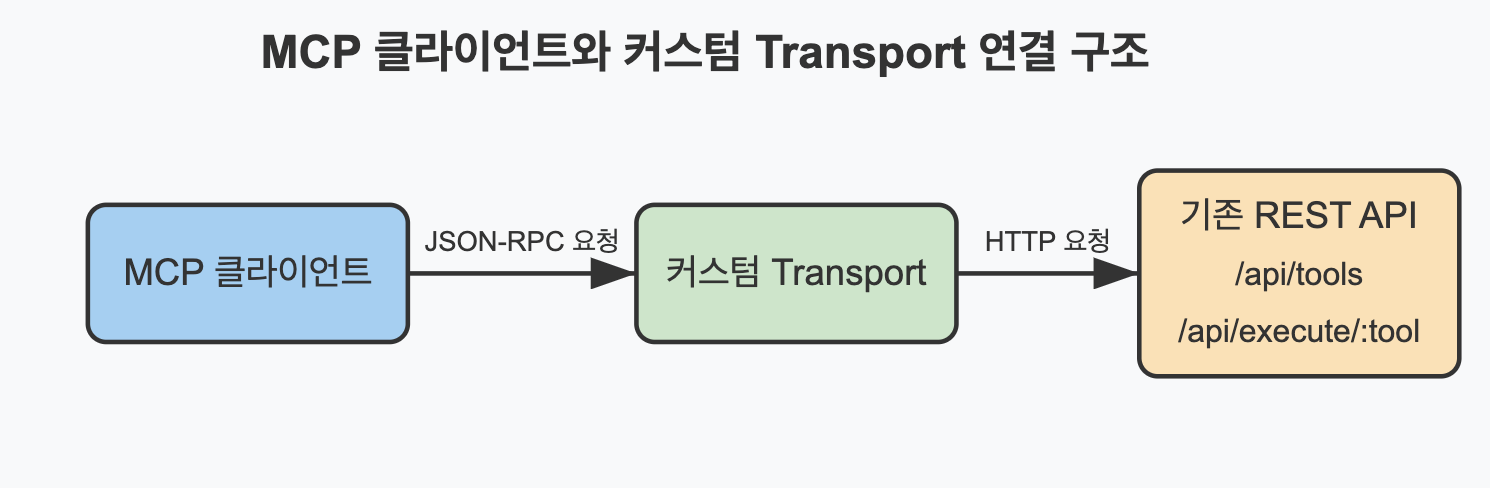

그런데 MCP 설계의 진정한 유연함은 기존 API를 새로 만들지 않고도 MCP 프로토콜에 맞게 사용할 수 있다는 점입니다. 이를 가능하게 하는 것이 바로 Transport 인터페이스입니다:

interface Transport {

// 통신 시작

start(): Promise<void>;

// JSON-RPC 메시지 전송 (요청 또는 응답)

send(message: JSONRPCMessage): Promise<void>;

// 연결 종료

close(): Promise<void>;

// 연결 종료 시 콜백

onclose?: () => void;

// 오류 발생 시 콜백

onerror?: (error: Error) => void;

// 메시지 수신 시 콜백

onmessage?: (message: JSONRPCMessage) => void;

// 세션 ID

sessionId?: string;

}이 인터페이스를 구현하면 기존 API를 MCP 프로토콜에 맞게 변환할 수 있습니다. 즉, 클라이언트는 Transport를 통해 request를 보내고, 이 Transport가 해당 요청을 적절한 API 호출로 변환하는 것입니다:

이렇게 하면 서버를 새로 구현할 필요 없이, 클라이언트 측의 Transport만으로 MCP 프로토콜을 구현할 수 있습니다.

MCP SDK 직접 사용해보기

MCP SDK를 사용하여 클라이언트를 초기화하고 서버와 통신하는 방법을 살펴봅시다:

import { Client } from "@modelcontextprotocol/sdk/client/index.js";

// 클라이언트 초기화

const client = new Client(

{ name: "my-client", version: "1.0.0" },

);

// 기존 엔드포인트를 MCP로 변환하는 Transport

class ExistingAPITransport implements Transport {

private baseUrl: string;

constructor(baseUrl: string) {

this.baseUrl = baseUrl;

}

onmessage?: (message: JSONRPCMessage) => void;

onclose?: () => void;

onerror?: (error: Error) => void;

async start(): Promise<void> {

console.log("API Transport started");

}

async send(message: JSONRPCMessage): Promise<void> {

// 요청이 아니면 무시

if (!('method' in message)) return;

const request = message as JSONRPCRequest;

try {

let response;

// 기존 API 엔드포인트로 라우팅

if (request.method === 'tools/list') {

// /api/tools 엔드포인트로 변환

response = await fetch(`${this.baseUrl}/api/tools`);

const tools = await response.json();

// MCP 형식으로 변환

if (this.onmessage) {

this.onmessage({

jsonrpc: '2.0',

id: request.id,

result: { tools }

});

}

}

else if (request.method === 'tools/call') {

const { name, arguments: args } = request.params;

// /api/execute/[도구명] 엔드포인트로 변환

response = await fetch(`${this.baseUrl}/api/execute/${name}`, {

method: 'POST',

headers: { 'Content-Type': 'application/json' },

body: JSON.stringify(args)

});

const result = await response.json();

// MCP 형식으로 변환

if (this.onmessage) {

this.onmessage({

jsonrpc: '2.0',

id: request.id,

result: {

content: [{ type: 'text', text: JSON.stringify(result) }]

}

});

}

}

} catch (error) {

if (this.onerror) this.onerror(error);

if (this.onmessage) {

this.onmessage({

jsonrpc: '2.0',

id: request.id,

error: {

code: -32603,

message: error.message

}

});

}

}

}

async close(): Promise<void> {

if (this.onclose) this.onclose();

}

}

// 기존 API를 가리키는 Transport 연결

const transport = new ExistingAPITransport("https://api.example.com");

await client.connect(transport);

console.log("Connected to existing API through MCP");

// tools/list 요청 예시

const toolsListResult = await client.request(

{ method: "tools/list" },

ListToolsResultSchema

);

console.log("Available tools:", toolsListResult.tools);

// tools/call 요청 예시

const toolCallResult = await client.request(

{

method: "tools/call",

params: {

name: "searchWeb",

arguments: {

query: "최신 AI 기술 동향",

limit: 3

}

}

},

CallToolResultSchema

);

console.log("Search result:", toolCallResult.content[0].text);서버 없이 로컬 서비스 활용하기

물론, 서버 없이 로컬에서 직접 구현체를 만들 수도 있습니다. 간단히 로컬 객체의 메서드를 MCP 도구로 노출하는 방식으로 구현할 수 있죠:

// 로컬 서비스 객체

const localServices = {

getWeather(city) {

return `${city}의 날씨는 맑음, 기온 22도입니다`;

},

translate(text, targetLang) {

return `번역된 텍스트: ${text} (${targetLang}로)`;

}

};

// 로컬 서비스를 MCP 도구로 변환하는 Transport

class LocalServicesTransport implements Transport {

async start() {}

async close() {}

async send(message) {

if (!('method' in message)) return;

const req = message;

if (req.method === 'tools/list') {

this.onmessage({

jsonrpc: '2.0',

id: req.id,

result: {

tools: [

{

name: 'getWeather',

description: '도시의 날씨 정보 조회',

inputSchema: {/* 스키마 정의 */}

},

{

name: 'translate',

description: '텍스트 번역',

inputSchema: {/* 스키마 정의 */}

}

]

}

});

}

else if (req.method === 'tools/call') {

const result = localServices[req.params.name](...Object.values(req.params.arguments));

this.onmessage({

jsonrpc: '2.0',

id: req.id,

result: { content: [{ type: 'text', text: result }] }

});

}

}

}

// 로컬 서비스 연결

const localTransport = new LocalServicesTransport();

await client.connect(localTransport);

// 이제 로컬 서비스를 MCP 도구로 호출할 수 있습니다

const weatherResult = await client.request({

method: "tools/call",

params: {

name: "getWeather",

arguments: { city: "서울" }

}

});

console.log(weatherResult.content[0].text); // "서울의 날씨는 맑음, 기온 22도입니다"MCP의 핵심 가치: 표준화된 인터페이스

MCP의 핵심 가치는 바로 여기에 있습니다. 기존에 존재하는 API나, 로컬 서비스, 또는 새로 구현한 서버 등 어떤 도구나 리소스든 Transport layer만 구현해놓으면, MCP client에서 정해진 메서드로 LLM Function Call에 필요한 내용들을 호출할 수 있습니다.

이것이 바로 '규격화'의 의미입니다. LLM이 외부 세계와 상호작용하는 방식을 일관되게 만들어 주는 것이죠. 개발자는 각 서비스마다 다른 방식의 함수 정의를 작성할 필요 없이, MCP 프로토콜만 따르면 됩니다.

Function Call을 사용할 때는 각 API마다 고유한 함수 정의를 작성해야 했지만, MCP를 사용하면 모든 도구와 리소스에 단일한 인터페이스로 접근할 수 있습니다. 이는 마치 USB 표준이 다양한 하드웨어를 연결하는 방식을 표준화한 것과 유사합니다.

MCP는 다음과 같은 이점을 제공합니다:

- 표준화된 인터페이스: 모든 도구와 리소스에 동일한 방식으로 접근할 수 있습니다.

- 유연한 구현: 서버를 새로 만들거나, 기존 API를 변환하거나, 로컬 서비스를 활용하는 등 다양한 방식으로 구현할 수 있습니다.

- LLM 독립성: 특정 LLM 제공업체에 종속되지 않고, 다양한 LLM과 함께 사용할 수 있습니다.

- 확장성: 새로운 도구나 리소스를 추가할 때도 동일한 인터페이스를 사용할 수 있습니다.

이러한 이점을 통해 MCP는 LLM과 외부 도구 간의 통신을 더욱 효율적으로 만들어 줍니다. Function Call이 첫걸음이었다면, MCP는 그 다음 단계로의 도약을 의미합니다.

MCP는 혼자서 아무것도 못해요

지금까지 MCP가 얼마나 멋진 프로토콜인지 살펴봤습니다. 표준화된 인터페이스로 외부 도구와 리소스에 접근하는 방법을 제공한다니, 정말 훌륭하죠? 하지만 이쯤에서 한 가지 중요한 사실을 짚고 넘어가야 합니다.

😈 호스트 앱은 직접 구현하셔야죠!

이쯤 되면 눈치채셨을지도 모르겠습니다. MCP에는 LLM이 없습니다. 그저 외부 리소스를 연결하는 일관된 인터페이스를 제공할 뿐이죠. 즉, LLM과의 연결, 대화 관리, 그리고 실제 도구 호출의 로직은 모두 호스트 앱에서 직접 구현해야 합니다.

다시 말해, MCP는 도구를 표준화된 방식으로 노출하는 방법을 제공하지만, 그 도구를 언제, 어떻게 사용할지는 호스트 앱의 책임입니다. 이 부분이 바로 Claude Desktop, Cursor, 그리고 다양한 AI 서비스들이 독자적으로 구현해야 하는 부분입니다.

호스트 앱에서 구현해야 하는 주요 로직을 살펴보겠습니다:

// 기본 구조

class MCPHostApp {

constructor() {

this.mcpClient = new MCPClient(); // MCP 클라이언트

this.llm = new LLMClient(); // LLM 클라이언트 (Claude, GPT 등)

}

async processUserQuery(query) {

// 1. MCP 서버에서 도구 목록 가져오기

const tools = await this.mcpClient.request({ method: "tools/list" });

// 2. LLM에 도구 목록 전달하고 쿼리 처리 요청

const llmResponse = await this.llm.processQuery(query, tools);

// 3. LLM이 도구 호출을 요청했다면

if (llmResponse.hasFunctionCall) {

// 4. MCP를 통해 도구 호출

const result = await this.mcpClient.request({

method: "tools/call",

params: {

name: llmResponse.functionName,

arguments: llmResponse.functionArgs

}

});

// 5. 도구 호출 결과를 LLM에 다시 전달

return await this.llm.processFunctionResult(result);

}

// 도구 호출이 없다면 LLM 응답 그대로 반환

return llmResponse.text;

}

}이 단순한 코드에서도 호스트 앱이 해야 할 일이 많다는 것을 알 수 있습니다:

- MCP 클라이언트와 LLM 클라이언트를 모두 관리

- MCP에서 도구 목록을 가져와 LLM에 전달

- LLM의 도구 호출 요청을 감지하고 MCP로 전달

- 도구 호출 결과를 다시 LLM에 전달

- 최종 응답을 사용자에게 제공

이것이 바로 Claude Desktop, Cursor, Visual Studio Code 확장 프로그램과 같은 AI 도구들이 모두 독자적으로 구현해야 하는 부분입니다. MCP는 단지 도구와 리소스에 접근하는 표준화된 방법만 제공할 뿐, 실제로 유용한 AI 경험을 만들기 위한 로직은 호스트 앱이 담당해야 합니다.

요약하자면, MCP는 혼자서는 아무것도 할 수 없습니다. 실제로 가치를 발휘하려면 잘 설계된 호스트 앱이 필요하죠. 그래서 다양한 AI 서비스들이 각자의 방식으로 호스트 앱을 구현하고 있는 것입니다.

🧠 호스트 앱이 전부입니다: LLM 워크플로우의 중요성

MCP 서버가 도구를 제공하고 LLM이 이를 호출한다면 모든 문제가 해결될까요? 단순히 Function Call 목록을 LLM에게 전달하고 호출하게 하면 모든 것을 완벽하게 수행할 수 있을까요?

현실은 그렇게 간단하지 않습니다. LLM의 진정한 능력을 끌어내기 위해서는 효과적인 LLM 워크플로우 설계가 필수적입니다.

가장 단순한 예시부터 생각해 봅시다. MCP를 통해 100개 또는 1000개의 도구를 사용할 수 있다고 가정해 보겠습니다. 이 모든 도구 정의를 한 번에 LLM에게 전달하면 어떻게 될까요?

// ❌ 비효율적인 방식: 모든 도구를 한 번에 LLM에 전달

const allTools = await mcpClient.request({ method: "tools/list" });

const llmResponse = await llm.processQuery(query, allTools); // 수많은 도구로 LLM이 혼란!이런 접근 방식은 두 가지 문제를 일으킵니다:

- 토큰 낭비: 수백 개의 도구 정의가 컨텍스트 윈도우를 차지하여 실제 사용자 쿼리를 처리할 공간이 줄어듭니다.

- 선택 혼란: LLM은 너무 많은 선택지 중에서 적절한 도구를 찾는 데 어려움을 겪을 수 있습니다.

효과적인 호스트 앱은 이 문제를 다음과 같이 해결할 수 있습니다:

// ✅ 효율적인 방식: 쿼리 기반으로 관련 도구만 선택하여 제공

async function processWithRelevantTools(query) {

// 1. 모든 도구 목록 가져오기

const allTools = await mcpClient.request({ method: "tools/list" });

// 2. 쿼리 임베딩 생성

const queryEmbedding = await generateEmbedding(query);

// 3. 도구 설명의 임베딩과 비교하여 관련 도구만 선택

const relevantTools = selectRelevantTools(allTools, queryEmbedding);

// 4. 선택된 도구만 LLM에 제공

return await llm.processQuery(query, relevantTools);

}이것은 호스트 앱이 단순한 중계자가 아니라 지능형 조정자로서 작동해야 함을 보여주는 한 가지 예시일 뿐입니다.

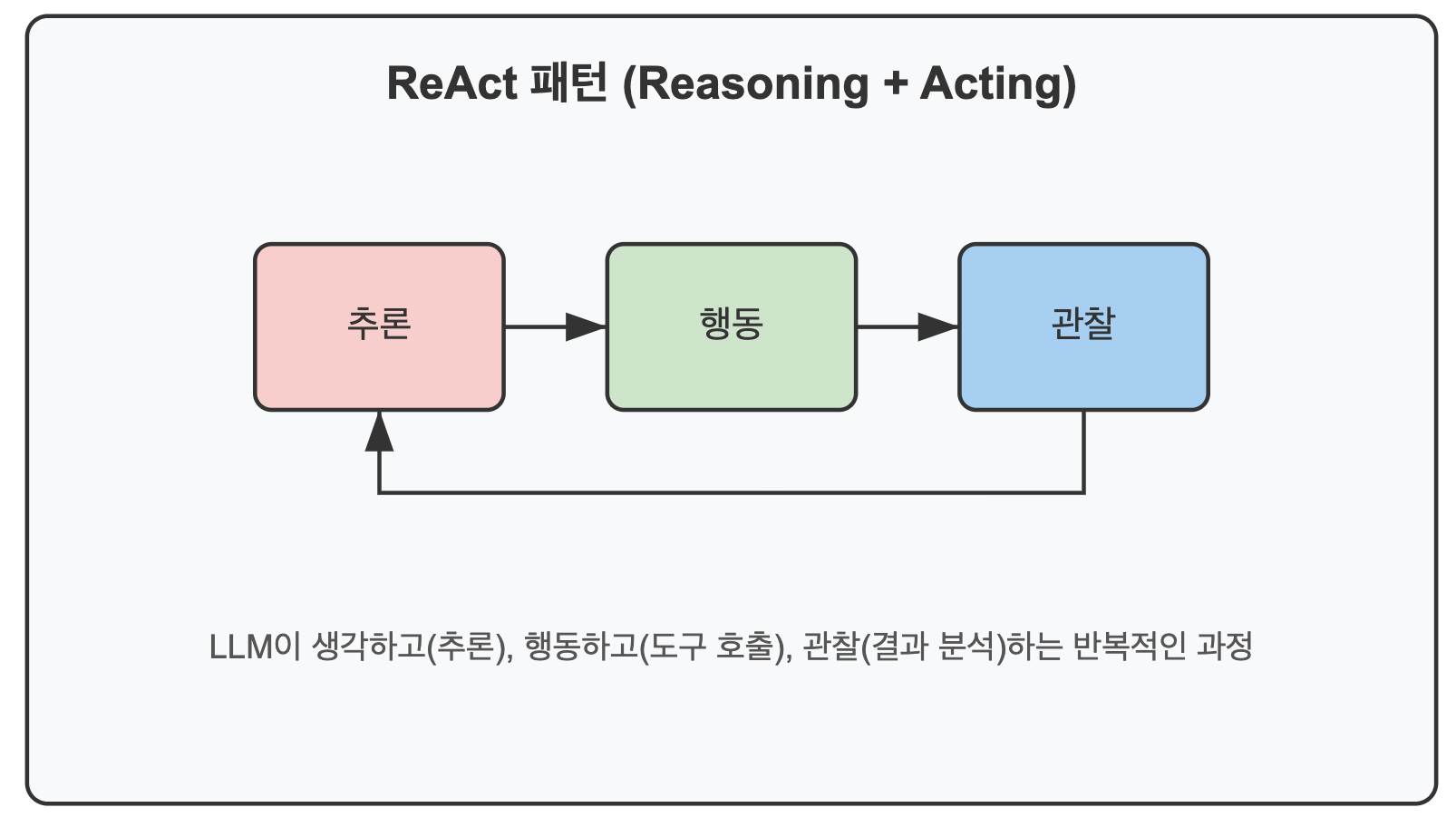

LLM 워크플로우: ReAct 패턴과 그 너머

LLM을 운용하는 방식은 아주 다양한 방법론이 있습니다. 그중 가장 널리 알려진 패턴 중 하나는 ReAct(Reasoning + Acting)입니다.

ReAct 패턴에서 LLM은:

- 추론(Reasoning): 어떤 도구를 사용할지 결정하고 그 이유를 설명합니다.

- 행동(Acting): 선택한 도구를 호출하여 정보를 얻거나 작업을 수행합니다.

- 관찰(Observation): 도구 실행 결과를 분석하고 다음 단계를 계획합니다.

이 과정은 반복적으로 수행되며, 각 단계에서 LLM은 자신의 행동을 설명하고 결과를 평가합니다.

그러나 ReAct는 시작일 뿐입니다. 다양한 워크플로우 패턴이 있습니다:

- Reflection: LLM이 자신의 응답을 비판적으로 평가하고 개선하는 과정

- Human-in-the-loop: 특정 시점에서 사용자의 피드백을 받아 정확도 향상

- Multi-agent Collaboration: 여러 LLM 에이전트가 협력하여 복잡한 문제 해결

Windsurf가 Cursor라는 경쟁자를 제치고 인기를 얻은 이유 중 하나는 이러한 LLM 에이전트 협업 관계를 효과적으로 설계했기 때문입니다.

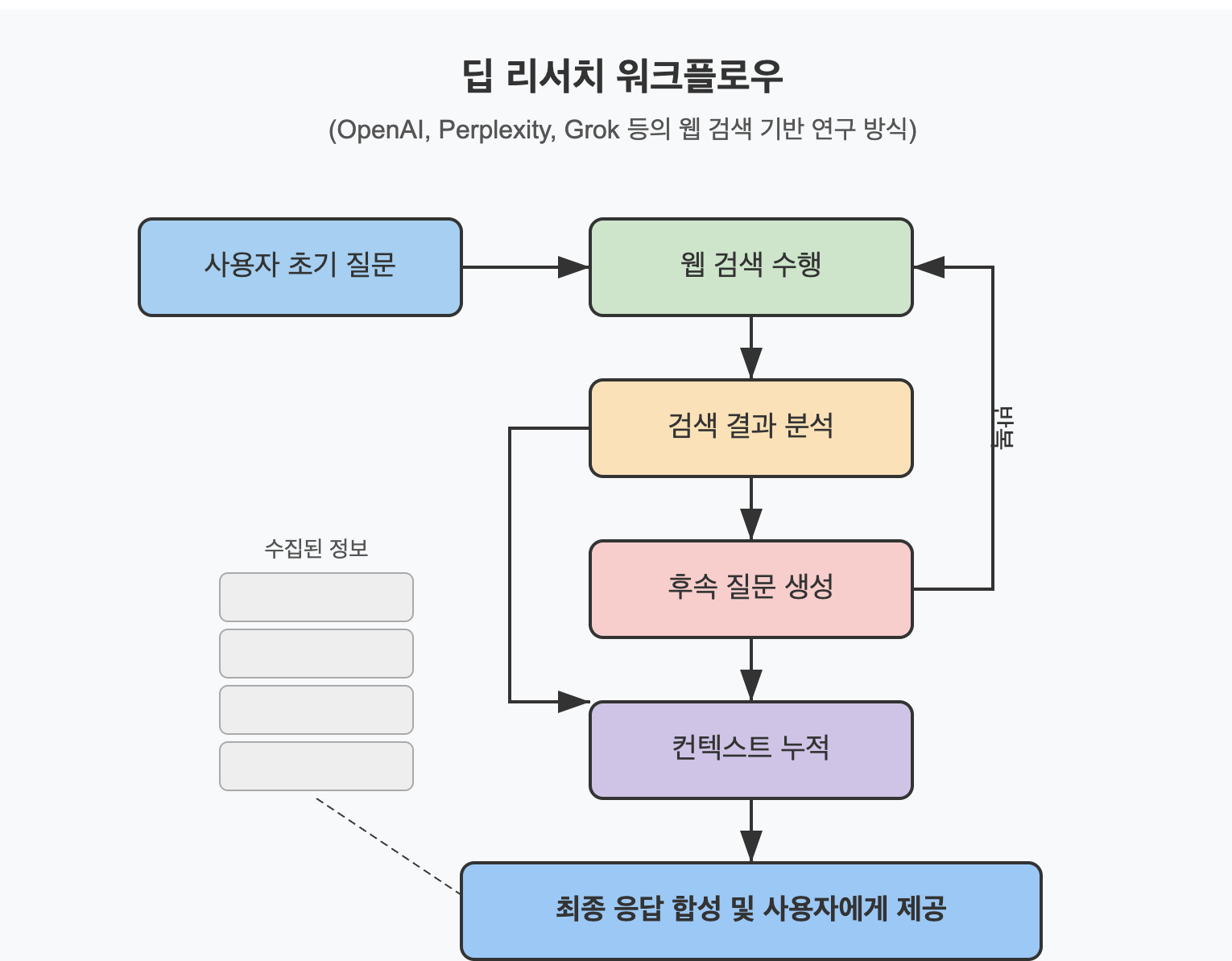

딥 리서치: 검색과 반복 질문

최근 OpenAI, Perplexity, Grok과 같은 서비스에서 볼 수 있는 딥 리서치 기능도 잘 설계된 워크플로우의 한 예입니다:

이 워크플로우에서는:

- 사용자의 질문을 기반으로 웹 검색을 수행합니다.

- 검색 결과를 분석하여 후속 질문을 생성합니다.

- 이 과정을 반복하여 점점 더 정확하고 깊이 있는 정보를 수집합니다.

- 최종적으로 모든 정보를 종합하여 사용자에게 제공합니다.

이런 방식은 단순한 질의응답보다 훨씬 더 정확하고 최신 정보를 제공할 수 있습니다.

프레임워크: 워크플로우 구축의 도구들

이러한 복잡한 워크플로우를 구현하기 위한 다양한 프레임워크가 존재합니다:

- Microsoft의 AutoGen: 여러 에이전트가 협업하는 방식으로, 각 에이전트는 고유한 시스템 프롬프트를 가지고 특정 역할을 수행합니다.

- LangGraph: 다양한 LLM 컴포넌트를 연결하여 복잡한 워크플로우를 구성할 수 있습니다.

// AutoGen 스타일의 다중 에이전트 구현 예시 (수도 코드)

const codeWriter = createAgent({

role: "코드 작성자",

systemPrompt: "당신은 사용자의 요구사항에 맞는 코드를 작성하는 전문가입니다..."

});

const codeReviewer = createAgent({

role: "코드 리뷰어",

systemPrompt: "당신은 코드의 품질과 보안을 검토하는 전문가입니다..."

});

// 에이전트 간 협업 워크플로우 설정

setupWorkflow([

codeWriter.writeInitialCode,

codeReviewer.reviewCode,

codeWriter.improveBadedOnFeedback,

// ...

]);저희 팀에서도 글쓰기 워크플로우를 구현하기 위해 독자적으로 프레임워크를 만들어서 사용하고 있습니다.

MCP의 역할과 한계

이 모든 맥락에서 MCP의 역할은 무엇일까요? MCP는 외부 세계와 연결될 단일 인터페이스를 제공하는 것일 뿐입니다. MCP 자체가 멀티에이전트 시스템이나 에이전트 워크플로우를 구성하지는 않습니다.

각 MCP 호스트(Claude Desktop, Cursor, Contiue 등)는 자신만의 고유한 워크플로우를 개발하여 LLM의 능력을 최대한 끌어올립니다:

- 동적으로 변하는 프롬프트를 사용할 수 있습니다.

- 에이전트를 여러 개로 나누어 협업하게 할 수 있습니다.

- 사용자와의 상호작용을 최적화할 수 있습니다.

- 도구 호출의 결과를 해석하고 다음 행동을 결정하는 방식을 개선할 수 있습니다.

결론적으로, MCP는 매우 유용한 표준화 프로토콜이지만, 진정한 가치는 이를 활용하는 호스트 앱의 워크플로우 설계에 있습니다. LLM의 능력을 최대한 활용하려면, 단순히 도구를 연결하는 것을 넘어서 지능적인 워크플로우를 설계해야 합니다. 이것이 바로 호스트 앱이 전부인 이유입니다.

MCP의 야망: 프롬프트에서 워크플로우까지

지금까지 우리는 MCP가 tools/list와 tools/call을 통해 LLM에게 도구를 제공하는 방법에 대해 살펴봤습니다. 하지만 MCP의 야망은 이에 그치지 않습니다. 단순한 도구 호출을 넘어 더 복잡하고 정교한 워크플로우까지 MCP로 구현할 수 있는 가능성이 열리고 있습니다.

📝 "프롬프트도 제공합니다만?" MCP의 특별한 스펙 공개

MCP 프로토콜을 자세히 들여다보면, 도구 호출만이 유일한 기능이 아님을 알 수 있습니다. 다양한 JSON-RPC 메서드가 정의되어 있는데, 그중에는 이런 것들도 있습니다:

**프롬프트 관련**

* `prompts/get`: 특정 프롬프트 가져오기

* `prompts/list`: 사용 가능한 프롬프트 목록 조회

**리소스 관련**

* `resources/list`: 리소스 목록 조회

* `resources/templates/list`: 리소스 템플릿 목록 조회

* `resources/read`: 리소스 읽기

* `resources/subscribe`: 리소스 변경 구독

* `resources/unsubscribe`: 리소스 구독 취소눈여겨봐야 할 부분은 바로 prompts/get과 prompts/list입니다. 이는 MCP 서버가 단순히 도구만 제공하는 것이 아니라, 프롬프트도 제공할 수 있음을 의미합니다. MCP 서버에서 제공하는 프롬프트를 호스트 앱이 LLM에게 전달하는 것이죠.

더 놀라운 것은 sampling/createMessage와 같은 메서드의 존재입니다. 이 메서드를 통해 MCP 서버가 호스트 앱에게 LLM 생성을 요청할 수 있습니다:

{

"method": "sampling/createMessage",

"params": {

"messages": [

{

"role": "user",

"content": {

"type": "text",

"text": "What files are in the current directory?"

}

}

],

"systemPrompt": "You are a helpful file system assistant.",

"includeContext": "thisServer",

"maxTokens": 100

}

}이것은 무엇을 의미할까요? MCP 서버가 단순한 도구 제공자를 넘어서서, 적극적으로 대화에 참여하는 에이전트가 될 수 있다는 것입니다. 서버가 질문을 하고, 호스트는 LLM을 통해 답변을 제공하며, 필요하다면 사용자를 루프에 포함시킬 수도 있습니다(Human-in-the-loop).

🤖 멀티에이전트 프레임워크가 MCP 서버로 이사 가는 중

이러한 기능들이 시사하는 바는 명확합니다. 복잡한 멀티에이전트 워크플로우를 구성하는 다양한 전략들이 이제 MCP 서버로 이동할 수 있습니다. 여러 MCP 서버들이 각자의 역할을 담당하고, prompts/list와 prompts/get으로 프롬프트를 제공하며, sampling/createMessage로 호스트에 LLM 생성을 요청하는 방식으로 워크플로우를 구성할 수 있습니다.

이런 접근 방식에서는:

- 여러 MCP 서버가 각각 특정 역할을 담당합니다 (코드 작성자, 코드 리뷰어 등)

- 각 MCP 서버는

prompts/list와prompts/get으로 자신의 역할에 맞는 프롬프트를 제공합니다 - MCP 서버는

sampling/createMessage를 통해 호스트 앱에 LLM 생성을 요청합니다 - 호스트 앱은 사용자와의 상호작용을 관리하며 필요할 때 Human-in-the-loop를 구현합니다

{

"method": "sampling/createMessage",

"params": {

"messages": [

{

"role": "user",

"content": {

"type": "text",

"text": "현재 디렉토리에 어떤 파일들이 있나요?"

}

}

],

"systemPrompt": "당신은 도움이 되는 파일 시스템 어시스턴트입니다.",

"includeContext": "thisServer",

"maxTokens": 100

}

}이 기능이 특별한 이유는 Human-in-the-loop 설계를 자연스럽게 지원하기 때문입니다. 샘플링 요청이 들어오면:

- 호스트 앱은 사용자에게 "코드리뷰 도구가 LLM에게 질문하려고 합니다. 허용하시겠습니까?"와 같은 확인을 요청할 수 있습니다.

- 사용자는 제안된 프롬프트를 검토하고 수정하거나 거부할 수 있습니다.

- 생성된 응답도 사용자가 검토하고 승인한 후에 MCP 서버로 전달됩니다.

이를 통해 사용자는 LLM이 무엇을 보고 생성하는지에 대한 통제권을 유지하면서도, MCP 서버가 복잡한 에이전트 행동을 수행할 수 있게 됩니다.

이처럼 멀티에이전트 워크플로우의 핵심 전략들을 MCP 서버로 옮기면, 동일한 워크플로우를 다양한 호스트 앱에서 재사용할 수 있게 됩니다.

호스트 앱을 MCP로 싸서 드셔보세요

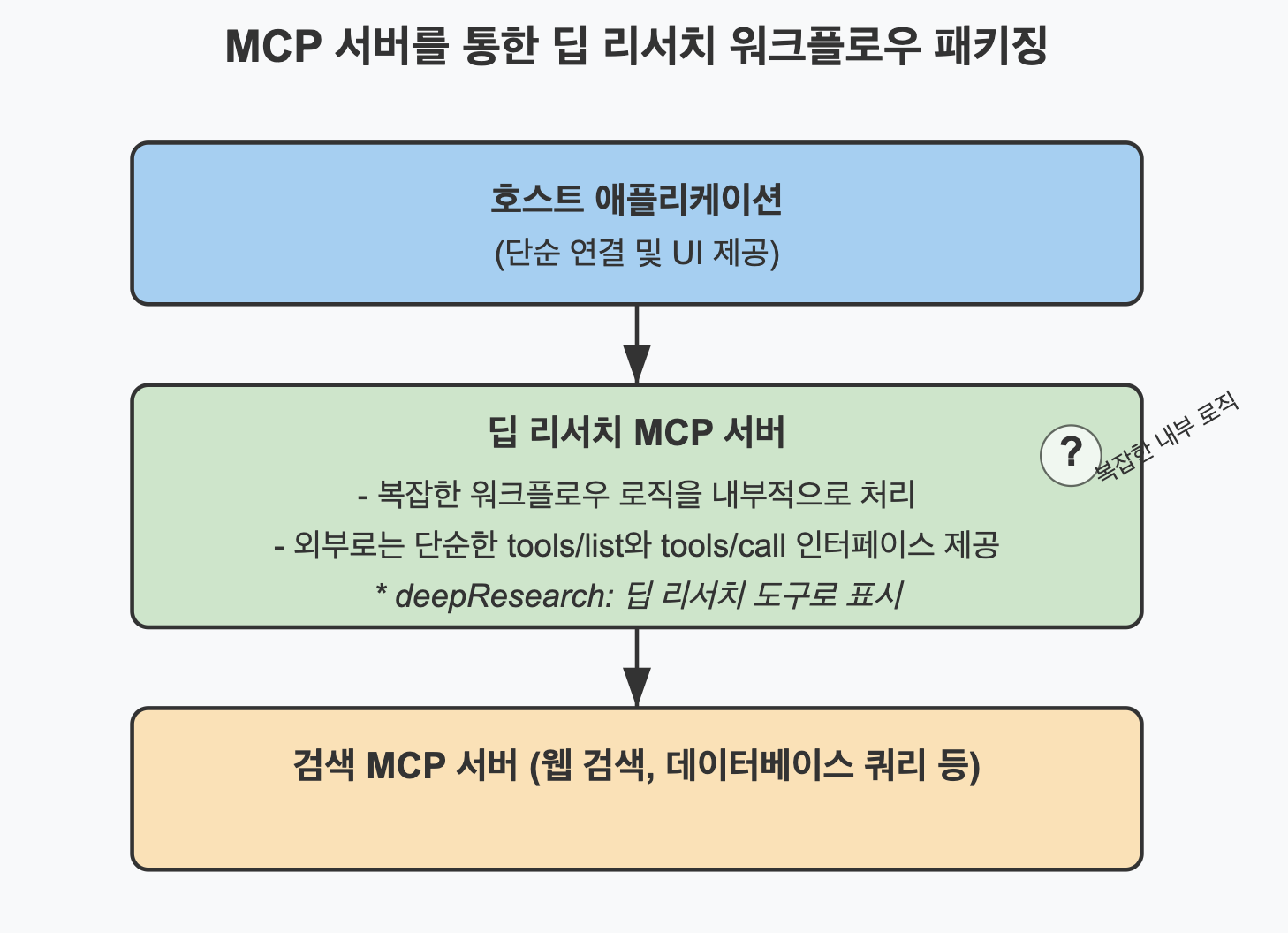

더 나아가, 복잡한 워크플로우 자체를 MCP 서버로 패키징하여 공유 가능한 형태로 제공할 수도 있습니다. 기존에는 호스트 앱에서 구현해야 했던 워크플로우 로직을 MCP 서버로 옮겨서, 다른 호스트 앱들이 쉽게 이용할 수 있게 만드는 것입니다.

예를 들어, 앞서 살펴본 딥 리서치 워크플로우가 호스트 앱에 구현되어 있었다면, 이제는 이를 MCP 서버로 패키징할 수 있습니다:

이 구조에서 딥 리서치 MCP 서버는 복잡한 워크플로우 로직을 모두 내부적으로 처리하지만, 외부로는 단순한 tools/list와 tools/call 인터페이스만 노출합니다. 호스트 앱은 deepResearch라는 단일 도구만 보게 되며, 복잡한 내부 구현은 숨겨집니다.

실제로는 딥 리서치 서버 내부에서 다양한 방식으로 구현될 수 있습니다. 하드코딩된 로직일 수도 있고, MCP 프로토콜을 십분 활용한 정교한 구현일 수도 있습니다. 이 서버는 다음과 같은 복잡한 작업을 수행합니다:

- 내부적으로 검색 MCP 서버에 도구 호출 요청

- 검색 결과 분석 및 후속 질문 생성

- 사용자 확인 프로세스 관리

- 여러 검색 결과 종합 및 최종 응답 생성

하지만 호스트 앱의 관점에서는 그저 deepResearch라는 단일 도구만 호출할 뿐입니다. 이처럼 MCP를 통해 복잡한 워크플로우를 캡슐화하고 재사용 가능한 형태로 제공할 수 있습니다. 다른 개발자들은 내부 구현을 이해할 필요 없이 자신의 호스트 앱에서 이 기능을 쉽게 활용할 수 있게 됩니다.

호스트는 가볍게, MCP는 다양하게

이러한 접근 방식의 가치는 명확합니다. 개발자들은 자신의 입맛에 맞는 워크플로우를 MCP 서버로 공개하고, 다른 개발자들은 이를 조합하여 새로운 AI 경험을 만들 수 있습니다. 마치 맛집 레시피를 공유하듯, AI 워크플로우 레시피를 공유하는 생태계가 형성될 수 있는 것이죠.

예를 들어:

- 웹 검색 + 코드 생성 워크플로우를 MCP 서버로 패키징

- 복잡한 데이터 분석 파이프라인을 MCP 서버로 구현

- 특정 도메인에 특화된 에이전트 협업 시스템을 MCP 서버로 제공

이렇게 되면 AI 개발의 미래는 호스트 앱을 처음부터 개발하는 것이 아니라, 다양한 MCP 서버 조합을 찾는 것만으로 구성하는 방향으로 진화할 수 있습니다.

MCP: 단순한 프로토콜을 넘어서

지금까지 MCP(Model Context Protocol)의 현재를 살펴봤다면, 이제는 미래를 상상해 볼 차례입니다. AI 개발 패러다임이 어떻게 변화할지, MCP가 어떤 역할을 할지 생각해보면 흥미로운 가능성이 펼쳐집니다.

🧩 AI 개발은 레고처럼 된다

가장 먼저 떠오르는 미래는 'AI 개발의 레고화'입니다. 오픈소스 커뮤니티와 상업 업체들이 다양한 MCP 서버 블록을 만들기 시작하면 어떻게 될까요? 개발자들은 이 블록들을 조합하여 복잡한 AI 애플리케이션을 구축할 수 있을 것입니다.

예를 들어:

- 웹 검색 MCP 서버

- PDF 분석 MCP 서버

- 코드 이해 및 생성 MCP 서버

- 데이터 시각화 MCP 서버

이들을 조합하면 "AI 연구 어시스턴트"나 "코드 리팩토링 도우미" 같은 특화된 애플리케이션을 빠르게 만들 수 있습니다. 마치 레고 블록을 조립하듯, 필요한 MCP 서버들을 연결하기만 하면 되는 세상이 오는 것이죠.

💡 AI 오케스트레이션의 시대

두 번째로, AI 워크플로우 오케스트레이션이 새로운 경쟁의 장이 될 것입니다. 현재는 도구를 만들거나 호스트 앱을 개발하는 데 초점이 맞춰져 있지만, 미래에는 다양한 MCP 서버들을 조율하는 '오케스트레이터'가 중요해질 수 있습니다.

이러한 오케스트레이터는:

- 상황에 맞는 최적의 MCP 서버 조합을 결정

- 서버 간 정보 흐름을 관리

- 사용자 개입이 필요한 시점을 판단

- 복잡한 멀티에이전트 협업을 조율

언젠가는 "이 오케스트레이터가 더 효율적인 워크플로우를 구성해요"라는 경쟁이 일어날지도 모릅니다.

🌐 MCP 서버 마켓플레이스

세 번째로, MCP 서버 마켓플레이스가 등장할 가능성이 큽니다. 마치 앱스토어처럼, 전문화된 MCP 서버를 제공하는 생태계가 형성될 수 있습니다. 법률, 의료, 금융 등 각 분야별로 특화된 MCP 서버가, 무료부터 구독형까지 다양한 모델로 제공될 것입니다.

이는 AI 개발의 민주화로 이어질 수 있습니다. 기술적 지식이 없는 사람들도 호스트 앱을 통해 필요한 MCP 서버를 구독하고 조합하여 자신만의 AI 워크플로우를 구성할 수 있게 될 테니까요.

🔄 AI 앱이 없어지고, AI 워크플로우만 남는다

네 번째로, 어쩌면 호스트 앱과 MCP 서버의 경계가 점점 흐려질 수도 있습니다. 사용자들은 특정 앱을 사용하는 것이 아니라, 필요에 따라 다양한 AI 워크플로우를 선택하게 될 수 있습니다.

"오늘은 연구 논문을 읽어야 하니 학술 워크플로우를 활성화해야겠다"

"지금은 코딩 중이니 개발 워크플로우로 전환해야겠다"

앱 단위가 아닌 '워크플로우 단위'로 AI 경험을 소비하는 세계가 오지 않을까요?

💼 MCP의 가능성을 탐색한다면?

MCP는 아직 발전 중인 기술이며, 앞으로 어떻게 진화할지는 커뮤니티와 개발자들의 손에 달려 있습니다. 현재 시점에서 MCP를 탐색한다면 고려해볼 만한 방향은 다음과 같습니다:

-

표준의 진화 지켜보기: MCP는 계속 발전하고 있습니다. 이 표준이 어떻게 진화하는지 지켜보는 것은 AI 개발의 미래 방향을 이해하는 데 도움이 될 수 있습니다.

-

모듈성 실험하기: 솔루션을 설계할 때 모듈화를 고려해보는 것은 언제나 좋은 접근법입니다. 어떤 부분이 독립적인 MCP 서버로 분리될 수 있을지 실험해볼 가치가 있습니다.

-

커뮤니티 참여하기: MCP와 관련된 오픈소스 프로젝트와 커뮤니티에 참여하면 다양한 아이디어와 사용 사례를 접할 수 있습니다.

MCP는 단순한 프로토콜이 아닐 수 있습니다. 이는 AI 개발의 새로운 패러다임, 더 모듈화되고, 더 협업적이며, 더 접근하기 쉬운 AI 생태계를 향한 한 걸음일지도 모릅니다.

37개의 댓글

감사합니다, 정말 잘 작성해 주셨네요! 저는 이 웹사이트 https://www.claudemcp.com/docs에서도 자세히 알아보았고, 그 후에 이 글을 읽으니 더 이해가 잘 되었습니다.

구글에서도 A2A 프로토콜을 출시했는데, 이에 대해서도 설명해 주시면 감사하겠습니다!

https://jpr.ritaroy.in/

https://pne.ritaroy.in/

https://goaz.ritaroy.in/

https://hrd.ritaroy.in/

https://mbi.ritaroy.in/

https://noa.ritaroy.in/

https://lkw.ritaroy.in/

https://pune.gurugramwali.com/

https://noidia.jiyadas.com/

https://mumbai.riyamalik.com/

https://luckknow.riyamalik.com/

https://kaviga.com/

https://participacion.cabildofuer.es/profiles/kaviga/timeline

https://jobs.suncommunitynews.com/profiles/6435934-varsha-chauhan

http://www.mappery.com/user.php?name=varshu05

https://www.jobscoop.org/profiles/6441807-varsha-chauhan

https://decidim.rezero.cat/profiles/varshu05/activity

https://grantha.jiva.org/index.php?show=profile&m_no=43364

https://jobhub.jp/co_workers/varshachauhan8050/

https://www.atozed.com/forums/user-32694.html

https://heylink.me/sduka/

https://www.lingvolive.com/ru-ru/profile/635fae57-6bda-4252-ad9f-83dab99cc055/translations

https://varecha.pravda.sk/profil/kaviga/o-mne/

https://app.roll20.net/users/15820301/kaviga-j

https://www.walkscore.com/people/115439339871/kaviga

https://www.gta5-mods.com/users/varsha05

https://www.elephantjournal.com/profile/varshachauhan8050/

https://www.fdb.cz/clen/219784-kaviga.html

https://www.dibiz.com/varshachauhan8050

https://iszene.com/user-267792.html

https://coub.com/varsha05

https://askplaybook.com/kaviga

https://social1776.com/kaviga

https://onetable.world/kaviga

https://blacksocially.com/kaviga

https://www.project1999.com/forums/member.php?u=296954

https://photoclub.canadiangeographic.ca/profile/21544842

https://motion-gallery.net/users/732181/creations

https://joy.link/kaviga

https://feyenoord.supporters.nl/profiel/75581/kaviga

https://bandzone.cz/fan/varshachauhan8050

https://allods.my.games/forum/index.php?page=User&userID=175596

https://www.pubpub.org/user/kaviga-jpr

https://forum.bee-link.com/home.php?mod=space&username=kaviga

https://findaspring.org/members/sdukanetwork/

https://metaldevastationradio.com/kaviga

https://forum.instaforex.com/index.php?showuser=57655

https://menta.work/user/167680

https://jobs.landscapeindustrycareers.org/profiles/6306909-kaviga-jpr

https://imageevent.com/kaviga

https://www.geniusu.com/profiles/2634127

https://www.zubersoft.com/mobilesheets/forum/user-67551.html

https://www.iniuria.us/forum/member.php?537712-kaviga

https://www.hoaxbuster.com/redacteur/kaviga

https://www.fundable.com/user-1107550

https://bresdel.com/kaviga

https://android-help.ru/forum/user/18879-kaviga/

https://pornedup.com/users/riyamalik/

https://olderworkers.com.au/author/varshachauhan8050gmail-com/

https://colibris-wiki.org/Tecap2182/?kaviga

https://screeningroom.org/community/users/67e86ff4f83cc90002ed8e29

https://hallbook.com.br/kaviga

https://videos.muvizu.com/Profile/kaviga/Latest

https://cannabis.net/user/174279

https://punecallgirlservice0005.tokka-blog.com/34736469/call-ladies-from-pune-not-a-mystery-any-more

https://plaza.rakuten.co.jp/varshachauhan05/diary/202504170000/

https://diamondzgold.thekatyblog.com/33167741/call-ladies-from-pune-not-a-mystery-any-more

https://toletmystry.blogolenta.com/31435706/how-to-save-time-stress-and-money-with-pune-call-girls

https://varshachauhan8050.wixsite.com/sonika-das-escorts

https://currentgenz.mybjjblog.com/the-5-minute-rule-for-pune-call-girls-47091964

https://intoxicatedxbl.humor-blog.com/33374073/about-call-girls-service-in-pune

https://thockermen.bleepblogs.com/34925551/5-useful-elements-for-pune-call-girls

https://varshu05.pointblog.net/one-of-the-most-important-things-to-know-about-call-girls-78570885

https://varshua05.pointblog.net/the-idea-that-people-offer-companionship-in-exchange-for-payment-78572916

https://varshua05.creacionblog.com/34251822/in-india-prostitution-itself-is-not-illegal

https://www.whizolosophy.com/category/love-dating-marriage/article-essay/jaipur-call-girl-service-at-low-cost

https://webyourself.eu/blogs/839217/Book-Jaipur-call-girl-service-at-Affordable-Price-with-Kaviga

https://test.niadd.com/article/1393676.html

https://kaviga.mypixieset.com/blog/book-call-girls-in-jaipur-at-affordable-price-anyime/

https://it.niadd.com/article/1393936.html

https://fr.niadd.com/article/1393947.html

https://english.niadd.com/article/1393962.html

https://de.niadd.com/article/1393969.html

https://br.niadd.com/article/1393971.html

https://www.niadd.com/article/1398408.html

https://test.niadd.com/article/1398441.html

https://www.prive2day.co.uk/advertisement/1133/kaviga-awesome-girls-service-in-jaipur/

https://yo.poematrix.com/autores/kaviga/poemas/book-call-girls-mumbai-affordable-prices

https://click4r.com/posts/g/20309769/book-mumbai-call-girl-service

https://hallbook.com.br/blogs/516446/Why-Choose-Mumbai-Escort-Service-Over-Others

这篇文章对MCP的深入分析让我对这个协议有了更清晰的理解,特别是它如何简化LLM与外部工具的连接。文章中提到的标准化接口真是个重要的观点!如果你也对MCP感兴趣,可以访问 mcpdb 了解更多信息。

https://callgirlsbooking.in/

https://callgirlsbooking.in/about-gurugram-escorts.html

https://callgirlsbooking.in/college-manesar-call-girls.html

https://callgirlsbooking.in/elite-noida-girls.html

https://callgirlsbooking.in/premium-imt-manesar-girls.html

https://callgirlsbooking.in/high-profile-bhiwadi-girls.html

https://callgirlsbooking.in/independent-faridabad-girls.html

https://callgirlsbooking.in/vip-escorts-gurgaon-escort.html

https://callgirlsbooking.in/dating-girl-sector-80.html

https://callgirlsbooking.in/hardcore-gurugram-Call-Girls.html

https://callgirlsbooking.in/private-call-girls-dlf-city.html

https://callgirlsbooking.in/luxury-hotels-escorts-golf-course-road.html

https://callgirlsbooking.in/busty-call-girls-in-aerocity.html

https://callgirlsbooking.in/housewife-escort.html

https://callgirlsbooking.in/model-escorts-services.html

https://callgirlsbooking.in/busty-girls.html

https://callgirlsbooking.in/call-girls-rates.html

https://callgirlsbooking.in/contact-us.html

https://callgirlsbooking.in/big-tits-call-girls-in-sector-75.html

https://callgirlsbooking.in/blonde-call-girls-sector-71.html

https://callgirlsbooking.in/cheap-escorts-service-paharganj.html

https://callgirlsbooking.in/curvy-figure-girls-in-sector-72.html

https://callgirlsbooking.in/dating-call-girls-hauz-khas.html

https://callgirlsbooking.in/hina-sexy-girl-in-sector-78.html

https://callgirlsbooking.in/juicy-escorts-service-sector-79.html

https://callgirlsbooking.in/body-massage-in-gurugram.html

https://callgirlsbooking.in/blonde-call-girls-in-goa.html

https://callgirlsbooking.in/sushantlok-vip-call-girls.html

https://callgirlsbooking.in/mahipalpur-russian-call-girls.html

https://callgirlsbooking.in/call-girls-in-ardee-city-gurugram.html

https://callgirlsbooking.in/badshahpur-call-girls.html

https://callgirlsbooking.in/call-girls-in-bawal.html

https://callgirlsbooking.in/air-hostess-escort-services.html

https://callgirlsbooking.in/model-escort-services.html

https://callgirlsbooking.in/call-girl-whatsapp-number.html

https://callgirlsbooking.in/juicy-sector-29-call-girls.html

https://callgirlsbooking.in/hardcore-call-girls-sector-54.html

https://callgirlsbooking.in/sector-36-independent-call-girls.html

https://callgirlsbooking.in/russian-escort-services-in-hyderabad.html

https://callgirlsbooking.in/call-girls-in-sector-55.html

https://callgirlsbooking.in/beauty-call-girl-sector-50.html

https://callgirlsbooking.in/best-female-escorts-sector-28.html

https://callgirlsbooking.in/female-escorts-sector-43.html

https://callgirlsbooking.in/sector-14-call-girls.html

https://callgirlsbooking.in/sensual-vip-escort-girl-sector-32.html

https://callgirlsbooking.in/sexy-call-girls-sector-45.html

https://callgirlsbooking.in/outdoor-call-girls-in-sector-67.html

https://callgirlsbooking.in/pink-lips-call-girls-sector-12.html

https://callgirlsbooking.in/call-girls-in-gurugram-sector-33.html

https://callgirlsbooking.in/call-girls-in-sector-40-gurugram.html

https://callgirlsbooking.in/housewife-escort-services.html

https://callgirlsbooking.in/call-girls-sector-35-gurugram.html

https://callgirlsbooking.in/cheap-escort-girls.html

https://callgirlsbooking.in/monika-model-escorts-services.html

https://callgirlsbooking.in/escort-girl-services-sector-39-gurugram.html

https://callgirlsbooking.in/escorts-service-in-sector-36.html

https://callgirlsbooking.in/gurugram-call-girls-rates.html

https://callgirlsbooking.in/gurugram-call-girls-sector-34.html

https://callgirlsbooking.in/gurugram-escort-services-sector-15.html

https://callgirlsbooking.in/gurugram-escort-services-sector-16.html

https://callgirlsbooking.in/gurugram-escort-services-sector-17.html

https://callgirlsbooking.in/gurugram-escort-services-sector-18.html

https://callgirlsbooking.in/gurugram-escort-services-sector-19.html

https://callgirlsbooking.in/gurugram-escort-services-sector-20.html

https://callgirlsbooking.in/gurugram-escort-services-sector-21.html

https://callgirlsbooking.in/gurugram-escort-services-sector-22.html

https://callgirlsbooking.in/gurugram-escort-services-sector-23.html

https://callgirlsbooking.in/gurugram-escort-services-sector-24.html

https://callgirlsbooking.in/gurugram-escort-services-sector-25.html

https://callgirlsbooking.in/gurugram-escort-services-sector-26.html

https://callgirlsbooking.in/gurugram-escort-services-sector-27.html

https://callgirlsbooking.in/gurugram-escort-services-sector-28.html

https://callgirlsbooking.in/gurugram-escort-services-sector-29.html

https://callgirlsbooking.in/gurugram-escort-services-sector-30.html

https://callgirlsbooking.in/gurugram-escort-services-sector-31.html

https://callgirlsbooking.in/gurugram-escort-services-sector-32.html

https://callgirlsbooking.in/gurugram-escort-services-sector-37.html

https://callgirlsbooking.in/gurugram-escort-services-sector-38.html

https://callgirlsbooking.in/gurugram-phase-I-escort-services.html

https://callgirlsbooking.in/gurugram-phase-II-escort-services.html

https://callgirlsbooking.in/gurugram-phase-III-escort-services.html

https://callgirlsbooking.in/gurugram-phase-IV-escort-services.html

https://callgirlsbooking.in/gurugram-phase-V-escort-services.html

https://callgirlsbooking.in/high-class-escort-services.html

https://callgirlsbooking.in/airhostess-escort-services.html

https://pihubansal.com/vasundhara-nagar-call-girls.html

https://pihubansal.com/verified-call-girls-in-adyar.html

https://pihubansal.com/virat-nagar-call-girls.html

https://pihubansal.com/vivek-vihar-call-girls.html

https://pihuhttps://pihubansal.com/vasant-vihar-call-girls.html

https://pihuhttps://pihubansal.com/wazirabad-call-girls.html

https://pihubansal.com/west-bengal-call-girls.html

https://pihubansal.com/west-delhi-call-girls.html

https://pihubansal.com/wonderful-call-girls-manikonda.html

https://pihubansal.com/yamunanagar-call-girls.html

https://pihubansal.com/young-ladies-escort-anna-nagar.html

https://pihubansal.com/zero-figure-call-girls-in-golf-course-extension.html

https://pihubansal.com/about.html Jaipur escort seva

https://pihubansal.com/achrol-call-girls.html

https://pihubansal.com/adarsh-nagar-call-girls.html

https://pihubansal.com/affordable-rate-call-girls-gachibowli.html

https://pihubansal.com/ajairajpura-call-girls.html

https://pihubansal.com/ajmer-call-girls.html

https://pihubansal.com/ajmeri-Gate-call-girls.html

https://pihubansal.com/alipur-call-girls.html

https://pihubansal.com/alluring-female-escort-jubilee-hills.html

https://pihubansal.com/alwar-call-girls.html

https://pihubansal.com/amazing-escorts-miyapur.html

https://pihubansal.com/ambabari-call-girls.html

https://pihubansal.com/ambala-call-girls.html

https://pihubansal.com/amer-call-girls.html

https://pihubansal.com/amrapali-circle-call-girls.html

https://pihubansal.com/anand-lok-call-girls.html

https://pihubansal.com/anand-nagar-call-girls.html

https://pihubansal.com/anand-puri-call-girls.html

https://pihubansal.com/andaman-and-nicobar-call-girls.html

https://pihubansal.com/andhra-pradesh-call-girls.html

https://pihubansal.com/anita-colony-call-girls.html

https://pihubansal.com/arjun-nagar-call-girls.html

https://pihubansal.com/arunachal-pradesh-call-girls.html

https://pihubansal.com/ashok-nagar-call-girls.html

https://pihubansal.com/assam-call-girls.html

https://pihubansal.com/aunty-call-girls-in-sector-57.html

https://pihubansal.com/badanpura-call-girls.html

https://pihubansal.com/badi-chaupar-call-girls.html

https://pihubansal.com/bagru-call-girls.html

https://pihubansal.com/bais-godam-call-girls.html

https://pihubansal.com/bajaj-nagar-call-girls.html

https://pihubansal.com/balawala-call-girls.html

https://pihubansal.com/banbeerpur-call-girls.html

https://pihubansal.com/bani-park-call-girls.html

https://pihubansal.com/banswara-call-girls.html

https://pihubansal.com/bapu-bazaar-call-girls.html

https://pihubansal.com/bapu-nagar-call-girls.html

https://pihubansal.com/baran-call-girls.html

https://pihubansal.com/barkat-nagar-call-girls.html

https://pihubansal.com/baroni-call-girls.html

https://pihubansal.com/bassi-call-girls.html

https://pihubansal.com/beautifull-nightlife-escorts-in-goa.html

https://pihubansal.com/best-figure-call-girl-begumpet.html

https://pihubansal.com/best-vip-escorts-begum-bazar.html

https://pihubansal.com/bhagat-singh-colony-call-girls.html

https://pihubansal.com/bhankrota-call-girls.html

https://pihubansal.com/bhan-nagar-call-girls.html

https://pihubansal.com/bharatpur-call-girls.html

https://pihubansal.com/bhilwara-call-girls.html

https://pihubansal.com/bhindoosi-call-girls.html

https://pihubansal.com/bhiwadi-call-girls.html

https://pihubansal.com/bhiwani-call-girls.html

https://pihubansal.com/bhojpura-call-girls.html

https://pihubansal.com/bichun-call-girls.html

https://pihubansal.com/bihar-call-girls.html

https://pihubansal.com/bikaner-call-girls.html

https://pihubansal.com/bilaspur-himachal-pradesh-call-girls.html

https://pihubansal.com/bindayaka-call-girls.html

https://pihubansal.com/biseswarji-call-girls.html

https://pihubansal.com/blowjob-call-girls-in-sector-83.html

https://pihubansal.com/blue-eyes-call-girls-in-calangute.html

https://pihubansal.com/boraj-call-girls.html

https://pihubansal.com/boytawala-call-girls.html

https://pihubansal.com/brahmpuri-call-girls.html

https://pihubansal.com/brijlalpura-call-girls.html

https://pihubansal.com/budhsinghpura-call-girls.html

https://pihubansal.com/bundi-call-girls.html

https://pihubansal.com/cash-on-delivery-escorts-in-hsr-layout.html

https://pihubansal.com/central-delhi-call-girls.html

https://pihubansal.com/chaksu-call-girls.html

https://pihubansal.com/chamba-himachal-pradesh-call-girls.html

https://pihubansal.com/chamroda-call-girls.html

https://pihubansal.com/chanakyapuri-call-girls.html

https://pihubansal.com/chandigarh-call-girls.html

https://pihubansal.com/chandpol-call-girls.html

https://pihubansal.com/chandwaji-call-girls.html

https://pihubansal.com/charkhi-dadri-call-girls.html

https://pihubansal.com/charming-call-girls-in-shamirpet.html

https://pihubansal.com/chawandi-khurd-call-girls.html

https://pihubansal.com/chhattisgarh-call-girls.html

https://pihubansal.com/chitrakoot-call-girls.html

https://pihubansal.com/chittora-call-girls.html

https://pihubansal.com/chittorgarh-call-girls.html

https://pihubansal.com/chokhi-dhani-call-girls.html

https://pihubansal.com/chomu-call-girls.html

https://pihubansal.com/Chopanki-call-girls.html

https://pihubansal.com/churu-call-girls.html

https://pihubansal.com/civil-lines-call-girls.html

https://pihubansal.com/contact.html jaipur call girls contact number

https://pihubansal.com/curvy-figure-call-girls-in-canacona.html

https://pihubansal.com/dadra-and-nagar-haveli-call-girls.html

https://pihubansal.com/daman-and-diu-call-girls.html

https://pihubansal.com/dantri-call-girls.html

https://pihubansal.com/daryaganj-call-girls.html

https://pihubansal.com/dating-call-girls-in-ambience-islands.html

https://pihubansal.com/dausa-call-girls.html

https://pihubansal.com/dayarampura-call-girls.html

https://pihubansal.com/defence-colony-call-girls.html

https://pihubansal.com/delhi-call-girls.html

https://pihubansal.com/delhi-cantonment-call-girls.html

https://pihubansal.com/dev-nagar-call-girls.html

https://pihubansal.com/dholai-call-girls.html

https://pihubansal.com/dholpur-call-girls.html

https://pihubansal.com/dmca-validation.html

https://pihubansal.com/doctors-colony-call-girls.html

https://pihubansal.com/dongra-call-girls.html

https://pihubansal.com/doongri-call-girls.html

https://pihubansal.com/door-step-delivery-call-girls-kotturpuram.html

https://pihubansal.com/dream-call-girls-in-rajaji-nagar.html

https://pihubansal.com/dudu-call-girls.html

https://pihubansal.com/dungarpur-call-girls.html

https://pihubansal.com/durgapura-call-girls.html

https://pihubansal.com/dwarka-call-girls.html

https://pihubansal.com/east-delhi-call-girls.html

https://pihubansal.com/elite-call-girls-in-golf-course-road.html

https://pihubansal.com/escort-girl-profile.html

https://pihubansal.com/excellent-call-girl-chennai.html

https://pihubansal.com/excellent-class-escort-mylapore.html

https://pihubansal.com/faridabad-call-girls.html

https://pihubansal.com/farrukh-nagar-call-girls.html

https://pihubansal.com/fatehabad-call-girls.html

https://pihubansal.com/foreplay-call-girls-in-sector-21.html

https://pihubansal.com/full-satisfaction-call-girl-bellundur.html

https://pihubansal.com/gandhi-nagar-call-girls.html

https://pihubansal.com/gandhola-call-girls.html

https://pihubansal.com/gangori-bazar-call-girls.html

https://pihubansal.com/gayatri-nagar-call-girls.html

https://pihubansal.com/genuine-call-girl-service-sadashivanagar.html

https://pihubansal.com/ghasoli-call-girls.html

https://pihubansal.com/ghat-darwaza-call-girls.html

https://pihubansal.com/ghati-karolan-call-girls.html

https://pihubansal.com/girdharipura-call-girls.html

https://pihubansal.com/goa-models-call-girls.html

https://pihubansal.com/godam-call-girls.html

https://pihubansal.com/gokulpura-call-girls.html

https://pihubansal.com/google36efdf63ab487b4f.html

https://pihubansal.com/google91e940feae54559a.html

https://pihubansal.com/gopalbari-call-girls.html

https://pihubansal.com/gopalpura-call-girls.html

https://pihubansal.com/goregaon-call-girls-malleshwaram.html

https://pihubansal.com/govind-nagar-call-girls.html

https://pihubansal.com/govindpura-call-girls.html

https://pihubansal.com/greater-vidhyadhar-nagar-call-girls.html

https://pihubansal.com/guaranteed-safe-escorts-basavanagudi.html

https://pihubansal.com/gujarat-call-girls.html

https://pihubansal.com/gurugram-call-girls.html

https://pihubansal.com/hamirpur-call-girls.html

https://pihubansal.com/hanumangarh-call-girls.html

https://pihubansal.com/hanuman-nagar-call-girls.html

https://pihubansal.com/haryana-call-girls.html

https://pihubansal.com/hasanpura-call-girls.html

https://pihubansal.com/hathroi-call-girls.html

https://pihubansal.com/hauz-khas-call-girls.html

https://pihubansal.com/heerawala-call-girls.html

https://pihubansal.com/hifi-model-girls-in-besant-nagar.html

https://pihubansal.com/himachal-pradesh-call-girls.html

https://pihubansal.com/himmat-nagar-call-girls.html

https://pihubansal.com/hisar-Call-girls.html

https://pihubansal.com/horny-call-girl-in-bangalore.html

https://pihubansal.com/horny-call-girl-in-koramangala.html

https://pihubansal.com/hottie-escorts-hi-tech-city.html

https://pihubansal.com/housewife-escort-service.html

https://pihubansal.com/hyderabad-call-girls.html

https://pihubansal.com/hygienic-call-girls-in-sohna-road.html

https://pihubansal.com/index.html Call girl in jaipur

https://pihubansal.com/indira-bazar-call-girls.html

https://pihubansal.com/innocent-call-girls-nirvana-country.html

https://pihubansal.com/israwala-call-girls.html

https://pihubansal.com/jagatpura-call-girls.html

https://pihubansal.com/jagmal-heri-call-girls.html

https://pihubansal.com/jaipur-call-girls.html

https://pihubansal.com/jairampura-call-girls.html

https://pihubansal.com/jaisalmer-call-girls.html

https://pihubansal.com/jaisinghpura-call-girls.html

https://pihubansal.com/jalore-call-girls.html

https://pihubansal.com/jalupura-call-girls.html

https://pihubansal.com/jamdoli-call-girls.html

https://pihubansal.com/jamnagar-house-call-girls.html

https://pihubansal.com/jamwa-ramgarh-call-girls.html

https://pihubansal.com/janata-colony-call-girls.html

https://pihubansal.com/janta-colony-call-girls.html

https://pihubansal.com/jaswant-nagar-call-girls.html

https://pihubansal.com/jawahar-circle-call-girls.html

https://pihubansal.com/jawahar-nagar-call-girls.html

https://pihubansal.com/jhajjar-call-girls.html

https://pihubansal.com/jhalawar-call-girls.html

https://pihubansal.com/jharkhand-call-girls.html

https://pihubansal.com/jharna-call-girls.html

https://pihubansal.com/jhotwara-call-girls.html

https://pihubansal.com/jhunjhunu-call-girls.html

https://pihubansal.com/jind-call-girls.html

https://pihubansal.com/jobner-call-girls.html

https://pihubansal.com/jodhpur-call-girls.html

https://pihubansal.com/johari-bazar-call-girls.html

https://pihubansal.com/jyothi-nagar-call-girls.html

https://pihubansal.com/Kahrani-call-girls.html

https://pihubansal.com/kaithal-call-girls.html

https://pihubansal.com/kalkaji-call-girls.html

https://pihubansal.com/kalwara-call-girls.html

https://pihubansal.com/kanakpura-call-girls.html

https://pihubansal.com/kanak-vihar-call-girls.html

https://pihubansal.com/kangra-call-girls.html

https://pihubansal.com/kanjhawala-call-girls.html

https://pihubansal.com/kanota-call-girls.html

https://pihubansal.com/kanwar-nagar-call-girls.html

https://pihubansal.com/kapashera-call-girls.html

https://pihubansal.com/kapriyawas-kalan-call-girls.html

https://pihubansal.com/karauli-call-girls.html

https://pihubansal.com/karishma-chakkarpur-call-girl.html

https://pihubansal.com/karishma-jharsa-call-girl.html

https://pihubansal.com/karnal-call-girls.html

https://pihubansal.com/karnataka-call-girls.html

https://pihubansal.com/karni-vihar-call-girls.html

https://pihubansal.com/karol-bagh-call-girls.html

https://pihubansal.com/kartarpura-call-girls.html

https://pihubansal.com/kerala-call-girls.html

https://pihubansal.com/keshar-vihar-call-girls.html

https://pihubansal.com/khatipura-call-girls.html

https://pihubansal.com/khushkhera-call-girls.html

https://pihubansal.com/kinnaur-call-girls.html

https://pihubansal.com/kishangarh-call-girls.html

https://pihubansal.com/kota-call-girls.html

https://pihubansal.com/kotputli-call-girls.html

https://pihubansal.com/kotra-call-girls.html

https://pihubansal.com/kotwali-call-girls.html

https://pihubansal.com/kukas-call-girls.html

https://pihubansal.com/kullu-call-girls.html

https://pihubansal.com/kurukshetra-call-girls.html

https://pihubansal.com/lajpat-nagar-call-girls.html

https://pihubansal.com/lakshadweep-call-girls.html

https://pihubansal.com/lalarpura-call-girls.html

https://pihubansal.com/lalkothi-call-girls.html

https://pihubansal.com/lal-kothi-call-girls.html

https://pihubansal.com/looking-genuine-escorts-indira-nagar.html

https://pihubansal.com/madhya-pradesh-call-girl.html

https://pihubansal.com/mahapura-call-girls.html

https://pihubansal.com/maharajpura-call-girls.html

https://pihubansal.com/maharashtra-call-girls.html

https://pihubansal.com/mahaveer-nagar-call-girls.html

https://pihubansal.com/mahendragarh-call-girls.html

https://pihubansal.com/mahesh-nagar-call-girls.html

https://pihubansal.com/mahindra-world-city-call-girls.html

https://pihubansal.com/malpura-call-girls.html

https://pihubansal.com/malviya-nagar-call-girls.html

https://pihubansal.com/mandha-call-girls.html

https://pihubansal.com/mandi-call-girls.html

https://pihubansal.com/manesar-call-girls.html

https://pihubansal.com/mangarh-khokhawala-call-girls.html

https://pihubansal.com/manipur-call-girls.html

https://pihubansal.com/manoharpura-call-girls.html

https://pihubansal.com/mansarovar-call-girls.html

https://pihubansal.com/marudhar-nagar-call-girls.html

https://pihubansal.com/maruti-nagar-call-girls.html

https://pihubansal.com/mature-call-girls-in-malibu-towne.html

https://pihubansal.com/mayur-vihar-call-girls.html

https://pihubansal.com/meethiyawas-call-girls.html

https://pihubansal.com/meghalaya-call-girls.html

https://pihubansal.com/mehrauli-call-girls.html

https://pihubansal.com/milap-nagar-call-girls.html

https://pihubansal.com/milf-call-girls-in-aerocity.html

https://pihubansal.com/model-town-call-girls.html

https://pihubansal.com/monica-ashok-vihar-call-girls.html

https://pihubansal.com/moti-nagar-call-girls.html

https://pihubansal.com/muhana-call-girls.html

https://pihubansal.com/muktanand-nagar-call-girls.html

https://pihubansal.com/mundiya-ramsar-call-girls.html

https://pihubansal.com/murlipura-call-girls.html

https://pihubansal.com/nagaland-call-girls.html

https://pihubansal.com/nagaur-call-girls.html

https://pihubansal.com/najafgarh-call-girls.html

https://pihubansal.com/nand-nagri-call-girls.html

https://pihubansal.com/naradpura-call-girls.html

https://pihubansal.com/narayan-vihar-call-girls.html

https://pihubansal.com/narela-call-girls.html

https://pihubansal.com/narsinghpura-call-girls.html

https://pihubansal.com/naughty-call-girls-banjara-hills.html

https://pihubansal.com/neemrana-call-girls.html

https://pihubansal.com/neha-dlf-phase-4-call-girl.html

https://pihubansal.com/nehru-nagar-call-girls.html

https://pihubansal.com/nepali-call-girls-in-sector-83.html

https://pihubansal.com/new-colony-call-girls.html

https://pihubansal.com/new-delhi-call-girls.html

https://pihubansal.com/newly-married-call-girls-bardez.html

https://pihubansal.com/nindar-call-girls.html

https://pihubansal.com/nirman-nagar-call-girls.html

https://pihubansal.com/niwai-call-girls.html

https://pihubansal.com/niwaru-call-girls.html

https://pihubansal.com/north-delhi-call-girls.html

https://pihubansal.com/north-east-delhi-call-girls.html

https://pihubansal.com/nuh-call-girls.html

https://pihubansal.com/omaxe-city-call-girls.html

https://pihubansal.com/orissa-call-girls.html

https://pihubansal.com/padampura-call-girls.html

https://pihubansal.com/palam-vihar-call-girls.html

https://pihubansal.com/paldi-meena-call-girls.html

https://pihubansal.com/pali-call-girls.html

https://pihubansal.com/palwal-call-girls.html

https://pihubansal.com/panchkula-call-girls.html

https://pihubansal.com/panchyawala-call-girls.html

https://pihubansal.com/panipat-call-girls.html

https://pihubansal.com/paota-call-girls.html

https://pihubansal.com/papri-call-girls.html

https://pihubansal.com/pataudi-call-girls.html

https://pihubansal.com/patel-nagar-call-girls.html

https://pihubansal.com/patrakar-colony-call-girls.html

https://pihubansal.com/Pavti-call-girls.html

https://pihubansal.com/perfect-call-girls-in-kukatpally.html

https://pihubansal.com/phulera-call-girls.html

https://pihubansal.com/pink-city-call-girls.html

https://pihubansal.com/pratapgarh-call-girls.html

https://pihubansal.com/pratap-nagar-call-girls.html

https://pihubansal.com/preet-vihar-call-girls.html

https://pihubansal.com/prithviraj-nagar-call-girls.html

https://pihubansal.com/private-call-girls-in-suncity..html

https://pihubansal.com/puducherry-call-girls.html

https://pihubansal.com/punjab-call-girls.html

https://pihubansal.com/punjabi-bagh-call-girls.html

https://pihubansal.com/purani-basti-call-girls.html

https://pihubansal.com/quality-call-girls-in-vadapalani.html

https://pihubansal.com/rabiya-dlf-phase-1-call-girl.html

https://pihubansal.com/raja-park-call-girls.html

https://pihubansal.com/rajasthan-call-girls.html

https://pihubansal.com/rajasthan-housing-board-colony-call-girls.html

https://pihubansal.com/rajouri-garden-call-girls.html

https://pihubansal.com/rajsamand-call-girls.html

https://pihubansal.com/ramnagar-call-girls.html

https://pihubansal.com/ram-nagar-call-girls.html

https://pihubansal.com/ramsinghpura-call-girls.html

https://pihubansal.com/ratan-vihar-call-girls.html

https://pihubansal.com/rates.html low rate call girl in jaipur

https://pihubansal.com/ravishing-escorts-ameerpet.html

https://pihubansal.com/reasonable-price-call-girls-in-uppal.html

https://pihubansal.com/renwal-call-girls.html

https://pihubansal.com/renwal-manji-call-girls.html

https://pihubansal.com/rewari-call-girls.html

https://pihubansal.com/rohini-call-girls.html

https://pihubansal.com/rohini-nagar-call-girls.html

https://pihubansal.com/rohtak-call-girls.html

https://pihubansal.com/ruchika-dlf-phase-2-call-girl.html

https://pihubansal.com/russian-call-girls-in-mumbai.html

https://pihubansal.com/saket-Call-girls.html

https://pihubansal.com/saraswati-vihar-call-girls.html

https://pihubansal.com/sarita-vihar-call-girls.html

https://pihubansal.com/sawai-madhopur-call-girls.html

https://pihubansal.com/sector-1-uti-call-girls.html

https://pihubansal.com/sector-10-uti-call-girls.html

https://pihubansal.com/Sector-11-UIT-call-girls.html

https://pihubansal.com/sector-14-call-girls.html

https://pihubansal.com/sector-34-call-girls.html

https://pihubansal.com/sector-37-call-girls.html

https://pihubansal.com/sector-41-call-girls.html

https://pihubansal.com/sector-42-call-girls.html

https://pihubansal.com/sector-100-call-girls.html

https://pihubansal.com/sector-101-call-girls.html

https://pihubansal.com/sector-102-call-girls.html

https://pihubansal.com/sector-103-call-girls.html

https://pihubansal.com/sector-104-call-girls.html

https://pihubansal.com/sector-105-call-girls.html

https://pihubansal.com/sector-106A-call-girls.html

https://pihubansal.com/sector-106-call-girls.html

https://pihubansal.com/sector-107A-call-girls.html

https://pihubansal.com/sector-107-call-girls.html

https://pihubansal.com/Sector-108-call-girls.html

https://pihubansal.com/sector-109-call-girls.html

https://pihubansal.com/Sector-110-call-girls.html

https://pihubansal.com/Sector-111-call-girls.html

https://pihubansal.com/Sector-112-call-girls.html

https://pihubansal.com/sector-113-call-girls.html

https://pihubansal.com/sector-114-call-girls.html

https://pihubansal.com/seelampur-call-girls.html

https://pihubansal.com/seemapuri-call-girls.html

https://pihubansal.com/sensual-vip-escort-jayanagar.html

https://pihubansal.com/sensuous-call-girls-in-badichowdi.html

https://pihubansal.com/shahdara-call-girls.html

https://pihubansal.com/shastri-nagar-call-girls.html

https://pihubansal.com/shimla-call-girls.html

https://pihubansal.com/shivaji-place-call-girls.html

https://pihubansal.com/shruti-dlf-phase-3-call-girl.html

https://pihubansal.com/sikar-call-girls.html

https://pihubansal.com/sikkim-call-girls.html

https://pihubansal.com/sirmaur-call-girls.html

https://pihubansal.com/sirohi-call-girls.html

https://pihubansal.com/sirsa-call-girls.html

https://pihubansal.com/sizzling-call-girls-in-sohna.html

https://pihubansal.com/solan-call-girls.html

https://pihubansal.com/sonipat-call-girls.html

https://pihubansal.com/soumya-dlf-phase-5-call-girl.html

https://pihubansal.com/south-city-call-girls.html

https://pihubansal.com/south-delhi-call-girls.html

https://pihubansal.com/south-east-delhi-call-girls.html

https://pihubansal.com/south-west-delhi-call-girls.html

https://pihubansal.com/sri-ganganagar-call-girls.html

https://pihubansal.com/sushant-lok-call-girls.html

https://pihubansal.com/taku-pala-village-call-girls.html

https://pihubansal.com/tamil-nadu-call-girls.html

https://pihubansal.com/tapukara-call-girls.html

https://pihubansal.com/teacher-Colony-call-girls.html

https://pihubansal.com/teenager-call-girls-in-sector-14.html

https://pihubansal.com/tijara-call-girls.html

https://pihubansal.com/time-pass-call-girls-in-panjim.html

https://pihubansal.com/tonk-call-girls.html

https://pihubansal.com/top-class-call-girls-available-in-frazer-town.html

https://pihubansal.com/top-rated-call-girls-in-sector-15.html

https://pihubansal.com/traditional-call-girls-in-south-city-1.html

https://pihubansal.com/tripura-call-girls.html

https://pihubansal.com/udaipur-call-girls.html

https://pihubansal.com/udyog-vihar-call-girls.html

https://pihubansal.com/una-Call-girls.html

https://pihubansal.com/uttarakhand-call-girls.html

https://pihubansal.com/uttar-pradesh-call-girls.html

https://girlgoa.in/virgin-call-girls-in-mahipalpur.html

https://girlgoa.in/beauty-call-girls-in-indore.html

https://girlgoa.in/adult-call-girls-in-bhopal.html

https://girlgoa.in/foreplay-call-girls-in-udaipur.html

https://girlgoa.in/hardcore-call-girls-in-manesar.html

https://girlgoa.in/hottest-call-girls-in-pune.html

https://girlgoa.in/luxury-hotels-call-girls-in-Ahmedabad.html

https://girlgoa.in/nepali-call-girls-in-kolkata.html

https://girlgoa.in/roasted-call-girls-in-surat.html

https://girlgoa.in/young-call-girls-in-vadodara.html

https://girlgoa.in/energetic-call-girls-in-ghaziabad.html

https://girlgoa.in/unrated-call-girls-in-faridabad.html

https://girlgoa.in/relationship-call-girls-in-meerut.html

https://girlgoa.in/cutipie-call-girls-in-navi-mumbai.html

https://girlgoa.in/crazy-call-girls-in-jabalpur.html

https://girlgoa.in/gorgeous-call-girls-in-gurgaon.html

https://girlgoa.in/graceful-call-girls-in-dehradun.html

https://girlgoa.in/ravishing-call-girls-in-ajmer.html

https://girlgoa.in/latina-call-girls-in-mangalore.html

https://girlgoa.in/horny-call-girls-in-new-delhi.html

https://girlgoa.in/alcoholic-call-girls-in-manali.html

https://girlgoa.in/longhair-call-girls-in-vishakapatnam.html

https://girlgoa.in/spicy-call-girls-in-nagpur.html

https://girlgoa.in/official-call-girls-in-patna.html

https://girlgoa.in/glamour-call-girls-in-jamshedpur.html

https://girlgoa.in/pink-lips-call-girls-in-kochi.html

https://girlgoa.in/dream-call-girls-in-chandigarh.html

https://girlgoa.in/jeans-call-girls-in-guwahati.html

https://girlgoa.in/hourly-call-girls-in-madurai.html

https://girlgoa.in/amazing-call-girls-in-nasik.html

https://girlgoa.in/budget-call-girls-in-allahabad.html

https://girlgoa.in/skirt-call-girls-in-bikaner.html

https://girlgoa.in/secretary-call-girls-in-silliguri.html

https://girlgoa.in/nasty-call-girls-in-bhilwara.html

https://girlgoa.in/flexible-call-girls-in-alwar.html

https://girlgoa.in/strip-call-girls-in-panipat.html

https://girlgoa.in/outdoor-call-girls-in-fatehpur.html

https://girlgoa.in/fantasy-call-girls-in-shimla.html

https://girlgoa.in/independent-call-girls-in-habra.html

https://girlgoa.in/adorable-call-girls-in-neemrana.html

https://girlgoa.in/hottest-call-girls-in-gonda.html

https://girlgoa.in/wonderful-call-girls-in-greater-noida.html

https://girlgoa.in/model-escort-services-in-goa.html

https://girlgoa.in/riya-model-escort-in-goa.html

https://girlgoa.in/beautifull-sexy-call-girls-gomti-nagar.html

https://girlgoa.in/no-advance-cash-paymant-call-girls-hazratganj.html

https://girlgoa.in/high-class-call-girl-in-alambagh.html

https://girlgoa.in/air-hostess-call-girls-in-jankipuram.html

https://girlgoa.in/call-girls-service-in-mahanagar.html

https://girlgoa.in/near-me-Call-girls-in-indira-nagar.html

https://girlgoa.in/full-day-escorts-in-sushant-golf-city.html

https://girlgoa.in/vip-call-girls-service-in-ashiyana-colony.html

https://girlgoa.in/casual-sex-call-girls-aliganj.html

https://girlgoa.in/queen-call-girls-in-rajaji-puram.html

https://girlgoa.in/foreplay-call-girls-in-amausi.html

https://girlgoa.in/hardcore-call-girls-in-aishbagh.html

https://girlgoa.in/energetic-call-girls-in-jhalamand.html

https://girlgoa.in/cute-call-girls-in-gangana-road.html

https://girlgoa.in/stunning-call-girls-in-sardarpura.html

https://girlgoa.in/ravishing-call-girls-in-kabir-nagar.html

https://girlgoa.in/natural-beauty-call-girls-in-mandore.html

https://girlgoa.in/hottest-call-girls-in-ashok-nagar.html

============================================https://girls69.co.in/

https://girls69.co.in/

https://girls69.co.in/about.html

https://girls69.co.in/services.html

https://girls69.co.in/gallery.html

https://girls69.co.in/rates.html

https://girls69.co.in/contact.html

https://girls69.co.in/megan-busty-escort-sevice-dlf-phase-1.html

https://girls69.co.in/dlf-phase-2-gurugram-call-girls.html

https://girls69.co.in/dlf-phase-3-escorts.html

https://girls69.co.in/escorts-service-dlf-phase-4-city-area.html

https://girls69.co.in/gurugram-phase-5-call-girls-service.html

https://girls69.co.in/golf-course-road-call-girls-service.html

https://girls69.co.in/manesar-escort-service.html

https://girls69.co.in/neemrana-beauty-call-girls.html

https://girls69.co.in/sushant-lok-escorts-service.html

https://girls69.co.in/busty-call-girls-in-mahipalpur.html

https://girls69.co.in/independent-bhiwadi-escorts-service.html

https://girls69.co.in/sector-41-escorts-girl-service.html

https://girls69.co.in/sexy-call-girls-in-sector-42.html

https://girls69.co.in/erotic-escorts-service-in-sector-43.html

https://girls69.co.in/gurugram-call-girls-sector-44.html

https://girls69.co.in/college-girls-in-sector-45.html

https://girls69.co.in/sector-46-area-escorts-service.html

https://girls69.co.in/call-girls-sector-47-gurugram.html

https://girls69.co.in/air-hostess-call-girls-sector-48.html

https://girls69.co.in/pornstar-call-girls-in-sector-49.html

https://girls69.co.in/escorts-service-gurugram-near-sector-50.html

https://girls69.co.in/call-girls-in-sector-29-gurugram.html

https://girls69.co.in/haryana-call-girls-service.html

https://girls69.co.in/high-profile-escorts-calangute-beach.html

https://girls69.co.in/foreigner-escorts-girls-service-palolem-beach.html

https://girls69.co.in/elite-call-girls-service-goa-baga-beach.html

================================================https://girls69.info/

https://girls69.info/

https://girls69.info/about-gurugram-escort.html

https://girls69.info/cheap-escorts-service.html

https://girls69.info/gurugram-escort-gallery.html

https://girls69.info/escort-service-rates.html

https://girls69.info/contact-us.html

https://girls69.info/sushant-lok-college-girls-escorts.html

https://girls69.info/air-hostess-girls-in-sector-29.html

https://girls69.info/call-girl-service-sector-6-noida.html

https://girls69.info/call-girls-sector-9-noida.html

https://girls69.info/call-girls-services-sector-1.html

https://girls69.info/college-escorts-girls.html

https://girls69.info/escort-sector-10-noida.html

https://girls69.info/escorts-girl-sector-7-noida.html

https://girls69.info/escorts-service-sector-2-noida.html

https://girls69.info/faridabad-escort-service.html

https://girls69.info/gurugram-call-girls.html

https://girls69.info/gurugram-escorts.html

https://girls69.info/high-profile-escorts-in-sector-53.html

https://girls69.info/housewife-escort-service-sector-77.html

https://girls69.info/monika-high-profile-escorts-sector-57.html

https://girls69.info/nikita-independent-escorts-sector-18.html

https://girls69.info/noida-sector-5-escorts-services.html

https://girls69.info/ragini-call-girl-sector-24.html

https://girls69.info/russian-escorts-gurugram.html

https://girls69.info/sector-3-escorts-services-noida.html

https://girls69.info/sector-4-noida-escorts-girls.html

https://girls69.info/sector-8-escort-services-noida.html

https://girls69.info/greater-noida-escorts.html

https://girls69.info/vip-model-escorts-gurgaon.html

=================================================https://girls69.net/

https://girls69.net/

https://girls69.net/about.html

https://girls69.net/rates.html

https://girls69.net/russian-escort-lisa.html

https://girls69.net/escort-girl-profile.html

https://girls69.net/contact.html

https://girls69.net/sushant-lok-call-girls.html

https://girls69.net/bhiwadi-call-girls.html

https://girls69.net/manesar-call-girls.html

https://girls69.net/greater-noida-call-girls.html

https://girls69.net/noida-sec-2-call-girl.html

https://girls69.net/rajeev-chowk-call-girl.html

https://girls69.net/mayur-vihar-call-girl.html

https://girls69.net/dlf-pahse-1-call-girl.html

https://girls69.net/dlf-pahse-2-call-girl.html

https://girls69.net/imt-manesar-girls.html

https://girls69.net/call-girl-phase-1.html

https://girls69.net/phase-2-call-girls.html

https://girls69.net/phase-4-escort-service.html

https://girls69.net/sohna-road-call-girl.html

https://girls69.net/sector-54-suncity-call-girls.html

https://girls69.net/sector-42-escort.html

https://girls69.net/escort-service-phase-5.html

https://girls69.net/gurugram-sector-call-girl.html

https://girls69.net/escort-service-gurgaon.html

https://girls69.net/joining-vacancy-for-escorts.html

https://girls69.net/call-girls-faridabad.html

https://girls69.net/dating-girl-sector-80.html

https://girls69.net/hardcore-call-girls-sector-54.html

https://girls69.net/high-profile-neemrana-call-girls.html

https://girls69.net/cheap-rate-call-girls-sector-29.html

https://girls69.net/bold-call-girls-in-goa.html

https://girls69.net/busty-call-girls-in-aerocity.html

https://girls69.net/female-escorts-sector-43.html

https://girls69.net/russian-escort-services-hyderabad.html

https://girls69.net/best-female-escorts-sector-28.html

https://girls69.net/sexy-call-girls-sector-45.html

https://girls69.net/housewife-call-girl-mumbai.html

https://girls69.net/beauty-call-girl-jaipur.html

https://girls69.net/outdoor-call-girls-delhi.html

https://girls69.net/dating-escort-lucknow.html

https://girls69.net/lovely-call-girls-agra.html

https://girls69.net/cheapest-call-girls-in-gurugram.html

https://girls69.net/call-girls-in-chakkerpur.html

https://girls69.net/online-call-girls-sector-15.html

https://girls69.net/pink-lips-escort-sector-46.html

https://girls69.net/sensual-vip-escorts-in-sector-47.html

https://girls69.net/riya-malhotra-gurgaon-escorts.html

https://girls69.net/kriti-bhiwadi-call-girls.html

https://girls69.net/aashi-manesar-call-girls.html

https://girls69.net/sneha-ghupta-mahipalpur.html

https://girls69.net/meghna-dlf-phase-1.html

https://girls69.net/sushmita-dlf-phase-2.html

https://girls69.net/kritika-neemrana-escort.html

https://girls69.net/palak-sector-29-call-girl.html

https://girls69.net/monika-aerocity-call-girl.html

https://girls69.net/megan-rewari-call-girls.html

https://girls69.net/komal-sector-43-call-girl.html

https://girls69.net/priyanka-sushant-lok-call-girl.html

https://girls69.net/kaavya-noida-escort.html

https://girls69.net/vaishnavi-sector-33-call-girls.html

https://girls69.net/yomita-sector-14-call-girl.html

https://girls69.net/kushboo-sector-21-escort.html

https://girls69.net/karishma-huda-city-canter.html

https://girls69.net/martha-chakkarpur-escort.html

https://girls69.net/rajda-sikanderpur-escort.html

https://girls69.net/sophie-sector-12-escort.html

https://girls69.net/priti-lucknow-call-girls.html

https://girls69.net/nikita-sector-55-call-girls.html

https://girls69.net/dimple-sector-56-escorts.html

https://girls69.net/ruchika-sector-62-escort.html

https://girls69.net/model-call-girls-hitech-city.html

https://girls69.net/college-manesar-call-girls.html

https://girls69.net/lovely-call-girls-gachiwali.html

https://girls69.net/best-call-girls-ameerpet.html

https://girls69.net/lovely-escorts-jublihills.html

https://girls69.net/mallu-call-girls-telangana.html

https://girls69.net/bangali-escorts-kukatpally.html

https://girls69.net/call-girls-madhapur.html

https://girls69.net/escorts-in-lakdi-ka-pull.html

https://girls69.net/college-escorts-hyderabad.html

https://girls69.net/prostitute-in-chennai.html

https://girls69.net/call-girls-in-t-nager.html

https://girls69.net/love-full-night-nugambakkam.html

https://girls69.net/sexy-call-girls-in-mount-rode.html

https://girls69.net/professional-escorts-guindy.html

https://girls69.net/call-girls-in-maylapur.html

https://girls69.net/cute-call-girls-in-royapetta.html

https://girls69.net/angel-call-girls-anna-salai.html

https://girls69.net/elite-noida-girls.html

https://girls69.net/premium-imt-manesar-girls.html

https://girls69.net/high-profile-bhiwadi-girls.html

https://girls69.net/independent-faridabad-girls.html

https://girls69.net/vip-escorts-gurgaon-escort.html

https://girls69.net/hardcore-gurugram-Call-Girls.html

https://girls69.net/private-call-girls-dlf-city.html

https://girls69.net/luxury-hotels-escorts-golf-course-road.html

https://girls69.net/big-tits-call-girls-in-sector-75.html

https://girls69.net/blonde-call-girls-sector-71.html

https://girls69.net/cheap-escorts-service-paharganj.html

https://girls69.net/curvy-figure-girls-in-sector-72.html

https://girls69.net/dating-call-girls-hauz-khas.html

https://girls69.net/hina-sexy-girl-in-sector-78.html

https://girls69.net/juicy-escorts-service-sector-79.html

https://girls69.net/body-massage-in-gurugram.html

https://girls69.net/blonde-call-girls-in-goa.html

https://girls69.net/sushantlok-vip-call-girls.html

https://girls69.net/mahipalpur-russian-call-girls.html

https://girls69.net/call-girls-in-ardee-city-gurugram.html

https://girls69.net/badshahpur-call-girls.html

https://girls69.net/call-girls-in-bawal.html

https://girls69.net/air-hostess-escort-services.html

https://girls69.net/model-escort-services.html

https://girls69.net/call-girl-whatsapp-number.html

https://girls69.net/juicy-sector-29-call-girls.html

https://girls69.net/sector-36-independent-call-girls.html

https://girls69.net/russian-escort-services-in-hyderabad.html

https://girls69.net/call-girls-in-sector-55.html

https://girls69.net/beauty-call-girl-sector-50.html

https://girls69.net/sector-14-call-girls.html

https://girls69.net/sensual-vip-escort-girl-sector-32.html

https://girls69.net/outdoor-call-girls-in-sector-67.html

https://girls69.net/pink-lips-call-girls-sector-12.html

https://girls69.net/housewife-escort.html

https://girls69.net/busty-girls.html

https://girls69.net/call-girls-in-gurugram-sector-33.html

https://girls69.net/call-girls-in-sector-40-gurugram.html

https://girls69.net/housewife-escort-services.html

https://girls69.net/call-girls-sector-35-gurugram.html

https://girls69.net/cheap-escort-girls.html

https://girls69.net/college-girl-escorts.html

https://girls69.net/monika-model-escorts-services.html

https://girls69.net/escort-girl-services-sector-39-gurugram.html

https://girls69.net/escorts-service-in-sector-36.html

https://girls69.net/russian-escort-services.html

https://girls69.net/gurugram-call-girls-rates.html

https://girls69.net/gurugram-call-girls-sector-34.html

https://girls69.net/gurugram-escort-services-sector-15.html

https://girls69.net/gurugram-escort-services-sector-16.html

https://girls69.net/gurugram-escort-services-sector-17.html

https://girls69.net/gurugram-escort-services-sector-18.html

https://girls69.net/gurugram-escort-services-sector-19.html

https://girls69.net/gurugram-escort-services-sector-20.html

https://girls69.net/gurugram-escort-services-sector-21.html

https://girls69.net/gurugram-escort-services-sector-22.html

https://girls69.net/gurugram-escort-services-sector-23.html

https://girls69.net/gurugram-escort-services-sector-24.html

https://girls69.net/gurugram-escort-services-sector-25.html

https://girls69.net/gurugram-escort-services-sector-26.html

https://girls69.net/gurugram-escort-services-sector-27.html

https://girls69.net/gurugram-escort-services-sector-28.html

https://girls69.net/gurugram-escort-services-sector-29.html

https://girls69.net/gurugram-escort-services-sector-30.html

https://girls69.net/gurugram-escort-services-sector-31.html

https://girls69.net/gurugram-escort-services-sector-32.html

https://girls69.net/gurugram-escort-services-sector-37.html

https://girls69.net/gurugram-escort-services-sector-38.html

https://girls69.net/gurugram-phase-I-escort-services.html

https://girls69.net/gurugram-phase-II-escort-services.html

https://girls69.net/gurugram-phase-III-escort-services.html

https://girls69.net/gurugram-phase-IV-escort-services.html

https://girls69.net/gurugram-phase-V-escort-services.html

https://girls69.net/high-class-escort-services.html

https://girls69.net/low-price-hot-escorts-uppal.html

https://girls69.net/russain-escorts-madhapur.html

https://girls69.net/high-profile-escorts-banjara-hills.html

https://girls69.net/vip-escorts-begumpet.html

https://girls69.net/somajiguda-call-girls-services.html

https://girls69.net/cute-call-girls-services-manikonda.html

https://girls69.net/evening-call-girls-miyapur.html

https://girls69.net/open-mind-call-girls-kondapur.html

https://girls69.net/independent-call-girls-adyar.html

https://girls69.net/elite-call-girls-anna-nagar.html

https://girls69.net/model-call-girls-besant-nagar.html

https://girls69.net/north-indian-call-girls-kotturpuram.html

https://girls69.net/premium-call-girls-mylapore.html

https://girls69.net/gujarati-call-girl-nungambakkam.html

https://girls69.net/young-college-girls-r-a-puram.html

https://girls69.net/dating-girls-in-thiruvanmiyur.html

https://girls69.net/big-boobs-escorts-teynampet.html

https://girls69.net/sexy-escorts-vadapalani.html

https://girls69.net/party-escorts-in-agra.html

https://girls69.net/teenage-escorts-in-lucknow.html

https://girls69.net/dating-girls-in-allahabad.html

https://girls69.net/high-society-girls-kanpur.html

https://girls69.net/platinum-escorts-fatehpur-sikri.html

https://girls69.net/housewife-call-girls-meerut.html

https://girls69.net/luxury-escorts-aligarh.html

https://girls69.net/female-escorts-agency-chennai.html

https://girls69.net/your-love-desires-madurai.html

https://girls69.net/gorgeous-female-escorts-dwarka.html

https://girls69.net/best-female-escort-agency-mumbai.html

https://girls69.net/door-step-bandra-bandstand.html

https://girls69.net/physical-intimacy-malabar-hill.html

https://girls69.net/busty-escorts-bandra.html

https://girls69.net/young-call-girls-versova.html

===============================https://girlsrent.in

https://girlsrent.in/Call Girls in Gurugram

https://girlsrent.in/vip-call-girls-gurugram.htm

https://girlsrent.in/best-call-girls-in-gurugram.htm

https://girlsrent.in/gurugram-call-girl-photos.htm

https://girlsrent.in/cheap-call-girls-gurugram.htm