[논문 리뷰] Stable Diffusion - High-Resolution Image Synthesis with Latent Diffusion Models(2022)

[논문 리뷰]

Paper: High-Resolution Image Synthesis with Latent Diffusion Models

🔍1. Introduction

최근 이미지 생성 분야 빠르게 발전 중.

특히 복잡한 자연 이미지 -> 고해상도로 생성하는 작업은 연산 비용이 매우 큼.

기존 방식은 다음 두 가지로 나뉨.

- Autoregressive (AR) Transformer 기반 모델: 대규모 파라미터로 고성능을 내지만, 학습에 막대한 연산 자원이 필요함. 대표적으로 수백~천 단위 GPU일 소요.

- GAN 기반 모델: 효율적으로 고품질 이미지를 생성할 수 있지만, mode collapse나 학습 불안정 같은 문제가 존재. 데이터 분포가 복잡할수록 성능 저하.

최근에는 Diffusion Model이 이미지 생성의 새로운 대안으로 부상 중.

확률적 노이즈 제거 과정을 기반으로 하며, 다양한 조건부/비조건부 생성 작업에서 안정적인 성능을 보임.

특히, GAN 대비 학습이 안정적이고, AR 모델 대비 파라미터 수가 적음.

다만, 기존 diffusion 모델은 픽셀 공간에서 직접 동작

-> 학습과 추론 비용이 매우 큼.

=> diffusion 모델은 자원 접근성이 제한되고, 실제 활용도 어렵다는 문제가 있음.

=> 학습과 추론에서 연산량을 줄이면서도 성능을 유지할 수 있는 구조가 필요함.

Departure to Latent Space

본 논문은 diffusion 모델을 latent 공간에서 학습하도록 구조를 바꿈.

기존 diffusion 모델 학습 과정을 분석해보면, 두 단계로 나눌 수 있음.

- 지각적 압축 단계: 고주파 세부 정보를 제거하지만, 의미 있는 표현은 아직 학습하지 않음.

- 의미적 압축 단계: 데이터의 의미 구조를 학습함.

이 구조를 바탕으로, 이미지와 지각적으로 동등하지만 연산적으로 더 효율적인 latent space를 학습하고, 이 공간에서 diffusion을 수행함.

이 방식을 Latent Diffusion Models (LDM)라고 정의함.

Autoencoder로 latent space를 먼저 학습하고, 이후 diffusion 모델은 이 latent 공간에서만 학습하면 됨.

Autoencoder는 재사용 가능하기 때문에 여러 생성 작업에 쉽게 적용 가능.

(ex. 텍스트 조건 생성, 이미지 조건 생성 등.)

contributions

- 기존 transformer 기반 접근과 달리, 고해상도 데이터에 효율적으로 확장 가능하고, 압축률이 낮아도 높은 복원 성능을 유지함.

- 이미지 생성, 인페인팅, 슈퍼해상도 등 다양한 작업에서 높은 성능을 달성하면서도 연산 비용을 크게 줄임.

- encoder/decoder와 prior를 동시에 학습하지 않고 분리함으로써, 복원과 생성 사이의 균형 조절이 필요 없음. latent 공간 정규화도 최소화 가능.

- super-resolution, inpainting 같은 task에서는 convolution 기반으로 작동 가능하여 고해상도 이미지도 처리 가능.

- cross-attention 기반 조건부 생성 구조 제안함. 텍스트, 레이아웃 등 다양한 조건으로 이미지 생성 가능.

- pretrained model과 코드 공개함. 다양한 downstream task에 재사용 가능.

✅2. Related work

이미지는 고차원 데이터이기 때문에 생성 모델 입장에서 다루기 까다로움.

기존 각 모델별 특징

- GAN: 고해상도 이미지 생성에 유리하고 샘플 품질도 좋지만, 학습이 불안정하고 전체 데이터 분포를 잘 커버하지 못함.

- VAE / Flow-based 모델: 학습은 안정적이지만, 샘플 품질이 GAN보다 떨어짐.

- Autoregressive 모델 (ARM): 밀도 추정 성능은 좋지만, 구조가 복잡하고 시퀀셜하게 샘플링해야 하므로 고해상도에는 비효율적임.

- Pixel-based 학습의 문제점: 고주파 잡음 같은 지각적으로 중요하지 않은 정보에까지 모델이 용량을 낭비하게 되어 학습과 추론 비용이 큼.

Diffusion Models (DM)

최근에는 Diffusion Probabilistic Model이 등장하여 밀도 추정, 샘플 품질 측면에서 모두 SOTA 달성.

특히 UNet 기반 구조를 사용했을 때 이미지 데이터에 대한 inductive bias와 잘 맞음.

재구성 기반 loss를 적절히 리웨이팅하면, DM은 일종의 손실 압축기 역할을 하며 품질/압축 trade-off 조정 가능.

단점: 여전히 픽셀 공간에서 동작하기 때문에 연산 비용이 큼.

본 논문에서 제안하는 Latent Diffusion Model (LDM) 은 이 문제를 해결하기 위해 latent space에서 diffusion을 수행함. 연산량이 크게 줄고, 품질 손실도 거의 없음.

Two-Stage Image Synthesis

고해상도 생성을 위해 두 단계로 분리하는 접근이 많이 제안됨.

- VQ-VAE + Transformer: discrete latent 공간에 대해 autoregressive prior를 학습함.

- VQGAN: 첫 번째 단계에서 perceptual loss + adversarial loss 기반 압축 수행. 이후 Transformer로 생성.

- DALL-E: 텍스트와 이미지를 함께 이산 공간으로 압축하고 joint distribution 학습.

단점: latent를 너무 많이 압축해야 AR 학습이 가능하다는 점. 이로 인해 복원 품질 저하 or 파라미터 수 폭증 문제가 생김.

LDM은 convolutional backbone을 사용하여 더 높은 해상도의 latent도 효율적으로 다룰 수 있음. 따라서 압축률을 자유롭게 조절하면서도 높은 복원 품질 확보 가능.

✅3. Method

기존 diffusion model

: 고해상도 이미지를 생성할 때, perceptually 중요하지 않은 정보를 무시할 수 있음에도 불구하고 픽셀 공간에서의 연산 자체가 매우 고비용임.

특히 학습과 추론 모두에서 수많은 반복 연산과 gradient 계산이 필요함.

본 논문에서는 압축 단계와 생성 단계를 분리함.

- Autoencoder를 먼저 학습시켜, 이미지와 지각적으로 유사하지만 연산량이 훨씬 적은 latent 공간을 정의함.

- 이후 Diffusion Model은 이 latent 공간에서만 학습 및 샘플링을 수행함.

- 고차원 픽셀 공간이 아닌, 저차원 latent 공간에서 연산을 수행하기 때문에 훈련과 샘플링 속도가 빨라짐.

- UNet 구조의 inductive bias 덕분에 spatial 구조가 있는 데이터에 대해 효과적으로 학습 가능함. 따라서 VQGAN처럼 품질 손해 감수하면서 심하게 압축할 필요 없음.

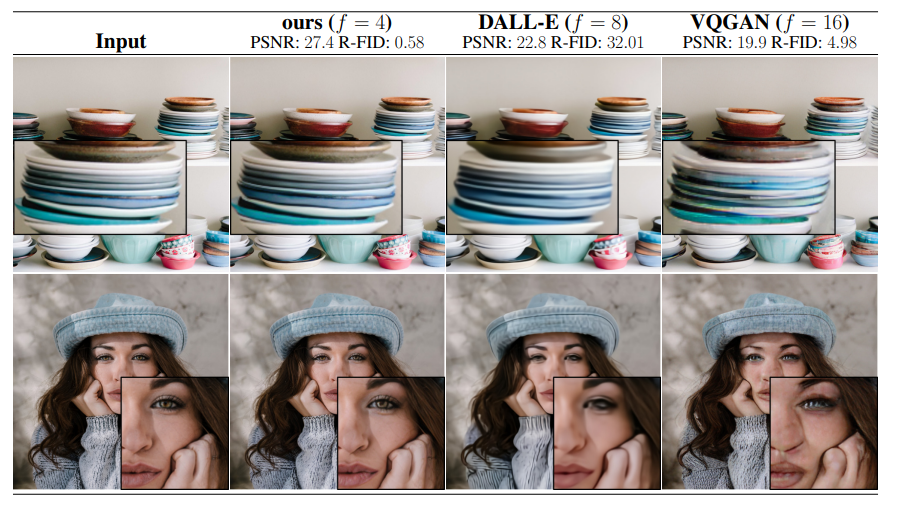

3.1. Perceptual Image Compression

고품질 이미지를 효율적으로 생성하기 위해, 먼저 이미지 자체를 지각적으로 압축(perceptual compression) 하는 autoencoder를 학습함.

입력이미지

- Encoder E(x)=z: 이미지 x를 latent z로 압축 (해상도는 H/f×W/f)

- Decoder D(z)= x: latent에서 원본 이미지 복원

- f : 다운샘플링 비율 (ex. f=4,8,16)

Perceptual loss + PatchGAN 기반 adversarial loss 사용

- L2, L1 같은 픽셀 기반 손실만 사용할 경우 생기는 블러 현상 방지

- 지역적 특성을 보존하며 이미지 manifold에 가까운 재구성

정규화 방식

latent 공간이 고분산(high variance)이 되는 것을 방지하기 위해.

- KL-reg.: VAE처럼 latent를 표준 정규분포에 가깝게 만듦 (KL divergence penalty 부여)

- VQ-reg.: VQGAN처럼 quantization 레이어 사용 (단, 이 레이어는 decoder에 통합됨)

두 방식 모두 latent 공간의 안정성과 표현력 향상을 목표로 함.

LDM은 2D 구조를 유지한 latent 공간을 그대로 사용함.

=> 약한 압축률로도 높은 재구성 성능 확보 가능.

3.2. Latent Diffusion Models

Diffusion Model

: 원래 고차원 픽셀 공간에서 데이터를 점점 노이즈화한 후, 이를 역방향으로 복원하는 과정을 학습하는 방식.

= 고정된 Markov Chain의 역과정을 모델링하는 것과 동일.

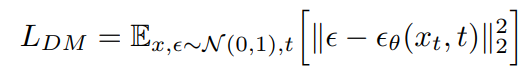

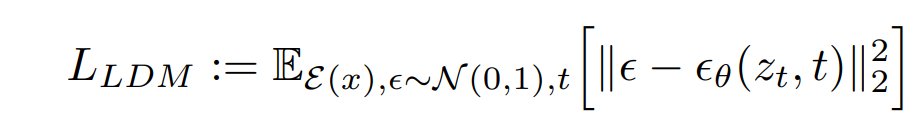

기존 diffusion 모델

노이즈가 추가된 이미지로부터 원래 노이즈 ϵ을 예측하도록 학습하는 것이 목표

xt: 원본 이미지에 시간 t만큼 노이즈 추가한 것

ϵθ: 노이즈 예측 모델

Latent 공간에서의 Diffusion

autoencoder로 압축한 latent 공간 z=E(x)에서 수행.

- latent 공간

- 지각적으로 중요한 정보만 포함

- 고주파 세부 정보는 제거

- 차원이 낮아져 학습 및 샘플링 비용 대폭 감소

- z_t = latent z = E(x)에 노이즈 추가

학습 끝난 후: latent 샘플 z∼p(z)을 생성 - decoder D(z)를 통해 최종 이미지 복원

기존

: transformer 기반 autoregressive 모델로 discrete latent 공간 학습

:연산량 많고 spatial 구조 무시함

LDM

: UNet을 그대로 활용

: 2D convolution 기반 inductive bias를 유지함

공간 구조 보존 + 저차원 학습 가능 + 고해상도 생성에 유리

3.3. Conditioning Mechanisms

기존 diffusion model도 조건부 생성(p(z|y)) 학습이 가능함.

다만, 지금까지는 클래스 레이블이나 블러 처리된 입력 이미지 같은 단순한 조건만 사용하는 경우가 대부분이었음.

본 논문에서는

다양한 조건(텍스트, 레이아웃, 세그멘테이션 맵 등)에 대해 더 유연한 조건부 생성을 가능하게 하기 위해 cross-attention 기반 조건부 LDM 구조를 제안함.

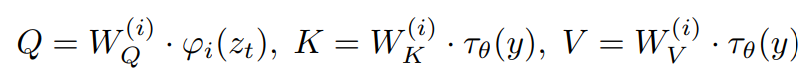

구성

- 조건 y(ex. 텍스트 prompt, 세그멘테이션 맵 등)를 latent 생성에 반영하기 위해 cross-attention 메커니즘 사용

- 조건 y는 도메인 전용 인코더 τθ(y)를 통해 중간 표현 𝜏𝜃(y)∈R^(Mxd_𝜏)로 변환됨

-> UNet의 중간 layer에 cross-attention을 통해 주입됨

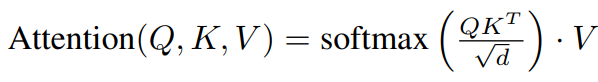

Cross-Attention 구조

결과적으로... 조건 y가 diffusion 과정의 중간에 주입되어 이미지 생성 흐름을 유도하게 됨

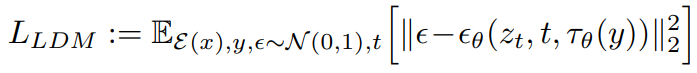

최종 학습 Loss (조건부 LDM)

- ϵθ: 조건 y까지 받아들이는 time-conditional UNet

- τθ: 입력 조건을 중간 표현으로 변환하는 모듈

학습 시 ϵθ와 τθ 동시에 최적화

이럴 경우,

- 다양한 modality(ex.text, layout 등)에 조건을 줄 수 있음

- 기존 text-to-image 모델처럼 Transformer를 도메인 인코더 τθ로 활용 가능

- 구조적 이미지 조건, 텍스트 조건 등 다양한 조건부 생성 모델 설계에 확장성 O

✅4. Experiments

LDM

: pixel 공간에서 직접 학습하는 기존 diffusion model에 비해 학습 및 추론 속도 모두에서 효율적

특히 VQ-regularized latent space에서 학습한 LDM

: autoencoder 복원 성능은 약간 떨어지지만 샘플 품질은 더 높게 나오는 경우도 있음

4.1. On Perceptual Compression Tradeoffs

LDM의 downsampling factor f (이미지를 latent로 압축할 때의 비율)가 성능에 어떤 영향을 미치는지 분석한 실험

- f=1: pixel 기반 diffusion model (LDM-1)을 의미

- f=2,4,8,16,32: 점점 더 압축하는 latent diffusion model 의미

결론적으로,

- 복잡한 데이터셋일수록 압축률은 너무 크면 안 됨...

- 전체적으로 LDM-4와 LDM-8이 가장 안정적이고 좋은 성능을 보임

4.2. Image Generation with Latent Diffusion

CelebA-HQ, FFHQ, LSUN-Churches, LSUN-Bedrooms에서 256×256 해상도 이미지에 대해 Unconditional 이미지 생성 성능 평가하는 실험.

결론적으로,

CelebA-HQ에서 FID 5.11 기록 → 기존 likelihood 기반 모델과 GAN 모두보다 우수

LDM은 적은 자원으로도 기존 GAN 및 diffusion 모델보다 더 나은 품질의 샘플 생성이 가능, 구현·학습 구조도 단순!

4.3. Conditional Latent Diffusion

4.3.1 Transformer Encoders for LDMs

Cross-Attention 기반 조건 입력을 통해 기존 diffusion 모델에서 다루지 못한 다양한 조건 입력 가능하게 함.

텍스트 조건 기반 이미지 생성 (Text-to-Image)

- 입력 문장은 BERT tokenizer로 처리, Transformer 기반 인코더(τθ)를 통해 UNet 내부에 Cross-Attention으로 삽입

-> 복잡한 사용자 텍스트 프롬프트에도 높은 일반화 능력 보여줌

OpenImages, COCO 데이터셋 기반으로 semantic layout → image 변환 실험도 수행

결론적으로,

성능은 향상되면서도 계산량과 파라미터 수는 현저히 적음

4.3.2 Convolutional Sampling Beyond 256^2

조건 정보(ex. semantic map, 텍스트 등)를 공간 정렬된 형태(spatially aligned)로latent input과 concatenate하여 입력하면,

LDM: 범용 image-to-image translation 모델로 사용 가능

256^2 해상도로 학습된 LDM도 고해상도(512×1024) 이미지 생성 가능함

특히 semantic map 기반 조건부 landscape 이미지 합성과 같은 공간 조건(spatial conditioning) 태스크에서 일반화 능력이 뛰어남

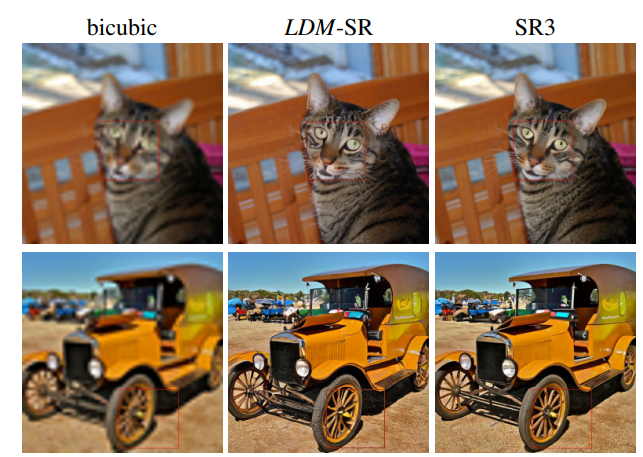

4.4. Super-Resolution with Latent Diffusion

낮은 해상도 이미지를 고해상도로 복원하는 Super-Resolution 작업에 LDM을 적용함

조건 입력 y = 저해상도 이미지

-> UNet 입력과 concatenate해서 조건부 학습 진행

두 모델이 서로 다른 장점을 가지고 있음. LDM은 질감 위주, SR3는 구조적 일관성 위주.

LDM

: 고품질 super-resolution 가능.

기존 SR3보다 FID 기준 우수, 사람 평가에서도 높은 선호도를 보임.

고정된 degradation뿐 아니라 일반화 가능한 모델도 제시함

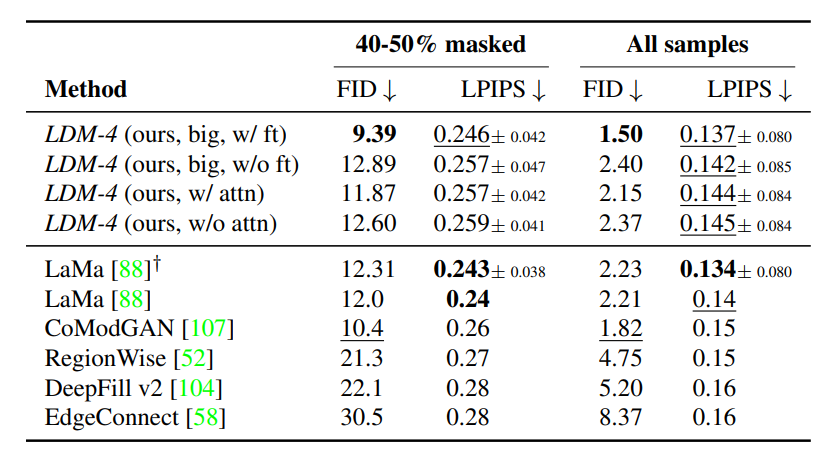

4.5. Inpainting with Latent Diffusion

Inpainting: 이미지에서 마스킹된 영역(손상 or 제거 대상)을 자연스럽게 복원하는 작업

범용 conditional LDM 접근이 이러한 특화 모델 대비 얼마나 효과적인지 실험

다른 inpainting 방식들과 비교한 결과(Lama 등), attention을 적용한 LDM이 FID 기준 더 나은 이미지 품질 보여줌.

글고LPIPS는 LDM이 Lama보다 약간 높음.

이유는 Lama가 단일 결과만 생성해 평균적인 복원 경향이 있는 반면, LDM은 다양한 결과를 생성하기 때문이라 설명.

✅5. Limitations & Societal Impact

Limitations

- LDM은 픽셀 기반 방식보다 연산 효율은 좋아졌지만, 샘플링이 순차적이라 여전히 GAN보다 느림.

- 고정밀도를 요구하는 작업에는 부적합할 수 있음.

ex. f=4의 autoencoding 모델은 품질 손실이 매우 적지만, 복원 정확도가 중요한 작업에서는 병목이 될 수 있음. - Super-resolution 모델도 이 부분에서 어느 정도 한계 있음.

Societal Impact

이미지 생성 모델이라는 것은 양면성 존재.

- 창작, 접근성 향상 등에 기여할 수 있음.

특히 LDM처럼 학습/추론 비용 낮추는 기술은 활용 장벽을 낮춰줄 수 있음.

반면,

- 조작 이미지, 가짜 뉴스 생성 및 유포의 악용 가능성도 있음.

특히 딥페이크 관련 문제 심각. - 생성 모델이 학습 데이터를 그대로 노출시킬 수 있다는 점도 문제.

특히 민감하거나 동의 없이 수집된 데이터라면 더 위험. - 딥러닝은 학습 데이터 내 편향을 그대로 복제하거나 강화하는 경향 존재.

Diffusion 모델은 GAN보다 분포를 더 잘 커버하지만, LDM처럼 adversarial과 likelihood 기반 학습을 결합한 구조가 어떤 편향을 발생시키는지는 추가 연구 必.

🔚6. Conclusion

Latent Diffusion Model(LDM)은 고품질을 유지하면서도 diffusion 모델의 학습 및 샘플링 효율을 크게 개선하는 간단하고 효과적인 방법!

제안한 cross-attention 기반 조건 부여 메커니즘을 통해,

별도의 태스크 특화 아키텍처 없이도 다양한 조건부 이미지 생성 과제에서 기존 최신 기법보다 우수한 성능을 보였음.