Parameter-Efficient Fine-Tuning (PEFT)은 모델의 모든 파라미터를 조정하지 않고, 특정 파라미터 집합만을 업데이트하여 모델을 튜닝하는 방법

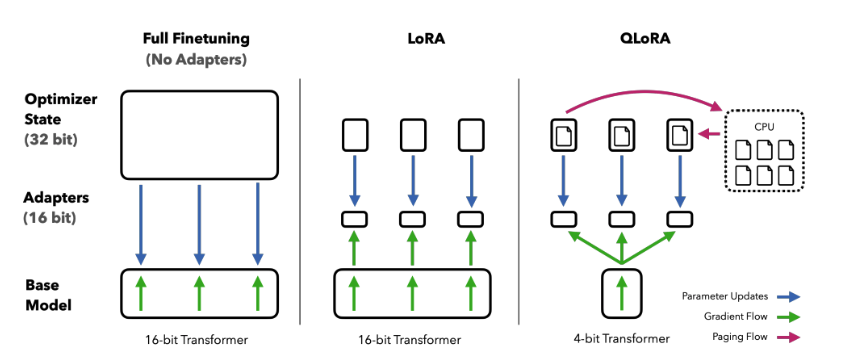

LoRA

- 마이크로소프트에서 발표한 기술

- Full Fine-Tuning은 돈과 시간이 너무소요됨

- 사전 훈련된 모델의 가중치 (Weight)는 고정시켜 놓고, 트랜스포머 아키텍처 각각의 계층에 훈련 가능한 행렬을 별도로 삽입해서, 다운스트림 과정에서 매개변수 수를 크게 줄이는 효과

- Full Fine - Tuning 에 비해 LoRa는 일괄적으로 바꾸기 때문에 유연성이 떨어짐

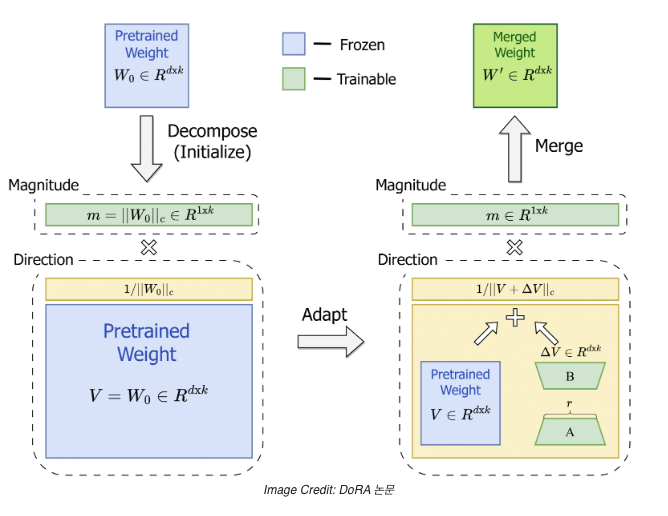

DoRA

- LoRA의 단점을 보안한 기술임으로 가중치를 분해해서, 가중치를 크기, 요소와방향 두분으로 나누어서 별도로 파인튜닝을 함

QLoRA

- ‘양자화 (Quantization) : 언어모델의 파라미터를 ‘실수형 (32비트 부동 소수)’에서 ‘정수형 (8비트 정수)’으로 바꿔서 비트 수를 줄이는 과정

- 메모리를 적게 사용하면서도, 일반적인 파인튜닝 방법에서 보여주는 수준의 성능을 유지하고, 속도 저하도 발생하지 않음

QDoRA

- 일률적으로 변경사항을 적용하는 QLoRA와 달리 좀 더 정밀하게 가중치를 조정하게해서 메모리효율성을 유지하면서 유연성 향상기법

참고자료

https://turingpost.co.kr/p/dora-qlora-qdora

https://ai.atsit.in/posts/1900838081/#google_vignette