경사하강법이란?

주어진 손실함수에서 모델의 파라미터의 최적의 값을 찾는 머신러닝과 딥러닝의 최적화 알고리즘 중 하나이다.

- 손실함수 : 신경망 모델의 예측 값과 실제 값 간의 차이를 측정하는 함수

- 모델 : 뉴럴 네트워크

- 파라미터 : 인공신경망을 구성하는 연결 가중치와 편향

손실함수

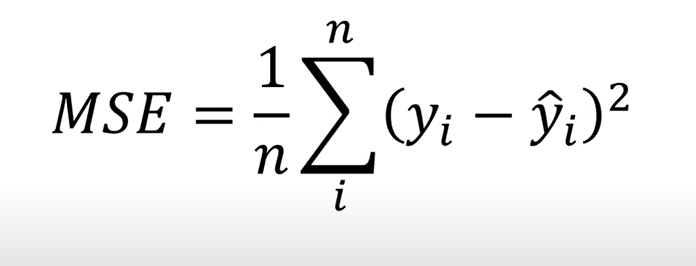

1. MSE(Mean Square Error)

MSE는 각 데이터들의 오차들의 제곱의 평균이다.

직관적으로 실제값과 예측값간의 차이들의 평균으로 생각하면 된다. 그렇기때문에 손실함수의 값이 작을수록 좋다!

2. MAE

MAE는 MSE의 공식에서 실제값과 예측값의 차이를 제곱하지않고 절대값을 씌운 함수이다.

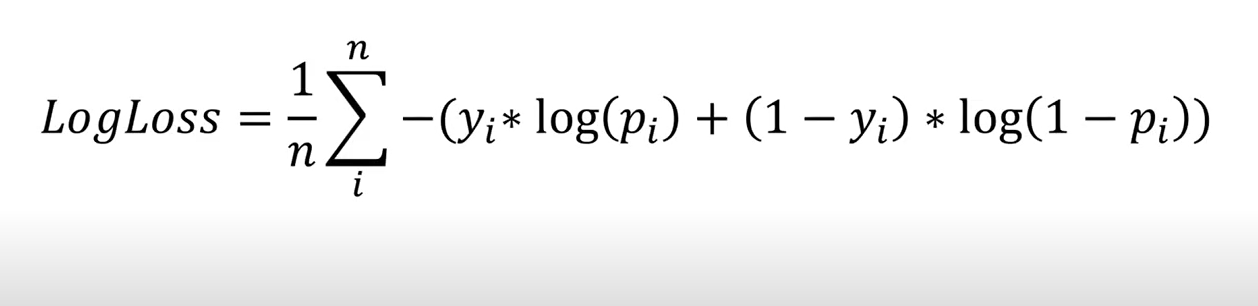

3. Cross Entropy(교차 엔트로피)

교차 엔트로피는 MSE에 비해서 학습속도가 빠르다는 장점이 있다.

경사하강법의 필요성

경사하강법의 필요 이유:

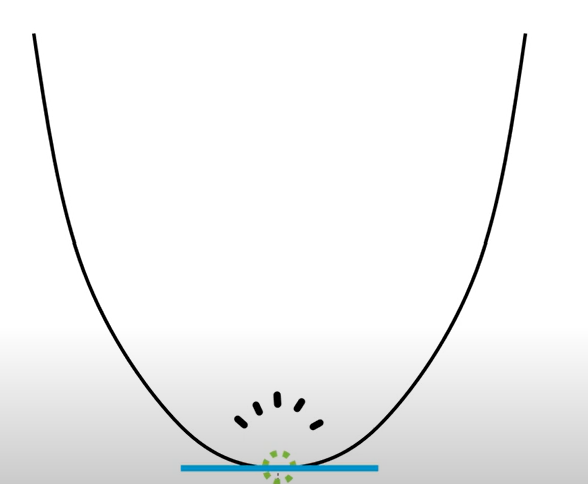

손실함수가 작으면 작을수록 실제값과의 오차가 줄어들어 좋기때문에 우리는 손실함수의 그래프에서 기울기가 0인 지점을 찾는 것이 아주 중요하다!

->이 손실함수의 그래프에서 기울기가 0이 되는 지점이 실제값과 예측값으 차이가 0인것을 알 수 있을 것이다 .

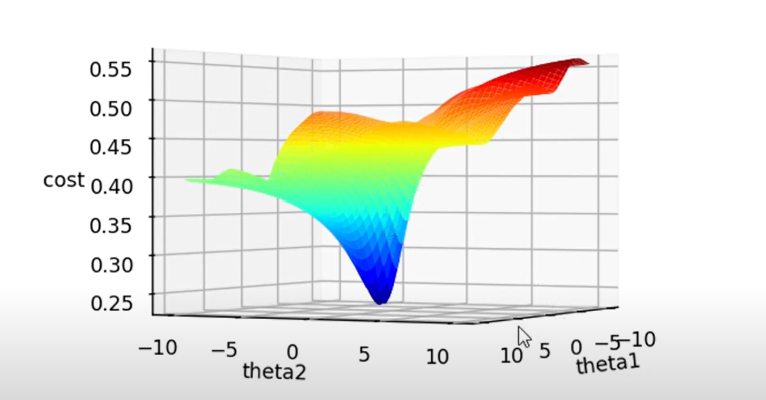

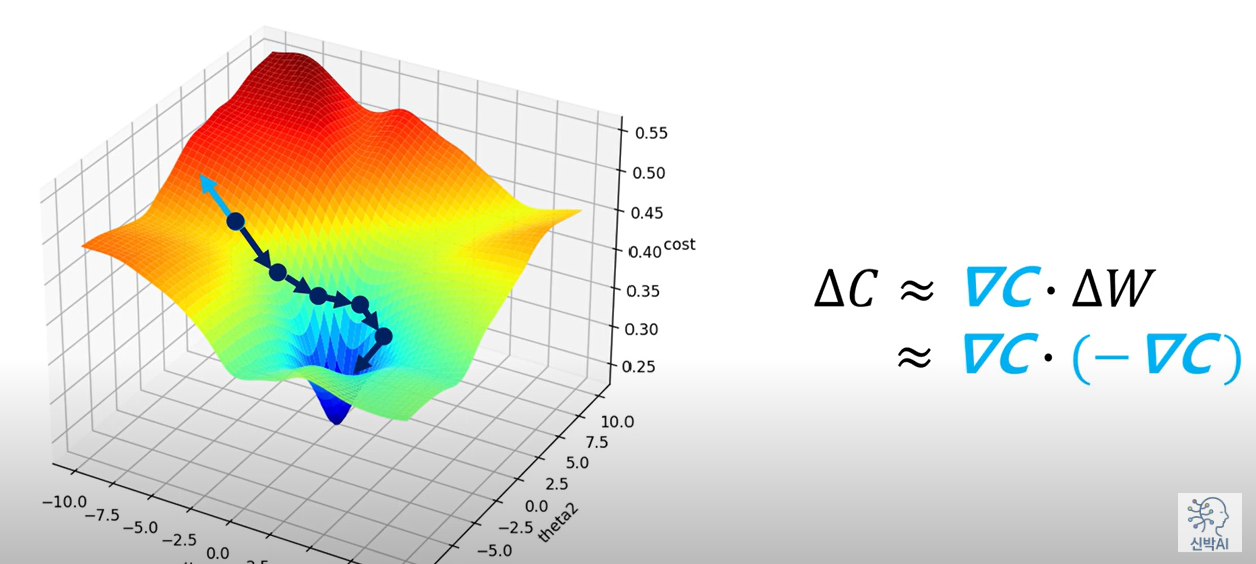

하지만 실제로 손실함수의 그래프는 위처럼 간단한 2차원 그래프가 아니다!

위 그래프는 입력값이 2개이고 시그모이드함수를 활성화 함수로하는 간단한 퍼셉트론의 MSE손실함수의 그래프 모습이다.

이처럼 복잡한 손실함수의 기울기가 0인 값을 구해가기 위해 경사하강법과 같은 알고리즘이 필요한 것이다!

경사하강법의 핵심

경사하강법을 이용한 가중치 학습법

- 퍼셉트론의 학습 방법:

새 연결강도 = 현 열결강도 + 현 입력값 X 오차 X 학습률- 경사 하강법을 이용한 가중치 학습법:

새 연결강도 = 현 연결강도 + 손실함수의 기울기의 변화량 X 습률 --> 즉 손실함수의 기울기가 클수록 연결강도의 변화량이 커진다!

결론

경사하강법은 손실함수의 최소값 즉 퍼셉트론의 모델을 최적으로 만들어가기 위해 필요한 알고리즘이다!

좋은 정보 감사합니다 :) 다음 포스트도 기대할게요 ^^;