1. 선형 회귀(Linear Regression)

- 입력과 출력 간의 관계를 파악하는 것

- 독립변수와 종속변수를 선형적 관계로 가정하고, 관계를 잘 나타내는 선형식 찾기

1) 단순 선형 회귀

- 독립변수: 1개

- 독립변수가 여러개: 다중 선형 회귀

- 입력과 출력을 선형으로 가정, 가설 yhat 중 데이터를 가장 잘 설명하는 직선 하나 찾기

2) 오차(손실)

-

오차: 가설과 정답(실제값)의 차이 ( 계산: |정답 - 가설| )

-

데이터를 가장 잘 나타내는 직선: 오차가 최소인 직선

-

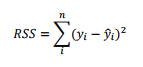

잔차 제곱 합(RSS)

-

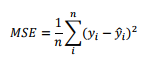

평균 제곱 오차(MSE)

: 선형 회귀의 손실 함수 -

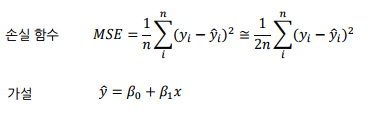

손실 함수(비용함수)

: 정답과 예측의 차이(Loss)를 계산하는 함수

-> 회귀 알고리즘: 손실함수가 최소가 되는 파라미터를 찾는 문제

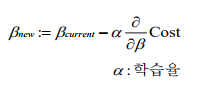

2. 경사 하강법

여러 종류의 문제에서 최적의 해법을 찾을 수 있는 최적화 알고리즘

-

비용함수를 최소화하기 위해 파라미터 반복 조정

-

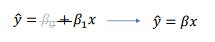

Beta에 대한 비용 계산

-

경사 하강법 과정

1) 임의 Beta 값에서 시작

2) 그 점에서 경사 구하기(미분)

3) 기울기의 반대방향으로 현재의 기울기의 크기에 비례한 만큼 빼기

- Cost: MSE 값

-

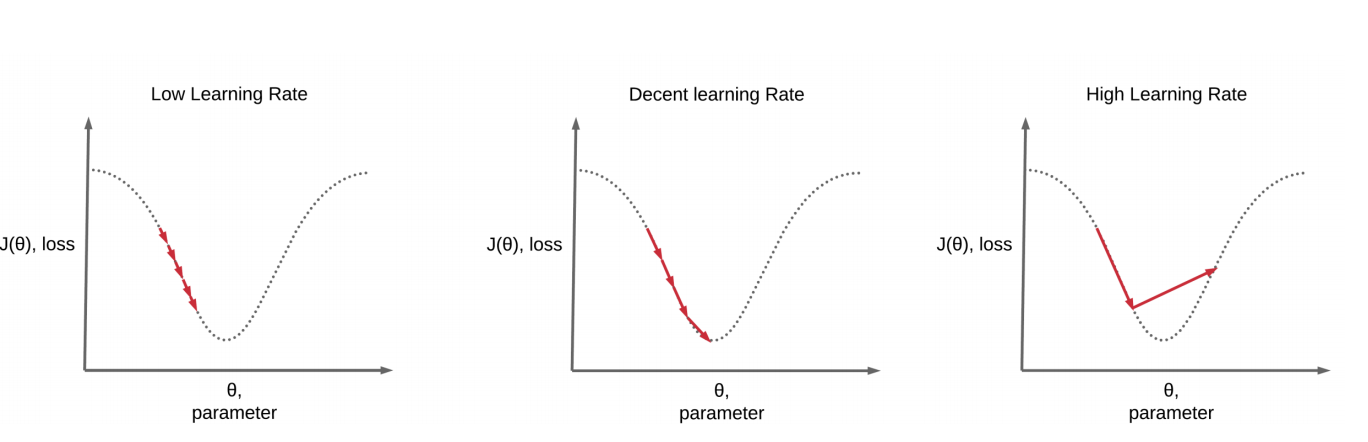

학습율 크기(alpha)에 따른 Loss

-

현실 세계의 손실 함수

: 지역 최솟값(local min) 존재

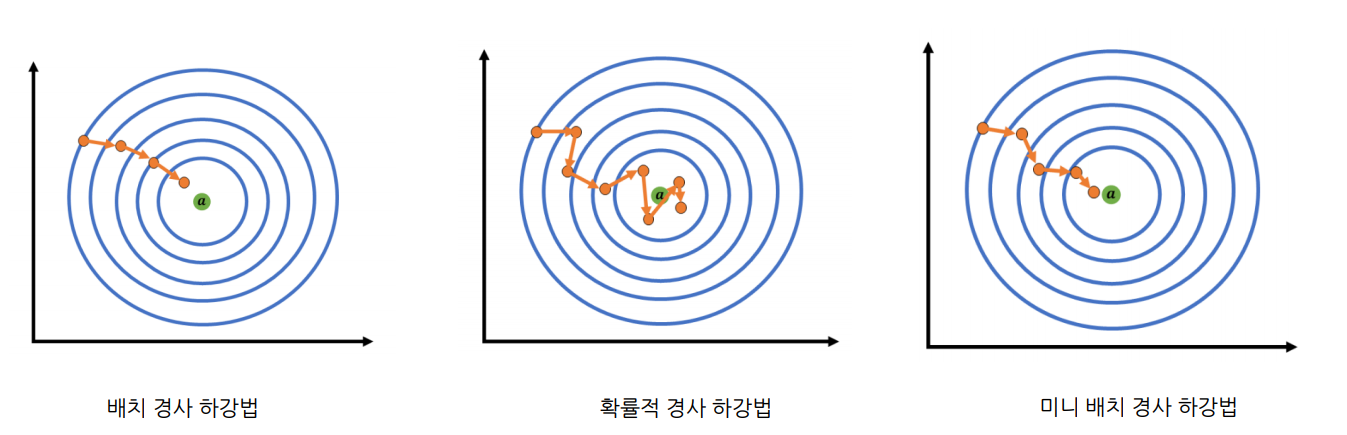

배치 경사 하강법

- 배치: 경사 하강법 1회에 사용되는 데이터 묶음

- 배치 크기 = 전체 학습 데이터: 배치 경사 하강법

- 배치 크기 = 1: 확률적 경사 하강법

- 배치 크기 = 사용자 지정: 미니 배치 경사 하강법 (주로 사용)

미니 배치 경사 하강법: 배치 경사 하강법보다 연산량이 적고, 확률적 경사 하강법보다 안정적으로 수렴

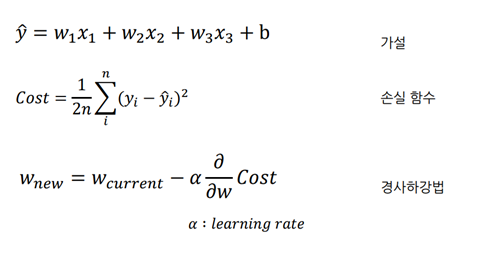

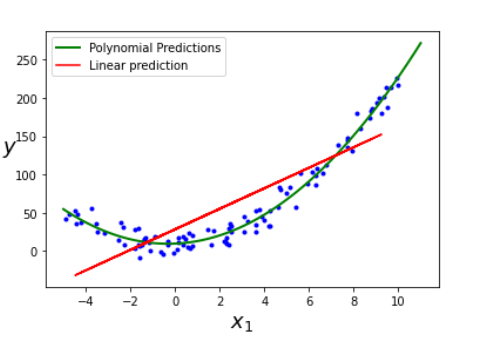

3. 다중 회귀 & 다항 회귀

1) 다중 선형 회귀

- 독립 변수가 여러 개인 선형회귀 모델

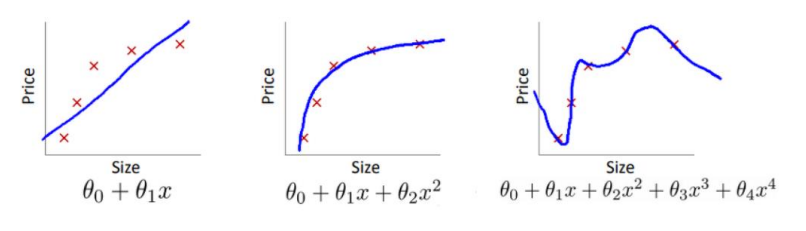

2) 다항 회귀(Polynomial Regression)

- 데이터가 단순한 직선이 아닌 경우 사용

- 데이터에 각 특성의 거듭제곱을 새로운 특성으로 추가하고, 선형 모델로 학습

4. 규제

- 고차 다항 회귀를 이용하면 과적합 가능성 증가

-> 모델의 규제로 다항식의 차수 줄이기(ex. 고차항의 계수를 0으로)

- 종류: 릿지(Ridge, L2) 규제, 라소(Lasso, L1) 규제

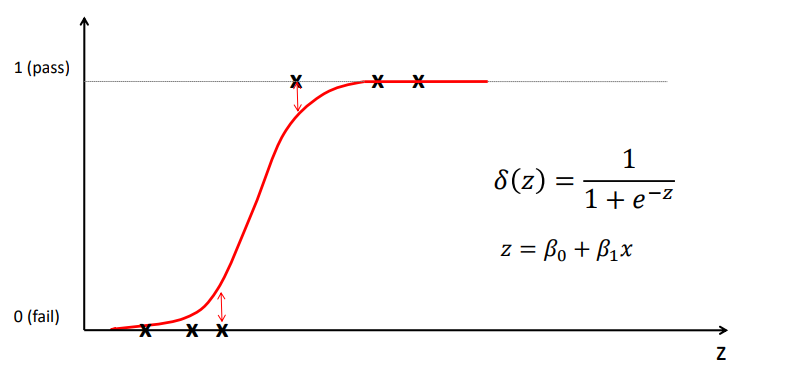

5. 로지스틱 회귀

- 분류에 사용

- 입력 특성치의 가중치 합 계산(-> 결과값의 로지스틱 출력)

- 확률로 해석

1) 시그모이드 함수

- Beta0, Beta1 값에 따라 그래프 위치, 모양 변함

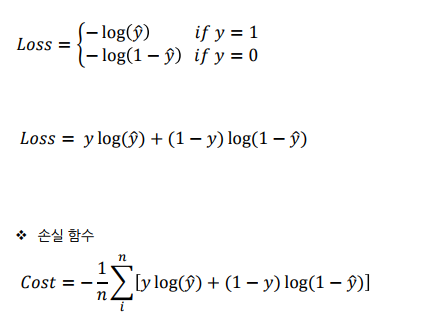

2) Cost Function

- 정답과 예측값의 차이에 비례해서 값을 반환(정답과 가까우면 작은 값, 멀면 큰 값)

- 학습을 통해, 비용 함수가 최소가 되는 파라미터 찾기

- 손실 함수: Binary Cross Entropy 사용

- 최적화 방법: 경사 하강법 사용

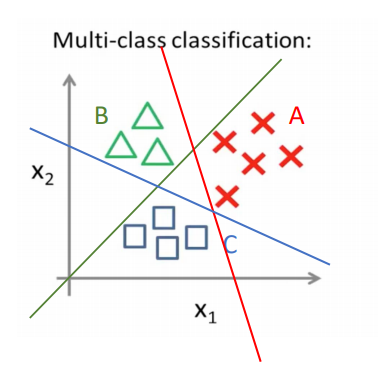

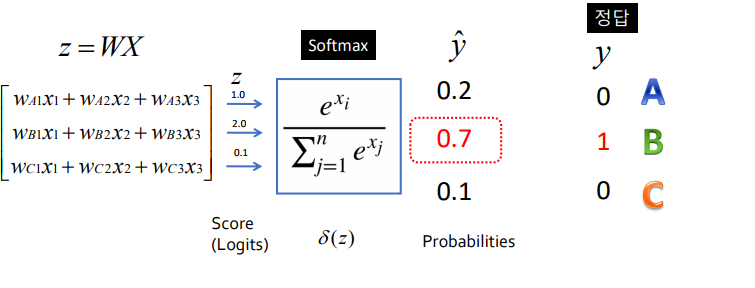

6. 다중 분류

여러개의 이진 분류기

-

Sigmoid 함수 대신 Softmax 사용(전체 확률의 합이 1이 되도록)

-

손실 함수: Categorical Cross Entropy

-

최적화: 경사 하강법 사용