📝 Ensemble Learning 소개

개념의 유래

- 대중의 지혜 (집단 지성)

- 무작위로 선택된 수천 명의 사람의 답이 한 명의 전문가의 답보다 좋은 경우들이 많다.

- 일련의 분류나 회귀 모델로부터 예측을 수집하면 가장 좋은 모델 하나보다 더 좋은 예측 성능을 얻을 수 있다.

- 일반적으로 다양한 머신러닝 기법들을 Ensemble 시켜주면 성능 향상

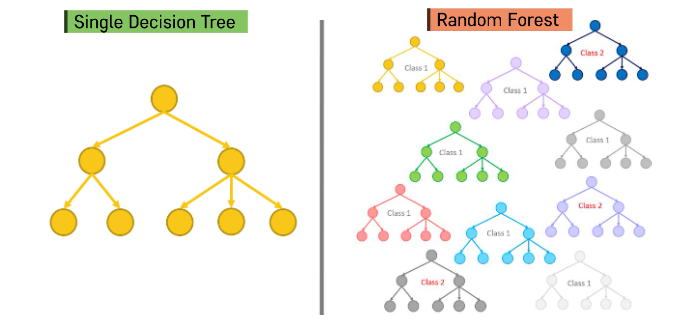

✏️ Random Forest

- Decision Tree의 Ensemble

- Robust하고 좋은 예측 성능을 보인다.

- 여러 개의 트리

- 각 모형의 결과물을 모아서 다수결 방식 또는 가중합 방식 적용

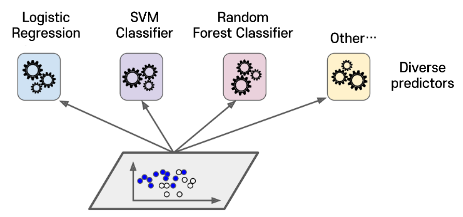

✏️ 투표 기반 분류기

- 다수결 투표 기반 예측

- 여러 가지 방식으로 학습한 후 다수결로 결정

📝 Ensemble Learning 이론

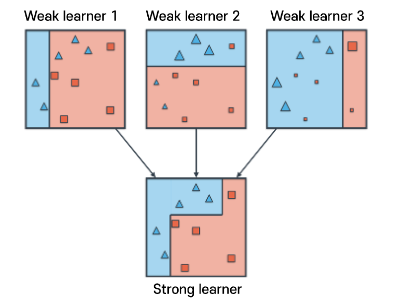

Weeak Learner & Strong Learner

-

다수결 투표 분류기: 앙상블에 포함된 개별 분류기 중 가장 뛰어난 것보다도 정확도가 높을 경우가 많다.

-

weak learner: 랜덤 추측보다 조금 더 높은 성능을 내는 분류기

-

각 분류기가 weak learner일지라도 충분히 많고 다양하다면 앙상블은 string learner가 될 수 있다.

-

Ensemble할 때 다양한 분류기를 만드는 것이 중요

① 각기 다른 훈련 알고리즘 적용

② Training 데이터의 서브셋을 무작위로 구성하여 분류기를 각기 다르게 학습 -

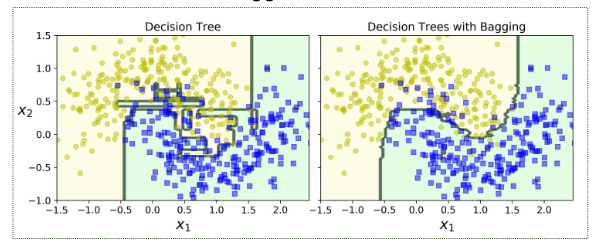

Bagging (Bootstrap aggregating)

: Training 데이터에서 중복을 허용하여 샘플링하는 방식 -

Pasting: 중복을 허용하지 않고 샘플링하는 방식