딥러닝 벼락치기, , 시간이 얼마 남지 않았다.

출처

Multiple linear regression

multiple 이라는 이름에서도 알 수 있듯 다양한 variable(type)이 있는 linear regression을 의미한다(고차원).

대부분의 문제는 보통 다 MLR 형태이다.

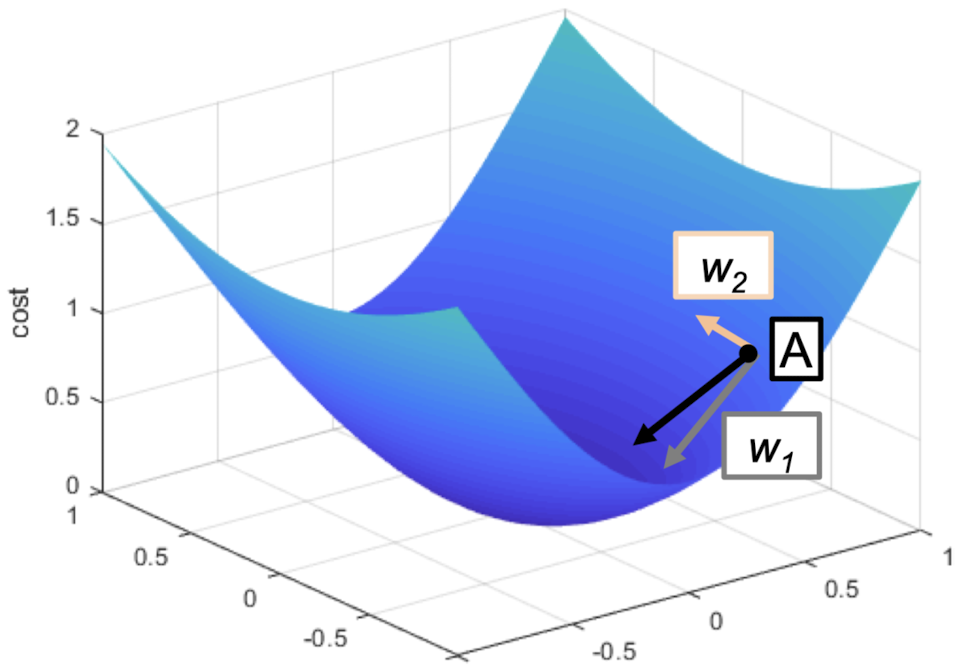

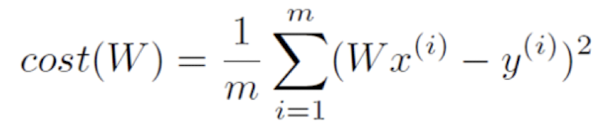

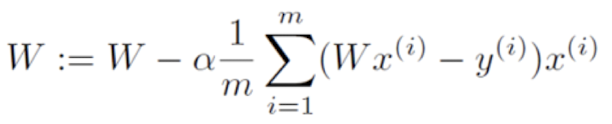

Optimization

그렇담 MLR은 gradient descent를 적용하는 방식이 좀 다른 것일까??

당연히 아니다!

그냥 고차원이 되었을 뿐, 방식은 똑같다.

하지만 살짝 다른 부분이 있다.

위의 그림을 보면 알 수 있지만 w가 하나뿐인 linear regresssion과 달리 A라는 점의 derivative는 각 축을 기준으로 나눠진다.

w 값이 몇개씩 나온다는 뜻이다.

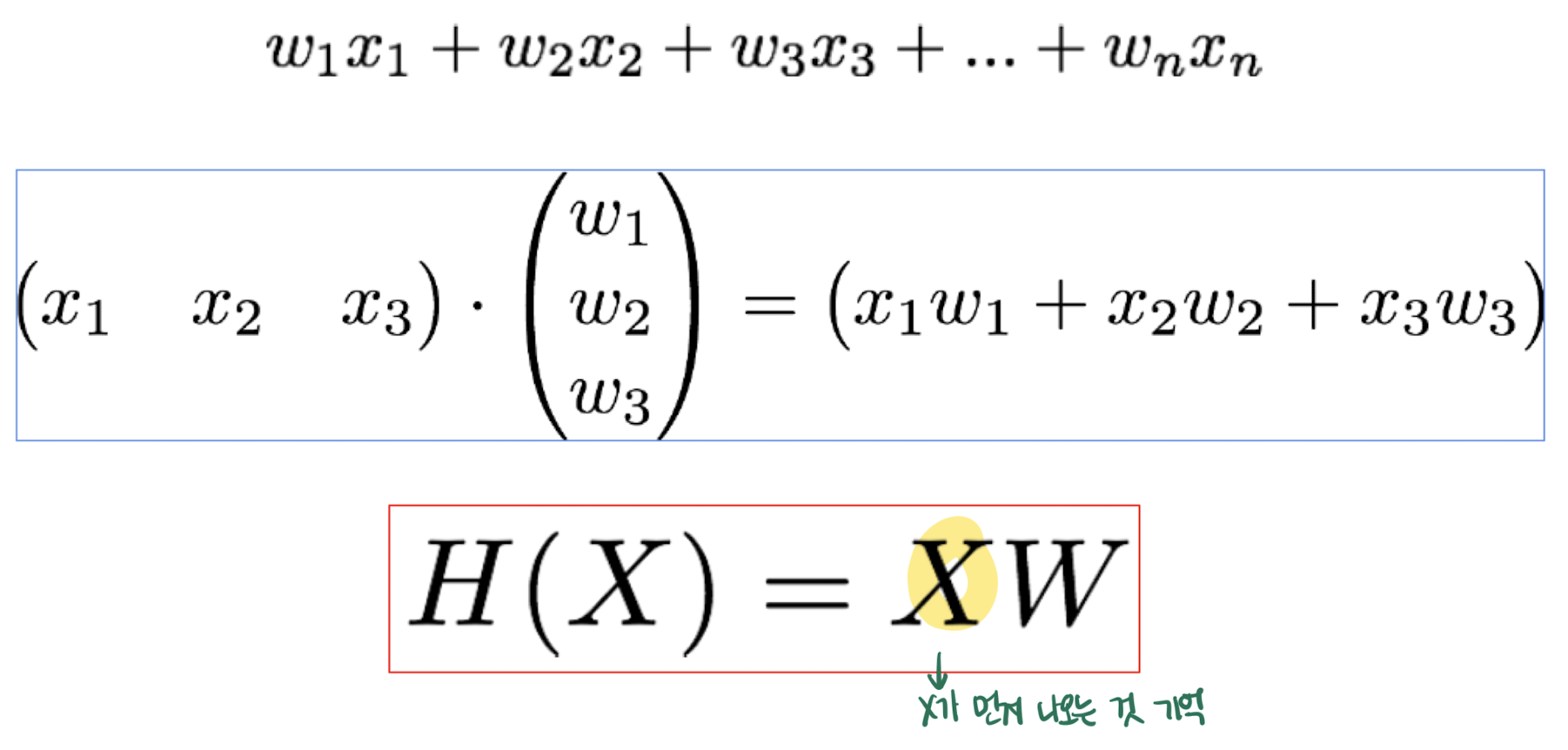

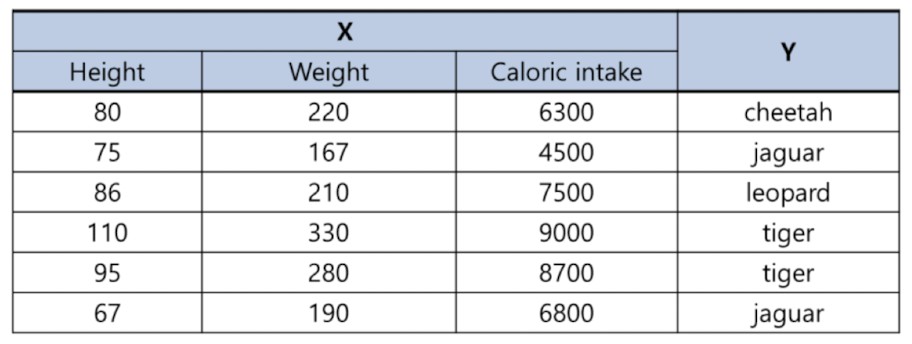

matirx representation

matrix를 이용해 hypothesis를 나타내는 방식에 대해 설명할 것이다.

사실 난 matrix 연산을 잘 못한다. 그래서 왜 X가 앞에 나오는지는 잘..

아무튼 이 방식이면 x와 y값을 이용해 w값을 구할 수 있다.

Logistic regression and classification

Linear regression은 직선으로 나타내어지는 값만을 분류한다는 한계점이 존재한다.

만약 0, 1을 나타내고 싶다면?? 결과값이 선형분포가 아니라면!! 문제가 생긴다는 것이다.

따라서 sigmoid function과 같이 data distribution에 fit할 수 있는 logistic regression function의 중요성이 대두된다.

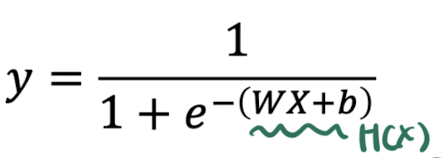

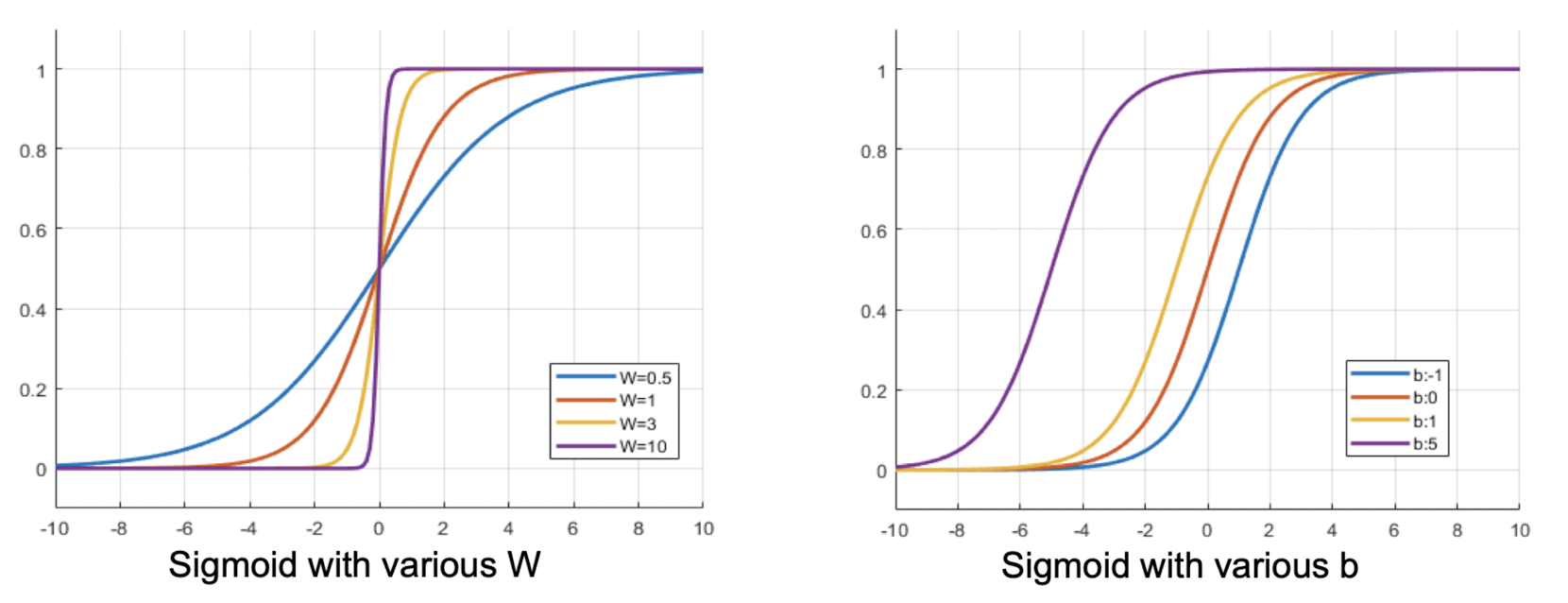

sigmoid function

logistic function에도 여러 종류가 있지만 일단은 sigmoid부터 알아보자!

sigmoid 함수의 공식이다.

우리의 목표는?? linear regression과 동일하게 최적의 w,b 값을 찾는 것이다. methodology는 같단 의미이다.

사진에서 확인할 수 있지만 w는 linear regression과 동일하게 기울기가 바뀌고, b는 선의 위치가 변경된다.

순서

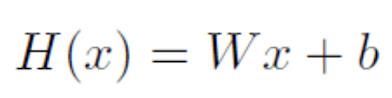

Linear regression

-

define hypothesis

-

define cost function

-

Find parameters that minimize the cost function using gradient descent method.

Logistic regression

위에서 계속 linear regression과 methodology가 동일하다고 했었다.

그렇다면 방식도 똑같지 않을까?? 싶지만,,,

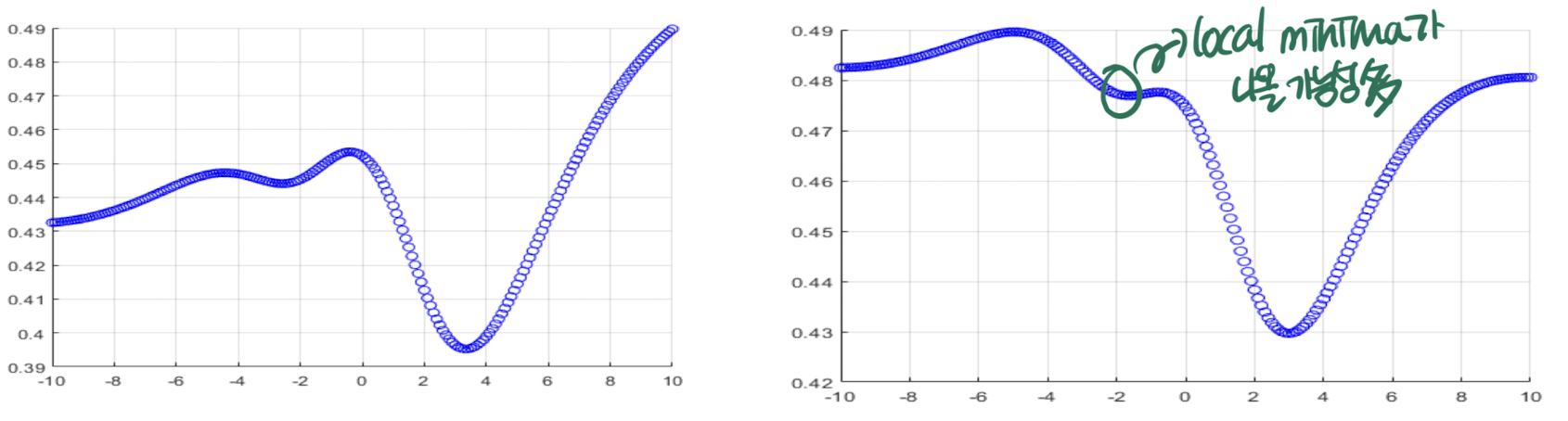

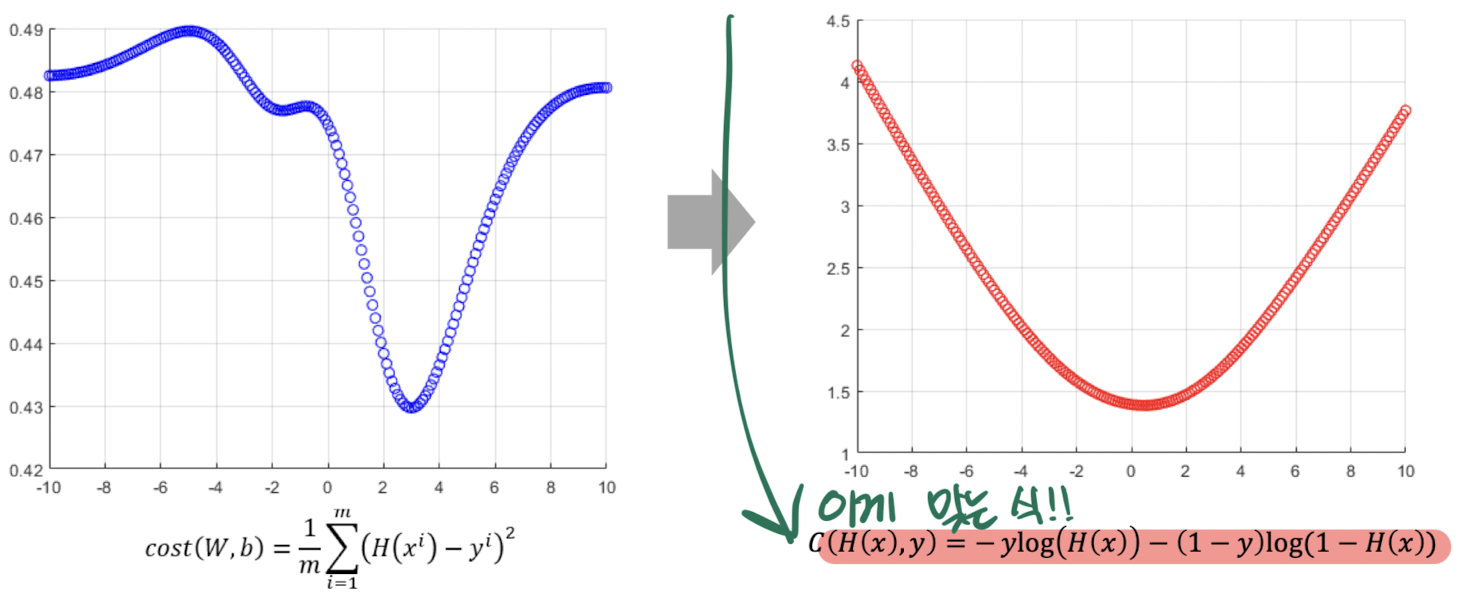

rogistic regression의 자연상수 e는 그래프를 구불구불하게 만드는 성질이 존재해, Non-convex 그래프를 만들어낸다.

이렇게되면 gradient descent의 최대의 단점 local minima에 빠지게 된다.

그렇게 되어서 우리가 찾은 대안은!!

new cost function을 찾아내는 것!!!

갑자기 마음이 편안해졌다.

이제 우린 linear regression과 동일하게 gradient descent를 적용할 수 있게 되었다.

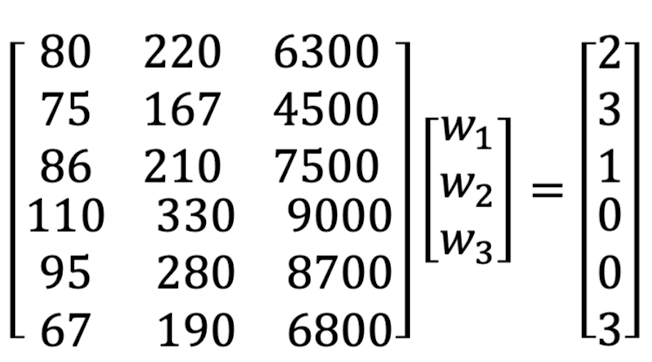

Multi-class Classification (Multi-class logistic regression)

정확한 개념은 다음 글에서 설명하고 그 전에 예시를 들어보겠다.

위와 같은 분류 테이블이 있다.

치타는 2, 재규어는 3, 레오파드는 1, 타이거는 0으로 정의했을 때, 아래의 Hypothesis가 맞을까?

답은...

당연히 아니다!!!

너무 당연한 질문과 답이었길 바란다 ㅎㅎ

위의 식대로 풀이를 하게 되면, 들어온 x값에 따라 결과값이 정수가 아닐 수도 있다.

근데 이건 classification 문제이다. 그렇게 값이 나온다면 분류를 할 수 없다.

단편적인 예시로 0.5는 레오파드인가 타이거인가? 대답할 수 없을 것이다.

따라서 우리는 결과값을 0과 1로 정의한다! 이렇게 되면 logistic regression의 개념을 차용하여 multiple logistic regression이 만들어 질 것이다.

빨간색으로 표시해둔 weight는 분류를 해주는 주체이기 때문에 classifier라고 부를 수 있겠다.

.jpeg)